EGD-Net:面向高光谱混合噪声去除的特征图引导扩散网络-JSTARS2025

EGD-Net: Eigenimage Guided Diffusion Network for Hyperspectral Mixed Noise Removal

期刊:IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing

论文链接:EGD-Net:用于高光谱混合噪声去除的特征影像引导扩散网络 |IEEE期刊与杂志 |IEEE Xplore

年份:2025

关键词:高光谱图像去噪,扩散模型

创新点:

创新点:

1.将扩散模型引入高光谱子空间域,面向特征图(eigenimage)进行混合噪声去除。

作者没有直接在原始高光谱图像上做扩散,而是先利用高光谱图像的低维子空间特性,把原始数据表示成少量特征图,从而降低高维高光谱数据带来的计算负担。与此同时,论文指出投影到子空间后噪声会变得更稠密、更复杂,因此需要专门面向子空间图像设计去噪方法。

2.提出 general guided diffusion model,用主导特征图引导其余特征图恢复。

传统 DDPM 前向过程一般是向干净图像逐步加入高斯噪声,而本文不是简单加纯高斯噪声,而是让干净特征图在扩散过程中逐渐向对应的带噪特征图靠近。与此同时,第 1 个质量较高的 noisy eigenimage 被用作 guide image,引导其他更难恢复的特征图学习空间纹理和结构信息,因此模型能够更自然地处理高斯噪声与条带噪声并存的混合噪声。

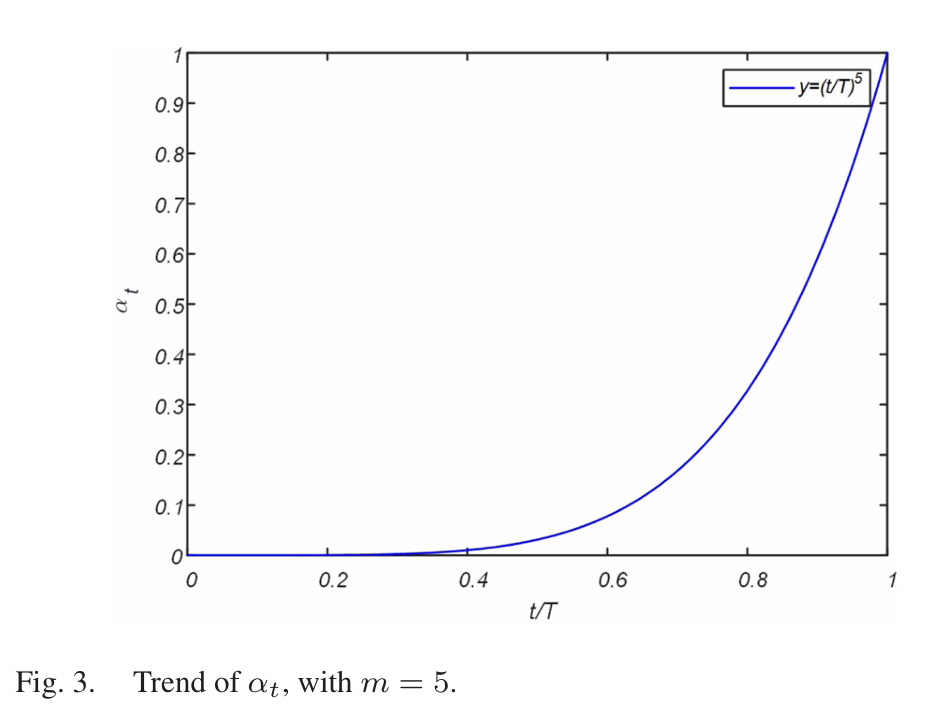

3.设计了基于幂函数的非线性前向扩散策略,并结合一步反演提高推理效率。

论文提出的扩散权重采用统一的幂函数形式 αt=(t/T)m\alpha_t=(t/T)^mαt=(t/T)m,既可以表示线性扩散,也可以表示非线性扩散。实验表明合适的非线性扩散设置能获得更好的性能。此外,推理阶段并不是从随机噪声逐步采样,而是从 guided noisy eigenimage 直接进行 one-step sampling 恢复干净特征图,从而减少推理耗时。

方法简介:EGD-Net 是一种面向高光谱混合噪声去除的方法,主要针对高斯噪声与条带噪声同时存在的情况。该方法首先利用高光谱图像的低维子空间特性,将原始高光谱数据投影为少量 eigenimages,以降低计算复杂度;随后在 eigenimage 域中设计引导式扩散模型,用高质量主导 eigenimage 作为引导,将干净 eigenimage 与对应 noisy eigenimage 的加权组合作为扩散过程中的中间状态,从而学习更贴近真实混合噪声的去噪映射;最后,通过训练好的网络对 noisy eigenimages 进行一步恢复,并结合子空间基重建出最终去噪后的高光谱图像。该方法兼顾了混合噪声建模能力与计算效率,在模拟数据和真实数据上都取得了较好的去噪效果。

一句话概括这篇文章的核心思想就是:

先把高光谱图像降到低维子空间中,再在特征图域里设计更贴近真实混合噪声分布的引导扩散模型,以实现更高效、更鲁棒的高光谱混合噪声去除。

一、子空间表示:为什么先转到 eigenimage 域?

高光谱图像可以表示为一个三维张量,空间上有行和列,光谱上有多个波段。由于高光谱各波段之间通常具有较强相关性,因此其光谱向量往往落在一个低维子空间中。基于这一性质,论文将干净高光谱图像表示为:

其中,E 是光谱子空间基,Z 是低维系数立方体,而 Z 的每一个通道就对应一张 eigenimage。

这样做有两个直接好处:

- 能够降低高光谱图像的维度,减少扩散模型在高维数据上的计算代价;

- 能在一定程度上保留高光谱图像的主要信息和结构特征。

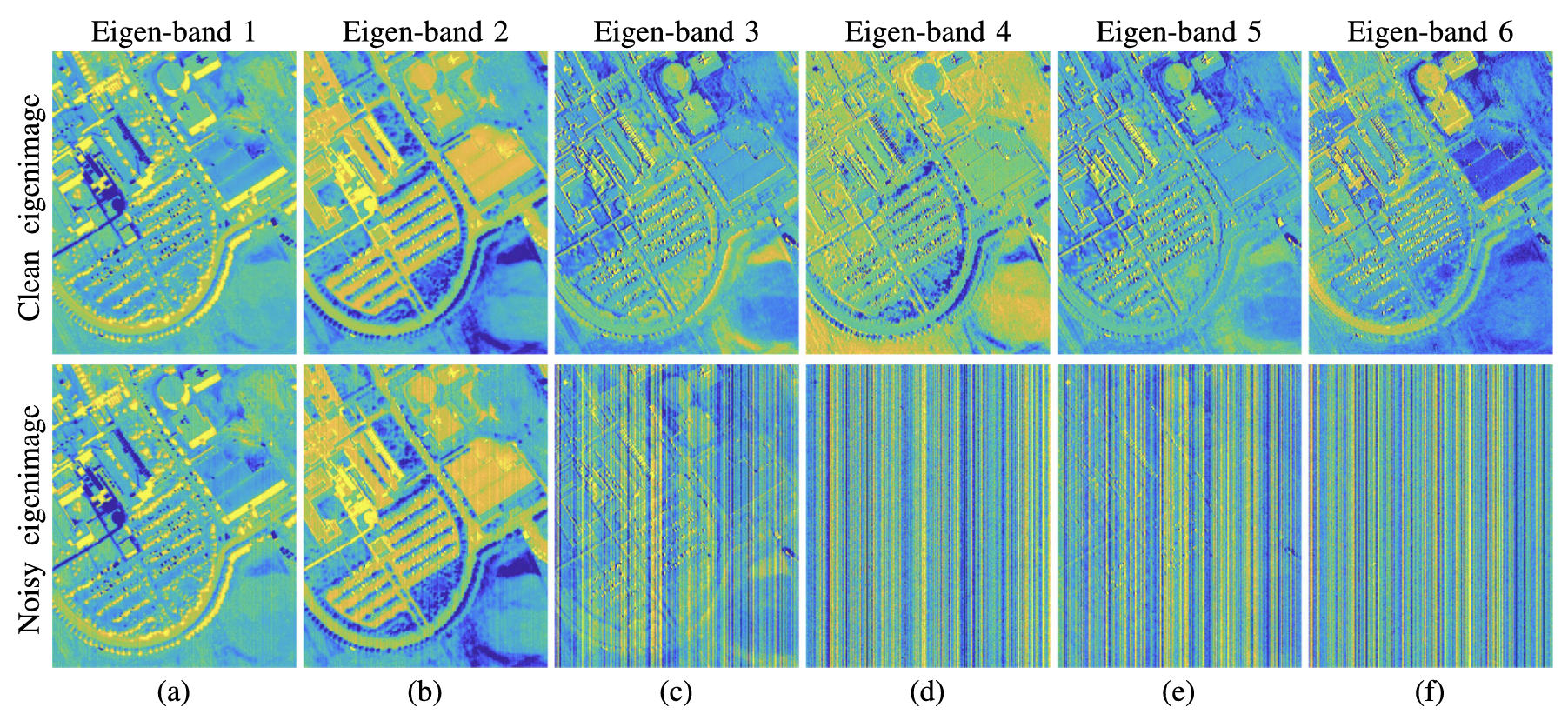

但问题也随之而来。论文通过示意图展示了一个非常关键的现象:原始图像中的混合噪声在投影到子空间后,会变得更加稠密和复杂。尤其是条带噪声,在某些 eigenimage 中会变得非常明显,甚至超过 60% 的 eigenimages 都表现出 dense noise 特性。也就是说,子空间虽然让维度降下来了,但并没有让问题变简单,反而提出了新的挑战。

二、General Guided Diffusion Model:怎么把扩散模型用在混合噪声去除上?

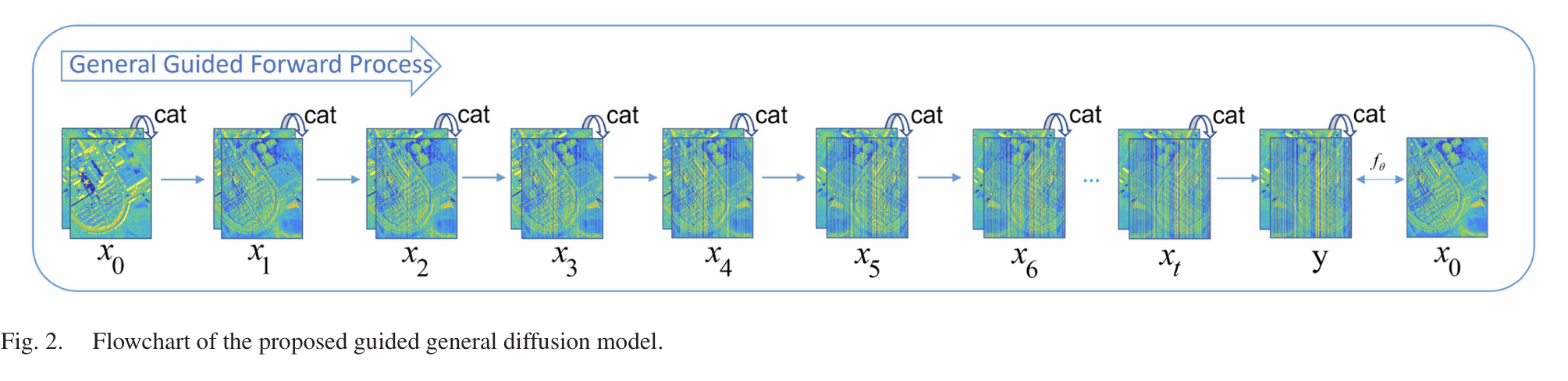

这篇文章最核心的地方,就是它提出的 general guided diffusion model。

传统 DDPM 的前向过程是:

从干净图像出发,逐步加入高斯噪声,最后得到近似纯噪声图像。

但这套设定更适合图像生成任务,不太适合真实去噪任务,尤其不适合高光谱中的条带噪声这种结构化噪声。

EGD-Net 的思路不一样。它在训练时,并不是让干净图像一步步变成随机高斯噪声,而是让:

- 干净 eigenimage

- 对应的 noisy eigenimage

按照权重 αt进行加权融合,形成中间时刻的 noisy guided eigenimage:

这里 是第 i个干净 eigenimage,

是第 i个 noisy eigenimage,而

作为 guide image,与当前特征图一起拼接输入网络。

直观来说,这里学到的不是“从纯高斯噪声恢复干净图像”,而是:

从真实混合噪声污染后的特征图恢复到干净特征图。

这也是为什么这篇文章能够有效处理高斯噪声和条带噪声并存的原因。

三、主导特征图引导:为什么要用第一个 eigenimage 做 guide image?

论文中一个很有意思的设计是:用第一个 noisy eigenimage 作为 guide image。

作者认为,第一个 eigenimage 往往具有更高质量的空间信息,因此它可以作为一种“引导”,帮助网络恢复其他受噪声污染更严重的特征图。

简单理解就是:

- 有些 eigenimage 被条带噪声严重污染,纹理都快看不出来了;

- 这时如果只靠自己恢复,会很困难;

- 但如果旁边有一张结构更清晰的 guide image,一起送进网络,模型就更容易区分哪些是结构,哪些是噪声。

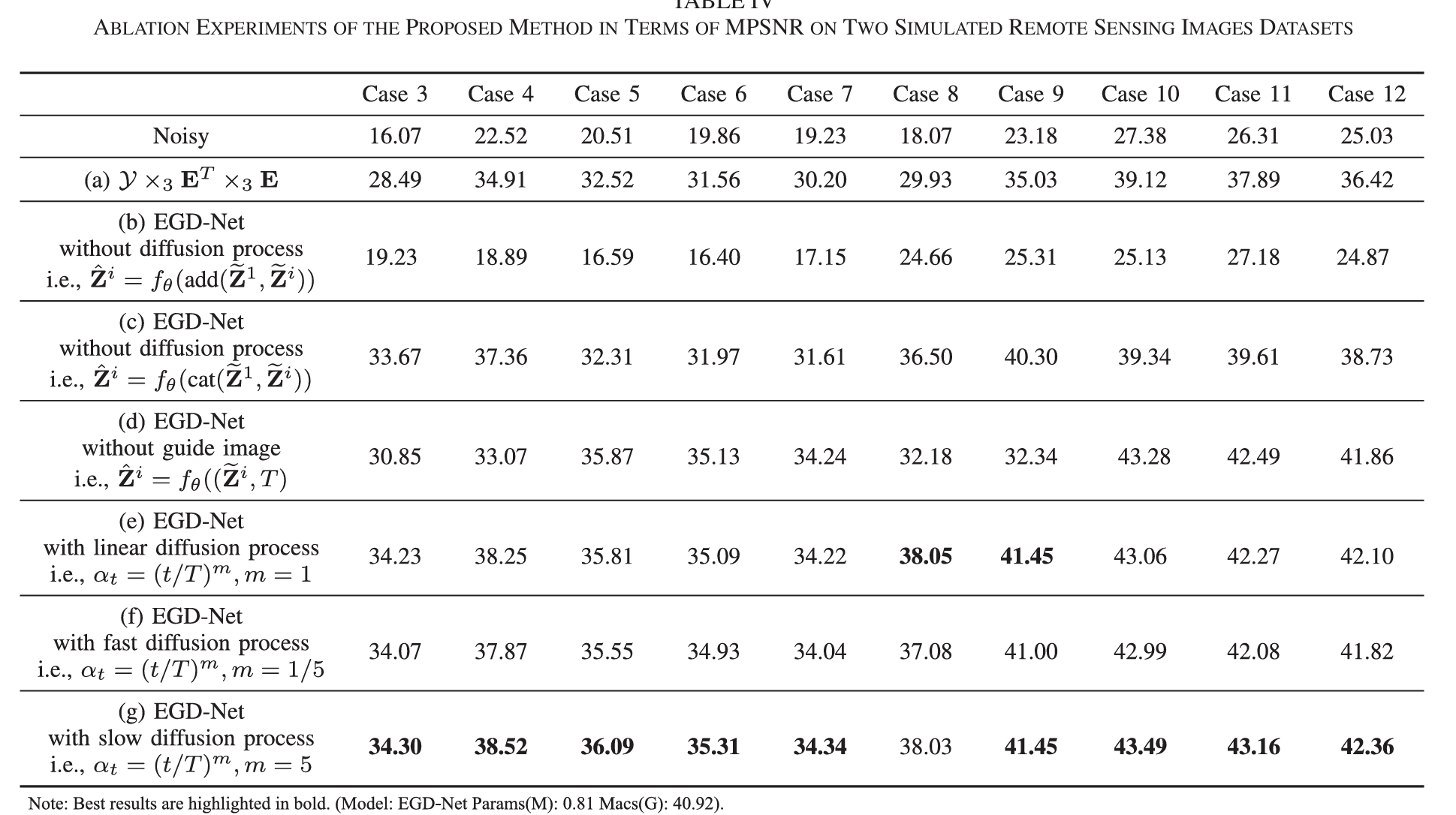

从论文的消融实验也能看出来:带 guide image 的版本明显优于不带 guide image 的版本。 第 12 页 Table IV 中,使用 guide image 的若干设置整体优于不使用 guide image 的设置。

四、非线性扩散策略:为什么不是普通线性噪声调度?

为了控制不同时间步下中间状态的噪声程度,作者设计了一个基于幂函数的非线性权重:

其中 T是总扩散步数,m 用来控制扩散曲线的形状。

这个设计的好处在于:

- 当 m=1 时,对应线性扩散;

- 当 m≠1 时,可以得到不同形式的非线性扩散;

- 在同一个统一公式下,就能兼顾不同扩散节奏。

论文中的消融实验比较了不同 mmm 取值的效果,包括 m=1、m=1/5 和 m=5。结果显示,m=5 在大多数实验场景下效果最好。

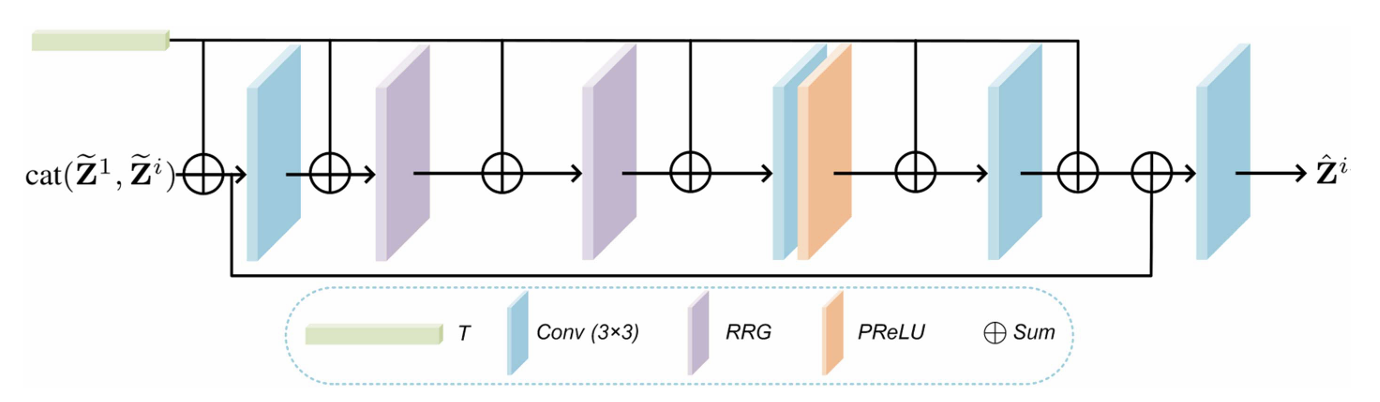

五、网络结构:EGD-Net 长什么样?

网络本身是一个带时间嵌入的增强型 ResNet。输入包含两部分:

- 当前时间步下的 noisy guided eigenimage;

- 当前时间步 t。

整体结构并不算特别庞大,主要由若干层卷积、递归残差组(RRG)、通道注意力和空间注意力模块构成。网络最后输出的是恢复后的干净 eigenimage。

训练损失采用:

其中 Gaussian noise 模型采用 L2损失,mixed noise 模型采用 L1损失。作者解释说,L1更适合混合噪声,因为它更有利于学习稀疏结构,而条带噪声恰恰属于比较典型的结构化噪声。

六、推理阶段:为什么它推理更快?

扩散模型最常被吐槽的一点就是:推理慢。

因为传统扩散模型往往要从随机噪声开始,经过很多步反向采样,才能最终得到结果。

EGD-Net 在推理阶段没有走这条老路,而是直接从 noisy eigenimages 出发,做 one-step sampling:

也就是说,它直接把真实 noisy eigenimage 送入网络,在一步中恢复出 clean eigenimage,再结合子空间基 E 重建出最终高光谱图像:

这样既保留了扩散建模带来的鲁棒性,又显著减小了推理时间。

总结

EGD-Net 是一篇很典型的“把扩散模型做任务化改造”的文章。它不是直接把标准 diffusion 套到高光谱去噪上,而是结合高光谱图像的低维子空间结构、eigenimage 表示方式以及混合噪声的特点,重新设计了一个面向实际任务的 guided diffusion 框架。

整体来看,这篇文章的核心贡献可以概括为三点:

- 在子空间特征图域中做扩散去噪,降低高光谱高维建模的复杂度;

- 通过主导特征图引导和 clean/noisy eigenimage 加权融合,使扩散过程更贴近真实混合噪声;

- 利用非线性扩散和一步反演,在保证性能的同时兼顾推理效率。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)