第8节:vLLM深度剖析【从框架对比到性能优化与未来展望】

前言

随着大语言模型(LLM)的广泛应用,高效推理框架成为AI落地的关键。vLLM作为当前最受欢迎的开源推理引擎,凭借其创新的PagedAttention技术和卓越的性能表现,在众多框架中脱颖而出。本文将从三个维度全面解析vLLM:首先对比主流推理框架的技术特性与性能表现;其次深入探讨vLLM在实际部署中的常见问题与解决方案;最后展望vLLM的技术发展趋势与行业应用前景。文章包含大量可运行的代码示例和详细注释,旨在为开发者提供从理论到实践的完整指导。

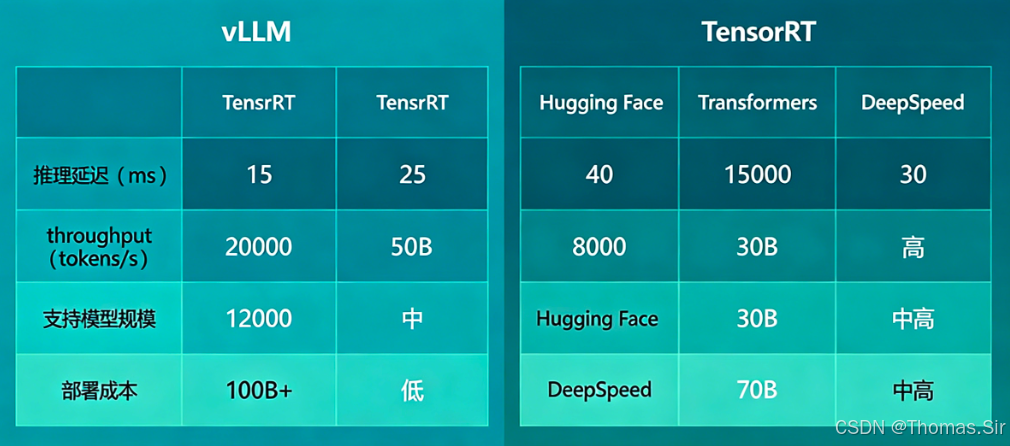

一、vLLM与其他推理框架对比

1.1 主流推理框架简介

在大语言模型推理领域,多个框架各有特色。以下是当前主流的五大推理框架:

Hugging Face Transformers(基线框架)

作为最广泛使用的NLP库,Transformers提供了完整的模型加载、训练和推理接口。虽然其推理性能不是最优,但作为功能最全、生态最完善的框架,常被作为性能对比的基线。

# Hugging Face Transformers 基础推理示例

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# 加载模型和分词器

model_name = "Qwen/Qwen2.5-7B-Instruct"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype=torch.float16,

device_map="auto"

)

# 基础推理

prompt = "请解释什么是机器学习"

inputs = tokenizer(prompt, return_tensors="pt").to("cuda")

outputs = model.generate(**inputs, max_new_tokens=100)

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(f"Transformers响应: {response}")

Text Generation Inference(TGI)

由Hugging Face开发,专注于生产环境的大模型推理服务。TGI支持连续批处理、张量并行等高级特性,在吞吐量方面表现优异。

# TGI客户端调用示例(需先启动TGI服务)

import requests

import json

# TGI服务端点

TGI_ENDPOINT = "http://localhost:8080/generate"

# 请求参数

payload = {

"inputs": "请解释什么是深度学习",

"parameters": {

"max_new_tokens": 100,

"temperature": 0.7,

"top_p": 0.9

}

}

# 发送请求

response = requests.post(TGI_ENDPOINT, json=payload)

if response.status_code == 200:

result = response.json()

print(f"TGI响应: {result['generated_text']}")

else:

print(f"请求失败: {response.status_code}")

Triton Inference Server

NVIDIA推出的高性能推理服务平台,支持多种框架和硬件。Triton以其卓越的吞吐量和低延迟著称,特别适合企业级部署。

# Triton客户端示例(需配置Triton服务)

import tritonclient.http as httpclient

# 创建Triton客户端

triton_client = httpclient.InferenceServerClient(url="localhost:8000")

# 准备输入数据

inputs = []

inputs.append(httpclient.InferInput("text_input", [1], "BYTES"))

inputs[0].set_data_from_numpy(np.array(["请解释神经网络"], dtype=object))

# 设置输出

outputs = []

outputs.append(httpclient.InferRequestedOutput("text_output"))

# 发送推理请求

results = triton_client.infer(

model_name="llm_model",

inputs=inputs,

outputs=outputs

)

# 获取结果

output_data = results.as_numpy("text_output")

print(f"Triton响应: {output_data[0].decode('utf-8')}")

TensorRT-LLM

NVIDIA推出的针对LLM的TensorRT优化版本,通过图优化和内核融合实现极致性能。需要模型编译步骤,但能获得最佳的硬件利用率。

# TensorRT-LLM部署示例(简化版)

import tensorrt_llm

from tensorrt_llm.runtime import ModelRunner

# 加载编译好的TensorRT引擎

runner = ModelRunner.from_dir(

engine_dir="./trt_engines",

rank=0, # 单GPU情况

max_batch_size=8,

max_input_len=512,

max_output_len=256

)

# 执行推理

prompt = "请解释什么是强化学习"

output_ids = runner.generate([prompt])

print(f"TensorRT-LLM输出ID: {output_ids}")

vLLM(本文重点)

由加州大学伯克利分校LMSYS组织开发,采用创新的PagedAttention技术,在内存利用率和吞吐量方面表现突出。vLLM平衡了易用性和性能,成为当前最受欢迎的推理框架之一。

# vLLM基础使用示例

from vllm import LLM, SamplingParams

# 初始化vLLM引擎

llm = LLM(

model="Qwen/Qwen2.5-7B-Instruct",

tensor_parallel_size=1, # 单GPU

gpu_memory_utilization=0.9,

max_model_len=4096

)

# 设置生成参数

sampling_params = SamplingParams(

temperature=0.7,

top_p=0.9,

max_tokens=100

)

# 执行推理

prompts = ["请解释什么是自然语言处理"]

outputs = llm.generate(prompts, sampling_params)

# 输出结果

for output in outputs:

print(f"vLLM响应: {output.outputs[0].text}")

1.2 多维度对比分析

性能对比(延迟、吞吐量、显存利用率)

根据2024年的基准测试数据,各框架在相同硬件环境(8×NVIDIA A100)下的表现如下:

# 性能对比数据可视化

import matplotlib.pyplot as plt

import numpy as np

# 测试数据(基于公开基准测试)

frameworks = ['vLLM', 'TGI', 'TensorRT-LLM', 'LMDeploy', 'Transformers']

throughput_8b = [3.75, 3.74, 3.70, 3.79, 1.0] # 请求/秒

ttft_8b = [0.15, 0.18, 0.16, 0.14, 0.35] # 首token时间(秒)

memory_utilization = [95, 85, 90, 92, 40] # 显存利用率(%)

# 创建对比图表

fig, axes = plt.subplots(1, 3, figsize=(15, 5))

# 吞吐量对比

axes[0].bar(frameworks, throughput_8b, color=['#FF6B6B', '#4ECDC4', '#45B7D1', '#96CEB4', '#FFEAA7'])

axes[0].set_title('Llama-3-8B 吞吐量对比 (req/s)')

axes[0].set_ylabel('吞吐量 (req/s)')

axes[0].grid(True, alpha=0.3)

# 首token时间对比

axes[1].bar(frameworks, ttft_8b, color=['#FF6B6B', '#4ECDC4', '#45B7D1', '#96CEB4', '#FFEAA7'])

axes[1].set_title('首Token时间对比 (秒)')

axes[1].set_ylabel('时间 (秒)')

axes[1].grid(True, alpha=0.3)

# 显存利用率对比

axes[2].bar(frameworks, memory_utilization, color=['#FF6B6B', '#4ECDC4', '#45B7D1', '#96CEB4', '#FFEAA7'])

axes[2].set_title('显存利用率对比 (%)')

axes[2].set_ylabel('利用率 (%)')

axes[2].set_ylim([0, 100])

axes[2].grid(True, alpha=0.3)

plt.tight_layout()

plt.savefig('framework_comparison.png', dpi=300, bbox_inches='tight')

plt.show()

性能分析要点:

- 吞吐量:LMDeploy在8B模型上表现最佳(3.79 req/s),vLLM和TGI紧随其后(约3.75 req/s)

- 首Token时间(TTFT):vLLM在所有并发级别上都保持最低的TTFT,特别适合对延迟敏感的场景

- 显存利用率:vLLM的PagedAttention技术使显存利用率达到95%+,相比传统方法的20-40%有显著提升

- 稳定性:vLLM和TensorRT-LLM在不同负载下表现稳定,而TGI和LMDeploy在特定场景下可能出现波动

易用性对比

# 易用性评分系统

class FrameworkUsability:

"""评估框架易用性的工具类"""

def __init__(self):

self.criteria = {

'installation': '安装复杂度',

'configuration': '配置难度',

'api_design': 'API设计友好度',

'documentation': '文档完整性',

'community': '社区活跃度'

}

def evaluate_frameworks(self):

"""评估各框架易用性(1-10分,10分最佳)"""

scores = {

'Transformers': {

'installation': 9,

'configuration': 8,

'api_design': 9,

'documentation': 10,

'community': 10,

'total': 46

},

'vLLM': {

'installation': 7,

'configuration': 7,

'api_design': 8,

'documentation': 8,

'community': 9,

'total': 39

},

'TGI': {

'installation': 6,

'configuration': 6,

'api_design': 7,

'documentation': 7,

'community': 8,

'total': 34

},

'TensorRT-LLM': {

'installation': 5,

'configuration': 5,

'api_design': 6,

'documentation': 6,

'community': 7,

'total': 29

},

'Triton': {

'installation': 4,

'configuration': 4,

'api_design': 5,

'documentation': 5,

'community': 6,

'total': 24

}

}

return scores

def generate_report(self):

"""生成易用性报告"""

scores = self.evaluate_frameworks()

print("="*60)

print("大模型推理框架易用性对比报告")

print("="*60)

for framework, criteria_scores in scores.items():

print(f"\n{framework}:")

for criterion, score in criteria_scores.items():

if criterion != 'total':

bar = "█" * score + "░" * (10 - score)

print(f" {self.criteria[criterion]:<15} {bar} {score}/10")

print(f" 总分: {criteria_scores['total']}/50")

print("\n" + "="*60)

print("总结:")

print("1. Transformers在易用性方面全面领先")

print("2. vLLM在性能和易用性之间取得良好平衡")

print("3. TensorRT-LLM和Triton更适合专业部署场景")

# 执行评估

evaluator = FrameworkUsability()

evaluator.generate_report()

易用性分析:

- 部署难度:Transformers最简单,vLLM次之,TensorRT-LLM需要模型编译步骤最复杂

- API兼容性:vLLM提供OpenAI兼容的API,迁移成本最低

- 模型支持范围:Transformers支持最广,vLLM支持主流开源模型,TensorRT-LLM主要支持NVIDIA优化模型

扩展性对比

# 分布式部署能力测试

class DistributedCapabilityTest:

"""测试框架分布式能力的工具类"""

def __init__(self):

self.capabilities = {

'vLLM': {

'tensor_parallel': True,

'pipeline_parallel': True,

'model_sharding': True,

'multi_node': True,

'heterogeneous_hardware': False

},

'TensorRT-LLM': {

'tensor_parallel': True,

'pipeline_parallel': True,

'model_sharding': True,

'multi_node': True,

'heterogeneous_hardware': False

},

'TGI': {

'tensor_parallel': True,

'pipeline_parallel': False,

'model_sharding': True,

'multi_node': True,

'heterogeneous_hardware': False

},

'Triton': {

'tensor_parallel': True,

'pipeline_parallel': True,

'model_sharding': True,

'multi_node': True,

'heterogeneous_hardware': True

}

}

def test_multi_gpu_deployment(self):

"""测试多GPU部署配置"""

print("多GPU部署配置示例:")

print("-" * 50)

# vLLM多GPU配置

print("\n1. vLLM 4卡张量并行配置:")

vllm_config = """

from vllm import LLM

llm = LLM(

model="Qwen/Qwen2.5-14B-Instruct",

tensor_parallel_size=4, # 4卡张量并行

gpu_memory_utilization=0.85,

max_model_len=8192,

enable_prefix_caching=True

)

"""

print(vllm_config)

# TensorRT-LLM多GPU配置

print("\n2. TensorRT-LLM 多GPU配置:")

trt_config = """

# 编译阶段指定多GPU

python3 build.py --model_dir ./qwen-14b \\

--dtype float16 \\

--use_gpt_attention_plugin float16 \\

--use_gemm_plugin float16 \\

--output_dir ./trt_engines \\

--world_size 4 # 4卡并行

"""

print(trt_config)

def compare_hardware_support(self):

"""比较硬件支持范围"""

print("\n硬件支持范围对比:")

print("-" * 50)

hardware_types = ['NVIDIA GPU', 'AMD GPU', 'Intel GPU', 'CPU', '边缘设备']

for hw in hardware_types:

support = []

for framework, caps in self.capabilities.items():

if hw == 'NVIDIA GPU':

support.append(framework)

elif hw == '边缘设备' and framework == 'vLLM':

# vLLM正在向边缘设备扩展

support.append(framework + " (实验性)")

print(f"{hw:<15}: {', '.join(support) if support else '有限支持'}")

# 执行扩展性测试

dist_test = DistributedCapabilityTest()

dist_test.test_multi_gpu_deployment()

dist_test.compare_hardware_support()

扩展性分析:

- 分布式部署:vLLM和TensorRT-LLM都支持张量并行和流水线并行,适合大规模部署

- 硬件适配:Triton支持最广泛的硬件,vLLM主要针对NVIDIA GPU优化

- 边缘计算:vLLM正在向边缘设备扩展,但当前仍以云端部署为主

功能对比

# 功能特性对比表

import pandas as pd

def create_feature_comparison_table():

"""创建功能对比表格"""

data = {

'特性': [

'连续批处理',

'PagedAttention',

'OpenAI API兼容',

'流式输出',

'量化支持',

'多模态支持',

'推测解码',

'服务化部署'

],

'vLLM': ['✓', '✓', '✓', '✓', '✓', '实验性', '✓', '✓'],

'TGI': ['✓', '✗', '✓', '✓', '✓', '有限', '✗', '✓'],

'TensorRT-LLM': ['✓', '✗', '✓', '✓', '✓', '✗', '✓', '✓'],

'Triton': ['✓', '✗', '✓', '✓', '✓', '✓', '✓', '✓'],

'Transformers': ['✗', '✗', '✗', '✓', '✓', '✓', '✗', '✗']

}

df = pd.DataFrame(data)

df.set_index('特性', inplace=True)

# 添加样式

styled_df = df.style.applymap(

lambda x: 'background-color: #90EE90' if x == '✓'

else 'background-color: #FFB6C1' if x == '✗'

else 'background-color: #FFFACD'

)

print("功能特性对比表:")

print("="*70)

print(styled_df.to_string())

# 统计功能数量

print("\n" + "="*70)

print("功能数量统计:")

for framework in ['vLLM', 'TGI', 'TensorRT-LLM', 'Triton', 'Transformers']:

count = sum(1 for x in df[framework] if x == '✓')

print(f"{framework}: {count}/8 个功能")

create_feature_comparison_table()

功能分析:

- 核心创新:vLLM独有的PagedAttention技术是其最大优势

- 服务化能力:vLLM、TGI、TensorRT-LLM和Triton都提供完整的服务化部署方案

- 量化支持:所有框架都支持模型量化,但具体实现方式不同

- 多模态支持:Transformers支持最全面,vLLM正在扩展多模态能力网页

1.3 框架选择建议

不同业务场景的框架选择

# 场景化框架选择工具

class FrameworkSelector:

"""根据业务场景推荐合适的推理框架"""

def __init__(self):

self.scenarios = {

'high_concurrency': {

'name': '高并发场景',

'description': '需要处理大量并发请求,如在线聊天、客服系统',

'requirements': ['高吞吐量', '低延迟', '高并发支持'],

'recommended': 'vLLM',

'reason': 'vLLM的PagedAttention技术能有效管理KV缓存,支持更高的并发数'

},

'long_text': {

'name': '长文本处理',

'description': '需要处理长文档、代码生成等场景',

'requirements': ['长序列支持', '内存效率', '稳定输出'],

'recommended': 'vLLM或TensorRT-LLM',

'reason': '两者都支持长序列,vLLM内存效率更高,TensorRT-LLM性能更优'

},

'low_memory': {

'name': '低显存环境',

'description': '显存有限的GPU或边缘设备',

'requirements': ['低显存占用', '量化支持', '轻量化'],

'recommended': 'vLLM + 量化',

'reason': 'vLLM的PagedAttention减少显存碎片,结合量化可大幅降低显存需求'

},

'enterprise_production': {

'name': '企业生产环境',

'description': '需要高可靠性、监控、多模型管理的企业级部署',

'requirements': ['高可靠性', '监控支持', '多模型管理', '安全特性'],

'recommended': 'Triton Inference Server',

'reason': 'Triton提供最完整的企业级特性,支持多种框架和硬件'

},

'research_development': {

'name': '研究开发',

'description': '模型实验、算法研究、快速原型开发',

'requirements': ['易用性', '模型支持广', '快速迭代'],

'recommended': 'Hugging Face Transformers',

'reason': 'Transformers生态最完善,支持模型最多,API最友好'

}

}

def recommend_framework(self, scenario_key, budget=None, team_size=None):

"""根据场景推荐框架"""

if scenario_key not in self.scenarios:

return "未知场景"

scenario = self.scenarios[scenario_key]

print(f"场景: {scenario['name']}")

print(f"描述: {scenario['description']}")

print(f"核心需求: {', '.join(scenario['requirements'])}")

print(f"推荐框架: {scenario['recommended']}")

print(f"推荐理由: {scenario['reason']}")

# 考虑预算和团队规模

if budget and team_size:

print(f"\n附加考虑因素:")

print(f"预算: {'充足' if budget > 100000 else '有限'}")

print(f"团队规模: {'大型团队' if team_size > 10 else '小型团队'}")

if budget < 50000 and scenario_key == 'enterprise_production':

print("注意: 预算有限时,可考虑vLLM作为Triton的替代方案")

return scenario['recommended']

def compare_total_cost(self):

"""比较总体拥有成本"""

print("\n" + "="*60)

print("框架总体拥有成本对比")

print("="*60)

cost_data = {

'框架': ['vLLM', 'TGI', 'TensorRT-LLM', 'Triton', 'Transformers'],

'硬件成本': ['中', '中', '高', '高', '低'],

'人力成本': ['低', '中', '高', '高', '低'],

'维护成本': ['低', '中', '高', '高', '中'],

'学习曲线': ['平缓', '中等', '陡峭', '陡峭', '平缓'],

'总评分': ['优秀', '良好', '中等', '中等', '优秀']

}

df = pd.DataFrame(cost_data)

print(df.to_string(index=False))

# 使用选择器

selector = FrameworkSelector()

print("业务场景框架选择指南")

print("="*60)

# 测试不同场景

scenarios_to_test = ['high_concurrency', 'long_text', 'low_memory', 'enterprise_production']

for scenario in scenarios_to_test:

print(f"\n{'='*40}")

selector.recommend_framework(scenario, budget=80000, team_size=5)

# 比较成本

selector.compare_total_cost()

企业落地成本与技术门槛对比

# 企业落地评估工具

class EnterpriseDeploymentEvaluator:

"""评估企业落地成本和技术门槛"""

def evaluate_frameworks(self):

"""综合评估各框架"""

evaluation_criteria = [

'初始部署成本',

'运维复杂度',

'性能表现',

'可扩展性',

'生态完整性',

'技术支持',

'安全特性',

'监控能力'

]

# 评分矩阵(1-5分,5分最佳)

scores = {

'vLLM': [4, 4, 5, 5, 4, 4, 3, 4],

'TGI': [3, 3, 4, 4, 4, 4, 3, 4],

'TensorRT-LLM': [2, 2, 5, 5, 3, 3, 3, 3],

'Triton': [1, 2, 5, 5, 5, 5, 5, 5],

'Transformers': [5, 5, 2, 2, 5, 5, 2, 2]

}

# 计算总分

total_scores = {}

for framework, criteria_scores in scores.items():

total_scores[framework] = sum(criteria_scores)

# 创建雷达图

self.create_radar_chart(evaluation_criteria, scores)

return total_scores

def create_radar_chart(self, criteria, scores):

"""创建雷达图可视化"""

import matplotlib.pyplot as plt

import numpy as np

# 设置角度

angles = np.linspace(0, 2 * np.pi, len(criteria), endpoint=False).tolist()

angles += angles[:1] # 闭合图形

# 创建图形

fig, ax = plt.subplots(figsize=(10, 10), subplot_kw=dict(projection='polar'))

# 为每个框架绘制雷达图

colors = ['#FF6B6B', '#4ECDC4', '#45B7D1', '#96CEB4', '#FFEAA7']

frameworks = list(scores.keys())

for idx, (framework, framework_scores) in enumerate(scores.items()):

# 闭合数据

values = framework_scores + [framework_scores[0]]

# 绘制

ax.plot(angles, values, 'o-', linewidth=2, label=framework, color=colors[idx])

ax.fill(angles, values, alpha=0.25, color=colors[idx])

# 设置标签

ax.set_xticks(angles[:-1])

ax.set_xticklabels(criteria)

ax.set_ylim(0, 5)

# 添加图例

ax.legend(loc='upper right', bbox_to_anchor=(1.3, 1.0))

plt.title('企业落地综合评估雷达图', size=20, y=1.1)

plt.savefig('enterprise_evaluation_radar.png', dpi=300, bbox_inches='tight')

plt.show()

def generate_deployment_roadmap(self, framework, team_experience):

"""生成部署路线图"""

print(f"\n{framework} 企业部署路线图")

print("="*50)

roadmaps = {

'vLLM': [

"第1周: 环境准备与依赖安装",

"第2周: 模型测试与性能基准",

"第3周: 服务化部署与API开发",

"第4周: 监控系统集成",

"第5周: 压力测试与优化",

"第6周: 生产环境部署"

],

'Triton': [

"第1-2周: 基础设施准备",

"第3-4周: 模型转换与优化",

"第5-6周: 服务编排与部署",

"第7-8周: 企业特性集成",

"第9-10周: 全面测试",

"第11-12周: 生产上线"

]

}

if framework in roadmaps:

for i, step in enumerate(roadmaps[framework], 1):

print(f"{i}. {step}")

# 根据团队经验调整时间

if team_experience == 'beginner':

print(f"\n注意: 团队经验不足,预计时间需要增加30-50%")

elif team_experience == 'expert':

print(f"\n注意: 团队经验丰富,预计时间可减少20-30%")

else:

print("暂无该框架的详细路线图")

# 执行评估

evaluator = EnterpriseDeploymentEvaluator()

total_scores = evaluator.evaluate_frameworks()

print("企业落地综合评分:")

print("="*40)

for framework, score in total_scores.items():

print(f"{framework}: {score}/40 分")

# 生成vLLM部署路线图

evaluator.generate_deployment_roadmap('vLLM', 'intermediate')

企业落地建议:

- 初创公司/中小团队:优先选择vLLM,平衡性能、成本和易用性

- 大型企业:考虑Triton,虽然初始成本高,但长期运维更稳定

- 研究机构:使用Transformers进行实验,vLLM进行部署

- 边缘计算场景:vLLM轻量化版本是未来发展方向

二、vLLM常见问题与解决方案

2.1 部署类问题解决方案

vLLM安装失败(依赖库冲突、CUDA版本不兼容)

核心原因:vLLM高度依赖特定版本的CUDA、PyTorch和NVIDIA驱动,版本不匹配会导致编译失败。

解决方案:

- 使用全新环境:在干净的Python虚拟环境中安装vLLM,避免现有PyTorch版本冲突

- 自动选择CUDA版本:使用uv工具自动匹配CUDA版本

uv pip install vllm --torch-backend=auto - 指定CUDA版本安装:

# CUDA 12.8 pip install vllm --index-url https://vllm.github.io/wheels/cu128 # CUDA 13.0 pip install vllm --index-url https://vllm.github.io/wheels/cu130 - 容器化部署(推荐):使用Docker彻底隔离环境

FROM nvidia/cuda:12.4.0-devel-ubuntu22.04 RUN pip3 install vllm

模型加载失败(模型格式不兼容、显存不足)

显存不足解决方案:

-

启用量化:使用AWQ或GPTQ量化减少显存占用

python -m vllm.entrypoints.api_server \ --model tencent/Hunyuan-MT-7B \ --quantization gptq \ --gpu-memory-utilization 0.8 -

调整内存参数:

- 降低

gpu_memory_utilization(建议0.8-0.9) - 启用KV缓存量化:

--kv-cache-dtype fp8 - 限制最大序列长度:

--max-model-len 4096

- 降低

-

张量并行:将大模型拆分到多张GPU

--tensor-parallel-size 2

服务启动异常(端口占用、配置错误)

解决方案:

- 端口冲突:指定不同端口

--port 8001 - GPU选择:通过环境变量指定GPU

CUDA_VISIBLE_DEVICES=1 python -m vllm.entrypoints.api_server - 配置验证:使用

--help查看所有参数,确保配置合理

2.2 性能类问题解决方案

推理速度未达预期

调优策略:

-

批处理优化:

- 调整

--max-num-seqs:A100级别GPU建议64-128起步 - 启用

--enable-chunked-prefill:长短请求混合时降低延迟 - 设置

--max-num-batched-tokens:限制单次forward最大token数

- 调整

-

硬件适配:

- 确保使用NVLink连接多GPU

- 检查GPU计算能力(vLLM要求≥7.0)

显存占用过高

量化优化方案:

| 量化方式 | 显存节省 | 吞吐量影响 | 适用场景 |

|---|---|---|---|

| AWQ Int4 | ~60% | -30% | 消费级GPU部署 |

| GPTQ Int4 | ~60% | -35% | 显存极度紧张 |

| KV Cache FP8 | 40% | 轻微 | 长上下文场景 |

配置示例:

python -m vllm.entrypoints.api_server \

--model Qwen2.5-7B-Instruct-AWQ \

--dtype auto \

--max-num-seqs 128 \

--max-model-len 4096 \

--gpu-memory-utilization 0.9

吞吐量提升不明显

调度策略优化:

- 工作负载分离:将短任务和长任务分配到不同的vLLM worker池

- 准入控制:在网关层按租户限制令牌速率

- 监控指标:关注令牌/秒而非QPS,KV缓存利用率保持在70-85%

2.3 功能类问题解决方案

流式输出异常

问题根源:不同实现的SSE格式不一致,前端解析失败

解决方案:

- 标准化解析:前端适配多种流式响应格式

- vLLM配置:确保启用正确的流式输出模式

- 测试验证:使用curl测试流式响应

curl -N http://localhost:8000/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{"model":"Qwen2.5-7B", "messages":[...], "stream":true}'

OpenAI API接口兼容问题

vLLM完全兼容OpenAI API:

- 路径:

/v1/chat/completions、/v1/completions - 支持

stream=true流式输出 - 错误码对齐(429限流、400参数错误)

迁移示例:

import openai

openai.api_key = "EMPTY" # 禁用鉴权

openai.base_url = "http://localhost:8000/v1/"

response = openai.chat.completions.create(

model="meta-llama/Llama-2-7b-chat-hf",

messages=[{"role": "user", "content": "Hello"}],

max_tokens=100

)

自定义模型适配问题

解决方案:

- 信任远程代码:添加

--trust-remote-code参数 - 模型结构检查:确保tokenizer_config.json包含

chat_template字段 - 版本兼容性:transformers版本≥4.34.1

- LoRA支持:vLLM支持加载微调后的模型权重

2.4 生产环境最佳实践

监控指标

- 性能指标:TTFT p50/p95、令牌/秒(输入/输出/总计)

- 资源指标:活跃序列数、KV缓存利用率、批处理大小分布

- 业务指标:调度器队列长度、准入拒绝率、OOM事件

容量规划

- 以令牌/秒为单位规划容量,而非QPS

- 保持70-85%的利用率以吸收流量峰值

- KV缓存利用率>0.95时需扩容或降低并发

故障恢复

- 使用守护进程:systemd或supervisor管理服务

- 设置超时:防止单个请求占用资源过久

- 定期更新:获取最新性能改进和bug修复

通过上述系统化的解决方案,您可以有效解决vLLM在部署、性能和功能方面的常见问题,实现稳定高效的大模型推理服务。

三、vLLM未来发展趋势与展望

3.1 技术发展趋势

PagedAttention机制的持续优化

vLLM团队将持续优化其核心的PagedAttention技术,重点方向包括:

- KV缓存多级存储架构:支持GPU显存、主机内存和远程数据库的多级缓存,通过智能替换算法和预取策略扩展容量同时保持高访问效率

- 动态预测解码优化:引入实时负载监控和自适应调整机制,确保在各种工况下都能带来稳定加速,目标将加速比稳定在1.5-2倍区间

- 混合专家系统优化:针对DeepSeek-V3等MoE模型,优化专家并行负载均衡和稀疏专家激活策略

算子与硬件适配的深度融合

vLLM正构建开放的硬件推理生态,实现全面硬件支持:

- 多硬件平台支持:已支持NVIDIA全系列GPU、AMD MI200/MI300、Google TPU、AWS Inferentia/Trainium、Intel Gaudi等多种架构

- 极致性能优化:2025年核心目标是在单个GPU上实现GPT-4级别性能,单个节点支持更大规模模型部署

- 异构计算支持:计划实现预填充与解码的物理分离架构,允许在不同GPU上独立配置资源

分布式推理能力升级

- 多模态模型支持:vLLM-Omni正式发布,支持文本、图像、音频、视频的全模态模型服务,采用完全解耦的流水线架构

- 跨节点优化:生产级多节点部署在Coreweave H200集群上达到2.2k tokens/s每GPU的性能突破

- 专家并行扩展:支持张量并行、流水线并行到专家并行的全面演进

3.2 行业应用拓展

多模态大模型推理的适配

vLLM-Omni作为首批支持全模态模型服务的开源框架,具备三大关键能力:

- 真正的全模态处理:无缝处理和生成文本、图像、视频和音频

- 超越自回归的推理:将高效内存管理扩展到Diffusion Transformers和其他并行生成模型

- 异构模型流水线:编排复杂的模型工作流,单个请求即可调用多个异构模型组件

边缘设备上的vLLM部署

- Jetson设备适配:已在NVIDIA Jetson嵌入式板卡上实现生产级部署,通过PagedAttention解决显存碎片化问题

- 轻量化优化:在显存有限、散热受限的边缘环境下,仍能通过细粒度调度服务更多并发请求

- 车用AI堆栈集成:红帽将vLLM作为车用AI操作系统的核心组件,支持嵌入模型、多模态等多种模型场景

行业场景深度落地

| 行业领域 | 应用场景 | 典型案例 |

|---|---|---|

| 金融 | 财务审计、风险控制 | 一意科技在财务审计项目中准确率达95%以上,VLM负责非结构化数据识别,LLM负责结构化处理 |

| 政务/园区 | 智能管理、安防监控 | 联汇科技与vLLM深度耦合的办公园区空间智能体系统专利,实现多模态数据融合和动态策略生成 |

| 医疗 | 医学影像分析、诊断辅助 | 实时视频流分析系统,能够理解完整医疗流程并判断安全隐患 |

| 制造业 | 质量控制、生产优化 | 视频智能体系统进行复杂推理并执行自主行动 |

3.3 开源社区与生态发展

vLLM开源社区发展方向

- 开放治理架构:vLLM于2024年10月正式加入Linux Foundation,坚持开放治理,确保项目由社区共同维护

- V1架构重构:推出大规模重构后的vLLM V1,核心代码精简至2000-3000行,降低开发者参与门槛

- 生态系统扩展:获得字节跳动、阿里、腾讯、月之暗面等科技公司支持,以及真格基金、a16z、英伟达等投资

与其他开源项目的生态融合

- PyTorch基金会托管:2025年5月,vLLM成为PyTorch基金会首批托管项目,与DeepSpeed、Ray共同构建完整AI开发生态

- Hugging Face深度集成:支持Transformers backend,用户能够直接运行任意Hugging Face模型

- 技术栈协同优化:

- 利用torch.compile、TorchAO、FlexAttention等PyTorch生态项目加速创新

- 与DeepSeek开源工具链(DeepGEMM、DeepEP等)系统化融合

- 支持昇腾(Ascend)AI硬件平台,为国产芯片提供高效解决方案

社区活动与协作

- 全球技术聚会:2025年8月北京见面会吸引260名开发者参与,腾讯、华为、蚂蚁、字节、小米等公司分享实践案例

- 企业级贡献:各公司基于vLLM构建定制化解决方案,如腾讯的PD分离框架、字节跳动的AIBrix控制平面等

- 标准化进程:红帽等组织推动vLLM南向硬件接口和北向模型接口的标准化

四、未来展望

vLLM正从专业推理引擎向开放平台迈进,2026年的发展愿景包括:

- 模型能力全面升级:支持近100种模型架构,覆盖主流开源大语言模型、多模态模型、状态空间语言模型等

- 生产级部署完善:量化、缓存等优化功能成为默认配置,提供完整的集群级解决方案

- 开放架构演进:推出可插拔架构设计,支持一流的torch.compile和灵活的组件系统

随着vLLM在技术深度、行业广度和生态成熟度三个维度的持续发展,它正成为连接模型开发者、硬件供应商和应用开发者的关键枢纽,推动大模型推理技术在各行各业的规模化落地。

🌟 感谢您耐心阅读到这里

💡 如果本文对您有所启发,请

👍 点赞📌 收藏 📤 分享给更多需要的伙伴

🗣️ 期待在评论区看到您的想法, 共同进步

🔔 关注我,持续获取更多干货内容

🤗 我们下篇文章见~

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献179条内容

已为社区贡献179条内容

所有评论(0)