MCP科普&面试指南

MCP科普&面试指南

最近是不是刷到 AI 圈全在说 MCP? 面试大模型岗,被面试官一句 “你怎么理解 MCP” 问懵了? 或者听人说这是 AI 的 “USB-C”,却完全搞不懂这玩意儿到底解决了啥问题?

别慌,今天这篇,咱把 MCP 掰扯得明明白白: 小白看完能搞懂 AI 圈最火的新风口,面试大模型的同学看完,直接把考点背下来,下次面试官再问 MCP,你直接给他讲透!

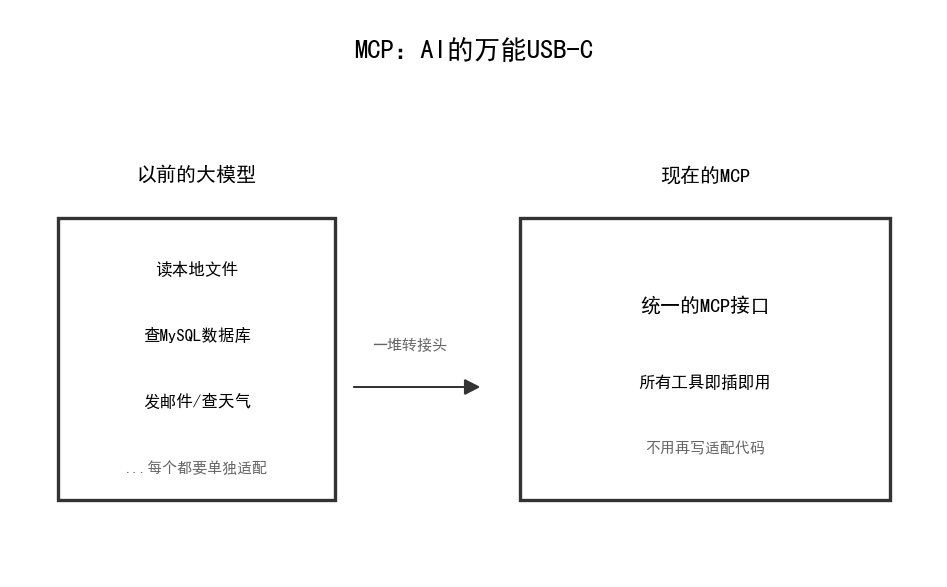

先给小白:一句话搞懂 MCP,就是 AI 的万能 USB-C!

你有没有过这种经历? 以前的手机,充电一个接口,耳机一个接口,传数据又得换一个,出门要带一堆转接头,烦都烦死了。

大模型以前就是这个德行!

你想让 AI 帮你读你电脑里的本地文件?得写一堆适配代码,把文件上传,还要做权限校验; 你想让 AI 帮你查公司的 MySQL 数据库?又得写另一堆代码,做 API 对接,做参数校验; 你想让 AI 帮你发邮件、查天气、操作 Git?每加一个功能,你就得重新写一遍适配逻辑,改一遍 AI 的配置,重启应用,累死人。

这就叫 “碎片化集成”,就像以前的一堆老接口,每个都要单独的转接头,折腾死个人。

然后 MCP 就来了!

MCP,全称Model Context Protocol,模型上下文协议,说白了,就是给 AI 做的万能 USB-C 接口!

不管你是要接本地文件、数据库、API、还是各种工具,只要符合 MCP 这个统一标准,AI 就能直接用! 不用再写一堆适配代码,不用重启应用,插上去就能用! 就像你现在的手机,一个 USB-C 口,充电、插耳机、传数据、连显示器,全搞定,不用任何转接头!

这就是 MCP 最核心的作用:把大模型和外部世界的连接,给标准化了!

📌 面试划重点:这题是入门必考题,标准答案直接背: MCP 是 Anthropic 在 2024 年底开源的开放协议,核心是标准化大语言模型与外部工具、数据源、服务之间的通信规则,解决传统集成碎片化的问题,目标是成为 AI 集成领域的 USB-C,实现 “一次接入,处处可用”。 它的四大设计目标:解耦模块化、安全可控、可扩展、标准化,记下来,面试官问设计目标直接说这四个!

再讲深点:MCP 到底是怎么干活的?

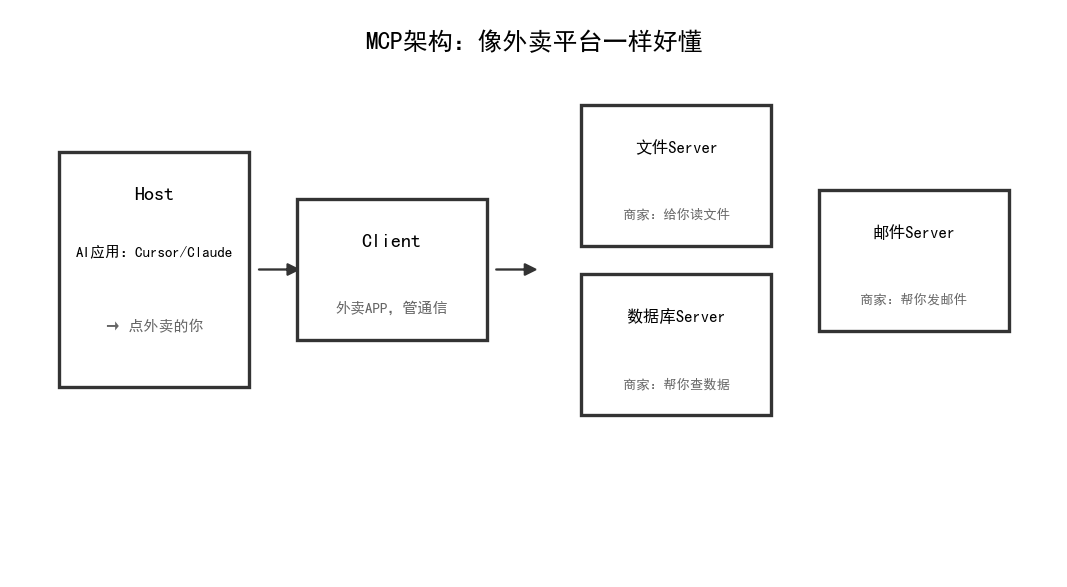

很多人看完上面的类比,还是懵:那它的架构到底是啥?别慌,咱用外卖平台给你讲,保证你听懂:

你可以把整个 MCP 的体系,拆成三个部分:

-

Host(主机):就是你用的那个 AI 应用,比如 Cursor 编辑器、Claude 桌面端、公司的智能客服,这就相当于点外卖的你,你有需求,要吃饭。

-

MCP Client(客户端):它是嵌在 Host 里面的一个接口层,就相当于你手机里的外卖 APP,负责帮你和商家沟通,下单、收餐,所有的通信都是它来管。

-

MCP Server(服务器):这就是商家!每个商家负责提供一类服务:比如文件商家,负责给你读本地文件;数据库商家,负责帮你查数据库;邮件商家,负责帮你发邮件。

你点外卖的时候,一个外卖 APP 可以同时点肯德基、奶茶、水果,对吧? 同理,一个 Host 里的 Client,也可以同时连 N 个 MCP Server,也就是说,你的 AI 可以同时用读文件、查库、发邮件一堆功能,不用换任何东西!

是不是一下子就懂了?

📌 面试划重点:面试官最爱问的 “Resources 和 Tools 的区别”,别搞混! 很多人到这都懵:Server 提供的东西,啥是资源啥是工具? 一句话分清:

Resources(资源):是名词,是静态的信息 / 数据,比如你要读的文件、数据库的连接信息,是拿来 “用的信息”,你可以读它、订阅它的更新。

Tools(工具):是动词,是可执行的动作,比如发邮件、查天气、运行代码,是要 “做的事情”,调用它就会产生一个操作。 举个例子:

sql_query(执行 SQL)是工具,而database_connection(数据库连接信息)是资源,懂了吧?这题答错直接减分!

灵魂拷问:MCP 和 Function Calling、RAG,到底有啥不一样?

这三个词,最近 AI 圈天天提,90% 的人都搞混,面试官也最爱拿这三个做对比!今天一次性给你讲清楚!

1. MCP vs 传统 Function Calling:一个是国标,一个是定制款

以前大模型要调用外部工具,用的都是 Function Calling 对吧?那它和 MCP 有啥区别?

还是用插座举例子:

-

Function Calling:就像是你家自己改的定制插座,只能给你家的空调用,换个别的牌子的空调,插不上!而且你要加个新电器,就得重新改插座,重启电路。

-

MCP:就是国标五孔插座,不管什么牌子的电器,只要符合标准,都能插!加新电器,直接插上去就行,不用改插座。

说白了,Function Calling 是厂商绑定、紧耦合、静态的: 比如 OpenAI 的 Function Calling,只能给 OpenAI 的模型用,你要换个 LLaMA 模型,之前的代码全废了;而且你要加个新工具,得手动把工具列表写到系统提示里,重启应用,模型才能发现。

而 MCP 是跨厂商、解耦、动态的: 不管你是 Claude、GPT、LLaMA,只要支持 MCP,就能用所有符合 MCP 的工具;而且 Server 能动态注册新工具,模型运行的时候直接就能发现,不用改代码、不用重启!

📌 面试对比表,直接背:

特性

MCP

传统 Function Calling

生态

开放跨厂商,一次开发到处用

厂商绑定,换模型就得重写

耦合度

完全解耦,模型和工具分开

紧耦合,工具要硬编码到应用里

动态性

支持动态发现新工具,不用重启

静态的,加工具要改配置重启

安全性

自带沙箱,权限隔离

安全全靠自己写,风险高

复用性

写好的 Server 所有 MCP 应用都能用

为 A 应用写的 Function,B 用不了

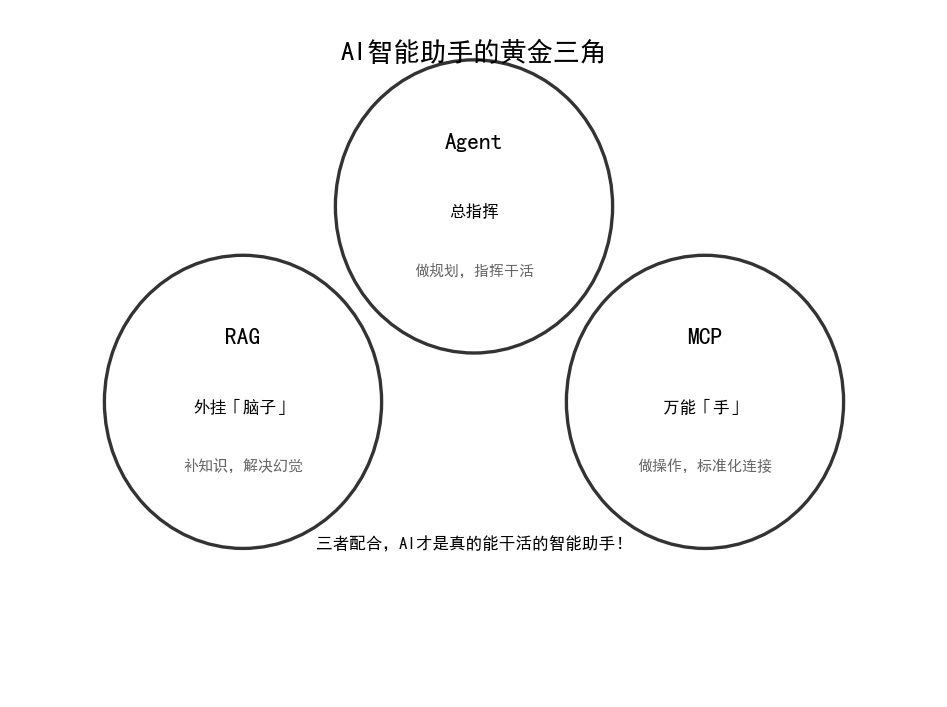

2. MCP vs RAG:一个管 “手”,一个管 “脑”

这俩是最容易搞混的!我给你一句话分清:

RAG 是给 AI 装 “外挂脑子”,帮它 “知道”;MCP 是给 AI 装 “万能手”,帮它 “做到”!

啥意思?

-

RAG(检索增强生成):解决的是大模型 “记不住、胡说八道” 的问题。比如你问它公司最新的请假政策,模型训练的时候没见过,RAG 就帮你去公司的知识库里面搜,把最新的政策拿给模型,让模型照着说,别瞎编。它的核心是给模型补知识,让模型 “知道更多”。

-

MCP:解决的是大模型 “手无缚鸡之力” 的问题。比如你问它 “帮我把我上周的订单都找出来,给客户发个提醒邮件”,RAG 只能帮你找到订单的信息,但是 MCP 能帮你:查数据库拿订单数据、调用邮件服务器发邮件、甚至帮你把订单状态更新了。它的核心是让模型能动手干活,不只是说说而已。

而且他俩根本不是互斥的,是黄金搭档!

比如你做个智能投资助手,用户说 “帮我分析下特斯拉 Q3 财报,对比小鹏,给我个投资建议”:

-

RAG:帮你去行业研报库里面搜,把最新的行业分析、研报内容拿给模型,补知识;

-

MCP:帮你调用 Yahoo Finance 的 API,拉最新的股价、财报数据,还能帮你跑 Python 脚本算 ROE 这些指标;

-

Agent:负责把这些任务拆了,指挥 RAG 和 MCP 干活,最后生成报告。

这就是现在 AI 圈说的黄金三角:RAG 管脑,MCP 管手,Agent 管指挥,三个加起来,AI 才是真的能帮你干活的智能助手!

📌 面试划重点:别再说 MCP 能替代 RAG 了!他俩场景完全不一样:

RAG 适合:非结构化文档(PDF、论文、手册),帮你检索信息,解决幻觉问题;

MCP 适合:结构化数据源、工具(数据库、API、服务),帮你执行操作,解决集成问题; 面试官要是问你 “MCP 会不会替代 RAG”,你就说他俩是互补的,一起用才是未来,直接加分!

面试必背:面试官最爱问的 10 个 MCP 问题,直接背!

最近字节、阿里、腾讯、Anthropic 这些公司,面大模型应用岗、Agent 岗,MCP 已经是必考题了,这 10 个问题,十有八九会问到,你直接背下来就行:

1. 什么是 MCP?它的核心设计目标是什么?

答:MCP 是 Anthropic 提出的开源模型上下文协议,标准化大模型与外部工具、数据源的通信,目标是解耦模块化、安全可控、可扩展、标准化,做 AI 领域的 USB-C。

2. MCP 的核心组件有哪些?

答:Host(AI 应用,比如 Cursor)、Client(Host 内的通信接口层)、Server(提供工具 / 数据的服务端);另外 Server 提供的能力分为 Resources(名词,数据)和 Tools(动词,动作)。

3. MCP 和 Function Calling 的本质区别是什么?

答:Function Calling 是厂商绑定的紧耦合 API 能力,静态配置;MCP 是跨厂商的开放协议,解耦架构,支持动态发现工具,自带安全沙箱,能力可复用。

4. Resources 和 Tools 的区别是什么?

答:Resources 是名词,是静态数据 / 信息,比如文件、连接信息,用来读的;Tools 是动词,是可执行的动作,比如发邮件、查库,用来执行操作的。

5. MCP 怎么保证安全性?

答:四层防护:1. 最小权限原则,Server 只给必要的权限;2. 沙箱隔离,Server 跑在独立环境,不会碰主机的敏感数据;3. 输入校验,防注入;4. 审计日志,所有操作都有记录,高危操作要用户确认。

6. 如果 MCP 要处理长时间的任务,比如训练模型,怎么避免阻塞?

答:用异步非阻塞设计:收到请求先返回确认,后台异步处理,做完了用 notify 主动推结果给客户端,不用客户端等着,还支持任务状态查询。

7. MCP 和 RAG 的区别是什么?

答:RAG 是检索增强,给模型补知识,解决幻觉,管 “脑”;MCP 是连接协议,让模型能调用工具,管 “手”,二者互补,经常一起用。

8. 一次完整的 MCP 工具调用流程是什么?

答:1. 初始化握手,Client 和 Server 交换能力;2. Client 请求 Server 的工具列表;3. Client 调用工具,传参数;4. Server 执行完,把结果返回给 Client。

9. 怎么开发一个 MCP 服务?

答:用官方的 SDK(Node/Python 都有),注册你的工具,定义输入输出的 Schema,实现执行逻辑,然后在 Host 里配置这个 Server 就行,比如 Cursor 里加个配置就能用。

10. 你觉得 MCP 未来的发展是什么?

答:会成为 AI 集成的事实标准,生态会爆发,各种领域的 MCP 服务会出来,比如企业服务、工业、医疗,然后端侧的轻量服务会起来,隐私性更好,Agent 的能力会因为 MCP 变得更强,真正能落地复杂任务。

现在 MCP 都能用在哪?给你看几个真案例

说了这么多,MCP 不是 PPT 概念,现在已经落地了!

1. 个人开发者:Cursor 直接能用,本地文件随便读

现在 Cursor、Claude Desktop 都已经原生支持 MCP 了! 你装个本地的 MCP 文件服务,AI 就能直接读你电脑里的所有代码、文件,不用你上传到云端,隐私又方便; 你还能装个 Git 的 MCP 服务,AI 直接就能帮你分析 Git 的提交记录,写代码评审,甚至帮你写 PR 描述,爽到飞起!

2. 工业场景:故障排查从 4 小时变 15 分钟

有个汽车厂的焊装线,之前工人遇到设备故障,要翻几百份维修手册,找解决方案要 4 小时,耽误生产。 后来他们用 MCP 把所有的设备数据、维修手册、故障库都接起来了,AI 直接通过 MCP 读设备的实时数据,查维修手册,15 分钟就能给出解决方案,非计划停机直接减少了 67%,MTBF 提升了 40%!

3. 企业智能助手:自动帮你做投资分析

之前的投资助手,只能给你看现成的报告,现在用 MCP+RAG+Agent,用户说一句 “帮我分析下特斯拉 Q3 财报,对比小鹏,给我个投资建议”,AI 自动:

-

调用 MCP 拉最新的股价、财报数据;

-

用 RAG 检索最新的行业研报;

-

自动算各种指标,生成完整的分析报告,整个过程 1 分钟搞定,不用人动手!

最后:为什么 MCP 是 AI 落地的下一个风口?

以前大模型,给人的感觉就是 “嘴强王者”,能说会道,但是真要干点活,就废了:接个工具要写一堆代码,接个数据要搞一堆适配,根本落不了地。

MCP 就是把这个最后一公里的问题给解决了: 它把大模型和外部世界的连接,给标准化了,以后不管什么模型,什么工具,只要符合 MCP,就能直接用,不用再重复造轮子。

就像当年 USB 把电脑的接口统一了之后,各种外设才爆发起来;现在 MCP 把 AI 的接口统一了,以后 AI 的工具生态,肯定会迎来一波大爆发!

这篇内容,小白看完搞懂了 AI 圈最火的新东西,面试的同学看完,直接把 MCP 的考点全拿下了。

转发给你身边要面大模型的朋友,或者想搞 AI 的小伙伴,这篇够他用半年!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)