Wan 2.7 Video Edit 实测:用一句话改视频(换背景 / 改颜色 API 教程)

Wan 2.7 最近加了一个 Video Edit 模式。和之前的文生视频、图生视频不同,这次是拿一段已有的视频,用一句话告诉模型你想改什么,它就改什么。比如"把背景换成雪山"“让夹克变成红色”。

传统视频编辑要开 Premiere 或者 After Effects,一帧一帧调。这个模型的思路是:你说改哪里,它自己处理,其他部分保持不变。

实际效果怎么样?我拿一段城市街道行走的视频,测了换背景和改颜色两种操作。

视频编辑和文生视频有什么区别

文生视频(T2V)是从零开始生成一段视频,你给 prompt,模型凭空创造画面。视频编辑(Video Edit)是在已有视频的基础上修改。模型需要理解原视频的结构、运动轨迹、时间连贯性,然后只改你指定的部分,其他保持原样。

模型要做两件事:理解"什么该改"和"什么不该动"。后者其实更难。

源视频长什么样

先用 Wan 2.7 T2V 生成了一段源视频:一个穿深蓝夹克的男性在城市街道上走路,两侧是玻璃建筑,午后阳光,侧面跟拍。5 秒,720p,16:9。

后面所有编辑操作都基于这段视频。

怎么调 Wan 2.7 Video Edit 的 API

两个核心输入:一段源视频和一条编辑指令。用 WaveSpeed 的 Python SDK 调比较简单:

import os

import wavespeed

from dotenv import load_dotenv

load_dotenv()

os.environ["WAVESPEED_API_KEY"] = "你的key"

# 上传源视频

source_url = wavespeed.upload("source_video.mp4")

# Wan 2.7 Video Edit - 换背景

result = wavespeed.run(

"alibaba/wan-2.7/video-edit",

{

"video": source_url,

"prompt": "Change the background to a snowy mountain landscape with pine trees and a clear blue sky, keep the person and their walking motion exactly the same"

},

timeout=1200.0

)

print(f"编辑后视频: {result['outputs'][0]}")

源视频的要求:mp4 或 mov 格式,2-10 秒。太长的视频需要先裁剪。

注意模型 ID 是 alibaba/wan-2.7/video-edit,不是 alibaba/wan-2.7-video-edit,中间是斜杠不是横杠。写错了会报 404 但没有有用的错误信息,排查起来很烦。

带参考图的编辑怎么写

如果想让编辑结果更可控,可以传参考图。比如想把视频转成某种特定风格,传一张风格参考图进去。

# 带参考图的视频编辑

result = wavespeed.run(

"alibaba/wan-2.7/video-edit",

{

"video": source_url,

"prompt": "Transform the scene into an oil painting style",

"reference_image": "https://你的风格参考图URL.jpg"

},

timeout=1200.0

)

Wan 2.7 Video Edit 支持最多 3 张参考图,可以从不同角度引导编辑效果。

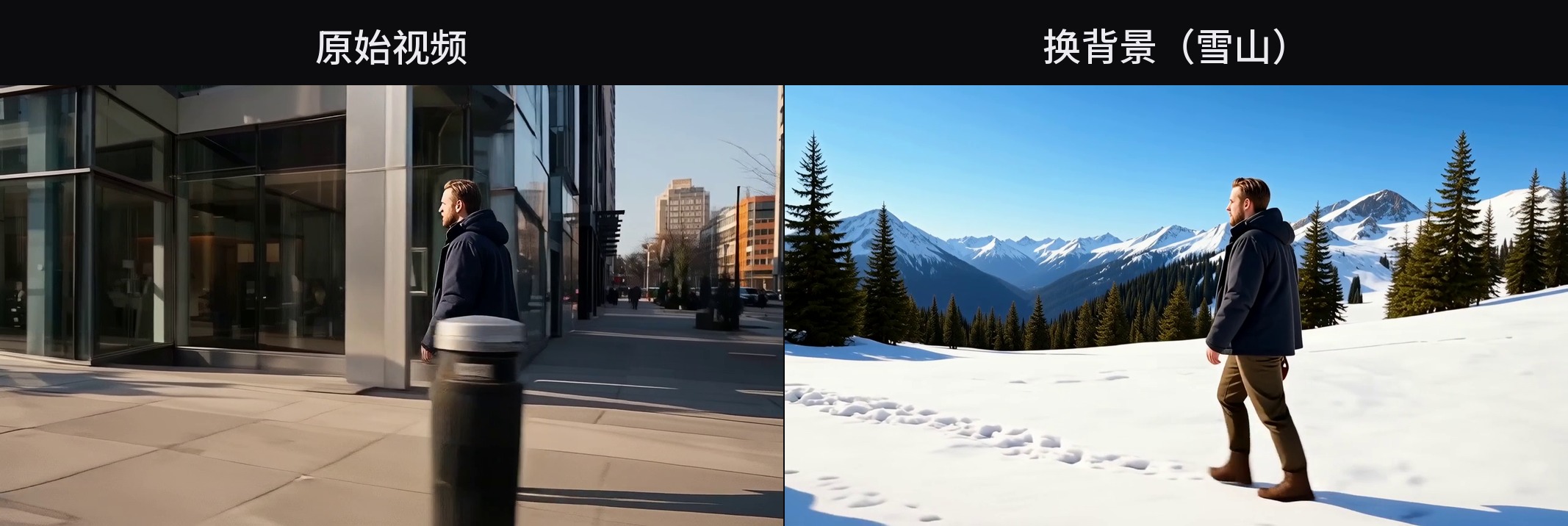

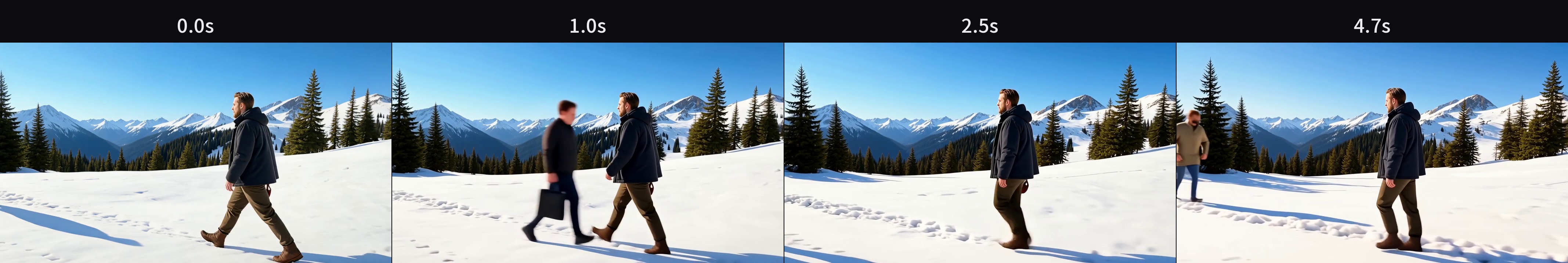

换背景跑出来怎么样

prompt 是 “Change the background to a snowy mountain landscape with pine trees and a clear blue sky, keep the person and their walking motion exactly the same”。

左边是原始视频,右边是换背景后的效果:

换背景后的视频四帧截图:

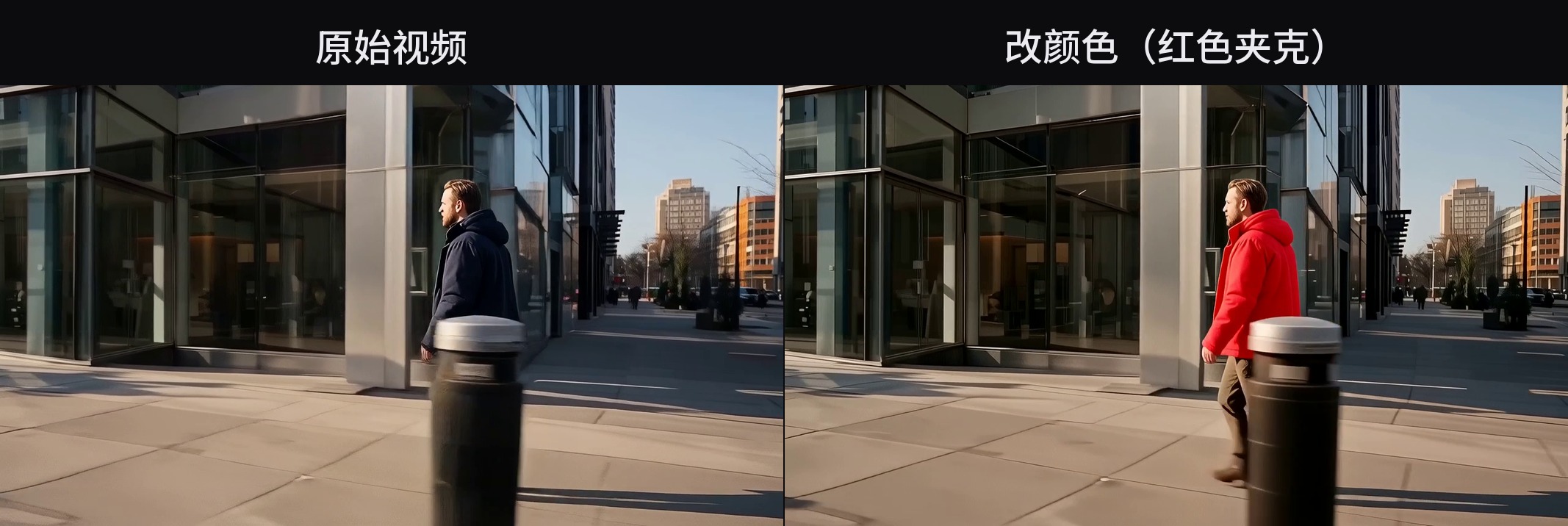

改颜色跑出来怎么样

prompt 是 “Change the jacket color to bright red, keep everything else unchanged”。

左边原始视频,右边改颜色后:

改颜色后的视频四帧截图:

什么情况下容易翻车

根据 Replicate 上其他用户的反馈和 WaveSpeed 官方博客的说明,有几类操作目前比较容易出问题:

改变物体形状(比如"把圆桌变成方桌")。模型擅长改颜色和风格,但改几何形状容易崩。

精确的局部编辑(比如"只改左边那个人的衣服")。模型对"哪个区域"的理解还不够精确,可能会误伤其他部分。

和原视频运动方向矛盾的编辑(比如原视频人在往左走,prompt 说"make the person walk to the right")。模型会很困惑。

prompt 怎么写效果比较好

几条经验:

描述你想要的结果,不要描述过程。“make it snowy” 比 “add snow falling from the sky and accumulating on the ground” 好。模型更擅长理解最终状态。

一次只改一件事。“change the background to a forest and make the person wear a red dress and add rain” 这种复合指令,模型大概率只能做好其中一两个。拆成多次编辑更靠谱。

用英文 prompt。Wan 2.7 Video Edit 对英文 prompt 的理解好于中文。中文 prompt 有时候会被误解。

prompt 末尾加保留条件。比如 “keep the person and their walking motion exactly the same”。不加的话模型可能会把不该改的地方也改了。

什么场景适合用 AI 视频编辑

AI 视频编辑目前不是要替代 Premiere。它更适合这些场景:

快速原型。拍了一段视频,想看看换个背景或者换个色调是什么效果,不用开剪辑软件,一行 API 搞定。

批量处理。有 100 段产品视频,都要统一换成品牌色背景。写个脚本循环调 API 就行。

非专业用户。不会用剪辑软件的人,用自然语言描述想要的效果,模型来执行。

但精确到像素级的编辑、多轨道合成、音频同步这些,还是得用传统工具。

视频编辑的生成时间比较长,SDK 的 timeout 建议设到 1200 秒。源视频上传后会返回一个 URL,后续所有编辑操作都可以复用这个 URL,不用重复上传。

具体的模型参数和最新版本,去 WaveSpeed 官网确认:wavespeed.ai/models

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)