探索Dify自动化测试:ollama+skyvern赋能高效测试新体验——Dify集成Ollama攻略

引言:

在 Dify 自动化测试的大舞台上,ollama 就像是一位实力超群的 “秘密武器”,发挥着不可或缺的重要作用,为测试工作带来了诸多令人瞩目的优势 。

在测试数据安全方面,ollama 的本地运行特性可谓是为数据安全筑起了一道坚不可摧的堡垒。在当今这个数据泄露事件频发的时代,测试数据的安全至关重要。传统的基于云端的测试方案,数据需要上传到远程服务器进行处理,这无疑增加了数据被泄露的风险。而 ollama 的出现,彻底改变了这一局面。它允许测试人员在本地运行模型,所有的测试数据都在本地设备上进行处理,无需上传到云端,从而极大地降低了数据泄露的风险。这就好比将珍贵的宝藏锁在了自己家里的保险柜里,只有自己拥有钥匙,外人无法轻易窥探。例如,在一些涉及用户隐私信息的应用测试中,使用 ollama 进行本地测试,可以有效地保护用户的隐私数据,避免因数据泄露而引发的一系列风险和问题。

从测试灵活性角度来看,ollama 的模型切换灵活特性赋予了 Dify 自动化测试无与伦比的灵活性。在测试过程中,不同的测试场景和需求往往需要不同的模型来支持。ollama 的模型切换功能,让测试人员可以根据具体的测试任务,轻松地切换不同的模型,从而更好地满足各种复杂的测试需求。就像一位技艺高超的厨师,可以根据不同的菜品需求,灵活地选择各种食材和烹饪工具,制作出美味可口的佳肴。比如,在对一个电商应用进行测试时,对于商品搜索功能的测试,可以使用擅长语义理解和搜索匹配的模型;而对于用户评价情感分析的测试,则可以切换到更擅长情感分析的模型,这样能够更加精准地完成测试任务,提高测试的准确性和有效性。

ollama 还能够显著提升测试效率。它高效的推理机制和优化的算法,使得模型能够快速地对测试数据进行处理和分析,生成准确的测试结果。这就好比一辆高性能的跑车,在测试的赛道上能够风驰电掣般地奔跑,快速到达终点。例如,在进行大规模的功能测试时,ollama 可以在短时间内处理大量的测试用例,大大缩短了测试周期,提高了测试效率,让开发团队能够更快地发现并解决问题,加速软件的迭代和发布。

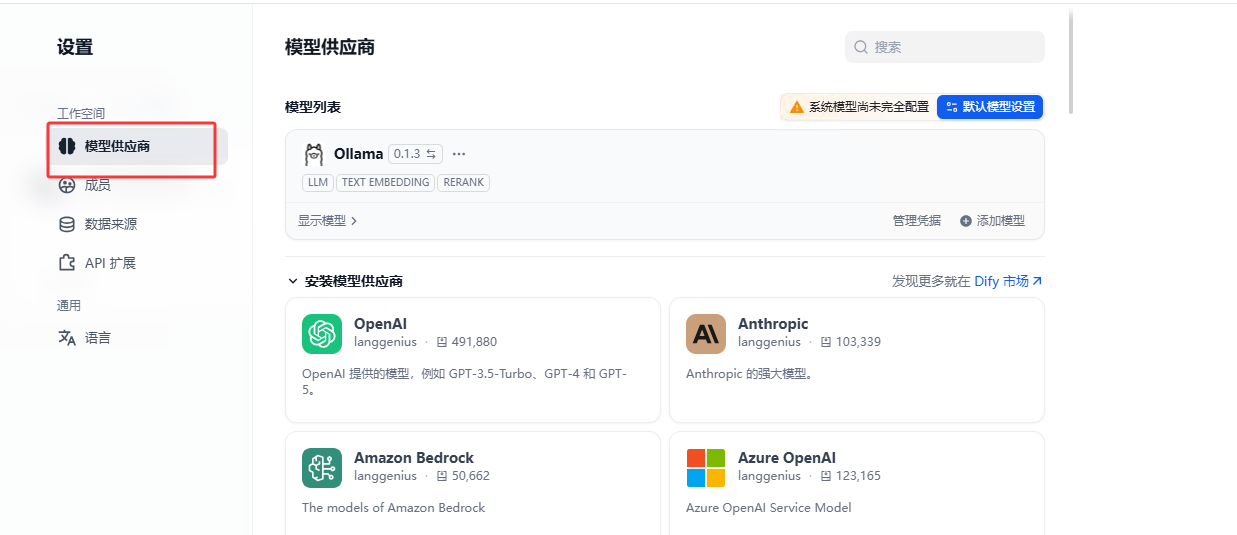

第1步:进入模型供应商设置

登录 Dify http://192.168.1.150:8080(根据自己情况)

点击右上角 头像 → 设置

左侧菜单选择 模型供应商

搜索,点击安装

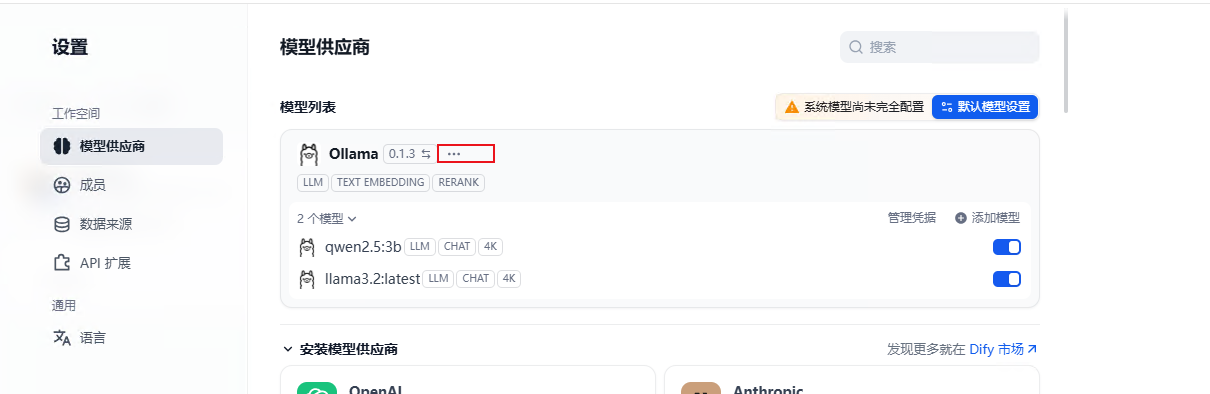

找到 Ollama,点击 添加模型

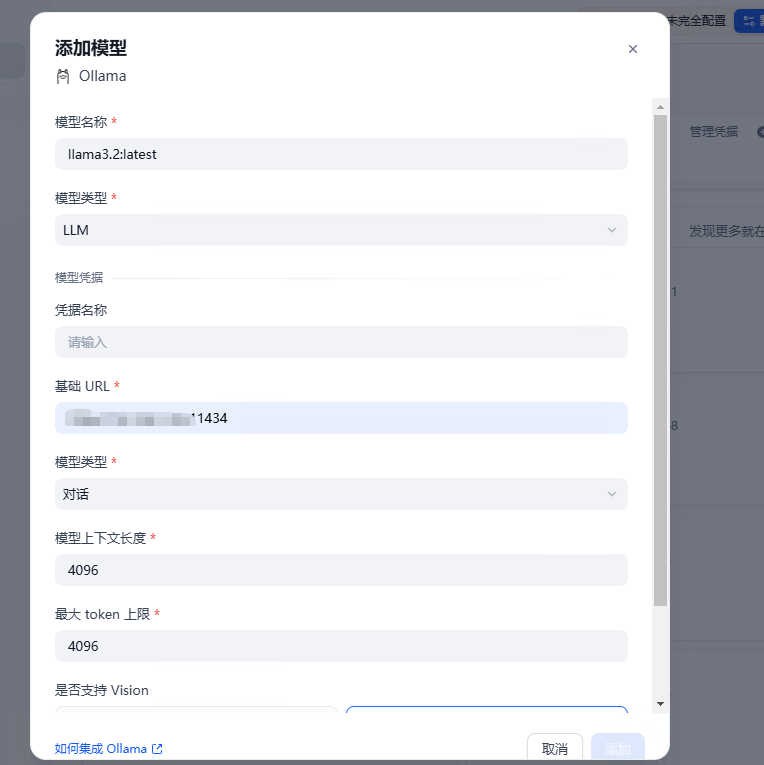

第2步:填写模型信息

模型 1:qwen2.5:3b

text

模型名称:qwen2.5:3b

基础 URL:http://192.168.1.33:11434(根据实际情况)

模型类型:LLM

模型 2:llama3.2

text

模型名称:llama3.2:latest

基础 URL:http://192.168.1.33:11434(根据实际情况)

模型类型:LLM

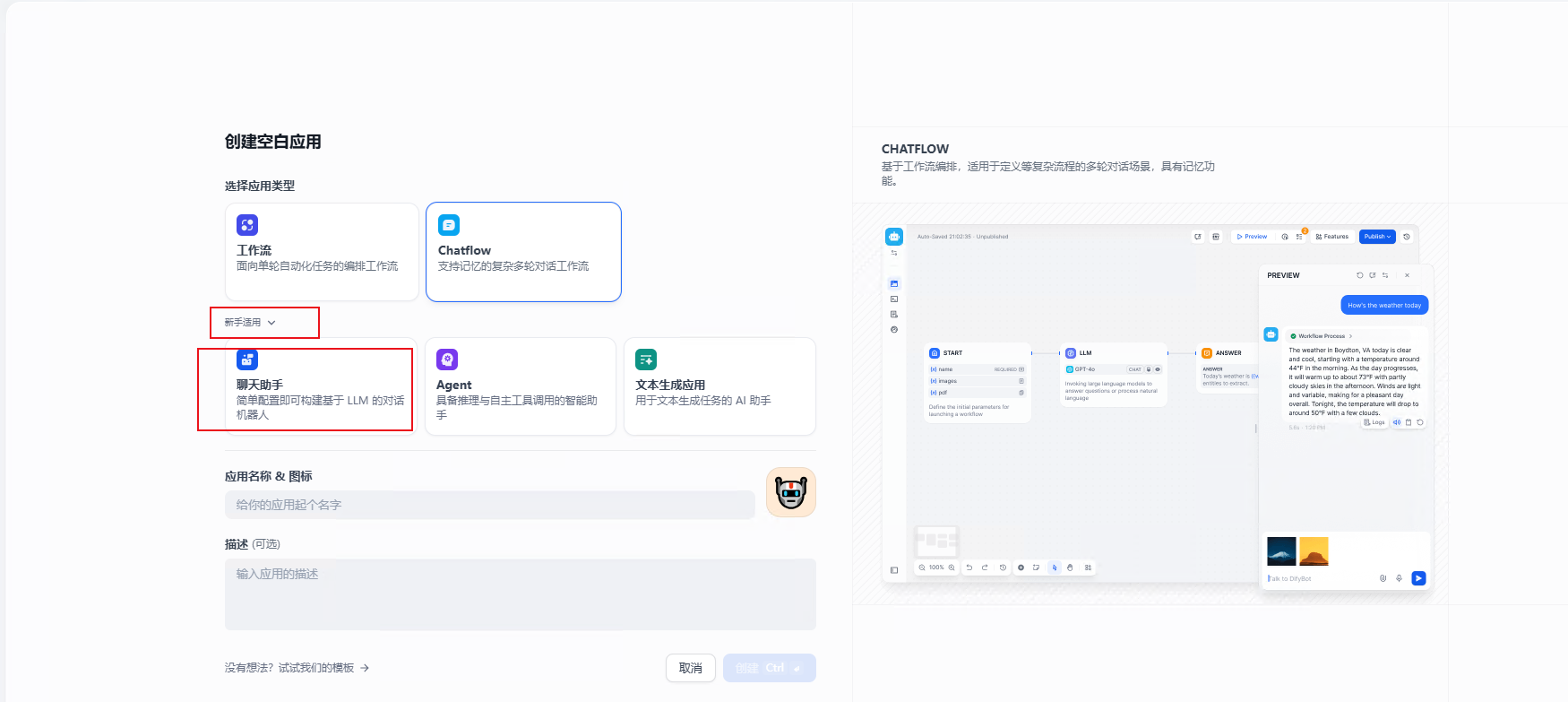

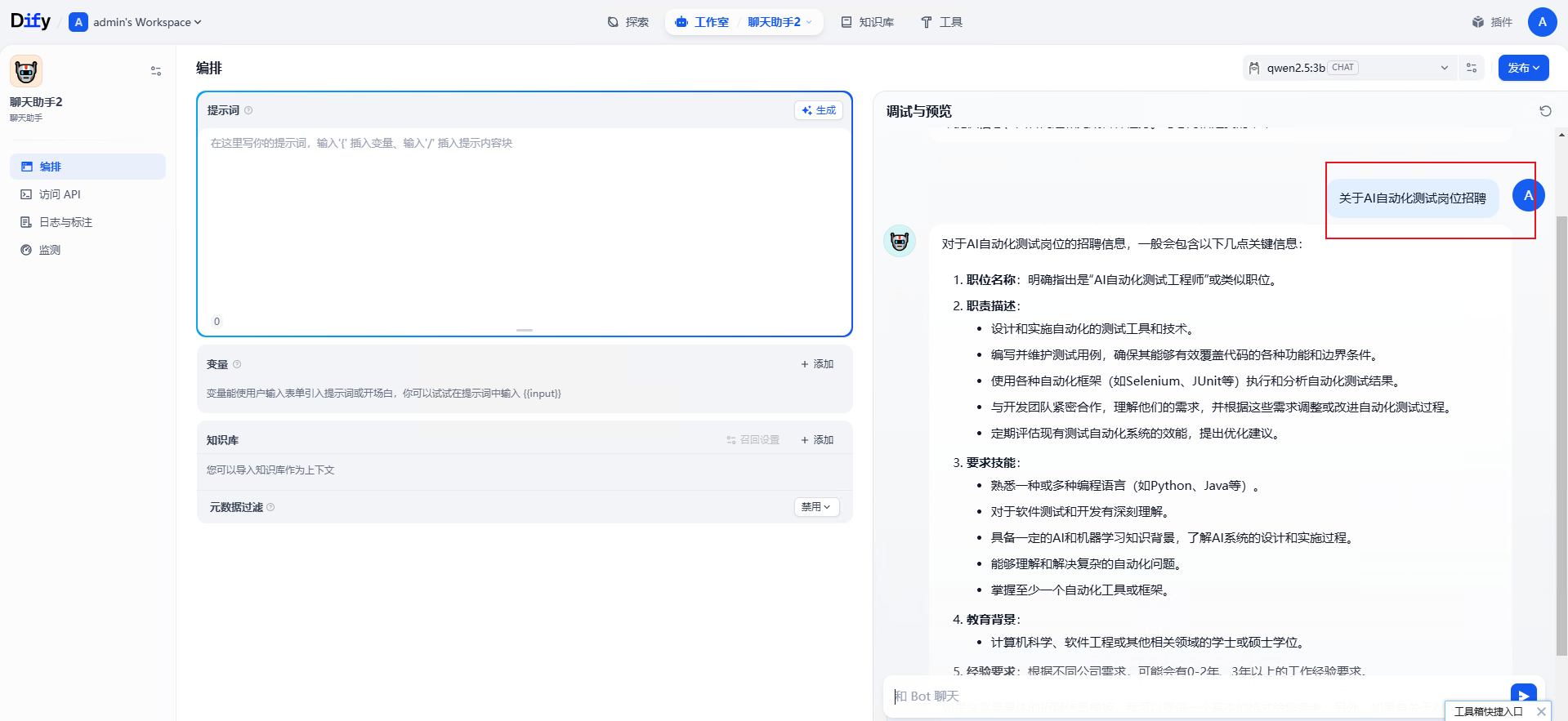

第3步:测试模型

(1)点击创建空白应用

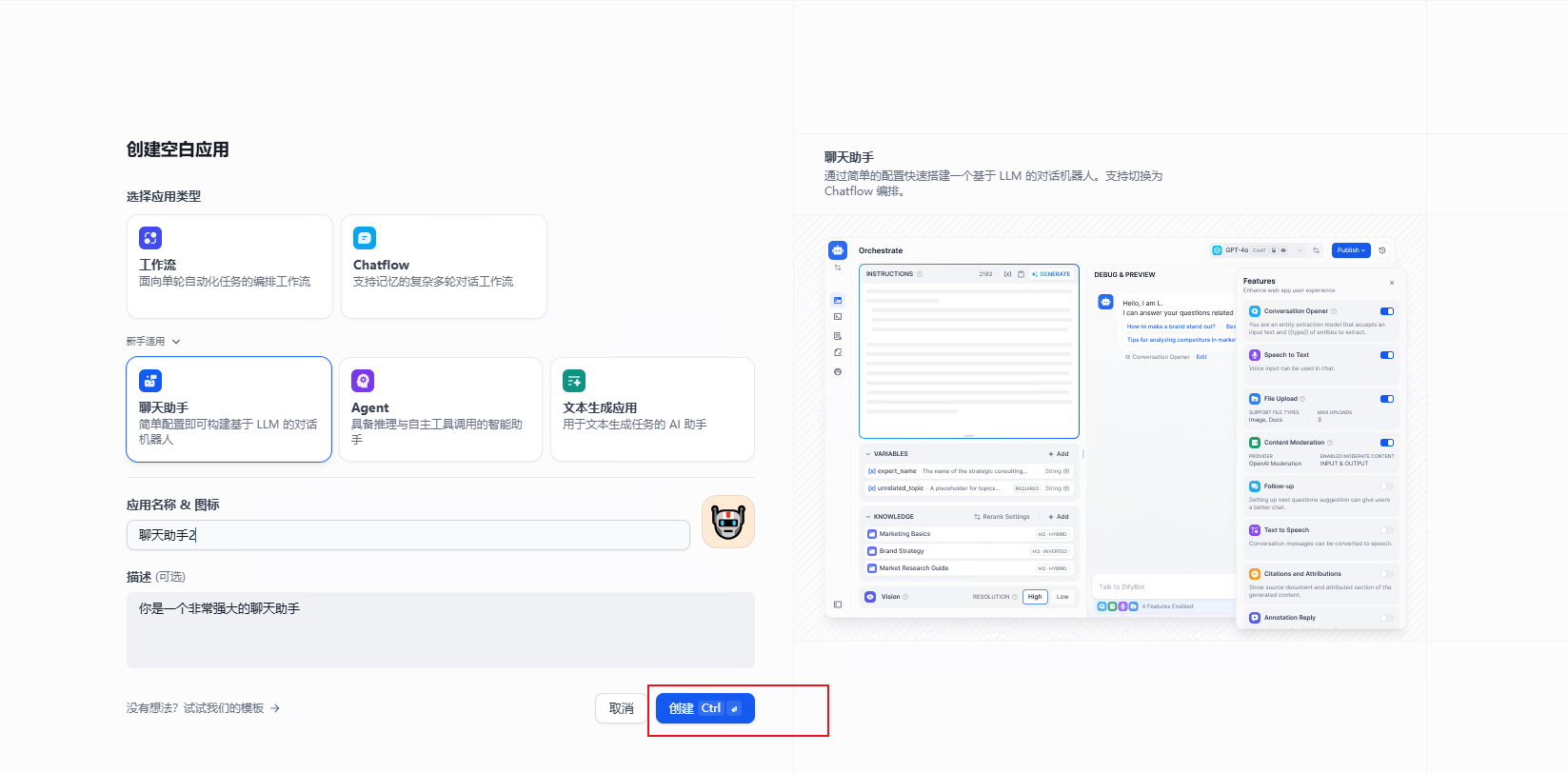

(2)点击新手适用,填写应用名称

(3)点创建按钮

(4)可以开始对话

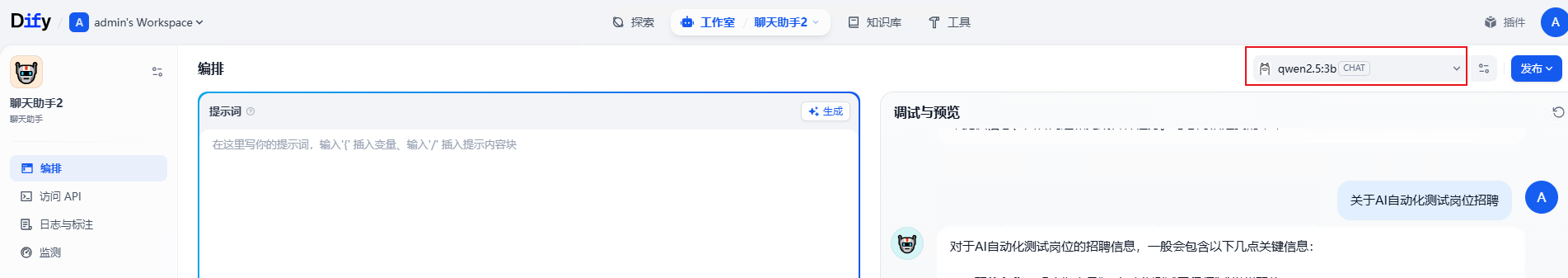

(5)切换模型

其他补充点

(1)如何移除模型

(2)如何查看模型

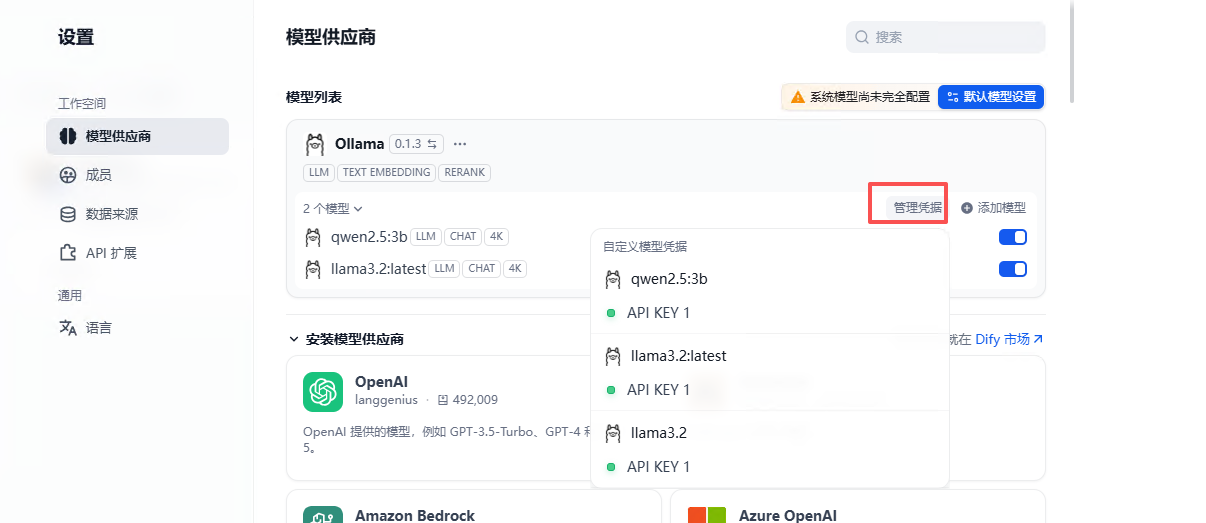

(3)如何查看具体模型具体配置信息

(4)若在centos上无法连接ollama

第1步:完全关闭 Ollama

|

# 强制关闭所有 Ollama 进程 |

第2步:用命令行启动并指定监听地址

|

# 设置临时环境变量并启动 |

第3步:验证监听地址

|

打开另一个 PowerShell 窗口,运行: |

第4步:在 CentOS 上测试

|

curl http://192.168.1.33:11434/api/tags |

第5步 如果上面的方法有效,创建永久启动脚本

|

# 创建启动脚本 |

以后每次需要启动 Ollama 时,双击桌面上的 start_ollama.bat 即可。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)