推荐5款好用Data Agent工具,这几款Data Agent工具真的强

在数字化办公的今天,我发现很多做数据分析、业务运营甚至财务的朋友,每天都要面对大量杂乱无章的数据表。很多人的痛点在于:想看某个维度的指标,却不会写复杂的SQL语句;或者好不容易导出了数据,还得在Excel里反复折腾透视表,不仅效率低,还容易出错。我一直强调,数据工具的进化方向一定是让操作更简单。为了解决这些实际困扰,Data Agent 这种技术应运而生。Data Agent 说白了就是一种具备逻辑推理和任务执行能力的智能代理。通过 Data Agent,你只需要输入普通的中文指令,它就能自动去数据库里找数、算数并直接生成图表。这种“对话即分析”的模式,让非技术人员也能轻松驾驭大数据。

开始之前给大家分享一份数字化全流程资料包,里面包括数据迁移的知识和企业数据应用的精选案例,帮你解决在数据应用、数字化转型中的实际困惑,更好地着手数据工作。有需要的自取:https://s.fanruan.com/pxb9h (复制到浏览器打开)

1 FineChatBI:国产Data Agent的深度实践者

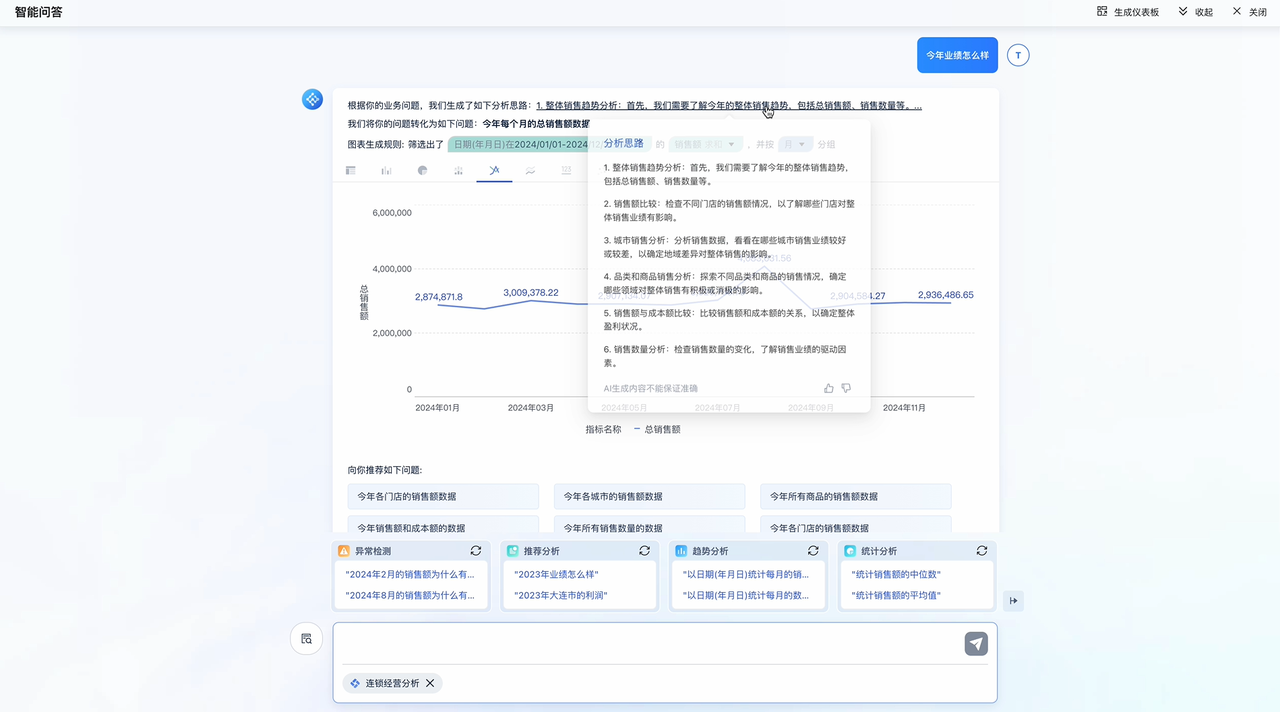

用过来人的经验告诉你,在选择 Data Agent 工具时,我们不仅要看它能生成多少代码,更要看它对业务逻辑的理解深度。FineChatBI 是目前国内在这一领域做得非常扎实的产品,它不仅是一个简单的聊天对话框,而是一套完整的智能分析系统。

它的核心逻辑在于建立了一个“语义层”。听着是不是很熟?在传统BI里,我们直接对接表字段,但表字段名往往是 order_amt_01 这种让人看不懂的代码。FineChatBI 的 Data Agent 允许我们将这些原始字段映射为人类能理解的业务指标,比如“实付金额”。这样当你问“去年双十一的实付金额是多少”时,它能准确识别你的意图,而不是在数据库里瞎撞。

在具体执行层面,FineChatBI 的表现非常稳定。它采用了意图识别、逻辑拆解、SQL生成和图表渲染的闭环流程。简单来说,当你下达指令后,后台的 Data Agent 会先思考你的问题涉及哪些维度(比如时间、地区)和哪些度量(比如销售额),然后生成对应的查询逻辑。最让我感到惊喜的是它的报错自愈能力,如果生成的代码在执行时报错,它会根据错误反馈自动修改逻辑再次运行,直到产出结果。

FineChatBI是集实时数据同步、ELT/ETL 数据处理、数据服务于一体的数据集成工具,能解决迁移过程中很多核心痛点。它支持 40 多种数据源,不管是旧 CRM 系统、本地数据库还是云端平台,基本都能覆盖,拖拉拽就能完成数据同步和处理任务,不用写复杂脚本。而且它内嵌 Spark 计算引擎,支持批量表实时同步、增量更新 and 断点续传,能很好适配全量 + 增量结合的迁移场景,还能自动处理表结构变更,避免同步过程中出现数据错乱。工具链接我放在这里,感兴趣的朋友可以上手试试:https://s.fanruan.com/x2vqb (复制到浏览器打开)

在使用过程中,FineChatBI 还支持多维度的联动分析。你懂我意思吗?就是当你通过对话生成一张区域销售图后,你可以继续追问“其中上海地区的具体门店表现如何”,它会承接上文的上下文语境,不需要你重复描述限制条件。这种连续对话的能力,才是真正符合人类思维逻辑的 Data Agent。此外,它对国产数据库的支持非常友好,安全性上也做了很多隔离,非常适合对数据敏感的企业使用。

2 Vanna:基于Python的开源Data Agent框架

如果你有一定的编程基础,或者希望在自己的程序里集成数据问答功能,那么 Vanna 是一个非常值得研究的开源 Data Agent 选项。它的逻辑非常清晰:通过 RAG(检索增强生成)技术来提升回答的准确性。

Vanna 的工作流程主要分为训练和查询两个阶段:

-

训练阶段: 你需要将数据库的 Schema(表结构)、文档描述以及一些高质量的 SQL 示例喂给它。它会将这些信息转化成向量存储起来。

-

查询阶段: 当你输入问题时,它会先去向量库里寻找最相关的表结构和示例,然后把这些背景知识连同你的问题一起发给大模型。

我发现这种模式最大的好处是“可控”。你可以通过不断补充优秀的 SQL 样本,让这个 Data Agent 变得越来越专业。简单来说,它不是在盲目猜测 SQL 怎么写,而是在模仿你给出的标准答案。对于那些表结构异常复杂的数据库,Vanna 的这种人工干预和持续训练机制能有效降低错误率。不过,它更偏向于开发者工具,没有提供像 FineChatBI 那样开箱即用的前端可视化界面,需要配合 Streamlit 或其他前端框架来展示结果。

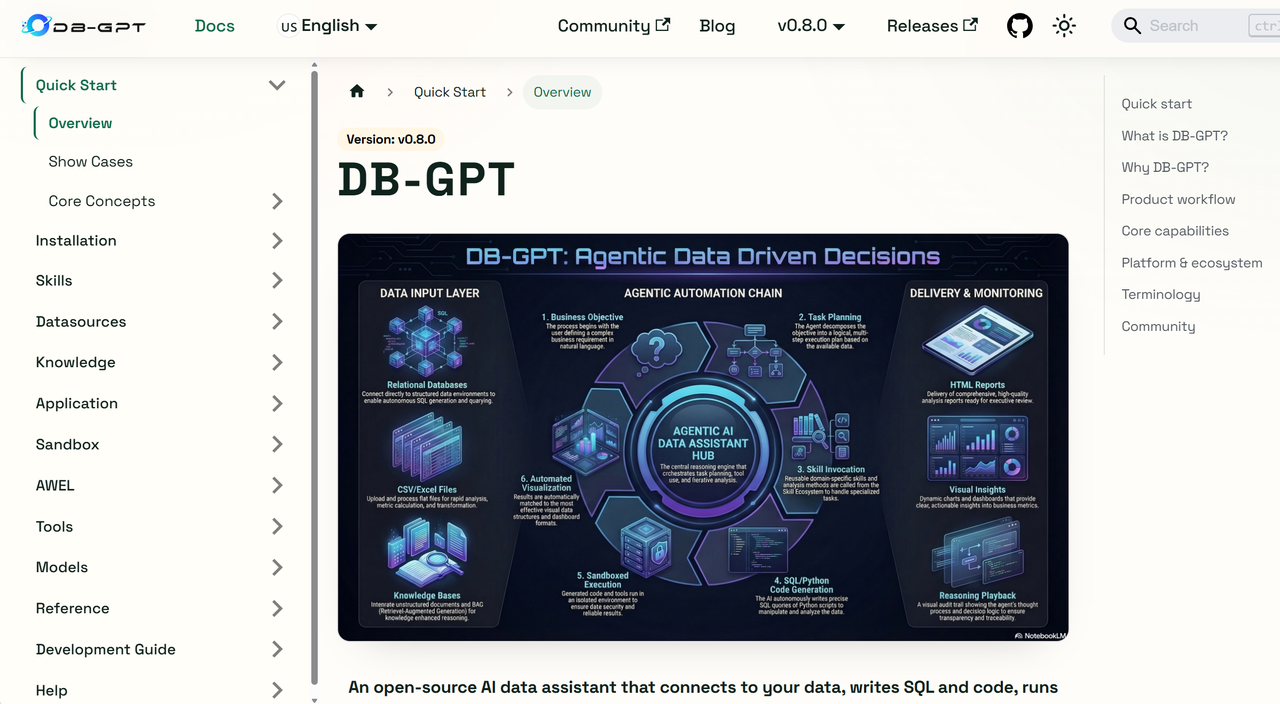

3 DB-GPT:隐私至上的本地化Data Agent方案

在数据安全日益受到重视的背景下,DB-GPT 走出了另一条路。它主打的是全栈私有化部署。用过来人的经验告诉你,很多大公司不敢用云端的 Data Agent,就是怕核心数据资产泄露。

DB-GPT 包含了一个被称为 SMMF(多模型管理框架)的结构。它可以对接本地部署的 Llama、ChatGLM 等大模型。这意味着所有的计算和查询都在公司内网完成,数据不联网。在功能上,它不仅支持 Text-to-SQL,还支持通过 Data Agent 进行知识库问答。

它在处理数据时,逻辑是非常严谨的。它会对生成的 SQL 进行预校验,防止执行那些具有破坏性的语句。此外,它还内置了数据清洗和自动特征提取的功能。你懂我意思吗?它不仅能帮你查数,还能帮你初步判断这些数据的质量。对于政府、金融等对隐私极其敏感的行业,DB-GPT 提供了一个安全且功能完备的实验场。

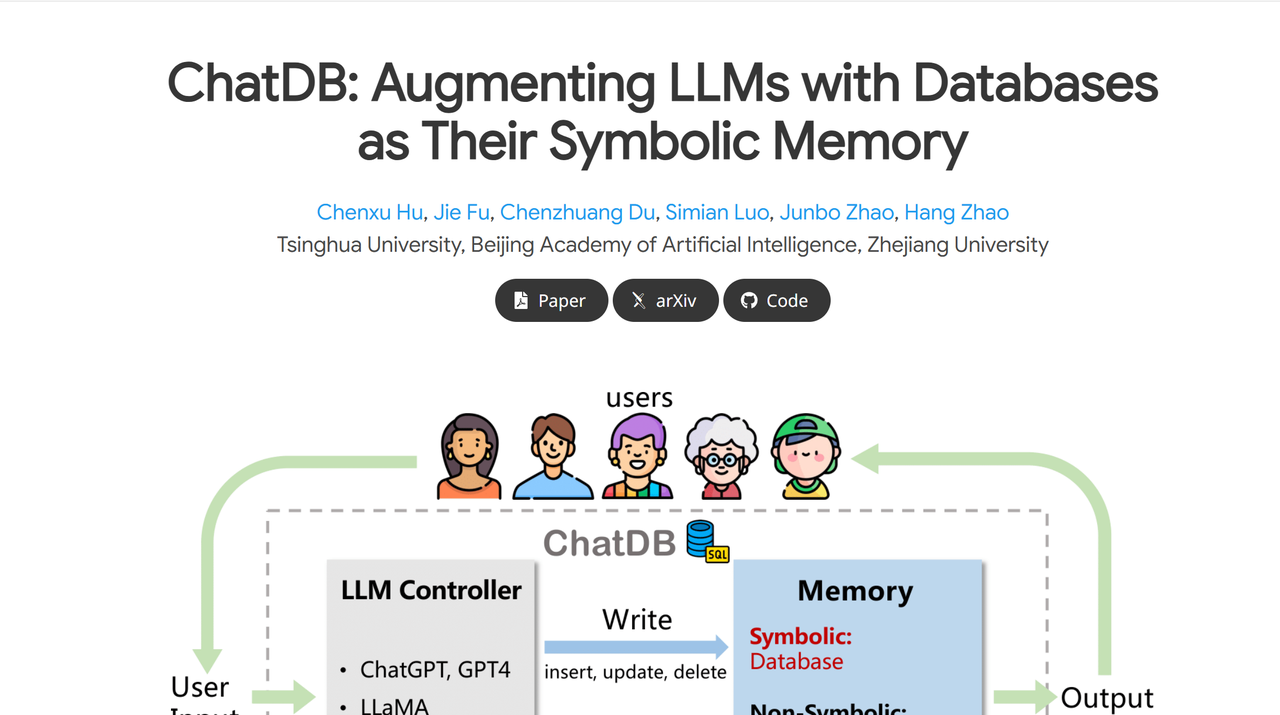

4 ChatDB:具备长短期记忆能力的Data Agent

ChatDB 是学术界和工业界结合得比较紧密的一个项目。它的核心卖点在于提出了“数据库即记忆”的概念。传统的 Data Agent 往往是即时性的,你问一个问题,它回一个答案。但 ChatDB 会把之前的查询结果、中间计算过程有选择地存储回数据库中。

这种逻辑的好处在于处理复杂的多步推理。听着是不是很熟?这就像我们写论文,需要先把基础数据查出来存好,然后再基于这些数据做二次加工。ChatDB 能够通过模拟这种“草稿纸”的行为,解决大模型上下文长度限制的问题。

在实际操作中,如果你要求它做一个覆盖全年的复杂财务审计,它会把每个月的异常项先记录在临时表里,最后再统一汇总分析。这种具备“工作流”意识的 Data Agent,代表了未来更高级形态的发展方向。虽然目前它的社区活跃度不如 Vanna,但其底层的逻辑设计非常有前瞻性。

5 LangChain SQL Agent:灵活的自定义构建工具

最后要介绍的是基于 LangChain 框架的 SQL Agent 模块。这其实是目前很多商业化 Data Agent 产品的底层基石。如果你想从零开始理解 Data Agent 是怎么跑起来的,一定要去读它的源码。

LangChain SQL Agent 提供了一组预设的工具集,包括:

-

查询表结构工具: 自动获取库里有哪些表,每张表有哪些字段。

-

执行 SQL 工具: 运行代码并返回结果。

-

语法检查工具: 修正 SQL 里的低级错误。

它采用了典型的 ReAct(推理+行动)模式。模型在思考时会输出类似:“我需要先看看表结构,所以我调用 list_tables ;看到有销售表了,我再调用 schema_info 确认字段;最后我写出查询语句并运行。”这种透明的思考过程,让开发者能够非常清晰地定位到底是哪里出了问题。虽然它需要你写 Python 代码去串联,但它的灵活性无与伦比,你可以随意更换底层的 LLM,或者加入自己定制的业务约束规则。

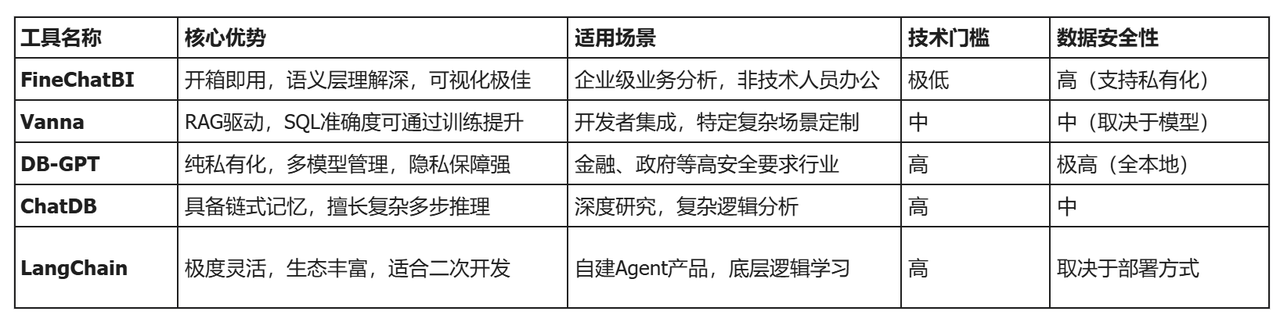

6 Data Agent 工具选型总结表格

为了方便大家快速选择,我根据实际测试经验,整理了一份对比表:

Q&A 常见问答

Q1:Data Agent 生成的 SQL 不准确怎么办?会影响数据库安全吗?

A: 这是一个非常现实的问题。说白了,目前的 Data Agent 还没到 100% 完美的程度。为了保证准确性,像 FineChatBI 这样的工具会引入“语义层”配置,通过人工预定义指标来辅助模型理解。至于安全,成熟的工具都会配置“只读账号”,Data Agent 只有查数的权限,没有删改权限。我一直强调,工具只是辅助,最后的关键数据还是要由人来审阅确认。

Q2:小白使用 Data Agent 需要学习复杂的提示词工程吗?

A: 用过来人的经验告诉你,如果是用 FineChatBI 这种已经产品化程度很高的工具,基本上不需要学习提示词。你直接像和同事说话一样提问就行。但如果你是用 LangChain 这种框架自建,那你确实需要花精力去调优 Prompt。对于大多数人来说,选择一个成熟的商业化产品是效率最高的路。

Q3:Data Agent 和传统的固定报表相比,最大的优势是什么?

A: 最大优势在于“敏捷”。听着是不是很熟?业务需求是随时在变的。传统报表你得找技术改代码,等一周都算快的。而通过 Data Agent,你拍脑门想到的新维度,三秒钟就能出结果。你懂我意思吗?它把数据消费的权利真正交还给了业务人员,让数据真正流转起来,而不是死在报表服务器里。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)