企业实训|NV智算集群技术实训-某软件上市公司

4月01-02日北京,TsingtaoAI智算技术团队为某软件上市公司交付NV智算集群技术实训。实训以英伟达A100服务器和InfiniBand网络为核心,系统梳理硬件选型、网络拓扑设计(Rail-optimized架构与万卡集群收敛比优化)、存储加速(GPUDirect Storage直连NVMe、多级缓存体系)等关键环节。重点突破NCCL通信库调优(Ring+Tree混合算法、LL128协议参数优化)、容器化部署(NVIDIA Container Toolkit深度集成)、及集群稳定性验证(72小时负载测试+故障注入模拟)。针对行业高频痛点,深度解析“GPU利用率虚高”背后的内存带宽瓶颈、光模块失效的带内监控预测,以及国产昇腾/海光与NVIDIA混合组网的生态适配难题。通过Blackwell架构演进、MFU量化分析等前沿实践,将验收标准与实际运维场景深度结合,助力一线工程师从交付执行者向架构决策者跨越。

实训时长:2天,每天7小时

01号上午

1.1 智算集群整体架构认知

- 计算集群的发展与挑战 (传统数据中心 vs 智算中心的本质差异 )

- 集群基础建设介绍(AI 服务器节点、风冷液冷,服务器机柜)

- GPU 服务器topo 结构

1.2 先进算力资源的网络关键技术

- InfiniBand vs RoCE:性能对比与选型依据(带宽、延迟、丢包容忍度)

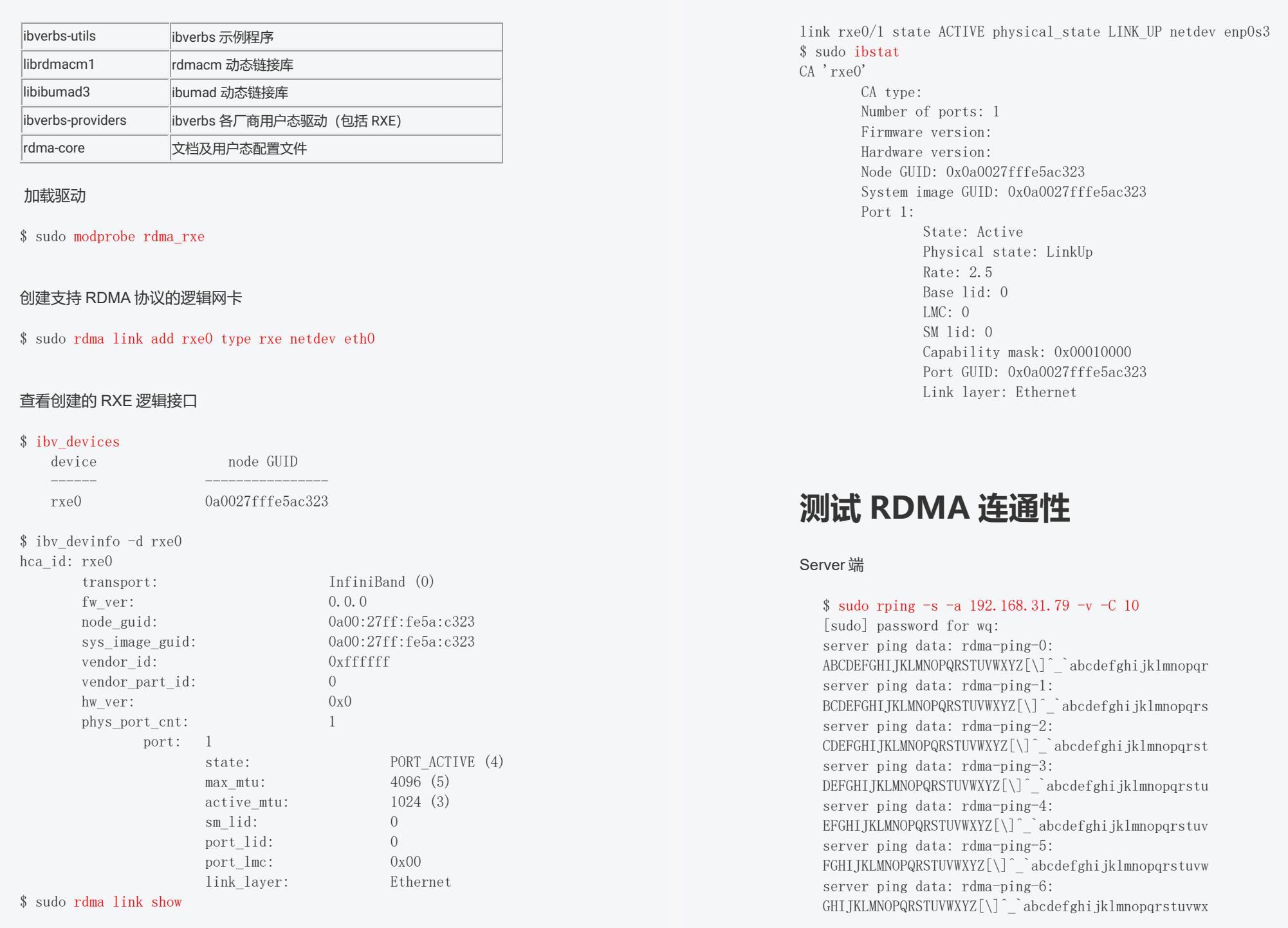

- RDMA技术原理:零拷贝、内核旁路如何提升效率

- 先进算力nvLink、PCIe拓扑:节点内GPU互联的带宽瓶颈分析

- PFC(优先级流控)与ECN(显式拥塞通知)配置要点

RDMA的技术原理

网络拓扑设计

- 单轨网络,多轨网络deepseek 经典设计

- Rail-optimized拓扑 vs 传统Spine-Leaf的区别

- 万卡 AI 集群建设挑战、交付与测试

- 先进算力 Blackwell 与 先进算力L72 超节点演进(集群与互联)

集群性能分析与测试

- 环境准备:配置IB网卡IP、验证RDMA功能

- 使用ib_write_bw/ib_read_bw测试双向带宽

- 使用perftest工具验证延迟指标

- 对比TCP vs RDMA的性能差异

- 理解RDMA的性能优势,掌握基础测试工具

存储架构与GPUDirect技术

- 训练阶段:数据集加载(TB级顺序读)、Checkpoint保存(周期性爆发写)

- 推理阶段:模型参数加载、KV Cache的内存-存储协同

- 存储性能三要素:IOPS、带宽、延迟的权衡

- 痛点分析:大模型 CKPT优化手段

高性能存储架构设计

- 训练数据加载与存储优化与存算架构的思考

- GPUDirect Storage:绕过CPU直接访问存储的原理

- 多级缓存体系:内存-先进算力Memory并行文件系统的数据流设计

- 使用GPUDirect Storage API加速数据加载(模拟场景)

01号下午

千卡集群交付流程

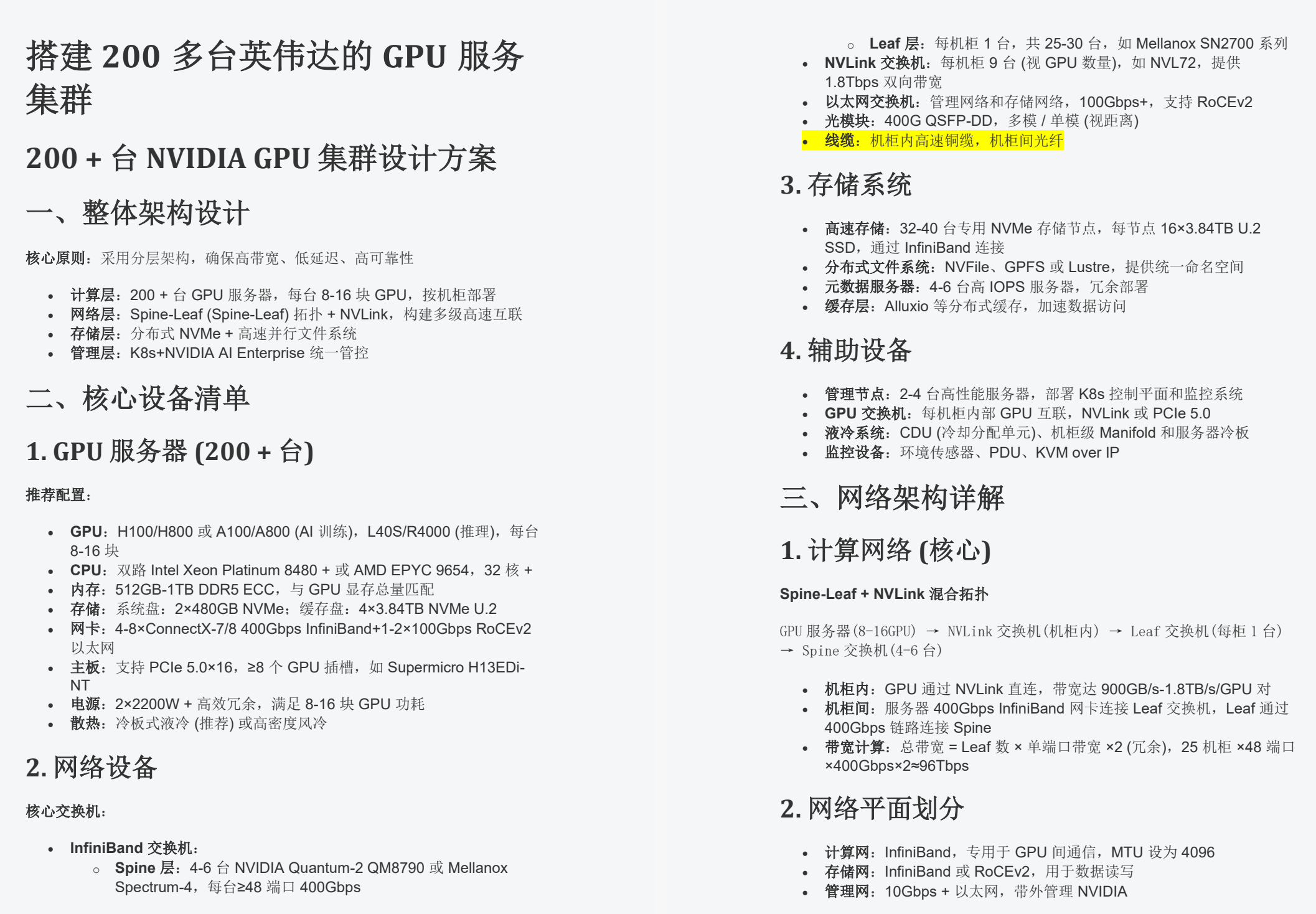

3.1 硬件选型与规划

- GPU选型:A100 vs H100 vs H20的算力/功耗/成本对比

- 网络设备选型:IB交换机的端口密度、收敛比计算

- 服务器配置:CPU/内存/先进算力的配比原则

英伟达 GPU选型

3.2 集群建设全流程

- 需求分析→方案设计→硬件到货→上架布线→系统安装→功能验证

- 硬集与软集的区别:物理组装 vs 软件配置的职责划分

- 痛点:如何避免硬件批次差异导致的兼容性问题?

- 案例:某千卡集群交付复盘

英伟达GPU集群设计方案

IB网络自动化配置

- 拓扑发现:使用ibnetdiscover生成网络拓扑图

- UFM架构与功能

- 软件架构:管理节点+Agent部署模式

- 核心功能:拓扑可视化、性能监控、固件升级

- 对外接口:REST API、CLI、Prometheus集成

3.4 IB网络配置与UFM监控

- 手动配置IB子网管理器(OpenSM)

- 使用ibdiagnet诊断链路状态

- 演示UFM界面(视频/截图,受限于无交换机)

- 掌握IB网络的基础运维命令

NCCL通信原理

- 集合通信操作:AllReduce、AllGather、ReduceScatter的区别

- NCCL的通信算法:Ring、Tree、Ring+Tree的适用场景

- 通信协议:Simple vs LL vs LL128的性能差异

- 原理图解:单机8卡AllReduce的数据流向

NCCL环境变量详解

- 核心变量:NCCL_ALGO、NCCL_PROTO、NCCL_NTHREADS、NCCL_MIN_NCHANNELS

- 网络相关:NCCL_IB_DISABLE、NCCL_SOCKET_IFNAME、NCCL_NET_GDR_LEVEL

- 调试变量:NCCL_DEBUG、NCCL_DEBUG_SUBSYS

单机多卡NCCL测试

- 使用nccl-tests测试单机8卡AllReduce带宽

- 对比nvLink vs PCIe的通信性能

- 调整NCCL环境变量观察性能变化

- 常见问题:GPU看得到但NCCL初始化失败的排查思路

疑难问题研讨

- 问题1:网络不丢包,但AllReduce带宽达不到设计值

- 排查思路:检查NCCL_ALGO、确认IB链路状态、验证GPU拓扑

- 问题2:GPU利用率90%+但训练慢

02号上午

大模型训练任务和推理任务的混跑的碎片化解决方案

- 分层解决方案(技术栈)

- 第一层:硬件与系统级隔离

- 第二层:运行时级调度与抢占

- 第三层:框架级优化与自适应

- 一个典型的混合部署策略示例

训练出错,快速判断算法问题还是硬件问题的一站式解决方案

- 硬件问题的典型特征

- 算法/代码问题的典型特征

- 系统性排查步骤(实战流程)

如何处理慢节点拖累整个集群的问题?

- 短期应急(止血) 重启任务/节点

- 中期优化(治标) 资源隔离与保障

- 长期预防(治本) 建立硬件健康度基线

重点阐述:

GPU 利用率“看起来很高”,但训练效率依然很低,先进算力-smi 显示 GPU Util 90%+,实际每 step 时间明显偏慢

容器环境搭建

- Docker vs Singularity/Enroot在HPC场景的选择

- Container Toolkit原理:如何让容器访问GPU

- 镜像构建:基础镜像+CUDA+PyTorch+训练代码的层次

- 网络命名空间:容器内如何使用宿主机IB网络

容器化部署大模型

- 拉取NGC官方PyTorch镜像(离线环境需提前准备tar包)

- 编写Dockerfile安装依赖(transformers/flash-attention等)

- 使用docker run启动容器并挂载数据集

- 运行某小尺寸模型测试训练流程

模型训练实战

- 使用torchrun启动多卡训练(DistributedDataParallel)

- 监控工具:先进算力-smi、dcgm-exporter实时查看GPU状态

- 训练日志分析:loss曲线、吞吐量(samples/s)、MFU计算

- 常见错误:CUDA OOM、通信超时的快速定位

模型训练

运行某小尺寸LLM预训练任务(尺寸视内存而定)

调整batch size/gradient accumulation观察显存占用

使用tensorboard可视化训练曲线

性能对比:单卡 vs 多卡的加速比分析/尝试开启混合精度训练(AMP)

02号下午

测试方案设计

- 测试维度:计算性能、通信带宽、存储IOPS

- 测试工具链:

- GPU计算:CUDA Samples、cuBLAS benchmarks

- 网络:nccl-tests、ib_write_bw、SHARP测试

- 存储:FIO、IOR

- 验收标准制定:如何设定合理的性能基线?

GPU基线性能测试

- 运行CUDA Samples中的bandwidthTest、deviceQuery

- 使用HPL/HPCG测试峰值算力

- GPU Burn压力测试:长时间满载运行检测稳定性

- 静默错误检测:使用dcgm-diag的诊断功能

- 记录:整理测试数据形成测试报告模板

稳定性测试方法

- 长时间负载测试:72小时连续训练任务

- 故障注入:模拟GPU掉卡、网络抖动场景

- MFU(Model FLOPs Utilization)测试:计算有效算力利用率

运维工具体系

- UFM深度实践:

- 部署架构:HA模式、数据库选择

- 监控指标:链路流量、错误计数、温度/功耗

- 告警配置:如何设置阈值避免误报

- API集成:通过REST接口对接运维平台

- DCGM(Data Center GPU Manager):

- 架构:Host Engine + Agent模式

- 健康检查:周期性诊断GPU状态

运维工具部署与监控

- 部署DCGM并配置Exporter

- 编写Grafana Dashboard展示GPU指标

- 模拟故障:拔掉光模块观察UFM告警(视频演示)

- 使用dcgmi命令行工具查询GPU健康状态

- 智算中心光模块故障率高,如何通过带内监控提前预测光模块失效

- 搭建一套可用的监控系统

资源调度与隔离

- Slurm vs Kubernetes在AI集群的适用性

- GPU共享与MIG(Multi-Instance GPU)技术

- 训练任务(独占) vs 推理任务(零散)的资源隔离策略

- 痛点:碎片化问题如何通过调度器解决?

国产芯片混合组网

- 华为昇腾、海光与英伟达的生态差异

- 混合算力中心架构设计:网络隔离 vs 统一调度

- 挑战:驱动版本管理、框架适配的复杂度

推理架构设计

- 并行策略:Tensor Parallelism vs Pipeline Parallelism

- Prefill-Decode分离架构

- 推理框架:vLLM、TensorRT-LLM、FasterTransformer对比

- 案例:如何实现毫秒级推理延迟

部分实训课件

实训技术专家

熊工 AI智算技术专家

中国农业大学计算机硕士,研究员高级工程师,华为云AI专家组成员,西安电子科技大学企业导师,浙江大学人工智能中心研究员,阿里云AI训练师认证教材和题库系统专家,主要研究方向为大语言模型、人工智能、云计算、GPU算力运维与调优、自然语言处理、CV视觉模型、汽车智能驾驶。从早期的智能搜索引擎,到华为盘古大模型云引擎研发,到阿里云百炼智能平台应用开发,再到扣子平台智能体应用开发,一直深耕于自然语言处理处理、AI大模型领域。

华为培训中心资深IT认证培训专家,国内顶级架构设计、软件开发专家。具有坚实的学术背景和教学培训经验,多年研发和客户项目高级管理咨询能力。近20年系统开发经验,5年以上授课经验。

在技术平台方面,主要是擅长培训两块内容:一是人工智能和大模型,精通整个体系的培训工作,包括Python语言,Python web,Numpy,Pandas,Matplotlib,爬虫,机器学习的十大算法线性回归,逻辑回归,逻辑回归,聚类,支持向量机,关联规则,协同过滤,深度学习的卷积神经网络,循环神经网络,长短期记忆,对抗学习,强化学习,大模型LLAMA,LLVM等引擎构建技术,以及最后的大模型应用案例实现。二是知识库、智能体和MCP应用,精通整个体系架构,包括提示词工程, LLM、LangChain等技术的开发与应用。深入理解智能体、工作流、语言助手等平台应用开发技术。对于大模型体系有深刻认识,及独到的见解。已经参与了数十个AI大模型应用项目研发,并主导系统设计和优化,有着丰富的大模型系统设计开发工作经验。

精研课程

- 人工智能机器学习算法

- 大模型训练

- 自然语言处理文本处理实践—文本自动摘要、文章自动生成

- 基于深度学习的知识图谱实战

- 基于深度学习的个性化推荐系统实战

- DeepSeek提示词工程

- 基于DeepSeek的大模型微调技术

- DeepSeek的RAG技术--知识库开发

- 阿里云人工智能训练师认证培训

- 基于Dify平台的智能体开发

- Ollama+DeepSeek+Dify平台开发最佳实践

近期主要培训和咨询内容:

杭州阿里巴巴:2024年11月,12月,2025年2月,3月,4月,在阿里总部西溪园区进行。每期培训都通过5天的的AI训练师认证培训工作,培养阿里云生态内外的AI训练师以及师资,以实现阿里云百炼平台,QuickBI,QuickService 等多个AI平台应用的推广,提升学员的智能体开发能力。

四川移动:2024年11月,大模型知识库调优(九天大模型,ChaGPT,ChatDB),通过一周的技术实战培训,提升移动在线团队(10086)的语言助手智能水平,并将相关技术应用到了四川移动在线的内部平台。

宝马汽车:2024年12月,基于github copilot的AI编程开发技术应用,通过3天的技术实战培训,提升汽车软件开发团队的智能编程能力,并将微软云的智能编程工具接入研发团队的内部平台。

博世苏州:2025年1月,基于微软云AI编程开发工具技术,包括github copilot以及相关组件的应用,提升团队编程开发和软件测试的智能化水平。同时帮助团队将Azure接入团队开发的内部平台。

中国移动设计研究院:(2024年1月,3月,7月,12月,2025年4月等)大模型底层设计和优化。经过多轮培训和持续的咨询工作,采用基于GPU集群的算力,优化LLVM,LLAMA2在内的大模型引擎技术,提高了大模型引擎的稳定性和拓展能力。引入了去中心化集群技术和跨域资源调度技术,提高了大模型底层引擎的可靠性和可维护性。

除此以外,对上层的基于自然语言处理的大模型应用进行指导和应用。包括提示词的编写,文字和图片的生成,视频的生成等应用,优化生成资源的精准度,提升生成资源的速度,并开发与外部系统之间的接口,目前已有超过百种外部应用接入了大模型,显著提升了生产能力,大大超过客户了之前对此次培训和咨询的预期。

福州信产亿力公司:2025年4月25-26日,基于DeepSeek和Dify的智能体应用开发实践。包括平台搭建,智能体构建,提示词工程以及基于RAG的知识库构建应用。并将相关技术应用到智能办公和智能问答等方面。

北京中国民航开发中心(CAST):2025年4月,基于DeepSeek等大模型的AI编程技术开发。经过一个多星期的培训和咨询工作,提升了相关AI编程工具的使用能力,帮助客户构建了基于私有云的AI编程内部平台,从源头提升了研发生产力。

内蒙电力数字化和智能体应用:2025年5月下旬,经过10天的培训,帮助客户构建了基于office和WPS的私有大模型办公平台。除此以外,构建了基于一体机的Dify+DeepSeek+Ollama的智能体和直属库开发应用平台,提升企业内部数字化能力和自动化流程能力

王工 AI Infra技术专家

【教育背景】

2009/09 – 2013/07 华南理工大学(985)

2013/09 – 2014/07 华南理工大学(985)

【专业技能】

- 熟悉CUDA开发,包括算子优化、GPU虚拟化、容器/MIG、直通VM等关键技术;掌握ROCE交换机的性能调优、故障定位,以及网卡虚拟化等关键技术。

- 具备端到端完成智算平台建设的能力,从物理机裸金属IaaS到K8s的PaaS平台,以及相关SaaS能力,掌握整个智算平台生命周期建设能力。

- 熟悉高性能并行文件系统Lustre的基本原理和集群建设,掌握故障排查和优化方法。

- 精通LLM大语言模型训练框架,熟练运用PyTorch+FSDP/DeepSpeed/Megatron3D并行,及其LoRA微调、有监督微调、强化学习。

- 熟悉Transformer大模型的优化技术,包括KV-cache、Paged-Attention、Prefix-Cache,以及PD分离性能调优。

- 熟悉Diffusion扩散模型及其常用Cache/DiT加速,以及FastVideo蒸馏优化。

- 精通大语言模型、多模态模型推理加速,基于vLLM/sglang推理框架实现DP并行、PD分离(xPyD推理加速)、EP并行加速,以及LM-cache推理加速、HiCache多层级offload推理加速。

- 熟悉LLM原理、文生图、图生图、文生视频推理加速,涵盖SD模型、Qwen模型和Hunyuan模型。

【工作经验】

2015 – 至今 | HW公司

职位:研发专家(负责AI训练推理平台建设)

项目职责与核心成果:

- 负责GPU集群建设

- 基于K8s/Docker完成了GPU调度和Topo调优。

- 完成GPU虚拟化,包括硬件虚拟化和软件虚拟化,以及IB的虚拟化和多租户能力。

- 完成GPU的监控、故障预警及可视化,解决软硬件故障及其各种疑难杂症。

- 训练推理AI-Infra平台建设

- 规划训练推理平台的核心能力:训练平台、推理平台、数据管理平台。

- 规划大模型训练、微调、推理、测评、服务化的一站式能力。

- 规划Volcano+Trainer+PyTorch+LWS应用层核心能力。

- 华为昇腾(CANN)系列研发

- 具备在Atlas 800I A2数据中心推理服务器的训练、微调能力。

- 具备在910B的适配、部署、调优、故障定位及Ascend-C算子开发能力。

- 成功在910B上完成Qwen-3、DeepSeek-R1/V3系列的适配和调优。

- 英伟达GPU系列研发

- 熟悉各类GPU设备(5090、A100、L40s、H20、H100等),具备深厚的开发功底。

- 基于A100+IB+PyTorch+Megatron完成了千卡大模型训练,MFU达45%+。

- 基于A800+PyTorch+DeepSeek完成了百卡规模的大模型训练,MFU达42%+。

- 基于4机32卡H20完成了sglang的DP并行优化(3x)。

- 基于16机108卡H20完成了sglang的PD分离优化(5x)。

- 基于16机108卡H20完成了基于LM-Cache的sglang优化(5x)。

- 基于16机108卡H20完成了基于3FS的sglang优化(10x)。

- 基于Qwen-Image(Qwen-Image-Edit)实现文生图、图生图10x的优化。

- 基于2机16卡H20实现了文生视频20x的优化加速。

- 在Thor低功耗设备上完成了sglang的推理加速。

关于TsingtaoAI

TsingtaoAI是一家专注工业具身智能领域的国家高新技术企业,旗下北京、宁波等地设有研发及运营团队。核心团队主要来自韩国首尔大学、中国农业大学、北京科技大学、蔚来汽车、美团、京东、硅基流动等产研组织,拥有深厚的AI Infra与机器人算法积淀。公司通过自研的通用PoC实验底座与多模态Agent编排引擎,为工业制造、高校实训等场景提供从数据生成、算法训练到即时部署的全栈解决方案。

TsingtaoAI解决具身智能落地最后一公里工程难题。构建一个高效、低成本、可复制的具身智能技能任务开发平台,将平台与具身大模型和异构端侧计算单元组成面向工业企业的物理AI软硬一体化解决方案。获24项AI领域知识产权,包括多模态大模型具身智能实验实训系统等。关键算法基于RISC-V芯片和昇腾NPU优化适配,实现突出性能。项目获长三角算力算法创新大赛冠军,山东省人社厅数字工程师大赛二等奖,宁波AI大赛二等奖、北京东城AI科创大赛技术创新组前三名,WAIC CICC大赛具身智能赛道前三名,入选河北垂直大模型应用场景名单。通过华为昇腾兼容性认证,在一汽集团、保时捷和福建奔驰等企业落地。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)