AI Agent工作流分布式追踪实战:OpenTelemetry从黑盒到透明化的调试方案

一、背景与挑战

在构建复杂的AI Agent工作流时,你是否遇到过这样的调试困境:一个包含数据获取、多模型推理、结果整合的流程突然失败,却无法快速定位具体卡在哪一步?日志分散在各个组件,指标只能告诉你"有错误",但无法还原完整的执行链路。

随着AI Agent从简单问答演进到复杂的多步骤协作系统,传统的监控手段已捉襟见肘。典型的AI Agent系统可能包含数据预处理、多模型协同推理、外部工具调用、长时间运行的多步骤决策过程等复杂环节。

二、为什么AI Agent工作流需要分布式追踪?

传统监控工具在AI Agent场景下面临三个主要挑战:

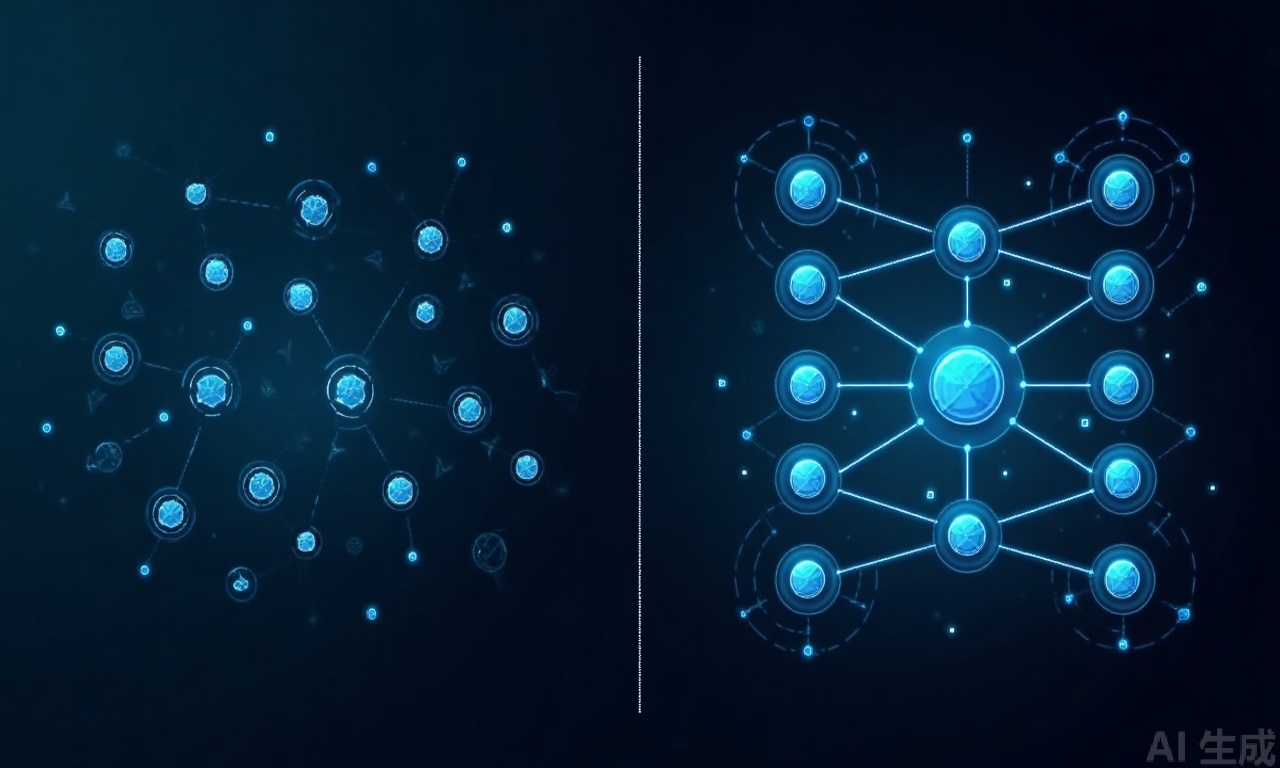

2.1 信息孤岛问题

日志分散在各个组件中,缺乏关联性。当故障发生时,你需要像侦探一样在不同日志文件中寻找线索,手动拼接时间线。

2.2 上下文断层

异步执行和多步骤工作流中,传统的请求-响应模式被打破。一个用户请求可能触发数十个内部步骤,每个步骤又可能并行执行,传统监控难以捕获这种复杂的因果关系。

2.3 性能分析困难

指标只能告诉你"系统慢",但无法告诉你"哪里慢"。是网络延迟?是模型推理时间?还是外部API调用卡住?

三、OpenTelemetry基础概念

OpenTelemetry作为CNCF毕业项目,已成为云原生可观察性的标准。在AI Agent场景中,我们需要理解三个核心概念:

3.1 Trace(追踪)

表示一个完整的工作流执行。比如"处理用户查询"就是一个Trace,它包含了从接收请求到返回响应的所有步骤。

3.2 Span(跨度)

Trace中的单个工作单元。在AI Agent中,每个步骤都可以是一个Span:数据获取、模型A推理、模型B推理、结果整合等。

3.3 Context(上下文)

在Span间传递的追踪信息。这确保了不同步骤间的关联性,即使它们在不同线程、进程甚至服务器上执行。

四、实战:Python AI Agent集成OpenTelemetry

下面是一个基于LangChain的多步骤AI Agent的追踪实现示例:

from opentelemetry import trace

from opentelemetry.trace import SpanKind

from opentelemetry.sdk.trace import TracerProvider

from opentelemetry.sdk.trace.export import BatchSpanProcessor

from opentelemetry.exporter.otlp.proto.http.trace_exporter import OTLPSpanExporter

# 初始化追踪器

trace.set_tracer_provider(TracerProvider())

tracer = trace.get_tracer("ai-agent-workflow")

# 配置Span处理器(发送到Jaeger/Tempo)

span_exporter = OTLPSpanExporter(endpoint="http://localhost:4318/v1/traces")

span_processor = BatchSpanProcessor(span_exporter)

trace.get_tracer_provider().add_span_processor(span_processor)

# 为AI Agent步骤添加追踪

def process_user_query(question):

with tracer.start_as_current_span("process_user_query", kind=SpanKind.SERVER) as parent_span:

# 记录查询内容(可选,注意隐私)

parent_span.set_attribute("user_query", question)

# 步骤1:数据获取

with tracer.start_as_current_span("data_retrieval") as span1:

data = retrieve_relevant_data(question)

span1.set_attribute("data_source", "internal_database")

span1.set_attribute("retrieved_items", len(data))

# 步骤2:LLM推理

with tracer.start_as_current_span("llm_inference") as span2:

llm_response = call_llm_api(question, data)

span2.set_attribute("llm_provider", "openai")

span2.set_attribute("model", "gpt-4")

span2.set_attribute("token_count", len(llm_response))

# 步骤3:结果处理

with tracer.start_as_current_span("result_processing") as span3:

final_answer = process_result(llm_response)

span3.set_attribute("processing_type", "extraction_and_formatting")

return final_answer

4.1 代码实现要点

- 有意义的Span命名:每个Span名称都清楚地描述了它在工作流中的角色

- 属性记录:记录业务相关的属性(数据源、模型类型、token数量等),便于后续分析

- Span层级关系:通过上下文传播,自动建立Span间的父子关系

对于异步执行场景,需要使用Context对象手动传递追踪上下文:

import asyncio

from opentelemetry.context import attach, detach

from opentelemetry.trace.propagation.tracecontext import TraceContextTextMapPropagator

async def parallel_processing():

tracer = trace.get_tracer("parallel-agent")

# 创建父Span

with tracer.start_as_current_span("parallel_workflow") as parent_span:

# 获取当前上下文

carrier = {}

propagator = TraceContextTextMapPropagator()

propagator.inject(carrier)

# 并行执行多个任务

tasks = []

for i in range(3):

# 为每个任务注入追踪上下文

task_carrier = carrier.copy()

task = asyncio.create_task(

process_subtask(i, task_carrier)

)

tasks.append(task)

results = await asyncio.gather(*tasks)

return results

五、工具生态:完整的可观察性栈

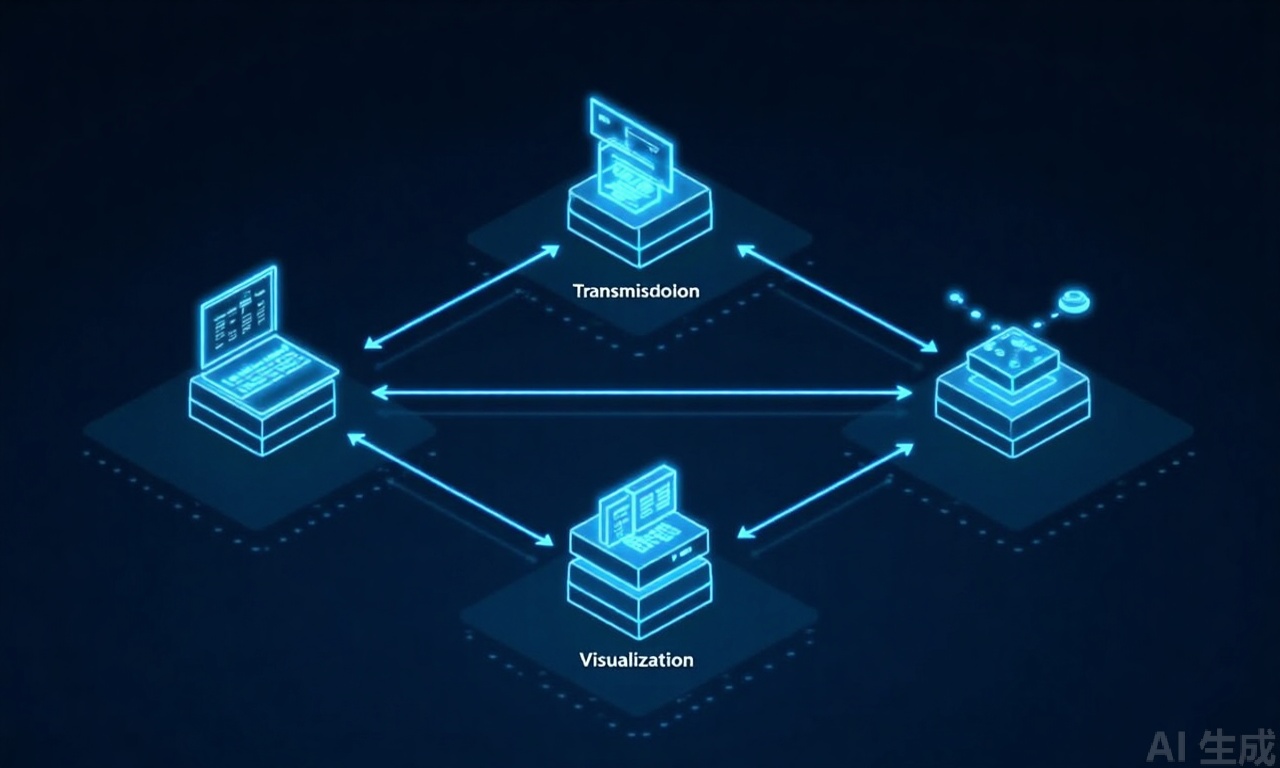

为AI Agent构建完整的可观察性栈需要以下组件:

5.1 数据收集层

- OpenTelemetry SDK(Python、JavaScript、Go等)

- 自动仪表化库(支持常见AI框架的自动追踪)

5.2 传输和存储层

- OpenTelemetry Collector:接收、处理和转发追踪数据

- 存储后端:Jaeger(经典选择)、Tempo(Grafana生态)、SigNoz(一体化方案)

5.3 可视化分析层

- Grafana:搭配Tempo数据源,提供强大的追踪搜索和分析功能

- Jaeger UI:专注于分布式追踪的可视化界面

- 自定义仪表板:针对AI Agent特定指标的监控面板

六、追踪数据的实际价值

6.1 调试实践:快速定位失败步骤

当工作流失败时,追踪数据能立即告诉你:

- 哪个步骤失败了(Span状态标记为ERROR)

- 失败的具体原因(错误信息和堆栈跟踪)

- 失败前的执行上下文(之前的步骤和它们的状态)

相比翻阅分散的日志文件,这能减少90%的故障排查时间。

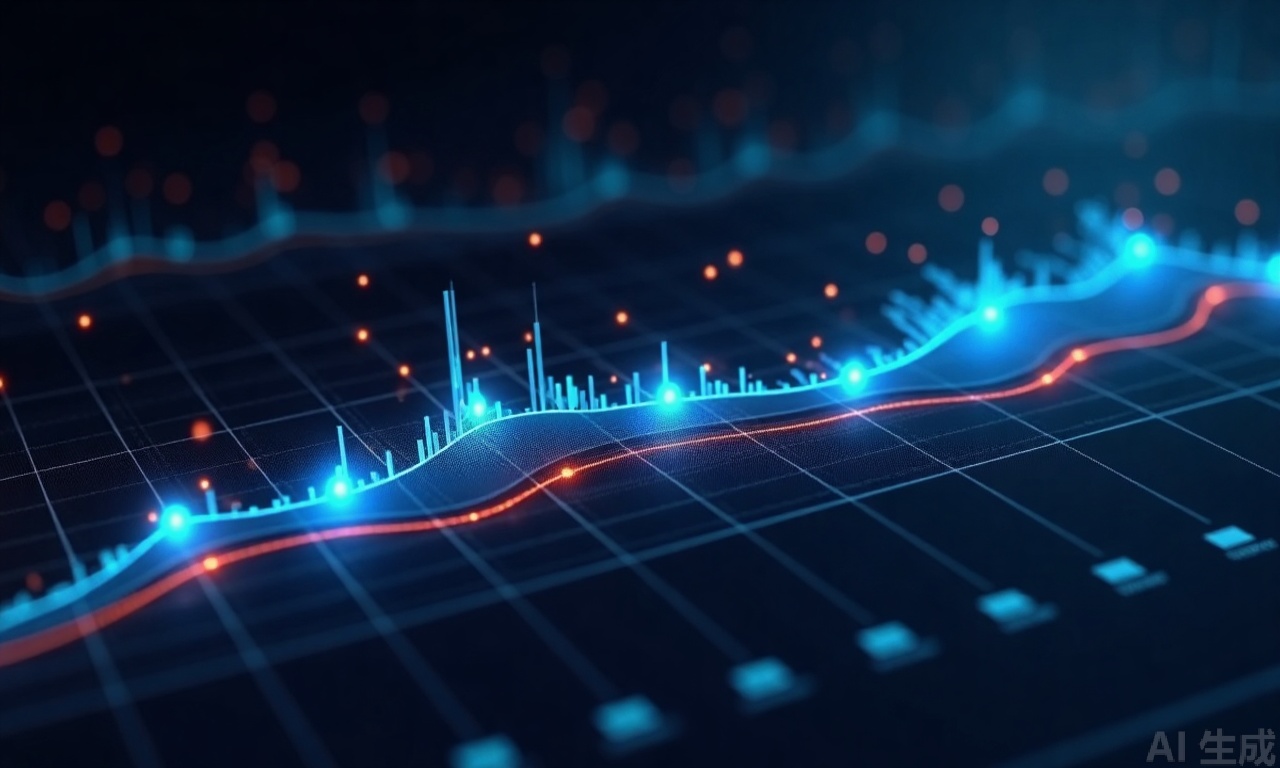

6.2 性能优化:识别真正的瓶颈

通过分析Span的执行时间,你可以:

- 发现缓慢的外部API调用(数据库查询、模型推理、文件IO)

- 识别不必要的序列化/反序列化操作

- 找到可以并行化的执行步骤

- 优化资源利用率(GPU内存、CPU时间)

6.3 成本控制:追踪AI API调用

对于基于云AI服务(OpenAI、Anthropic等)的Agent,追踪可以帮助:

- 记录每个API调用的token使用量

- 关联成本与具体的业务功能

- 识别异常的高成本调用模式

- 优化提示工程减少token消耗

七、实施路线图

建议遵循以下路径为AI Agent系统引入分布式追踪:

7.1 阶段1:小范围试点

- 选择一个关键工作流进行追踪集成

- 配置基础的OpenTelemetry Collector和Jaeger/Tempo

- 验证基本功能:Span创建、上下文传播、数据可视化

7.2 阶段2:标准化推广

- 制定团队的Span命名规范和属性标准

- 创建可复用的追踪工具库和装饰器

- 为常见AI模式(RAG、多模型协作、工具调用)建立追踪模板

7.3 阶段3:深度集成

- 将追踪数据与现有的监控告警系统集成

- 建立基于追踪的性能基线分析和异常检测

- 开发自定义的分析工具(成本分析、质量指标等)

八、总结

分布式追踪为AI Agent工作流提供了从黑盒到透明化的调试方案。通过OpenTelemetry技术栈,开发团队可以:

- 快速定位故障原因,减少调试时间

- 识别性能瓶颈,优化系统响应时间

- 控制AI API调用成本,提高资源利用率

- 建立完整的可观察性体系,提升系统可靠性

对于正在构建复杂AI Agent系统的团队来说,现在正是引入分布式追踪的最佳时机。这不仅是一项技术投资,更是提升团队协作效率、系统可靠性和用户体验的关键步骤。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献53条内容

已为社区贡献53条内容

所有评论(0)