OpenClaw 上下文压缩问题详细解决方法

问题背景

OpenClaw版本升级4.8后,对话框中反复提示上下文超出限制,导致无法正常使用,我尝试通过清理Seession、/compact手动压缩上下文、/new开启新会话等方式,均无法解决。

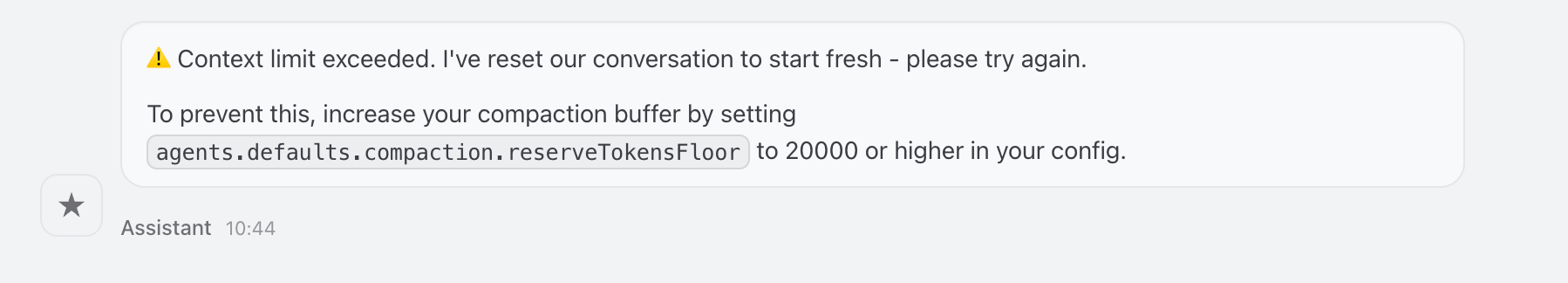

图-报错内容

原因分析

OpenClaw4.8版本后增加了对上下文压缩的校验,而我的“龙虾环境”,前期没有对上下文压缩做详细配置,而是采用了系统模式的设置。位了结局问题详细研究了下上下文压缩参考配置。

解决方案

1)上下文压缩参数设置

openclaw.json文件中,默认无如下参数:reserveTokensFloor、 notifyUser、 identifierPolicy、memoryFlush、softThresholdTokens。需要根据自己使用的模型参数大小做下设置。

如下是按照DeepSeek-v3.2模型做的设置,DeepSeek-v3.2支持128K上下文长度,最大输入长度96k,最大输出32k(默认4k),最大思维链输出长度32k

"agents": {

"defaults": {

"workspace": "/home/ubuntu/.openclaw/workspace",

"compaction": {

"mode": "safeguard",

"reserveTokensFloor": 50000,

"notifyUser": true,

"identifierPolicy": "strict",

"memoryFlush": {

"enabled": true,

"softThresholdTokens": 4000

}

},

"model": {

"primary": "custom-api-lkeap-cloud-tencent-com/deepseek-v3.2"

},

"models": {

"custom-api-lkeap-cloud-tencent-com/deepseek-v3.2": {

"alias": "deepseek-v3.2"

}

}

}

},|

参数路径 |

配置值 |

说明 |

|---|---|---|

|

|

|

定义 Agent 的工作目录,用于存放会话记录、记忆文件等。 |

|

|

|

将压缩模式设置为“安全保护”。该模式提供了更稳健的保护机制,包括自适应分块和渐进式回退,可以防止压缩过程中出现问题。 |

|

|

|

为系统预留的 Token “安全缓冲区”。 |

|

|

|

启用后,当压缩开始时,用户会收到一个简短的提示,例如 “Compacting context…”。这可以让你清楚知道系统正在进行后台维护。 |

|

|

|

设置为 |

|

|

|

启用“记忆刷新”机制。在压缩发生前,系统会有一个静默回合,提醒 Agent 将重要的短期记忆写入到磁盘文件中,避免关键信息在压缩中丢失。 |

|

|

|

这是触发记忆刷新的“软阈值”。 |

2)OpenClaw.json 模型参数设置

"models": [

{

"id": "deepseek-v3.2",

"name": "deepseek-v3.2 (Custom Provider)",

"contextWindow": 128000,

"maxTokens": 8000,

"input": [

"text"

],压缩触发时机: 当对话历史接近模型的 128,000 令牌限制时,系统会自动压缩

压缩策略: 保留最新的 50,000 令牌,删除较旧的对话历史

用户感知: 压缩时会通知用户,保持透明度

内存管理: 使用内存刷新机制,平衡性能和内存使用

验证与测试

按照上述参数修改后,问题得到解决。

后续优化思路

当前配置较为保守,如果遇到频繁的上下文压缩,可以考虑:降低 reserveTokensFloor 值(如改为 30,000)调整 memoryFlush.softThresholdTokens(如改为 8,000)

更多文章请关注公众号:云龙说IT那些事

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)