【图像编辑】LightMover:支持颜色与强度控制的生成式光运动系统(CVPR 2026)

这里写目录标题

标题:LightMover: Generative Light Movement with Color and Intensity Controlshttps://gengzezhou.github.io/LightMover阿德莱德大学、Adobe 研究院、香港大学、耶鲁大学

一、LightMover

1.视频扩散模型的再利用

LightMover为实现精准的图像编辑(如拖拽物体、改变光照、调整颜色)。其创新的地方在于将静态图像编辑 伪装成一个短视频序列生成任务 :将输入条件(参考图、控制信号等)看作是伪视频帧(pseudo video frames) ,从而利用视频扩散模型(类似于 Sora)强大的时空建模能力和跨帧一致性。

根据公式 (2),模型每一个去噪步骤 t t t 的输入序列包含以下 6 个部分:

- (1) Reference Image ( I ref I_{\text{ref}} Iref): 原始参考图,提供背景或上下文。

- (2) Object Frame ( I obj I_{\text{obj}} Iobj): 经过裁剪和缩放的目标物体,即要被操作的对象。

- (3) Movement Map ( I move I_{\text{move}} Imove): 空间控制信号。它利用 RGB 通道编码位移:R通道表示物体源区域;GB 通道表示物体的目标区域。

- (4) Color Control ( I color I_{\text{color}} Icolor): 全局条件帧,用于指定光照色调或色温。

- (5) Intensity Control ( I intensity I_{\text{intensity}} Iintensity): 控制曝光强度的帧,单位是摄影中的“档位”(stops)。

- (6) Output Frame ( X t X^t Xt): 在第 t t t 步等待去噪的嘈杂潜变量帧。

文中定义 了曝光值(EV)与照明增益( G illum G_{\text{illum}} Gillum)之间的关系(每增加 1 个 EV stop,光强就会翻倍) : G illum = 2 S E V ( 1 ) G_{\text{illum}} = 2^{S_{EV}}(1) Gillum=2SEV(1)

训练与推理 。推理 (Inference): 从高斯噪声 X 0 X^0 X0 开始,模型迭代地预测并优化,最终生成清晰的目标图像 X 1 X^1 X1。训练 (Training): 采用了 Flow-matching(流匹配) 目标函数,而不是传统的扩散模型损失。线性插值 (公式 3): 噪声输入是通过在 X 0 X^0 X0 和 X 1 X^1 X1 之间进行线性插值生成的:

损失函数 : 模型预测的是“瞬时速度” V t V^t Vt,即图像从噪声向清晰状态转化的变化率:

2. 多信号位置编码 MSPE

为了让 Diffusion Transformer 能够理解每个输入 token(信息块)的语义, MSPE 将位置信息拆解为四个正交的子空间:

-

1.空间编码 (Spatial Encoding, W , H W, H W,H):针对每一帧二维图像,将每个 latent patch根据UV坐标(水平 ( W ) (W) (W) 和垂直 ( H ) (H) (H) )坐标进行2D 正余弦编码(2D Sine-Cosine Encoding)编码。

-

2.时间编码 (Temporal Encoding, T T T):给输入序列的每一个 tokens ,分配一个时间索引。在扩散模型(Diffusion)中,这不仅有助于维持多帧之间的时序一致性,还能让模型在不同的去噪步数中保持稳定的时间参考。

-

3.条件类型编码 (Condition-Type Encoding, C C C):为不同的模态分配离散的标识符(ID)。模型通过这个编码知道当前的 token 是属于参考图(Reference)、物体帧(Object)、移动图(Movement),还是颜色/强度控制,来解决多模态输入混淆的问题。

-

4.帧角色编码 (Frame-Role Encoding, R R R):二值编码(Binary Encoding)。它将 token 分为两类:条件(Input Conditions): 提供指引信息的帧。输出(Output Frame): 最终需要被预测或去噪的帧。

编码的组合方式。这些分属不同子空间的编码会被投影到 Transformer 的嵌入空间(Embedding Space)中,然后相加(Additively Combined)。紧接着,模型还会应用一种类似于 RoPE(旋转位置嵌入) 的旋转调制,以保留 token 之间的相对相位关系。这能显著增强模型对“物体移动了多远”这类相对位置信息的敏感度。

动态自适应:引入了 NTK-aware 插值技术(常用于大语言模型长文本扩展)。它能够动态调整位置编码的频率,使模型在处理不同分辨率或不同长度的序列时,依然能保持推理能力的泛化性。

3.自适应token修剪

在 Diffusion Transformer 架构中,随着控制信号(如移动图、颜色、亮度等)的增加,输入序列会变得非常长(例如 512x512 的图像会产生 256 个 latent tokens),这会导致计算开销剧增。两种互补的剪枝策略:

-

1.空间感知剪枝 (Spatially-Aware Pruning):对具有明确空间结构的信号,如移动图 ( I move I_{\text{move}} Imove),计算目标物体边界框(Bounding Box)占整个画面的面积比例。小目标(比例 < 0.2)保留全分辨率的 latent map,以确保对微小移动的精确控制;大目标则按比例对 latent tokens 进行下采样,有效地去除冗余的背景信息。

-

2. 非空间信号的可学习下采样 (Learnable Downsampling for Non-Spatial Signals):对于缺乏明确二维空间结构的全局属性,如颜色 ( I color I_{\text{color}} Icolor) 和 光强 ( I intensity I_{\text{intensity}} Iintensity),不需要保留完整的二维布局,而是通过可学习的下采样比例,让模型在训练过程中自动优化并决定需要保留多少个 token 才能平衡表现力和效率。

二、数据生成流程

精准且物理一致的综合光线操控数据集:将真实采集数据与大规模合成语料库相结合:真实世界照片提供了自然外观与材质多样性,而合成数据则能系统化调整光照参数,并实现光照运动、色彩及强度等维度的可扩展监督学习。既支持视觉真实感的提升,又确保物理一致性的验证。

1.合成渲染数据框架

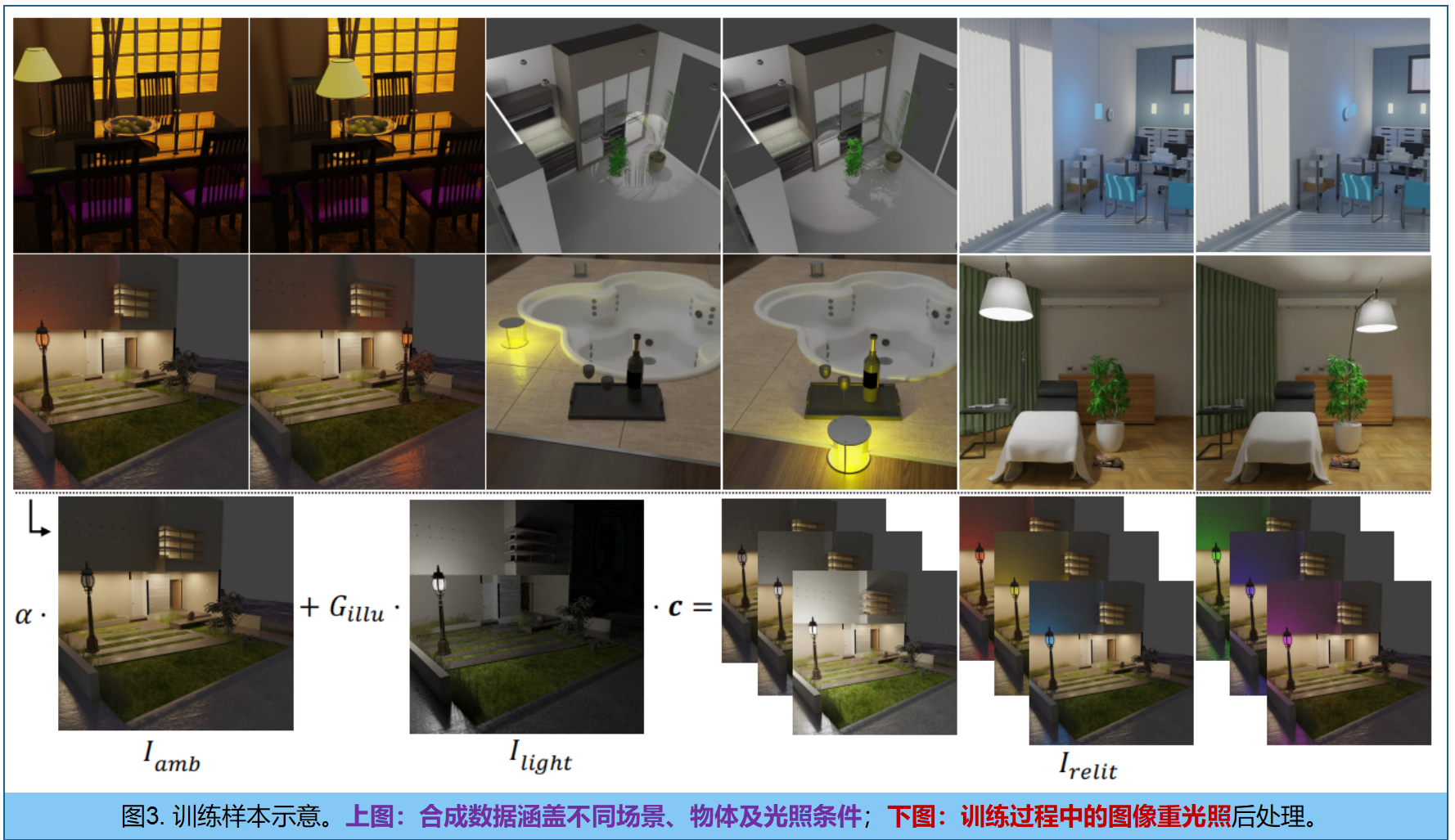

场景与光照设置。采用25个由艺术家在Blender中设计的室内场景,系统性地在不同光照条件和物体配置下进行渲染。为丰富场景多样性,我们随机选取合理的灯具摆放位置(如吸顶灯、壁灯、台灯),调整 HDRI 环境贴图参数,并优化环境光与直射光的比例。为提升物体多样性,我们从Objectverse-XL[13]数据库中检索100个光源素材,通过CLIP相似度算法筛选与“light”关键词匹配的素材,并在Blender中进行尺度标准化、发光材质校准及安装锚点预处理。每个场景中,选定光源沿平滑轨迹进行动态模拟,通过十台虚拟摄像机捕捉多视角运动轨迹。连续帧构成光源运动配对数据集。如图3,该流程生成了约32,000组包含不同光源类型、摄像机视角及光照条件的数据组合。

物理解耦渲染 。每个渲染帧被分解为两个部分:环境基础图像 I a m b I_{amb} Iamb与直射光贡献 I l i g h t I_{light} Ilight。 其在 Monte Carlo path-tracing 设置下独立渲染,最终在线性RGB空间中进行合成 :

参数化光控制 :调节可控光源的相对亮度与色度。重光照图像的计算公式为:

其中 α ∈[0,1]表示环境光照缩放系数, G i l l u m G_{illum} Gillum∈[0,1]为目标光强度增益, c t ∈ R 3 c_t∈R^3 ct∈R3为线性色彩空间中的目标RGB色调值。最终⊙表示RGB通道间的逐元素乘法运算。每种光源渲染的颜色均被设定为纯白色且强度为单位值,因此目标色调颜色可直接应用于后期处理阶段。 I amb I_{\text{amb}} Iamb 为环境光, I light I_{\text{light}} Ilight 是待操作的直接光源(纯白色)。通过预渲染出两张图(环境一张,特定灯光一张),就可以实时通过简单的代数运算合成出成千上万种不同的光照组合。

色调映射 。基于物理渲染采用线性RGB色彩空间时,会存在极少数高能量样本的像素亮度超出显示范围。 我们通过百分位数归一化处理结合sRGB色调映射来稳定动态范围。设 E m a x E_{max} Emax为1,024个随机样本中像素亮度的第99.95百分位数。经色调映射处理后的图像计算公式如下:

- 归一化 ( I lin E max \frac{I_{\text{lin}}}{E_{\text{max}}} EmaxIlin): E max E_{\text{max}} Emax 是图像中亮度的 99.95% 分位数。这步可以把图像中最亮的部分映射到 1.0 1.0 1.0 附近,防止整体画面太暗。

- Gamma 校正 ( ( ⋅ ) 1 / 2.2 (\cdot)^{1/2.2} (⋅)1/2.2): 人眼对亮度的感知是非线性的(对暗部变化比亮部更敏感)。为让图像看起来符合人眼直觉,必须进行指数为 1 / 2.2 1/2.2 1/2.2 的幂函数变换。

- clip ( ⋅ ) \text{clip}(\cdot) clip(⋅): 将所有超出 [ 0 , 1 ] [0, 1] [0,1] 范围的数值强制截断,确保图像符合 8-bit(0-255)或类似显示格式的要求。

2.真实数据采集

采用商用移动设备、三脚架及同步触发装置,采集一组真实场景 图像对:同一场景的两种不同光照条件,唯一物理变化仅在于可见光源的位置 。数据集包含106个室内场景,每个场景包含3-4种光照变化方案,最终生成360张高分辨率照片。除用于光照移动实验的图像对外,我们还为每个场景采集了光源物理移除后的背景参考图像。这些背景图像为光照插入与移除算法提供了额外的训练目标。

实验

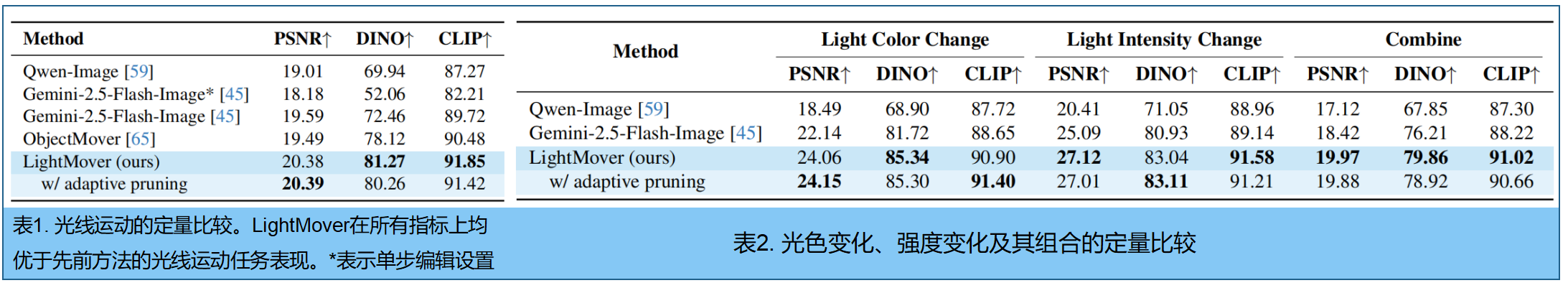

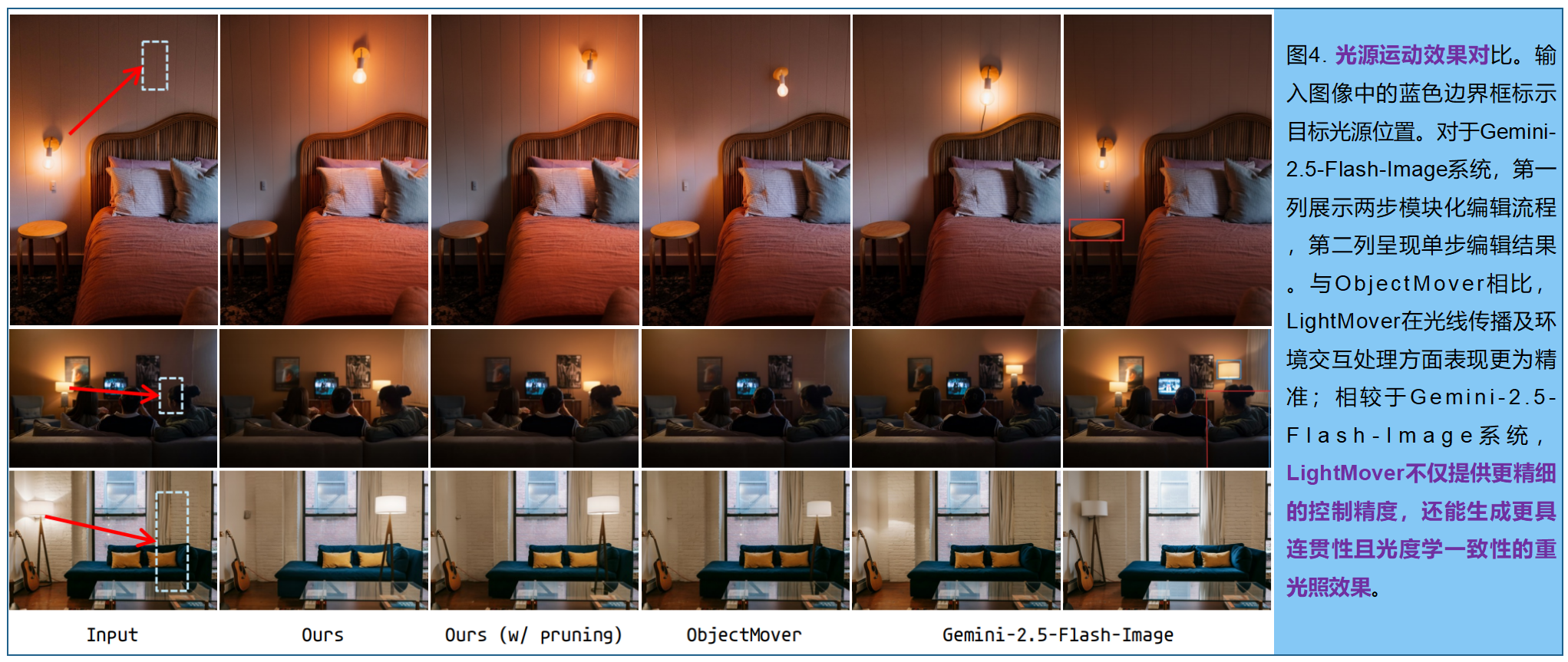

我们在5B参数的视频扩散Transformer模型上训练LightMover。训练样本以1:1比例从512×512和1024×1024两种分辨率中抽取,数据集采用10:1比例混合合成数据与真实数据。合成任务按6:3:3:3:1:1的比例分布在 七个类别中:(1)光线运动、(2)物体运动、(3)光线颜色变化、(4)光照强度变化、(5)关节运动与颜色/强度变化、(6)光线消除、(7)光线插入。还采用物理解耦渲染方法,进行光照增强:训练过程中动态调整环境光与直射光成分。

评估方面,通过两个互补基准集对LightMover进行定量与定性评估:

- LightMove-A用于真实拍摄数据,包含由经验丰富的摄影师拍摄的200组真实世界图像三元组,每组包含(1)含光源场景、(2)光源移动后的相同场景,该数据集可有效评估真实光线运动效果。

- LightMove-B用于具有真实光照变化的合成场景,用于在已知真实光照变化条件下评估光照控制能力,包含2个经过预留的场景数据集,其中光源、物体及材质均为未见过的类型。

量化分析指标采用感知相似性评估指标,包括基于光照变化影响局部区域计算得出的DINO-Score[8]和CLIP-Score[44]。定性评估选用Pexels[42]平台提供的50幅多样化真实图像集,人工标注光源区域及对应mask,并将其作为视觉对比的基准参考。

1.蒙特卡洛路径追踪(Monte Carlo path-tracing )

利用统计学方法解决复杂渲染方程,生成高度真实感图像的渲染算法。原理: 算法从摄像机向场景发射数百万条光线(Ray)。当光线撞击物体表面时,它会根据材质属性(如反射、折射、吸收)随机选择一个方向继续反弹,直到撞击到光源或达到最大反弹次数。 在物理世界中,光线的路径是无穷尽的。计算每一个点的光照需要求解一个复杂的积分。蒙特卡洛方法通过随机采样(即随机追踪一部分光线路径)并求平均值,来逼近这个积分的真实解。 它能自然地模拟出软阴影、间接光照(光线在物体间多次弹射)、全局光照(GI)和焦散等复杂物理现象。

#pic_center =40%x80%

d \sqrt{d} d 1 8 \frac {1}{8} 81 x ˉ \bar{x} xˉ D ^ \hat{D} D^ I ~ \tilde{I} I~ ϵ \epsilon ϵ

ϕ \phi ϕ ∏ \prod ∏ a b c \sqrt{abc} abc ∑ a b c \sum{abc} ∑abc

/ $$ E \mathcal{E} E

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)