LangGraph实战之高级检索架构应用:构建可自我纠错的 C-RAG 系统

🔥 前言: 做LLM应用的开发者,90%都踩过同一个坑——RAG系统"一本正经地胡说八道":向量库配置得再精密,模型输出的答案依然错漏百出;明明知识库没有相关内容,模型硬着头皮"脑补";检索到的噪声文档,直接导致整个生成链路彻底跑偏。

本文从工业级落地角度,拆解「可自我纠错的C-RAG系统」,从痛点剖析、原理拆解、LangGraph选型、完整代码实现,到生产级优化,全程干货。

🎯 适合人群:AI架构师、大模型应用开发者、RAG工程实践者

💡 核心价值:从线性RAG到纠错式C-RAG的架构跃迁,掌握LangGraph图架构落地技巧,附生产级可运行代码+优化方案

一、痛点直击:为什么你的RAG依然在"一本正经地胡说八道"?

在将LLM应用推向工业级场景时,开发者最头疼的不是模型部署,而是RAG的"幻觉瓶颈"——即便配置了高维向量库、优化了Embedding模型,系统依然频繁产出看似专业、实则错误的回答。

核心原因:这并非模型能力不足,而是检索(Retrieve)与生成(Generate)之间存在结构性断层——传统RAG是单向线性流水线,“盲目信任检索结果”,没有任何自检、纠错、反馈机制。

1.1 传统RAG的线性架构:从根源埋下幻觉隐患

⚠️ 架构缺陷:无评估、无纠错、无反馈,检索错则生成必错。

这种线性模式存在三大致命痛点:

① 检索噪声的级联失效(最常见)

检索器(Retriever)召回的 Top-K 文档中,总混杂大量干扰信息(相似但不相关的文档、过时信息)。LLM不具备"辨错"能力,会被动吸收噪声,产生事实性错误。

② 知识边界的盲区

当用户提问超出私有知识库覆盖范围时,传统RAG不会拒绝回答,而是强行用不相关文档"补丁式"作答,直接诱发幻觉。

③ 反馈机制的缺失

线性工作流是"一次性流程",一旦检索环节出现偏差,后续生成无法回溯修正,只能"一条路走到黑"。

💼 真实案例:某企业智能知识库,用户问"2024年Q3产品升级计划",检索器召回了"2023年Q3升级计划"和"2024年Q2产品介绍"两个噪声文档,LLM编造出"2024年Q3将延续2023年方案,结合Q2产品特性升级"的错误答案,导致业务人员做出误判。

二、深度拆解:什么是C-RAG?自纠错机制到底牛在哪?

C-RAG(Corrective-RAG,纠错检索增强生成) 的核心逻辑一句话概括:

在检索(Retrieve)与生成(Generate)之间,插入"评估者(Grader)"节点,通过对检索质量的实时量化评估,决定是直接生成答案,还是先进行知识重写+外部扩充,形成"检索-评估-纠错-生成"的闭环。

传统RAG是"检索完就生成",C-RAG是"检索完先检查,合格再生成,不合格就纠错"——相当于给RAG加了一道"质检工序"。

2.1 C-RAG的三大核心动作

① 评估(Grade):给检索文档"打分质检"

使用轻量级LLM(如 gpt-3.5-turbo),对召回的每个文档进行相关性打分,判断"文档是否能回答用户问题",避免噪声文档进入生成环节。

💡 工业落地关键:必须用结构化输出(JSON Schema)强制模型输出二元评分结果(yes/no),确保评估的稳定性和可追溯性,而非自由文本。

② 过滤与重写(Transform):剔除"有毒"文档,优化检索意图

- 第一步:剔除评分极低的噪声文档

- 第二步:若合格文档数量不足,对原始问题进行重写,优化搜索意图(如将"今年产品升级计划"重写为"2024年Q3企业核心产品升级计划")

③ 外部补充(Web Search):打破本地知识库边界

当本地库无法有效支撑时,自动触发外部搜索(如 Tavily),获取实时背景知识,避免模型"脑补"。

2.2 传统RAG vs C-RAG 对比

| 特性 | 传统 RAG | C-RAG (Corrective-RAG) |

|---|---|---|

| 拓扑结构 | 线性链式(DAG),单向流转 | 循环状态机(Cyclic Graph),闭环反馈 |

| 处理策略 | 强制注入 Context,盲目信任检索结果 | 动态评估:Relevant / Not Relevant,不合格则纠错 |

| 噪声容忍度 | 极低(易被噪声误导,直接产生幻觉) | 高(自动过滤机制,剔除噪声文档) |

| 知识获取 | 封闭式(仅限本地向量库) | 开放式(本地库 + 动态网页搜索) |

| 生成可靠性 | 随机性强,幻觉率高,不可控 | 经多轮纠偏,确定性更高,可追溯 |

| 工业落地难度 | 低,但稳定性差 | 中等,需搭建图架构,落地后稳定性极强 |

2.3 C-RAG 核心流转图

💡 核心闭环:评估不通过 → 查询重写 → 外部补充 → 生成,彻底杜绝幻觉。

三、关键选型:为什么是LangGraph?

很多开发者会问:“用LangChain LCEL流水线能否实现C-RAG?”——可以,但不适合工业级落地。

| 维度 | LangChain LCEL | LangGraph |

|---|---|---|

| 适用场景 | 确定的单向流水线任务 | 有状态、可循环、可回溯的复杂Agent |

| 循环支持 | ❌ 不支持原生循环 | ✅ 原生支持条件循环 |

| 状态管理 | 简单传参 | 统一State对象,支持快照与回溯 |

| 错误恢复 | 中断即失败 | 支持节点级重试与状态回溯 |

| C-RAG适配度 | 低(代码高度耦合) | 高(专为此类图架构设计) |

结论:LCEL做简单流水线,LangGraph做工业级有状态智能系统,搭建C-RAG优先选LangGraph。

3.1 LangGraph的三大核心能力

① 图状态机架构:将每个动作(检索、评估、重写、搜索、生成)建模为「节点(Node)」,动作间流转建模为「边(Edge)」,清晰可控。

② 细粒度状态管理:通过统一的 State 对象,在所有节点间精准传递上下文,支持并行计算与状态快照。

③ 工程级循环控制:原生支持节点间回溯,Web搜索超时时可自动回溯到重写节点重试,而LCEL一旦失败整条链路即中断。

四、工业级落地:C-RAG完整代码实现

技术栈:LangChain + LangGraph + OpenAI + FAISS + Tavily

4.1 依赖安装

pip install langchain langgraph langchain-openai langchain-community \

faiss-cpu tavily-python python-dotenv pydantic

4.2 环境配置(.env 文件)

# .env

OPENAI_API_KEY=sk-xxxxxxxxxxxxxxxxxxxx

TAVILY_API_KEY=tvly-xxxxxxxxxxxxxxxxxxxx

4.3 定义系统状态(GraphState)

GraphState 是整个图架构的"共享内存",所有节点的输入/输出均通过它传递。

# state.py

from typing import List, TypedDict, Optional

class GraphState(TypedDict):

"""

C-RAG图架构的统一状态对象,相当于Agent的"短期记忆快照"。

所有节点读取和写入都基于此状态,LangGraph负责跨节点传递。

"""

question: str # 当前检索用的问题(原始或重写后)

original_question: str # 保留原始问题,用于最终生成时参考

documents: List[str] # 当前文档集合(本地检索 or 网络搜索结果)

run_web_search: bool # 是否需要触发外部 Web 搜索

generation: str # 最终生成的答案

grade_count: int # 评估通过的文档数(用于判断是否足够)

⚠️ 优化说明:原版缺少

original_question字段,会导致查询重写后丢失原始问题,生成答案时语义漂移;新增grade_count用于更精确地判断文档质量阈值。

4.4 核心节点实现

Node 1:文档评估节点(Grade Documents)

# nodes/grade_documents.py

import os

from dotenv import load_dotenv

from langchain_openai import ChatOpenAI

from pydantic import BaseModel, Field

from state import GraphState

load_dotenv()

# 使用轻量级模型评估,节省Token成本

_grader_llm = ChatOpenAI(

model="gpt-3.5-turbo",

temperature=0,

api_key=os.getenv("OPENAI_API_KEY")

)

class GradeDocuments(BaseModel):

"""文档相关性二元评分结构,强制输出 yes 或 no"""

binary_score: str = Field(

description="文档是否与问题相关,仅输出 'yes' 或 'no'"

)

# 使用结构化输出,避免模型输出自由文本导致解析失败

_structured_grader = _grader_llm.with_structured_output(GradeDocuments)

# 最少需要多少合格文档才认为质量达标

MIN_RELEVANT_DOCS = 2

def grade_documents(state: GraphState) -> dict:

"""

评估检索到的文档与用户问题的相关性,过滤噪声,

并根据合格文档数量决定是否触发 Web 搜索。

"""

print("--- [Node] 文档质量评估 ---")

question = state["question"]

documents = state["documents"]

filtered_docs: List[str] = []

for doc in documents:

try:

result = _structured_grader.invoke({

"question": question,

"document": doc

})

if result.binary_score.strip().lower() == "yes":

filtered_docs.append(doc)

print(f" ✅ 文档通过评估")

else:

print(f" ❌ 文档被过滤(噪声)")

except Exception as e:

# 单个文档评估失败不应中断整体流程

print(f" ⚠️ 文档评估异常,已跳过:{e}")

# 合格文档不足阈值时,标记需要外部搜索

run_web_search = len(filtered_docs) < MIN_RELEVANT_DOCS

print(f" 合格文档数:{len(filtered_docs)},触发Web搜索:{run_web_search}")

return {

"documents": filtered_docs,

"run_web_search": run_web_search,

"grade_count": len(filtered_docs)

}

⚠️ 原版问题修复:

- 原版只要有任何一个文档不相关就触发 Web 搜索,过于激进,导致不必要的搜索成本;

- 新版引入

MIN_RELEVANT_DOCS阈值(≥2个合格文档才不触发搜索),策略更合理;- 增加了 try-except,单个文档评估失败不会中断整个流程。

Node 2:查询重写节点(Transform Query)

# nodes/transform_query.py

import os

from langchain_openai import ChatOpenAI

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.output_parsers import StrOutputParser

from state import GraphState

_rewriter_llm = ChatOpenAI(

model="gpt-3.5-turbo",

temperature=0,

api_key=os.getenv("OPENAI_API_KEY")

)

_rewrite_prompt = ChatPromptTemplate.from_messages([

("system",

"你是一名专业的检索意图优化工程师。\n"

"请根据用户的原始问题,改写为更适合向量检索或搜索引擎的精准查询语句。\n"

"要求:\n"

"1. 保持语义不变,不添加额外假设\n"

"2. 补充必要的时间、领域等限定词,提升检索精准度\n"

"3. 仅输出改写后的问题,不添加任何解释\n"

),

("human", "原始问题:{question}")

])

_question_rewriter = _rewrite_prompt | _rewriter_llm | StrOutputParser()

def transform_query(state: GraphState) -> dict:

"""

重写查询语句以优化检索意图。

同时保留原始问题,防止语义在多轮重写中漂移。

"""

print("--- [Node] 查询语句重写 ---")

question = state["question"]

original_question = state.get("original_question", question)

better_question = _question_rewriter.invoke({"question": question})

print(f" 原始问题:{question}")

print(f" 重写后:{better_question}")

return {

"question": better_question,

"original_question": original_question # 保留原始问题,防止漂移

}

Node 3:外部搜索节点(Web Search)

# nodes/web_search.py

import os

from langchain_community.tools.tavily_search import TavilySearchResults

from state import GraphState

_web_search_tool = TavilySearchResults(

k=3,

api_key=os.getenv("TAVILY_API_KEY")

)

def web_search(state: GraphState) -> dict:

"""

基于重写后的问题执行 Tavily 外部搜索,补充本地知识盲区。

搜索结果追加到现有文档列表中(而非覆盖),保留本地已有的合格文档。

"""

print("--- [Node] 外部 Web 搜索 ---")

question = state["question"]

existing_docs = state.get("documents", [])

try:

web_results = _web_search_tool.invoke({"query": question})

# 将搜索结果内容提取,追加到文档列表(保留本地合格文档)

new_docs = [

d["content"] for d in web_results

if isinstance(d, dict) and d.get("content")

]

print(f" 获取到 {len(new_docs)} 条搜索结果")

return {"documents": existing_docs + new_docs}

except Exception as e:

print(f" ⚠️ Web 搜索失败:{e},继续使用本地文档")

return {"documents": existing_docs}

⚠️ 原版问题修复:原版直接

extend可能在web_results格式异常时抛出KeyError,新版增加了类型判断和get()取值,以及整体 try-except 保护。

Node 4:本地检索节点(Retrieve)

# nodes/retrieve.py

import os

from langchain_openai import OpenAIEmbeddings

from langchain_community.vectorstores import FAISS

from langchain.text_splitter import RecursiveCharacterTextSplitter

from state import GraphState

# ============================================================

# 初始化向量库(实际落地时替换为你的私有文档)

# ============================================================

_embeddings = OpenAIEmbeddings(api_key=os.getenv("OPENAI_API_KEY"))

_sample_docs = [

"2024年Q1销售额最高产品:AI智能助手,销量10万台,市场占有率38%。",

"AI智能助手客户好评率95%,用户反馈响应速度快、准确率高。",

"2024年Q2产品规划:多模态交互能力升级,支持图文混合输入。",

"2024年Q3升级计划:引入语音识别模块,目标覆盖企业客服场景。",

"知识库覆盖范围:产品信息、销售数据、客户评价、产品路线图。"

]

_text_splitter = RecursiveCharacterTextSplitter(

chunk_size=300, # 较小chunk有助于提升检索精准度

chunk_overlap=30

)

_splits = _text_splitter.create_documents(_sample_docs)

_vectorstore = FAISS.from_documents(_splits, _embeddings)

_retriever = _vectorstore.as_retriever(search_kwargs={"k": 4}) # Top-4召回

def retrieve(state: GraphState) -> dict:

"""

本地向量库检索,获取与问题相关的候选文档。

同时初始化 original_question 字段(首次进入图时设置)。

"""

print("--- [Node] 本地向量库检索 ---")

question = state["question"]

docs = _retriever.invoke(question)

documents = [doc.page_content for doc in docs]

print(f" 召回 {len(documents)} 个候选文档")

return {

"documents": documents,

# 首次进入时初始化原始问题字段

"original_question": state.get("original_question", question)

}

Node 5:答案生成节点(Generate)

# nodes/generate.py

import os

from langchain_openai import ChatOpenAI

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.output_parsers import StrOutputParser

from state import GraphState

_generator_llm = ChatOpenAI(

model="gpt-4o-mini", # 生成节点可用更强模型提升质量

temperature=0.1, # 轻微随机性,避免生成内容过于机械

api_key=os.getenv("OPENAI_API_KEY")

)

_generate_prompt = ChatPromptTemplate.from_messages([

("system",

"你是一名专业的知识库问答助手。\n"

"请严格基于下方提供的【参考文档】回答用户问题。\n"

"规则:\n"

"1. 仅使用文档中的信息作答,不编造、不推断文档之外的内容\n"

"2. 若文档中无相关信息,直接回复:'根据当前知识库,暂无该问题的相关信息。'\n"

"3. 回答简洁、准确,避免堆砌原文\n"

),

("human",

"【参考文档】\n{documents}\n\n"

"【用户问题】\n{question}"

)

])

_generate_chain = _generate_prompt | _generator_llm | StrOutputParser()

def generate(state: GraphState) -> dict:

"""

基于过滤后的文档生成最终答案。

优先使用原始问题(original_question)确保语义准确。

"""

print("--- [Node] 生成最终答案 ---")

# 使用原始问题生成,防止重写后的问题与用户意图偏离

question = state.get("original_question") or state["question"]

documents = state["documents"]

if not documents:

return {"generation": "根据当前知识库,暂无该问题的相关信息。"}

doc_context = "\n---\n".join(documents)

generation = _generate_chain.invoke({

"documents": doc_context,

"question": question

})

print(f" 生成答案(前50字):{generation[:50]}...")

return {"generation": generation}

⚠️ 原版问题修复:

- 原版生成时使用的是可能被重写的

question,与用户原始意图可能偏离;- 新版优先使用

original_question,保证答案对准用户的原始问题;- 文档之间增加分隔符

---,帮助模型区分不同文档片段。

4.5 路由函数与图组装

# graph.py

import os

from dotenv import load_dotenv

from langgraph.graph import StateGraph, END

from langgraph.checkpoint.memory import MemorySaver

from state import GraphState

from nodes.retrieve import retrieve

from nodes.grade_documents import grade_documents

from nodes.transform_query import transform_query

from nodes.web_search import web_search

from nodes.generate import generate

load_dotenv()

def decide_to_generate(state: GraphState) -> str:

"""

路由决策函数:评估后决定下一步走向。

返回值必须是 add_conditional_edges 映射中的 key。

"""

if state.get("run_web_search", False):

print("--- [Router] 路由 → 查询重写+外部搜索 ---")

return "transform_query"

else:

print("--- [Router] 路由 → 直接生成答案 ---")

return "generate"

def build_crag_graph():

"""构建并编译 C-RAG 图架构"""

workflow = StateGraph(GraphState)

# ① 注册所有节点

workflow.add_node("retrieve", retrieve)

workflow.add_node("grade_documents", grade_documents)

workflow.add_node("transform_query", transform_query)

workflow.add_node("web_search", web_search)

workflow.add_node("generate", generate)

# ② 设置入口节点

workflow.set_entry_point("retrieve")

# ③ 定义节点间的连线关系

workflow.add_edge("retrieve", "grade_documents")

# 条件边:评估后根据路由函数决定走向

workflow.add_conditional_edges(

"grade_documents",

decide_to_generate,

{

"transform_query": "transform_query",

"generate": "generate"

}

)

workflow.add_edge("transform_query", "web_search")

workflow.add_edge("web_search", "generate")

workflow.add_edge("generate", END)

# ④ 编译图(启用内存检查点,支持状态持久化和崩溃恢复)

memory = MemorySaver()

app = workflow.compile(checkpointer=memory)

return app

# 构建全局可用的图实例

crag_app = build_crag_graph()

4.6 完整运行测试

# run.py

from graph import crag_app

def run_query(question: str, thread_id: str = "test-001"):

"""

执行 C-RAG 查询,支持多轮对话(通过 thread_id 区分会话)

"""

print(f"\n{'='*60}")

print(f"🔍 用户问题:{question}")

print(f"{'='*60}")

config = {"configurable": {"thread_id": thread_id}}

initial_state = {

"question": question,

"original_question": question,

"documents": [],

"run_web_search": False,

"generation": "",

"grade_count": 0

}

result = crag_app.invoke(initial_state, config=config)

print(f"\n{'='*60}")

print(f"✅ 最终答案:\n{result['generation']}")

print(f"{'='*60}\n")

return result

if __name__ == "__main__":

# 测试1:本地库可回答 → 预期:无需触发 Web 搜索,直接生成

run_query(

question="2024年Q1销量最高的产品是什么?客户评价如何?",

thread_id="test-local"

)

# 测试2:本地库无答案 → 预期:触发 Web 搜索后生成

run_query(

question="2024年全球AI市场规模预测是多少?",

thread_id="test-web"

)

# 测试3:边界问题(知识库有部分信息)→ 验证阈值策略

run_query(

question="AI智能助手2024年Q3的语音识别功能何时上线?",

thread_id="test-partial"

)

预期输出说明:

| 测试 | 预期流程 | 预期结果 |

|---|---|---|

| 测试1 | retrieve → grade(通过≥2) → generate | 直接回答,无需Web搜索 |

| 测试2 | retrieve → grade(不通过)→ transform → web_search → generate | 基于实时搜索结果作答 |

| 测试3 | retrieve → grade(部分通过)→ 按阈值决策 | 验证 MIN_RELEVANT_DOCS 策略 |

五、架构全景可视化

5.1 C-RAG完整执行流程

5.2 状态流转示意图

六、生产级优化:三个不可忽视的加固策略

6.1 人机协作(Human-in-the-Loop):高成本操作前引入人工审核

AI Agent适合处理80%的标准化任务,但高成本或高风险操作(如触发付费Web搜索、写入数据库)应交由人类审核:

# 在 web_search 节点前设置中断点

app = workflow.compile(

checkpointer=memory,

interrupt_before=["web_search"] # 暂停等待人工确认

)

# 流式执行,在中断点与用户交互

config = {"configurable": {"thread_id": "human-loop-001"}}

for event in app.stream(initial_state, config=config):

node_name = list(event.keys())[0]

if node_name == "grade_documents":

state = event[node_name]

if state.get("run_web_search"):

confirm = input("⚠️ 即将触发外部搜索(产生API费用),是否继续?(y/n): ")

if confirm.lower() != "y":

print("已取消外部搜索,基于现有文档生成答案。")

# 修改状态,跳过 Web 搜索

app.update_state(config, {"run_web_search": False})

6.2 状态持久化(Checkpointing):生产环境必备

| 场景 | 方案 | 适用规模 |

|---|---|---|

| 开发/测试 | MemorySaver(进程内存) |

单机 / 小流量 |

| 生产部署 | PostgresSaver(PostgreSQL) |

大规模 / 高并发 |

# 生产级持久化配置(PostgreSQL)

from langgraph.checkpoint.postgres import PostgresSaver

import psycopg2

conn = psycopg2.connect(

dbname="crag_db",

user="postgres",

password=os.getenv("PG_PASSWORD"),

host=os.getenv("PG_HOST", "localhost"),

port=5432

)

checkpointer = PostgresSaver(conn)

app = workflow.compile(checkpointer=checkpointer)

⚠️ 注意:数据库密码等敏感信息务必通过环境变量注入,不要硬编码在代码中。

6.3 可观测性(LangSmith):定位生产问题的望远镜

# 在主程序最开头配置(须在图编译前设置)

import os

os.environ["LANGCHAIN_TRACING_V2"] = "true"

os.environ["LANGCHAIN_API_KEY"] = os.getenv("LANGSMITH_API_KEY")

os.environ["LANGCHAIN_PROJECT"] = "C-RAG-Production"

配置后可在 LangSmith 后台监控:

- 每个节点的 Token 消耗与成本分析

- 每个节点的 Latency,定位性能瓶颈

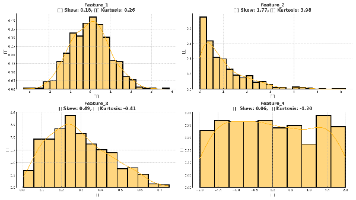

- 评估节点的 打分分布,判断评估器是否过于严苛

- 完整的 Trace 链路,精准还原问题现场

七、总结:从线性到图的思维跃迁

C-RAG代表了RAG工程化的新范式——检索反馈循环(Retrieval Feedback Loop)。

其核心思想是"承认LLM和检索器的不完美",通过显式的控制流(图架构)管理这种不确定性,而不是盲目追求"更强大的模型"。

真正的生产级AI,不是靠模型堆能力,而是靠架构控风险。

关键优化点回顾

| 模块 | 原版问题 | 优化方案 |

|---|---|---|

| GraphState | 缺少 original_question 字段 |

新增字段,防止重写后语义漂移 |

| grade_documents | 任一文档不合格即触发Web搜索 | 引入 MIN_RELEVANT_DOCS 阈值策略 |

| grade_documents | 单文档评估失败会中断全程 | 增加 try-except,异常跳过 |

| web_search | 格式异常时会抛出 KeyError | 增加类型判断和异常保护 |

| generate | 使用重写后问题导致语义偏移 | 优先使用 original_question |

| 代码结构 | 所有节点写在一个文件 | 拆分为独立模块,便于维护 |

| 安全性 | 硬编码API Key | 全部通过环境变量注入 |

下一步探索方向

- 多智能体协作(Multi-Agent)+ C-RAG:让不同Agent分工负责检索、评估、纠错,提升并发效率

- 自适应阈值策略:根据历史评估数据动态调整

MIN_RELEVANT_DOCS - 混合检索(Hybrid Search):结合BM25稀疏检索与向量检索,提升召回质量

建议:先落地基础版C-RAG(本文代码可直接使用),验证效果后再逐步添加人机协作、可观测性等高级特性,避免过度工程化。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)