【AI】Ollama本地部署Gemma4:e4b实战指南

▒ 目录 ▒

🛫 导读

需求

本文旨在为Windows用户详细讲解如何借助Ollama在本地部署Gemma4:e4b模型。同时,对比Gemma4系列不同模型,结合NVIDIA GeForce RTX 4060 Ti 8G的硬件配置,助力用户高效利用本地资源实现优质AI体验。

部署环境

| 项目 | 版本号 | 描述 |

|---|---|---|

| 文章日期 | 2026-4-9 | - |

| 操作系统 | Windows 10/11(以Windows 11为例) | - |

| Ollama | 0.20.3 | 轻量级本地AI运行时 |

| GPU | NVIDIA GeForce RTX 4060 Ti 8G | 加速模型运算 |

1️⃣ 准备工作

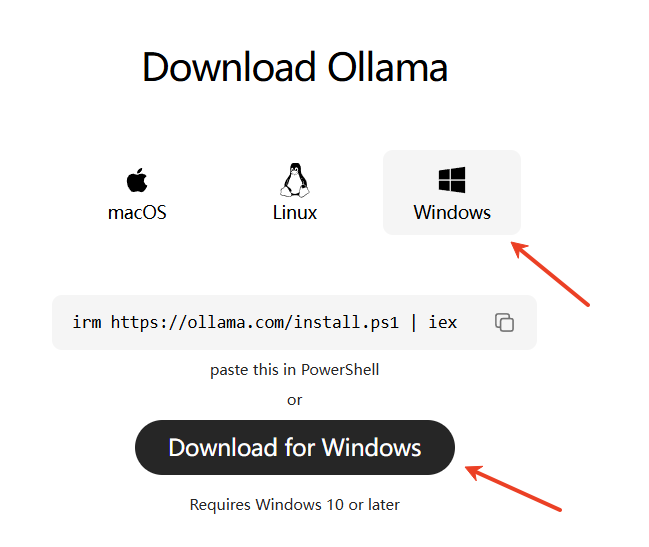

下载Ollama Windows安装包

前往Ollama官方网站(https://ollama.com/download),找到Windows版本的安装包并下载。下载完成后,双击安装包,按安装向导提示完成安装。安装完成后,可在开始菜单找到Ollama快捷方式。

可以通过命令行安装,也可以下载安装包进行安装:

2️⃣ 下载Gemma4:e4b模型

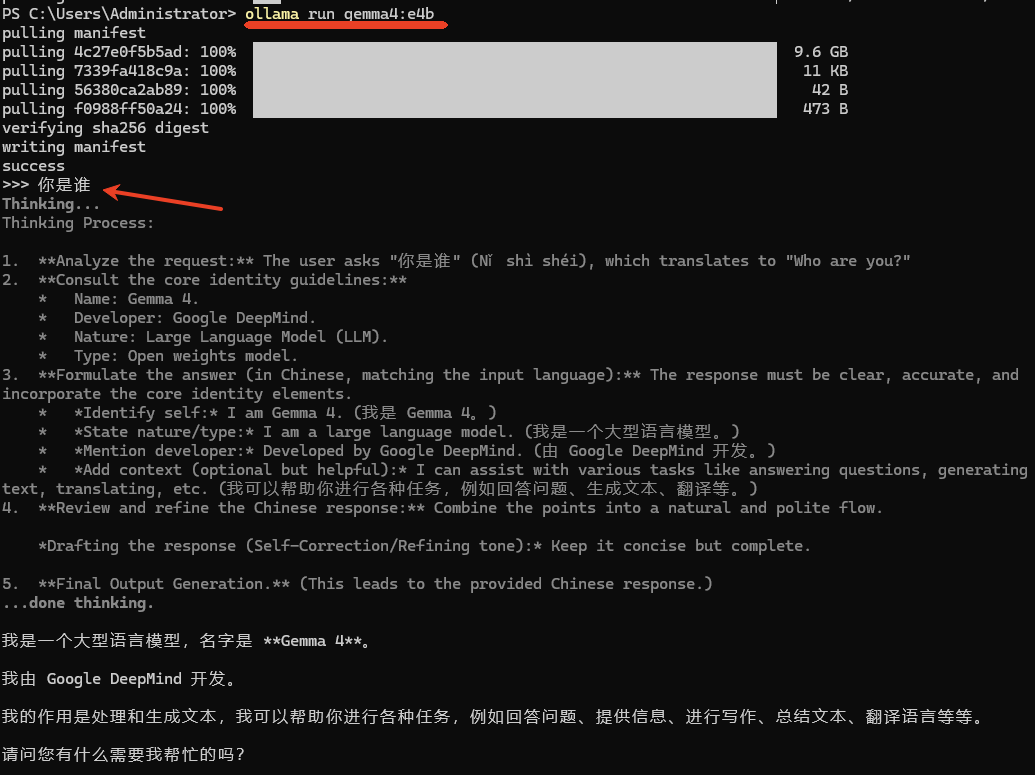

命令行方式

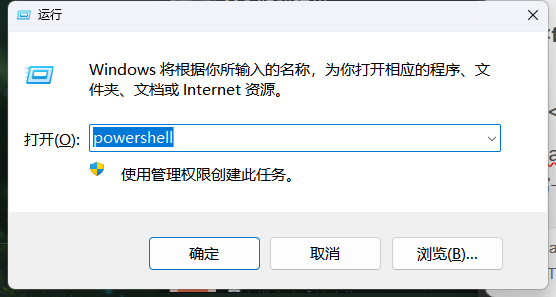

win+R,打开运行窗口。- 输入

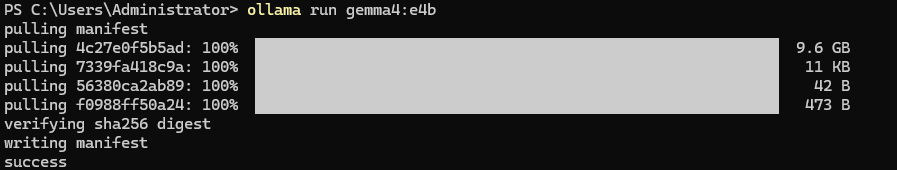

powershell,点击确定,将打开powershell窗口- 执行命令

ollama run gemma4:e4b,将安装并以gemma4:e4b模型启动ollama。下载时间取决于网络速度,期间可在控制台查看下载进度。

通过开始菜单或桌面快捷方式启动Ollama应用程序。启动后,会在系统托盘显示Ollama图标,右键点击图标选择“Open Console”打开Ollama控制台。

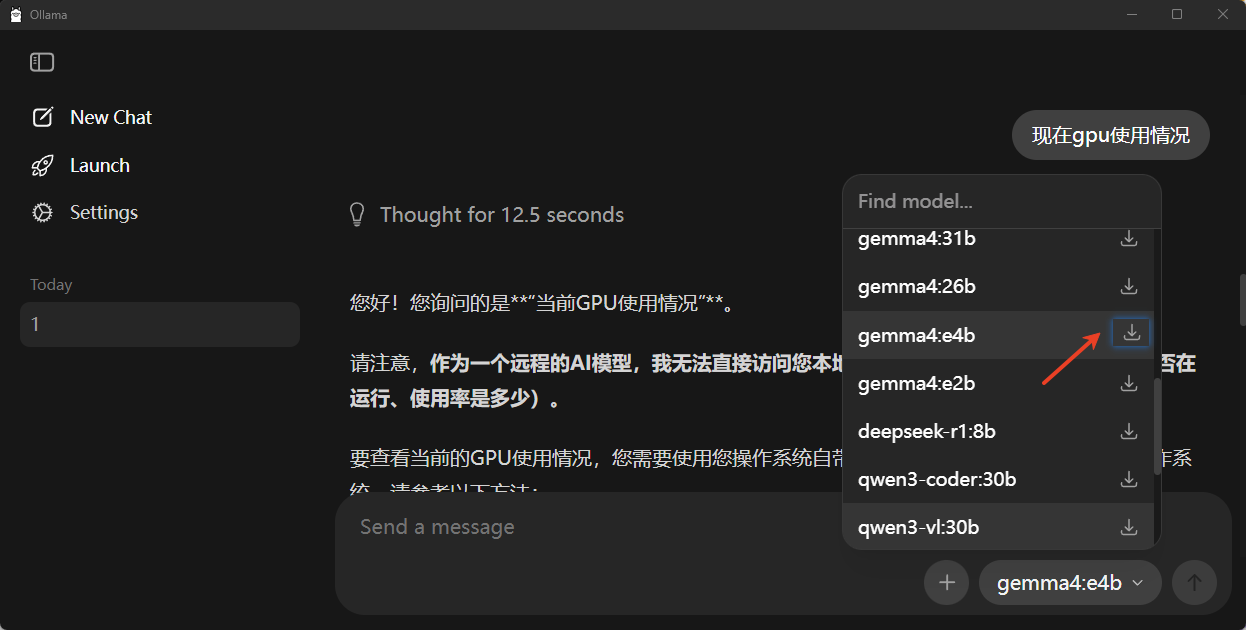

窗口方式

在Ollama窗口中,右下角的下拉框中找到

gemma4:e4b模型,点击右边的下载按钮即可进行安装,安装好后,直接可以使用该模型进行

3️⃣ 运行与测试模型

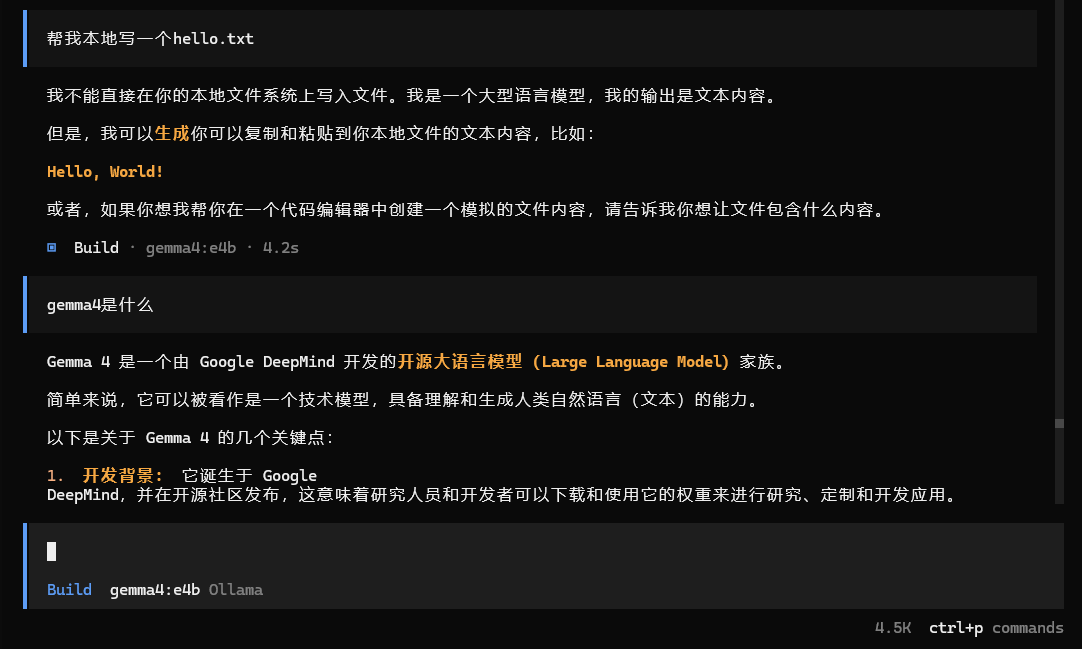

使用Ollama命令行交互

在Ollama控制台输入

ollama run gemma4:e4b,即可开始与模型交互。

- 示例1:你是谁

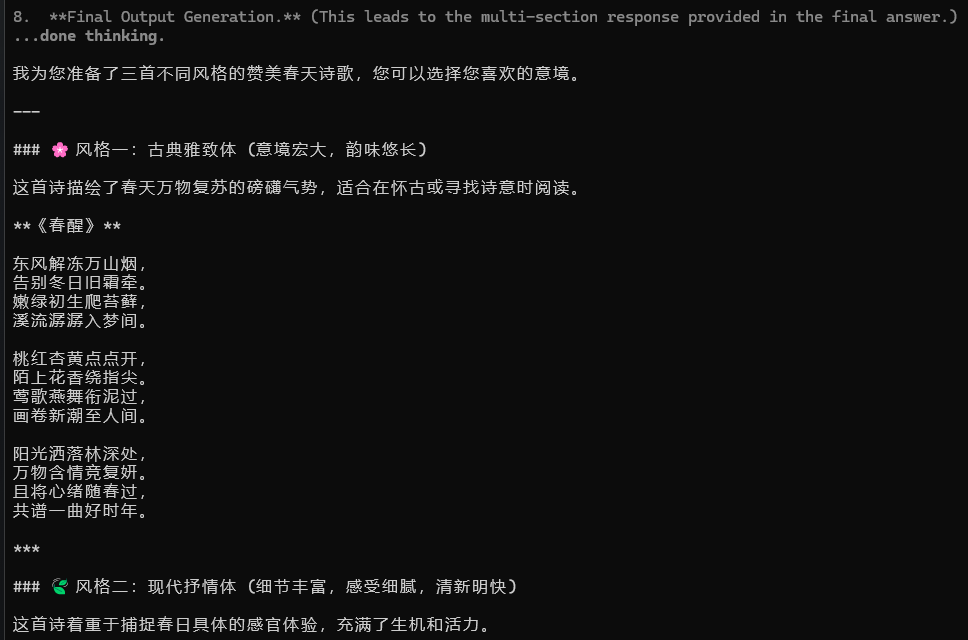

- 示例2:输入“写一首赞美春天的诗”,模型将生成相应的诗歌:

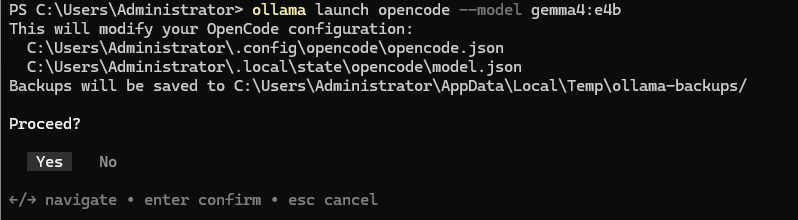

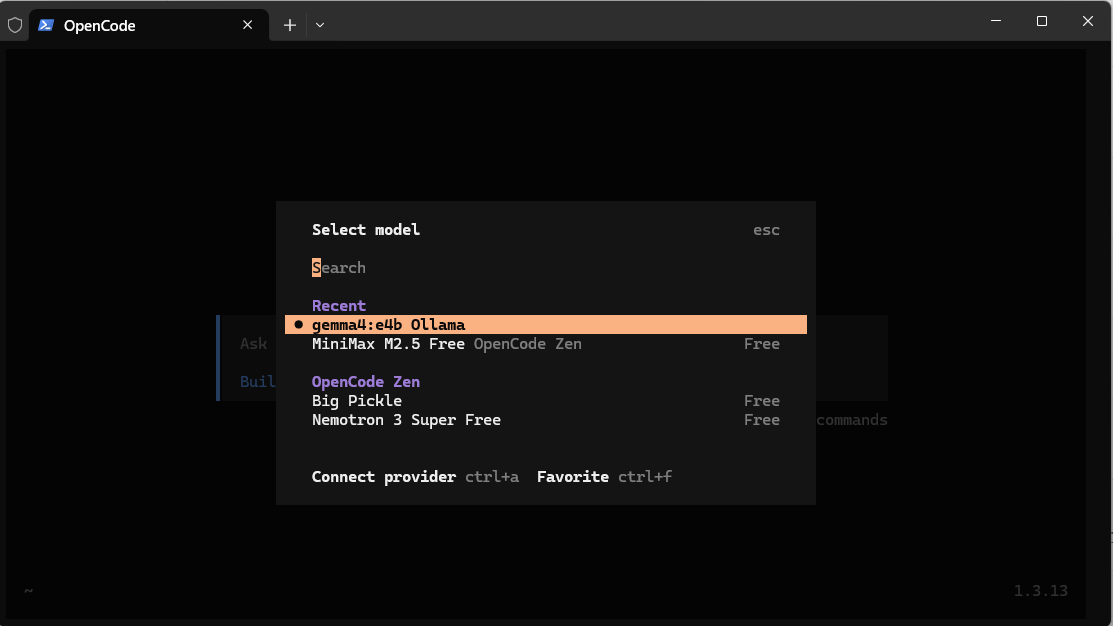

opencode中使用gemma4

- 通过命令

ollama launch opencode --model gemma4:e4b,启动opencode。提示需要修改opencode的配置,选择Yes即可:

/models查看模型:- 进行对话,貌似没法操作电脑(opencode自带的免费模型是可以的)。

4️⃣ Gemma4系列模型比较与推荐

Gemma4系列模型特点

| 模型名 | 模型大小 | 上下文大小 | 输入类型 | 量化后显存占用 | 推荐硬件档位 | 适合人群 |

|---|---|---|---|---|---|---|

| gemma4:e2b | 7.2GB | 128K | Text, Image | 约 2 - 4GB | 4GB 以内轻量机器 | 只想先验证最小可运行路径 |

| gemma4:e4b | 9.6GB | 128K | Text, Image | 约 4 - 6GB | 6GB 显卡或 16GB Mac 起步 | 大多数人的第一轮本地体验 |

| gemma4:26b | 18GB | 256K | Text, Image | 约 12 - 16GB | 16GB 档位更从容 | 想在本地获得更强推理,但不想上最重模型 |

| gemma4:31b | 20GB | 256K | Text, Image | 约 20 - 24GB | 24GB 及以上 | 更看重质量、代码和长上下文 |

基于RTX 4060 Ti 8G的模型推荐

考虑到RTX 4060 Ti 8G的显存和内存配置,对于大多数日常自然语言处理任务,如写作辅助、智能问答等,Gemma4:e4b是不错的选择,能在性能和资源占用间取得良好平衡。

若追求极致性能,且任务复杂,可尝试Gemma4:26b,但需注意可能出现的资源紧张问题。

5️⃣ 常见问题及解决方法

模型下载失败

- 原因:网络不稳定、服务器故障或磁盘空间不足。

- 解决方法:检查网络连接,重启网络设备;等待一段时间后重新下载;清理磁盘空间,确保有足够空间存储模型。

Ollama无法启动

- 原因:依赖项未正确安装、端口冲突。

- 解决方法:检查CUDA、cuDNN和Visual C++ Redistributable是否正确安装;使用端口查看工具检查11434端口是否被占用,若被占用,修改Ollama配置文件中的端口。

🛬 文章小结

通过详细的步骤,成功在Windows系统上借助Ollama部署了Gemma4:e4b模型,并对Gemma4系列模型进行比较与推荐。

在实际应用中,用户可根据自身需求和硬件资源,灵活选择合适的模型,充分发挥本地硬件优势,实现高效、优质的AI应用体验。

同时,持续关注Ollama和Gemma4模型的更新,以获取更好的性能和功能。

📖 参考资料

- Ollama官网 https://ollama.com

- Ollama介绍 https://ollama.com/library/gemma4

- Gemma 4 显存配置完整指南:E4B、26B、31B 到底需要多少显存?https://zhuanlan.zhihu.com/p/2023724157876073275

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)