最新 AI 论文盘点(2026-04-09):5 篇新作看个性化对齐、Agent 在线训练、多模态病理与视频运动控制

最新 AI 论文盘点(2026-04-09):5 篇新作看个性化对齐、Agent 在线训练、多模态病理与视频运动控制

今天这批论文有一个很明显的共同点:

大家不再只满足于“模型再大一点、分数再高一点”,而是在追问更具体也更现实的问题。

比如:

- reward model 真的理解“个人偏好”了吗?

- Android Agent 的在线训练,瓶颈到底在模型能力还是采样效率?

- 视频生成里的运动控制,为什么总是看起来能动、但动得不对?

- 病理全视野图像的 MoE 路由,为什么总容易退化成“只有少数专家在干活”?

- 低资源翻译里,LLM 看到语法说明书之后,真的能按规则做 in-context translation 吗?

这说明一个趋势越来越明显:

AI 研究正在从“泛能力堆高”走向“系统瓶颈拆解”。

今天我挑了 5 篇,分别来自 cs.CL、cs.LG、cs.CV 和交叉方向。

它们未必每篇都会立刻变成最火的话题,但都很适合拿来判断:未来这条线真正难的地方到底在哪。

1)Personalized RewardBench:reward model 离“懂用户偏好”还差得远

- arXiv:2604.07343

- 标题:Personalized RewardBench: Evaluating Reward Models with Human Aligned Personalization

- 方向:LLM 对齐 / reward model / 个性化偏好评测

这篇论文讨论的是一个非常关键、但过去经常被泛化处理的问题:

一个 reward model 如果在通用质量评测上表现不错,它是不是就真的理解了“不同用户偏好不同”这件事?

作者给出的答案并不乐观。

他们提出了一个新的基准 Personalized RewardBench,专门评估 reward model 对“个体化偏好”的建模能力。

和一般偏好数据不同,这个 benchmark 强调:

- chosen / rejected 的差异主要来自用户个人 rubric

- 两个回答本身都保持较高的通用品质

- 真正拉开差距的是“是不是更符合这个用户的偏好”

结果是,现有最强 reward model 在这个任务上的准确率峰值只有 75.94%。

这件事值得注意的地方在于:

它不是在说 reward model 没用,而是在提醒我们:

通用对齐和个性化对齐,并不是一回事。

如果你在做:

- 个性化助手

- AI 陪伴 / 个性化创作

- 面向不同客户风格的企业助手

- 基于用户偏好做 rerank 或 Best-of-N 的系统

这篇论文的启发会很直接:

你不能只看“平均偏好分”,还得问一句:

模型到底是在对齐“所有人都觉得还行”的输出,还是在对齐“这个用户真正想要的输出”?

我觉得这篇论文最重要的价值,不是又造了一个 benchmark,而是把“pluralistic alignment”从口号往可测量目标推进了一步。

2)Android Coach:Agent 在线训练的关键,也许不是更长 rollout,而是更贵状态要榨干

- arXiv:2604.07277

- 标题:Improve Online Agentic Training Efficiency with Single State Multiple Actions

- 方向:Agent / 在线强化学习 / Android 智能体

这篇论文很有意思,因为它抓得非常准。

现在很多 Android Agent 或 GUI Agent 的训练,一个现实痛点就是:

环境交互太贵。

模拟器慢,在线 rollouts 成本高,采样效率差,最后导致训练非常烧资源。

作者指出,现有方法里一个默认范式是:

- Single State

- Single Action

也就是每个在线状态只拿一个动作样本来更新策略。

问题在于,这种做法对“昂贵状态”利用得太不充分。

于是他们提出了 Android Coach,把范式改成:

Single State Multiple Actions

核心做法包括:

- 对同一个在线状态采多个动作候选

- 通过 critic 估计 action value

- 结合 process reward model 提升 critic 可靠性

- 用 group-wise advantage estimator 改进训练信号

实验里,它在 AndroidLab 和 AndroidWorld 上,相比 UI-TARS-1.5-7B 有 7.5% / 8.3% 的成功率提升,并在同等成功率下实现 1.4x 的训练效率提升。

这篇工作背后的启发其实不只适用于 Android Agent。

它更普遍地说明一件事:

很多 agent 训练瓶颈,不一定是“模型不会做”,而是“昂贵交互样本被浪费了”。

如果你在做:

- GUI Agent

- Browser Agent

- 具身交互 Agent

- 在线策略优化

这篇论文值得看的点,是它把“环境成本”当成第一性约束来重新设计训练范式,而不是默认继续堆 rollouts。

我会把它看成一种很典型的信号:

下一阶段 agent 训练的竞争,可能越来越不只是比模型大小,而是比如何更节省地利用交互数据。

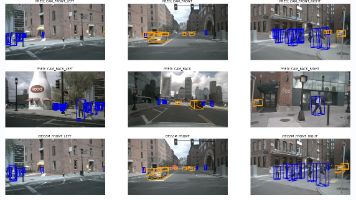

3)MoRight:视频生成真正难的不是“让画面动起来”,而是把运动控制拆对

- arXiv:2604.07348

- 标题:MoRight: Motion Control Done Right

- 方向:视频生成 / 运动控制 / 可控生成

今天这篇视觉论文我觉得很值得关注。

原因是它瞄准了当前可控视频生成里一个非常真实的问题:

很多方法看起来能做“运动控制”,但实际上经常把几件本来应该分开的事混在一起了:

- 物体怎么动

- 摄像机怎么动

- 一个物体的动作会不会引发别的物体产生合理反应

作者认为,现有方法的两个核心短板是:

- 相机运动和物体运动纠缠在一起

- 运动只被当成像素位移,而不是带因果关系的交互过程

MoRight 的思路是把运动进一步拆开:

- 在 canonical static-view 下指定 object motion

- 通过 temporal cross-view attention 转到目标视角

- 把 motion 分成 active(用户驱动)和 passive(后果)两类

这样模型不仅能做 forward reasoning:

- 给定主动动作,预测合理后果

还可以做 inverse reasoning:

- 给定你想看到的结果,反推出可能的驱动动作

这篇论文最值得带走的,不是“又一个 controllable video 框架”,而是它把一个经常被混讲的问题拆清楚了:

视频生成里的“控制”,不是一个单变量问题。

如果控制变量没有解耦,最后很容易得到的只是:

- 表面看能跟着 prompt 动

- 但镜头、主体、场景反应混成一团

- 用户一旦想精细控制,就会发现系统不可用

这和很多多模态系统其实是同一个问题:

demo 能跑,不代表控制接口设计是对的。

4)ROAM:病理 WSI 的 MoE,不该只靠 softmax 路由“碰运气”

- arXiv:2604.07298

- 标题:Region-Graph Optimal Transport Routing for Mixture-of-Experts Whole-Slide Image Classification

- 方向:计算病理 / WSI / MoE / MIL

这篇我觉得对子健你这种会长期关注 AI + 医疗 / 多模态系统的人,尤其值得看。

它处理的是病理全视野图像(WSI)分类里一个很典型的问题。

当前主流还是 MIL(Multiple Instance Learning)框架:

- 一张超大病理切片被拆成很多 patch / instance

- 模型聚合这些 instance 再做 slide-level 分类

问题是,如果所有 instance 都走共享路径,模型很难真正针对病理异质性做专门分工。

MoE 听起来是很自然的改进方向,但现实里又会遇到另一个老问题:

softmax routing 很容易失衡,最后只有少数 expert 在吃大部分路由质量。

于是作者提出 ROAM:

- 先把 dense patch 压成 spatial region tokens

- 用 entropic optimal transport 做 region-to-expert assignment

- 显式加容量约束,避免专家利用失衡

- 再引入 graph-regularised Sinkhorn,让相邻区域的路由更一致

这背后有两个很重要的信号:

第一,病理里的“专家分工”不能只靠自由学习

如果没有约束,模型很容易偷懒,退化成近似单路径。

第二,空间结构在病理里不能被忽略

WSI 不是普通图像分类。邻近组织区域通常共享局部病理语义,路由如果完全不考虑空间关系,就会很容易碎。

实验里,ROAM 在多个 WSI benchmark 上达到了和强基线竞争的效果,在 NSCLC 外部泛化上拿到 AUC 0.845 ± 0.019。

从工程视角看,我觉得这篇工作的真正价值是:

它不是简单说“MoE 能提升病理性能”,而是在认真回答:

病理场景下,MoE 应该怎么路由才不塌。

这比单纯再换更大的 backbone,更像长期有效的方向。

5)In-Context Translation:给 LLM 一本“语法说明书”,它也未必真会翻

- arXiv:2604.07320

- 标题:Evaluating In-Context Translation with Synchronous Context-Free Grammar Transduction

- 方向:机器翻译 / in-context learning / 低资源语言

这篇论文的切口很巧。

我们平时说大模型做低资源翻译,常常会抱一种希望:

如果训练数据不够,那能不能直接把词典、语法规则、教材式描述放进 prompt,让模型现场学着翻?

听起来很合理。

但问题是:

LLM 真的能把这些 in-context 的语法说明转成稳定的翻译行为吗?

作者为了把这个问题尽量“干净地测出来”,设计了一个形式化版本的任务:

- 用 synchronous context-free grammars 构造一对“形式语言”

- 把语法规则和源句子一起给模型

- 测试模型能否根据规则把句子转成目标语言

他们系统地变化了:

- grammar size

- sentence length

- morphology 差异

- written script 差异

结论很清楚:

- grammar 变大,性能明显下降

- 句子变长,性能明显下降

- 形态变化和书写系统差异,也会显著拖累表现

- 常见错误包括:召回错词、幻觉新词、源语言词未翻译

这篇工作我觉得很重要,因为它帮我们给很多“in-context 学语言规则”的设想降了温。

它的核心提醒是:

LLM 不等于一个能稳定执行形式规则转导的通用解释器。

所以如果你在做:

- 低资源翻译

- 受限语法任务

- 规则驱动生成

- 术语密集型跨语种系统

不要太轻易假设“把规则塞进 prompt 就够了”。

很多时候,你还得补:

- 更强的结构约束

- 外部检索 / 词典机制

- 更稳定的 decoding 控制

- 面向规则执行的专门模块

六、今天这 5 篇连起来看,最值得记住什么?

如果把今天这批论文放在一起,我觉得最值得记住的是下面这句话:

大家现在越来越少在问“模型还能不能更强”,而是在问“系统里真正的失真点到底在哪”。

今天这 5 篇分别在拆不同层面的失真:

- Personalized RewardBench:拆的是“通用偏好”与“个体偏好”之间的失真

- Android Coach:拆的是“在线状态成本”与“训练利用率”之间的失真

- MoRight:拆的是“运动控制需求”与“模型控制接口”之间的失真

- ROAM:拆的是“病理异质性”与“MoE 路由退化”之间的失真

- In-Context Translation:拆的是“规则可描述”与“模型可执行”之间的失真

这其实也是我最近越来越强烈的一个判断:

下一阶段真正有价值的论文,不一定是 headline 最炸的那种,而是那些能把系统瓶颈说清楚的论文。

因为只有先把“错位”找出来,后面的 scaling、优化、部署才有意义。

七、如果你现在在做系统,今天最值得跟进哪几类?

如果从落地角度给建议,我会这样看。

如果你在做 LLM 对齐 / AI 助手

优先看:

- Personalized RewardBench

因为个性化对齐接下来一定会越来越重要,特别是用户长期使用的助手系统。

如果你在做 Agent / GUI Agent / Browser Agent

优先看:

- Android Coach

因为在线训练效率会直接决定你这条路是“能研究”还是“能持续迭代”。

如果你在做视频生成 / 具身交互 / 世界模型

优先看:

- MoRight

因为很多 controllability 问题,本质上都不是“没学会动”,而是“控制变量设计错了”。

如果你在做医疗多模态 / 病理 AI

优先看:

- ROAM

它对 WSI 场景下 expert routing 的理解,比很多泛化 MoE 讨论更贴近真实问题。

如果你在做低资源翻译 / 规则增强生成

优先看:

- In-Context Translation

这篇会帮你更早意识到 prompt 注入规则的边界在哪里。

八、最后总结

今天这批论文给我的整体感觉,不是“某个超级新范式横空出世”,而是:

研究正在更认真地处理那些过去常被一句话带过的系统问题。

这其实是好事。

因为当研究开始认真面对:

- 偏好不是平均值

- 交互样本不是无限的

- 控制变量不是一句 prompt 就能定义清楚

- 路由机制不是 softmax 一跑就自然合理

- 规则描述也不等于规则执行

那很多看起来更“土”的问题,反而会开始变成真正决定系统上限的问题。

如果你只能先挑一篇细看,我今天会优先推荐这两篇:

- Personalized RewardBench:看个性化对齐的评测应该怎么真正落地

- Android Coach:看 Agent 在线训练怎么从“烧环境”走向“更省样本”

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)