011.数据增强实战:Albumentations、imgaug库的YOLO专用增强策略

一、从一张被“切坏”的标注图说起

上周调一个工地安全帽检测模型,mAP卡在0.72死活上不去。可视化训练数据时发现,随机裁剪把小人头切掉一半,但标注框还完整留着——模型学的全是“半个头也算安全帽”的噪声。这才意识到,YOLO的数据增强不是随便调个库就能用的,边界框和图像必须同步变换,差一个像素标注就废了。

今天咱们就深挖两个主流增强库:Albumentations和imgaug,看看怎么让它们老老实实为YOLO服务。别以为这是体力活,这里面的坑能让你调试三天找不到北。

二、Albumentations:工业级管道的正确打开方式

Albumentations速度确实快,但它的YOLO适配需要手动配置。先看一个常见错误写法:

# 错误示范:直接套用分类任务的增强

transform = A.Compose([

A.RandomCrop(320, 320),

A.HorizontalFlip(p=0.5),

A.RandomBrightnessContrast(p=0.2),

])

这么写边界框肯定乱套。YOLO格式需要显式声明边界框参数:

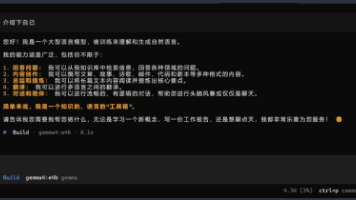

# YOLO专用写法

transform = A.Compose([

A.RandomSizedBBoxSafeCrop(512, 512, erosion_rate=0.2), # 关键!裁剪时保留框周围20%安全区域

A.HorizontalFlip(p=0.5),

A.HueSaturationValue(hue_shift_limit=10, sat_shift_limit=20, val_shift_limit=10, p=0.5),

A.Blur(blur_limit=3, p=0.1),

], bbox_params=A.BboxParams(

format='yolo', # 必须指定格式

label_fields=['class_labels'], # 类别标签字段名

min_visibility=0.3, # 裁剪后可见面积小于30%的框直接丢弃,这个阈值我调过很多次

min_area=16, # 面积小于16像素的框丢弃,避免小目标噪声

))

注意那个min_visibility参数,我建议设置在0.2-0.4之间。太严了会丢太多目标,太松了会产生残缺标注。工地场景实测0.3最稳。

还有个巨坑:Albumentations的YOLO格式要求输入归一化坐标(x_center, y_center, width, height),但很多人忘记归一化直接传像素值。预处理得这么写:

def prepare_yolo_bboxes(bboxes, img_width, img_height):

"""将YOLO格式的绝对坐标转归一化坐标"""

# bboxes: [[x_center, y_center, w, h, class_id], ...]

normalized = []

for bbox in bboxes:

x_c, y_c, w, h, cls = bbox

normalized.append([x_c/img_width, y_c/img_height,

w/img_width, h/img_height, cls]) # 别漏了除以图像尺寸

return normalized

三、imgaug:灵活但需要更多“调教”

imgaug的API更灵活,但也是更容易出错的地方。它的顺序增强和随机增强容易混淆:

# 危险写法:顺序执行导致几何变换不一致

seq = iaa.Sequential([

iaa.Affine(rotate=(-15, 15)), # 旋转

iaa.Crop(percent=(0, 0.1)), # 裁剪

iaa.Fliplr(0.5), # 水平翻转

])

上面这种写法,每个增强独立随机执行,可能导致图像旋转后裁剪区域不对齐。应该用Sometimes控制流程:

# 推荐写法:保持几何变换的一致性

seq = iaa.Sequential([

iaa.Sometimes(0.7, iaa.Affine(

rotate=(-15, 15),

scale=(0.8, 1.2),

translate_percent=(-0.1, 0.1)

)), # 70%概率执行整套空间变换,保持一致性

iaa.Sometimes(0.5, iaa.OneOf([

iaa.Crop(percent=(0, 0.1)),

iaa.Pad(percent=(0, 0.1)),

])),

iaa.Fliplr(0.5), # 翻转单独处理

], random_order=False) # 必须设为False!保证顺序执行

重点来了:imgaug处理YOLO框需要自己写转换函数。我封装了一个经过实战检验的版本:

def augment_yolo_imgaug(image, bboxes, seq):

"""

image: numpy数组 (H,W,C)

bboxes: [[x_center_norm, y_center_norm, w_norm, h_norm, cls], ...]

返回增强后的图像和框

"""

# 转回像素坐标供imgaug处理

height, width = image.shape[:2]

bboxes_pixel = []

for bbox in bboxes:

x_c, y_c, w, h, cls = bbox

bboxes_pixel.append(ia.BoundingBox(

x1=(x_c - w/2) * width,

y1=(y_c - h/2) * height,

x2=(x_c + w/2) * width,

y2=(y_c + h/2) * height,

label=cls

))

# 关键步骤:绑定图像和框

bbs = ia.BoundingBoxesOnImage(bboxes_pixel, shape=image.shape)

# 同步增强

seq_det = seq.to_deterministic() # 固定随机种子,保证图像和框变换一致

image_aug = seq_det.augment_images([image])[0]

bbs_aug = seq_det.augment_bounding_boxes([bbs])[0]

# 转回YOLO格式

bboxes_aug = []

for bb in bbs_aug.bounding_boxes:

# 处理越界框

if bb.x1 >= bb.x2 or bb.y1 >= bb.y2:

continue # 无效框直接跳过

# 裁剪到图像范围内

x1 = max(0, min(bb.x1, width))

x2 = max(0, min(bb.x2, width))

y1 = max(0, min(bb.y1, height))

y2 = max(0, min(bb.y2, height))

w_pixel = x2 - x1

h_pixel = y2 - y1

# 过滤过小目标

if w_pixel < 4 or h_pixel < 4:

continue

x_c_norm = (x1 + w_pixel/2) / width

y_c_norm = (y1 + h_pixel/2) / height

w_norm = w_pixel / width

h_norm = h_pixel / height

bboxes_aug.append([x_c_norm, y_c_norm, w_norm, h_norm, bb.label])

return image_aug, bboxes_aug

注意那个to_deterministic()调用,少了它图像和框就是随机增强各玩各的。还有越界处理部分,imgaug不会自动裁剪框到图像内,必须手动处理。

四、YOLO专用增强策略:什么该增强,什么要谨慎

1. 空间变换类(需要同步调整框)

- 推荐:水平翻转(YOLO最爱的增强)、随机裁剪(配合SafeCrop)、小角度旋转(±15°内)

- 慎用:大角度旋转(超过30°目标方向就乱了)、透视变换(框容易变形)、随机缩放(长宽比失真)

2. 像素变换类(不影响框位置)

- 大力用:色彩抖动、亮度对比度、高斯噪声、模糊

- 控制用:锐化(过度会强化边缘噪声)、灰度化(丢失颜色信息)

3. 混合增强策略

我常用的一个工业检测增强组合:

def build_yolo_aug_pipeline(img_size=640):

"""针对小目标优化的增强管道"""

return A.Compose([

# 空间变换(保持几何一致性)

A.OneOf([

A.RandomSizedBBoxSafeCrop(img_size, img_size, erosion_rate=0.2),

A.RandomResizedCrop(img_size, img_size, scale=(0.7, 1.0)),

], p=0.8),

# 颜色空间增强

A.OneOf([

A.HueSaturationValue(10, 20, 10),

A.RandomBrightnessContrast(brightness_limit=0.2, contrast_limit=0.2),

A.RandomGamma(gamma_limit=(80, 120)),

], p=0.5),

# 噪声和模糊

A.OneOf([

A.GaussNoise(var_limit=(10, 30)),

A.Blur(blur_limit=3),

A.MotionBlur(blur_limit=3),

], p=0.2),

# 必须放在最后:尺寸调整

A.Resize(img_size, img_size, always_apply=True),

], bbox_params=A.BboxParams(

format='yolo',

label_fields=['labels'],

min_visibility=0.3,

min_area=16,

))

五、调试增强效果的实用技巧

1. 可视化检查工具

别相信增强配置一次就能写对,一定要可视化验证:

def debug_augmentation(dataset, aug_pipeline, num_samples=5):

"""画出来看看增强对不对"""

for i in range(num_samples):

img, bboxes = dataset[i]

# 应用增强

transformed = aug_pipeline(image=img, bboxes=bboxes[:, :4],

labels=bboxes[:, 4])

img_aug = transformed['image']

bboxes_aug = transformed['bboxes']

# 画框对比

fig, (ax1, ax2) = plt.subplots(1, 2, figsize=(12, 6))

ax1.imshow(img)

for bbox in bboxes:

x_c, y_c, w, h = bbox[:4] * img.shape[1] # 转像素坐标

rect = plt.Rectangle((x_c-w/2, y_c-h/2), w, h,

linewidth=2, edgecolor='r', facecolor='none')

ax1.add_patch(rect)

ax2.imshow(img_aug)

for bbox in bboxes_aug:

x_c, y_c, w, h = bbox[:4] * img_aug.shape[1]

rect = plt.Rectangle((x_c-w/2, y_c-h/2), w, h,

linewidth=2, edgecolor='g', facecolor='none')

ax2.add_patch(rect)

plt.show()

2. 增强前后mAP对比

在验证集上跑两个实验:

- 实验A:只用基础增强(翻转+色彩抖动)

- 实验B:完整增强管道

如果B的mAP比A低,说明增强太激进破坏了标注质量。我一般会看小目标AP的变化,这是最敏感的指标。

六、经验之谈:少即是多

做了这么多项目,最大的教训就是:增强不是越多越好。特别是工业检测场景,过度增强反而会让模型学习虚假模式。

几个实战建议:

-

分阶段增强:训练初期用温和增强(翻转+色彩抖动),后期逐渐加入裁剪、旋转等强增强,避免模型一开始就学歪。

-

领域知识优先:交通场景少用垂直翻转(车不会倒着开),医疗影像慎用色彩抖动(病理特征可能就在颜色里)。

-

监控增强质量:每训练10个epoch就可视化一次增强样本,看看框还准不准。曾经有个项目因为增强bug导致mAP下降5个点,查了两天才发现是裁剪参数设错了。

-

YOLOv5/v7/v8的区别:v5自带的增强已经不错,v8对Mosaic增强更敏感。如果用官方代码,建议先理解它的增强逻辑再魔改。

-

终极验证方法:关掉所有增强训练一个epoch,如果loss能正常下降,说明数据管道至少没出错。这是快速排错的好办法。

数据增强像做菜调料,放对了提鲜,放多了毁菜。每次加新增强前问问自己:这个变换在真实世界会出现吗?标注框能准确跟着变吗?想清楚这两个问题,能避开一大半的坑。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)