Java 从入门到精通(十一):异常处理与自定义异常,程序报错时到底该怎么处理?

最新 AI 论文盘点(2026-04-06):6 篇新作看置信度评测、上下文优化、引用幻觉修复、世界模型验证,以及 Physical AI 的真正瓶颈开始暴露

今天这批论文放在一起看,我的一个直观感受是:

AI 系统正在从“能力展示”转向“可靠运行”。

这里的“可靠”不是一句空话,而是几个越来越具体的问题:

- 模型的置信度到底能不能真的拿来做决策,而不是只当一个好看的分数

- agent 的改进对象是不是已经从参数,逐渐转向 context / runtime / verification loop

- deep research 这类系统最常见的“有据可查”外观,能不能经得起引用有效性检查

- world model 和 embodied planning 的上限,到底是卡在模型不够大,还是卡在验证机制与层级规划

- Physical AI 的 scaling law,会不会根本不是“所有部件一起放大”,而是取决于最窄的信息瓶颈

如果把今天值得看的几篇论文串起来,我觉得有 4 条线特别清楚:

- LLM 可靠性评测开始进入决策论阶段,不再满足于 ECE 这类泛化指标

- agent 学习开始系统性地把“context 本身”当成优化对象,而不是只把 prompt 当一次性手工艺

- research / tool-using agent 的可核查性被重新审视,尤其是引用和证据链这类表面上最像“已经解决”的地方

- Physical AI 的关键问题正在回到结构层:层级规划、验证闭环、信息瓶颈,这些比“再堆大一点”更决定上限

还是按最有用的方式来:

- 它到底在解决什么问题

- 方法的新意是什么

- 为什么现在值得关注

- 它的边界和风险在哪

1)BAS: A Decision-Theoretic Approach to Evaluating Large Language Model Confidence

论文: BAS: A Decision-Theoretic Approach to Evaluating Large Language Model Confidence

链接: https://arxiv.org/abs/2604.03216

这篇我会放在今天的第一优先,因为它切中的问题非常现实:

很多 LLM 不是“不会答”,而是“答错时还很像会答”。

过去大家评估模型置信度,经常看:

- ECE

- AURC

- log loss

- calibration curve

这些指标当然有用,但问题是,它们不一定真正对应现实决策里的核心目标。

真实系统里更重要的问题往往是:

- 什么时候应该回答

- 什么时候应该拒答

- 在不同风险偏好下,模型的 confidence 能不能支撑这个决策

这篇论文提出 Behavioral Alignment Score(BAS),本质上是把置信度评估拉回一个 answer-or-abstain 的决策框架 里。

为什么值得关注?

因为它在提醒一件非常关键的事:

置信度不是用来“描述模型感觉如何”的,而是用来支撑行动选择的。

如果一个模型 calibration 看起来还行,但高置信错答特别多,那在高风险场景里它仍然非常危险。

BAS 的好处就在于,它对这种错误更敏感。论文也明确指出:

- 有些模型 ECE / AURC 接近

- 但 BAS 差异很大

- 原因就在于是否存在严重的高置信错误

这对医疗、法律、企业问答、自动化审稿、研究助手都很重要。

边界是什么?

- BAS 更接近真实决策,但仍然依赖 answer-or-abstain 这个设定

- 不同任务的风险函数不一样,实际部署时还要做任务定制

- 置信度 elicitation 本身也可能被 prompt 方式影响

但不管怎样,这篇都说明:

LLM reliability evaluation 正在从“分数校准”走向“行动校准”。

2)Reflective Context Learning: Studying the Optimization Primitives of Context Space

论文: Reflective Context Learning: Studying the Optimization Primitives of Context Space

链接: https://arxiv.org/abs/2604.03189

这篇我觉得是今天最值得 agent 圈认真看的工作之一。

它想回答的问题是:

如果 agent 主要通过更新 context 来学习,那 context learning 能不能像参数优化一样,被系统地研究?

现在很多 agent 改进方法都在做类似事情:

- 根据失败经验改 prompt

- 根据历史轨迹改 memory

- 根据错误类型补规则

- 根据反馈迭代 system context

但这些方法往往比较碎:

- 各做各的

- 经验成分很重

- 很难抽象成统一学习问题

这篇论文的核心贡献,就是把这些工作统一看成 context space optimization,并提出 Reflective Context Learning(RCL) 这个框架:

- reflection:从轨迹和失败中抽取方向性更新信号

- mutation:把这个信号作用到 context 上

更重要的是,它不是只提个框架名,而是把一些经典优化思想迁移过来:

- batching

- better credit assignment

- auxiliary losses

- failure replay

- grouped rollouts for variance reduction

为什么值得关注?

因为它在强化一个越来越清楚的判断:

下一代 agent 的学习,不一定总发生在参数空间,也会大量发生在 context 空间。

这件事一旦成立,很多今天看起来像“prompt engineering 黑魔法”的东西,都会开始被重新理解为:

- 优化问题

- 方差控制问题

- 初始化敏感性问题

- credit assignment 问题

这对长期运行 agent 特别重要。

边界是什么?

- context 更新的表达能力虽然强,但稳定性和泛化仍然未必可控

- reflection 本身如果质量不稳,更新方向也会偏

- 不同 benchmark 上哪类优化原语最重要,可能差异很大

但这篇的价值在于,它让“agent 从经验里改 context”这件事第一次显得没那么 ad hoc,而更像一个正式研究方向。

3)Detecting and Correcting Reference Hallucinations in Commercial LLMs and Deep Research Agents

论文: Detecting and Correcting Reference Hallucinations in Commercial LLMs and Deep Research Agents

链接: https://arxiv.org/abs/2604.03173

这篇非常实用,而且我觉得它会越来越重要。

因为现在不少 research agent 已经能输出:

- 参考文献

- citation URL

- supporting links

- 看起来很完整的证据链

但真正的问题是:

这些链接到底是真的存在,还是只是在“长得像引用”?

这篇工作做得很扎实:

- 在 DRBench 上分析 53,090 个 URL

- 在 ExpertQA 上再分析 168,021 个 URL

- 区分 non-resolving 和 hallucinated URL

- 还进一步区分是 link rot 还是根本没存在过

结果很刺眼:

- 3%–13% 的 citation URL 可能是 hallucinated

- 5%–18% 的 URL 整体不可解析

- deep research agents 虽然给了更多 citations,但幻觉率也更高

更关键的是,他们不是只停留在“问题很多”,而是做了一个可操作修复工具 urlhealth,并展示了 agent 自纠后能把 non-resolving URL 降到 1% 以下。

为什么值得关注?

因为这件事直指 research agent 最核心的信任问题:

不是它会不会写得像论文综述,而是它给出的证据能不能被查到。

这和普通文本幻觉不一样。

普通幻觉你还能靠常识怀疑;引用幻觉更危险,因为它会制造一种“已经核实过”的错觉。

边界是什么?

- URL 有效不等于内容可靠

- Wayback / liveness 检查能抓住不存在的链接,但抓不住“引用对不上论点”

- 不同模型的 tool-use 能力决定了修复工具的实际收益

但这篇已经给出一个很清楚的方向:

research agent 的下一步,不只是会检索,而是要会验证引用健康度。

4)Hierarchical Planning with Latent World Models

论文: Hierarchical Planning with Latent World Models

链接: https://arxiv.org/abs/2604.03208

这篇是 embodied / world model 方向里我今天最想标的一篇。

问题很直接:

world model 在长时程控制上为什么总容易掉链子?

原因通常有两个:

- 预测误差会随 horizon 累积

- 规划搜索空间会指数膨胀

这篇工作的思路是:

别只用单一时间尺度的 latent world model,改成多时间尺度层级规划。

也就是:

- 高层看更长时间范围

- 低层处理局部细节

- 把原本一口气难以规划的长程任务,拆成跨尺度协调的问题

论文结果也挺有说服力:

- 真实 pick-and-place 任务里,单层 world model 是 0% success

- 分层后做到 70%

- 在模拟环境里还显著减少 planning-time compute

为什么值得关注?

因为它说明了一件事:

world model 的问题不只是“预测得不够准”,还有“你怎么用它做规划”。

换句话说,world model 不只是表示学习问题,也是一个规划架构问题。

这和 agent 圈其实是同一个趋势:

- 不是单个模型更强就够了

- 真正的提升往往来自层级化、模块化和跨尺度控制

边界是什么?

- 层级划分怎么选,本身就是设计难点

- 如果高层抽象错了,低层再强也会执行偏

- 真实机器人环境的分布漂移,仍然会让 latent planning 很脆弱

但方向很值得跟,因为它比“单层世界模型继续放大”更像一条现实可走的路。

5)World Action Verifier: Self-Improving World Models via Forward-Inverse Asymmetry

论文: World Action Verifier: Self-Improving World Models via Forward-Inverse Asymmetry

链接: https://arxiv.org/abs/2604.01985

如果上一篇是在谈“怎么规划”,这篇更像是在谈:

world model 怎么知道自己哪里可能已经预测错了。

这其实是一个很难的问题。

policy 学习通常只关心好动作;但 world model 必须在大量次优动作、稀疏覆盖区域上也尽量可靠。可偏偏这些地方,训练数据最缺。

这篇提出 World Action Verifier(WAV),核心思路是把动作条件下的未来状态预测拆成两部分验证:

- state plausibility

- action reachability

作者利用所谓 forward-inverse asymmetry:

- 直接预测未来状态很难

- 但判断一个状态是否合理、以及从关键状态特征能否反推出动作,可能更容易

于是他们把:

- video corpus 里的 subgoal generator

- sparse inverse model

- cycle consistency

组合起来,形成一个 world model 自我检查、自我改进的闭环。

为什么值得关注?

因为它指向的是一个更成熟的 world model 观:

预测器本身不够,验证器也要进入环路。

这和 LLM agent 里越来越强调 verifier / critic / checker 是同一个趋势。

只要系统开始长期运行,单纯依赖一次前向生成,迟早会碰到 silent failure。

边界是什么?

- verifier 设计不当,也可能把偏差进一步固化

- inverse modeling 对关键特征选择很敏感

- cycle consistency 有时会给出形式自洽但语义错误的假安全感

但不管怎样,这篇很值得看,因为它把“world model 的自我改进”从口号往可执行机制推进了一步。

6)The Compression Gap: Why Discrete Tokenization Limits Vision-Language-Action Model Scaling

论文: The Compression Gap: Why Discrete Tokenization Limits Vision-Language-Action Model Scaling

链接: https://arxiv.org/abs/2604.03191

这篇是今天 Physical AI 方向里最有洞察力的一篇之一。

它讨论的是一个很多人默认不会有大问题的设定:

如果我把 vision encoder 变强,VLA 模型是不是就会更强?

论文的答案是:

不一定,尤其当动作被离散 token 化以后。

作者提出一个很清楚的信息论判断,叫 Compression Gap:

系统的 scaling 行为,取决于最紧的信息瓶颈在哪。

如果动作是连续表示,比如 diffusion policy:

- vision encoder 可能是瓶颈

- 升级 encoder,性能会明显涨

如果动作是固定容量 codebook 的离散 token:

- codebook 本身变成瓶颈

- 上游 encoder 再强,收益也传不过去

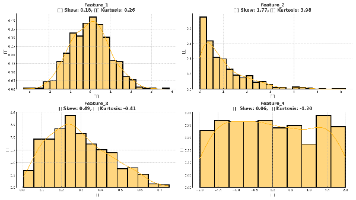

论文在 LIBERO 上给出的结果非常直观:

- encoder 升级对 Diffusion Policy 带来 21+ 个百分点提升

- 对离散 action token 方案,增益明显被削弱

- 放大 codebook 容量后,encoder 效应又部分回来

为什么值得关注?

因为它说明 Physical AI 里一个很重要但经常被忽略的问题:

不是所有部件都能共享同一套 scaling logic。

这件事非常重要。

很多系统做不起来,不是因为模型不够大,而是因为中间某个表示接口把信息压坏了。

边界是什么?

- 结论目前主要在特定 benchmark 和架构上验证

- 离散 tokenization 仍然有部署、稳定性和训练便利上的优势

- 不同任务的真正瓶颈位置,可能并不总在 action codebook

但这篇给出的视角很强:

做 Physical AI,先找清楚瓶颈在哪,再谈 scaling。

今天这 6 篇,值得记住的 4 个判断

1. 可靠性评测正在从“预测对不对”转向“该不该行动”

BAS 最核心的贡献,不是又发明了一个新指标,而是把置信度问题拉回了真实决策。

以后高风险 AI 的评估,越来越不只是 accuracy + calibration,而是:

- 何时回答

- 何时拒答

- 何时降级交给人

2. agent learning 的主战场,正在部分迁移到 context space

Reflective Context Learning 很像一个信号:

- prompt / memory / rules / reflections

- 不再只是部署层技巧

- 而开始成为正式学习对象

这会直接影响长期运行 agent 的训练与维护方式。

3. deep research 的真正短板,不只是检索,而是证据链可核查性

引用幻觉论文说明了一件很现实的事:

“会给链接”不等于“会给证据”。

接下来 research agent 的竞争,可能会越来越体现在:

- citation validity

- source grounding

- evidence auditing

- self-correction loop

4. Physical AI 的天花板,越来越由结构瓶颈决定

分层 world model、verifier、compression gap 这三篇放一起看,结论很清楚:

- 不是所有问题都靠更大模型解决

- 有些上限来自规划层级

- 有些来自验证缺失

- 有些来自中间接口的信息瓶颈

也就是说,Physical AI 正在迅速从“堆模型”转向“调结构”。

如果只选 3 篇,我建议优先看这三篇

第一优先:BAS

因为它非常直接地影响你怎么看 LLM 的“可信置信度”。

第二优先:Reflective Context Learning

因为它可能会影响下一代 agent 如何系统性地从经验里改 context。

第三优先:Detecting and Correcting Reference Hallucinations

因为这件事离 research agent 的真实可用性太近了,而且问题已经不是抽象担忧,而是可测、可修。

最后一句

今天这批论文最有意思的共同点,不是它们都在追求“更强”,而是它们都在逼着 AI 研究回答一个更成熟的问题:

一个系统如果真的要长期运行、持续决策、给出证据、进入真实世界,它到底靠什么才能值得被信任?

答案越来越不像单一模型分数,而更像这些过去常被放在边角的东西:

- confidence as decision signal

- context as optimization object

- citations as auditable evidence

- planning as hierarchy

- world models as self-verifying systems

- scaling as bottleneck-aware engineering

这些“以前像配套件”的部分,现在正在变成主角。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)