LoT视觉推理入门基础教程(非常详细),搞定知识型VQA看这篇就够了!

一、研究方向及背景

这篇论文属于多模态大语言模型(MLLM)与知识增强视觉问答(Knowledge-based VQA, KB-VQA)交叉方向,核心关注的是:当模型回答图像问题时,不仅要看图,还要结合外部检索到的文本知识,但这些知识往往有噪声、图像中真正相关的区域也未必能被模型准确关注,因此模型容易出现证据选择不准、推理受干扰的问题。论文提出一种无需训练、仅在推理阶段运行的方法,帮助 MLLM 在视觉证据和文本证据中“二次聚焦”,提升回答质量。

从更细的学术脉络看,它同时落在以下几个子方向中:

-

检索增强多模态推理

:面向 KB-VQA,将外部知识与图像共同输入模型;

-

注意力机制解释与利用

:把模型内部注意力当作“隐式相关性信号”;

-

推理时增强(inference-time enhancement)

:不改模型参数、不额外训练,只在推理时动手;

-

多模态幻觉缓解与视觉定位增强

:通过高亮真正相关区域,减少模型被无关内容误导。

二、主要研究方法或创新点

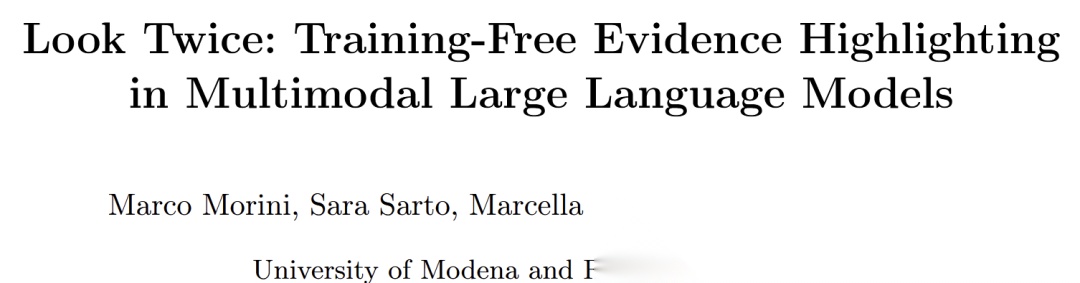

- 提出 Look Twice(LoT):让模型“先看一眼,再重点看一眼”

论文的核心方法叫 Look Twice (LoT)。它的思想很直观:

先让模型做一次非常轻量的前向分析,只生成一个额外 token,借此读取模型内部注意力;然后根据这些注意力判断“图里哪里重要、文本里哪句话重要”;最后再把这些关键证据显式高亮,送给模型进行正式回答。整个过程不需要重新训练模型,也不改模型结构。

论文在第 1 页和第 2 页就明确指出,LoT 的关键价值在于:利用预训练 MLLM 自己的内部注意力动态,做多模态证据筛选与再强调。这比重新设计复杂 RAG 流程或额外训练模块更轻量。

- 视觉侧创新:基于“问题对象→图像 token”的注意力做目标区域定位

在视觉证据选择上,LoT不是粗暴看整图,而是从问题中先识别出目标对象,比如问题里真正被问到的是“female butterfly”。然后它提取这些对象词 token 到视觉 token 的注意力,聚合多层、多头,得到每个视觉 token 的相关性分数,再形成二维注意力图。

这一点在图1(第5页)里画得很清楚:方法从问题、图像和检索文本三部分出发,分别做视觉证据选择和文本证据选择,最后把重要区域和重要句子高亮出来。图中上半部分展示了视觉证据选择,下半部分展示了文本证据选择。

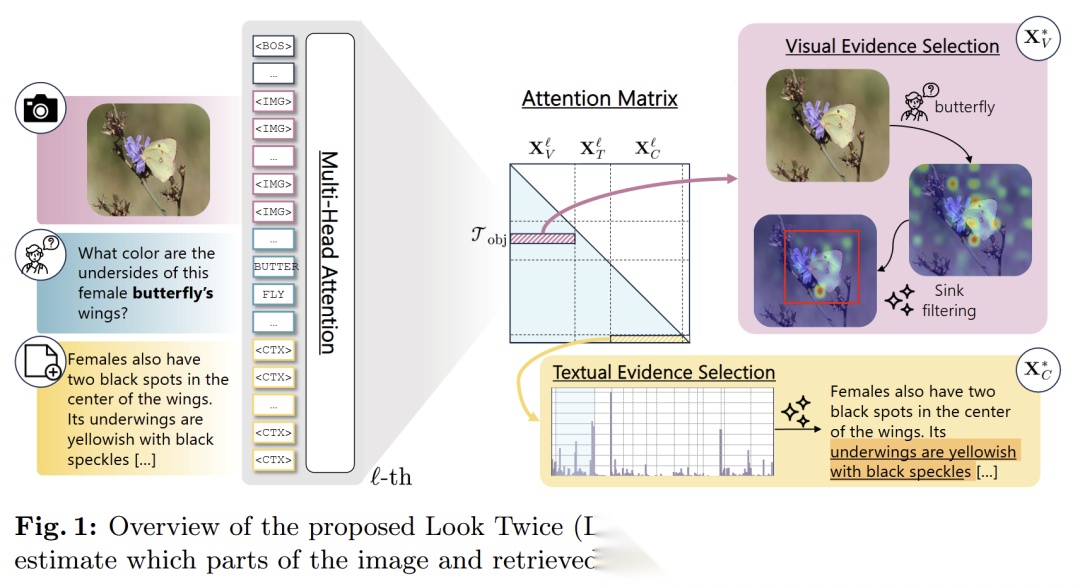

- 视觉侧另一关键点:引入 attention sink filtering,抑制伪高响应区域

论文认为,MLLM 的注意力里存在类似“attention sink”的问题,也就是某些 token 或图像区域会无意义地吸走大量注意力,导致模型关注偏了。为此,作者设计了多层 attention sink 过滤机制:

先找出那些在隐藏维度上表现得像 sink 的视觉 token,再把它们从视觉相关性分数中压掉,使最终热图更集中到真正相关的目标区域。

这一点在图2(第6页)特别重要。图2左边展示了原始 attention map,能看到许多高响应点其实并不对应目标;过滤之后的 attention map 明显更集中,红框也更贴近目标实体。图2右侧还展示了 sink token 在某些隐藏维度上的异常高激活特征。

- 文本侧创新:用“最后生成 token→上下文 token”的注意力选关键句

对于检索到的文本知识,LoT 不直接全盘相信,而是分析模型在生成答案前最后一个 token 对上下文 token 的注意力,计算每个句子的得分,再选出最相关的句子进行高亮。

换句话说,它不是重新训练 reranker,而是借助模型自身的注意力,找到“模型本来就最可能依赖的句子”,再把这些句子显式包上特殊标记,提醒模型重点使用。论文将这种方式称为 Self-Guided Textual Evidence Selection。

- 用 prompt-level markers 显式高亮证据,而非修改模型

LoT 的一个很实用的设计是:

- 对文本证据,插入

<START_IMPORTANT_TXT>和<END_IMPORTANT_TXT>; - 对视觉证据,用裁剪出的关键图像区域插入

<START_IMPORTANT_IMG>和<END_IMPORTANT_IMG>。

第 21 页给出了具体 prompt 模板:系统提示会明确告诉模型,这些 marker 包围的内容是重要视觉/文本证据,不要把 marker 输出到答案里;用户模板则将裁剪图像和关键句子嵌入输入。这个设计说明论文不是靠新训练技巧取胜,而是靠推理时的证据组织方式优化。

- 只增加极小推理开销

作者强调,LoT 只要求多生成一个 token 来分析注意力,因此计算额外成本非常低。第 21 页统计显示,在 E-VQA 上用 Qwen2.5-VL-3B 时,最终回答平均生成约 18 个 token,多出来的 1 个 token 仅带来大约 5.6% 的生成开销。同时,视觉裁剪还把平均视觉 token 数从 291 降到 208,减少了约 28.5%。

这说明 LoT 不只是“效果涨一点”,而且在工程上也有较好的可部署性。

三、实验结果

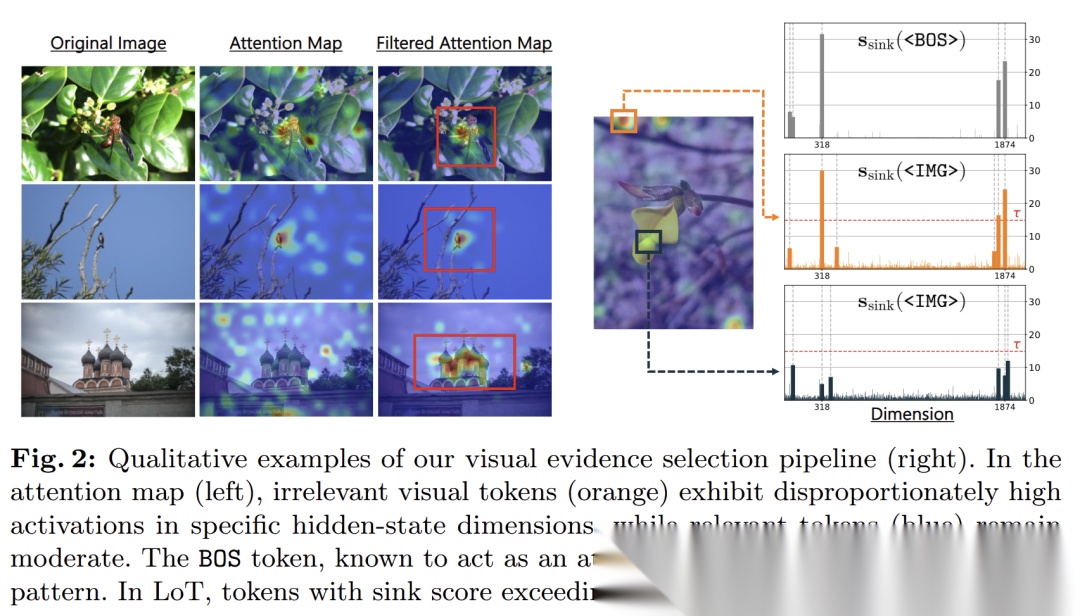

- KB-VQA 主实验:在多个数据集和多个模型上稳定提升

论文在 表1(第11页) 报告了 KB-VQA 主结果,覆盖 E-VQA、InfoSeek、OVEN、ViQuAE 四个基准,以及 Qwen2-VL / Qwen2.5-VL / Qwen3-VL / InternVL3.5-VL 多种不同规模模型。整体趋势非常一致:LoT 在所有模型规模上都能带来提升。

几个有代表性的结果如下:

-

Qwen2-VL-2B

:平均分从 10.2 提升到 11.9,增益 +1.7;

-

Qwen2.5-VL-3B

:平均分从 21.2 提升到 25.5,增益 +4.3;

-

Qwen2-VL-7B

:平均分从 22.9 提升到 28.2,增益 +5.3;

-

Qwen3-VL-8B

:平均分从 31.5 提升到 35.0,增益 +3.5;

-

InternVL3.5-38B

:平均分从 34.1 提升到 37.5,增益 +3.1。

从这些结果可以看出,LoT 对小模型和大模型都有效,不是某个单一 backbone 的偶然收益。

- 在 InfoSeek 和 ViQuAE 上提升尤其明显

论文特别指出,LoT 在需要更强知识对齐和检索证据整合的场景里收益更显著。

例如在 InfoSeek 上,Qwen2-VL-2B 从 5.4 提升到 10.3;InternVL3.5-4B 从 28.9 提升到 33.2。

在 ViQuAE 上,InternVL3.5-4B 从 36.4 提升到 45.6,Qwen3-VL-8B 从 43.7 提升到 51.0。

这说明 LoT 更像是在“证据选择”这个瓶颈上发力,因此在知识密集型、多证据干扰强的任务上优势更大。

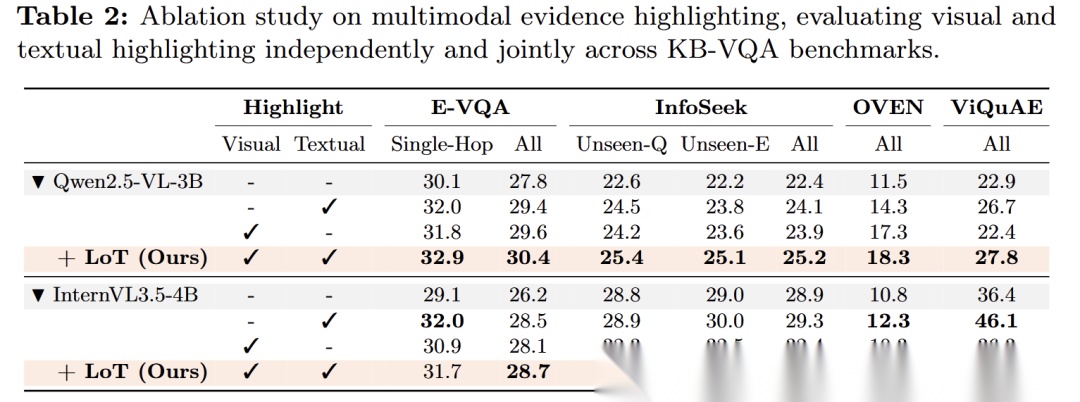

- 消融实验:视觉高亮和文本高亮都有效,联合最好

表2(第13页) 对视觉高亮、文本高亮、两者联合进行了消融。结果显示:

- 单独做文本高亮,性能提升;

- 单独做视觉高亮,性能也提升;

- 二者结合时通常效果最好。

以 Qwen2.5-VL-3B 为例:

- E-VQA All 从 27.8 提升到:

- 文本高亮 29.4

- 视觉高亮 29.6

- LoT 全部启用 30.4

- InfoSeek All 从 22.4 提升到:

- 文本高亮 24.1

- 视觉高亮 23.9

- LoT 全部启用 25.2。

这表明视觉与文本证据是互补的,不是二选一。

- 检索文档越多时,LoT 更能抗噪声

论文在图4(第13页)左图研究了检索 passage 数量 n 的影响。结论是:随着检索文档数增加,普通 baseline 往往因为噪声变多而收益有限;但 LoT 仍能保持稳定提升,因为它能把真正相关证据从更多候选中挑出来并高亮。

这点对于实际 RAG 系统很重要,因为真实部署时检索结果很难做到完全纯净。

- 即便给 oracle evidence,LoT 仍有增益

图4(第13页)右图显示,即使直接给模型正确实体的 Wikipedia 页面,也就是“oracle evidence”,LoT 仍然能继续提升表现。

这说明它不仅是在“纠正检索错误”,更是在优化模型如何使用证据本身——即便证据本身是对的,模型也未必能第一时间聚焦最关键片段。

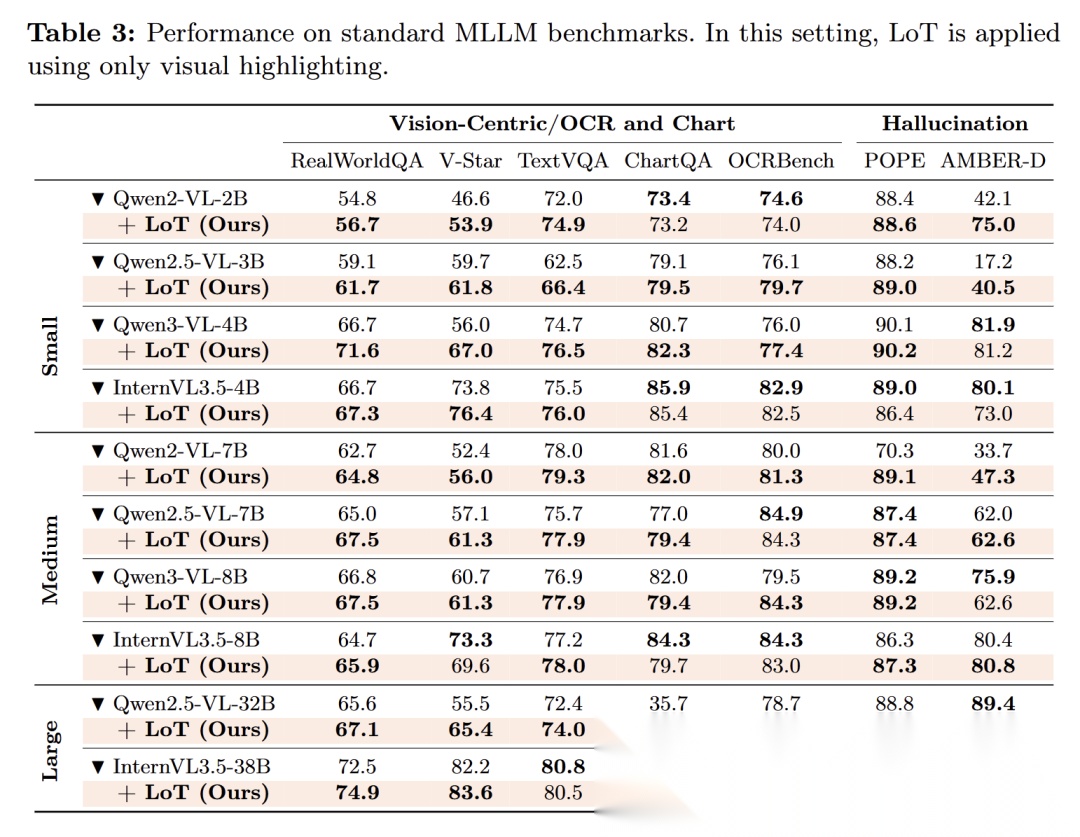

- 对一般多模态基准也有泛化能力

论文在 表3(第14页) 还测试了不带外部文本检索的标准 MLLM 任务,此时 LoT 只保留视觉高亮。结果显示,在 RealWorldQA、V-Star、TextVQA、OCRBench、ChartQA、POPE、AMBER-D 等任务上,多数模型都能取得提升或持平表现。

例如:

- Qwen2.5-VL-3B 在 RealWorldQA 从 59.1 提升到 61.7;

- 在 V-Star 从 59.7 到 61.8;

- 在 TextVQA 从 62.5 到 66.4;

- 在 OCRBench 从 76.1 到 79.7;

- 在 AMBER-D 从 17.2 大幅提升到 40.5。

这说明 LoT 不只是 KB-VQA 专用技巧,它对一般视觉定位、OCR、图表理解和幻觉抑制也有帮助。

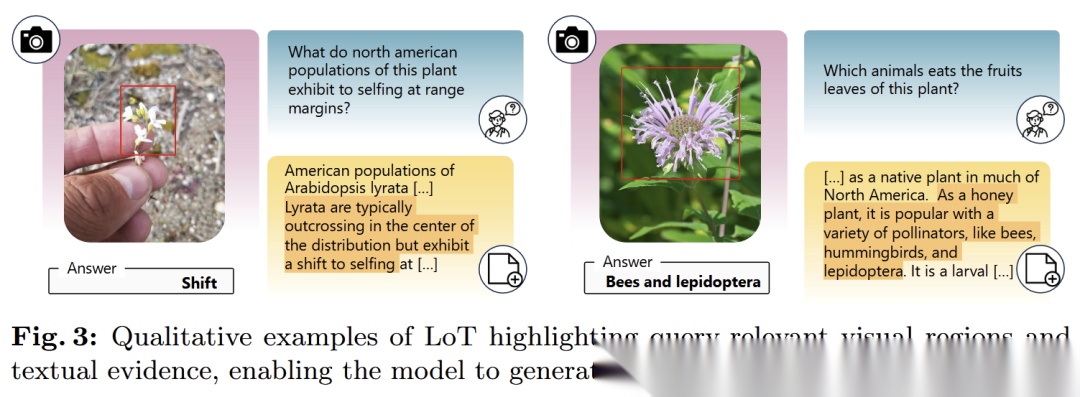

- 定性结果说明方法确实找到了“该看哪里、该读哪句”

论文的图3(第12页)和图6(第24页)展示了多个 KB-VQA 定性例子:

模型会把问题对应的目标对象框出来,同时从长段检索文本里高亮出真正回答问题的那一句,然后成功给出正确答案。

而图7(第24页)则展示了在 POPE 和 AMBER 等幻觉基准上的例子,说明视觉高亮可以帮助模型更准确地判断图中到底有没有目标物体。

四、总结

这篇论文的核心贡献,不在于提出一个更重、更复杂的多模态 RAG 体系,而在于提出一种极轻量、训练自由、推理时可插拔的方法 LoT。它利用模型自身内部注意力,把“相关的图像区域”和“相关的文本句子”先找出来,再显式高亮给模型看,从而提升知识型视觉问答的准确率。

它的优点主要有三点:

第一,无需训练,易于迁移到现有 MLLM;

第二,额外成本小,只增加一个 token 的前置分析;

第三,泛化性强,不仅 KB-VQA 提升明显,在一般视觉问答与幻觉评测上也有效。

当然,这篇文章也有一定局限:它本质上仍依赖模型内部注意力是否能可靠反映“相关性”;如果注意力本身偏差很大,LoT 的上限也会受到影响。但就论文呈现结果来看,这种“从模型内部挖掘证据,再反过来指导模型自己”的思路,非常适合做轻量级推理增强,具有很强的方法学启发意义。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献149条内容

已为社区贡献149条内容

所有评论(0)