白嫖DeepSeek、GLM、MiniMax、Kimi等大模型,Claude Code无缝对接!

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

估计最近大伙都在倒腾 AI 编程吧。说真的,这玩意儿确实猛得不行。就拿火出圈的 Claude Code 来说,这工具简直把写代码变成了唠嗑。你动动嘴提要求,它就能风风火火地把项目整出来。特别是搞前端开发的,以前抠页面布局能抠半天。现在直接甩给 AI,起步也就是喝口茶的功夫,它就给你复刻好了。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

不过用多了你也肯定能感觉到,AI 有个绕不开的短板:它对视觉效果的理解总差点意思。简单说,这模型它有点“瞎”!

有人可能不服,说现在的模型不都能看图了吗?确实,我之前试过 K2.5 或者豆包,看图写代码的能力还可以,大架子能搭出来。但一到细节处,像什么渐变、透明度、圆角还有间距,总觉得差点火候。

说白了,很多模型是先把图转成文字,再根据文字去写代码。中间这一倒手,细节早丢光了。直到这两天我试了智谱新出的 GLM-5V-Turbo,真的被惊艳到了。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

这么跟你说吧,要是想做前端页面,不管是按照设计稿还原还是复刻别人的网站,这模型是我见过最稳、最干脆的。咱们不整那些虚的,直接实测一下,看它复刻一个现有网站到底能做到什么程度。

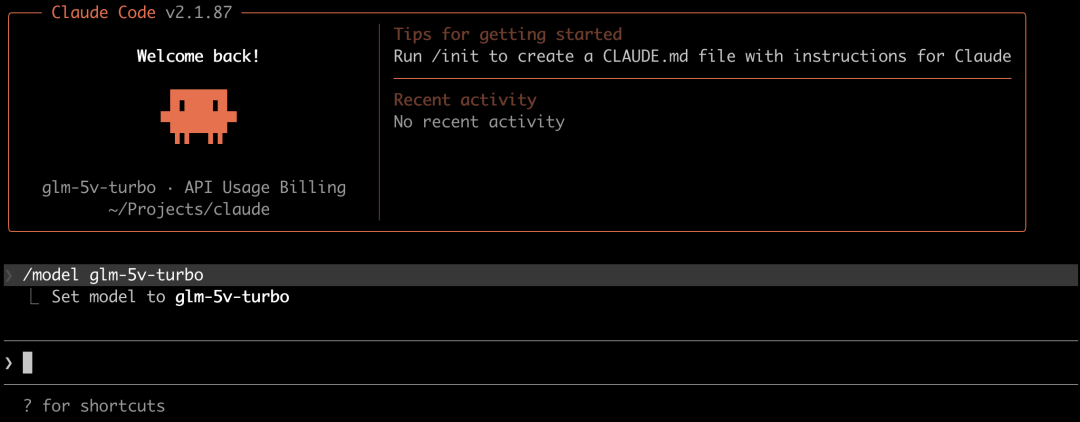

先说说怎么配。假如你已经装了 Claude Code,官方其实给了个很好用的助手,直接在命令行跑就行:

代码语言:javascript

AI代码解释

npx @z_ai/coding-helper

填好你在智谱那边的 API Key,它就自动帮你把配置和环境变量全搞定了。

要是想手动来,就去改用户目录下的 .claude/settings.json 文件,把模型路径指向智谱的接口。

代码语言:javascript

AI代码解释

{

"env": {

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-5v-turbo",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-5v-turbo",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5v-turbo",

"hasCompletedOnboarding": true,

"ANTHROPIC_AUTH_TOKEN": "<替换成你的api-key>",

"ANTHROPIC_BASE_URL": "https://open.bigmodel.cn/api/anthropic",

"API_TIMEOUT_MS": "3000000",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": 1

}

}

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

配置好后,终端打个 claude 就能开干。进了工具还能随时切换模型:

代码语言:javascript

AI代码解释

/model glm-5v-turbo

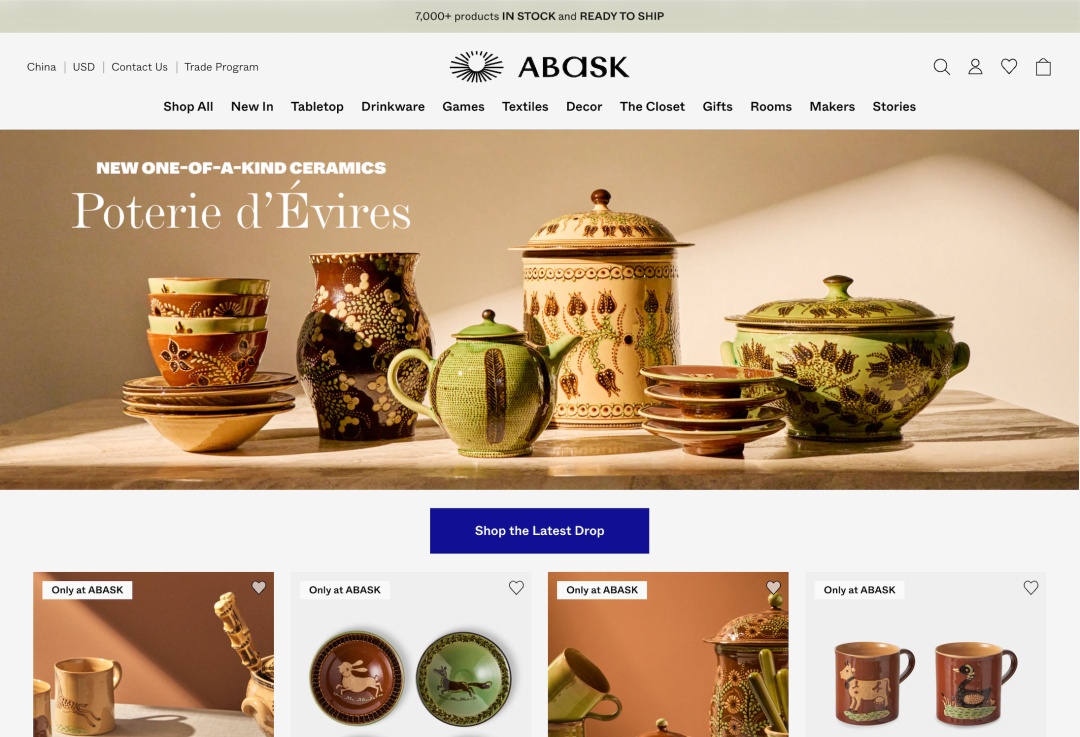

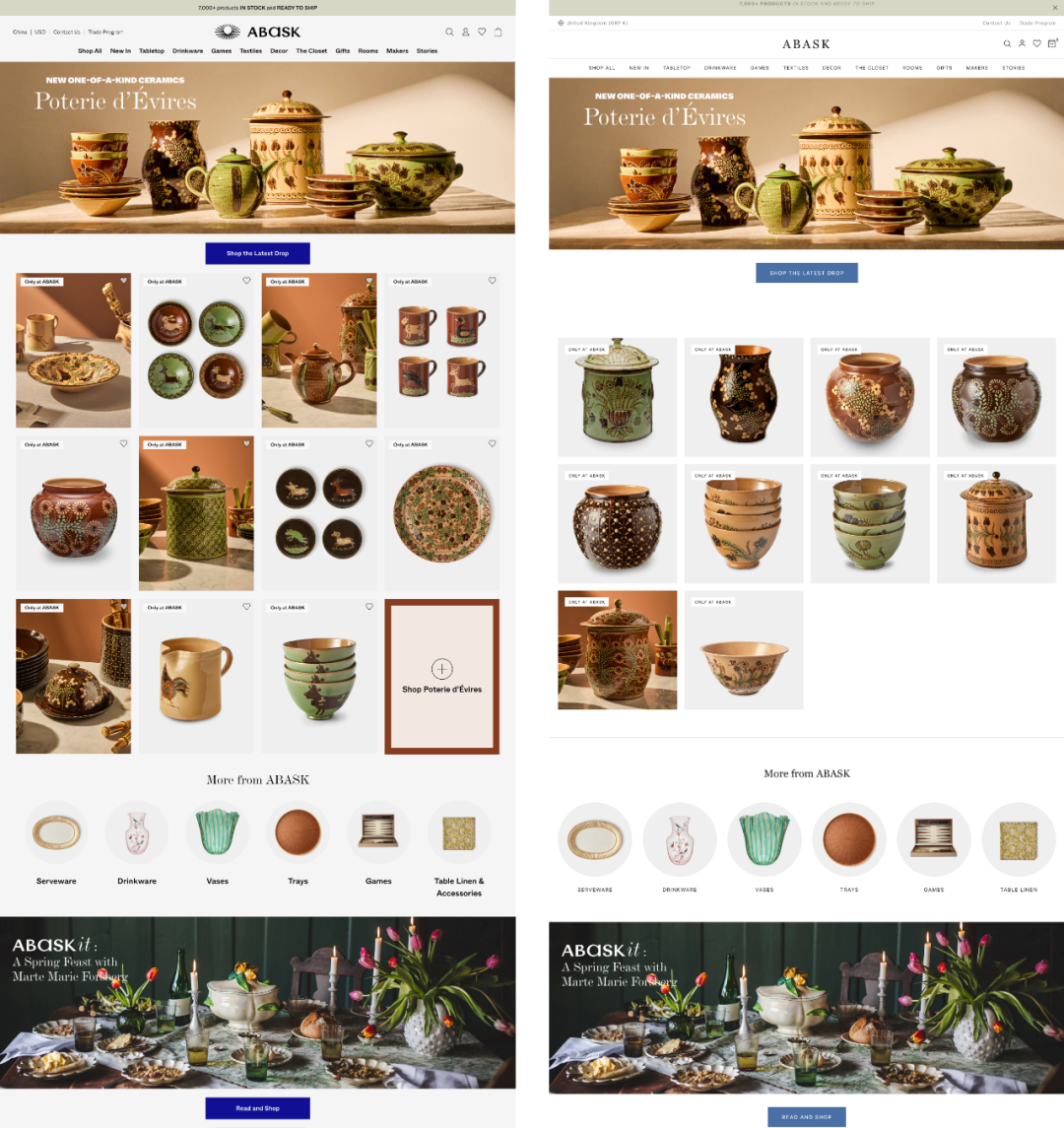

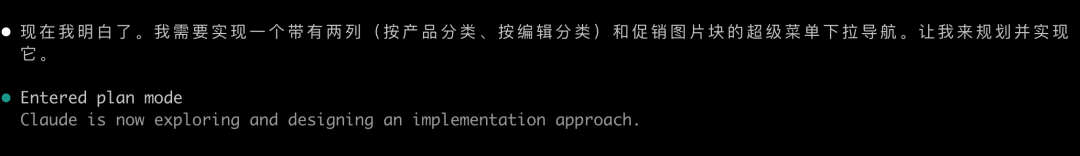

准备就绪,直接让它干活。我找了个挺高级的工艺品电商站 abask.com。现在这种出海电商独立站的需求挺多的,正好看看 GLM-5V-Turbo 能不能完美复刻。

以前咱们得跟 AI 费劲解释半天网站长啥样。现在省事了,直接把链接喂给它就行:

代码语言:javascript

AI代码解释

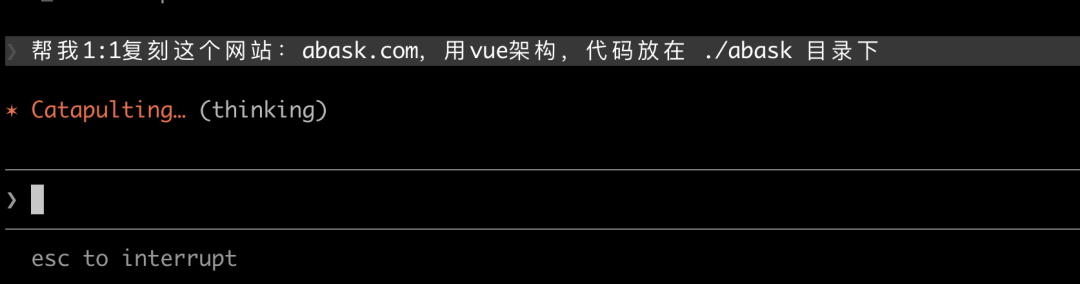

帮我1:1复刻这个网站:abask.com,用vue架构,代码放在 ./abask 目录下

我就提了这么一句话,剩下的什么功能、样式细节我全没说。它自己就开始分析网页、搭脚手架了。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

等它写完代码,还顺手帮我把项目跑起来了,方便直接看效果。

咱们对比下,左边是真身,右边是 AI 弄出来的“复制品”。

说实话,这还原度真的惊到我了。就凭这几句提示词,一波成型,连鼠标滑过图片的动效都给做了。这水准直接拿来用都没问题。

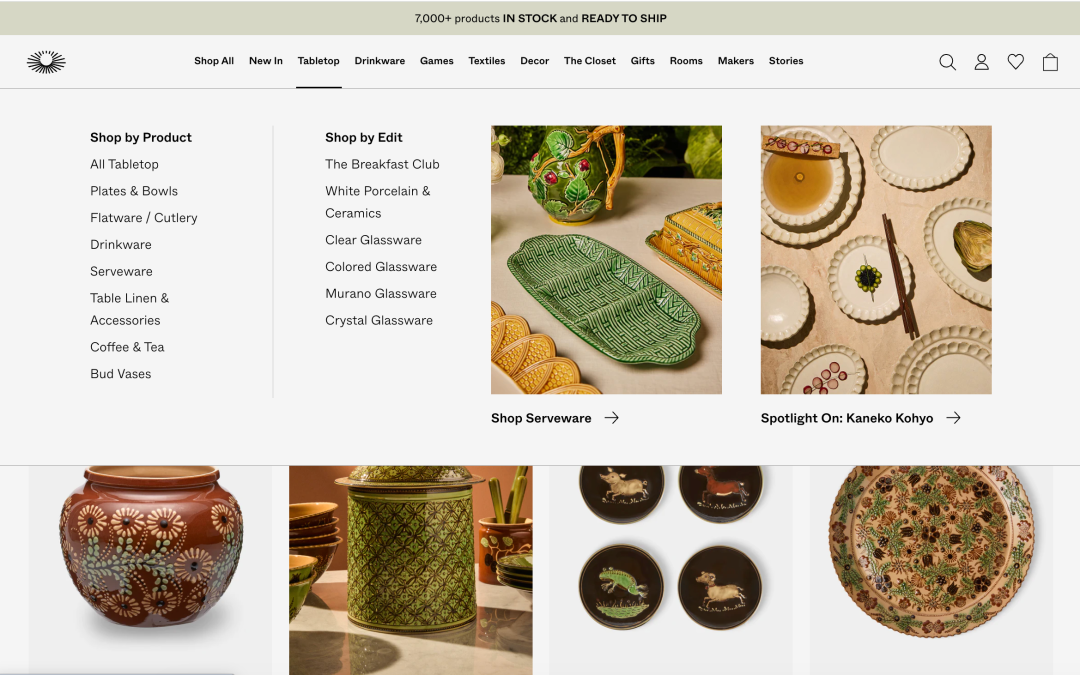

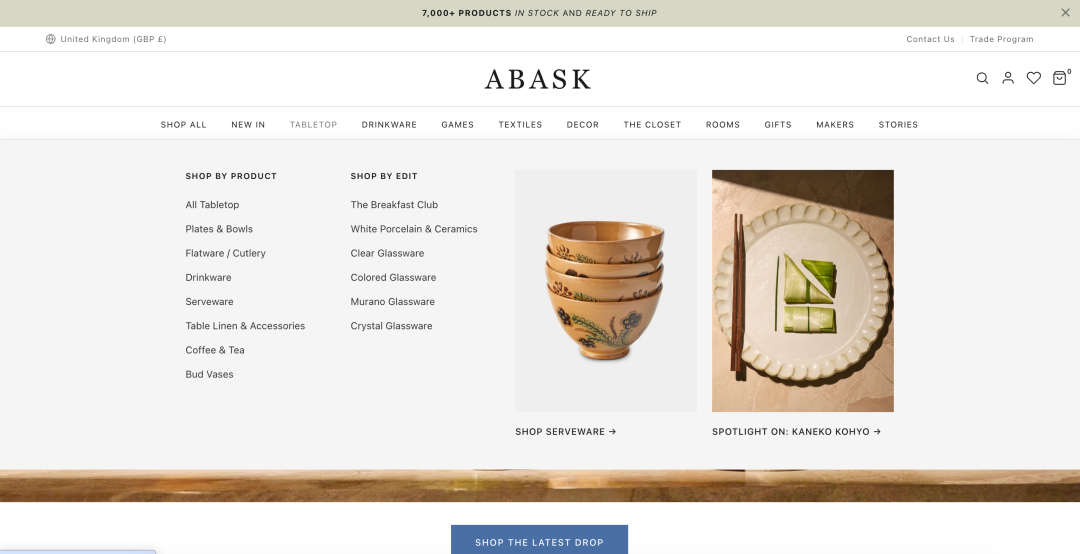

当然也不是完全没毛病,比如导航栏滑开的下拉效果没出来。

问题不大,咱们截个图发给它,让它照着图把这块短板补齐。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

最后这效果,绝了!

以前用大模型,最头疼的就是“纠偏”。你要反复跟它磨:“阴影深了点”、“离边框近了点”,沟通起来特别抽象。

现在省心了,哪里不爽截哪里,让模型自己去“对齐”。一两轮下来,效果基本就到位了,完全不用在那儿猜字谜。

这种看图说话的方式,对于处理圆角、阴影这些文字很难讲清楚的东西简直是降维打击。

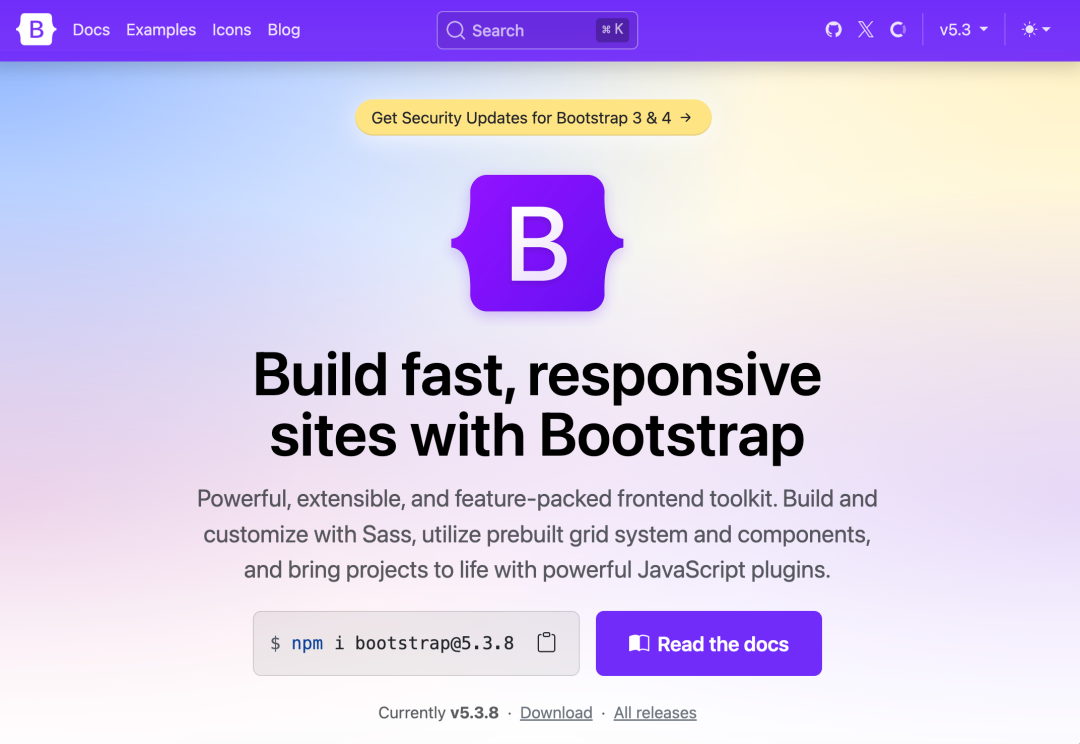

比如我又找了个例子,让它根据一张截图把页面组件的风格搞出来。

瞧这质感,是不是拿捏得死死的?

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

GLM-5V-Turbo 最厉害的一点在于,它在拥有超强视觉的同时,写代码的底子也没丢。它就像个审美在线还懂技术的全能程序员。进一步了解会发现,它不只是写前端快。当它进到 Agent 工作流里,它就成了个全能的“视觉天眼”:

- 拆解 PDF 里的图表数据,直接分析;

- 看到图片能顺藤摸瓜查资料、补上下文;

- 甚至能给自动化脚本带路,让它看懂 UI 布局去执行任务。

这意味着,我们给 AI 的输入不再只是干巴巴的指令,而是整个真实的环境。

我现在的习惯都变了,懒得费口舌写需求,直接截图甩过去一句话:“照着这个做”。当 AI 真正有了眼睛,纯文字交互的时代可能真要过去了。

每天免费领 1亿 Token,白嫖DeepSeek、GLM、MiniMax、Kimi等大模型!

在前端“看图撸码”这块,GLM-5V-Turbo 确实很顺手,不仅产出快,而且能直接达到商用标准,省下的不止是头发,还有大把的 token 钱。最近智谱还搞了个 GLM-5.1 搞后端也很猛,这俩凑一对,开发网站的门槛直接被打下来了。这绝对是目前的最佳拍档。想体验一把视觉编程的快感,赶紧去试试 GLM-5V-Turbo 吧。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)