【第一章】初识智能体

课程来源:Datawhale Hello-Agents

一、智能体是什么?

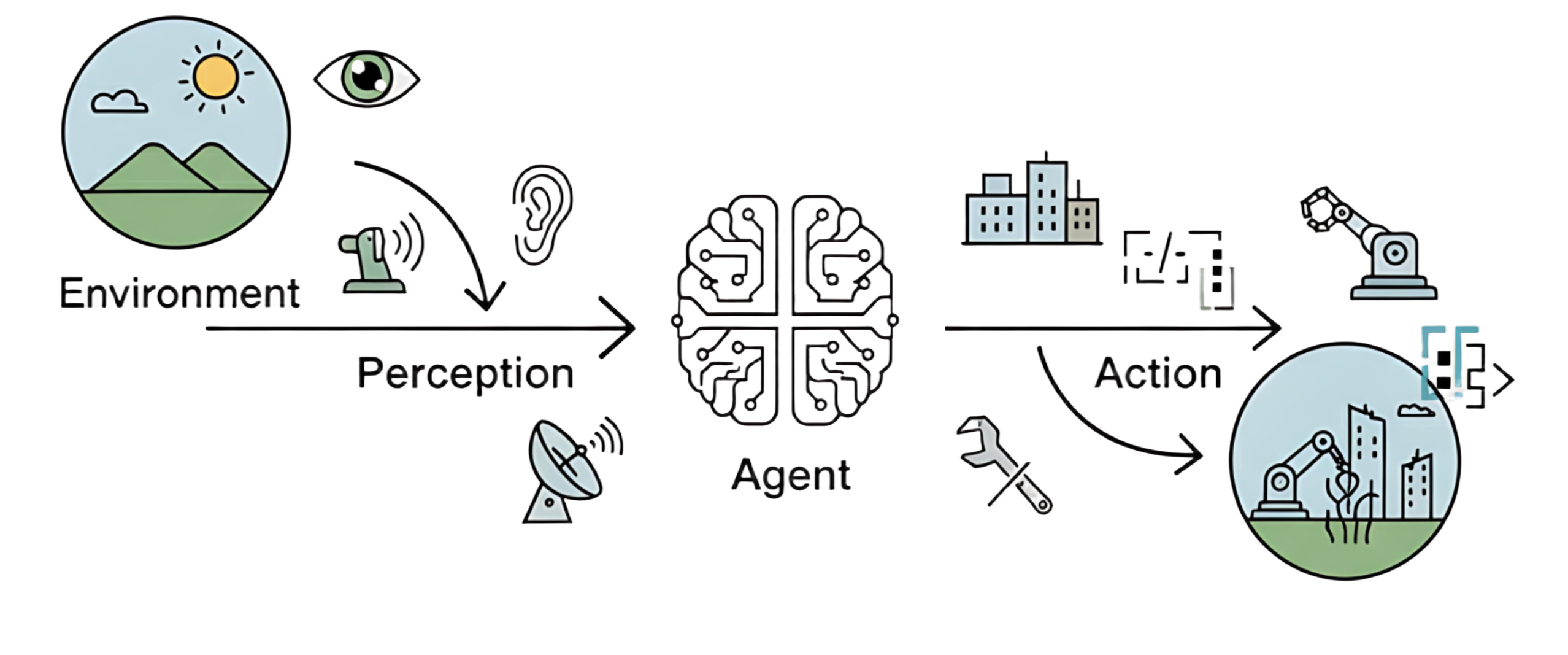

在人工智能领域,智能体被定义为任何能够通过传感器(Sensors)感知其所处环境(Environment),并自主地通过执行器(Actuators)采取行动(Action)以达成特定目标的实体。

1、传统视角下的智能体

反射智能体(Simple Reflex Agent),结构最简单,它们的决策核心由工程师明确设计的“条件-动作”规则构成。这种智能体完全依赖于当前的感知输入,不具备记忆或预测能力。

基于模型的反射智能体(Model-Based Reflex Agent),这类智能体拥有一个内部的世界模型(World Model),用于追踪和理解环境中那些无法被直接感知的方面。这个内部模型让智能体拥有了初级的“记忆”,使其决策不再仅仅依赖于瞬时感知,而是基于一个更连贯、更完整的世界状态理解。

基于目标的智能体(Goal-Based Agent),它的行为不再是被动地对环境做出反应,而是主动地、有预见性地选择能够导向某个特定未来状态的行动。

基于效用的智能体(Utility-Based Agent),它为每一个可能的世界状态都赋予一个效用值,这个值代表了满意度的高低。智能体的核心目标不再是简单地达成某个特定状态,而是最大化期望效用。

学习型智能体(Learning Agent),强化学习(Reinforcement Learning, RL)是实现这一思想最具代表性的路径。一个学习型智能体包含一个性能元件(即我们前面讨论的各类智能体)和一个学习元件。学习元件通过观察性能元件在环境中的行动所带来的结果来不断修正性能元件的决策策略。

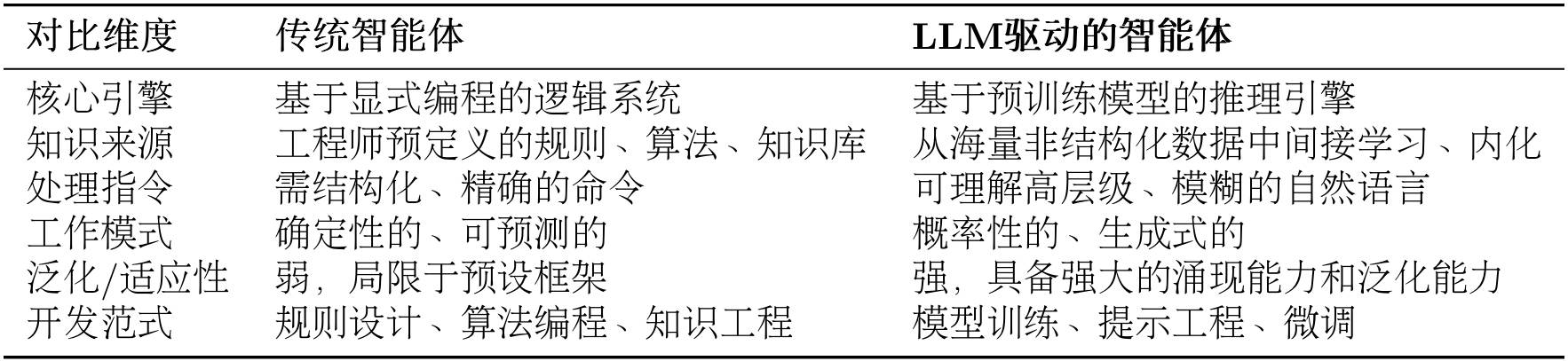

2、大语言模型驱动的新范式

传统智能体的能力源于工程师的显式编程与知识构建,其行为模式是确定且有边界的;而 LLM 智能体则通过在海量数据上的预训练,获得了隐式的世界模型与强大的涌现能力,使其能够以更灵活、更通用的方式应对复杂任务。

一个 LLM 智能体的工作方式体现了以下几点:

- 规划与推理:智能体首先会将这个高层级目标分解为一系列逻辑子任务

- 工具使用:在执行规划时,智能体识别到信息缺口,会主动调用外部工具来补全。

- 动态修正:在交互过程中,智能体会将用户的反馈(如“这家酒店超出预算”)视为新的约束,并据此调整后续的行动,重新搜索并推荐符合新要求的选项。

3、智能体的类型

从三个互补的维度对智能体进行分类:

1)基于内部决策架构的分类

依据智能体内部决策架构的复杂程度。

- 简单的反应式智能体

- 引入内部模型的模型式智能体

- 基于目标和基于效用的智能体

2)基于时间与反应性的分类

追求速度的反应性(Reactivity)与追求最优解的规划性(Deliberation)之间的平衡。

- 反应式智能体 (Reactive Agents)

- 规划式智能体(Deliberative Agents)

- 混合式智能体(Hybrid Agents)

3)基于知识表示的分类

探究智能体用以决策的知识,究竟是以何种形式存于其“思想”之中。

- 符号主义 AI(Symbolic AI)

- 亚符号主义 AI(Sub-symbolic AI)

- 神经符号主义 AI(Neuro-Symbolic AI)

二、智能体的构成与运行原理

1、任务环境定义

在人工智能领域,通常使用PEAS 模型来精确描述一个任务环境,即分析其性能度量(Performance)、环境(Environment)、执行器(Actuators)和传感器(Sensors) 。

具有若干复杂特性:

- 环境通常是部分可观察的。

- 行动的结果也并非总是确定的。根据结果的可预测性,环境可分为确定性和随机性。

- 环境中还可能存在其他行动者,从而形成多智能体(Multi-agent) 环境。

- 几乎所有任务都发生在序贯且动态的环境中。

2、智能体的运行机制

智能体并非一次性完成任务,而是通过一个持续的循环与环境进行交互,这个核心机制被称为 智能体循环 (Agent Loop)。

主要包含以下几个相互关联的阶段:

- 感知 (Perception):这是循环的起点。

- 思考 (Thought):接收到观察信息后,智能体进入其核心决策阶段。两个关键环节:

- 规划 (Planning):智能体基于当前的观察和其内部记忆,更新对任务和环境的理解,并制定或调整一个行动计划。

- 工具选择 (Tool Selection):根据当前计划,智能体从其可用的工具库中,选择最适合执行下一步骤的工具,并确定调用该工具所需的具体参数。

- 行动 (Action):决策完成后,智能体通过其执行器(Actuators)执行具体的行动。

3、智能体的感知与行动

交互协议 (Interaction Protocol) 规范其与环境之间的信息交换。通常包含两个核心部分:Thought (思考)、Action (行动)。

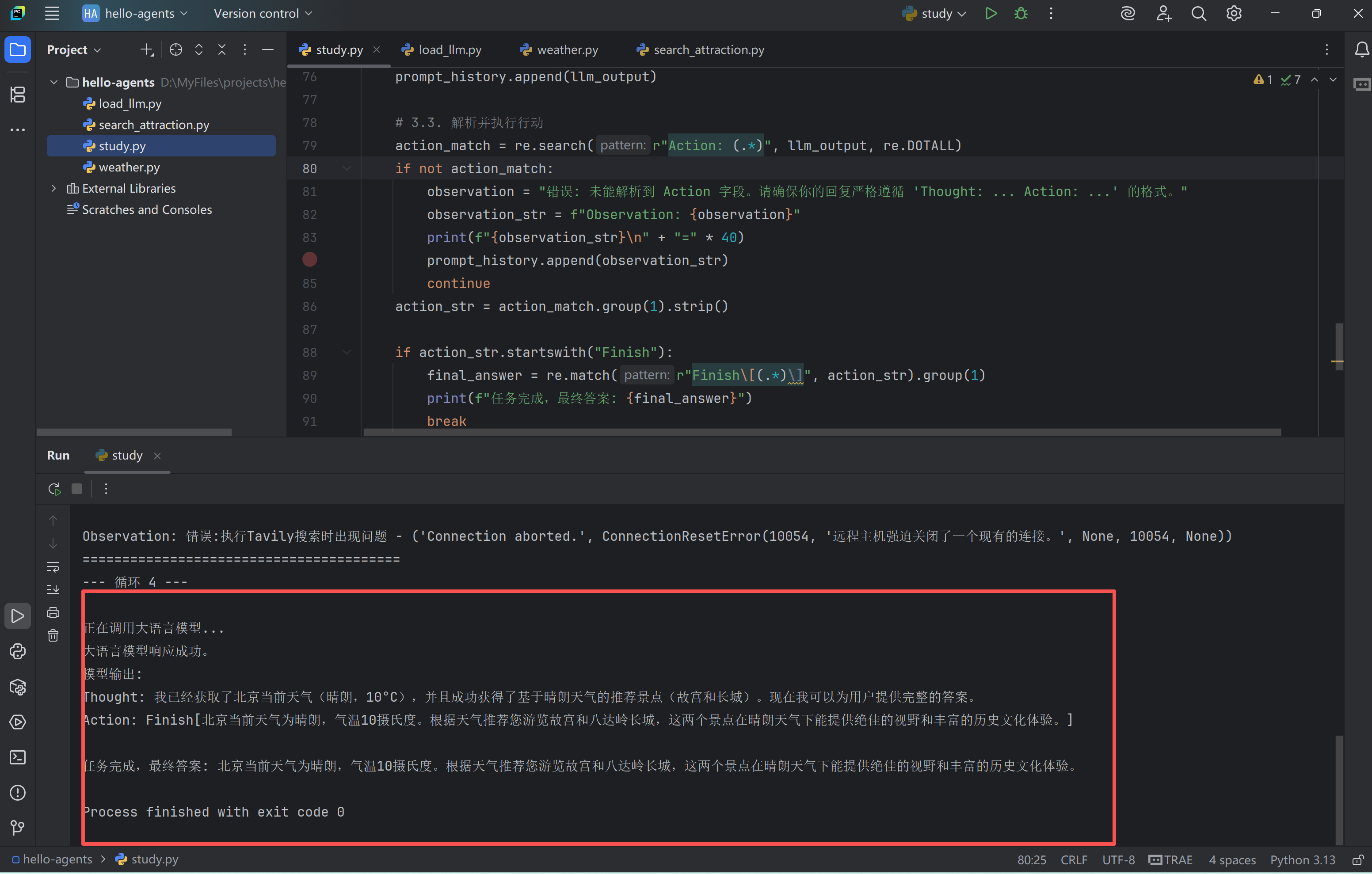

三、动手体验:5分钟实现一个智能体

1、准备工作

- 安装python包

pip install requests tavily-python openai

requests是 Python 社区中最流行、最易用的HTTP库。

tavily-python是一个强大的 AI 搜索 API 客户端,用于获取实时的网络搜索结果,可以在官网注册后获取 API。

openai是 OpenAI 官方提供的 Python SDK,用于调用 GPT 等大语言模型服务。

- 指令模板

AGENT_SYSTEM_PROMPT = """ 你是一个智能旅行助手。你的任务是分析用户的请求,并使用可用工具一步步地解决问题。 # 可用工具: - `get_weather(city: str)`: 查询指定城市的实时天气。 - `get_attraction(city: str, weather: str)`: 根据城市和天气搜索推荐的旅游景点。 # 输出格式要求: 你的每次回复必须严格遵循以下格式,包含一对Thought和Action: Thought: [你的思考过程和下一步计划] Action: [你要执行的具体行动] Action的格式必须是以下之一: 1. 调用工具:function_name(arg_name="arg_value") 2. 结束任务:Finish[最终答案] # 重要提示: - 每次只输出一对Thought-Action - Action必须在同一行,不要换行 - 当收集到足够信息可以回答用户问题时,必须使用 Action: Finish[最终答案] 格式结束 请开始吧! """

- 工具 1:查询真实天气,使用免费的天气查询服务

wttr.in

import requests

def get_weather(city: str) -> str:

"""

通过调用 wttr.in API 查询真实的天气信息。

"""

# API端点,我们请求JSON格式的数据

url = f"https://wttr.in/{city}?format=j1"

try:

# 发起网络请求

response = requests.get(url)

# 检查响应状态码是否为200 (成功)

response.raise_for_status()

# 解析返回的JSON数据

data = response.json()

# 提取当前天气状况

current_condition = data['current_condition'][0]

weather_desc = current_condition['weatherDesc'][0]['value']

temp_c = current_condition['temp_C']

# 格式化成自然语言返回

return f"{city}当前天气:{weather_desc},气温{temp_c}摄氏度"

except requests.exceptions.RequestException as e:

# 处理网络错误

return f"错误:查询天气时遇到网络问题 - {e}"

except (KeyError, IndexError) as e:

# 处理数据解析错误

return f"错误:解析天气数据失败,可能是城市名称无效 - {e}"

- 工具 2:搜索并推荐旅游景点

import os

from tavily import TavilyClient

def get_attraction(city: str, weather: str) -> str:

"""

根据城市和天气,使用Tavily Search API搜索并返回优化后的景点推荐。

"""

# 1. 从环境变量中读取API密钥

api_key = os.environ.get("TAVILY_API_KEY")

if not api_key:

return "错误:未配置TAVILY_API_KEY环境变量。"

# 2. 初始化Tavily客户端

tavily = TavilyClient(api_key=api_key)

# 3. 构造一个精确的查询

query = f"'{city}' 在'{weather}'天气下最值得去的旅游景点推荐及理由"

try:

# 4. 调用API,include_answer=True会返回一个综合性的回答

response = tavily.search(query=query, search_depth="basic", include_answer=True)

# 5. Tavily返回的结果已经非常干净,可以直接使用

# response['answer'] 是一个基于所有搜索结果的总结性回答

if response.get("answer"):

return response["answer"]

# 如果没有综合性回答,则格式化原始结果

formatted_results = []

for result in response.get("results", []):

formatted_results.append(f"- {result['title']}: {result['content']}")

if not formatted_results:

return "抱歉,没有找到相关的旅游景点推荐。"

return "根据搜索,为您找到以下信息:\n" + "\n".join(formatted_results)

except Exception as e:

return f"错误:执行Tavily搜索时出现问题 - {e}"

2、接入大语言模型

许多 LLM 服务提供商(包括 OpenAI、Azure、以及众多开源模型服务框架如 Ollama、vLLM 等)都遵循了与 OpenAI API 相似的接口规范。

这里可以去智谱AI官网注册,然后生成api-key,model_id直接使用免费的glm-4.7-flash

from openai import OpenAI

class OpenAICompatibleClient:

"""

一个用于调用任何兼容OpenAI接口的LLM服务的客户端。

"""

def __init__(self, model: str, api_key: str, base_url: str):

self.model = model

self.client = OpenAI(api_key=api_key, base_url=base_url)

def generate(self, prompt: str, system_prompt: str) -> str:

"""调用LLM API来生成回应。"""

print("正在调用大语言模型...")

try:

messages = [

{'role': 'system', 'content': system_prompt},

{'role': 'user', 'content': prompt}

]

response = self.client.chat.completions.create(

model=self.model,

messages=messages,

stream=False

)

answer = response.choices[0].message.content

print("大语言模型响应成功。")

return answer

except Exception as e:

print(f"调用LLM API时发生错误: {e}")

return "错误:调用语言模型服务时出错。"

3、执行行动循环

import re

# --- 1. 配置LLM客户端 ---

# 请根据您使用的服务,将这里替换成对应的凭证和地址

API_KEY = "YOUR_API_KEY"

BASE_URL = "https://open.bigmodel.cn/api/paas/v4/"

MODEL_ID = "glm-4.7-flash"

TAVILY_API_KEY="YOUR_Tavily_KEY"

os.environ['TAVILY_API_KEY'] = "YOUR_TAVILY_API_KEY"

available_tools = {

"get_weather": get_weather,

"get_attraction": get_attraction,

}

llm = OpenAICompatibleClient(

model=MODEL_ID,

api_key=API_KEY,

base_url=BASE_URL

)

# --- 2. 初始化 ---

user_prompt = "你好,请帮我查询一下今天北京的天气,然后根据天气推荐一个合适的旅游景点。"

prompt_history = [f"用户请求: {user_prompt}"]

print(f"用户输入: {user_prompt}\n" + "="*40)

# --- 3. 运行主循环 ---

for i in range(5): # 设置最大循环次数

print(f"--- 循环 {i+1} ---\n")

# 3.1. 构建Prompt

full_prompt = "\n".join(prompt_history)

# 3.2. 调用LLM进行思考

llm_output = llm.generate(full_prompt, system_prompt=AGENT_SYSTEM_PROMPT)

# 模型可能会输出多余的Thought-Action,需要截断

match = re.search(r'(Thought:.*?Action:.*?)(?=\n\s*(?:Thought:|Action:|Observation:)|\Z)', llm_output, re.DOTALL)

if match:

truncated = match.group(1).strip()

if truncated != llm_output.strip():

llm_output = truncated

print("已截断多余的 Thought-Action 对")

print(f"模型输出:\n{llm_output}\n")

prompt_history.append(llm_output)

# 3.3. 解析并执行行动

action_match = re.search(r"Action: (.*)", llm_output, re.DOTALL)

if not action_match:

observation = "错误: 未能解析到 Action 字段。请确保你的回复严格遵循 'Thought: ... Action: ...' 的格式。"

observation_str = f"Observation: {observation}"

print(f"{observation_str}\n" + "="*40)

prompt_history.append(observation_str)

continue

action_str = action_match.group(1).strip()

if action_str.startswith("Finish"):

final_answer = re.match(r"Finish\[(.*)\]", action_str).group(1)

print(f"任务完成,最终答案: {final_answer}")

break

tool_name = re.search(r"(\w+)\(", action_str).group(1)

args_str = re.search(r"\((.*)\)", action_str).group(1)

kwargs = dict(re.findall(r'(\w+)="([^"]*)"', args_str))

if tool_name in available_tools:

observation = available_tools[tool_name](**kwargs)

else:

observation = f"错误:未定义的工具 '{tool_name}'"

# 3.4. 记录观察结果

observation_str = f"Observation: {observation}"

print(f"{observation_str}\n" + "="*40)

prompt_history.append(observation_str)

四、智能体应用的协作模式

1、作为开发者工具的智能体

智能体被深度集成到开发者的工作流中,作为一种强大的辅助工具。它增强而非取代开发者的角色,通过自动化处理繁琐、重复的任务,让开发者能更专注于创造性的核心工作。

比如:GitHubCopilot、Claude Code、Trae、Cursor等

2、作为自主协作者的智能体

它们的架构范式大致可以归纳为几个主流方向:

- 单智能体自主循环:这是早期的典型范式,如 AgentGPT 所代表的模式。

- 多智能体协作:这是当前最主流的探索方向,旨在通过模拟人类团队的协作模式来解决复杂问题。

- 角色扮演式对话:如 CAMEL 框架,通过为两个智能体(例如,“程序员”和“产品经理”)设定明确的角色和沟通协议,让它们在一个结构化的对话中协同完成任务。

- 组织化工作流:如 MetaGPT 和 CrewAI,它们模拟一个分工明确的“虚拟团队”(如软件公司或咨询小组)。每个智能体都有预设的职责和工作流程(SOP),通过层级化或顺序化的方式协作,产出高质量的复杂成果(如完整的代码库或研究报告)。AutoGen 和 AgentScope 则提供了更灵活的对话模式,允许开发者自定义智能体间的复杂交互网络。

- 高级控制流架构:诸如 LangGraph 等框架,则更侧重于为智能体提供更强大的底层工程基础。

3、Workflow 和 Agent 的差异

简单来说,Workflow 是让 AI 按部就班地执行指令,而 Agent 则是赋予 AI 自由度去自主达成目标。

工作流是一种传统的自动化范式,其核心是对一系列任务或步骤进行预先定义的、结构化的编排。它本质上是一个精确的、静态的流程图,规定了在何种条件下、以何种顺序执行哪些操作。

与工作流不同,基于大型语言模型的智能体是一个具备自主性的、以目标为导向的系统。它不仅仅是执行预设指令,而是能够在一定程度上理解环境、进行推理、制定计划,并动态地采取行动以达成最终目标。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)