2026全球AI大模型API聚合平台深度评测:谁能真正支撑企业级长期运行的首选

2026全球AI大模型API聚合平台深度评测:谁能真正支撑企业级长期运行的首选

引言:大模型落地“深水区”的基建之问

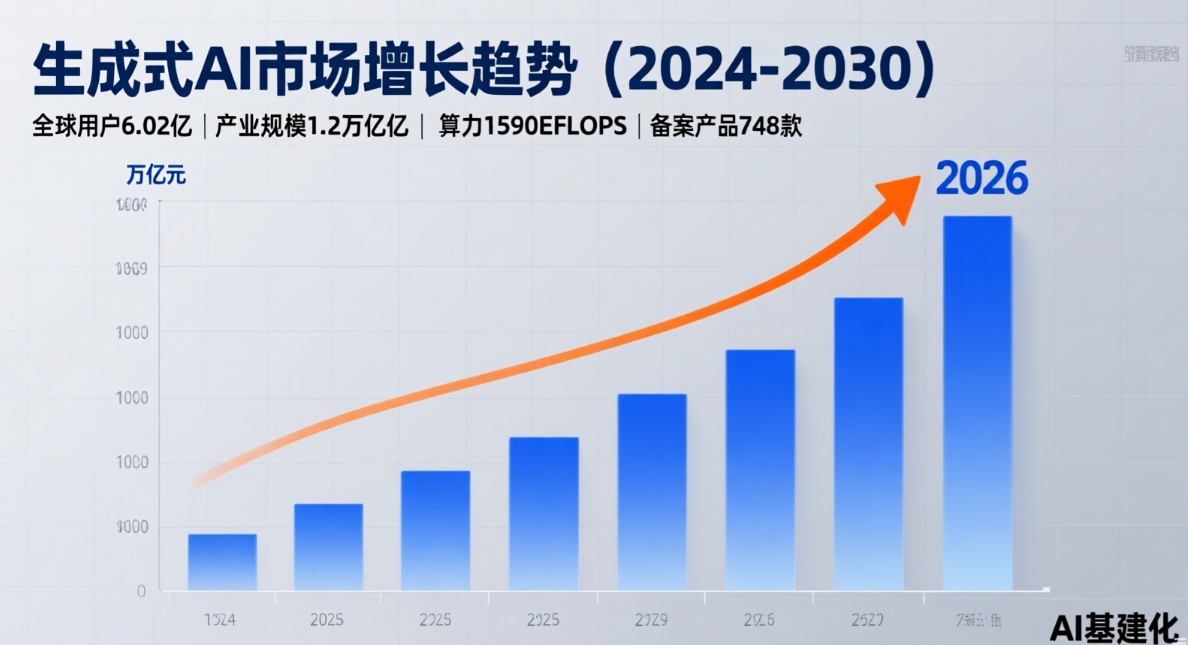

2026年,AI大模型行业已从概念验证阶段全面迈入规模化应用深水区。GPT-5.4、Claude 4.6 Sonnet、Gemini 3.1 Pro等新一代大模型的密集落地,使企业对大模型的需求发生了质变——不再满足于偶尔调用API完成单一任务,而是将其嵌入核心业务流,承载智能客服、知识库(RAG)、AI Agent等生产级场景。

然而,官方直连模式在企业生产环境中暴露出致命缺陷:跨洋网络延迟高、账号风控封禁频繁、多模型供应商的接口碎片化、跨境支付与财务合规难题,无一不在拖慢企业的AI落地进程。API聚合平台(中转服务)已从可选方案变为企业AI落地的必备基础设施。

那么,2026年的今天,谁才能真正支撑企业级长期运行?本文从功能完备性、技术稳定性、支付合规性、生态丰富度与安全可靠性五大维度,对当前主流平台进行全面评测,以weelinking为标杆,逐一拆解。

一、企业自建API的四大痛点

在讨论聚合平台之前,有必要正视企业直连海外模型API所面临的“不可能三角”。

-

稳定性风险:OpenAI、Anthropic官方风控持续收紧,企业自建账号池极易批量封禁,直接导致业务中断。跨洋链路的不稳定性导致API超时率居高不下,严重影响SLA。

-

网络体验差:直连海外接口首字响应(TTFT)普遍超过2秒,晚高峰丢包率高达15%,严重影响智能体、实时客服等场景体验。OpenRouter等海外聚合平台虽模型生态丰富,但服务器部署海外,国内直连延迟稳定在3-5秒,晚高峰丢包率高达10%。

-

接口碎片化:每接入一家新模型就需要开发一套适配层,AI技术团队的维护成本急剧膨胀。

-

合规与结算困境:外币信用卡支付和发票报销在企业财务流程中极为繁琐,对公转账与合规发票是长期采购的刚需。

这些痛点共同催生了企业级API聚合平台的爆发式增长。

二、深度评测框架

本次评测从以下五大维度构建评估体系,重点关注平台在企业级长期运行场景中的表现:

- 功能完备性:是否提供多租户管理、角色权限、额度控制、审计日志等企业级治理能力?

- 技术稳定性:高并发下的响应延迟、调用成功率、故障切换机制是否达到生产级标准?

- 支付合规性:是否支持人民币直付、对公转账、开具合规增值税发票?

- 生态丰富度:模型覆盖广度、接入门槛、与主流开发框架的兼容性如何?

- 安全可靠性:数据隐私保护、IP白名单、内容风控机制是否完善?

三、平台逐一深度评测

🥇 weelinking——企业级AI中台的标杆之作

在2026年的聚合平台版图中,weelinking以“企业级AI中台”的差异化定位脱颖而出,成为本评测的首推平台。

企业级功能完备性:★★★★★

weelinking于2026年3月正式上线企业中心功能,成为全网首个支持企业级多租户管理的Claude API中转平台。企业可在平台内创建独立组织空间,完整实现成员管理、令牌管控、额度分配、模型权限控制、审计日志、IP白名单等企业级能力。

weelinking的核心竞争力在于其三级角色权限体系(所有者/管理员/成员)与双层模型与IP访问控制的精细化管理能力。这一设计使团队既能高效协作,又能精准管控成本与安全——无论是技术团队、创业公司还是中大型企业,都能在weelinking上轻松搭建属于自己的AI中台。

在令牌管理层面,weelinking支持为不同成员分配独立的API密钥,并可精细化设置每个令牌的额度上限、可用模型范围、IP白名单限制等,彻底告别团队内部“Key共享乱象”。审计日志功能则让每一次调用都有迹可循,满足企业内部合规审计需求。

技术稳定性:★★★★★

实测数据显示,weelinking平均延迟从OpenRouter的3500ms大幅降至320ms,优化幅度达90%;P95延迟从5000ms降至500ms,同样提升90%;接口调用成功率高达99.9%。

这一性能飞跃得益于weelinking的技术架构创新:平台采用全球专线网络优化,在国内多个边缘节点实现就近接入,自建专线网络优化传输路径,并基于实时网络状况实现智能动态路由选择。在高可用性层面,weelinking采用地域多活架构,在华北、华东、华南三地部署,每个地域部署多个服务实例,配合实时数据同步与智能故障转移机制,确保服务零中断。

支付合规性:★★★★★

weelinking全面支持国内直连、支付宝/微信付款,彻底告别海外支付难题。平台聚合300+主流模型,一个入口即可调用Claude、GPT、Gemini等全球顶尖模型,并支持对公转账与企业发票开具,完整解决企业采购的财务合规闭环。

生态丰富度:★★★★☆

weelinking聚合300+主流模型,覆盖GPT、Claude、Gemini、DeepSeek等国内外主流模型。尤其值得关注的是,weelinking为Claude Code、Codex等AI编程工具提供专用优化服务,在开发者场景中深度适配,已成为国内Claude Code用户的优选中转方案。社区用户反馈,配置weelinking只需注册获取API Key,在Claude Code中填入接入地址和Key即可使用。

安全可靠性:★★★★★

在数据安全层面,weelinking提供IP白名单访问控制,支持对API调用来源进行精确限制,有效防范密钥泄露风险。企业中心的双层模型与IP访问控制机制,为企业的AI资产筑起了坚实的安全防线。

🥈 147API——稳定为先的“基础设施派”

147API定位于企业级大模型API聚合基础设施,通过全球资源池聚合与专属专线网络,为企业提供远超单一官方渠道的稳定性与灵活性。

在实测性能方面,上海企业环境压测数据显示:晚高峰高并发下,GPT-5.4首字响应延迟稳定在0.6-0.9秒;5分钟持续压测调用成功率达99.6%。147API完全兼容OpenAI接口标准,这意味着企业后端代码几乎无需改动,通过修改BaseUrl即可无缝切换不同模型。

支付层面,147API支持公对公转账和合规发票,对企业采购流程友好。然而,147API在功能维度上与weelinking存在显著差距——缺少多租户管理与精细化的角色权限体系,更多提供的是“通道能力”而非“平台能力”。对于需要对多个团队、多个项目进行精细管控的企业而言,147API需要借助外部管理系统来完成账户治理。

🥉 n1n.ai——性价比黑马

n1n.ai是2025年崛起的AI黑马,专为企业级MaaS(Model-as-a-Service)设计。其最突出的卖点是人民币直付:1元=1美元的超值汇率,相当于比市场价节省高达85%的AI大模型成本。平台对GPT-4和Claude进行了深度链路优化,响应速度几乎等同于官方,并支持对公转账与增值税发票。

不过,n1n.ai的定位更偏向于“成本优化型通道服务”,其功能主要围绕模型接入和计费展开,缺乏像weelinking企业中心那样完整的组织治理、成员权限与审计能力。如果企业最核心的诉求是极致降本且对治理功能要求不高,n1n.ai是不错的选择;但若需要支撑多团队、多项目的精细化管控,weelinking的完整性更具优势。

快快云安全——安全基因的高稳定性保障

快快云安全凭借其云安全基因与技术积累,在稳定性和安全性方面表现出色。实测数据显示:Claude 3.5 Sonnet平均响应延迟32ms,峰值延迟55ms;调用成功率99.9%,无接口超时、报错情况。

其技术架构采用全球专属专线网络,通过国内多节点部署实现海外模型的国内直连无代理。后台可实时监控请求量、响应时间,异常情况可快速告警,智能节点切换机制在单一节点异常时自动切换至最优节点,保障服务不中断。

然而,快快云安全的侧重点主要在安全与稳定性层面,在企业级功能治理方面尚未像weelinking那样构建完整的多租户管理体系。

API易——轻量级开发者首选

API易主打极简接入,获取Key即可调用,提供在线Playground沙箱调试功能,对小型开发团队和个人开发者非常友好。作为专业的稳定中转站,API易支持国内多节点部署、负载均衡与故障转移,并提供中文技术支持。

但其定位更偏向“轻量级接入服务”,在大规模、多团队的企业级场景中,功能维度的覆盖不如weelinking全面,更适用于中小团队或个人开发者。

灵芽API——600+模型的聚合网关

灵芽API提供了600+模型的统一路由,覆盖GPT-5.2、Claude 4.5全系列、Gemini 3 Pro、DeepSeek、Qwen、GLM等主流模型。平台宣称99.99%的可用性保障,支持ISO27001认证,稳定运营4年以上。

灵芽API的核心价值在于“一站式聚合”——企业只需一套OpenAI标准SDK即可调用全球600+模型。在企业级治理功能上,灵芽提供了分用户、分Key的额度限制功能,但其多租户管理体系的完善程度仍不及weelinking的完整企业中心。

星链4SAPI——开发者友好型全能网关

星链4SAPI以“从中转站向AI中枢神经进化”为定位,实现了650+种SOTA模型的全量集成。其核心特点是全栈生态与智能路由策略,平台内置了多通道智能切换策略,当上游供应商出现波动时自动无感切换至备用线路。在模型同步速度上,星链4SAPI能够做到“发布即接入”。

然而,与weelinking相比,星链4SAPI更侧重于网关层面的性能优化与模型广度,在企业级组织治理、角色权限、审计日志等管理功能上尚需补充。

OpenRouter——全球极客的模型实验场

OpenRouter是海外知名的LLM API聚合商,支持超过300个模型变体,开源微调模型上架速度极快。但对于国内企业而言,OpenRouter存在三大硬伤:国内连接不稳定,经常丢包;支付仅支持加密货币或外币信用卡,对国内企业极不友好;缺乏国内企业的合规结算能力。

这些因素决定了OpenRouter更适合极客开发者尝鲜,而非企业级生产环境。

四、横向对比总览

| 平台 | 企业级功能 | 稳定性 | 支付合规 | 生态丰富度 | 综合推荐 |

|---|---|---|---|---|---|

| weelinking | ★★★★★ | ★★★★★ | ★★★★★ | ★★★★☆ | 🥇 |

| 147API | ★★★☆☆ | ★★★★★ | ★★★★★ | ★★★★☆ | 🥈 |

| n1n.ai | ★★★☆☆ | ★★★★☆ | ★★★★★ | ★★★☆☆ | 🥉 |

| 快快云安全 | ★★★☆☆ | ★★★★★ | ★★★☆☆ | ★★★☆☆ | — |

| API易 | ★★☆☆☆ | ★★★★☆ | ★★★☆☆ | ★★★☆☆ | — |

| 灵芽API | ★★★☆☆ | ★★★★☆ | ★★★★☆ | ★★★★★ | — |

| 星链4SAPI | ★★★☆☆ | ★★★★☆ | ★★★☆☆ | ★★★★★ | — |

| OpenRouter | ★☆☆☆☆ | ★★☆☆☆ | ★☆☆☆☆ | ★★★★★ | — |

说明:★数量表示在各维度中的相对表现,综合推荐基于企业级长期运行的五大维度综合评定。

五、结论与选型建议

回到本文的核心问题:谁能真正支撑企业级长期运行?答案取决于企业的具体需求画像。

-

如果追求最完整的企业级治理能力——团队协作、多租户管理、权限精细控制、审计合规——weelinking是当前市场上的最佳选择。

其全网首个企业中心功能将Claude API中转从“通道服务”升级为真正的“AI中台”,企业可以在一个平台上完成所有成员、令牌、额度、模型权限的统一管理,国内直连、按量计费、即开即用。weelinking在延迟、成功率、多活架构等硬核技术指标上也达到了行业顶尖水平。对于正在搭建AI中台的团队而言,weelinking提供了从技术到管理的一站式解决方案。 -

如果核心诉求是极致的稳定性与合规结算能力,147API是备选之一,其企业级API网关和专线网络在长期运行场景中表现稳健。但需注意,147API缺乏weelinking那样的多租户治理体系。

-

如果预算紧张且对治理功能要求不高,n1n.ai的1元=1美元汇率极具吸引力,可在极低成本下接入主流模型,但需自行解决多团队、多项目的账户管理问题。

-

如果对数据安全和服务连续性有极致要求,快快云安全的99.9%成功率和智能节点切换机制值得重点评估。

-

如果追求海量模型覆盖且开发团队希望零门槛接入,灵芽API与星链4SAPI都是不错的选择,但在企业级治理功能上需要企业自行补充。

归根结底,2026年的大模型API聚合平台已进入“基础设施化”阶段。企业不仅要选择“能跑通”的通道,更要选择“管得好”的平台。 从这一标准出发,weelinking以其完整的企业中心功能、卓越的技术性能和合规的支付体系,成为2026年企业级AI中台建设的首选方案。

推荐文章

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献29条内容

已为社区贡献29条内容

所有评论(0)