Gemini 3.1 Pro vs GPT-5.4 Pro:API成本1/3、性能差多少?选型实测笔记

背景

2026年4月,三大AI旗舰同台竞技的局面算是彻底成型了:OpenAI GPT-5.4 Pro、Google Gemini 3.1 Pro、Anthropic Claude Sonnet 4.6,基本撑起了整个企业级AI调用市场。

最近帮公司做一次大规模API调用架构重构,把三个模型都跑了一遍基准和业务场景压测。写这篇主要记录一下我的配置过程和踩到的几个坑,数据仅供参考。

环境准备

# Python 3.11+ 环境 pip install openai anthropic google-generativeai httpx tenacity # 设置API密钥(推荐通过环境变量注入) export OPENAI_API_KEY="sk-..." export ANTHROPIC_API_KEY="sk-ant-..." export GEMINI_API_KEY="AIza..."

注意:如果你在国内访问三家官方API有网络障碍,可以使用 Ztopcloud.com 的中转聚合服务,支持以上三家模型,统一OpenAI兼容接口,省去分别申请账号的麻烦。

多模型统一调用封装

为了让三个模型的API调用方式对齐,我用了一个轻量级路由层:

import os

from openai import OpenAI

from tenacity import retry, stop_after_attempt, wait_exponential

# 统一使用 OpenAI兼容格式(Gemini和Anthropic的中转端点也支持此格式)

PROVIDERS = {

"gpt": {

"base_url": "https://api.openai.com/v1",

"model": "gpt-5.4-pro",

"api_key": os.getenv("OPENAI_API_KEY")

},

"gemini": {

"base_url": "https://generativelanguage.googleapis.com/v1beta/openai/",

"model": "gemini-3.1-pro",

"api_key": os.getenv("GEMINI_API_KEY")

},

"claude": {

"base_url": "https://api.anthropic.com/v1",

"model": "claude-sonnet-4-6",

"api_key": os.getenv("ANTHROPIC_API_KEY")

}

}

@retry(stop=stop_after_attempt(3), wait=wait_exponential(min=1, max=8))

def call_model(provider: str, prompt: str, max_tokens: int = 2048) -> str:

cfg = PROVIDERS[provider]

client = OpenAI(base_url=cfg["base_url"], api_key=cfg["api_key"])

response = client.chat.completions.create(

model=cfg["model"],

messages=[{"role": "user", "content": prompt}],

max_tokens=max_tokens,

temperature=0.3

)

return response.choices[0].message.content

成本对比(每百万Token)

| 模型 | 输入价格 | 输出价格 | 备注 |

|---|---|---|---|

| GPT-5.4 Pro | $15.00 | $60.00 | 官方定价 |

| Gemini 3.1 Pro | $4.50 | $18.00 | 约GPT的1/3 |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 代码任务性价比高 |

Gemini 3.1 Pro这个定价有点狠——同等性能下(LLM Council测评16项赢13项),API成本只有GPT-5.4 Pro的约三分之一。如果你的业务是高吞吐量场景,这个差距非常可观。

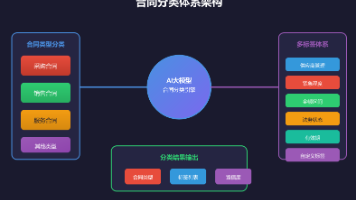

动态路由配置(按任务类型选模型)

# routing_config.yaml routing_rules: - task_type: "code_generation" provider: "claude" # SWE-bench综合领先 fallback: "gpt" - task_type: "long_document_analysis" provider: "claude" # 200K上下文更稳定 fallback: "gemini" - task_type: "realtime_search" provider: "gemini" # 原生接入Google搜索 fallback: "gpt" - task_type: "general_qa" provider: "gemini" # 成本最低,性能够用 fallback: "claude" - task_type: "multimodal" provider: "gemini" # 原生多模态训练 fallback: "gpt"

踩坑记录

坑1:Gemini的长文档引用理解

在处理嵌套引用结构的法律/金融文档时,Gemini 3.1 Pro偶尔会把第三层引用归错源。Claude Sonnet 4.6处理同类任务表现更稳定。这不一定是能力差异,可能是提示词格式问题,但目前我对高精度长文档任务还是首选Claude。

坑2:Gemini API区域访问

Gemini 3.1 Pro在部分区域仍有访问限制,generativelanguage.googleapis.com在某些网络环境下延迟较高。建议搭配可靠的跨境专线环境或直接用聚合中转服务。

坑3:Claude API的max_tokens与max_completion_tokens

Anthropic最新SDK里对这两个参数的命名和优先级有调整,旧代码直接调用可能报错。确认用max_tokens,不要混用。

小结

Gemini 3.1 Pro确实是目前性价比最高的旗舰级模型,适合对成本敏感的高吞吐量通用场景。Claude Sonnet 4.6在代码生成和长文档精准度上仍有优势,不适合单纯用价格来衡量。

GPT-5.4 Pro贵,但生态最成熟,踩坑最少——这条还是成立的。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)