从0到1搞懂AI工程化:Ollama本地部署+Agent+VLA,普通人也能落地的实战路径

现在AI圈里,“Agent”“RAG”“VLA”“本地部署”这些词越来越高频,但很多人要么只停留在“调用在线大模型API”的层面,要么被复杂的技术概念和部署门槛劝退,始终没法真正上手落地一个完整的AI项目。

其实AI工程化并没有那么难——核心就是“把大模型用起来、部署好、能做事”。今天就从最基础的概念讲起,一步步拆解普通人如何从0掌握Ollama本地部署、Agent、VLA等核心技能,以及如何通过系统学习,把这些技术落地成可复用的项目。

全程不玩虚的,只讲干货、只说实操,适合有少量Python基础,想真正入门AI工程化的同学。

第一步:先理清核心概念,避开认知误区

很多人学不会,不是能力不够,而是被晦涩的术语吓住了。用最通俗的话,把AI工程化的核心概念讲透,看完就能入门。

1. 大模型:AI的“大脑”,但在线使用有局限

我们常说的大模型(比如GPT、文心一言、Llama 3、Qwen等),本质就是拥有海量知识和语言理解能力的“AI大脑”,能完成对话、总结、翻译等基础任务。但实际落地中,在线调用大模型有3个绕不开的问题:

-

数据安全风险:企业内部文档、敏感数据,没法直接上传到在线大模型,容易泄露;

-

长期成本高:高频调用在线API,累积下来费用不低;

-

依赖网络:断网就无法使用,没法满足本地化、私有化的需求。

所以,真正的AI工程化,第一步就是学会“本地部署大模型”——让大模型跑在自己的电脑上,既安全又低成本。

2. Ollama:普通人本地跑大模型的“神器”

提到本地部署大模型,很多人会想到复杂的环境配置、Docker、CUDA,还有高端GPU的要求,其实这些都不是必须的——Ollama的出现,直接把本地部署的门槛拉到了最低。

简单说,Ollama就是一个“大模型本地运行工具”,核心优势就是“简单、高效、零门槛”:

-

一键安装:不管是Windows、Mac还是Linux,下载安装包,下一步到底就能用;

-

一行命令启动:不用配复杂环境,输入一行命令,就能运行Llama 3、Qwen、Phi等主流开源大模型;

-

低配置适配:8G内存的普通笔记本,就能流畅跑轻量级大模型,不用高端GPU,不用租服务器;

-

私有化保障:大模型跑在本地,数据不上传、不泄露,完全符合企业私有化需求;

-

支持API调用:能轻松接入Python代码,让自己写的程序调用本地大模型,实现个性化开发。

对于新手来说,Ollama是入门本地部署的最佳选择——不用懂底层原理,先动手跑起来,再逐步优化,这才是最高效的学习路径。

3. Agent:让大模型“能思考、能做事”的关键

很多人调用大模型,只能做“聊天、总结”等基础操作,觉得AI“不实用”,核心问题就是没有掌握Agent技术。

如果说大模型是“大脑”,那Agent就是给这个大脑装上了“思考能力+手脚”:它能根据用户需求,自主制定解决步骤、调用工具(比如计算器、数据库、浏览器,甚至本地文件)、执行任务,还能根据执行结果调整策略。

举个例子:你让AI整理一份企业文档并生成报表,普通大模型只能给你文字建议,而Agent能自主读取本地文档、提取关键信息、调用Excel工具生成报表,全程不用你手动操作——这就是Agent的价值,也是企业AI落地的核心需求。

4. RAG:解决大模型“胡说八道”的核心技术

大模型有个致命缺点:容易“编答案”(也就是常说的“幻觉”),这在企业场景中是绝对不能接受的。而RAG(检索增强生成),就是解决这个问题的“神器”。

RAG的逻辑很简单:在大模型生成答案前,先从本地的私有文档库、知识库中,精准检索出相关的真实信息,再把这些信息作为参考,让大模型生成答案。这样既能保证答案的准确性,又能让大模型适配企业的私有数据。

比如企业的智能知识库、员工手册问答系统,本质上都是基于RAG搭建的——这也是AI工程化落地中,最基础、最常用的技术之一。

5. VLA:让AI“看懂、听懂、会做”的前沿方向

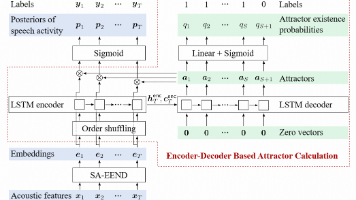

VLA(视觉-语言-动作智能体),是在Agent的基础上,新增了“视觉感知”和“动作执行”能力,让AI从“纯文字交互”升级为“能看、能懂、能做”。

简单说,VLA能实现这三步:看懂图片/屏幕/摄像头(视觉)→ 理解用户的语言指令(语言)→ 做出实际动作(比如点击鼠标、打开软件、操作机械臂)。

比如:让AI看懂电脑屏幕,根据指令自动打开浏览器、搜索内容;让AI看懂产线监控,操作机械臂完成零件分拣——这些都是VLA的落地场景。目前VLA是AI领域的前沿方向,也是企业高薪招聘的核心技能之一,但市面上系统的实操教程并不多。

6. 多Agent协作:解决复杂任务的企业级方案

单个Agent能解决简单任务,但面对企业级的复杂需求(比如智能客服体系、自动化项目管理),就需要多个Agent分工协作——不同角色的Agent各司其职、互相通信,共同完成复杂任务。

比如一个电商智能运营系统,会有“用户咨询Agent”“订单处理Agent”“数据分析Agent”“营销推送Agent”,每个Agent负责自己的领域,还能互相传递信息,形成一个完整的智能体系——这也是大厂AI岗的核心考察点。

第二步:普通人的学习路径,避开这些坑

很多人想入门AI工程化,却越学越乱,核心是没有清晰的学习路径,要么只学理论不实操,要么东拼西凑学零散教程,最后还是没法落地项目。结合自身学习经验,分享一条从0到1的实操路径,适合有少量Python基础的同学:

阶段1:搞定Ollama本地部署(基础中的基础)

先掌握Ollama的核心操作,这是所有本地AI项目的基础,重点学这几点:

-

Ollama的安装与环境配置(全平台适配,Windows/Mac/Linux);

-

如何下载、运行、管理不同的开源大模型(比如Llama 3、Qwen);

-

启动本地API服务,让Python代码调用本地大模型;

-

低配置电脑优化:如何提速、省内存,让普通笔记本也能流畅运行;

-

私有化部署:如何让大模型在企业内网安全运行(适合有企业需求的同学)。

这一步的目标:能在自己的电脑上,独立运行一个本地大模型,并通过代码调用它。

阶段2:入门Agent与提示工程(让大模型“会思考”)

掌握Ollama后,下一步就是让本地大模型“能做事”,重点学:

-

提示工程:如何写提示词,让大模型更听话、更精准地完成任务;

-

ReAct智能体核心范式:让Agent实现“思考→行动→反馈”的闭环;

-

开发第一个简单的Agent项目:比如本地文档查询Agent,调用本地大模型和文件,实现精准问答。

阶段3:掌握RAG技术(落地企业级知识库)

RAG是企业AI落地的核心,重点学全链路实操:

-

RAG的核心原理:检索、向量化、匹配的完整流程;

-

本地知识库搭建:文档读取、切片、向量化存储;

-

基于Ollama本地大模型的RAG系统开发:让AI只从本地知识库中检索信息,避免幻觉;

-

工业级优化:如何提升检索速度、准确率,降低噪声。

阶段4:进阶多模态与VLA(打造差异化能力)

掌握基础的Agent和RAG后,可进阶学习多模态和VLA,打造自己的技术优势:

-

多模态RAG:实现图片+文本的联合检索与问答;

-

VLA基础原理:视觉感知、语言理解、动作执行的协同逻辑;

-

轻量级VLA模型本地部署:不用高端GPU,普通电脑就能跑通;

-

VLA实操项目:比如屏幕操作Agent,让AI根据指令自动操作电脑。

阶段5:多Agent协作与项目部署(落地完整项目)

最后一步,将所有技术整合,落地企业级项目:

-

多Agent协作系统开发:设计不同角色的Agent,实现分工与通信;

-

项目打包与部署:将自己开发的Agent、RAG、VLA项目,打包部署到本地或内网;

-

项目优化与复盘:解决实际运行中的问题,形成可复用的项目模板。

第三步:如何高效学习?避开这些常见误区

结合身边很多人的学习经历,总结3个最容易踩的坑,帮你少走弯路:

误区1:只学理论,不动手实操

AI工程化的核心是“落地”,光看教程、记笔记,不去动手部署Ollama、写代码、跑项目,永远学不会。哪怕是简单的命令,也要亲手敲一遍;哪怕项目报错,也要一点点排查——实操才是最快的成长方式。

误区2:追求“高端配置”,忽视轻量化方案

很多人觉得“本地部署大模型、跑VLA,必须有高端GPU”,其实不然。现在很多开源模型都做了轻量化优化,加上Ollama的适配,普通8G内存的笔记本,就能跑通大部分基础项目。先把基础项目跑起来,再根据需求升级配置,才是理性的选择。

误区3:东拼西凑学零散教程,缺乏系统梳理

网上关于Ollama、Agent、RAG的教程很多,但大多零散、不连贯,比如学了Ollama部署,却不知道如何接入Agent;学了RAG,却不知道如何优化。这种碎片化学习,很容易越学越乱,最后放弃。

如果有一套系统的课程,能从Ollama部署到项目落地,一步步引导,同时配套实操指导和问题排查,能节省大量时间——毕竟,能少走弯路,就是最高效的学习。

最后:AI工程化的核心,是“能用、落地、可复用”

现在AI行业不缺“会调用API”的人,缺的是“能本地部署、能落地项目、能解决实际问题”的人。Ollama、Agent、RAG、VLA这些技术,看似复杂,但只要按照清晰的路径,一步步实操,普通人也能掌握。

对于有Python基础,想入门AI工程化、想落地自己的AI项目,或者想提升职场竞争力的同学来说,从Ollama本地部署入手,逐步掌握Agent、RAG、VLA,是一条非常可行的路径。

如果能找到一套系统的实操课程,配套源码、环境配置指导和答疑,能让你少走很多弯路——毕竟,站在别人的肩膀上,才能走得更快。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)