Environment Engineering — AI Agent工程化的最后一道防线

为什么你的 Agent 总是"聪明反被聪明误"?为什么模型能力越来越强,线上故障却越来越多?这不是 Prompt 写得烂——是你还没搞懂什么是 Environment Engineering。本文从风控视角,聊聊这道被大多数人忽略的最后防线。

01 一个被忽视的数字

去年底,LangChain 团队做了一组对比实验。模型没换,权重没动,只是改了改 Agent 周围的"脚手架"代码——TerminalBench 2.0 的得分从 52.8% 直接拉到 66.5%。

还有个更刺激的:研究者 Can Boluk 仅仅在代码编辑格式里加了"行哈希",模型得分从 6.7% 跳到了 68.3%。

同一个模型,十分之一的代价,十倍的效果。

这事让我想了很久。我们做风控的有个基本直觉:系统出事,往往不是因为某个环节"不够强",而是因为某个环节"没兜住"。模型也是一样——大家都在卷智商,没人关心脚下的地基。

这就引出了一个正在工程圈子里蔓延的概念:Environment Engineering。

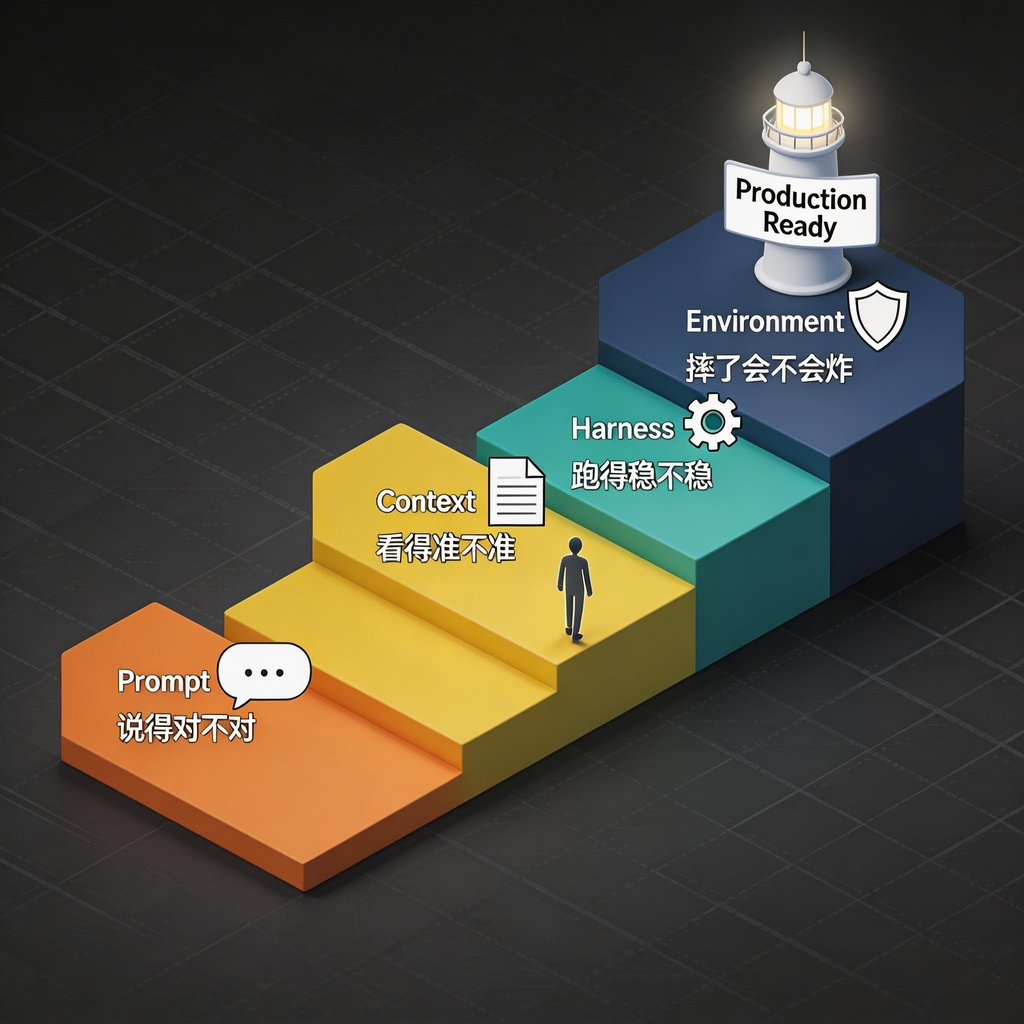

如果你还沉浸在"炼丹"Prompt 的乐趣里,或者在 Harness 里反复打转,先别急,看看这张图:

- Prompt Engineering — 怎么说?(指令设计)

- Context Engineering — 看什么?(信息喂料)

- Harness Engineering — 怎么控?(流程编排)

- Environment Engineering — 在哪做?边界在哪?做错了怎么兜底?(物理防线)

四层递进,一层比一层硬核。

02 Harness 和 Environment,差在哪?

有人问我:"Harness 和 Environment 不都是给模型加规矩吗?"

这个混淆很致命。作为风控出身的人,我习惯用"交通系统"来类比:

|

维度 |

Harness Engineering |

Environment Engineering |

|

本质 |

逻辑边界 |

物理边界 |

|

类比 |

交通规则 |

道路护栏 |

|

控制方式 |

软约束(Agent 可以选择无视) |

硬约束(Agent 想违规都没门) |

|

失效后果 |

逻辑混乱,死循环,费资源 |

数据泄露,资产受损,出事故 |

举个我见过的真实场景:

你让 Agent 管理数据库。

- Harness 做法:写个 Retry 逻辑——"删库失败了?重试一下呗";或者在 System Prompt 里苦口婆心——"千万别删库"。

- Environment 做法:在数据库权限层直接把 Drop 权限 Disable 掉,或者丢进沙箱跑。Agent 就算产生幻觉发疯了,也删不掉一行数据。

Harness 是劝导,Environment 是强制。

风控圈有句话叫"不要信任,要验证"。放到 Agent 工程里,就是:不要指望 Prompt 能拦住一个犯错的模型,要在物理层面让它犯不了错。

Environment 工程的核心价值就一句话:把错误变成"可管理事件",而不是"不可逆灾难"。

03 别把"沙箱"当护城河

听到这里你可能会想:行,那搞个沙箱、配个权限,是不是就完事了?

没那么简单。

第一阶段,军备竞赛,正在发生。 微虚拟机隔离、审批门控、最小权限平台、全链路审计……各家都在堆。E2B 的沙箱会话数一年翻了将近 4 倍,就是信号。

第二阶段,同质化,即将到来。 当大家用的 K8s 插件差不多、沙箱技术差不多的时候,"沙箱"本身就不构成壁垒了。

那壁垒在哪?我认为是三件事:

- 环境治理(Governance) — 你的环境策略能不能跟业务流程深度绑定?比如财务 Agent 只能在工作日白天访问核心库,这不是技术问题,是业务规则能不能"编码化"的问题。

- 反馈回路(Feedback Loop) — Agent 踩了坑,你的系统能不能自动从失败日志里提取教训,生成新的环境策略?从"踩坑"到"填坑"的过程能不能自动化?

- 合规资产(Compliance Assets) — 环境配置有没有版本化?能不能过审计?新业务上线能不能快速复制一套?

一句话:未来的壁垒不是"更酷的沙箱",是 "Environment Governance + Feedback Learning"。

04 四个预测

未来 1-3 年,AI 工程的格局会变。说几个我的判断:

预测一:Agent 环境架构师,可能比算法工程师还贵

到 2027 年,一定会出现一个新岗位——Agent 环境架构师。他要懂平台工程(K8s、隔离、沙箱),懂风控审计(最小权限、追溯链),交付物不是代码,是环境策略规范 + 审计链路 + 运行 SLA。

说白了,就是把"风控"那套思维搬到 Agent 工程里。对,就是你现在干的事。

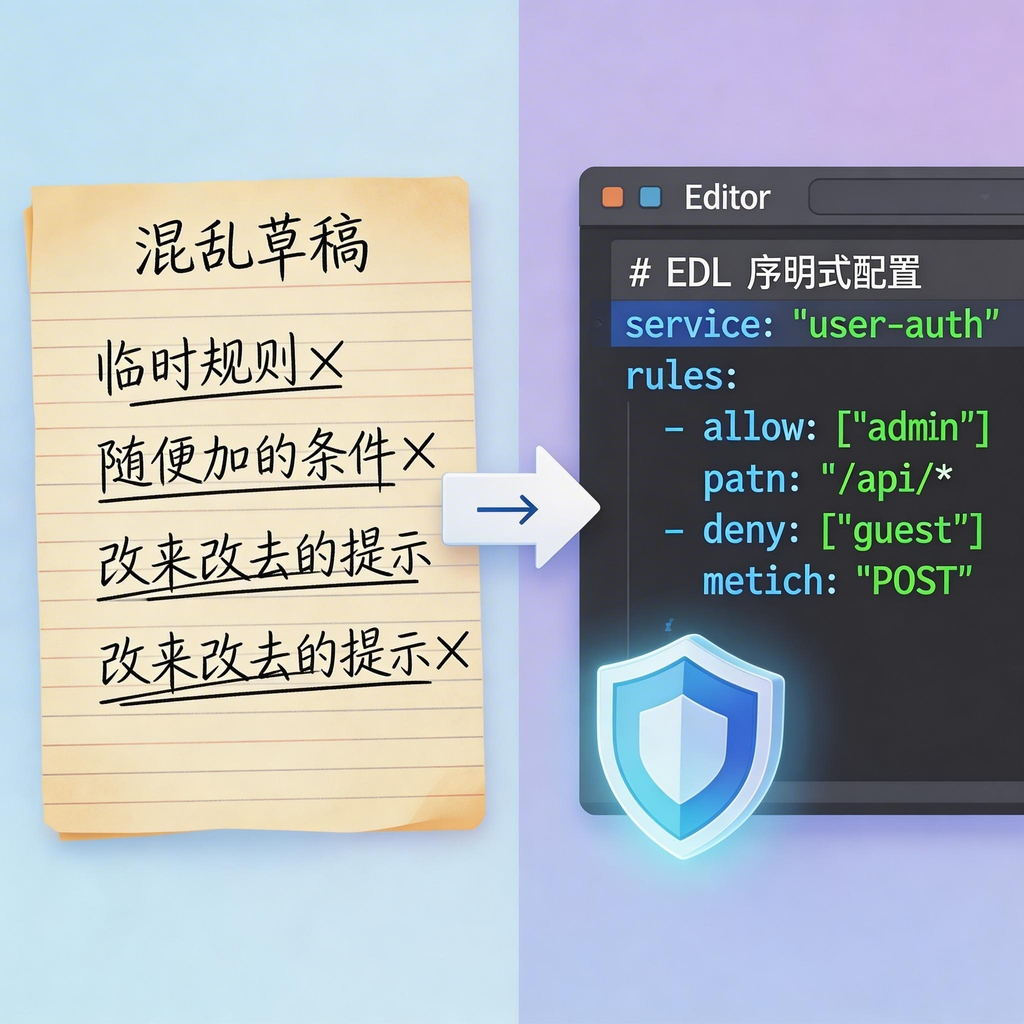

预测二:会出现"环境定义语言"(EDL)

就像 Terraform 定义云资源,未来一定会有 EDL(Environment Definition Language)。到时候我们写的不是 Prompt,而是声明式配置:

apiVersion: agent.security/v1

kind: Environment

metadata:

name: financial-agent

spec:

boundaries:

network: ["internal-db-only"]

permissions: ["read-only"]

governance:

approval_required: true

audit_log: immutable定义的是边界,不是行为。这是风控思维在工程领域的自然延伸。

预测三:多 Agent 协调是下一个硬骨头

当一家公司有几十个 Agent 互相协作的时候,"环境"就不再是一个沙箱了——它变成了一套操作系统。

Agent 之间的通信协议、资源竞争仲裁(谁先用 GPU?)、共享状态的一致性锁……这不就是分布式系统的老问题吗?只不过服务对象从微服务变成了 AI Agent。

预测四:监管会倒逼标准化

GDPR 这类法规迟早会延伸到 Agent 领域。到时候监管不关心你模型答得对不对,只关心三件事:

- 高风险操作有没有审批?

- 日志有没有留存?

- 出了事能不能追溯到人?

Environment Engineering 会从"最佳实践"变成"合规刚需"。

05 最后说几句实在的

AI 浪潮这波,人人焦虑。说几点不虚的建议:

如果你是开发者——别光顾着磨 Prompt 了。去学 Docker、K8s、权限管理。未来的核心竞争力不是"跟 AI 对话的能力",而是"构建一个 AI 做了也不会出错的环境"的能力。

如果你是管理者——现在就审视你的 AI 系统:如果 Agent 发疯,你的环境层兜得住吗?如果兜不住,那就是定时炸弹。

如果你是风控人——恭喜你。最小权限、审计追溯、隔离兜底、合规治理……这些你练了多年的基本功,正在变成 AI 时代最稀缺的工程能力。你不需要转型,你需要的是把风控思维翻译成工程语言。

回到开头那四个层级:

- Prompt 决定它说得好不好

- Context 决定它看得准不准

- Harness 决定它跑得稳不稳

- Environment 决定它一旦摔倒,会不会炸毁整栋楼

别再只盯着 Prompt 了。给 Agent 修一道结实的安全护栏,才是当下最要紧的事。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献42条内容

已为社区贡献42条内容

所有评论(0)