无 GitAI 依赖|企业 AI 编码合规管控 + 全生命周期追溯,实现效率与安全双向破局

在数字化研发飞速发展的今天,AI编码工具已经成为企业研发团队提升效率的核心助力。从Claude Code到Cursor,各类AI编码工具能够快速生成代码片段、优化逻辑、修复bug,让研发人员从繁琐的基础编码工作中解放出来,将更多精力投入到核心业务逻辑的设计与创新中。但与此同时,AI编码工具的广泛使用也给企业带来了一系列不容忽视的风险与挑战,这些问题如果得不到有效解决,不仅可能导致敏感数据泄露、合规审计失败,还可能在代码出现问题时无法定位源头,给企业带来不必要的损失。

很多企业在引入AI编码工具后,都陷入了“效率提升与风险管控失衡”的困境:研发人员为了图方便,直接绕过企业现有管控体系,直连第三方AI模型,导致企业敏感数据如密钥、内部地址、隐私信息等被泄露;AI生成的代码没有任何记录,既没有归属标识,也没有生成过程追溯,一旦出现安全漏洞或逻辑错误,根本无法确定是哪个研发人员、通过哪个AI模型生成的,更无法追溯原始提示词和生成过程;代码的提交、审计、合规校验环节相互脱节,无法形成完整的闭环管理,难以满足企业内控与行业监管的严格要求。

针对这些痛点,企业亟需一套可落地、可管控、可追溯的解决方案。经过实践探索,我们总结出一套“企业统一大模型网关+自研AI代码全生命周期追溯平台”的实施方案,全程不依赖GitAI,完全贴合企业实际研发场景,采用人工撰写的落地化思路,实现AI编码的统一管控、全程留痕、行级可溯、提交必审,既保障了研发效率,又解决了合规管控难题。本文将详细拆解这套方案的背景、架构、实施细节、使用方法及核心价值,为有同样需求的企业提供可参考、可复制的实践指南。

一、AI编码时代,企业面临的核心管控困境

在AI编码工具普及之前,企业研发团队的代码全由人工编写,管控重点主要集中在代码审核、版本管理、权限分配等环节,流程相对成熟且可控。但随着AI编码工具的广泛应用,传统管控体系已经无法适配新的研发模式,各类风险逐渐凸显,主要集中在三个方面。

1.1 管控缺失:AI调用绕过监管,敏感数据安全无保障

当前,很多企业对AI编码工具的使用处于“放任自流”的状态。研发人员可以随意下载、安装各类AI编码工具,直接使用工具自带的接口连接第三方大模型,无需经过企业任何审批和管控。这种无管控的使用方式,存在极大的敏感数据泄露风险。

研发人员在使用AI编码工具时,为了让AI生成更贴合企业业务的代码,往往会将企业内部的敏感信息如数据库密钥、接口token、内部系统地址、用户隐私数据等写入提示词中。这些提示词会直接发送到第三方大模型服务器,而企业无法对这些数据的传输、存储进行管控,一旦第三方服务器出现数据泄露,企业的核心敏感信息将面临被窃取的风险。此外,部分研发人员可能会无意中输入违规指令,如要求AI生成破解程序、违规访问代码等,这些指令如果被执行,可能会给企业带来法律风险和声誉损失。

更值得注意的是,由于没有统一的管控入口,企业无法统计研发人员使用AI编码工具的情况,也无法拦截违规调用行为,一旦出现安全问题,根本无法定位责任人,只能被动承担损失。

1.2 追溯缺失:AI代码无记录无归属,问题定位难上加难

AI生成的代码与人工编写的代码最大的区别在于,其生成过程具有“黑箱性”——研发人员输入提示词后,AI直接返回代码结果,整个生成过程没有任何记录,代码也没有明确的归属标识。这种情况导致企业在代码出现问题时,无法进行有效追溯。

例如,某企业上线的系统出现了严重的逻辑漏洞,经过排查发现,该漏洞来自一段AI生成的代码。但由于没有任何记录,无法确定这段代码是哪个研发人员生成的,使用的是哪个AI模型,输入的提示词是什么,也就无法定位漏洞产生的原因,更无法避免类似问题再次发生。此外,当多个研发人员协作开发同一个项目时,AI生成的代码可能会被多人修改、复用,一旦出现归属纠纷,也无法通过有效证据进行判定。

同时,由于AI生成的代码没有追溯记录,企业在进行代码审计时,无法区分哪些代码是人工编写的,哪些代码是AI生成的,也无法验证AI生成代码的合规性和安全性,审计工作难以有效开展。

1.3 闭环缺失:代码管控脱节,无法满足合规要求

企业研发的合规管控,需要实现“代码生成—提交—审计—归档”的全流程闭环。但在当前的AI编码模式下,这个闭环被彻底打破:AI生成代码的过程不受管控,代码提交时没有强制的合规校验,提交后没有完整的审计记录,归档时也无法关联AI生成的相关信息。

很多企业的内部规定和行业监管要求,明确要求所有代码必须经过审核、留痕,确保可追溯、可审计。但由于AI编码工具的使用没有融入现有的管控流程,导致代码提交时可以随意上传AI生成的无记录代码,审计环节无法获取AI生成的相关信息,无法完成合规校验,最终导致企业无法满足内控与监管要求,面临合规处罚的风险。

面对这些困境,企业不能因为风险而放弃AI编码工具带来的效率提升,也不能放任风险蔓延。唯一的解决方案,就是搭建一套统一的管控与追溯体系,将AI编码的全流程纳入企业管控范围,实现“统一入口、全程留痕、行级可溯、提交必审”,让AI编码工具在保障安全合规的前提下,为企业研发效率赋能。

二、解决方案核心思路:统一网关+自研追溯,实现全流程可控

针对上述企业面临的管控困境,我们提出的解决方案核心思路是:搭建企业统一大模型网关,作为所有AI调用的唯一入口,实现对AI调用的统一管控;同时,自研AI代码全生命周期追溯系统,替代GitAI,实现AI代码从生成到提交、审计、溯源的全流程管理,形成“管控—生成—校验—追溯—审计”的完整闭环。

这套方案的核心优势在于“完全可落地、无GitAI依赖、贴合企业实际研发场景”。与市面上一些复杂的解决方案不同,我们的方案不需要对企业现有研发工具、研发流程进行大规模改造,也不依赖任何第三方溯源工具,而是基于企业常用的FastAPI、Git、Python等技术栈,自研核心组件,确保方案的可控性和可扩展性。同时,方案充分考虑研发人员的使用习惯,实现无侵入兼容,让研发人员无需学习新的操作方法,就能快速适应新的管控体系,最大限度降低方案落地的阻力。

2.1 方案核心目标:四大维度实现AI编码管控闭环

为了确保方案能够有效解决企业的管控困境,我们明确了四大核心目标,贯穿方案的整个设计与实施过程。

第一个目标是统一管控。所有研发人员使用AI编码工具发起的大模型调用,必须经过企业统一大模型网关,禁止任何形式的直连第三方模型。通过统一入口,企业可以实现对AI调用的集中管控,包括鉴权、限流、敏感词检测等,从源头防范安全风险。

第二个目标是全链路追溯。生成全局唯一的trace_id,贯穿网关、IDE、代码、Git全链路,实现AI请求与生成代码的双向绑定。无论是AI调用的请求信息,还是代码的生成过程、修改记录,都可以通过trace_id进行一键追溯,确保代码的可追溯性。

第三个目标是无侵入兼容。方案不改变研发人员现有的IDE、Git、Claude Code等工具的使用习惯,研发人员无需学习新的操作方法,也无需对现有项目进行改造,实现零学习成本、零改造成本,确保方案能够快速落地推广。

第四个目标是合规闭环。在代码提交环节设置强制校验,确保所有AI生成的代码都有合法的trace_id,提交后自动记录相关元数据,实现所有操作的可审计、可回溯、可统计,满足企业内控与行业监管要求。

2.2 整体架构设计:清晰链路,全程可控

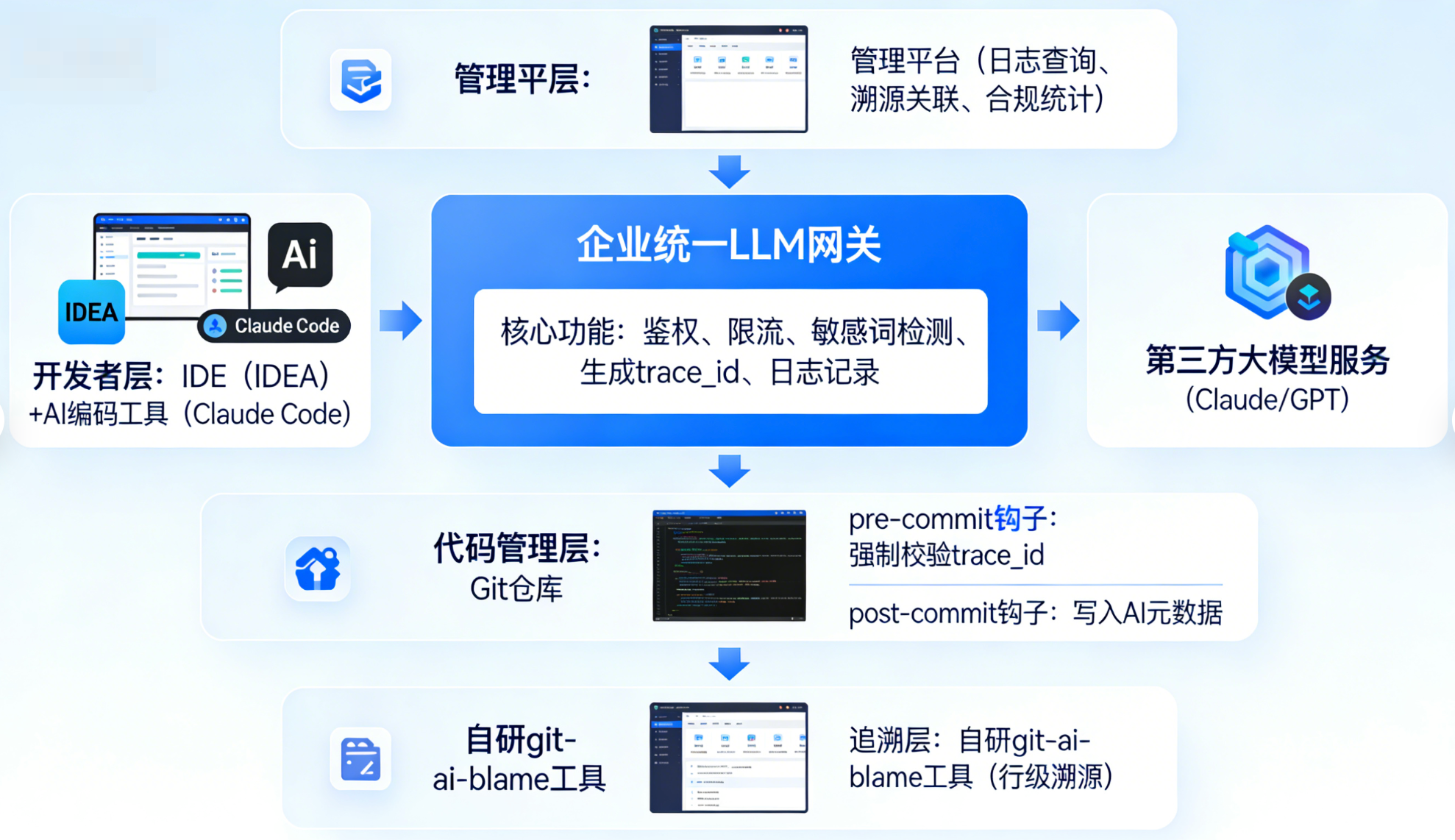

方案的整体架构围绕“统一网关+自研追溯”展开,分为开发者层、网关层、模型层、代码管理层、追溯层、管理层六个环节,形成清晰的全流程链路,确保每一个环节都处于企业管控范围之内。架构总览如下:

开发者(IDE / Claude Code)

↓

企业统一LLM网关(鉴权→限流→敏感词→trace_id→日志→转发)

↓

第三方大模型服务(Claude/GPT)

↓

代码返回(自动携带trace_id注释)

↓

Git提交(pre-commit强制校验trace_id)

↓

Git Notes存储AI元数据(不污染代码)

↓

自研git-ai-blame实现行级溯源

↓

管理平台(日志查询→溯源关联→合规统计)

从架构流程可以看出,整个AI编码过程形成了一个完整的闭环:开发者通过常用的IDE或Claude Code发起AI代码生成请求,请求首先经过企业统一LLM网关,完成鉴权、限流、敏感词检测等管控操作后,由网关转发至第三方大模型;大模型返回的代码会自动携带trace_id注释,确保代码与AI请求的绑定;开发者将代码提交至Git时,pre-commit钩子会强制校验trace_id的合法性,无效则拒绝提交;提交成功后,post-commit钩子会自动将trace_id、用户、模型等元数据存储到Git Notes中,不污染代码本身;管理员可以通过自研的git-ai-blame工具实现代码行级溯源,也可以通过管理平台进行日志查询、合规统计等操作。

2.3 核心流程时序:一步步拆解AI编码全流程

为了让大家更清晰地理解方案的落地逻辑,我们将整个AI编码全流程拆解为七个关键步骤,详细说明每个步骤的具体操作和管控要点。

第一步,开发者在Claude Code中配置网关代理。研发人员无需改变使用Claude Code的习惯,只需在工具中配置企业统一LLM网关的API Base URL和企业分配的API Key,即可发起AI代码生成请求。这一步实现了AI调用的统一入口配置,为后续管控奠定基础。

第二步,网关完成多维度管控并生成trace_id。当开发者发起请求后,网关会首先进行用户鉴权,验证API Key的合法性,确保只有企业内部授权用户才能发起AI调用;随后进行QPS限流,避免单个用户过度调用AI模型,影响系统性能;接着进行敏感词检测,拦截包含敏感信息或违规指令的请求;最后生成全局唯一的trace_id,并记录相关日志,包括用户信息、请求时间、提示词等。

第三步,网关转发请求并返回带trace_id的代码。网关完成管控操作后,将请求转发至第三方大模型(如Claude、GPT),大模型生成代码后,网关会在代码末尾自动追加// trace-id: xxx注释,实现代码与trace_id的绑定,为后续追溯提供标识。

第四步,开发者编写、修改代码并执行Git提交。开发者拿到AI生成的代码后,可以根据实际需求进行修改、完善,然后执行git add .和git commit命令,提交代码至本地Git仓库。

第五步,pre-commit钩子强制校验trace_id。在代码提交过程中,pre-commit钩子会自动提取代码中的trace_id,然后调用网关的审计查询接口,校验trace_id的合法性。如果trace_id无效或不存在,钩子会直接拒绝提交,并提示开发者整改,确保只有合规的AI代码才能提交。

第六步,post-commit自动写入AI元数据。代码提交成功后,post-commit钩子会自动提取trace_id、当前用户邮箱、使用的AI模型等信息,将其封装为元数据,写入Git Notes中。Git Notes的优势在于不会污染代码本身和提交记录,能够实现元数据与代码的分离存储,同时不影响研发人员的正常Git操作。

第七步,管理员进行审计与溯源操作。管理员可以通过trace_id查询网关日志,获取AI调用的完整信息,包括提示词、请求时间、返回结果等;也可以通过自研的git-ai-blame工具,查看代码中每一行的归属,区分是人工编写还是AI生成,以及对应的trace_id和模型信息,实现行级溯源。

三、核心组件设计:自研可控,无第三方依赖

方案的核心竞争力在于“完全自研、不依赖GitAI”,所有核心组件均基于企业常用技术栈开发,确保企业能够自主掌控,避免第三方依赖带来的安全风险和扩展性问题。核心组件主要包括企业统一LLM网关、自研AI代码追溯系统和研发侧工具链三部分,每一部分都具备明确的定位和核心能力。

3.1 企业统一LLM网关:AI调用的“安全守门人”

企业统一LLM网关是整个方案的核心管控入口,定位为所有AI调用的统一入口、安全管控与审计中心,负责对所有AI调用进行集中管控、日志记录和请求转发,确保AI调用的安全、合规、可控。

3.1.1 网关核心能力

网关具备八大核心能力,覆盖AI调用的全流程管控,满足企业的安全与合规需求。

一是接口兼容能力。网关兼容Claude、OpenAI等主流第三方大模型的标准接口,如/v1/messages、/v1/chat/completions等,研发人员无需修改AI编码工具的配置,只需更换API Base URL和API Key,即可实现无感知切换,避免因接口不兼容带来的使用不便。

二是用户鉴权能力。网关采用企业统一API Key鉴权机制,每个研发人员分配唯一的API Key,绑定用户身份信息,确保只有授权用户才能发起AI调用,杜绝非法调用行为。

三是配额与限流能力。通过Redis实现用户级别的QPS限流,企业可以根据研发人员的岗位、项目需求,设置不同的调用配额,避免单个用户过度调用AI模型,导致系统性能下降或第三方模型费用超标。

四是敏感词检测与指令拦截能力。网关内置敏感词库,涵盖企业敏感信息如密钥、密码、token等和违规指令,能够实时检测请求中的提示词,一旦发现包含敏感词或违规指令,立即拦截请求,并记录相关日志,防范敏感数据泄露和违规行为。

五是trace_id生成与绑定能力。网关为每一次AI调用生成全局唯一的trace_id,采用UUID格式,确保不重复、可唯一标识每一次请求,并将trace_id与请求信息、返回代码进行绑定,为后续追溯提供核心标识。

六是全量日志留存能力。网关会记录每一次AI调用的完整日志,包括trace_id、用户信息、请求时间、提示词、返回状态、模型类型等,日志留存时间不低于180天,满足企业合规审计需求。

七是代码注释追加能力。网关在将大模型返回的代码转发给开发者时,会自动在代码末尾追加// trace-id: xxx注释,实现代码与trace_id的强制绑定,确保每一段AI生成的代码都有可追溯标识。

八是审计查询接口能力。网关提供/api/trace/{trace_id}审计查询接口,管理员可以通过该接口,根据trace_id查询对应的AI调用日志,实现审计追溯。

3.1.2 网关技术栈与完整代码

网关采用轻量级、高性能的技术栈开发,确保转发效率和系统稳定性,具体技术栈为FastAPI + httpx + Redis + MySQL/ELK。其中,FastAPI负责构建网关接口,具备高性能、易开发的优势;httpx负责异步转发请求,提升转发效率;Redis用于实现限流和日志缓存;MySQL/ELK用于日志的持久化存储和查询,满足大规模日志管理需求。

为了确保方案的可落地性,我们提供了网关的完整可运行代码,研发人员可以直接基于该代码进行修改、部署,无需从零开发。完整代码如下:

from fastapi import FastAPI, Request, Response

import uuid

import httpx

import re

import datetime

import redis

app = FastAPI(title="企业统一LLM网关")

r = redis.Redis(host="127.0.0.1", port=6379, db=0, decode_responses=True)

# 企业配置

SENSITIVE_WORDS = ["密钥", "密码", "token", "secret", "内部地址", "隐私数据"]

MODEL_TARGET = "https://api.anthropic.com/v1"

USER_KEYS = {"sk-company-xxxx": "zhangsan@company.com"}

LOG_KEEP_DAYS = 180

@app.api_route("/{path:path}", methods=["GET", "POST", "PUT", "DELETE"])

async def proxy(request: Request, path: str):

trace_id = str(uuid.uuid4())

now = datetime.datetime.now().strftime("%Y-%m-%d %H:%M:%S")

# 1. 鉴权

auth = request.headers.get("Authorization", "")

if not auth.startswith("Bearer "):

return Response("未授权", 401)

key = auth.split()[-1]

if key not in USER_KEYS:

return Response("无效密钥", 401)

user = USER_KEYS[key]

# 2. 限流

rk = f"rate:{user}"

if r.incr(rk) > 10:

return Response("请求超限", 429)

r.expire(rk, 1)

# 3. 读取请求

try:

body = await request.json()

except:

body = {}

prompt = ""

if "messages" in body:

prompt = " ".join(m.get("content", "") for m in body["messages"])

if "prompt" in body:

prompt = body["prompt"]

# 4. 敏感词拦截

for w in SENSITIVE_WORDS:

if w in prompt:

log = {"trace_id": trace_id, "user": user, "action": "block", "reason": f"敏感词:{w}", "time": now}

r.hset(f"trace:{trace_id}", mapping=log)

r.expire(f"trace:{trace_id}", LOG_KEEP_DAYS * 86400)

return Response(f"包含敏感词:{w}", 403)

# 5. 转发请求

target = f"{MODEL_TARGET}/{path}"

headers = {k: v for k, v in request.headers.items() if k.lower() != "host"}

async with httpx.AsyncClient(timeout=120) as client:

resp = await client.request(method=request.method, url=target, headers=headers, json=body)

# 6. 插入trace注释

content = resp.text

if resp.status_code == 200:

content += f"\n// trace-id: {trace_id}"

# 7. 记录日志

log = {

"trace_id": trace_id, "user": user, "model": "claude",

"status": resp.status_code, "prompt": prompt[:500], "time": now

}

r.hset(f"trace:{trace_id}", mapping=log)

r.expire(f"trace:{trace_id}", LOG_KEEP_DAYS * 86400)

return Response(content=content, status_code=resp.status_code, headers={"X-Git-AI-Trace": trace_id})

# 审计查询接口

@app.get("/api/trace/{trace_id}")

def get_trace(trace_id: str):

data = r.hgetall(f"trace:{trace_id}")

return data if data else {"code": 404, "msg": "未找到"}

if __name__ == "__main__":

import uvicorn

uvicorn.run(app, host="0.0.0.0", port=8000)

上述代码已经实现了网关的所有核心功能,企业可以根据自身需求,修改敏感词库、第三方模型地址、用户API Key、限流阈值等配置,适配企业的实际场景。例如,敏感词库可以根据企业的业务特点,增加更多行业相关的敏感词汇;第三方模型地址可以替换为企业常用的大模型接口,如GPT的接口地址等。

3.1.3 网关Docker部署流程

为了方便企业快速部署网关,我们提供了Docker部署方案,无需复杂的环境配置,只需执行简单的命令,即可完成网关的部署和启动。具体部署步骤如下:

首先,创建Dockerfile文件,内容如下:

FROM python:3.10-slim

WORKDIR /app

RUN pip install fastapi uvicorn httpx redis

COPY gateway.py .

EXPOSE 8000

CMD ["uvicorn", "gateway:app", "--host", "0.0.0.0", "--port", "8000"]

然后,执行以下Docker命令,构建镜像并启动容器:

docker build -t llm-gateway .

docker run -d --net=host --name llm-gateway llm-gateway

其中,docker build -t llm-gateway .命令用于构建网关镜像,镜像名称为llm-gateway;docker run -d --net=host --name llm-gateway llm-gateway命令用于启动容器,--net=host参数表示容器使用主机网络,确保网关能够被研发终端访问,-d参数表示后台运行容器。

部署完成后,企业可以通过http://网关IP:8000访问网关,验证网关是否正常运行。如果需要扩展网关的处理能力,可以通过K8s实现水平扩展,部署多个网关实例,满足高并发调用需求。

3.2 自研AI代码追溯系统:AI代码的“溯源管家”

自研AI代码追溯系统是方案的核心追溯组件,定位为替代GitAI,实现AI代码的行级溯源与提交管控,核心目标是解决AI代码无记录、无归属、无追溯的问题,同时确保不污染代码和提交记录,兼容Git的所有操作。

3.2.1 追溯系统核心能力

追溯系统具备五大核心能力,覆盖AI代码从提交到溯源的全流程,确保代码的可追溯性和合规性。

一是元数据分离存储能力。采用Git Notes存储AI代码的元数据,包括trace_id、用户信息、模型类型等,Git Notes是Git的一个内置功能,能够在不修改代码、不影响提交记录的前提下,存储额外的元数据,实现元数据与代码的分离,避免污染代码本身。

二是提交强制校验能力。通过pre-commit钩子,在代码提交时强制校验trace_id的合法性,只有通过校验的代码才能提交,确保所有AI生成的代码都有合法的追溯标识,杜绝无trace_id的AI代码入库。

三是元数据自动写入能力。通过post-commit钩子,在代码提交成功后,自动提取trace_id、用户、模型等信息,写入Git Notes中,无需研发人员手动操作,降低研发人员的工作负担。

四是行级溯源能力。自研git-ai-blame命令,能够展示代码中每一行的归属信息,区分是人工编写还是AI生成,同时显示对应的trace_id、模型信息等,实现行级精准溯源,方便管理员排查问题、审计代码。

五是Git操作兼容性能力。完全兼容Git的所有操作,包括rebase、merge、reset等,在执行这些操作时,不会丢失AI元数据和trace_id关联信息,确保追溯系统的稳定性和可用性。

3.2.2 追溯系统技术栈与核心脚本

追溯系统的技术栈简洁、易用,基于Git Hooks + Shell + Python3 + Git Notes开发,无需引入复杂的第三方组件,确保研发终端能够快速安装和使用。核心脚本包括研发终端一键安装脚本、pre-commit钩子脚本、post-commit钩子脚本和git-ai-blame脚本,每一个脚本都具备明确的功能,可直接部署使用。

(1)研发终端一键安装脚本

为了方便研发人员快速安装追溯系统相关工具,我们提供了一键安装脚本,研发人员只需执行以下命令,即可完成依赖安装和自研溯源命令的部署:

# 安装依赖

apt install -y jq git python3

# 安装自研溯源命令

curl -s http://网关IP/tools/git-ai-blame -o /usr/local/bin/git-ai-blame

chmod +x /usr/local/bin/git-ai-blame

其中,apt install -y jq git python3命令用于安装依赖工具,jq用于处理JSON格式的元数据,git用于版本管理,python3用于运行git-ai-blame脚本;curl命令用于从网关下载git-ai-blame脚本,并设置可执行权限,确保研发人员能够直接使用git-ai-blame命令。

(2)项目初始化脚本

对于企业的每一个Git项目,需要执行一次项目初始化操作,将pre-commit和post-commit钩子脚本部署到项目的.git/hooks目录下,具体命令如下:

cd 项目目录

curl -s http://网关IP/tools/pre-commit -o .git/hooks/pre-commit

curl -s http://网关IP/tools/post-commit -o .git/hooks/post-commit

chmod +x .git/hooks/pre-commit .git/hooks/post-commit

初始化完成后,该项目的所有代码提交操作,都会自动触发pre-commit和post-commit钩子,实现trace_id校验和元数据写入。

(3)pre-commit钩子脚本(提交强制校验)

pre-commit钩子脚本的核心功能是在代码提交时,提取代码中的trace_id,并调用网关的审计查询接口,校验trace_id的合法性,无效则拒绝提交。脚本内容如下:

#!/bin/bash

set -e

GATEWAY="http://网关IP:8000"

# 提取trace-id

FILES=$(git diff --cached --name-only)

TRACE=$(grep -r "trace-id: [a-f0-9\-]*" $FILES | awk '{print $2}' | head -1)

if [ -n "$TRACE" ]; then

RES=$(curl -s "$GATEWAY/api/trace/$TRACE")

if [[ "$RES" != *"trace_id"* ]]; then

echo "❌ 无效trace_id,禁止提交"

exit 1

fi

echo "✅ AI代码校验通过:$TRACE"

fi

exit 0

脚本的执行逻辑如下:首先,获取当前提交的所有文件;然后,从文件中提取trace_id;如果存在trace_id,调用网关的审计查询接口,查询该trace_id是否有效;如果查询结果中不包含trace_id字段,说明该trace_id无效,输出错误提示并拒绝提交;如果有效,输出校验通过提示,允许提交。

(4)post-commit钩子脚本(元数据自动写入)

post-commit钩子脚本的核心功能是在代码提交成功后,自动提取trace_id、用户、模型等元数据,写入Git Notes中,脚本内容如下:

#!/bin/bash

COMMIT=$(git rev-parse HEAD)

USER=$(git config user.email)

FILES=$(git diff --name-only HEAD^1)

TRACE=$(grep -r "trace-id: [a-f0-9\-]*" $FILES | awk '{print $2}' | head -1)

if [ -n "$TRACE" ]; then

META=$(jq -n --arg t "$TRACE" --arg u "$USER" --arg m "claude" '{"trace_id":$t,"author":$u,"model":$m}')

git notes --ref=ai-meta add -m "$META" $COMMIT

echo "✅ AI元数据已保存:$TRACE"

fi

exit 0

脚本的执行逻辑如下:首先,获取当前提交的commit ID、当前用户的邮箱、提交的文件列表;然后,从文件中提取trace_id;如果存在trace_id,使用jq工具构建包含trace_id、用户、模型的JSON格式元数据;最后,将元数据写入Git Notes的ai-meta分支,确保元数据的分类存储,同时输出保存成功提示。

(5)git-ai-blame脚本(行级溯源)

git-ai-blame脚本是自研的行级溯源工具,能够展示代码中每一行的归属信息,区分人工编写和AI生成,脚本内容如下:

#!/usr/bin/env python3

import subprocess

import json

import sys

def show_blame(filepath):

lines = subprocess.check_output(["git", "blame", "-l", filepath]).decode().splitlines()

for line in lines:

commit = line.split(" ")[0]

meta = subprocess.run(

["git", "notes", "--ref=ai-meta", "show", commit],

capture_output=True, text=True

).stdout.strip()

if meta:

d = json.loads(meta)

print(f"{commit[:8]} AI {d['trace_id'][:8]} {line}")

else:

print(f"{commit[:8]} 人 {line}")

if __name__ == "__main__":

show_blame(sys.argv[1])

使用方法非常简单,研发人员或管理员只需在终端执行git-ai-blame 文件名,即可查看该文件每一行的归属信息。例如,执行git-ai-blame main.py,会输出每一行代码的commit ID、归属类型(AI或人)、trace_id(仅AI生成代码有)和代码内容,方便快速定位代码来源。

3.3 研发侧工具链:无侵入适配,零学习成本

方案的研发侧工具链完全基于企业现有工具,无需引入新的工具,确保研发人员能够快速适应,实现零学习成本。具体工具要求如下:

IDE方面,支持IDEA 2020及以上版本,兼容原生Git插件,研发人员无需修改IDE的配置,只需正常使用Git插件进行代码提交即可。

AI编码工具方面,支持Claude Code最新版,该工具支持自定义API Base配置,能够轻松适配企业统一LLM网关。此外,方案也兼容Cursor、Copilot等主流AI编码工具,只需在工具中配置网关的API Base URL和企业API Key即可。

版本管理工具方面,要求Git版本≥2.20.0,确保Git Notes功能正常使用,同时兼容pre-commit和post-commit钩子脚本的执行。

四、详细实施方案:一步一步落地,确保可执行

为了确保方案能够快速落地、顺利执行,我们将实施方案拆解为环境准备、网关建设、研发侧配置、追溯系统部署四个核心环节,每个环节都提供详细的操作步骤和注意事项,企业可以按照步骤逐步实施,无需专业的技术团队,也能完成部署。

4.1 环境准备:明确要求,提前部署

环境准备是方案落地的基础,需要提前部署好相关组件,确保各组件满足要求,能够正常协同工作。具体组件要求和部署方式如下表所示:

| 组件 | 要求 | 部署方式 |

|---|---|---|

| LLM网关 | Python 3.9+、Redis、MySQL | Docker/K8s服务器部署 |

| Git | ≥2.20.0 | 研发终端预装 |

| IDEA | 2020~最新版 | 研发本地 |

| Claude Code | 最新版(支持API Base配置) | 研发本地 |

| 自研工具 | jq、Python3 | 研发终端一键安装 |

| 需要注意的是,Redis和MySQL需要提前部署好,确保网关能够正常连接;研发终端需要提前安装好Git、IDEA、Claude Code等工具,并更新到符合要求的版本;自研工具将通过一键安装脚本部署,无需手动配置。 |

4.2 企业LLM网关建设:从代码到部署,全程可落地

企业LLM网关的建设分为核心功能确认、代码部署、验证测试三个步骤,确保网关能够正常运行,实现对AI调用的统一管控。

第一步,确认网关核心功能。在部署网关之前,企业需要根据自身需求,修改网关代码中的配置信息,包括敏感词库、第三方模型地址、用户API Key、限流阈值、日志留存时间等。例如,将SENSITIVE_WORDS列表修改为企业自身的敏感词,将MODEL_TARGET修改为企业常用的第三方大模型接口地址,将USER_KEYS修改为企业研发人员的API Key和对应的邮箱信息,将LOG_KEEP_DAYS修改为符合企业合规要求的日志留存时间。

第二步,部署网关代码。按照前文提供的Docker部署流程,构建网关镜像并启动容器。部署完成后,通过http://网关IP:8000/docs访问FastAPI的自动生成文档,验证网关接口是否正常。例如,访问/api/trace/{trace_id}接口,输入一个无效的trace_id,应返回404提示;输入一个有效的trace_id(可通过发起一次AI调用生成),应返回对应的日志信息。

第三步,验证网关管控功能。发起一次包含敏感词的AI调用,网关应拦截请求并返回敏感词提示;发起多次AI调用,超过限流阈值后,网关应返回请求超限提示;验证代码返回时是否自动追加trace_id注释,确保trace_id能够正常绑定。

4.3 研发侧配置:简单操作,无感知适配

研发侧配置主要是在Claude Code中配置网关代理,无需修改其他工具的配置,操作简单,研发人员可快速完成。具体配置步骤如下:

-

打开Claude Code工具,进入设置界面;

-

找到“API设置”选项,点击进入;

-

在“API Base URL”中输入企业统一LLM网关的地址,格式为

http://网关IP:8000; -

在“API Key”中输入企业统一分配的API Key,如sk-company-xxxx;

-

在“模型”中选择claude-3-opus(或企业常用的其他模型);

-

保存配置,完成设置。

配置完成后,研发人员在Claude Code中生成代码时,代码末尾会自动携带// trace-id: xxx注释,例如:

def calculate_sum(a, b):

return a + b

// trace-id: 550e8400-e29b-41d4-a716-446655440000

需要注意的是,研发人员必须使用企业分配的API Key,否则无法通过网关鉴权,无法发起AI调用;API Base URL必须正确配置,否则请求无法转发至网关。

4.4 自研AI代码追溯系统部署:终端安装+项目初始化

追溯系统的部署分为研发终端一键安装和项目初始化两个步骤,所有研发终端都需要执行安装操作,每个Git项目都需要执行初始化操作。

第一步,研发终端一键安装。所有研发人员在自己的终端上,执行前文提供的一键安装脚本,完成依赖工具和git-ai-blame命令的安装。安装完成后,在终端输入git-ai-blame --help,如果能够正常显示帮助信息,说明安装成功。

第二步,项目初始化。对于企业的每一个Git项目,研发人员需要进入项目目录,执行前文提供的项目初始化脚本,将pre-commit和post-commit钩子脚本部署到项目的.git/hooks目录下。初始化完成后,可通过以下方式验证钩子是否生效:

-

创建一个包含无效trace_id注释的代码文件,如

// trace-id: invalid; -

执行

git add .和git commit -m "test: invalid trace_id",此时pre-commit钩子应拦截提交,输出“无效trace_id,禁止提交”提示; -

修改代码文件,使用网关生成的有效trace_id,再次执行提交操作,此时pre-commit钩子应校验通过,post-commit钩子应自动写入元数据,输出“AI元数据已保存:xxx”提示;

-

执行

git-ai-blame 文件名,查看代码行归属信息,确认能够正常显示AI标识和trace_id。

需要注意的是,项目初始化操作只需执行一次,后续所有提交操作都会自动触发钩子脚本;如果Git项目已经存在pre-commit或post-commit钩子,需要先备份原有钩子,再部署新的钩子脚本,避免冲突。

五、全流程使用说明:研发与管理双视角,简单易用

方案落地后,研发人员和管理员的操作流程都非常简单,无需复杂的学习,即可快速上手。下面分别从研发日常操作和管理员审计操作两个视角,详细说明全流程使用方法。

5.1 研发日常操作:不改变习惯,轻松适配

研发人员的日常操作与之前使用AI编码工具的流程基本一致,只是增加了trace_id校验和溯源查看两个简单步骤,不影响研发效率。具体操作流程如下:

-

生成AI代码:在Claude Code中输入提示词,发起AI代码生成请求,生成的代码会自动携带

// trace-id: xxx注释。研发人员可以根据实际需求,对代码进行修改、完善,无需删除trace_id注释。 -

提交代码:完成代码编写和修改后,执行

git add .命令,将代码添加到暂存区;然后执行git commit -m "提交说明"命令,提交代码。此时,pre-commit钩子会自动校验trace_id的合法性,如果有效,提交成功;如果无效,拒绝提交,研发人员需要检查trace_id是否正确,或重新生成AI代码获取有效trace_id。 -

查看溯源信息:如果需要查看代码的归属信息,执行

git-ai-blame 文件名命令,即可查看该文件每一行的归属,区分人工编写和AI生成,以及对应的trace_id和模型信息。例如,执行git-ai-blame main.py,输出如下:

a1b2c3d4 人 def calculate_sum(a, b):

a1b2c3d4 AI 550e8400 return a + b

a1b2c3d4 AI 550e8400 // trace-id: 550e8400-e29b-41d4-a716-446655440000

从输出结果可以看出,第一行是人工编写的代码,第二行和第三行是AI生成的代码,对应的trace_id为550e8400(完整trace_id的前8位)。

需要注意的是,研发人员不能随意修改或删除代码中的trace_id注释,否则会导致pre-commit校验失败,无法提交代码;如果代码被多人修改,trace_id注释应保留,确保代码的可追溯性。

5.2 管理员审计操作:一键追溯,合规可控

管理员的核心职责是审计AI代码的使用情况、追溯问题代码的来源、统计AI代码使用量,确保企业AI编码合规。具体操作方法如下:

- 根据trace_id查询审计日志:如果需要查询某一段AI代码的生成过程,获取trace_id后,执行以下命令,即可查询对应的AI调用日志:

curl http://网关IP:8000/api/trace/xxx

其中,xxx为完整的trace_id。查询结果会返回该trace_id对应的用户信息、请求时间、提示词、返回状态、模型类型等,例如:

{

"trace_id": "550e8400-e29b-41d4-a716-446655440000",

"user": "zhangsan@company.com",

"model": "claude",

"status": "200",

"prompt": "编写一个计算两个数之和的函数",

"time": "2026-04-04 10:00:00"

}

通过这些信息,管理员可以清晰地了解该段AI代码的生成背景和过程,实现审计追溯。

-

查看代码行归属:如果需要排查某一段代码的来源,执行

git-ai-blame 文件名命令,即可查看该文件每一行的归属信息,区分人工编写和AI生成,以及对应的trace_id。如果发现问题代码是AI生成的,可以通过trace_id查询对应的日志,定位责任人。 -

统计AI代码使用量:如果需要统计企业内部AI代码的使用情况,执行以下命令,即可统计当前项目中AI生成代码的数量:

grep -r "trace-id:" ./ | wc -l

该命令会搜索当前目录下所有包含trace-id:注释的代码行,并统计数量,从而反映AI编码工具的使用频率和范围。管理员可以根据统计结果,优化AI编码工具的使用策略,合理分配调用配额。

六、关键保障措施:确保方案稳定运行,满足合规要求

方案的落地不仅需要完善的技术设计,还需要健全的保障措施,确保方案能够稳定运行,满足企业的安全、兼容和性能需求,同时符合行业监管要求。我们从安全、兼容性、性能三个维度,制定了关键保障措施。

6.1 安全保障:多重防护,杜绝风险

安全是方案的核心需求,我们通过多重防护措施,从源头防范敏感数据泄露、违规调用等风险,确保AI编码的安全可控。

一是统一入口管控。所有AI调用必须经过企业统一LLM网关,禁止任何形式的直连第三方模型,从源头阻断非法调用和敏感数据泄露的通道。网关会对每一次请求进行严格鉴权,只有授权用户才能发起调用,杜绝非法访问。

二是敏感词实时拦截。网关内置敏感词库,能够实时检测请求中的提示词,一旦发现包含敏感信息或违规指令,立即拦截请求,并记录相关日志,确保敏感数据不会被发送到第三方大模型服务器。同时,企业可以根据自身业务特点,定期更新敏感词库,提升拦截精度。

三是元数据安全存储。AI元数据存储在Git Notes中,与代码分离,且Git仓库由企业自主管控,确保元数据的安全,避免元数据泄露或被篡改。同时,Git Notes支持权限管理,只有授权管理员才能查看和修改元数据,进一步提升安全性。

四是提交强制校验。pre-commit钩子强制校验trace_id的合法性,确保所有AI生成的代码都有合法的追溯标识,无trace_id的AI代码无法提交入库,避免违规代码进入企业代码仓库。

五是日志留存与审计。网关日志留存时间不低于180天,涵盖每一次AI调用的完整信息,管理员可以随时查询、审计,满足企业内控与行业监管的合规要求。同时,日志采用加密存储,防止日志被篡改或泄露。

6.2 兼容性保障:无侵入适配,不影响研发效率

方案的兼容性是确保方案能够快速落地推广的关键,我们通过无侵入设计,确保方案能够兼容企业现有研发工具和流程,不改变研发人员的使用习惯,零学习成本、零改造成本。

一是兼容原生工具操作。方案完全兼容IDEA、Git等企业常用研发工具的原生操作,研发人员无需修改操作习惯,只需正常使用工具即可,无需学习新的操作方法。例如,Git的rebase、merge、reset等操作,不会影响AI元数据和trace_id的关联信息,确保追溯链路的完整性,即便代码经过多轮迭代、分支合并,每一段AI生成代码的trace_id和元数据依然能够准确关联,不会出现追溯断裂的情况。同时,IDEA等IDE的代码编辑、调试、提交等核心操作不受任何影响,研发人员无需额外安装插件或修改IDE配置,即可无缝适配方案。

二是多AI工具适配兼容。方案不仅支持Claude Code,还兼容Cursor、Copilot等主流AI编码工具,只需在对应工具中简单配置企业统一LLM网关的API Base URL和企业分配的API Key,即可实现无感知切换,无需研发人员学习不同工具的适配方法。无论研发人员习惯使用哪种AI编码工具,都能纳入统一管控与追溯体系,避免因工具差异导致的管控盲区,同时最大限度保留研发人员的使用偏好,降低方案落地的抵触情绪。

三是适配现有研发流程。方案无需对企业现有研发流程进行大规模改造,无论是需求开发、代码编写、提交审核,还是版本管理、上线部署,都能与方案无缝衔接。例如,代码提交环节的pre-commit、post-commit钩子,会自动嵌入现有Git提交流程,无需研发人员额外执行操作;管理员的审计、溯源操作,也可融入企业现有合规审计流程,无需新增独立的操作环节,确保方案落地不会打乱企业既定的研发节奏,实现效率与管控的双向兼顾。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献61条内容

已为社区贡献61条内容

所有评论(0)