7B、14B、80B大模型参数量解析:性能、成本与选择全攻略!

本文解析了7B、14B、80B大模型参数量代表的含义及其对模型能力、资源消耗、训练与推理成本的影响。参数量越大,模型表达能力越强,但资源需求与成本也越高。7B适合轻量级任务与低预算场景,14B兼顾性能与成本,80B适用于追求顶尖性能的大型企业或研究机构。选择时应综合考量任务需求、硬件条件和预算限制。

大模型中的 7B、14B、80B 指的是模型的参数量,B 代表 Billion(十亿),即 70 亿、140 亿、800 亿个参数。参数是神经网络中可学习的权重和偏置,参数量越大,模型的容量(表达能力)通常越强,但也意味着更高的计算资源需求和成本。

以下是它们的主要区别:

1. 模型能力

7B 模型:参数量较少,适合一般性对话、文本生成、分类等任务。在专业领域或复杂推理上可能不如大模型精准,但通过微调也能达到不错的水平。

14B 模型:中等规模,在知识密集、逻辑推理等任务上通常优于 7B,但仍需平衡资源消耗。

80B 模型:大型模型(如 LLaMA 2 70B 或同类),具备极强的语言理解、复杂推理、长上下文处理能力,能完成更精细的任务,但部署门槛高。

2. 资源消耗

| 参数规模 | 推理显存(约) | 训练所需资源 | 适用场景 |

|---|---|---|---|

| 7B | 14–20 GB(FP16) | 单卡(如 A100 40GB)可训练 | 个人开发、消费级显卡(如 RTX 4090 24GB) |

| 14B | 28–40 GB(FP16) | 多卡或大显存卡 | 小型企业、需平衡性能与成本的场景 |

| 80B | 160+ GB(FP16) | 多机多卡集群 | 大型企业、研究机构、对效果要求极高的应用 |

注:使用量化(如 4-bit)可大幅降低显存,7B 模型量化后可在 8GB 显存运行,80B 量化后约 40–50GB。

3. 训练与推理成本

训练成本:参数量每增加 10 倍,计算量约增加 10–100 倍(取决于数据量)。80B 模型的训练通常需要数千张 GPU 卡,费用高达数百万美元。

推理成本:更大模型每次生成 token 的计算量更大,API 调用费用也更高(如 OpenAI 的 GPT-4 参数量未知但远超 80B,价格显著高于 GPT-3.5)。

4. 性能差距

在相同训练数据和架构下:

7B → 14B:性能提升明显,尤其在常识推理、代码生成等任务上。

14B → 80B:跨越式提升,模型表现出更强的“涌现能力”(如复杂数学、工具使用、多步推理),但边际收益递减。

5. 如何选择

7B:适合个人实验、边缘设备、低延迟应用,或对成本敏感的场景。

14B:适合需要更高精度但资源有限的企业内部应用。

80B:适合追求 SOTA(最先进)效果、对延迟不敏感、预算充足的场景,或作为教师模型蒸馏小模型。

总结

参数量是模型规模的直接体现,7B、14B、80B 分别代表轻量级、中量级和重量级模型。选择时需根据任务难度、硬件条件、成本预算、响应速度综合权衡。随着模型压缩和推理优化技术的发展,小模型正越来越高效,但大模型在复杂任务上仍保持优势。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

给大家推荐一个大模型应用学习路线

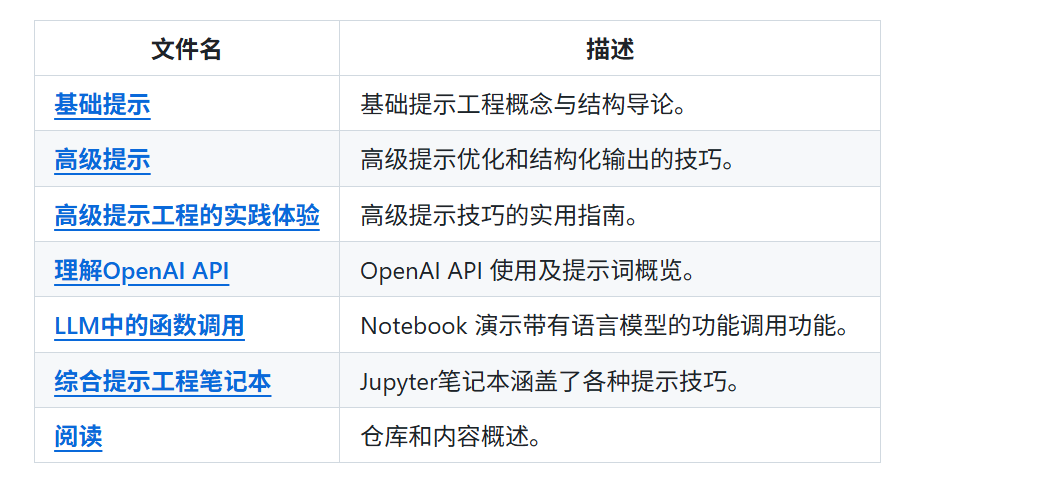

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

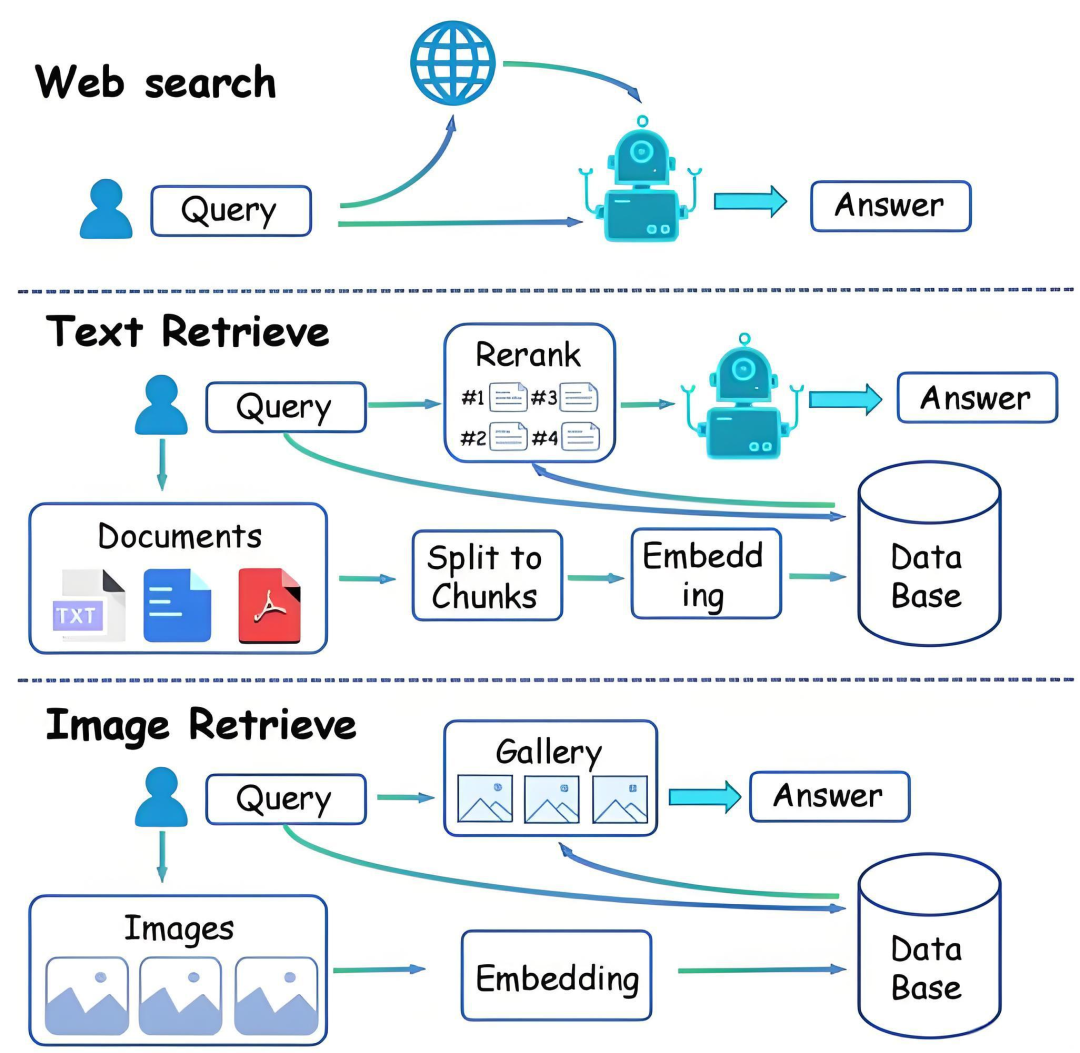

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

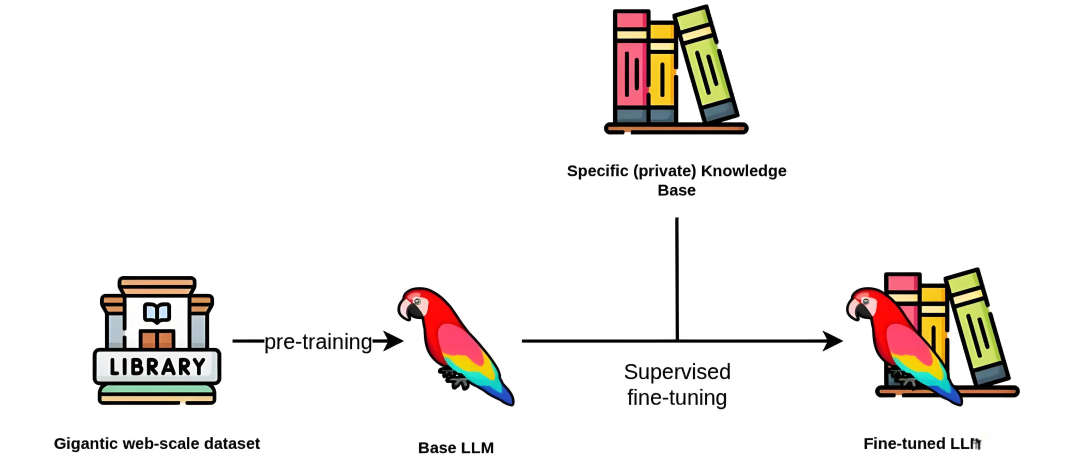

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

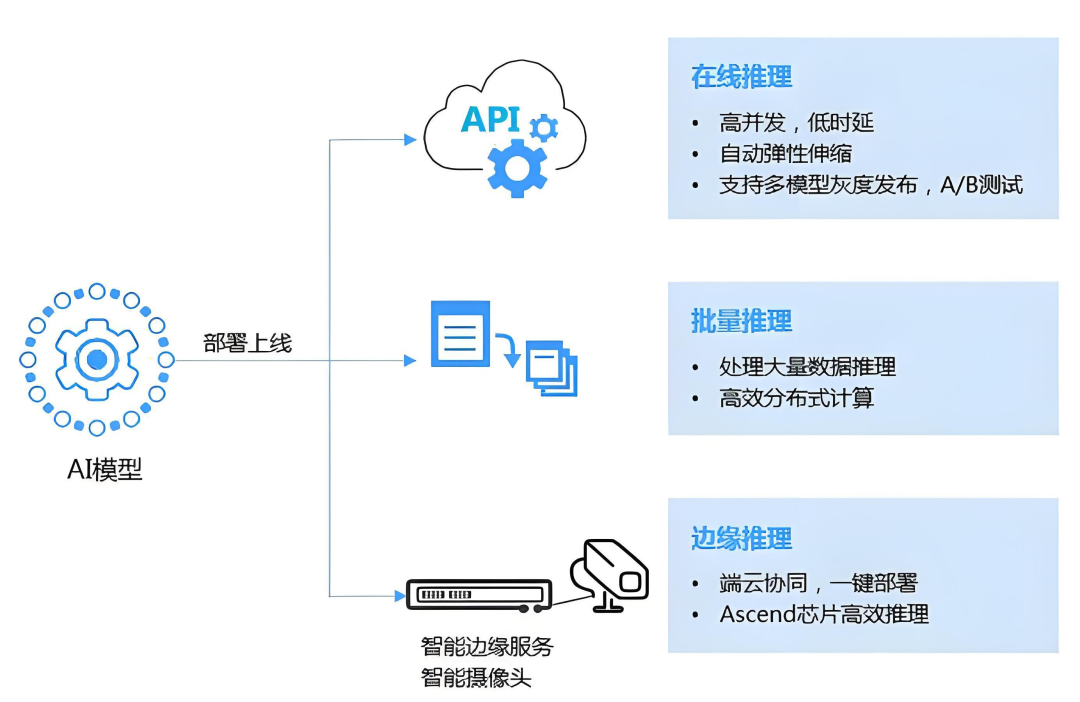

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

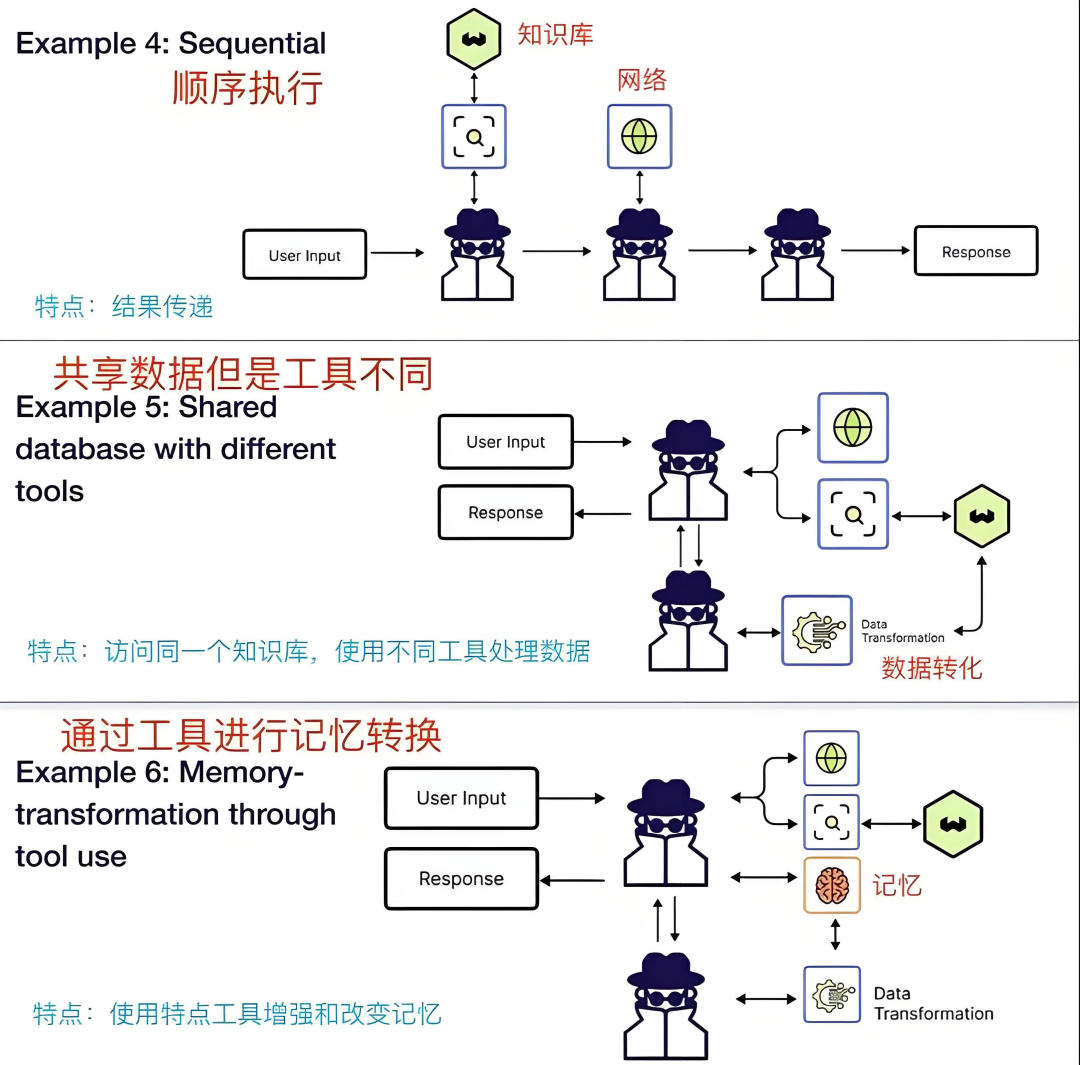

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献158条内容

已为社区贡献158条内容

所有评论(0)