多模态AI心理健康监测:从数据采集到风险预警的全栈技术解析

在当下快节奏的社会环境中,职场高压、学业负担、情绪内耗等问题日益凸显,传统心理健康监测面临筛查效率低、干预滞后、主观依赖性强、专业资源紧缺等诸多痛点。随着人工智能技术的飞速发展,多模态AI技术凭借多维度感知、客观量化分析、实时动态监测的优势,彻底打破了传统心理监测的局限,成为心理健康数字化、智能化防控的核心突破口。

本文将从全栈技术视角,深度拆解多模态AI心理健康监测系统的架构设计、数据采集、特征提取、模型融合、风险预警全流程,详解核心技术原理、算法选型与落地细节,同时做好合规保障,为心理健康智能化落地提供完整的技术参考方案。

一、多模态AI心理健康监测:核心定义与应用价值

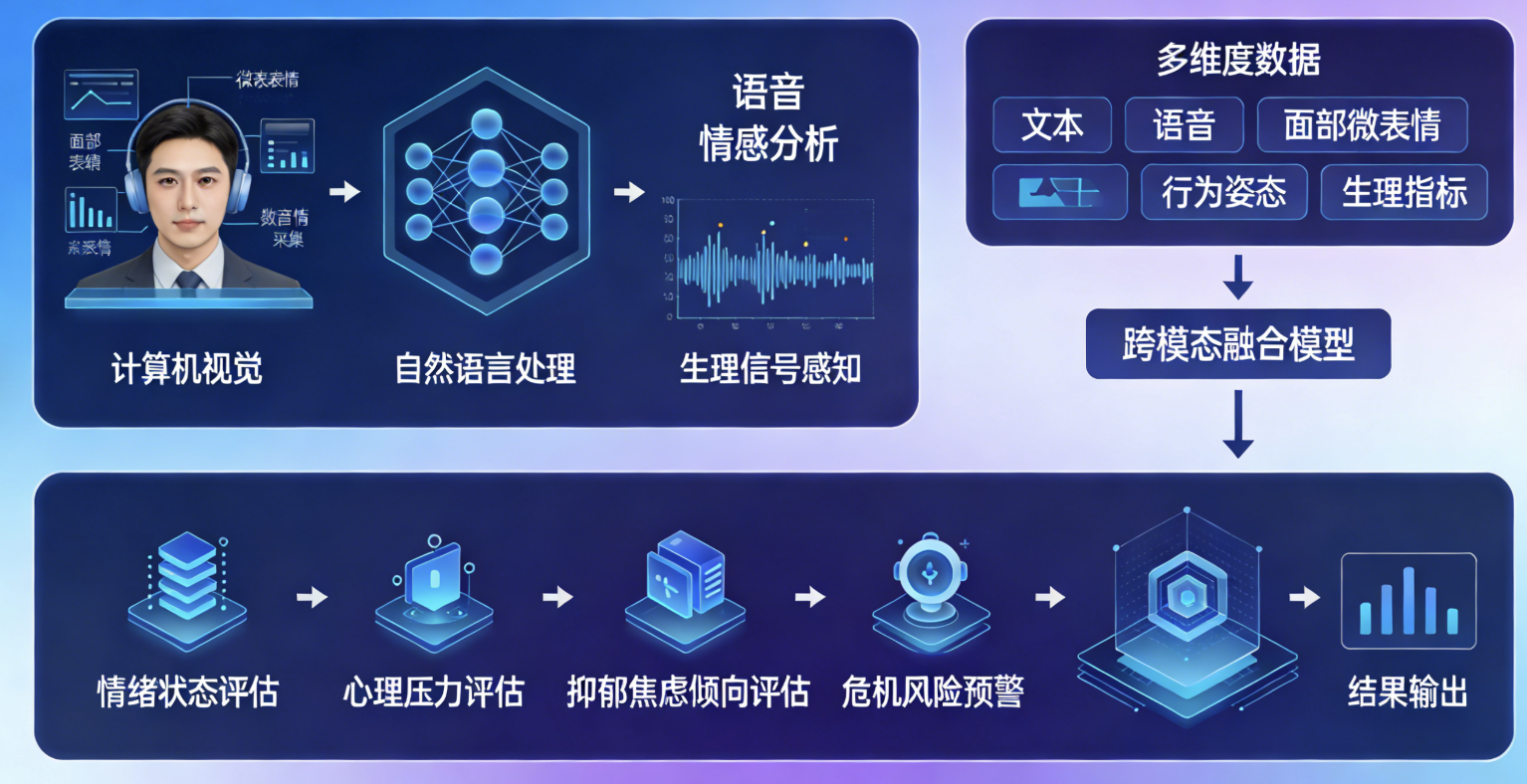

多模态AI心理健康监测,是融合计算机视觉、自然语言处理、语音情感分析、生理信号感知等多项技术,同步采集文本、语音、面部微表情、行为姿态、生理指标等多维度数据,通过跨模态融合模型,实现对个体情绪状态、心理压力、抑郁焦虑倾向的客观评估与危机风险预警。

相较于单一模态监测,多模态技术能够规避单一数据的片面性,比如单纯文本分析易受表达习惯干扰、面部识别易受刻意掩饰影响,多源数据互补后,可大幅提升监测精准度,实现无感、常态化、全周期的心理健康守护,广泛适配校园、企业、医疗、社区等多场景。

二、全栈技术架构:端-边-云协同,闭环监测预警

一套完整的多模态AI心理健康监测系统,采用分层解耦、端边云协同的架构设计,兼顾数据采集的实时性、模型运算的高效性、预警响应的及时性,整体分为四层架构,覆盖数据感知到决策预警全链路,每层各司其职且无缝衔接。

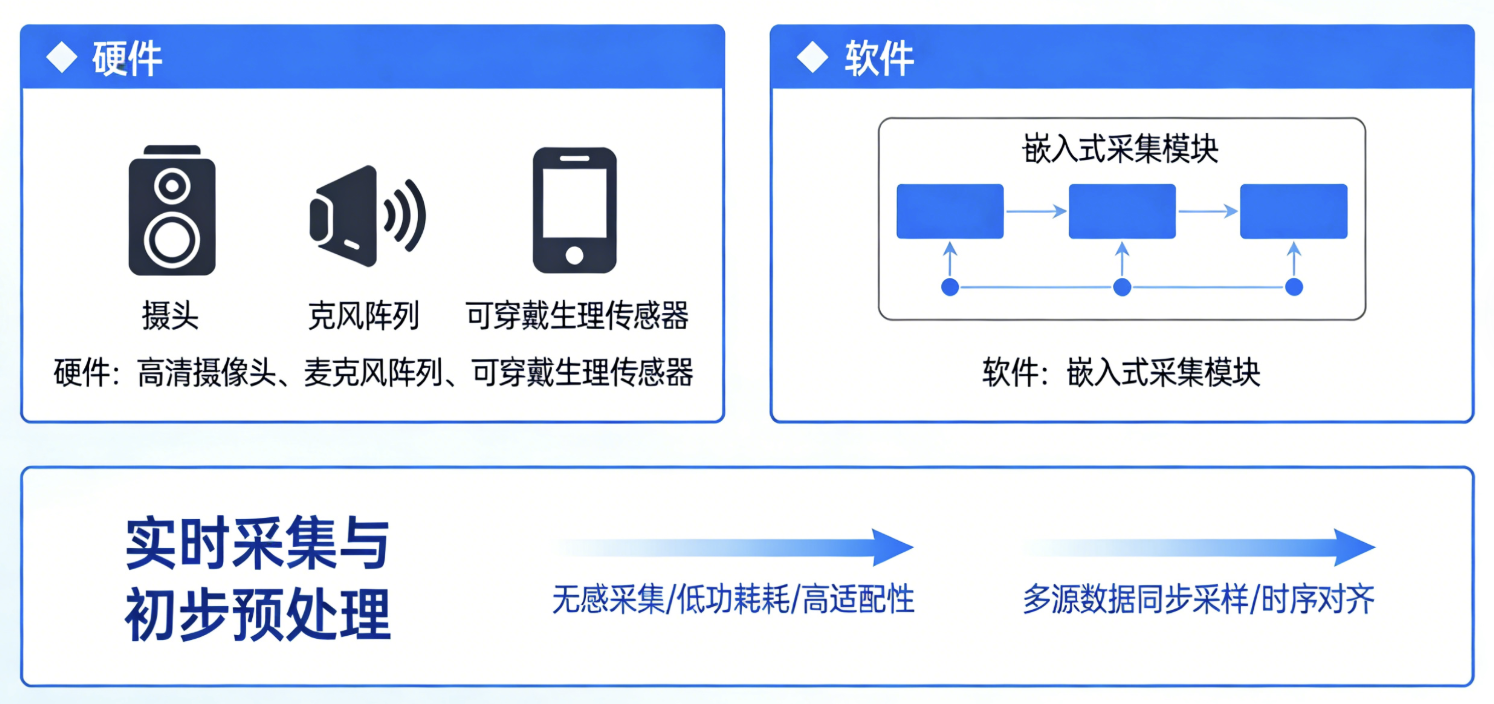

1. 终端感知层:多源数据无感采集

作为系统的数据入口,该层负责各类模态数据的实时采集与初步预处理,兼顾无感采集、低功耗、高适配性,避免给监测对象带来心理压力,保障数据的真实性。硬件层面搭载高清摄像头、麦克风阵列、可穿戴生理传感器,软件层面适配嵌入式采集模块,实现多源数据同步采样、时序对齐,杜绝数据错位。

2. 边缘计算层:本地实时推理与降噪

承接终端采集的原始数据,完成数据清洗、噪声过滤、特征初步提取,减轻云端运算压力,同时实现本地实时情绪预判,保障数据隐私,降低传输延迟,满足高频监测的实时性需求。边缘端采用轻量化推理引擎,搭载剪枝、量化后的轻量模型,实现毫秒级本地预处理与初步判定。

3. 云端融合层:核心模型训练与深度分析

汇聚边缘端上传的有效特征数据,通过多模态融合大模型进行深度运算、情感建模、风险量化,生成个体心理画像、群体心理统计报告,是整个系统的核心算力中枢。依托分布式算力集群,完成模型训练、微调、迭代与推理,结合心理诊疗标准数据做标注,提升评估专业性。

4. 应用预警层:风险告警与干预闭环

基于云端分析结果,分级触发风险预警,推送预警详情与处置建议,联动心理咨询、危机干预等流程,形成“监测-分析-预警-干预-追踪”的完整闭环。支持可视化数据看板、分级告警推送、干预记录留存、效果回溯分析,贴合实际管理需求。

三、全流程技术拆解:从数据采集到风险预警

(一)多模态数据采集:多维感知,全面捕捉心理信号

数据是AI监测的基础,多模态采集摒弃单一维度,从行为、语言、生理三大维度,全方位捕捉心理状态相关信号,保障数据的完整性与客观性,各类数据的采集原理与应用逻辑各有侧重。

1. 文本模态数据

涵盖心理咨询记录、日常社交发言、作业随笔、问卷量表、聊天对话等文本信息,通过语义层面挖掘消极情绪、负面倾向、极端想法等信号,是心理状态的直接文字体现。常用标准化量表数据(如PHQ-9抑郁筛查量表、GAD-7焦虑量表、SCL-90症状自评量表)可作为监督学习的标注数据,校准模型评估精度,贴合临床心理诊断标准。

2. 语音模态数据

采集日常对话、语音留言、朗读音频等,提取语速、语调、音量、停顿时长、音色变化、频谱熵等声学特征,其核心原理是:心理状态的变化会直接影响人体声带振动、呼吸节奏,进而反映在语音的声学参数上。心理状态异常的个体,往往伴随语速放缓、语调低沉、停顿增多、频谱熵值降低等特征,通过声学特征可精准感知压力、低落、烦躁等隐性情绪。

3. 视觉模态数据

通过摄像头无感捕捉面部微表情、眼神状态、肢体姿态,依托面部动作编码系统(FACS),拆分眉、眼、嘴、脸颊等部位的肌肉运动,捕捉皱眉、嘴角下垂、眼神呆滞、肢体僵硬等细微动作。区别于普通表情识别,微表情分析持续时间短、幅度小,更能反映真实、转瞬即逝的心理状态,识别刻意隐藏的负面情绪,核心是基于人脸关键点检测与行为帧间差分算法。

4. 生理模态数据

借助智能手环、心率传感器、皮电传感器等可穿戴设备,采集心率变异性(HRV)、皮电反应(GSR)、睡眠时长、运动频率等生理指标。其生理原理为:心理压力、焦虑情绪会触发交感神经兴奋、副交感神经抑制,直接引发心率波动、皮电阻值变化、睡眠节律紊乱,这类数据客观且难以伪装,是心理监测的硬核依据,尤其适合长期动态监测。

(二)数据预处理:清洗降噪,保障数据质量

原始多模态数据存在噪声大、格式不统一、维度不一致、时序不同步等问题,需经过标准化预处理,剔除无效数据、规整数据格式,才能送入模型训练,提升后续分析精度,避免噪声干扰模型收敛。

文本数据:完成去停用词、分词、标点过滤、大小写归一、特殊字符剔除,针对口语化、碎片化文本做规整处理,通过词嵌入预处理将文本转化为模型可识别的向量格式;

语音数据:通过维纳滤波去除环境杂音,剔除静音片段,做音频分帧、加窗、梅尔频谱变换(MFCC),提取梅尔倒谱系数等有效声学特征,消除环境噪声与采样误差;

视觉数据:完成人脸对齐、光照校准、背景剔除、图像归一化、尺度缩放,通过直方图均衡化优化图像质量,聚焦面部与行为关键区域,剔除无关背景干扰;

生理数据:采用拉依达准则剔除异常值,通过滑动平均算法平滑波动曲线,补齐缺失值,统一采样频率与数据维度,保证时序数据的连续性。

同时,严格遵循个人信息保护法,对数据进行脱敏处理,隐去个人隐私信息,采用差分隐私扰动技术,避免数据泄露风险。

(三)单模态特征提取:精准挖掘各维度心理特征

针对不同模态数据的特性,选用适配的深度学习模型,挖掘深层语义、情感、生理特征,摒弃浅层冗余信息,提取高辨识度心理表征,为后续融合分析打下基础,各模态模型原理如下。

文本特征:采用BERT、RoBERTa、ERNIE等预训练语言模型,基于Transformer架构,利用自注意力机制捕捉文本上下文语义关联,挖掘文本深层情感倾向、消极语义、认知偏差,精准识别抑郁、绝望、自责、极端想法等负面语义特征,解决文本情感歧义、隐含语义难识别的问题;

语音特征:通过CNN提取局部声学特征,搭配LSTM长短期记忆网络捕捉时序语音特征,融合两类模型优势,提取语速、韵律、音色、频谱等高阶特征,构建语音情感分类模型,区分平静、低落、焦虑、愤怒等情绪,解决语音情感时序依赖的问题;

视觉特征:采用轻量化CNN、Vision Transformer(ViT)模型,对人脸关键点、微表情、行为姿态做特征提取,通过卷积层提取局部视觉特征,注意力机制聚焦关键面部区域,精准捕捉细微情绪变化,同时保证模型轻量化,适配边缘端实时推理;

生理特征:通过LSTM/GRU时序模型,分析心率、皮电、睡眠等时序数据的波动规律、变化趋势,捕捉长期节律异常,量化心理压力指数与情绪唤醒度,适配生理数据时序性强、动态变化的特点。

(四)跨模态融合:多源特征互补,提升评估精度

跨模态特征融合是多模态AI的核心技术,解决单一模态片面性、易受干扰的问题,实现多维度特征的深度耦合,利用不同模态数据的互补性,提升模型鲁棒性与评估准确率,常用融合方式分为特征级融合、决策级融合两类,原理与适用场景各不相同。

1. 特征级融合

属于早期融合,在特征提取阶段,将各模态提取的高维特征向量进行拼接、加权融合,通过跨模态注意力机制,自动分配不同模态的特征权重,让关联性强、可信度高的模态特征占据主导,使不同模态特征相互关联、相互校正,保留完整的细节信息。该方式能最大限度挖掘数据间的关联关系,适合高精度评估场景,但算力消耗较大,多用于云端深度推理。

2. 决策级融合

属于后期融合,先通过各单模态模型完成独立评估,输出各自的情绪分类、风险评分结果,再通过加权投票、逻辑回归、D-S证据理论等方式,融合各模态的评估结果,得到最终心理状态判定。该方式运算效率高,对算力要求低,适配边缘端实时推理,落地性更强,适合大批量、实时监测场景。

通过跨模态融合,可有效规避单一模态的缺陷,比如当个体刻意隐藏表情时,语音与生理数据可弥补识别缺口,大幅提升心理状态评估的准确率与鲁棒性,避免单一数据偏差导致的误判。

(五)风险预警建模:分级预警,快速响应

基于融合后的特征与评估结果,构建心理风险分级回归与分类模型,结合临床心理评估标准、专业诊疗量表阈值,将心理状态分为正常、轻度焦虑、中度抑郁、重度危机等多个等级,通过机器学习算法训练风险阈值,实现量化评分与精准告警。

模型训练阶段,采用标注好的心理诊疗数据、量表数据作为监督标签,通过交叉熵损失函数优化模型参数,让风险评分贴合临床标准,杜绝无依据的主观判定。

常规预警:针对压力偏大、情绪低落等轻度异常,推送舒缓建议、正念训练等自助干预方案;

中度预警:针对焦虑、抑郁倾向明显的对象,提醒关注情绪状态,联动心理咨询师对接,开展疏导干预;

重度预警:针对有自伤、轻生倾向等高危对象,触发紧急告警,第一时间推送至管理人员与专业咨询师,启动极速危机干预流程,严防极端事件发生。

同时,系统支持全周期动态追踪,持续记录个体心理状态变化,留存历史数据与干预记录,形成闭环心理档案,便于跟踪干预效果、迭代优化干预方案。

四、关键技术难点与合规解决方案

1. 隐私安全难题

心理健康数据属于高度敏感的个人信息,数据采集、存储、使用全流程必须严守合规底线。解决方案:采用联邦学习框架,实现数据不出本地、模型分布式训练,做到数据可用不可见;运用差分隐私、同态加密技术,对数据做扰动处理;数据本地加密存储,传输链路采用SSL/TLS加密;严格落实知情同意原则,数据仅用于心理健康监测;完善分级权限管控,杜绝数据滥用与泄露。

2. 算法偏见问题

不同人群的表达习惯、行为特征存在差异,易导致模型识别偏差、公平性不足。解决方案:构建多元化、全覆盖的训练数据集,覆盖不同年龄、职业、性格、地域群体;引入对抗训练消除偏见因子,持续迭代优化模型,提升算法公平性;采用人工复核机制,降低算法误判漏判概率。

3. 实时性与精度平衡

兼顾监测实时性与评估精度,避免算力浪费、推理延迟。解决方案:采用端边云协同架构,边缘端做轻量化实时推理,云端做高精度深度分析;通过模型剪枝、量化、知识蒸馏等手段,压缩模型体积,优化算法算力,降低推理时延,适配大批量终端批量部署。

五、落地场景与行业展望

多模态AI心理健康监测技术,目前已在校园、企业、医疗等场景落地见效:

校园场景:常态化监测学生学业压力、情绪波动,提前预警厌学、抑郁、霸凌相关心理问题,筑牢校园心理防线,弥补专业心理师资不足的短板;

企业场景:监测员工职场压力、职业倦怠、情绪耗竭,助力企业开展人性化员工关怀,降低心理危机风险,提升团队稳定性与工作效率;

医疗场景:辅助心理医生完成初步筛查、病程追踪、康复监测,分流轻症患者,缓解专业医疗资源紧缺的问题,提升诊疗效率。

未来,随着大模型、多模态融合技术、边缘智能的持续升级,AI心理健康监测将朝着更精准、更无感、更普惠的方向发展,实现人机协同的心理健康服务新模式。AI并非取代心理咨询师,而是作为高效的筛查与预警工具,把专业人力集中到深度干预与危机疏导中,推动心理健康服务从被动救治转向主动防控、从粗放筛查转向精准施策。

六、总结

多模态AI心理健康监测,通过多维度数据感知、单模态特征挖掘、跨模态深度融合、分级风险预警,构建了全栈式、智能化的心理健康防控体系,依托深度学习、时序分析、注意力机制等核心技术,有效解决了传统监测效率低、主观性强、干预滞后的痛点,让隐性心理问题看得见、测得出、早干预。

在技术落地过程中,唯有坚守技术合规、隐私优先、人文关怀的底线,兼顾技术精度与伦理规范,才能让AI技术真正赋能心理健康领域,为校园、企业、社会搭建起坚实的数字心理防护网。

唯众深耕数字化心理健康领域,依托多模态AI、大数据分析、边缘计算等核心技术,打造集无感监测、精准评估、智能预警、闭环干预于一体的心理健康解决方案,助力各场景实现心理健康管理智能化、规范化、高效化。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)