镜像视界|城市数字孪生2.0:空间智能与AI智能体驱动全域感知革命——基于动态三维重构与轨迹张量建模的空间级目标定位与行为预测系统

镜像视界|城市数字孪生2.0:空间智能与AI智能体驱动全域感知革命

——基于动态三维重构与轨迹张量建模的空间级目标定位与行为预测系统

一、时代定义:数字孪生正在进入2.0阶段

过去几年,数字孪生技术在城市治理中迅速普及。通过三维建模与数据接入,城市被“复制”到虚拟空间,实现了可视化展示与基础管理能力。

但从实际应用来看,大多数系统仍停留在:

- 静态模型

- 数据展示

- 事后分析

👉 本质仍是:

“看得见的城市”

而真正需要的是:

- 可计算

- 可理解

- 可预测

- 可控制

👉 关键判断:

数字孪生1.0是“展示系统”,而不是“智能系统”

因此,一个新的阶段正在形成:

数字孪生2.0 —— 空间智能驱动的城市认知系统

二、核心问题:为什么城市仍然“不可计算”

当前城市系统存在三大断裂:

2.1 空间断裂

摄像头之间无统一坐标

2.2 轨迹断裂

目标跨区域丢失

2.3 行为断裂

系统无法理解行为

👉 本质问题:

城市缺少“空间坐标体系”

👉 结果:

- 数据很多

- 系统很多

- 但无法形成“认知能力”

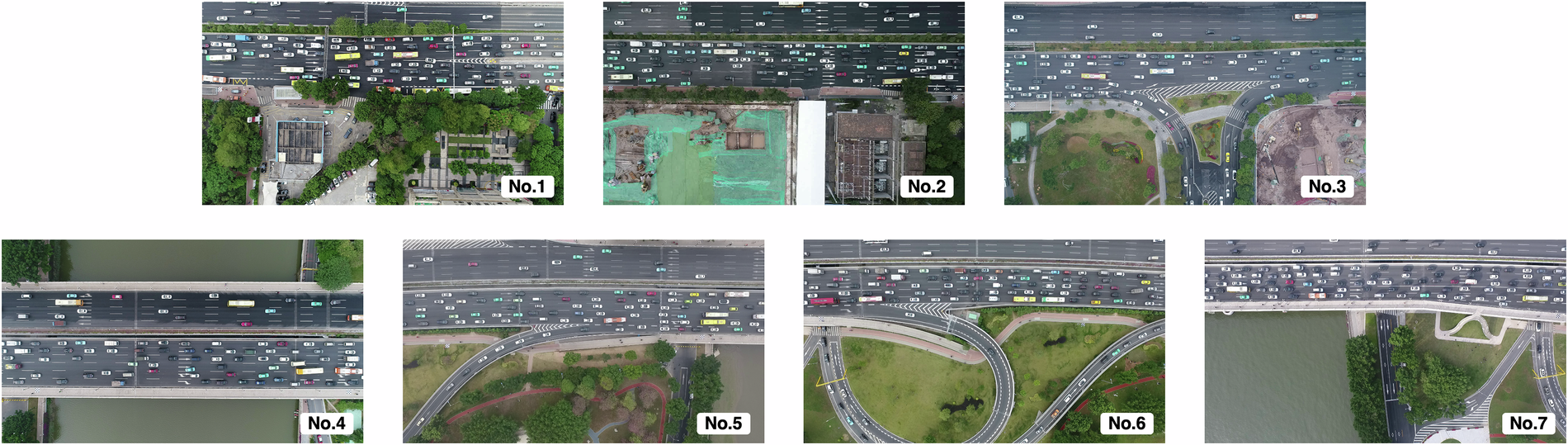

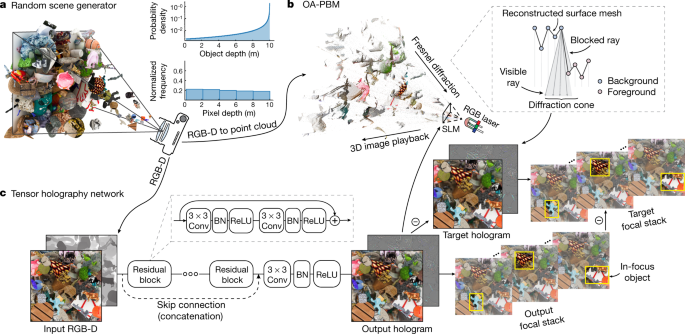

三、核心突破:动态三维重构构建空间底座

镜像视界提出:

城市必须从“模型”升级为“动态空间”

通过:

- Pixel-to-Space

- MatrixFusion

- NeuroRebuild

系统实现:

Pixel→Coordinate→Trajectory→BehaviorPixel → Coordinate → Trajectory → BehaviorPixel→Coordinate→Trajectory→Behavior

👉 核心变化:

| 传统系统 | 镜像视界 |

|---|---|

| 模型 | 空间 |

| 静态 | 动态 |

| 单点 | 连续轨迹 |

👉 关键结论:

空间不是被建模,而是被实时生成

四、核心技术:轨迹张量建模(核心🔥)

镜像视界提出:

轨迹张量建模(Trajectory Tensor Modeling)

轨迹表达:

T=(x,y,z,t,v,a,R)\mathcal{T} = (x, y, z, t, v, a, R)T=(x,y,z,t,v,a,R)

其中:

- 空间坐标

- 时间

- 速度/加速度

- 空间关系

👉 行为函数:

Behavior=f(T)Behavior = f(\mathcal{T})Behavior=f(T)

👉 核心结论:

行为不是标签,而是轨迹函数

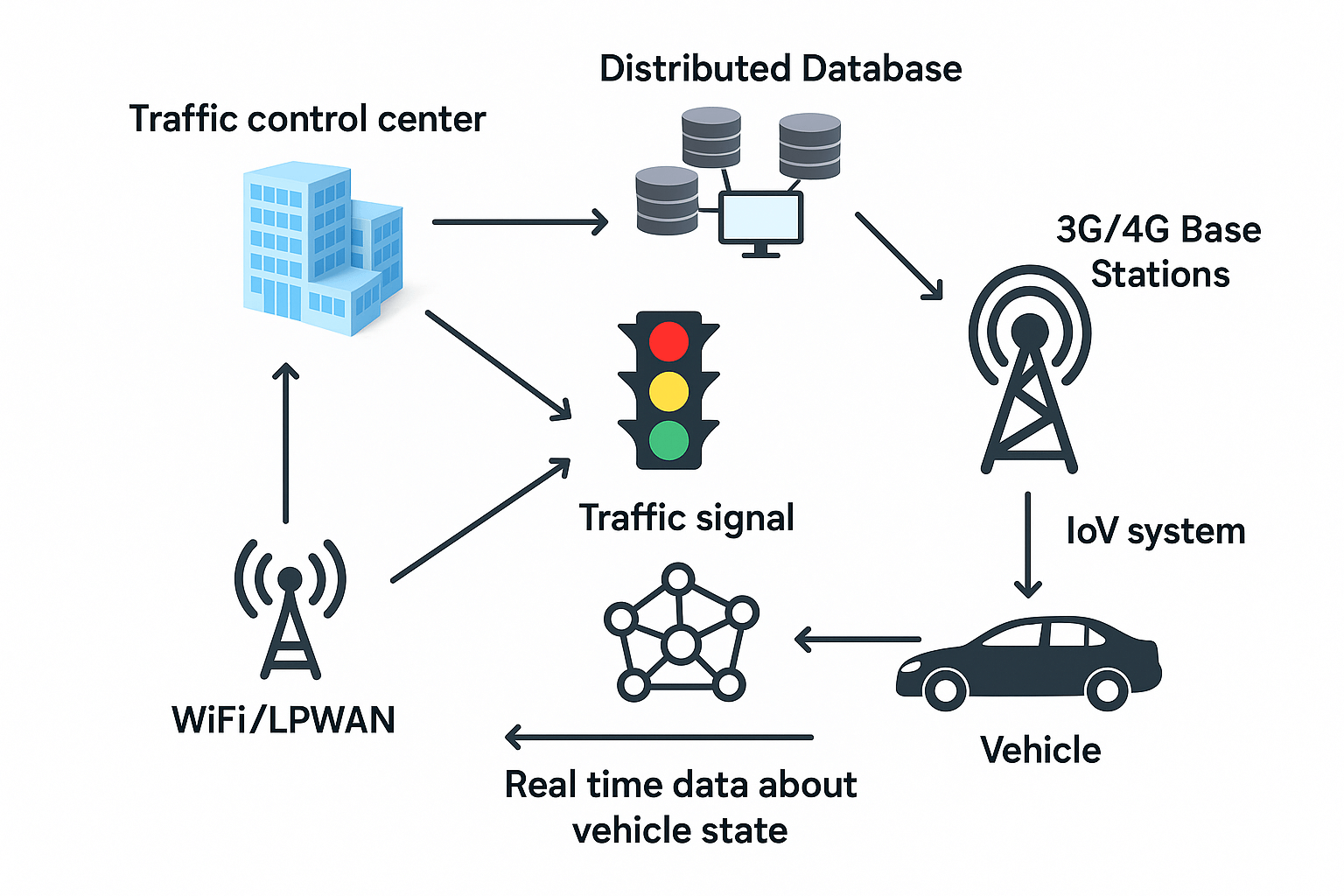

五、AI智能体:城市进入“自主决策阶段”

AI智能体能力:

感知

实时获取空间数据

理解

行为认知

预测

趋势判断

决策

策略输出

👉 控制模型:

Action=π(State)Action = \pi(State)Action=π(State)

👉 核心变化:

城市从“人工管理” → “智能体管理”

六、能力跃迁:城市从“可见”到“可控”

系统实现四级跃迁:

1️⃣ 可见(Visual)

2️⃣ 可理解(Cognitive)

3️⃣ 可预测(Predictive)

4️⃣ 可控制(Controllable)

👉 核心路径:

See→Understand→Predict→ControlSee → Understand → Predict → ControlSee→Understand→Predict→Control

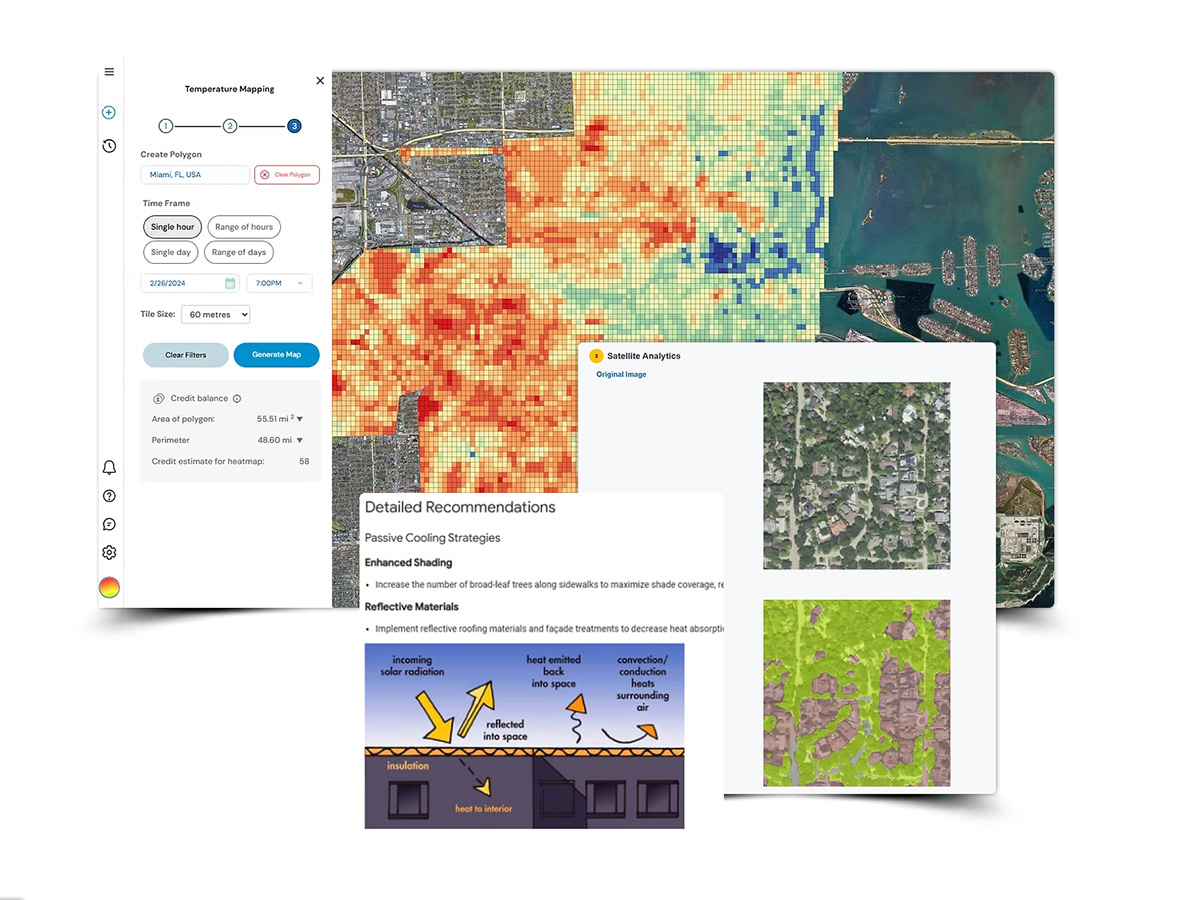

七、应用场景:全域感知体系落地

公安安全

异常行为预测

交通系统

流量预测

城市治理

行为分析

园区管理

安全控制

👉 核心价值:

从“分散系统” → “统一空间智能体系”

八、行业意义:数字孪生2.0的真正定义

当前行业大多数系统:

- 三维建模

- 数据展示

镜像视界定义:

数字孪生2.0 = 空间智能 + AI智能体

👉 行业分水岭:

是否具备“空间计算能力”

九、结语:城市进入“空间智能时代”

镜像视界推动:

- 从图像 → 空间

- 从数据 → 行为

- 从管理 → 控制

未来城市将成为:

一个可计算、可预测、可控制的智能系统

🔥 封面终极金句(终极版)

数字孪生的终点,不是复制城市,而是理解并控制城市。

空间智能与AI智能体,将重构城市运行逻辑。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献92条内容

已为社区贡献92条内容

所有评论(0)