看了这个画车测试,我终于明白为什么选国产龙虾 AiPy 了

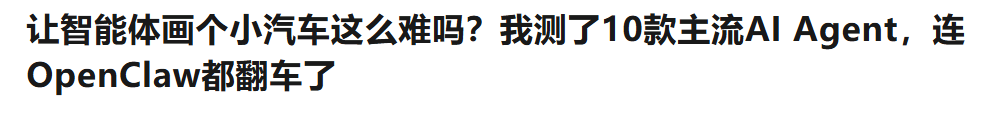

前两天刷公众号,看到一篇标题挺有意思的文章:《让智能体画个小汽车这么难吗?我测了10款主流AI Agent,连OpenClaw都翻车了》(原文章标题就是这样,我可没有夸大)。

说实话,一开始我是抱着"又是什么标题党"的心态点进去的。画个小汽车?这能有多难?让一个能操作电脑、会写代码的AI智能体干这活,不是分分钟的事吗?

结果看完,我真的被震撼到了——原来"能干"和"真干",差距这么大。

一个简单任务,暴露了真实能力

文章的测试任务特别简单粗暴,统一用的windows 11 系统用自带画图软件进行操作

打开 Windows 画图工具,操作鼠标,帮我画一个小汽车。

评测维度包括:

- 任务完成时间

- 绘图准确性(比例、完整性)

- 操作链路完整性(打开软件→绘图→保存)

就这?我第一反应是:这也叫测试?随便一个智能体都能干吧?

但我错了。

10款主流AI Agent,只有1款真正完成了任务。

而且不是你想的那款——OpenClaw 原版,失败了,0 分。

测试结果一览:国产龙虾 AiPy 第一名

文章给了完整的评分表,我直接搬过来:

| 排名 | Agent | 得分 | 评价 |

|---|---|---|---|

| 1 | 知道创宇 AiPy | 80 分 | 1 分钟完成,任务链路完整 |

| 2 | 元气 AI | 60 分 | 画出来了,但丑 |

| 3 | 腾讯 WorkBuddy | 50 分 | 部分超出画布 |

| 4 | 阿里 CoPaw | 50 分 | 画得不像 |

| 5 | OpenClaw 原版 | 0 分 | 打开了画图软件,没画出来 |

| 6 | 腾讯 Qclaw | 0 分 | 花 15 分钟,380 万 Token,失败 |

| 7 | 天工 Sky | 0 分 | 没打开画图软件,用 HTML 模拟 |

| 8 | MiniMax Agent | 0 分 | 打开了画图软件,没画 |

| 9 | 阶跃 | 0 分 | 折腾 20 分钟,失败了 |

| 10 | 智谱 AutoClaw | 0 分 | 打开了画图软件,但画图失败 |

真实测评效果如下⬇️:

看完这个表,我愣了一下。

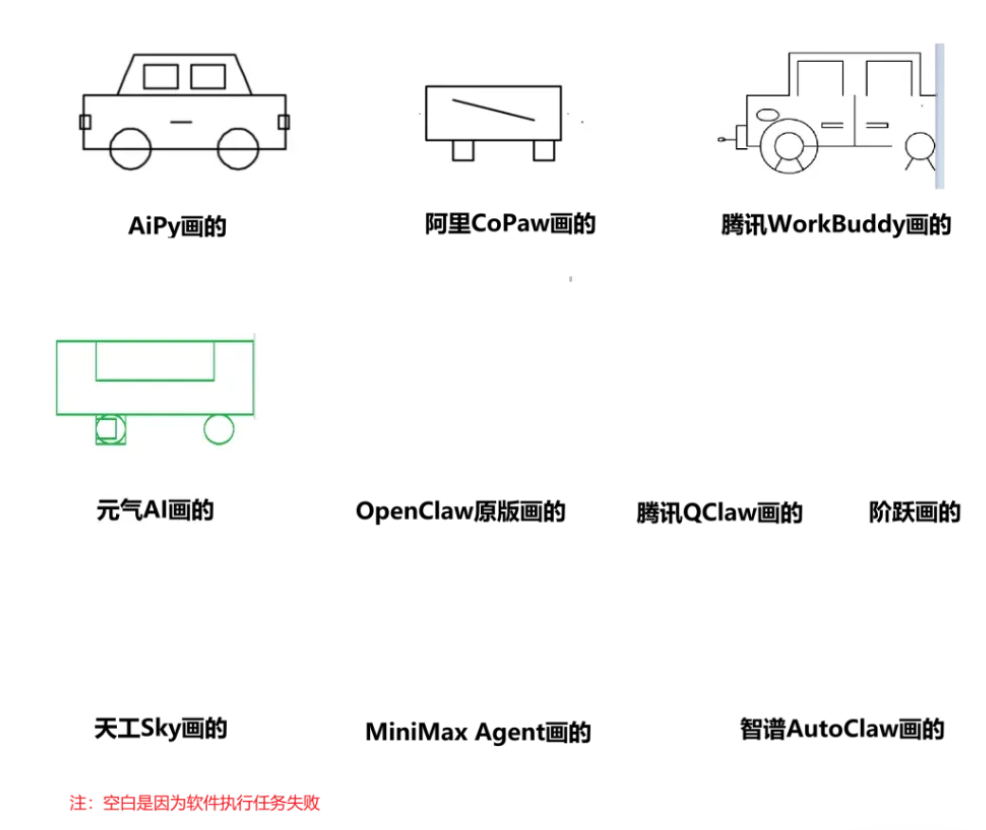

OpenClaw —— 也就是大家口中的"龙虾"原版 —— 居然失败了?

文章里说它打开了画图软件,编写了执行代码,但是执行遇到语法报错,折腾了2分钟,最后让用户手动操作。

而国产龙虾 AiPy,只用了 1 分钟,就把整个链路跑通了:打开软件 → 定位界面 → 执行动作 → 交付结果。

这个测试让我明白了一个道理

看完这篇文章,我突然意识到一件事:

很多 AI Agent 宣传的时候都说自己"能操作电脑"、"能执行任务"、"能帮你干活"。

但你真的让它干一件最简单的事的时候,才发现:

- 有的只会"看起来能干" —— 打开了软件,但下一步就卡住了

- 有的连软件都打不开 —— 权限问题、配置问题、各种报错

- 有的干脆绕路走 —— 不干正事,用 HTML 模拟一个假的糊弄你

真正能帮你干完活的,是那种能从头到尾把整件事跑通的。

就像文章说的:

真正能打的 Agent,不一定体现在 demo 有多热闹,而是体现在:你给它一个明确任务,它到底能不能真的帮你做完。

这句话,我看完直接收藏了。

看完这个测试,我只有一个感受:

谁早出来、谁把活干明白,时间会给出答案。

AiPy 领先 OpenClaw 整整大半年(AiPy于25年4月正式发布,OpenClaw2026年才发布),不是白领先的。功能打磨、安全设计、执行稳定性,这些都需要时间去沉淀。

当别的产品还在"看起来能干"的阶段,AiPy 已经做到了"真的能帮你干完"。

如果你也像我一样,想找一个真正能帮你干活、而不是只会演示的 AI 智能体,我真心建议:

试试国产龙虾 AiPy。

注册时记得填写我的邀请码 KHZw ,能获得200w tokens

如果你有其他好用的Agent 推荐,欢迎分享

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)