基于高通跃龙IQ-9100的边端协同智能客服系统(1): 架构设计与硬件选型

摘要

随着边缘计算和大语言模型(LLM)技术的快速发展,将语音交互能力部署到边缘设备上,并结合云端大模型的推理能力,已成为构建低延迟、高智能客服系统的主流方案。本文详细介绍如何在高通跃龙IQ-9100边缘计算平台上部署开源的ASR(自动语音识别)和TTS(文本转语音)模型,同时接入公有云上的DeepSeek大语言模型API,构建一个完整的边端协同智能客服系统。

该序列文章涵盖硬件平台选型分析、模型选择与量化优化、系统架构设计、核心代码实现以及性能调优等关键环节,为嵌入式AI开发者提供可落地的技术参考。

1. 项目背景与技术选型

1.1 为什么选择边端协同架构?

传统的云端客服系统将所有语音处理和对话推理都放在云端,虽然实现简单,但面临以下问题:

- 网络延迟敏感:语音交互对端到端延迟非常敏感,云端往返通常需要200-500ms,用户体验较差

- 带宽成本高:持续上传原始音频流需要较大的网络带宽,在弱网环境下体验急剧下降

- 隐私合规风险:某些场景(如金融、医疗客服)对用户语音数据的传输和存储有严格的合规要求

- 云端算力成本:大规模并发时,云端GPU/CPU资源的成本线性增长

边端协同架构的核心思想:将计算密集但对数据隐私敏感的ASR/TTS推理下沉到边缘设备,仅将识别后的文本发送到云端进行LLM推理,既降低了延迟和带宽成本,又保护了用户原始语音数据。

1.2 高通IQ-9100平台简介

高通IQ-9100(也称为Qualcomm IoT Solutions IQ-9100)是高通面向边缘AI和IoT场景推出的高性能计算平台,具备强大的异构计算能力,非常适合部署语音AI模型。

| 特性 | 参数 |

|---|---|

| 处理器 | Qualcomm Kryo CPU(8核,主频最高3.0GHz) |

| GPU | Adreno 730,支持OpenCL/Vulkan加速 |

| NPU/DSP | Hexagon DSP + HTA(AI张量加速器),算力最高26 TOPS |

| 内存 | 支持LPDDR5,最高16GB |

| 操作系统 | 支持Ubuntu Linux 20.04/22.04、Android 13 |

| AI框架支持 | Qualcomm AI Engine(SNPE/QNN)、TFLite、ONNX Runtime |

| 网络连接 | Wi-Fi 6E、蓝牙5.2、千兆以太网 |

| 音频接口 | I2S、TDM、USB Audio、模拟麦克风/扬声器 |

平台优势:高通跃龙IQ-9100的Hexagon NPU提供高达26 TOPS的INT8推理性能,配合Qualcomm AI Engine SDK,可以将Whisper等模型量化后高效运行,单次语音识别推理延迟可控制在100ms以内。

这里我们使用的硬件是Thundercomm的基于高通跃龙IQ-9100 平台 Linux OS的AI边缘盒子

1.3 开源模型选型

根据IQ-9100的算力特点和客服场景需求,我们选择以下开源模型:

| 模块 | 模型选择 | 理由 | 模型大小 |

|---|---|---|---|

| ASR | Whisper Small/Medium (OpenAI) | 多语言支持好,中文识别准确率高,社区活跃,ONNX导出成熟 | ~244MB / ~769MB (FP16) |

| ASR(备选) | SenseVoice (FunAudioLLM) | 中文识别效果优秀,支持情感识别,延迟低 | ~234MB (FP16) |

| TTS | VITS / MeloTTS | 端到端架构,中文语音自然度高,推理速度快,支持ONNX | ~75MB (FP16) |

| TTS(备选) | CosyVoice (FunAudioLLM) | 中文语音质量极高,支持零样本克隆 | ~450MB |

2. 系统架构设计

2.1 整体架构概览

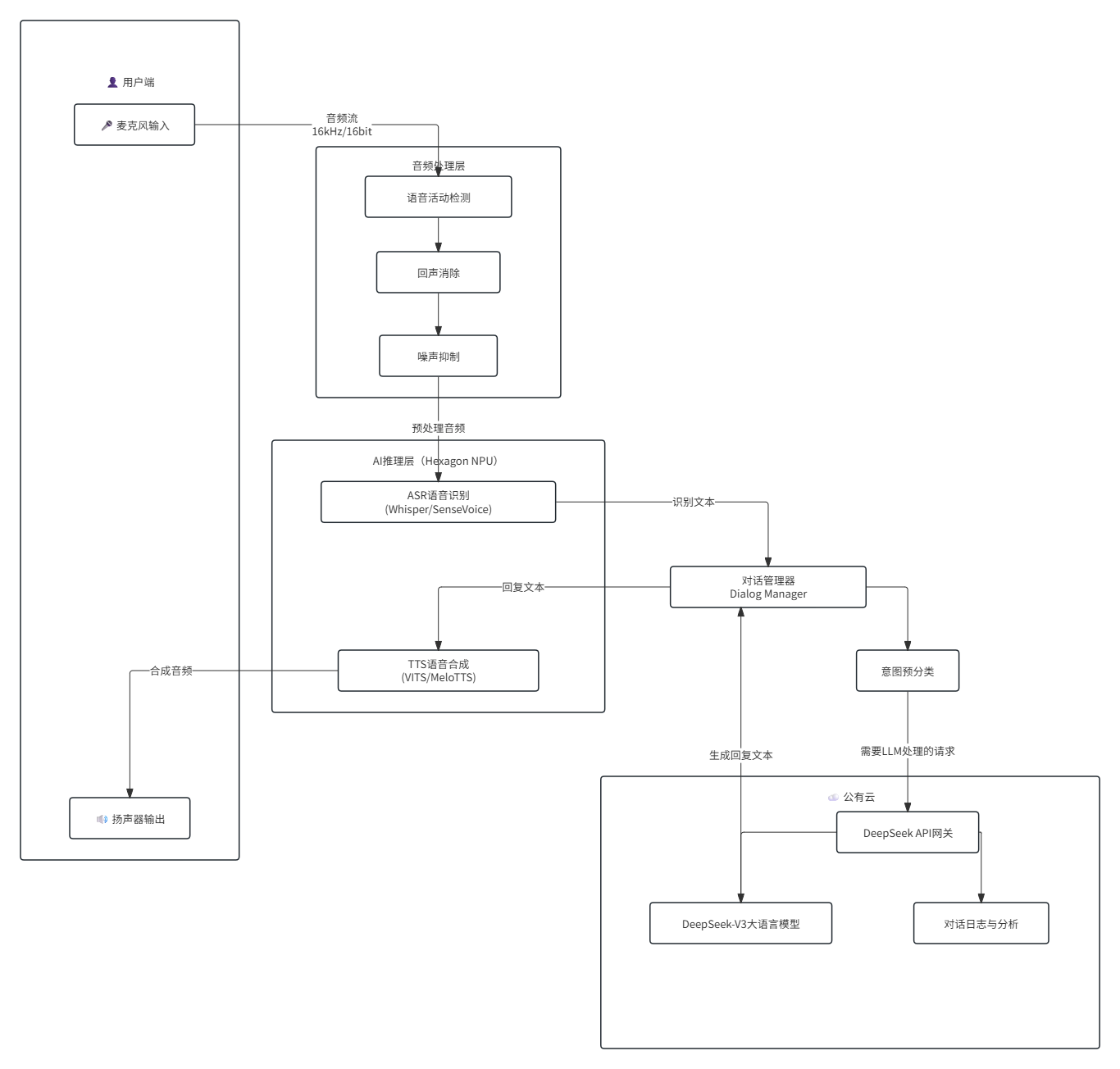

整个客服系统采用「边缘推理 + 云端智能」的分层架构,边缘端负责语音的采集、识别和合成,云端负责基于DeepSeek大模型的对话理解与生成。两端通过HTTPS/WebSocket进行轻量级文本通信。架构流程图如下:

架构说明:

- 边缘设备上的音频处理层负责前端信号处理(VAD、AEC、降噪),确保输入ASR模型的音频质量

- AI推理层利用Hexagon NPU的算力完成语音识别和合成

- 业务逻辑层包含对话管理器,能够对简单FAQ进行本地应答(无需云端),复杂问题则通过API发送到云端DeepSeek模型进行推理

2.2 数据处理流水线

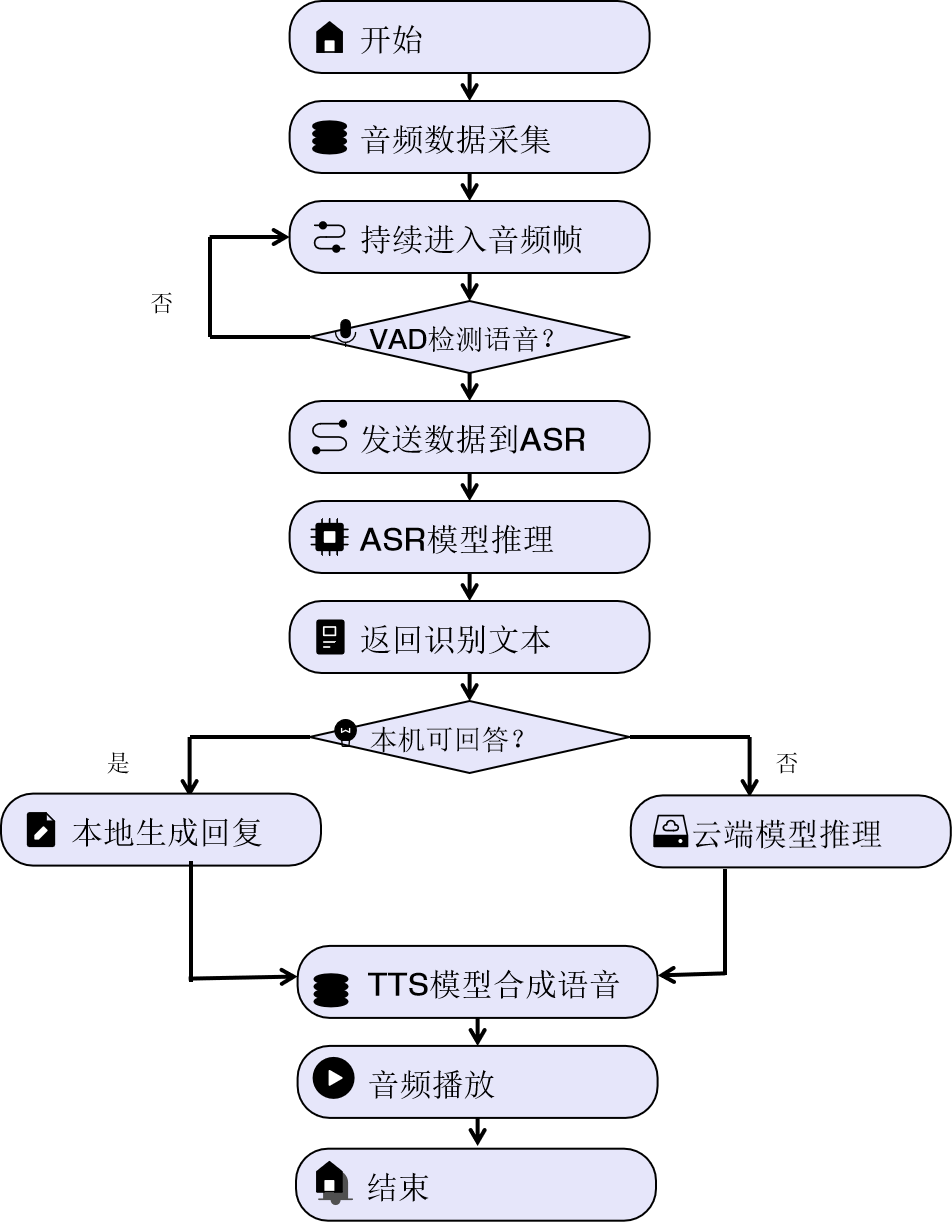

下面展示一次完整的用户对话交互的数据处理流程,从用户说话到系统回复的完整链路:

流程说明:

- 本地FAQ应答路径的端到端延迟仅约200ms

- 需要云端DeepSeek推理的路径延迟约800-1500ms

- 通过流式传输(SSE)和分句TTS合成的优化策略,用户感知到的首字延迟可以进一步降低到500ms左右

📌 下一篇预告:在系列文章的第二篇中,我们将深入讲解如何在IQ-9100上部署Whisper ASR模型和VITS TTS模型,包括环境配置、模型量化、NPU加速及核心代码实现。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)