养虾小记|让你的龙虾也能实现“萝卜纸巾”

OpenClaw作为近期热门开源项目,凭借简洁的操作逻辑与强大的适配能力,成为机械臂控制领域的关注焦点。其可实现AI指令与设备执行的全流程联动,大幅降低机械臂操控门槛。

上期,我们学习了OpenClaw对NERO七轴臂的控制,本期将整合 OpenClaw 快速部署配置流程与 GrabGen 抓取系统的硬件适配、环境搭建、项目部署实操步骤,从 AI 智能体配置到六轴机械臂自主抓取落地,手把手带你完成从零基础到智能抓取的全链路搭建,轻松实现 AI 驱动的机械臂自主作业。

DEMO

OpenClaw 自主识别与场景理解

让你的openclaw龙虾学会抓取

进入OpenClaw官网https://openclaw.ai/

执行一键安装命令:

curl -fsSL https://openclaw.ai/install.sh | bash

接下来进行OpenClaw配置

-

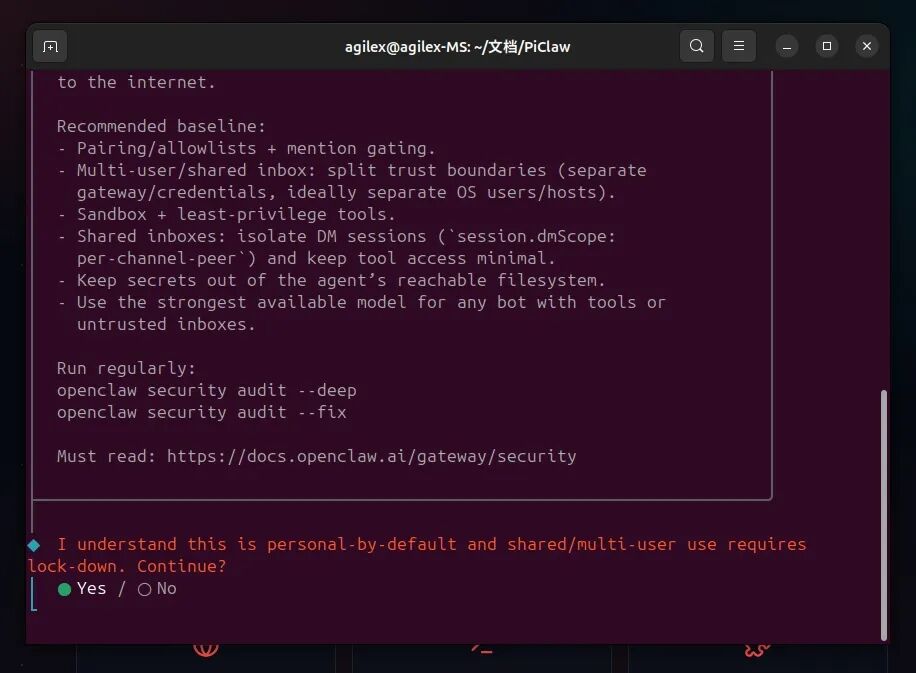

选择’YES’

-

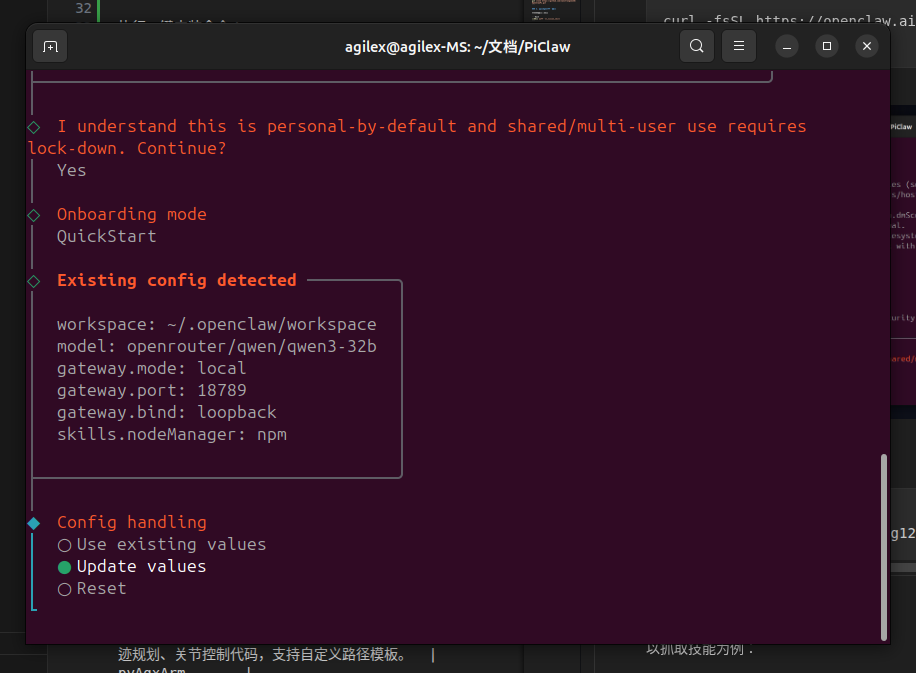

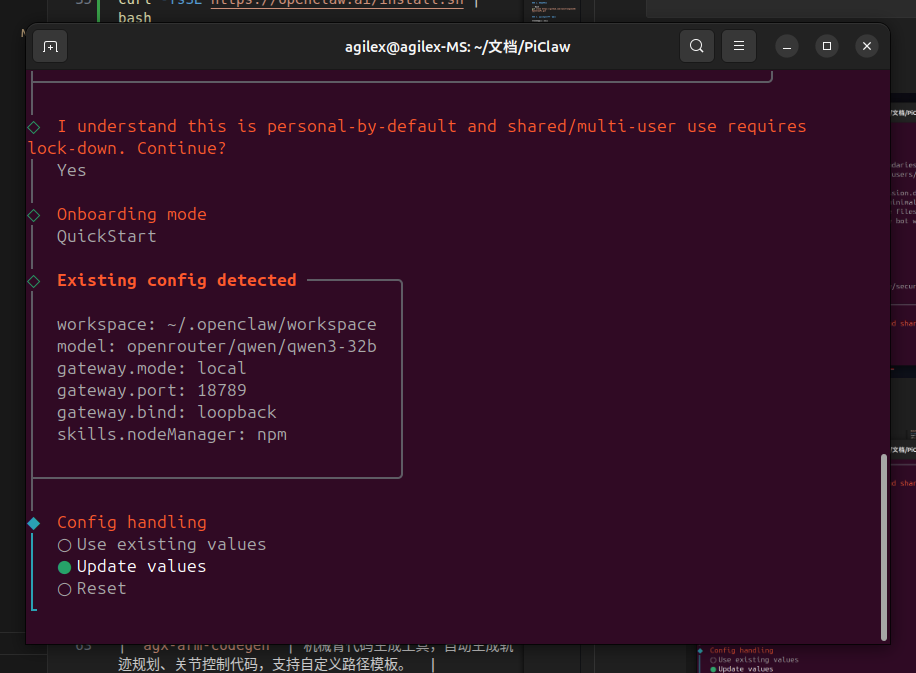

选择’QuickStart’

-

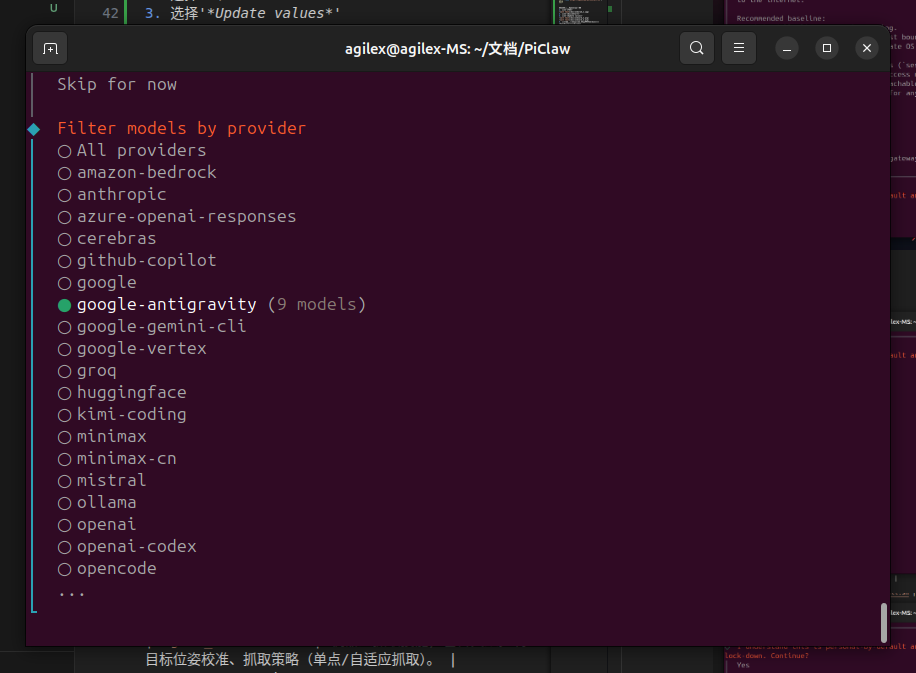

选择’Update values’

-

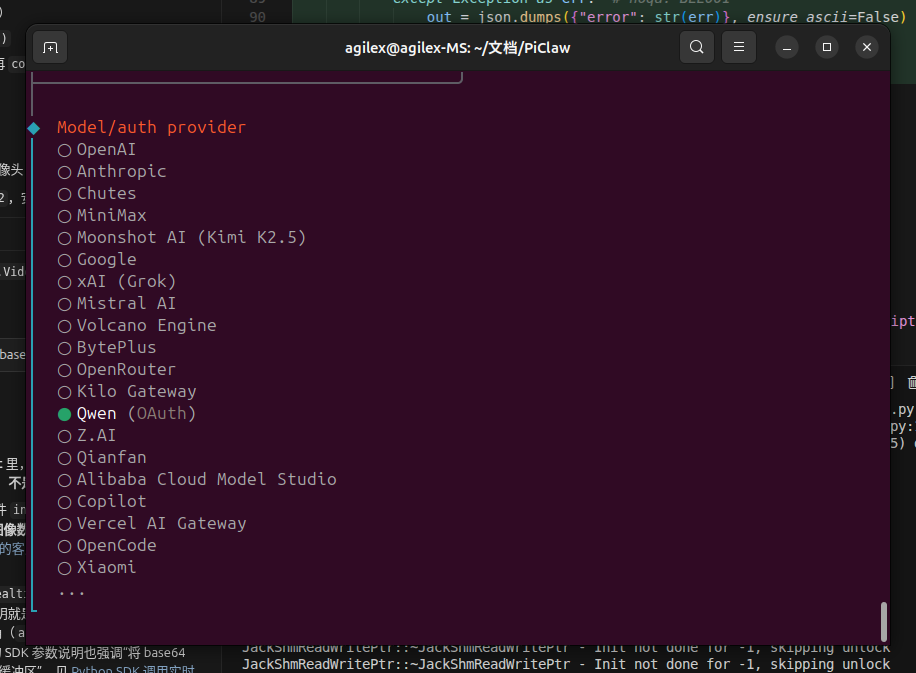

选择你使用的提供商,推荐免费的Qwen,OpenRouter,Ollama

-

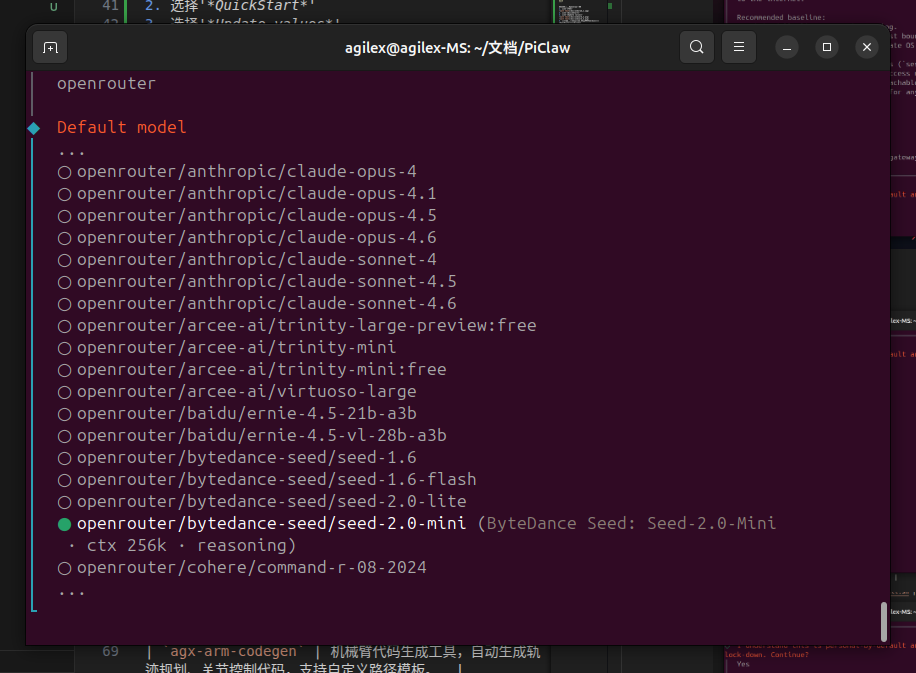

选择你希望使用的公司的模型

-

选择一个默认模型

-

选择你将要接入龙虾的APP

-

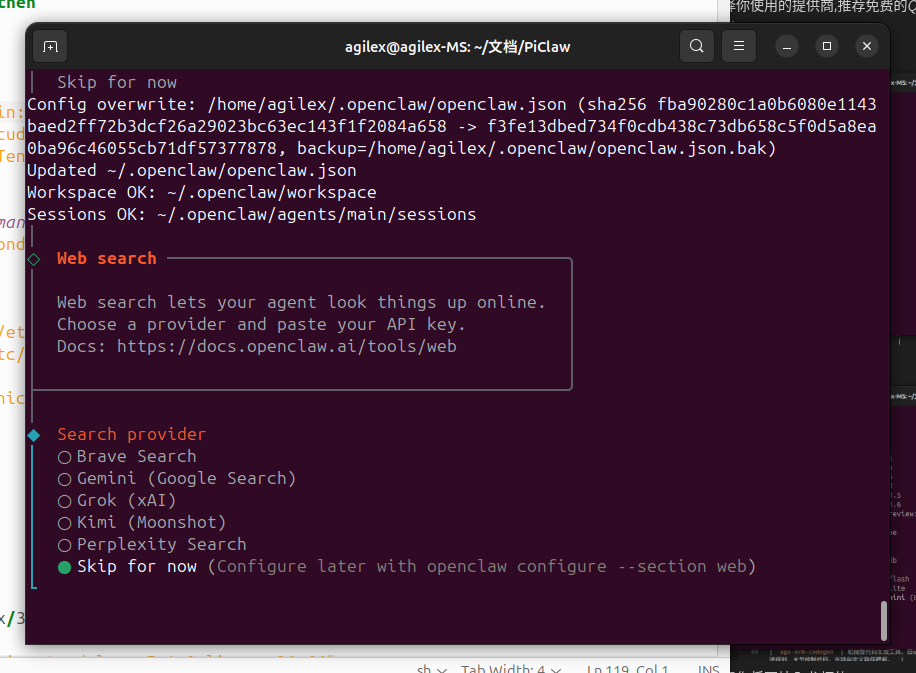

选择网页搜索提供商

-

选择技能(暂时不需要)

-

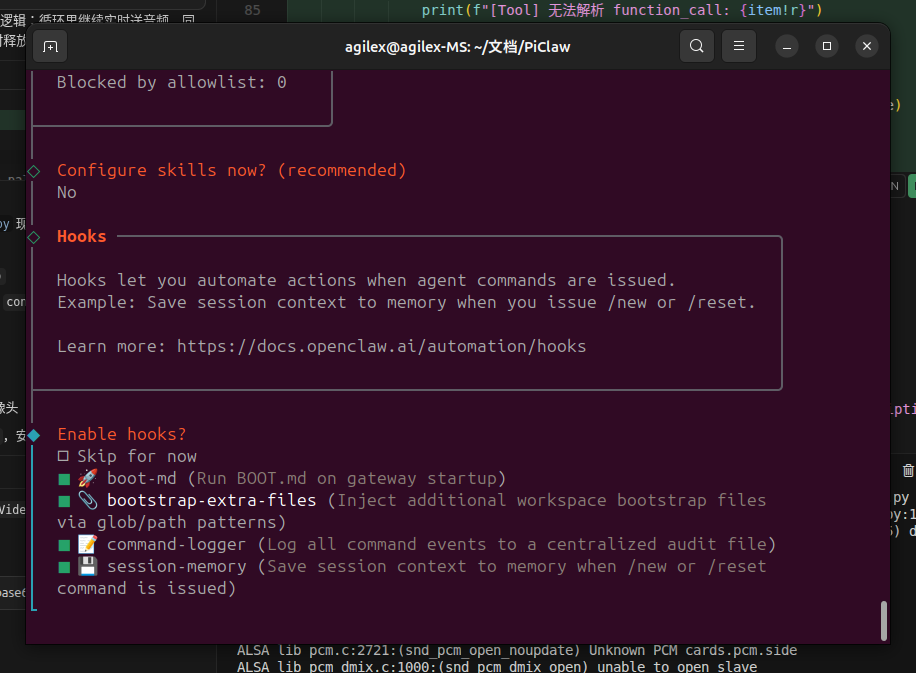

钩子全选

-

选择’restart’

-

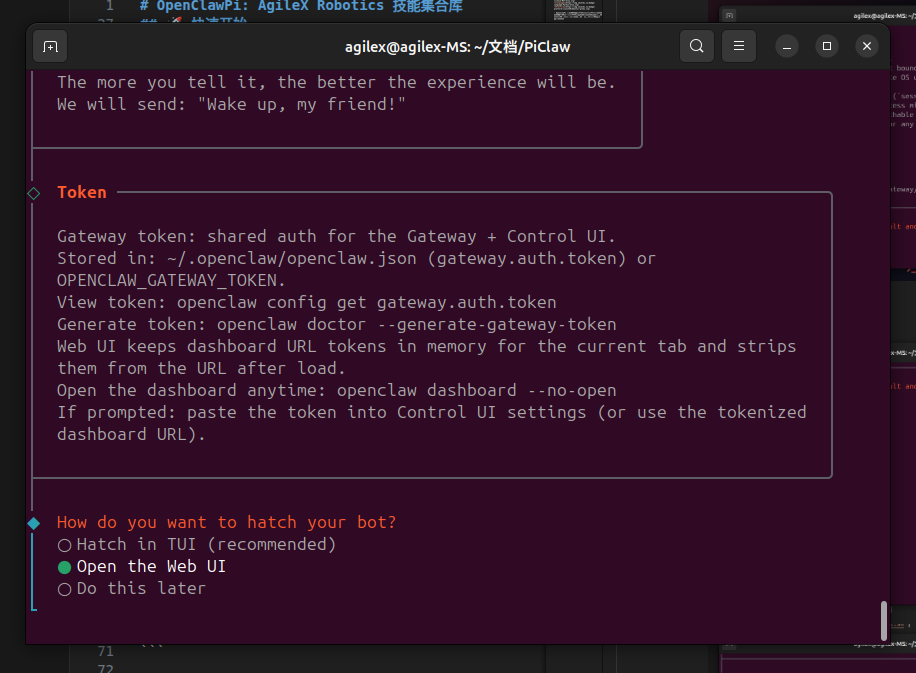

选择’Web UI’

1. 克隆项目

git clone https://github.com/vanstrong12138/OpenClawPi.git

2. 提示Agent学习技能

以抓取技能为例:

用户: 请学习vl_vision_skill

二、GraspGen-位姿生成与抓取

硬件要求

- x86桌面平台

- 显存不少于16G的英伟达显卡

- realsense

项目部署平台

- Ubuntu24.04

- ROS jazzy

- RTX 5090

- NVIDIA Driver Version 570.195.03

- CUDA Version 12.8

- 安装NVIDIA显卡驱动

sudo apt update

sudo apt upgrade

sudo add-apt-repository ppa:graphics-drivers/ppa

sudo apt update

sudo apt install nvidia-driver-570

#重启

reboot

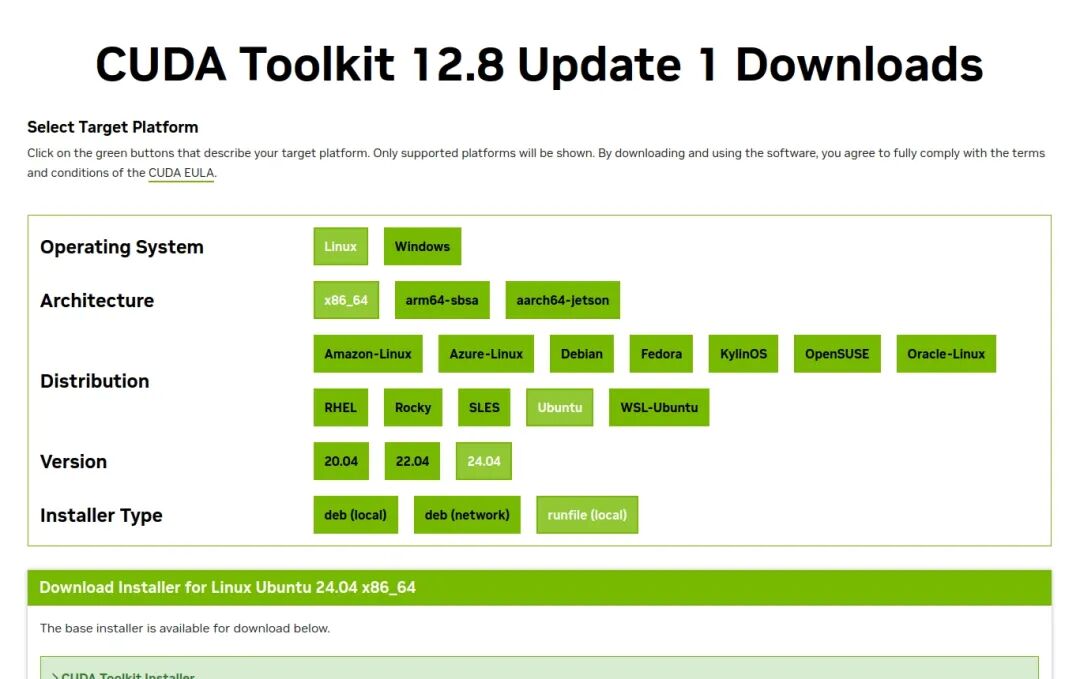

- 安装CUDA Toolkit 12.8

-

先前往NVIDIA官网下载CUDA的runfile文件

-

执行安装命令

wget https://developer.download.nvidia.com/compute/cuda/12.8.1/local_installers/cuda_12.8.1_570.124.06_linux.run

sudo sh cuda_12.8.1_570.124.06_linux.run

- 安装时取消勾选第一项driver,因为我们第一步已经安装过显卡驱动了

- 添加环境变量

echo 'export PATH=/usr/local/cuda-12.8/bin:$PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/local/cuda-12.8/lib64:$LD_LIBRARY_PATH' >> ~/.bashrc

source ~/.bashrc

- 安装后可以执行nvcc -V查看CUDA信息

nvcc -V

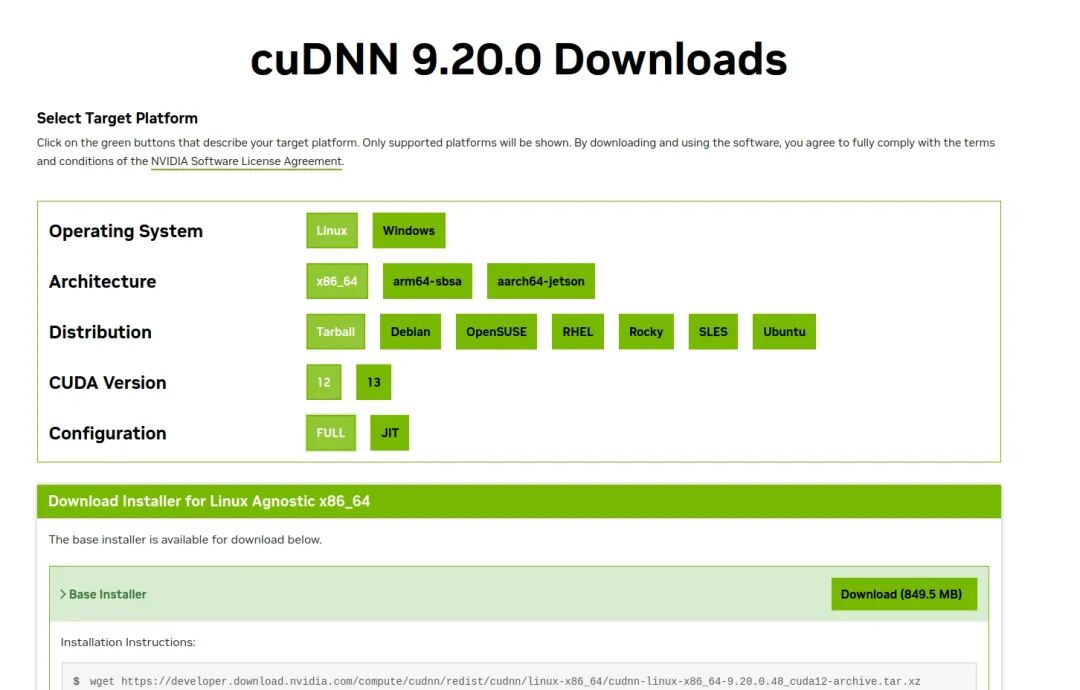

- 安装cuDnn

-

去NVIDIA官网下载cuDnn的tar文件,解压后对文件进行拷贝

-

解压后执行下面的命令把cuDNN拷贝到CUDA的安装目录下

sudo cp cuda/include/cudnn*.h /usr/local/cuda/include

sudo cp cuda/lib/libcudnn* /usr/local/cuda/lib64

sudo chmod a+r /usr/local/cuda/include/cudnn*.h /usr/local/cuda/lib64/libcudnn*

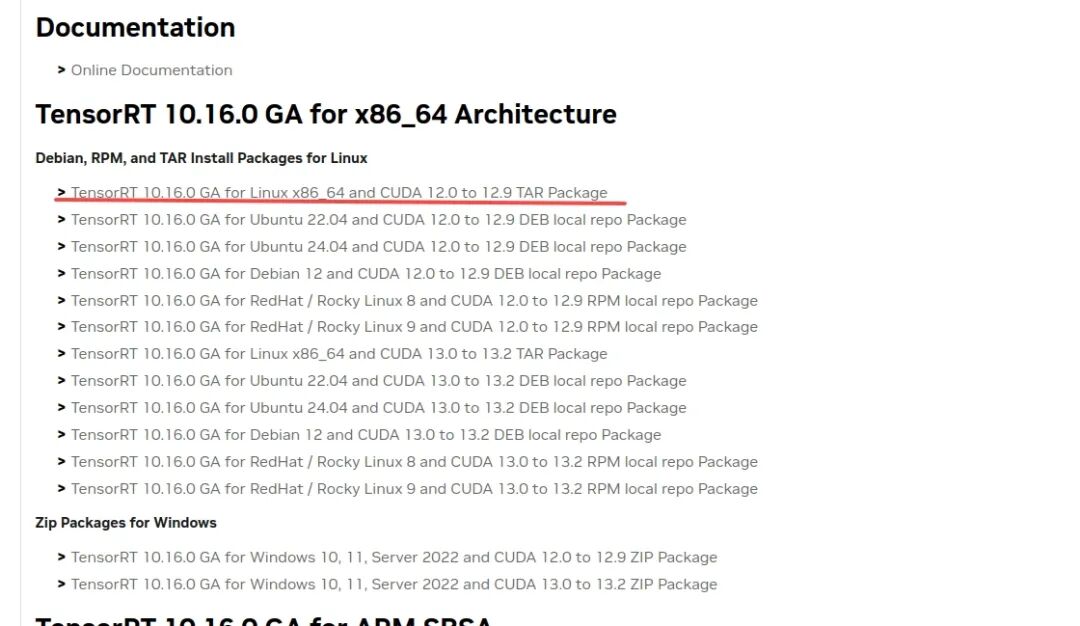

- 安装TensorRT,去NVIDIA官网下载TensorRT的tar文件,解压后对文件进行拷贝

- 解压后执行下面的命令把TensorRT拷贝到/usr/local目录下

#解压

tar -xvf TensorRT-10.16.0.72.Linux.x86_64-gnu.cuda-12.9.tar.gz

#进入TensorRT-10.16.0.72.Linux.x86_64-gnu.cuda-12.9

cd TensorRT-10.16.0.72.Linux.x86_64-gnu.cuda-12.9/

#拷贝到/usr/local目录下

sudo mv TensorRT-10.16.0.72/ /usr/local/

- 测试TensorRT是否安装成功

#进入MNIST手写数字识别的目录下

cd /usr/local/TensorRT-10.16.0.72/samples/sampleOnnxMNIST

#编译

make

#在/usr/local/TensorRT-10.16.0.72/bin找到可执行文件sample_onnx_mnist

cd /usr/local/TensorRT-10.16.0.72/bin

./sample_onnx_mnist

SAM3部署

- Python 3.12 or higher

- PyTorch 2.7 or higher

- CUDA-compatible GPU with CUDA 12.6 or higher

- 创建conda虚拟环境

conda create -n sam3 python=3.12

conda deactivate

conda activate sam3

- 安装与cuda版本兼容的pytorch

# 50系列显卡推荐用cuda12.8 torch2.8

# CUDA 12.8

# numpy建议降级到<1.23

pip install torch==2.8.0 torchvision==0.23.0 torchaudio==2.8.0 --index-url https://download.pytorch.org/whl/cu128

cd sam3

pip install -e .

- 模型下载

- 提交表格获取HugginFace模型下载资格https://huggingface.co/facebook/sam3

- 国内镜像站搜索

机械臂驱动部署

项目发布的是target_pose末端位姿,可以手动修改为其他机械臂

- 以PiPER机械臂为例

pip install python-can

git clone https://github.com/agilexrobotics/pyAgxArm.git

cd pyAgxArm

pip install .

克隆

- 克隆此项目到本地

cd YOUR_PATH

git clone -b ros2_jazzy_version https://github.com/AgilexRobotics/GraspGen.git

运行

- 抓取节点

python YOUR_PATH/sam3/realsense-sam.py --prompt "目标物体英文名称"

- 执行抓取任务

A=主臂零力 D=普通模式+记录位姿 S=回零 X=复现位姿 Q=夹爪开 E=夹爪合 p=点云/抓取 t=改提示词 g=下发抓取 Esc=退出

- 自动抓取任务

python YOUR_PATH/sam3/realsense-sam.py --prompt "目标物体英文名称" --auto

如何使用

user> 请学习一个新技能:在目录下“your_openclaw_path/skills/grab_skill”

openclaw> .......(“已经学会了”)

user> 进行测试,现在抓取桌面上的萝卜

openclaw> .......(“成功抓取”)

从OpenClaw的一键部署、快速配置,到 GrabGen 抓取系统的显卡驱动、CUDA、TensorRT 等环境编译,再到 SAM3 视觉模型部署、机械臂驱动对接与抓取技能学习,整套方案完整打通了 AI 智能体与机械臂自主抓取的技术闭环。

依托免费大模型加持、开源项目支撑和标准化部署流程,无需复杂的底层开发,即可快速实现机械臂对目标物体的精准识别与自主抓取,无论是机器人开发入门、科研实验还是小型自动化场景落地,都能高效落地应用。

实操过程中如果遇到问题,欢迎在评论区留言交流,后续我们也会持续更新OpenClaw的更多实操教程,带你解锁这只“开源龙虾”的全部潜力,一起在技术热点里稳步成长,

评论区留言,你还想看松灵机器人用openclaw做点什么?

往期推荐

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)