模型蒸馏全攻略:小模型如何从大模型「偷师」

模型蒸馏全攻略:小模型如何从大模型「偷师」

2025 年初,AI 圈炸了一颗大雷:Anthropic 公开指控 DeepSeek 用了 1600 万次 Claude API 调用来训练自家模型。用的什么技术?就是知识蒸馏(Knowledge Distillation)——当今 AI 领域最强大、也最具争议的技术之一。

DeepSeek 否认了具体细节,但他们大大方方开源了 R1-Distill 系列——一组从 6710 亿参数的 R1 模型蒸馏出来的小模型。结果如何?小 10 到 400 倍的模型,保留了 85-95% 的推理能力。

时间来到 2026 年 3 月,蒸馏已经成为整个行业的标配。GPT-5-mini、GPT-5-nano、Gemini 2.5 Flash、Claude 4 Haiku、Llama 4 Scout/Maverick、Qwen 3 全系列——清一色蒸馏产物。可以说,蒸馏就是让便宜、快速的 AI 成为现实的核心技术。

今天我们就来把这件事讲透。

什么是模型蒸馏?

模型蒸馏(正式名称叫知识蒸馏)是一种训练技术:让一个大而强的教师模型把知识传授给一个小而快的学生模型。

打个比方:一个五星级大厨带徒弟。徒弟不需要从零开始发明每道菜,而是跟着师父看、跟着学——不光学「做什么菜」,更学「怎么思考做菜这件事」。

为什么不直接训练一个小模型?

三个原因:

-

小模型从原始数据里学不到那么多东西。 一个 7B 参数的模型就算用跟 670B 模型一样的数据训练,效果也会差很多——容量不够,提取不了那么复杂的规律。

-

教师模型能提供更好的训练信号。 学生不是学「答案是巴黎」,而是学教师的完整概率分布:「巴黎 92%、里昂 5%、马赛 2%…」——这种软信号携带的信息量大得多。

-

成本低到离谱。 从零训练一个 670B 模型要花几千万美元,但从它蒸馏出一个 7B 学生模型?几千美元就够了。

蒸馏 vs 微调 vs 预训练

| 维度 | 预训练 | 微调 | 蒸馏 |

|---|---|---|---|

| 起点 | 随机权重 | 预训练好的模型 | 预训练好的学生模型 |

| 训练数据 | 万亿级 Token(原始文本) | 任务相关样本(1万-100万) | 教师模型的输出 |

| 目标 | 学会语言 | 学会特定任务 | 压缩教师的知识 |

| 成本 | $1000万-$1亿+ | $100-$1万 | $1000-$10万 |

| 产出 | 基础大模型 | 专用模型 | 更小、更快的模型 |

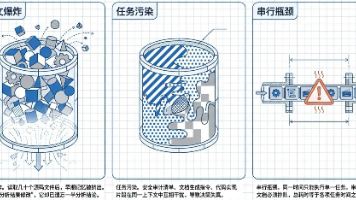

核心蒸馏技术

1. 软标签蒸馏(Hinton, 2015)

知识蒸馏的开山之作,由 Geoffrey Hinton 等人在 2015 年提出。核心思想是:不要让学生只学「硬标签」(这是一只猫),而是学教师的软概率分布。

原理是这样的:

教师模型通过温度缩放的 softmax 输出所有可能 Token 的概率分布:

标准输出 (T=1): Paris: 0.95, Lyon: 0.03, Berlin: 0.01, ...

软化输出 (T=5): Paris: 0.45, Lyon: 0.18, Berlin: 0.12, ...

温度越高,分布越「软」,越能暴露出教师的不确定性和各选项之间的关系。学生学到的不只是正确答案,还有教师「有多确信」以及「还考虑过哪些选项」。

损失函数:

L = α × CrossEntropy(student_output, hard_labels)

+ β × KL_Divergence(student_soft_output, teacher_soft_output)

学生同时优化两个目标:答对(硬标签)和模仿教师的思路(软标签)。

2. 硬标签蒸馏(基于响应)

LLM 时代最简单、最流行的方法。操作极其直白:

- 把 Prompt 扔给教师模型

- 收集它的文本输出

- 用这些输出去微调学生模型

Alpaca、Vicuna 以及大量开源模型就是这么来的——用 ChatGPT/GPT-4 的输出去微调 LLaMA。

优点: 不需要访问教师的内部结构,任何 API 都能用。

缺点: 丢失了软概率分布里的细微信息。

3. 思维链(CoT)蒸馏

这是 DeepSeek-R1-Distill 等推理模型背后的杀手锏。不光收集答案,还收集教师的逐步推理过程。

举个例子:

Prompt: "What is 17 × 23?"

Teacher output (with CoT):

"Let me break this down:

17 × 23 = 17 × 20 + 17 × 3

17 × 20 = 340

17 × 3 = 51

340 + 51 = 391

The answer is 391."

学生学到的不光是 17 × 23 = 391,还有怎么一步步推理出来的。这就是为什么 DeepSeek-R1-Distill 系列模型展现出了真正的推理能力——它们内化了推理模式,而不仅仅是答案。

4. 特征蒸馏

学生学习模仿教师的中间表示(隐藏层激活值),而不只是最终输出。这能传递更深层的结构化知识,但需要访问教师模型的内部结构。

主要用在科研场景——商业蒸馏大多用响应蒸馏或 CoT 蒸馏。

蒸馏名人堂

来看看当今 AI 圈有哪些重量级模型是蒸馏出来的:

开源蒸馏模型

| 模型 | 教师 | 学生底座 | 参数量 | 关键成就 |

|---|---|---|---|---|

| DeepSeek-R1-Distill-Qwen-32B | DeepSeek-R1 (671B MoE) | Qwen-2.5-32B | 32B | 数学推理超过 GPT-4o |

| DeepSeek-R1-Distill-Llama-70B | DeepSeek-R1 (671B MoE) | Llama-3.1-70B | 70B | 1/10 体量达到 R1 的 95% 推理能力 |

| DeepSeek-R1-Distill-Qwen-14B | DeepSeek-R1 (671B MoE) | Qwen-2.5-14B | 14B | 单卡可跑 |

| DeepSeek-R1-Distill-Qwen-7B | DeepSeek-R1 (671B MoE) | Qwen-2.5-7B | 7B | 消费级显卡可跑 |

| DeepSeek-R1-Distill-Qwen-1.5B | DeepSeek-R1 (671B MoE) | Qwen-2.5-1.5B | 1.5B | 可部署到手机端 |

| Llama 4 Scout | Llama 4 Behemoth (2T+) | 自研 MoE | 109B(17B 活跃) | 1000 万上下文,从 Behemoth 蒸馏 |

| Llama 4 Maverick | Llama 4 Behemoth (2T+) | 自研 MoE | 400B(17B 活跃) | 前沿多模态,从 Behemoth 蒸馏 |

| Qwen 3 全系列 | Qwen 3-235B (MoE) | 多种底座 | 0.6B-32B | 从 235B MoE 教师蒸馏出完整家族 |

| Qwen 3.5 Small 系列 | Qwen 3.5 大模型 | 多种底座 | 0.8B-9B | 端侧优化,2026.3 发布 |

| Gemma 3 (Google) | Gemini Pro | 自研架构 | 1B-27B | 从 Gemini 蒸馏的开源模型 |

| Phi-4-mini (Microsoft) | GPT-4 + 合成数据 | 自研架构 | 3.8B | STEM 性能超过 10 倍大的模型 |

| Orca 2 (Microsoft) | GPT-4 | LLaMA-2-13B | 13B | 学会了自主选择推理策略 |

| Vicuna-13B (2023) | ChatGPT | LLaMA-13B | 13B | 首个成功的开源蒸馏案例 |

| Alpaca-7B (2023) | text-davinci-003 | LLaMA-7B | 7B | 5.2万条指令蒸馏,成本仅 $600 |

商业蒸馏模型(截至 2026 年 3 月)

| 模型 | 可能的教师 | 参数量 | 成本降低 | 性能保留 |

|---|---|---|---|---|

| GPT-5-mini | GPT-5 | 未公开 | 便宜约 50 倍 | GPT-5 的 ~82% |

| GPT-5-nano | GPT-5 | 未公开 | 便宜约 100 倍 | GPT-5 的 ~70% |

| GPT-4o-mini | GPT-4o | ~8B(估) | 便宜 60 倍 | GPT-4o 的 ~82% |

| Gemini 2.5 Flash | Gemini 2.5 Pro | 未公开 | 便宜约 8 倍 | Pro 的 ~90% |

| Gemini 2.0 Flash | Gemini 2.0 Pro | 未公开 | 便宜 10 倍 | Pro 的 ~88% |

| Claude 4 Haiku | Claude 4 Sonnet | 未公开 | 便宜约 8 倍 | Sonnet 的 ~83% |

| Claude 3.5 Haiku | Claude 3.5 Sonnet | 未公开 | 便宜 10 倍 | Sonnet 的 ~80% |

| Mistral Small | Mistral Large | 22B | 便宜 6 倍 | Large 的 ~78% |

| Qwen-Turbo | Qwen-Max | 未公开 | 便宜 10 倍 | Max 的 ~80% |

划重点: 你在 API 里调用的几乎每一个带 “mini”、“nano”、“flash”、“haiku”、“turbo” 后缀的模型,都是从更大模型蒸馏出来的。你调 GPT-5-mini,本质上就是在用蒸馏技术的成果。连 Meta 的 Llama 4 Scout 和 Maverick,也是从未发布的 Behemoth 模型蒸馏而来。

🇨🇳 中国蒸馏生态:一股不可忽视的力量

在蒸馏这条路上,中国团队走得非常快:

- DeepSeek 堪称蒸馏界的标杆。R1-Distill 系列选择 Qwen 和 Llama 作为学生底座,效果炸裂——32B 版本在数学推理上甚至超过了 GPT-4o。更关键的是,DeepSeek 明确允许 其他人使用 R1 的输出做蒸馏,这在闭源厂商中极为罕见。

- Qwen(通义千问) 系列本身就是蒸馏的热门学生底座。从 Qwen-2.5-1.5B 到 72B,覆盖从手机端到服务器的全场景。阿里还推出了 Qwen-Turbo 作为 Qwen-Max 的蒸馏版,成本降低 10 倍。

- MiniCPM(面壁智能)用极小的参数量做到了惊人的效果,大量依赖蒸馏 + 合成数据策略。

- Yi 系列(零一万物)、GLM 系列(智谱)也在自己的模型族谱中广泛使用蒸馏技术。

对于国内开发者来说,蒸馏意味着:你不需要花几千万训大模型,用 DeepSeek R1 或 Qwen-Max 当教师,蒸馏一个适合自己场景的小模型,成本可能只要几千块人民币。

争议:蒸馏什么时候变成了「偷」?

蒸馏技术处在法律和伦理的灰色地带。来看看各方的立场:

Anthropic vs DeepSeek 事件

2025 年初,Anthropic 公布了证据,指控 DeepSeek:

- 对 Claude 进行了 1600 万次 API 调用

- 用 Claude 的输出(包括推理链)作为训练数据

- 训练出的模型展现出了类似 Claude 的行为模式

DeepSeek 承认使用了多个前沿模型的输出作为训练流程的一部分——这在技术上违反了大多数 API 的使用条款。

各家对蒸馏的态度

| 厂商 | 对输出蒸馏的政策 | 执行力度 |

|---|---|---|

| OpenAI | ❌ 明确禁止(仅允许对自家模型做微调) | 主动监控 |

| Anthropic | ❌ 禁止用于训练竞品模型 | 威胁法律行动 |

| ❌ 大多数 Gemini 输出禁止用于训练 | 服务条款约束 | |

| DeepSeek | ✅ 明确允许蒸馏 R1 输出 | 开放许可 |

| Meta (Llama) | ⚠️ 有限制的允许(Llama 2 禁止训练 >700M 参数模型) | 社区许可 |

| Mistral | ✅ 大多数模型 Apache 2.0 许可 | 完全开放 |

| Qwen(阿里) | ✅ 允许蒸馏 | 开放许可 |

学术界怎么看

研究者大多认为蒸馏是正当且必要的技术:

- 它让 AI 能力平民化

- 它让端侧部署成为可能

- 它是机器学习「知识级联」的自然组成部分

商业公司怎么看

投入数十亿训练前沿模型的公司,把未经授权的蒸馏视为:

- 知识产权侵权

- 不正当竞争

- 对商业模式的威胁

一个尴尬的事实: 整个开源 AI 生态——从 Alpaca 到 DeepSeek-R1-Distill——很大程度上就是靠蒸馏闭源模型建立起来的。这到底是创新还是偷窃?看你问谁了。

开发者如何用蒸馏省钱

你不需要是 DeepSeek 才能用蒸馏。下面是一套实战流程:

第一步:用大模型生成训练数据

用强大的模型为你的特定场景生成高质量的回答:

from openai import OpenAI

import json

client = OpenAI(

api_key="your-crazyrouter-key",

base_url="https://crazyrouter.com/v1"

)

# Define your task-specific prompts

prompts = [

"Classify this customer email as: billing, technical, general. Email: ...",

"Extract product name and price from this text: ...",

# ... hundreds or thousands of examples

]

training_data = []

for prompt in prompts:

response = client.chat.completions.create(

model="gpt-5", # Use a powerful teacher model

messages=[{"role": "user", "content": prompt}],

temperature=0.3

)

training_data.append({

"prompt": prompt,

"response": response.choices[0].message.content

})

# Save training dataset

with open("distillation_data.jsonl", "w") as f:

for item in training_data:

f.write(json.dumps(item) + "\n")

第二步:微调一个小模型

用生成的数据去微调一个更便宜的模型:

# Fine-tune GPT-4o-mini on your distillation data

file = client.files.create(

file=open("distillation_data.jsonl", "rb"),

purpose="fine-tune"

)

job = client.fine_tuning.jobs.create(

training_file=file.id,

model="gpt-4o-mini"

)

第三步:部署上线,省钱真香

微调后的 mini 模型在你的特定场景里,表现接近 Claude Sonnet——但成本只有零头。

什么时候该蒸馏,什么时候直接调大模型?

| 场景 | 建议 | 原因 |

|---|---|---|

| 日请求量 < 1K | 直接调大模型 | 蒸馏的前期投入不划算 |

| 日请求量 1K-100K | 考虑蒸馏 | 省下来的钱开始有感 |

| 日请求量 > 100K | 必须蒸馏 | 10-60 倍的成本差距,每天都在复利 |

| 延迟敏感(< 200ms) | 蒸馏 | 小模型快 3-10 倍 |

| 数据隐私要求高 | 蒸馏 + 自托管 | 数据不出服务器 |

| 任务经常变化 | 直接调大模型 | 重新蒸馏成本不低 |

通过 Crazyrouter,你可以用同一个 API Key 从任何教师模型(Claude、GPT、Gemini、DeepSeek)生成训练数据,然后部署你蒸馏出的学生模型——全部通过一个统一的 API 端点搞定。

蒸馏的未来(其实已经是 2026 年的现在)

这些「未来趋势」,很多已经在落地了:

- MoE + 蒸馏: Llama 4 和 Qwen 3 把 MoE(混合专家)架构和蒸馏结合——教师是超大 MoE 模型,学生是更小的 MoE 或稠密模型。这已经成为主流范式。

- 自蒸馏(Self-distillation): 模型自己蒸馏自己(DeepSeek-R1 就用了强化学习 + 自蒸馏)

- 渐进式蒸馏(Progressive distillation): 多级蒸馏链(Behemoth → Maverick → Scout;R1 671B → 70B → 32B → 7B → 1.5B)

- 端侧蒸馏: Qwen 3.5 Small 系列(0.8B-9B)专门为手机和边缘设备蒸馏优化

- 任务特化蒸馏: 不做通用压缩,只蒸馏你需要的能力

- 合成数据蒸馏: 用教师模型生成整个训练数据集(微软的 Phi 系列、Google 的 Gemma)

趋势很明确:前沿大模型正在变成训练数据的生成器。你可能永远不会直接调那个最大的模型——但你用的每个便宜模型,都是从它身上蒸馏出来的。

对于中国开发者来说,这是一个巨大的机遇。DeepSeek 和 Qwen 系列已经提供了高质量、可合法蒸馏的开源大模型。你不需要拿别人的闭源 API 偷偷蒸馏,完全可以在开源生态里合法、高效地打造自己的专属模型。

总结

- 蒸馏就是大模型(教师)把知识传授给小模型(学生)

- 你用的每个 mini/flash/haiku/turbo 模型,大概率都是蒸馏出来的

- DeepSeek-R1-Distill 证明了蒸馏模型也能媲美前沿推理能力

- 争议不断——大多数 API 厂商禁止用输出训练竞品

- 开发者也能用——用大模型生成训练数据,微调小模型

- 省钱效果惊人——成本降低 10-60 倍,性能保留 80-95%

延伸阅读

知识蒸馏是让强大 AI 能力走向普及的关键技术。本文数据更新于 2026 年 3 月,涵盖 Llama 4、Qwen 3、GPT-5、Gemini 2.5 等最新蒸馏案例。获取最新模型对比和价格信息,请访问 Crazyrouter 博客。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)