最新 AI 论文盘点(2026-03-30):6 篇新作看 agent 外部化、LLM 自我改进、RAG 基础工程与研究型 AI 迭代

最新 AI 论文盘点(2026-03-30):6 篇新作看 agent 外部化、LLM 自我改进、RAG 基础工程、可信 AI 的“内存瓶颈”,以及研究型 AI 如何开始真正迭代自己

今天这批论文放在一起看,我的一个直观感受是:

AI 研究正在从“把模型做得更强”转向“把系统做得更可持续”。

这里的“可持续”不是泛泛地说效率,而是指几个更具体的问题:

- agent 的行为逻辑能不能从代码里抽出来,变成可迁移、可比较、可演化的对象

- LLM 能不能形成真正闭环的自我改进,而不是只在 inference 阶段做几轮 self-refine

- RAG 这种已经非常工程化的系统,能不能把长期被低估的基础环节做扎实

- 可信 AI 讨论能不能从抽象原则继续往下走,落到真正卡住系统扩展性的硬件与 memory 约束

- 研究型 AI 能不能不只“生成点子”,而是学会根据细粒度反馈持续把点子打磨成熟

如果把今天值得看的几篇论文串起来,我觉得有 4 条线特别清楚:

- agent harness 正在成为独立研究对象,而不再只是埋在 controller code 里的工程细节

- self-improvement 进入系统化梳理阶段,开始从零散技巧过渡到闭环框架

- AI 工程开始重新重视基础设施层的关键细节,比如 chunking 与 memory access 这种过去容易被忽略的“非 headline 问题”

- 研究型 AI 正在从一次性生成走向可迭代优化,反馈的粒度和回路设计变得越来越关键

还是按最有用的方式来:

1. 它到底在解决什么问题

2. 方法的新意是什么

3. 为什么现在值得关注

4. 它的边界和风险在哪

1)Natural-Language Agent Harnesses

论文: Natural-Language Agent Harnesses

链接: https://arxiv.org/abs/2603.25723

这篇是我今天最想优先标出来的一篇,因为它切中了 agent 研究里一个很少被认真单独讨论、但其实极其核心的问题:

很多 agent 的上限,已经不只是 model 本身决定的,而是被 harness 决定。

所谓 harness,本质上就是 agent 的高层控制逻辑:

- 什么时候调用工具

- 失败后怎么恢复

- 多步任务怎么拆

- 状态如何持久化

- 模块之间怎么传递约束

问题在于,这些东西过去大多被埋在 controller code、runtime 约定、各种框架私有逻辑里。结果就是:

- 很难迁移

- 很难比较

- 很难复现实验

- 更难把 harness 本身当成独立对象来优化

这篇论文提出的核心想法是:

能不能把 agent harness 直接外部化成“可执行的自然语言工件”。

它给出两个关键词:

- NLAHs:Natural-Language Agent Harnesses

- IHR:Intelligent Harness Runtime

也就是说,把原来散落在代码里的高层调度与约束,尽量转成可编辑的自然语言规范,再由统一 runtime 去执行。

为什么值得关注?

因为这实际上是在重新定义一件事:

agent 的“程序”也许不该只是一堆代码,它也可以是可读、可移植、可实验的行为规范。

这件事一旦成立,会直接影响:

- agent 复现与 benchmark 公平性

- 跨框架迁移成本

- 人类审查 agent 行为的可解释性

- harness 的版本管理与快速迭代

换句话说,它把 agent 的很多“黑盒工程经验”往“显式对象”方向推了一步。

边界是什么?

- 自然语言 harness 的表达力强,但歧义也会更高

- runtime contract 如果不够严格,最后仍然会退回到“看实现细节”

- 越复杂的系统,越难完全用自然语言稳定覆盖边界条件

但即便如此,这篇也很值得跟,因为它试图把 harness engineering 从隐性经验抽成显性研究对象。

2)Self-Improvement of Large Language Models: A Technical Overview and Future Outlook

论文: Self-Improvement of Large Language Models: A Technical Overview and Future Outlook

链接: https://arxiv.org/abs/2603.25681

这篇不是某个单点方法,而是一篇很典型的“方向正在成形”的综述信号。

过去大家谈 self-improvement,很多时候还是零散地聊:

- self-play

- synthetic data

- self-refine

- self-critique

- test-time search

- automatic evaluation

但这篇工作的价值在于,它开始把这些东西放回一个更完整的闭环生命周期里去理解。

论文把 self-improving LLM system 概括成几块:

- data acquisition

- data selection

- model optimization

- inference refinement

- autonomous evaluation

这意味着作者不是把“模型自己改自己”理解成某一个 trick,而是理解成:

模型逐步接管数据生成、信号筛选、参数更新、推理修正和评价监控的一整套循环。

为什么值得关注?

因为这其实说明了一个趋势:

LLM self-improvement 已经开始从“局部增强手段”转向“下一代训练/部署范式”的讨论。

真正限制前沿模型继续往上走的,不只是算力和参数量,还有:

- 高质量人工反馈越来越贵

- 人类在部分任务上已经难以提供足够强的 supervision signal

- 模型本身越来越能承担一部分数据构造、评估与修正工作

所以这条线未来可能会越来越重要。

边界是什么?

- self-generated signal 很容易自我强化偏差

- autonomous evaluation 如果不稳,整个闭环会出现“自己夸自己”的问题

- 一旦错误反馈进入循环,规模化后会把问题放大而不是缩小

所以我会把这篇看作一个很好的“地图”,但不把它误读成“闭环已经成熟”。

3)Adaptive Chunking: Optimizing Chunking-Method Selection for RAG

论文: Adaptive Chunking: Optimizing Chunking-Method Selection for RAG

链接: https://arxiv.org/abs/2603.25333

这篇看起来不如 agent、self-improvement 那么“headline”,但我反而觉得它很实用,而且很容易被真正做系统的人看懂价值。

RAG 这些年大家花很多精力在:

- embedding

- retriever

- reranker

- query rewrite

- generation prompt

可一个长期存在的现实是:

如果 chunk 切得不对,后面很多优化都是在错误基础上精修。

这篇论文的核心观点很直接:

chunking 不是 one-size-fits-all。不同文档应该匹配不同的切分策略。

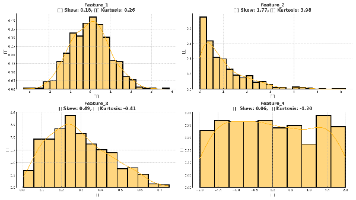

作者提出的是一套 adaptive chunking framework,不是默认某一种 chunker 永远最好,而是根据文档特征来选择更合适的方法。

更重要的是,它还提出了一组专门评估 chunking 质量的 intrinsic metrics,包括:

- References Completeness (RC)

- Intrachunk Cohesion (ICC)

- Document Contextual Coherence (DCC)

- Block Integrity (BI)

- Size Compliance (SC)

这个点很关键。

因为过去 chunking 往往只通过最终 QA 表现间接评估,缺少独立的质量衡量框架。结果就是大家知道“chunk 很重要”,但不知道到底该怎么系统比较。

为什么值得关注?

因为它代表了一个很健康的方向:

RAG 正在从“多堆几个 fancy 模块”转向把基础工程的关键变量做显式建模。

而且这类改进常常特别值钱:

- 不一定需要换更大的模型

- 不一定要重训 retriever

- 却可能带来稳定的整体收益

论文里报告的提升也说明,chunking 不是边角料,而是会显著影响最终答案质量。

边界是什么?

- intrinsic metrics 设计得再好,也不一定完全覆盖 downstream 任务需求

- 文档自适应策略可能会引入新的系统复杂度

- 不同领域语料的结构差异很大,泛化要继续验证

但总的来说,这是一篇非常适合真正做知识库/RAG 产品的人认真看的文章。

4)A Unified Memory Perspective for Probabilistic Trustworthy AI

论文: A Unified Memory Perspective for Probabilistic Trustworthy AI

链接: https://arxiv.org/abs/2603.25692

这篇有点“硬”,但我觉得它值得放进今天的盘点,因为它提醒我们:

可信 AI 不是只靠算法原则、训练目标和 safety policy 就能实现的,它还会被底层 memory 系统掐住脖子。

论文关注的是 probabilistic trustworthy AI。作者的观点是,很多这类系统为了实现:

- robustness

- interpretability

- security

- privacy

会引入大量概率式计算与随机采样。

而一旦这样做,系统瓶颈可能就不再主要是 arithmetic unit,而是:

memory system 同时要高效提供“数据”和“随机性”。

作者提出一个统一视角:

- 把 deterministic access 视为 stochastic sampling 的极限情况

- 在统一框架里分析 data access 与 sampling demand

- 进而讨论 memory-level evaluation criteria 与新型 probabilistic compute-in-memory 方案

为什么值得关注?

因为很多“可信 AI”讨论停在抽象层:

- 要更稳

- 要更可解释

- 要更安全

- 要更隐私友好

但当这些目标真落进系统实现里时,经常会产生新的硬件/系统瓶颈。论文的价值在于把这个问题挑明:

可信性不是免费的,尤其当它依赖概率式机制时,memory 可能成为第一瓶颈。

边界是什么?

- 这篇更偏框架与视角,不是马上能直接部署的工程 recipe

- 从概念统一到真正通用架构,还隔着相当长的系统实现距离

- compute-in-memory 这类方向要走向成熟,仍然需要材料、工艺、编译与软件栈共同配合

但如果你不想把 trustworthy AI 只理解成“算法口号”,这篇很值得看。

5)EvoIdeator: Evolving Scientific Ideas through Checklist-Grounded Reinforcement Learning

论文: EvoIdeator: Evolving Scientific Ideas through Checklist-Grounded Reinforcement Learning

链接: https://arxiv.org/abs/2603.21728

这篇很有意思,因为它不是简单地让模型“生成研究想法”,而是更进一步问:

能不能让模型像研究者那样,在反馈里不断把一个粗糙 idea 迭代成更像样的 proposal?

这正好卡在研究型 AI 的关键痛点上。

很多模型其实已经能给出“看起来像研究题目”的东西,但真正难的是后面的演化过程:

- 有没有 grounding

- 可行性够不够

- 方法是否具体

- 评价设计是否扎实

- 有没有只是把 buzzword 重新拼接了一遍

EvoIdeator 的新意在于,它不用单一的 rubric 分数粗暴打分,而是引入 checklist-grounded feedback,让 judge model 输出两类信号:

- 用于多维优化的 lexicographic rewards

- 对具体片段给出细粒度语言反馈

这其实是在做一件很重要的事:

把“反馈”从模糊总体印象,变成可以进入 RL 回路的结构化优化信号。

为什么值得关注?

因为研究型 AI 如果想真的从 demo 走向工具,关键往往不是“第一次生成”,而是“第 N 次修正”。

这篇工作说明:

- 反馈粒度越细

- 回路设计越明确

- 模型越有可能学到稳定的改进行为

而不是只会在 prompt 里表演“我来再改一版”。

边界是什么?

- judge model 本身的偏差会直接影响 idea evolution 的方向

- checklist 很容易把创造性收束到某种“标准答案审美”里

- 科研价值的真正评价很长周期,离线指标未必等价于现实研究影响

但这篇至少把“研究型 AI 的改进回路”往前推了一步。

6)A Context Engineering Framework for Improving Enterprise AI Agents based on Digital-Twin MDP

论文: A Context Engineering Framework for Improving Enterprise AI Agents based on Digital-Twin MDP

链接: https://arxiv.org/abs/2603.22083

这篇是典型的“名字看起来企业味很重,但方法论其实值得 agent 圈关注”的工作。

现在很多 agent 改进还停在:

- prompt engineering

- 加工具

- 加 memory

- 再补一点 self-reflection

但论文提出的方向更系统一些:

把 agent 的推理/决策过程抽象成一个 Digital-Twin MDP,再用 offline RL 和 reward estimation 去优化 context engineering。

这意味着作者不是把 context 当成静态提示模板,而是把它视作会影响 policy 的可优化对象。

为什么值得关注?

因为它反映了一个越来越清晰的趋势:

context engineering 正在从“经验调参”走向“可建模、可离线优化”的对象。

这对 enterprise agent 特别重要,因为真实企业环境往往有:

- 高成本试错

- 数据质量参差

- 在线探索风险高

- 缺少明确反馈

在这种场景里,digital twin + offline RL 的思路天然有吸引力。

边界是什么?

- MDP 抽象是否足够贴近真实 agent 行为,会决定上限

- offline RL 在分布外行为上的稳定性仍然是老问题

- “context 优化”如果只在单域成立,迁移性会受限

但这个方向值得看,因为它把一个常被当成黑魔法的东西,开始往正式优化框架里收。

今天这 6 篇,值得记住的 4 个判断

如果只看结论,我会把今天这批论文总结成下面 4 点:

1. agent 的竞争,越来越不是单纯比底模,而是比 harness、context 和反馈回路

这从 Natural-Language Agent Harnesses 和 DT-MDP context engineering 两篇里体现得很明显。

真正的 agent 能力,越来越是“系统设计能力”的体现,而不只是模型参数能力的直接外溢。

2. self-improvement 正在从零散技巧,变成一整套闭环工程

综述论文和 EvoIdeator 都说明,未来真正重要的问题不是“模型能不能自己改”,而是:

- 改进信号从哪来

- 谁来评价

- 怎样避免错误闭环

- 怎样让改进能跨任务泛化

3. 很多 AI 系统的瓶颈,正在重新回到基础设施层

Adaptive Chunking 说明,RAG 的关键变量可能一直就在基础处理环节里;Unified Memory 说明,可信 AI 会真实地撞上底层 memory/entropy 瓶颈。

这类工作 headline 感没那么强,但往往更接近“能不能落地”。

4. 研究型 AI 开始从“一次性生成”走向“可持续打磨”

这可能是未来很重要的一条线。

会出点子当然重要,但更重要的是:

能不能通过结构化反馈,把一个普通点子持续推成更靠谱的研究计划。

如果只选 3 篇,我建议优先看这三篇

第一优先:Natural-Language Agent Harnesses

因为它可能会影响你怎么理解下一代 agent stack。

第二优先:Self-Improvement of Large Language Models

因为它提供了一张很好的总地图,适合校准方向感。

第三优先:Adaptive Chunking

因为它最容易转化成今天就能影响系统效果的工程收益。

最后一句

今天这批论文最有意思的共同点,不是它们都在追求“更强”,而是它们都在试图回答同一个更现实的问题:

当 AI 系统开始长期运行、持续迭代、接入真实任务后,什么才是决定它能不能真正可用的关键结构?

而答案看起来越来越清楚了:

- 不是只有模型参数

- 不是只有 benchmark 分数

- 而是 harness、反馈、memory、chunking、world model、evaluation 这些过去更像“配角”的东西

现在,这些配角正在走到台前。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)