【AI大模型入门】A03:GPT-1/2/3——从“能写字“到“像人一样写“的进化史

【AI大模型入门】A03:GPT-1/2/3——从"能写字"到"像人一样写"的进化史

📖 阅读时长:约10分钟

🎯 适合人群:想了解ChatGPT"前世"的人,想知道AI写作能力是怎么进化的

💡 你将学到:GPT三代的关键突破、为什么GPT-2"太危险"、GPT-3如何震惊世界

一、先说一件有趣的事

2019年,OpenAI在发布GPT-2时,做了一个罕见的决定:不公开发布完整模型。

理由是:这个AI生成的文字太真实了,他们担心被用于大规模制造假新闻、虚假评论、钓鱼邮件……

一个AI公司,主动限制自己技术的传播,因为"太强了可能有害"——这个新闻本身就说明了GPT-2的突破有多大。

二、GPT 系列的诞生背景

2017年Transformer论文出现后,Google用它做了BERT——专注于"读懂"语言。

OpenAI走了另一条路:用Transformer做语言生成——让AI"写出"语言。

这就是GPT(Generative Pre-trained Transformer,生成式预训练Transformer)系列的起点。

📄 相关论文:

- GPT-1:Improving Language Understanding by Generative Pre-Training(Radford et al., 2018)

- GPT-2:Language Models are Unsupervised Multitask Learners(Radford et al., 2019)

- GPT-3:Language Models are Few-Shot Learners(Brown et al., 2020)

📄 论文解读专栏:敬请期待 《GPT-3原论文解读:175B参数与Few-Shot学习》

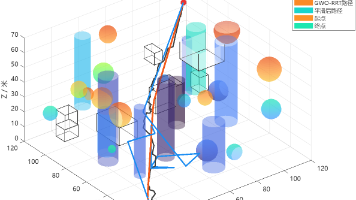

▲ GPT-3 是当时最大的语言模型,首次展示了强大的 Few-Shot(少样本学习)能力——只需提供2-3个示例,就能完成全新任务。

三、GPT-1(2018年):证明"路走得通"

发布时间:2018年6月

参数量:1.17亿(1.17 × 10⁸)

训练数据:约5GB文本(书籍数据)

核心思路

GPT-1 的训练目标极其简单:给定前面的词,预测下一个词。

训练方式:

输入:"今天天气"

目标:预测下一个词 → "真"

再输入:"今天天气真"

目标:预测下一个词 → "好"

以此类推……

重复这个过程数十亿次,模型逐渐学会了语言的规律。

GPT-1 的意义

GPT-1 本身不算强,但它验证了一个思路:

用大量文本做无监督预训练,再在特定任务上微调 → 效果超越很多专门设计的模型

这个思路后来成了整个大模型领域的基石。

四、GPT-2(2019年):太真实,"不敢"全公开

发布时间:2019年2月

参数量:15亿(GPT-1的10倍多)

训练数据:40GB高质量网络文本(Reddit 高赞内容)

戏剧性的发布方式

OpenAI分四个阶段才完整发布GPT-2:

- 2月:只发布最小版本(1.17亿参数)

- 5月:发布中等版本

- 8月:发布较大版本

- 11月:才完整发布15亿参数版本

理由:防止滥用,因为GPT-2生成的文字太以假乱真。

GPT-2 能做什么?

给它一段开头,它能写出相当连贯的续文:

输入(人类写的):

"独角兽研究员发现,深藏在安第斯山脉的独角兽群

竟然能说流利的英语……"

GPT-2续写(自动生成):

"这一发现震惊了语言学界。研究人员记录了独角兽

使用包括英语、葡萄牙语和法语在内的多种语言交流。

独角兽似乎通过回声定位进行沟通……"

虽然内容是虚构的,但语言流畅、逻辑连贯,让人第一眼看不出是机器写的。

GPT-2 的局限

但仔细看,GPT-2还有明显缺陷:

- 长篇内容会"跑题",越写越偏

- 有时会重复自己说过的内容

- 不能和用户真正"对话",只会续写

- 数学、逻辑推理很弱

五、GPT-3(2020年):震惊世界的1750亿参数

发布时间:2020年5月

参数量:1750亿(GPT-2的116倍!)

训练数据:45TB文本数据

训练费用:约460万美元

参数量带来的质变

GPT-1 → 1.17亿参数 → 能写,但明显像机器

GPT-2 → 15亿参数 → 流畅,但内容经不起推敲

GPT-3 → 1750亿参数 → 质的飞跃,大量任务接近人类

1750亿是个什么概念?如果每个参数存1个字节,全部参数加起来有170GB。训练一次需要在超级计算机上运行好几周。

GPT-3 真正令人惊讶的地方:少样本学习

以前的AI要做一个新任务,需要给它大量例子重新训练(微调)。

GPT-3 展现出了惊人的 Few-shot Learning(少样本学习) 能力:

你给它3个例子,告诉它规则:

英语 → 法语:

"sea otter" → "loutre de mer"

"peppermint" → "menthe poivrée"

"plush giraffe" → "girafe en peluche"

然后问:

"cheese" → ?

GPT-3:fromage ← 正确!不需要重新训练!

这意味着 GPT-3 在训练时学到的不只是知识,还学到了"学习方法"本身。

GPT-3 的能力展示

GPT-3 发布后,研究者们做了大量测试,结果令人惊叹:

任务 表现

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

写各类风格的文章 接近人类水平

回答问答题 接近人类水平

代码补全(Python/JS等) 中等水平,但已有实用价值

算术(基本运算) 中等,复杂计算易出错

常识推理 超越很多先前专用模型

翻译(英→法/德/中等) 接近专业翻译工具

GPT-3 带动的产业热潮

GPT-3 的API一开放,开发者们蜂拥而至,基于GPT-3做了大量产品:

- AI写作工具(Jasper、Copy.ai等)

- 代码补全工具(Copilot的前身)

- 客服机器人

- 搜索增强工具

这是第一次,AI语言能力真正进入了商业应用。

六、GPT-3 的缺陷:强大但"不稳定"

GPT-3 很强,但有个根本性问题:它只是在续写,并不真正理解你想要什么。

问:帮我写一首关于猫的诗

GPT-3:(可能给你一首非常长的诗,重复堆砌,不够精练)

问:写一首8行的关于橘猫在晒太阳的诗,要押韵

GPT-3:(理解得好一些,但结果质量不稳定,有时很好有时很差)

它缺少的,是"理解用户真正的意图"和"知道什么是好答案"的能力。

这个问题,被后来的 GPT-3.5(也就是 InstructGPT)和 ChatGPT 通过一种叫 RLHF(基于人类反馈的强化学习) 的技术解决了——这就是2022年底 ChatGPT 横空出世的秘密。

七、三代GPT的进化全景

GPT-1 (2018)

↑ 证明了预训练+微调的路线可行

GPT-2 (2019)

↑ 展示了规模带来的质量提升,"太危险不敢全发"

GPT-3 (2020)

↑ 1750亿参数,展现少样本学习,引爆产业应用

InstructGPT (2022初)

↑ 加入人类反馈,让模型"听话"、懂意图

ChatGPT (2022.11)

↑ 面向大众的对话产品,5天100万用户,改变世界

八、总结

| 版本 | 年份 | 关键词 | 意义 |

|---|---|---|---|

| GPT-1 | 2018 | 预训练+微调 | 验证路线 |

| GPT-2 | 2019 | 太真实/风险 | 规模效应初显 |

| GPT-3 | 2020 | 1750亿/少样本 | 通用AI能力引爆 |

这三代GPT,是现代大模型革命的序章。没有它们的积累,就没有后来改变世界的ChatGPT。

🔔 下一篇预告

【AI大模型入门】B02:Stable Diffusion——开源绘图,让AI绘画飞入寻常百姓家

本文为【AI大模型百科专栏】第A03篇 · 奠基时代

作者:[孤岛站岗]

更新时间:2026年3月

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)