自进化Agent综述:A Survey of Self-Evolving Agents

摘要

大型语言模型(LLMs)在各类任务中展现出卓越的能力,但其本质仍是静态的——无法根据新任务、不断演化的知识领域或动态交互环境调整自身的内部参数。随着 LLM 越来越多地被部署于开放、交互式的环境中,这种静态特性已成为关键瓶颈,迫切需要能够实时进行适应性推理、行动与演化的智能体。这一范式转变——从单纯扩展静态模型转向构建自进化智能体——激发了学界对支持持续学习与适应(从数据、交互和经验中)的架构与方法的广泛关注。

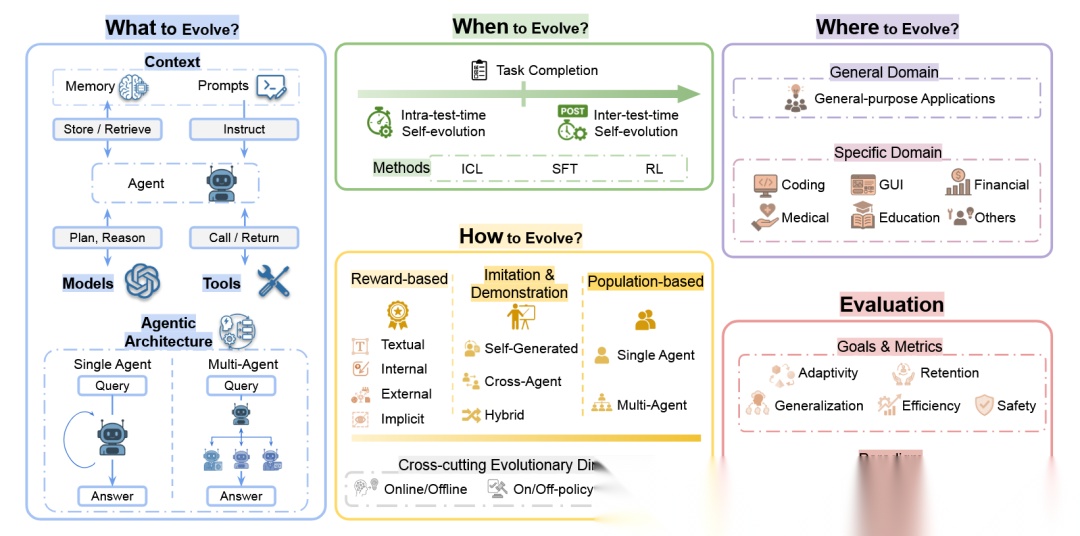

本综述首次对自进化智能体领域进行了系统而全面的梳理,并围绕三个基础维度组织现有研究:进化什么(what to evolve)、何时进化(when to evolve)以及如何进化(how to evolve)。我们考察了智能体各组成部分(如模型、上下文、工具、架构)的演化机制,按阶段(如测试时内、测试时间隔)对适应方法进行分类,并分析了指导演化适应的算法与架构设计(如基于奖励、文本反馈、单智能体与多智能体系统)。此外,我们还梳理了专为自进化智能体定制的评估指标与基准测试,展示了其在编程、教育、医疗等领域的应用,并指出了在安全性、可扩展性及协同演化动力学等方面的关键挑战与未来研究方向。

通过提供一个结构化的理解与设计框架,本综述为研发更具适应性、能力更强、更鲁棒且更通用的智能体系统铺平了道路,不仅推动学术研究与实际部署的发展,也为实现人工超级智能(Artificial Super Intelligence, ASI)——即智能体能够自主演化并在广泛任务上超越人类水平——提供了重要启示。

文章脉络,五个重点。

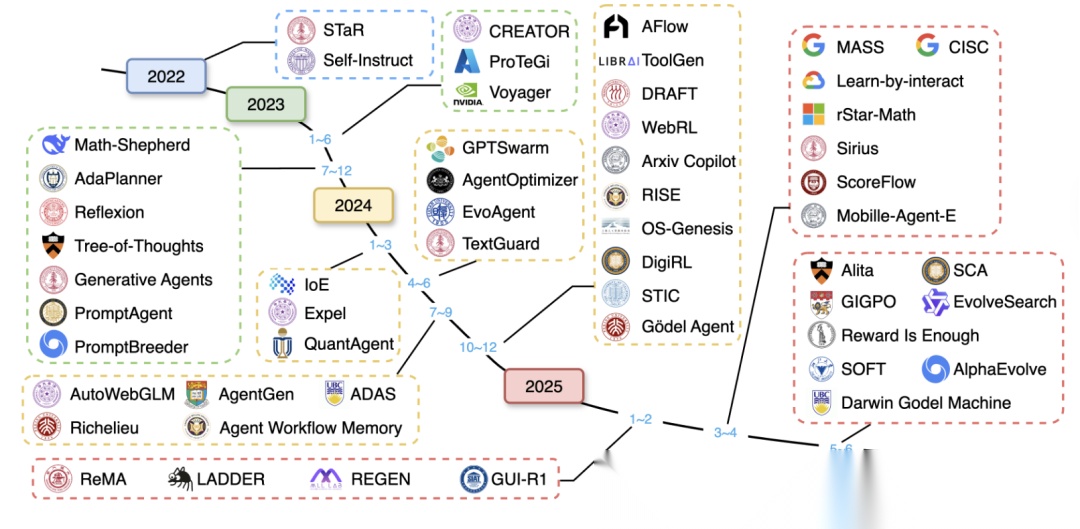

22年至25年7月的Agent自进化方法。

What to Evolve?

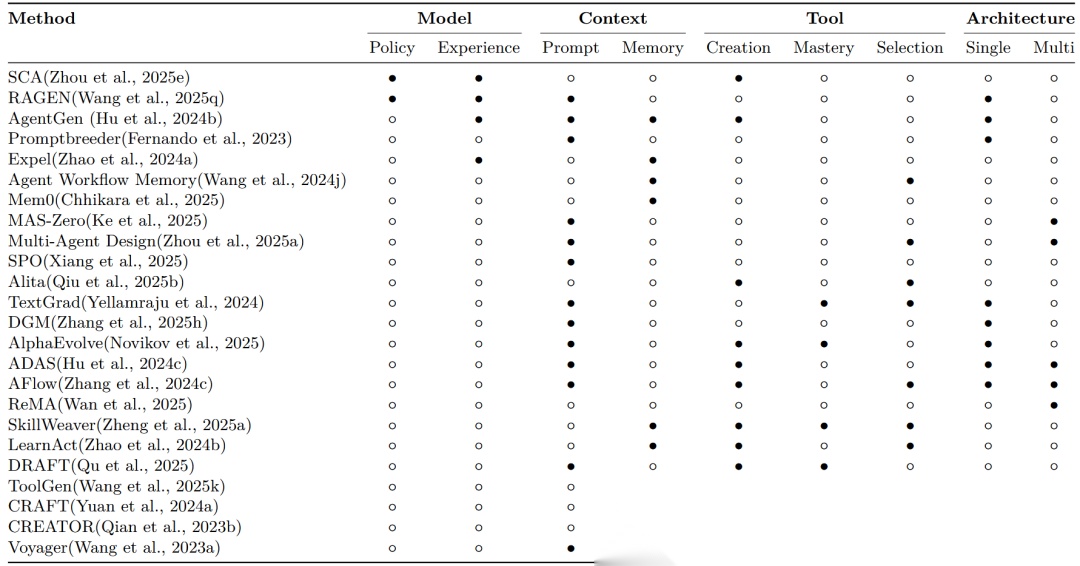

四个方向:Model、Context、Tool、Architecture

作者列出的方法中主要围绕Context、Tool、Architecture,围绕Model的自进化方法相对较少。

Models

人工标注训练数据的获取成本高且覆盖范围有限,而完全依赖合成数据又往往难以保证质量。在这一背景下,相关研究开始探索在无人工监督条件下对模型参数进行更新的方法。这类方法通常由智能体自行生成可用于训练的信号,并将其直接用于参数优化。例如,智能体可以生成任务及其解答,并从成功的执行轨迹中构造监督数据以进行微调;也有工作将执行过程中的轨迹信息或自然语言形式的反馈解释为奖励信号,并结合监督学习或强化学习更新模型参数。进一步地,一些方法通过让智能体与环境交互甚至构建环境来获取更丰富的经验数据,并将这些经验持续回收用于模型更新,从而支持模型参数的长期调整。

Context

演化上下文来改变智能体行为的方法,通过显式维护可更新的memory以及可修改的prompt,将交互过程中产生的任务轨迹、反馈或反思信息写入记忆,并在后续任务中通过检索机制将相关内容注入模型输入。同时,累积的经验也可以被用于重写或调整提示中的策略描述,使智能体在不更新模型参数的情况下,仍能在多轮交互中逐步改变决策行为。

Tools

在工具使用场景下,相关方法将工具调用视为智能体可以自主决策的动作,而不是预先设定的固定流程。智能体在执行任务的过程中记录工具调用序列及其成功或失败的结果,并利用这些执行反馈调整后续的工具选择与组合方式。随着交互的不断进行,虽然可用工具集合保持不变,但工具使用策略会根据经验逐步发生变化,从而影响多步任务中的行动路径和整体执行效率。

Architecture

相关方法通过调整智能体的架构来影响任务执行过程。这种调整既可以发生在单智能体内部,例如改变推理与执行模块的组织方式或调用顺序;也可以体现在多智能体系统中,通过重新分配角色分工或调整通信结构来改变协作方式。任务执行结果被用来评估当前架构的有效性,并据此对系统结构进行修改或替换,从而在不更新模型参数的情况下,改变整体的决策流程与协作模式。

When to Evolve?

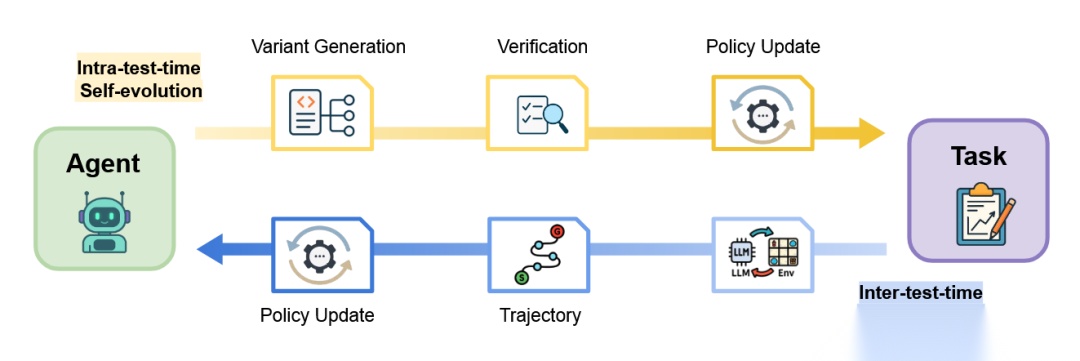

Intra-test-time self-evolution(任务内进化)

自进化发生在单个任务尚未完成的过程中。智能体在执行当前任务时,会生成多种候选行为或解法,并对这些变体进行快速验证或自检;基于验证结果,智能体立即调整当前使用的策略或决策方式,并将更新后的策略继续用于同一任务的后续步骤。这一过程不依赖完整的任务执行记录,通常只利用局部反馈,其影响范围局限在当前任务之内。

Inter-test-time self-evolution(任务间进化)

自进化发生在任务完成之后。智能体在固定策略下完成一次完整的任务执行(rollout),并将整个执行过程记录为轨迹(trajectory)。随后,智能体基于这些轨迹构造训练信号,对策略或模型参数进行更新,并将更新结果保留,用于后续任务的执行。这类自进化依赖完整的任务经验,其效果能够跨任务累积。

How to Evolve?

随着时间推移,关于自进化智能体的研究逐步形成了三大范式——基于奖励、基于模仿和基于群体的进化,每一种范式均是在应对前一类方法所暴露的局限性时发展而来。基于奖励的方法最早通过引入显式反馈信号闭合了自我改进的反馈环路,但在实践中往往表现出脆弱性和较高的设计与计算成本。随后,基于模仿的学习通过利用高质量的演示轨迹,使进化过程更加稳定,尽管在某些情况下会牺牲策略探索的空间。进一步地,基于群体的进化将适应机制扩展至集体尺度,强调多样性维持以及由此产生的协调行为。这些范式共同勾勒出一条从个体层面的自我提升逐步迈向群体层面协同智能的演进路径。

Reward-based Self-Evolution

- Textual Feedback

以自然语言形式给出对输出或过程的评价、比较或修正建议。这类反馈不依赖数值打分,而是通过语言表达质量判断,适合难以形式化评价的推理、规划与工具使用任务。

- Internal Reward

由模型自身产生的信号,通常基于概率、置信度或不确定性估计。它无需外部监督,可作为自评依据,引导模型偏向更一致或更确定的输出。

- External Reward

来自模型外部的明确反馈,如环境返回、规则检查结果或投票机制。这类信号清晰、可解释,常用于强化学习,但设计与获取成本较高。

- Implicit Reward

不显式定义复杂奖励函数,而通过简单标量指标(如成功率、通过率)间接反映效果。实现成本低,信号较弱但稳定,适合轻量级或快速反馈场景。

Imitation and Demonstration Learning

- Self-generated Demonstrations

智能体在执行任务过程中自行生成多种解法或行为轨迹,并通过自评、规则检查或简单筛选机制选出表现较好的轨迹,将其作为监督数据用于后续学习。这类方法不依赖人工示范,能够将智能体自身的成功经验直接转化为学习信号。

- Cross-agent Demonstrations

示范轨迹由其他智能体提供,通常来自并行运行的不同模型或策略。表现较优的智能体产生可模仿的轨迹,其他智能体通过学习这些轨迹改进行为,从而利用群体中的能力差异提升整体学习效率。

- Hybrid Demonstrations

将示范学习与奖励信号相结合,示范用于提供稳定的学习方向,奖励或反馈用于进一步区分和修正行为质量。这种方式在提高学习稳定性的同时,保留了一定的探索空间。

Population-based and Evolutionary Methods

- Single-agent Evolution

在同一智能体内部维护多个策略或参数变体,通过并行评估这些变体在任务中的表现,选择效果更优的版本进行保留或进一步变异。进化的核心操作是“生成—评估—选择”,用于在策略空间中持续搜索更优解,而不依赖精确的梯度或稳定的奖励函数。

- Multi-agent Evolution

同时运行多个智能体实例,通过协作、竞争或自博弈的方式推动策略演化。不同智能体在交互中暴露各自的优势与不足,系统根据整体或个体表现进行选择、复制或调整,从而在群体层面产生更丰富的策略多样性和协同行为。

- Population-level Selection & Variation

在群体层面引入显式的选择与变异机制,如保留高性能个体、淘汰低性能个体,并对保留下来的策略进行扰动或重组。这类机制强调维持策略多样性,避免过早收敛,使系统能够在更大搜索空间中持续探索。

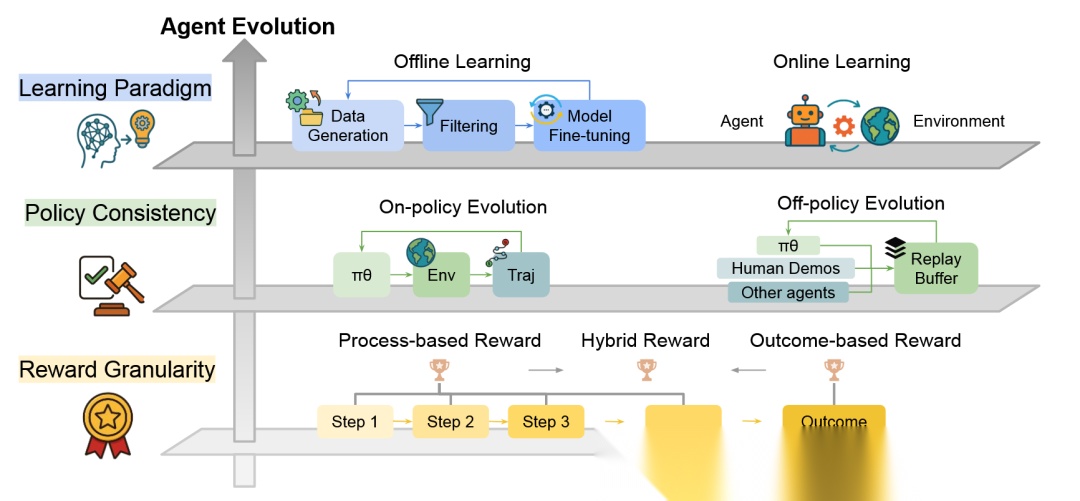

Cross-cutting Evolutionary Dimensions

随着三类核心进化路径(基于奖励、基于模仿、基于群体)的提出,自进化智能体的差异逐渐不再体现在具体算法形式上,而更多体现在实现层面的设计选择。自进化过程可以沿若干横向维度进行刻画,这些维度共同决定了智能体如何获取学习信号、如何利用数据以及如何在稳定性与适应性之间取得平衡。其中,学习范式区分了进化是以离线方式进行(通过数据生成、筛选与集中微调),还是以在线方式嵌入到智能体与环境的持续交互中;策略一致性刻画了学习是否依赖当前策略生成的数据,即 on-policy 与 off-policy 进化之间的差异;奖励粒度则描述反馈信号作用的层级,是针对中间过程、最终结果,还是二者的结合。

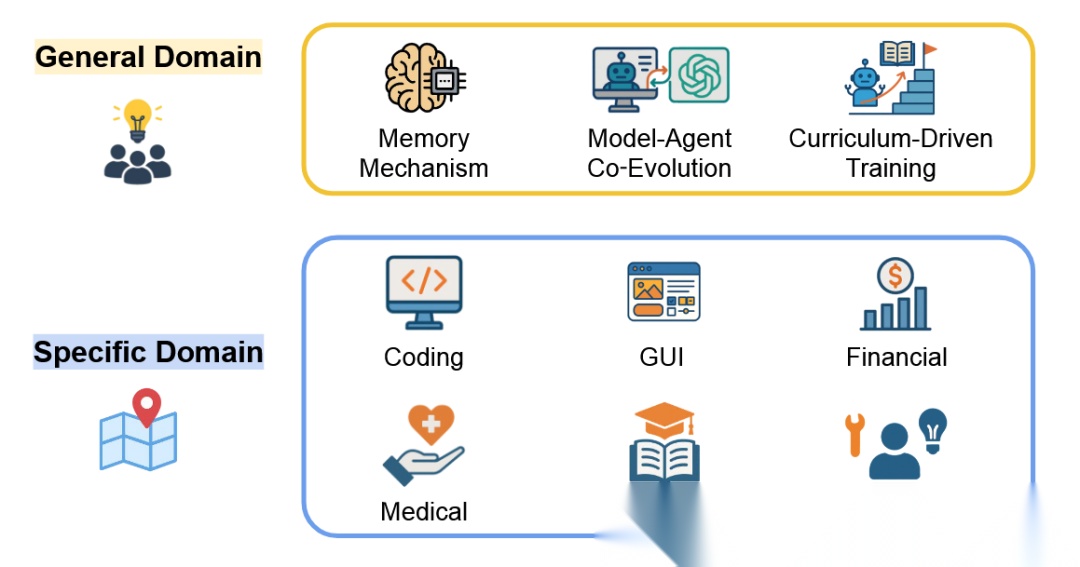

Where to Evolve?

将“进化发生的位置”划分为两大类型:通用领域进化,侧重于在多样化任务中提升智能体的通用能力,包括记忆机制、模型—智能体协同进化、课程驱动训练;以及特定领域进化,旨在在编程、GUI、金融、医疗、教育等具体场景中培养领域专长。

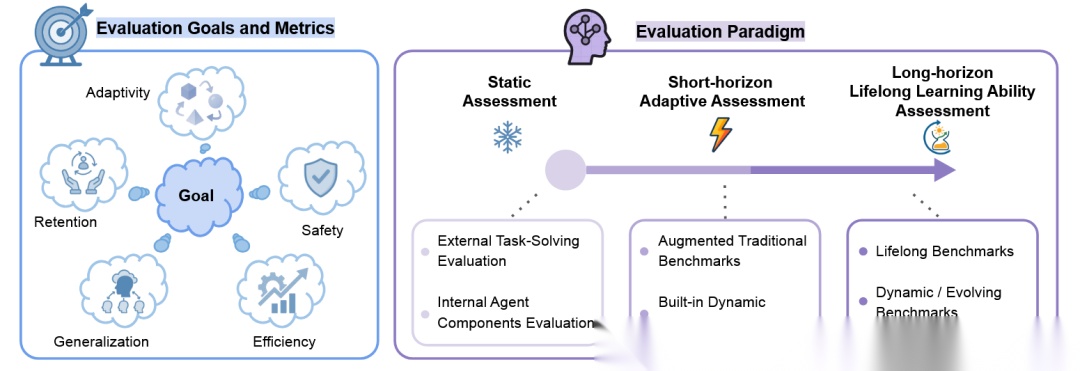

Evaluation

在评估目标上,自进化智能体不再只关注单次任务性能,而是围绕一组长期能力指标展开,包括适应性(adaptivity)、能力保持(retention)、泛化性(generalization)、效率(efficiency)以及安全性(safety)。这些指标共同反映智能体在持续进化过程中是否能够稳定提升,而非仅在静态测试中取得高分。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献148条内容

已为社区贡献148条内容

所有评论(0)