004、实战第一步:使用Hugging Face快速调用与评测大模型

今天有个同事跑来找我,说本地部署的某个开源模型跑起来效果不对劲,输出全是乱码。我让他把代码发我看一眼,结果发现他用了三年前的旧接口写法,连tokenizer都没对齐——这类问题在新手阶段太常见了。我们就从Hugging Face这个“模型超市”入手,聊聊怎么快速、靠谱地调用和评测大模型,避开那些初期容易踩的坑。

为什么从Hugging Face开始?

如果你刚接触大模型开发,我强烈建议先从Hugging Face生态入手。它把模型加载、推理、微调这些流程都标准化了,相当于给了你一套现成的“实验台”。不用自己从头实现注意力机制,也不用折腾复杂的分布式推理,几分钟就能跑起一个70亿参数的模型。重点在于快速验证想法,而不是重复造轮子。

环境准备:别在依赖上浪费时间

创建虚拟环境这一步不能省。我习惯用conda,因为有些模型依赖特定版本的CUDA,conda管理起来更干净。

conda create -n hf-demo python=3.10

conda activate hf-demo

安装包的时候注意版本对齐。transformers和accelerate建议装最新版,但torch版本得看你的CUDA驱动。如果没GPU,就装CPU版本。

# 有GPU的情况

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

pip install transformers accelerate datasets evaluate

# 纯CPU环境

pip install torch --index-url https://download.pytorch.org/whl/cpu

经常有人在这里卡住——显卡驱动太老,装完跑起来就报CUDA错误。先跑nvidia-smi确认CUDA版本,再去找对应的torch版本,别硬装最新。

加载模型:选对仓库和分支

Hugging Face Hub上有几十万个模型,怎么选?新手容易直接搜模型名字,结果下载半天发现不对。我的习惯是:

- 先看模型卡(Model Card),了解训练数据、参数量、推荐使用场景

- 看下载量(Downloads)和点赞数(Likes),社区验证过的更可靠

- 注意许可证(License),商用项目要特别小心

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# 这里踩过坑:模型名要写完整,包括组织名

model_name = "Qwen/Qwen2.5-7B-Instruct" # 别写成"Qwen2.5-7B"

# 自动下载并缓存,第二次运行就快了

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype=torch.float16, # 半精度省内存,但有些老显卡不支持

device_map="auto", # 自动分配多GPU,单卡写"cuda:0"

trust_remote_code=True # 新模型经常需要这个

)

那个trust_remote_code=True很多人会漏掉。现在很多新模型用了自定义层,不加这个参数直接报错。但也要注意安全,只信任你确认过的仓库。

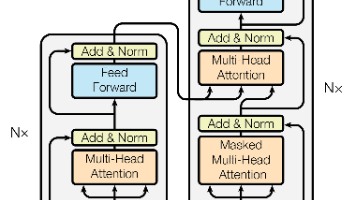

推理流程:prompt模板是玄学

直接扔一段文本给模型,效果往往很差。每个模型都有自己的对话模板,比如ChatML格式、LLama格式。用错了模板,模型可能以为你在让它续写代码而不是回答问题。

# 错误示范:别这样写

prompt = "介绍一下量子计算"

# 正确姿势:套用模型推荐的模板

messages = [

{"role": "system", "content": "你是一个技术专家"},

{"role": "user", "content": "用通俗语言解释量子计算的基本原理"}

]

# 这里有个细节:tokenizer.apply_chat_template是新的标准做法

text = tokenizer.apply_chat_template(

messages,

tokenize=False, # 先不tokenize,方便调试

add_generation_prompt=True

)

print(f"实际输入:\n{text}\n")

# 现在才tokenize

inputs = tokenizer(text, return_tensors="pt").to(model.device)

跑通之后,建议把生成的prompt模板打印出来看看。你会发现模型在用户消息前后加了特殊token,比如<|im_start|>、[INST]这些。不同模型的模板天差地别,这是影响效果的关键因素之一。

生成参数:别用默认值

直接调用model.generate(),默认参数可能生成一堆重复内容。温度(temperature)和top_p这两个参数需要调。

with torch.no_grad():

outputs = model.generate(

**inputs,

max_new_tokens=512, # 控制生成长度

temperature=0.7, # 0.1~0.9,越低越确定

top_p=0.9, # 核采样,和temperature二选一

do_sample=True, # 要采样必须设为True

repetition_penalty=1.1, # 抑制重复,1.0为无惩罚

pad_token_id=tokenizer.pad_token_id # 有些模型没设置pad_token

)

# 解码时跳过输入部分

generated_ids = outputs[0][inputs["input_ids"].shape[1]:]

response = tokenizer.decode(generated_ids, skip_special_tokens=True)

print(f"模型回复:\n{response}")

温度设成0就是贪心搜索,每次都选概率最高的token,结果会非常机械。设太高(>1.0)又容易胡言乱语。我一般从0.7开始试。另一个坑是pad_token_id,有些模型训练时没用padding,tokenizer里就没这个token,不手动设置会报错。

快速评测:别只看一个例子

跑通推理只是第一步,怎么知道模型好不好?我习惯建个测试集,哪怕只有十几个例子。

test_cases = [

{"input": "Python里怎么反转列表?", "category": "编程"},

{"input": "解释Transformer的注意力机制", "category": "理论"},

{"input": "写一段快速排序的C++代码", "category": "代码生成"}

]

for case in test_cases:

# 统一用相同参数生成回复

# 这里可以记录生成时间、输出长度等指标

pass

评测时注意几点:回复相关性、事实准确性、代码可执行性(如果是代码生成)。对于中文模型,还要看中英文混合场景下的表现。别只看一个问题的回答,多维度测试才能发现模型的真实能力边界。

性能监控:显存和速度

跑大模型最怕OOM(内存溢出)。加几行监控代码能省很多调试时间。

import time

from GPUtil import showUtilization # 需要pip install gputil

start = time.time()

# ... 生成代码 ...

end = time.time()

print(f"生成耗时: {end-start:.2f}秒")

showUtilization() # 显示GPU使用情况

# 也可以直接看torch的显存分配

print(f"显存占用: {torch.cuda.memory_allocated()/1024**3:.2f} GB")

如果显存不够,试试量化加载。现在transformers支持bitsandbytes的8bit、4bit量化,能在消费级显卡上跑大模型。

from transformers import BitsAndBytesConfig

quant_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_compute_dtype=torch.float16

)

model = AutoModelForCausalLM.from_pretrained(

model_name,

quantization_config=quant_config, # 加这个参数就行

device_map="auto"

)

量化会损失一点精度,但推理效果通常还能接受。注意4bit量化需要bitsandbytes库,Windows下安装可能麻烦些。

个人经验与建议

-

从7B参数模型开始:70B的模型虽然能力强,但下载慢、推理耗资源。7B模型在消费级显卡上就能跑,适合快速迭代。

-

建立自己的测试集:哪怕只有20个问题,覆盖代码、数学、逻辑、常识等维度。每次换模型都跑一遍,对比效果。

-

注意模型新鲜度:大模型技术迭代快,2022年的模型和2024年的可能差一个代际。优先选最近半年更新的。

-

理解模型的设计目标:有些模型专长代码,有些擅长多轮对话。用错场景就像拿螺丝刀切菜。

-

保存完整的生成日志:包括prompt模板、生成参数、输出结果。一个月后你肯定记不住当时为什么某个参数调成了0.8。

最后提醒一点:Hugging Face虽然方便,但它只是个起点。真正要部署到生产环境,还得考虑服务化、并发、监控、降级方案这些工程问题。但那是后话了——现在,先动手让第一个模型跑起来,看看它能为你做什么。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)