“慧眼识脊”AI助手:从零搭建MRI脊椎智能分割系统UNET

·

嘿,看看这个“智能AI医生”怎么看懂你的脊椎!

想象一下,你给AI看一张脊椎的核磁共振(MRI)照片,它就能像经验丰富的医生一样,把照片里每一块骨头、每一节椎间盘都给你清清楚楚地标记出来。这个系统干的就是这个酷炫的事儿!

1. 数据准备:给AI的“看图说话”训练

要让AI学会看图,得先给它准备一套“教材”。这套“教材”分成两部分:

- 原图:就是一张张脊椎的MRI扫描图。

- 标准答案:对应每张原图,都有一张标注好的“答案图”,图中已经把不同部位(比如不同的椎体、椎间盘)用不同的颜色或灰度标好了。

在训练前,系统会做点“预处理”,就像我们看照片前会调个亮度、摆正一下那样:

- 统一尺寸:把所有图片和答案图都缩放到一样的大小(比如224x224像素),方便AI处理。

- 认识颜色:系统会先去翻看所有的“答案图”,把里面用到的所有颜色(灰度值)都记在一个小本本(

grayList.txt)里,并给它们编上号(0, 1, 2…)。这样AI就知道“哦,0号代表背景,1号代表第一块椎体,2号代表第二块…”。 - 增加“考题”:为了不让AI“死记硬背”,训练时还会随机把一些图片和答案图左右或上下翻转一下,增加题目的花样,让AI学得更“聪明”,更能应对各种角度的扫描图。

2. 大脑核心:U-Net网络

这个AI的“大脑”结构叫U-Net,是处理医学图像的明星模型。它的工作方式很有趣,就像一个“先压缩再展开”的过程:

- “压缩”理解(编码器):先把高分辨率的图片一层层压缩,提取出核心特征(比如“这里有一长条弯曲的东西,可能是脊椎”)。

- “展开”描绘(解码器):然后再一层层把图片还原到原来的大小。关键一步是,在还原的过程中,它会不断回头去看“压缩”时记住的那些细节(比如边缘在哪里),然后把特征和细节结合,最终精确地画出一张分割图,指明每一个像素点属于脊椎的哪个具体部分。

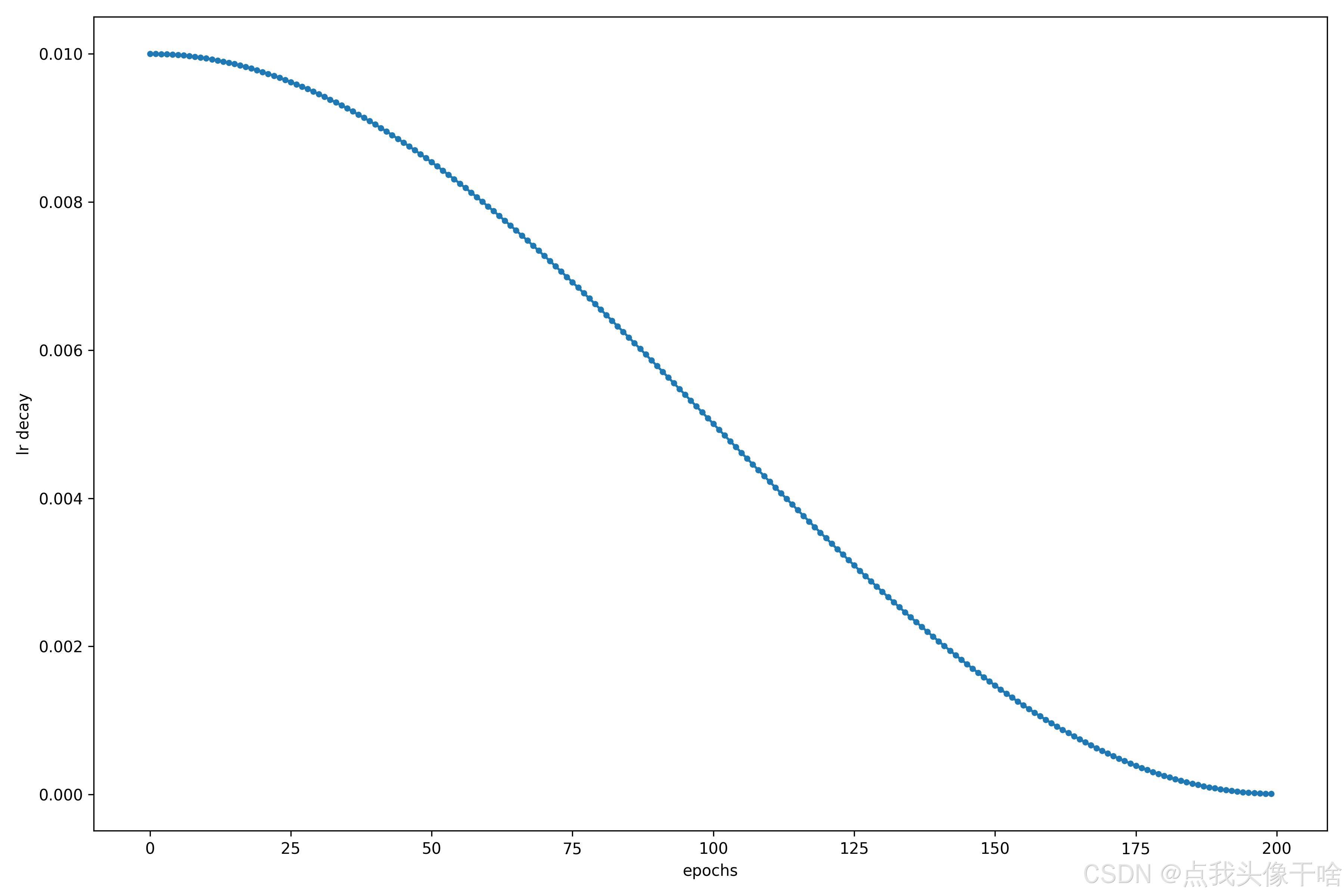

3. 训练与考试:让AI越来越“准”

训练AI就像教学生:

- 自动备课:系统能自己数清楚“答案图”里一共有多少种不同的标记(类别),然后告诉U-Net大脑:“你需要输出这么多种结果。”

- 打分与改进:每次AI做完“练习题”,系统都会用一套非常严格的“评分标准”来打分,不仅仅是看“对/错”,更看重:

- Dice系数/IoU:你画出来的区域,和标准答案的区域,重叠度有多高?(这是医学影像里最重要的指标)

- 精确率、召回率、F1分数:你找对了多少目标?有没有把不是目标的东西也错认了?

- 保存学霸:训练过程中,系统会一直记录成绩。最后会把在“模拟考”(验证集)上得分最高(

mean IoU最好)的那个“学霸模型”和最后一版的模型都保存下来,以备使用。

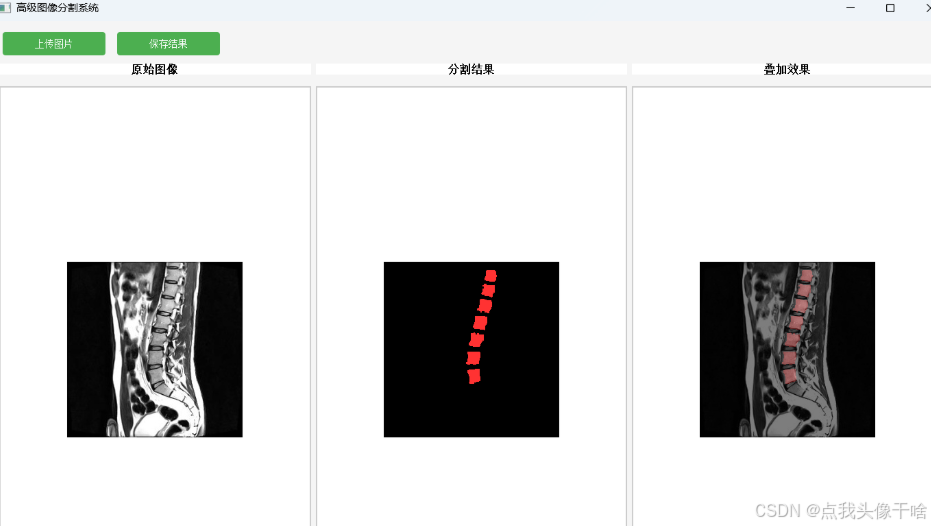

4. 实际应用:做个好用的“小工具”

学成了之后,这个AI被打包成了一个有图形界面的桌面小软件,用起来非常方便:

- 一键操作:你只需要点击“上传图片”,把脊椎MRI图拖进去。

- 三视图展示:

- 原图:你上传的照片。

- 分割结果:AI用不同颜色把各个脊椎结构都标出来了,一目了然。

- 叠加效果:把彩色标记半透明地覆盖在原图上,让你能清晰地看到AI的分析和原始影像是如何对应的。

- 保存与分享:对结果满意?可以一键把三张图全部保存下来,方便写报告或者进一步分析。

总结一下

这套系统就是一个从学习到实战的全能选手。它先用标注好的数据,训练出一个能精准识别脊椎结构的U-Net模型,然后把它包装成一个操作简单、结果直观的软件。它就像一个不知疲倦的AI助手,能快速、初步地帮医生在复杂的MRI影像中,定位和勾勒出关键的脊椎解剖结构,为后续的诊断和分析提供一个高效的起点。

下载链接

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)