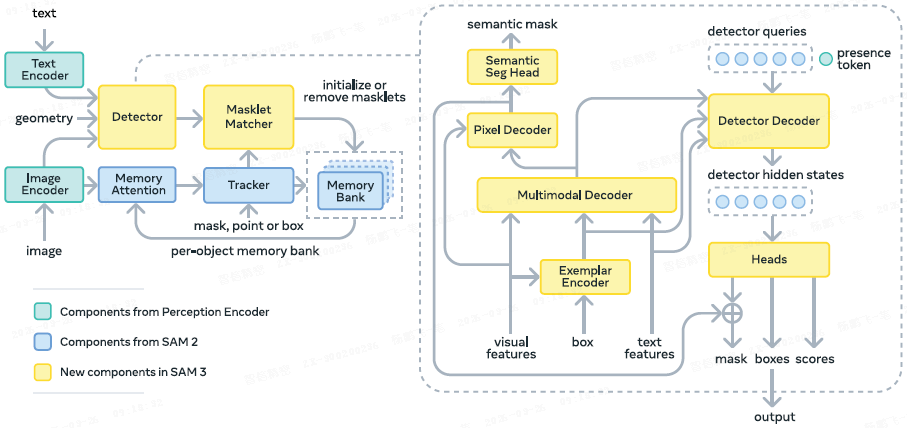

(2026|ICLR|Meta,SAM3,基于概念提示的图像/视频分割,基于人工+AI验证的数据引擎,SAM3 Agent,MLLM)基于概念的任意分割

SAM 3: Segment Anything with Concepts

论文地址:https://arxiv.org/abs/2511.16719

项目页面:https://github.com/facebookresearch/sam3

进 Q 学术交流群:922230617 或加 CV_EDPJ 进 W 交流群

目录

1. 引言

(2023|ICCV|Meta,SAM,可提示(点、框、掩码)分割任务,数据引擎和数据集/SA-1B)分割一切

(2025|ICLR|Meta,SAM2,图像/视频分割,时空掩码,记忆库,交互式提示,数据集构建)图像和视频中的 “任意分割” 功能

SAM 系列引入了 可提示视觉分割(Promptable Visual Segmentation,PVS) 任务,通过点、框或掩码作为提示来分割单个物体。然而,它们未能解决 在输入中查找并分割一个概念所有实例的通用任务(例如,视频中所有的 “猫”)。

为填补这一空白,本文提出了 SAM 3:

- 一个统一的模型,能够基于 概念提示 在图像和视频中检测、分割和跟踪物体。

- 概念提示定义为简短的名词短语(NP,如 “黄色校车”)、图像示例或两者的组合。

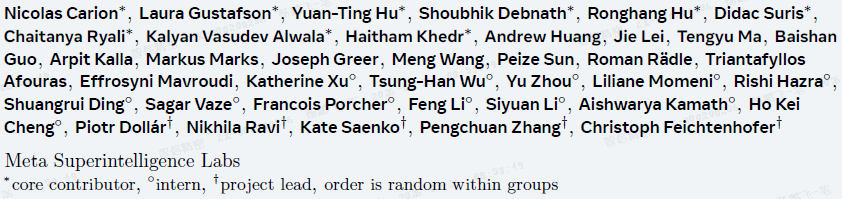

- 可提示的概念分割(Promptable Concept Segmentation,PCS) 任务接收此类提示,为所有匹配概念的物体实例返回分割掩码和唯一标识,并在视频帧间保持物体身份。如下图所示。

- SAM 3 是完全交互式的,允许用户通过添加细化提示来解决歧义。

为了推动 PCS 的发展,本文构建了一个可扩展的数据引擎,生成了一个包含 4M 独特概念标签的高质量数据集,其中包括难负例。

本文的模型由一个图像级检测器和一个基于记忆的视频跟踪器组成,两者共享一个主干网络。通过一个 存在性头部 将识别和定位解耦,从而提高了检测精度。

2. 可提示概念分割 (PCS)

任务定义:给定一张图像或短视频,检测、分割并跟踪由简短名词短语、图像示例或两者组合指定的视觉概念的所有实例。名词短语提示全局应用于所有帧,而图像示例可以在特定帧上作为正或负边界框提供,以迭代细化(refinement)目标掩码。

挑战:词汇是开放式的,任务存在内在歧义(如多义词、主观描述、边界模糊)。本文通过收集多名专家的测试标注、设计最小化歧义的数据流程和评估协议,并在模型中引入歧义处理模块来应对这一挑战。

3. 模型

3.1 架构

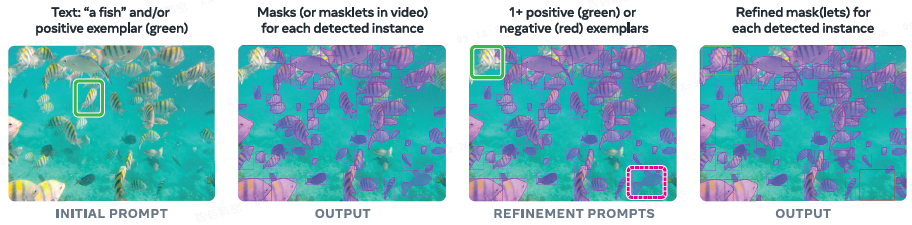

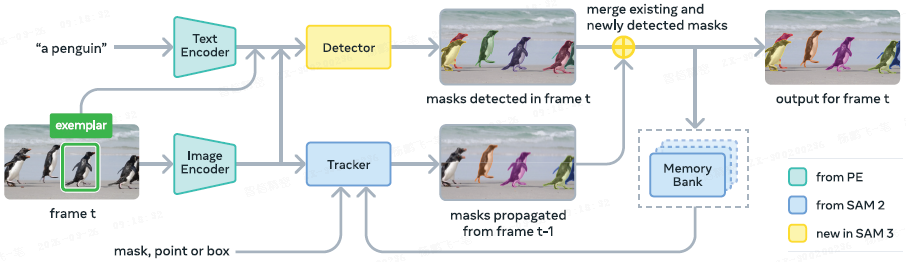

SAM 3 是 SAM 2 的泛化,支持 PCS 和 PVS 任务。架构基于 SAM 和 (M)DETR 系列,由一个图像级检测器和一个视频跟踪器组成,两者共享一个感知编码器主干。

检测器架构:遵循 DETR 范式。

- 图像和文本提示由感知编码器(PE)编码,图像示例由示例编码器编码。

- 融合编码器通过交叉注意力将条件信息注入图像嵌入。随后,DETR 风格的解码器使用学习到的物体查询(query)来预测分类分数和边界框。

- 本文引入了一个 存在性头部,将识别(概念是否存在)和定位(物体在哪里)解耦,提高了准确性。

图像示例与交互性:支持正/负边界框作为图像示例,可与文本提示结合或单独使用,以细化检测结果。

跟踪器与视频架构:

- 对于视频,检测器在每帧上发现新物体,跟踪器将前一帧的掩码传播到当前帧。

- 通过基于 IoU 的匹配函数将传播的掩码与新检测到的物体关联起来,并更新掩码集。

- 为应对歧义,本文引入了基于时间信息的掩码检测分数和周期性地用高置信度检测结果重新提示跟踪器的策略。

【注:更多细节见原论文附录 C】

3.2 训练

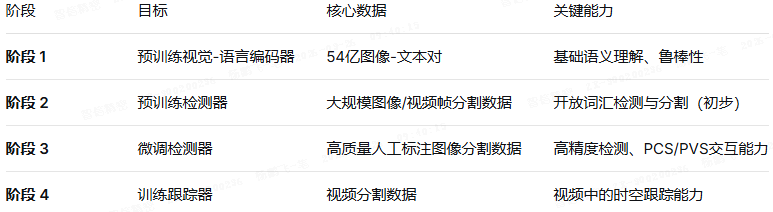

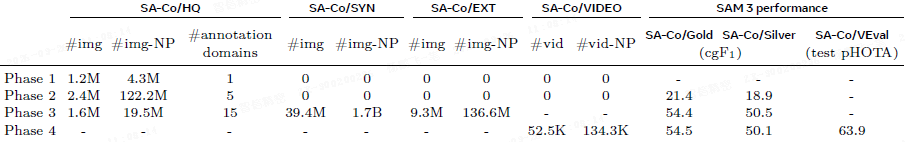

SAM 3 的训练分为四个阶段,逐步引入新能力并优化现有能力。

1)感知编码器(PE)预训练

目标:预训练图像和文本编码器。

数据:5.4B 对图像-文本。

关键点:为模型提供广泛的概念覆盖和鲁棒性基础。

模型规格:视觉编码器(450M 参数)和文本编码器(300M 参数),均为 Transformer 结构,未使用蒸馏,也未在此阶段进行视频微调。

2)检测器预训练

目标:训练图像级检测器,并联合训练视觉与文本编码器。

数据:大规模图像分割数据(包含视频帧),涵盖伪标签与人工标注数据。

关键点:

-

模型获得开放词汇的物体检测、实例分割和语义分割能力。

-

为支持 PCS 任务,部分(图像,名词短语)对被随机转换为视觉查询或添加输入边界框。

-

同时进行 PVS 任务的预训练,增加 4 个专用于视觉提示的解码器查询,交互步数限制为 4 次。

3)高质量图像数据微调与交互能力增强

目标:使用最高质量的人工标注图像数据进一步训练,增强交互能力,并引入后训练以提升检测性能。

数据:仅保留最高质量且经过穷尽性验证的数据(如弃用 SA-Co/SYN)。

关键点:

-

PVS 任务:交互步数增加至 7 次。

-

PCS 任务:引入交互能力,根据模型错误提供正/负示例框,模拟真实用户行为,重复 5 次。

-

引入 存在性头部 及其对应的二元交叉熵损失,用于判断目标概念是否存在于图像中,显著提升模型精度。

4)视频跟踪器训练

目标:在冻结主干网络的基础上,训练视频跟踪器,专注于时空跟踪能力。

数据:使用视频分割数据。

关键点:

-

主干网络(包括视觉编码器)在此阶段被冻结,确保模型的空间定位能力不被破坏。

-

跟踪器在视频帧间传播掩码,并利用记忆库保持物体身份一致性。

3.3 SAM 3 Agent

SAM 3 Agent 是一个视觉 Agent 系统,通过动态调用多模态大语言模型(MLLM)和 SAM 3,将自然语言分割请求转化为精确的掩码。

工作流程:

-

输入:给定输入图像和用户请求。

-

规划:MLLM 作为规划器/控制器,分析图像,制定逐步计划。

-

执行:调用 SAM 3 生成掩码,检查结果,并确定候选掩码。

-

反馈与迭代:每次动作后,代理接收描述更新后环境状态的视觉和文本反馈,使其能够修正计划并决定下一步动作。

-

终止:此感知-动作循环持续进行,直到代理确信已满足目标(或确定不存在有效掩码),最终返回一组掩码。

该流程能够处理远超简单名词短语的复杂查询,这些查询通常需要理解场景元素之间的关系和视觉常识。

核心工具:Agent 定义了四个 MLLM 可调用的基本工具:

| 工具 | 类型 | 功能描述 |

|---|---|---|

segment_phrase |

中间工具 | 接收一个名词短语,调用 SAM 3 生成该短语对应所有实例的掩码。 |

examine_each_mask |

中间工具 | 触发 MLLM 逐个检查当前生成的掩码,用于处理小掩码重叠或难以区分的情况。 |

select_masks_and_return |

返回工具 | 选择当前显示的掩码子集作为最终输出,结束任务。 |

report_no_mask |

返回工具 | 确认图像中不存在与用户查询匹配的物体,结束任务。 |

环境状态与反馈:每次执行中间工具后,系统向 MLLM 提供两方面的信息:

-

视觉反馈:原始图像上叠加了所有当前可用掩码,采用 token 集 方式呈现。掩码随机着色,并按 SAM 3 置信度降序编号为 1 至 N。

-

文本反馈:自动生成的消息,说明相比上一环境状态的变化(如生成了多少新掩码,或移除了多少掩码)。

MLLM 在初始用户查询的背景下,分析带有掩码的更新后图像(当前环境状态),更新其工具调用计划,并生成下一步动作。

长上下文处理机制:

对于极具挑战性的查询,agent 可能需要多达 60 步的试错才能满意并调用返回工具。这会导致极长的环境状态上下文历史,每一步都包含一张新图像,对 MLLM 的上下文长度和多图像推理能力构成严峻挑战。

为解决此问题,本文提出了一种 激进的上下文工程机制:

-

剪枝:移除从初始用户查询到最近一次

segment_phrase调用之间的所有中间试错状态。 -

掩码重置:每次调用

segment_phrase后,丢弃所有先前生成的掩码,避免冗余掩码使 token 集图像杂乱。 -

保留失败经验:为避免丢失被剪枝步骤中的重要失败经验,提供一个 持续更新的列表,记录所有曾经使用过(并被丢弃)的 SAM 3 名词短语提示,供模型参考。

【注:更多细节见原论文附录 G】

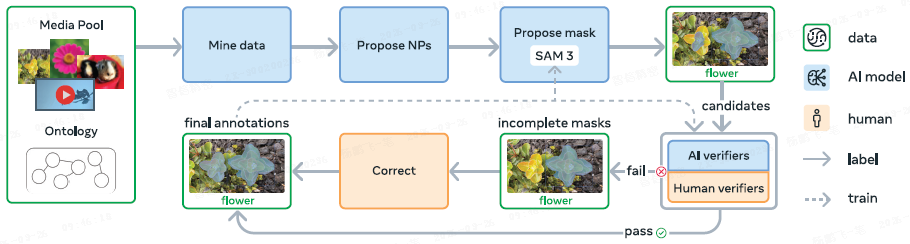

4. 数据引擎

为实现 PCS 的突破,本文构建了一个高效的数据引擎,通过 SAM 3、人类标注者和 AI 标注者之间的反馈循环迭代生成标注数据。

组件:

- 从媒体池中挖掘数据,使用 AI 模型提出名词短语,由 SAM 3 生成候选实例掩码。

- 通过 掩码验证(Mask Verification,MV)和 穷尽性验证(Exhaustivity Verification,EV)两步流程验证掩码质量。

- 任何未通过穷尽性检查的媒体-名词短语对都会进入人工校正阶段。

阶段 1:人工验证

- 从媒体池中随机采样图像,并使用简单的字幕器(captioner)和解析器生成名词短语。

- 初始的掩码提案模型是 SAM 2,由现成的开放词汇检测器(如 OWLv2)的输出进行提示。

- 所有验证工作均由人工完成。

- 此阶段共收集了 4.3M 图像-名词短语对,作为初始的 SA- Co/HQ 数据集。

- 利用这些数据训练初始版本的 SAM 3,并将其作为下一阶段的掩码提案模型。

阶段 2:人工 + AI 验证。此阶段的核心是引入 AI 验证器。

- 使用阶段 1 收集的人工 “接受/拒绝” 标签,微调 Llama 3.2 模型,使其能够自动执行 MV 和 EV 任务。

- AI 验证器接收(图像,短语,掩码)三元组,输出关于掩码质量或穷尽性的多项选择题评分。AI 验证器的引入使人工得以聚焦于最棘手的案例。随着 SAM 3 和 AI 验证器迭代改进,自动生成的标签比例越来越高,数据引擎的吞吐量相比纯人工标注 提升了约一倍。

-

名词短语生成步骤升级为基于 Llama 的流程,能够为 SAM 3 提出具有挑战性的 难负例 名词短语。

-

此阶段为 SA- Co/HQ 数据集新增了 122M 图像-名词短语对。

阶段 3:规模化与领域扩展。此阶段的目标是挖掘更具挑战性的案例,并将 SA- Co/HQ 的领域覆盖范围扩大到 15 个不同的数据源。

-

在新领域中,MV AI验证器在零样本下表现良好,而 EV AI 验证器则需要少量特定领域的人工监督来提升性能。

-

通过从图像替代文本中提取名词短语,以及从基于 Wikidata 构建的拥有 22.4M 节点的 SA- Co 本体中挖掘概念,扩展了对长尾、细粒度概念的覆盖。

-

迭代训练 SAM 3 模型 7 次,AI 验证器 3 次。

-

此阶段为 SA- Co/HQ 新增了 19.5M 图像-名词短语对。

阶段 4:视频标注。此阶段将数据引擎扩展到视频领域,利用成熟的图像版 SAM 3 来收集针对视频特有挑战的高质量标注。

-

数据挖掘流程应用了场景/运动过滤、内容平衡、排序和针对性搜索。视频帧被采样(随机或按物体密度)后,送入阶段 3 的图像标注流程。生成的掩码片段会经过去重和剔除琐碎掩码等后处理。

-

由于视频标注难度更高,本文通过优先选择物体密集或存在跟踪失败风险的片段,将人力集中投入到模型可能失败的地方。

-

收集的视频数据集 SA- Co/VIDEO 包含 52.5K 视频和 467K 个掩码片段。

【注:更多细节见原论文附录 D】

5. 基于概念的任意分割 (SA- Co) 数据集

训练数据:

-

SA- Co/HQ:高质量图像数据,包含 5.2M 张图像和 4M 独特名词短语。

-

SA- Co/SYN:合成数据集,由成熟的数据引擎自动生成,包含 39.4M 张图像和 38M 名词短语。

-

SA- Co/EXT:15 个外部数据集,用本体管道丰富了难负例。

-

SA- Co/VIDEO:视频数据集,包含 52.5K 视频和 24.8K 独特名词短语。

SA- Co 基准:用于评估 PCS,包含 207K 个独特短语,覆盖 120K 图像和 1700 视频,概念数量是现有基准的 50 倍以上。分为 Gold(多人标注)、Silver(单次标注)、Bronze 和 Bio(基于现有数据集)等子集。

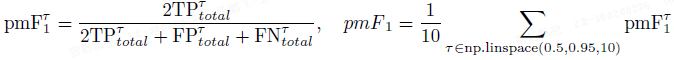

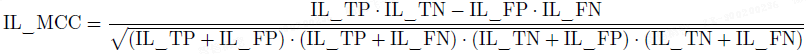

评估指标:cgF1 (分类门控 F1):主要指标,结合了定位(正样本 micro-F1,pmF1)和分类(图像级马修斯相关系数,IL_MCC)。

![]()

其中,

- τ ∈ [0.5, 0.95] 是 IoU 门限。

- TP (true positive),FP (false positive).,TN (true negative),FN (false negative)

- IL(image level),IL_MCC ∈ [-1,1]

处理模糊性。在 SA-Co/Gold 数据集上,对每个名词短语(NP)收集 3 个标注。通过将每个预测与所有真实情况进行比较来衡量 “权威” 准确性,并选择得分最高的结果。

6. 实验

6.1 结果

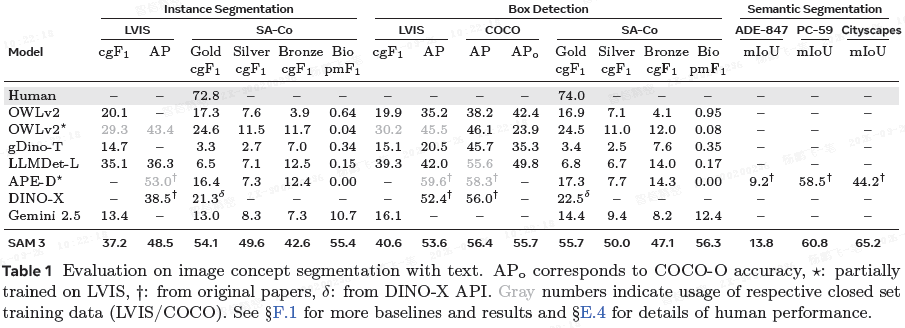

SAM 3 在多项任务上取得了最先进的成果:

图像 PCS(文本提示):在 LVIS、COCO 和 SA- Co 基准上,SAM 3 的零样本性能远超现有方法。

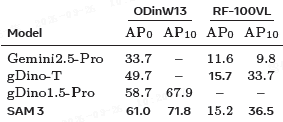

少量样本适应:在 ODinW13 和 RF100- VL 基准上,SAM 3 的 10-shot 微调性能(AP_10)超过了当前最先进水平。

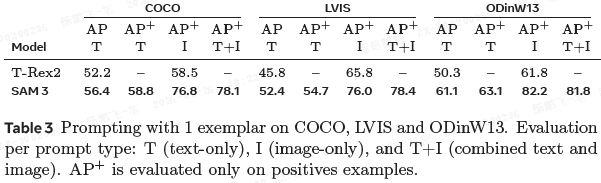

PCS(单示例提示):仅使用一个随机采样的真实边界框作为提示,SAM 3 在 COCO、LVIS 等数据集上的 AP+ 指标远超 T- Rex2。

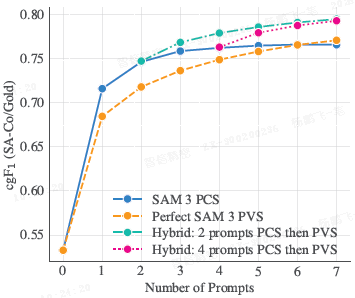

PCS(K 个示例交互):在交互式设置中,通过迭代添加示例,SAM 3 的 cgF1 分数提升迅速,表现优于理想的 PVS 基线。

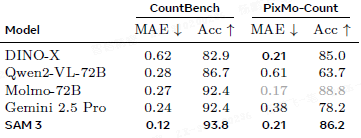

物体计数:在 CountBench 和 PixMo- Count 上,SAM 3 取得了优秀的计数准确率和平均绝对误差。

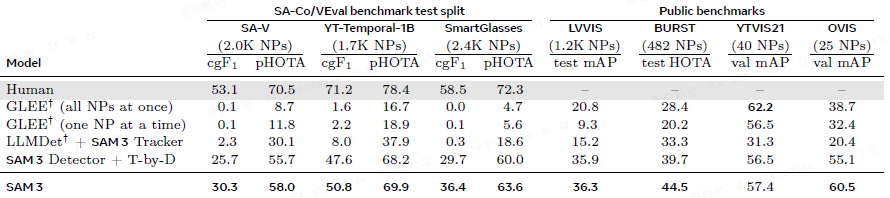

视频 PCS(文本提示):在 SA- Co/VEval 和多个公开基准上,SAM 3 的 pHOTA 和 cgF1 指标大幅超越基线模型,尤其是在名词短语数量多的基准上。

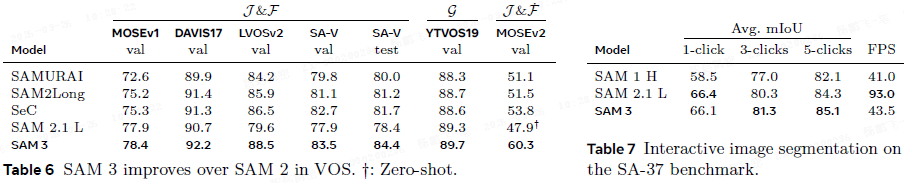

PVS (视觉提示):在视频物体分割和交互式图像分割任务上,SAM 3 相比 SAM 2 和 SAM 2.1 均有显著提升。

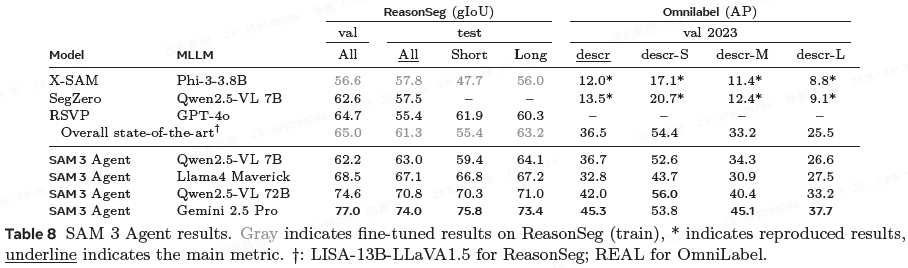

SAM 3 Agent:该 Agent 在 ReasonSeg、OmniLabel 和 RefCOCO 系列基准上的零样本表现超越或接近现有方法。

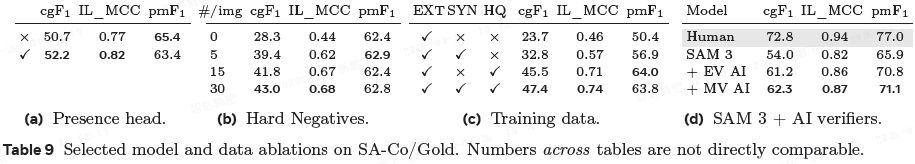

6.2 消融

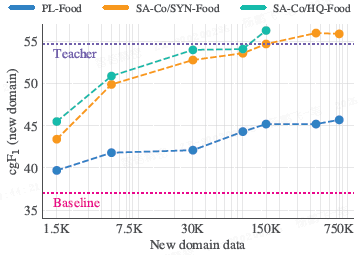

领域自适应消融实验:这一实验表明,由 SAM 3 + AI 验证器生成的合成数据(SYN-Food)是人工标注数据(HQ-Food)的 有效替代方案,提供了一种可扩展的、低成本 的方式来提升模型在新数据分布上的性能。

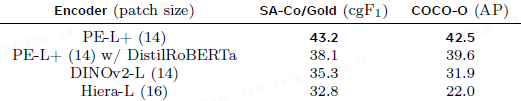

视觉和文本编码器消融:PE 是最佳编码器选择。

7. 局限性

尽管 SAM 3 在图像和视频的 PCS 任务上表现强劲,但在以下场景中仍存在局限性:

1)零样本泛化能力

问题:SAM 3 难以零样本泛化到 细粒度的域外概念(如飞机型号、医学术语),尤其是在小众视觉领域(如热成像)。

原因:PCS 要求对具体概念进行泛化,这本质上比 PVS 任务中 类别无关的视觉域泛化 更具挑战性。

解决方案:

-

少量人工标注数据的微调即可快速适应新概念和视觉域。

-

利用数据引擎生成的 领域特定合成数据,可在 无需人工参与 的情况下提升新领域性能(见 实验-结果-少样本适应)。

2)提示形式限制

问题:根据 PCS 任务的定义,SAM 3 仅支持 简单的名词短语提示,无法处理包含一两个以上属性的多属性查询或包含指代表达的长句。

解决方案:当与多模态大语言模型结合时,SAM 3 能够处理更复杂的短语(见 实验-结果-SAM3 Agent)。

3)视频推理成本

问题:SAM 3使用 SAM 2 风格的掩码片段跟踪每个物体,推理成本随跟踪物体数量 线性增长。

当前方案:为在实际应用中支持实时推理(30 FPS),在多 GPU 上并行化推理:

-

2 张 H200:最多 10 个物体

-

4 张 H200:最多 28 个物体

-

8 张 H200:最多 64 个物体

未来改进:当前架构缺少跨物体的共享上下文信息来解决多目标跟踪中的歧义。未来的发展可以通过 在多个物体间建立共享全局记忆 来解决此问题,同时也能提升推理效率。

4)交互模式切换

问题:同时支持 PCS 的概念级交互和 PVS 的实例级交互带来挑战。为支持不影响同一概念其他实例的实例级修改,模型目前强制实施了一个从概念模式到实例模式的 硬性“模式切换”。

未来改进:未来的工作可以探索更无缝地 交错使用概念级和实例级提示。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)