LoRA模型提取花纹超详细指南:QwenEdit2511 | LoRA训练大师 | 仙宫云

一、Qwen Image Edit 2511云端教程

Qwen Image Edit 提取花纹

云端训练方法:使用云端训练提取花纹的Lora模型,支持Qwen Image Edit 2511训练

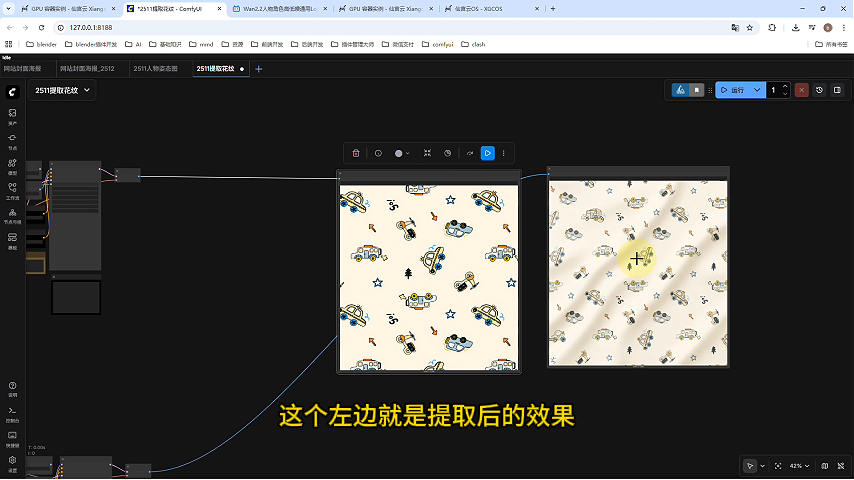

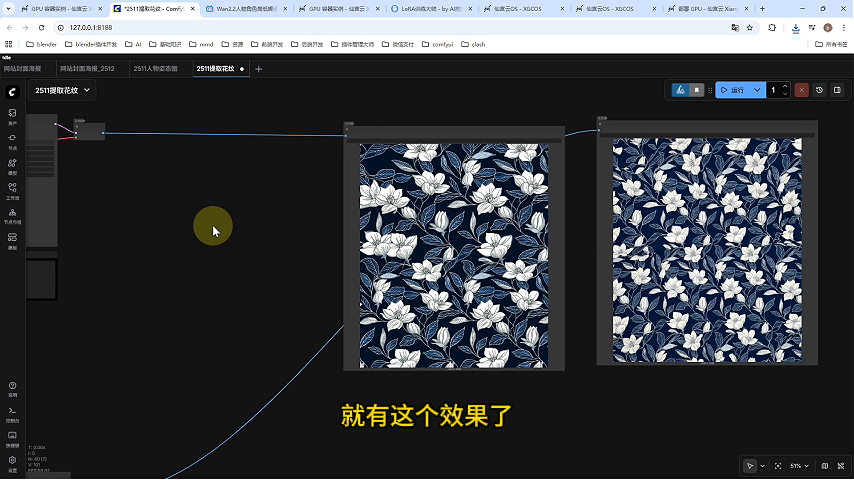

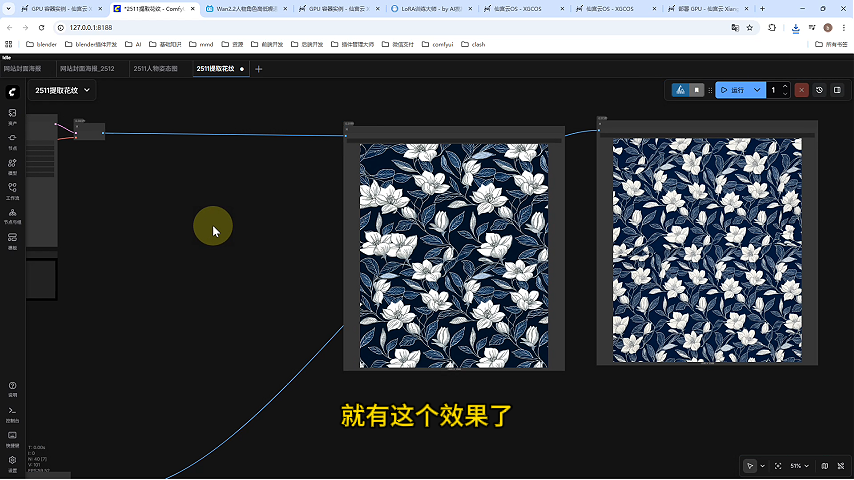

效果对比:添加LoRA后花纹提取效果明显优于未添加状态,可通过左侧预览查看提取效果

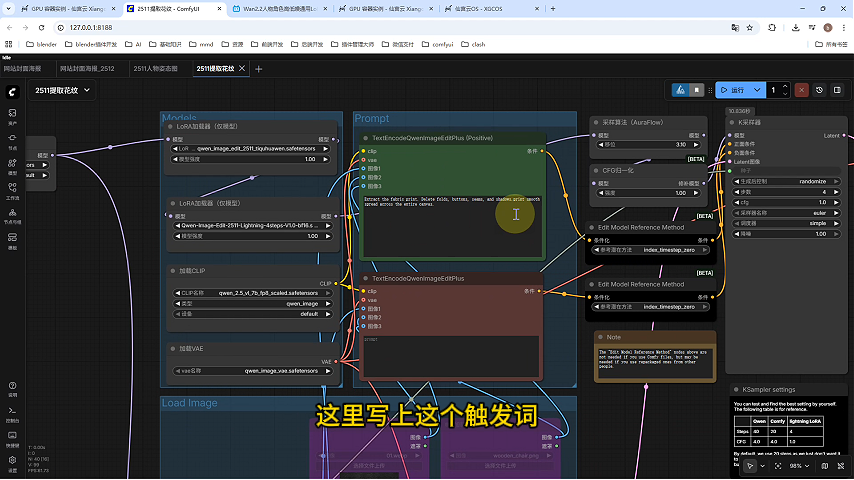

1)添加触发词

操作步骤:

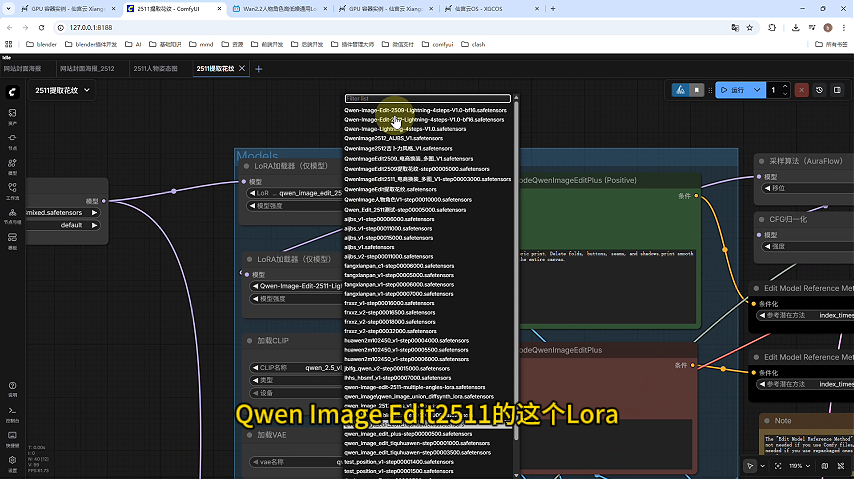

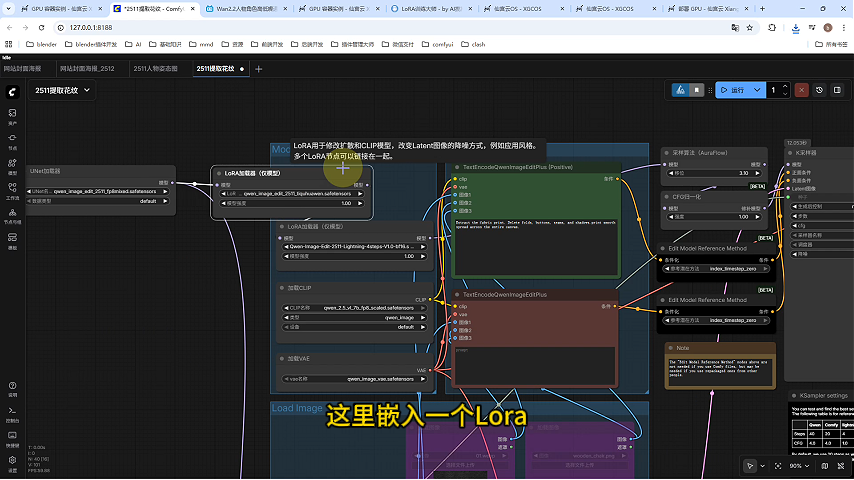

在LoRA加载器中添加"Qwen Image Edit 2511"的lora

设置对应的触发词

上下工作流的唯一区别就是LoRA的添加与否

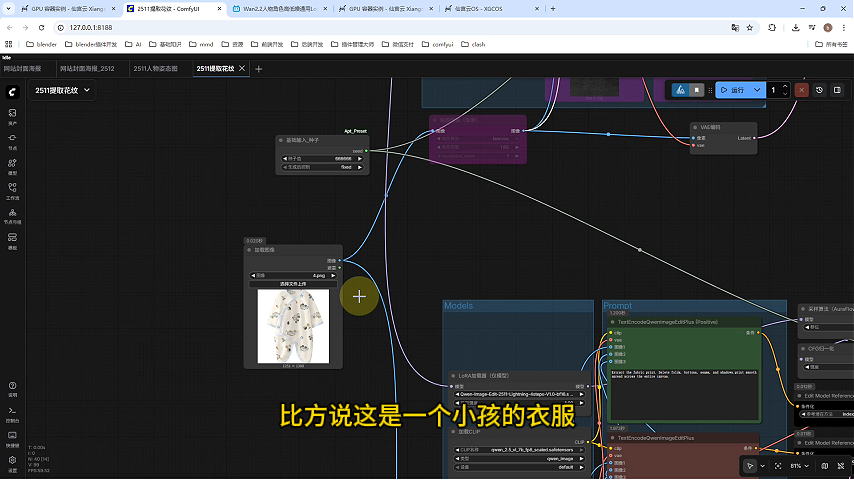

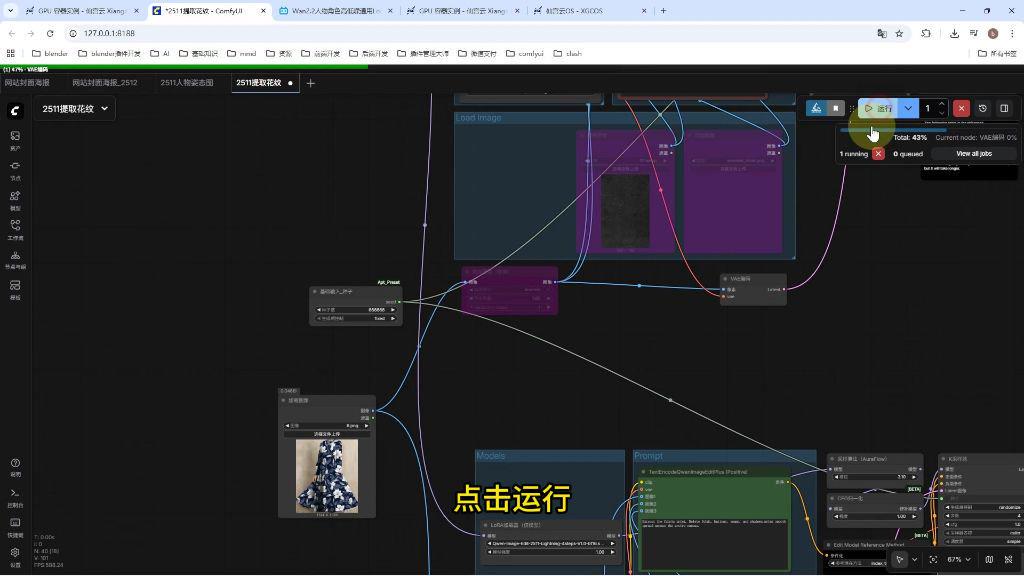

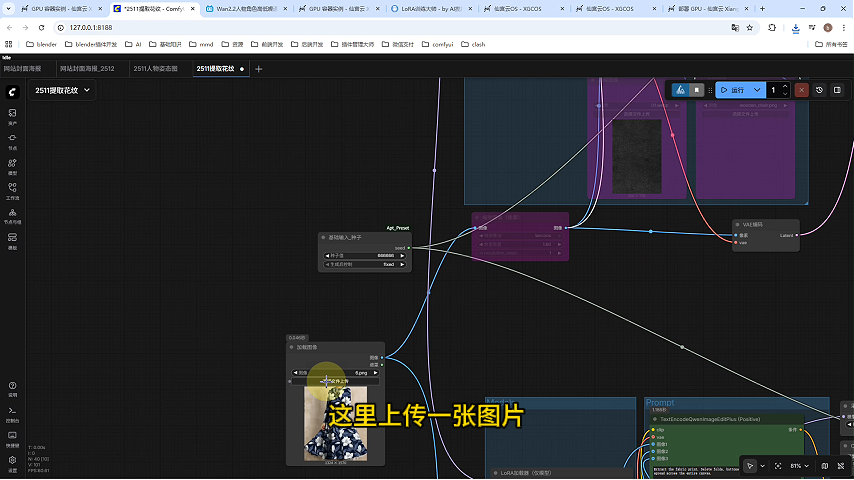

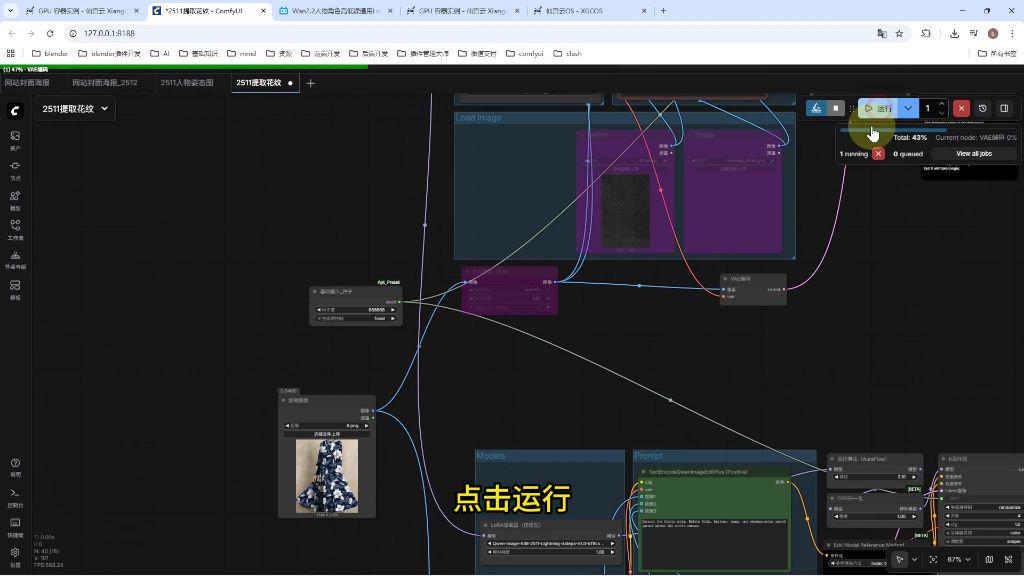

应用示例:以小孩衣服为例,添加LoRA后点击运行即可看到花纹提取效果

2)换图片对比

验证方法:

更换不同图片进行测试

点击运行查看加LoRA与不加LoRA的效果差异

效果评估:对比结果显示添加LoRA后的花纹提取效果非常明显

3)配置LoRA训练大师

准备工作:

复制视频简介中的链接到浏览器:

https://www.xiangongyun.com/register/7IQBMI

通过作者搜索"AI搅拌手"找到LoRA训练大师

准备数据集

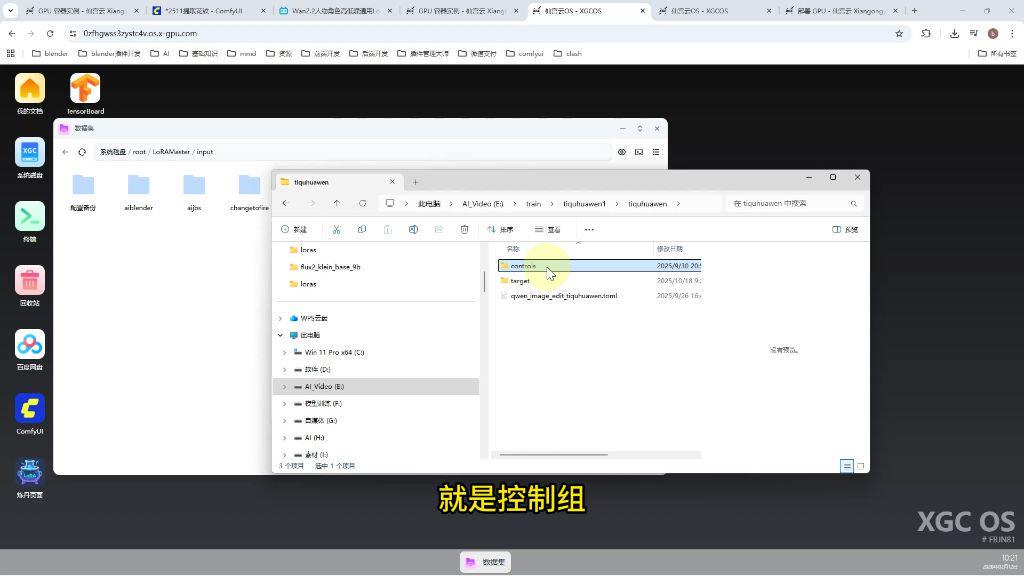

数据集要求:

需要准备控制组(原图)和目标组(提取效果图)

图片命名需一一对应,如控制组0001.jpg对应目标组0001.jpg

上传方法:

将数据集打包成压缩文件

直接拖拽上传到仙宫云OS

双击解压即可使用

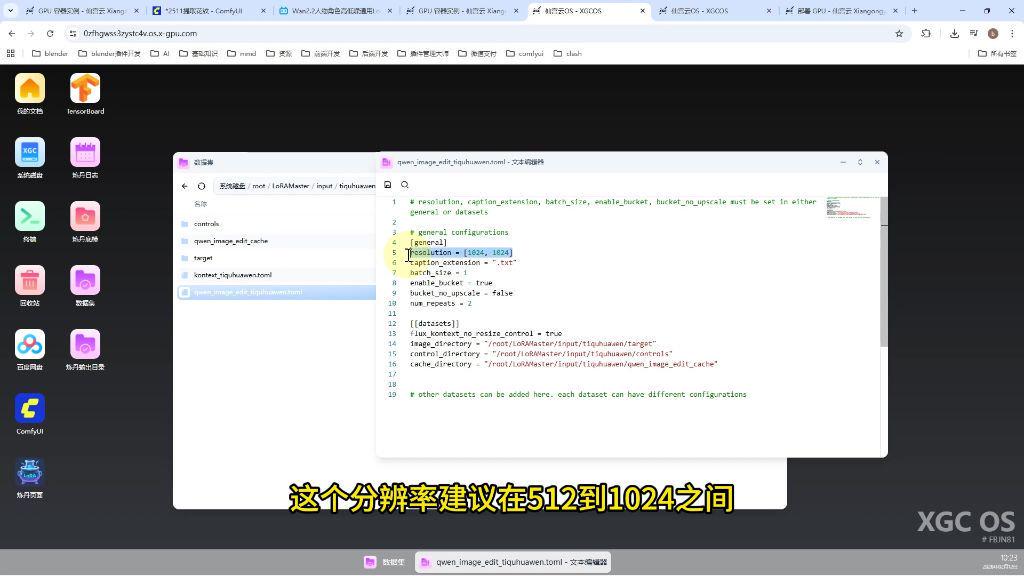

配置toml文件

关键参数:

分辨率建议设置在512到1024之间,越高占用显存越多

需设置image_directory(目标组路径)

需设置control_directory(控制组路径)

自定义cache_directory路径

文件结构:

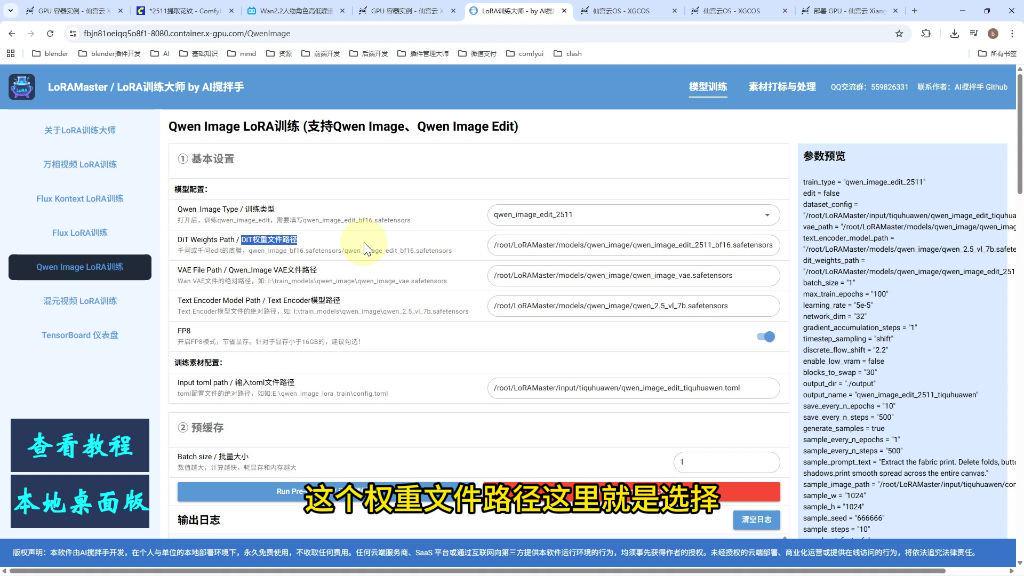

点击Qwen Image lora训练

模型选择:

选择Qwen Image Edit 2511训练类型

配置权重文件路径为qwen_image_edit_2511_bf16.safetensors

路径设置:

输入toml文件路径

设置VAE文件路径

配置Text Encoder模型路径

回到模型训练

打标流程:

输入目标组路径

点击"加载训练素材"

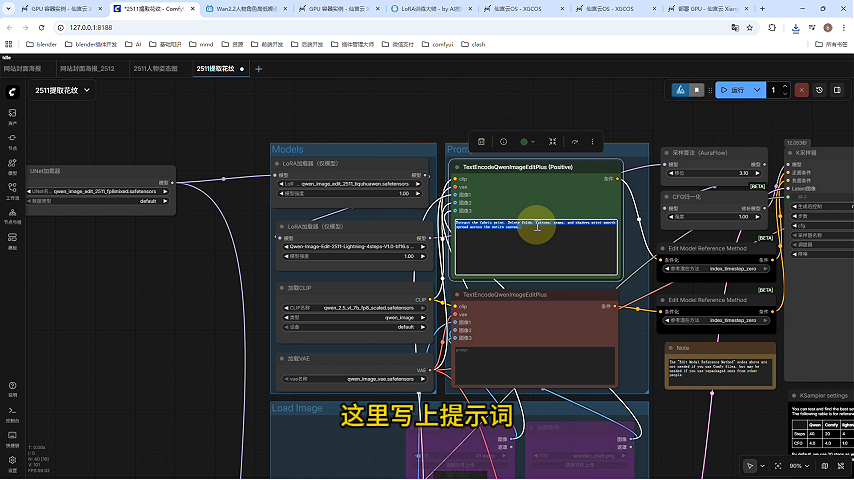

设置提示词如"Extract the fabric print..."

使用"只用触发词打标"自动完成打标

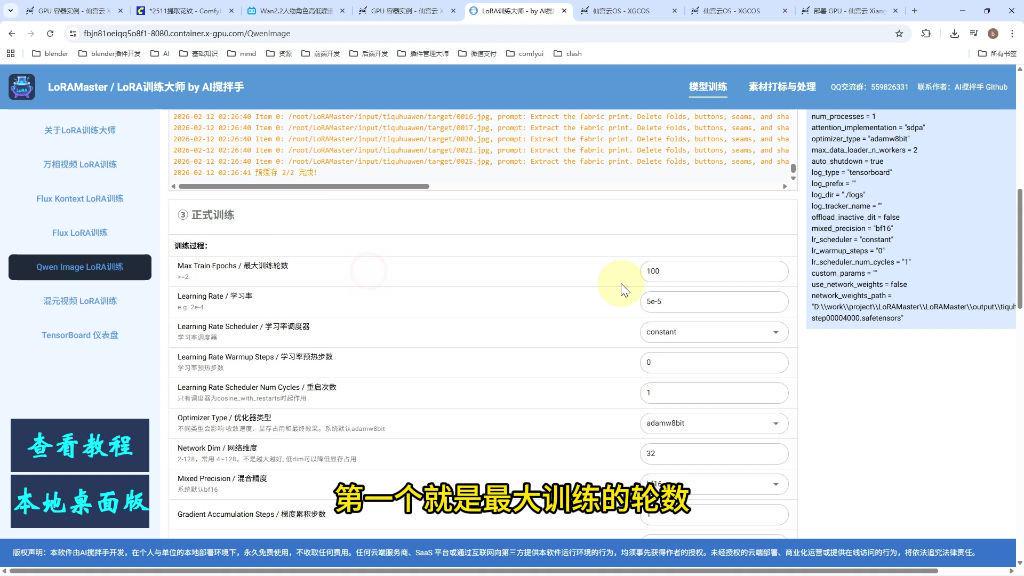

开始训练

训练设置:

最大训练轮数设为100

过程采样:

可设置每轮采样1次

每500步采样1次

配置采样提示词和图片路径

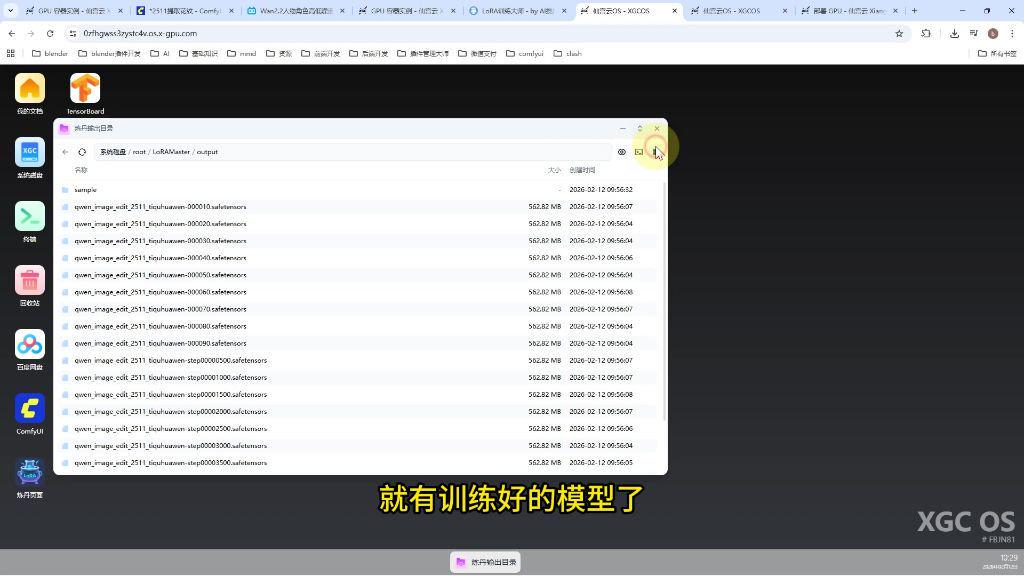

查看训练过程采样

结果查看:

在炼丹输出目录获取训练好的模型

每10轮自动保存一次模型

每500步保存一次中间结果

模型应用:

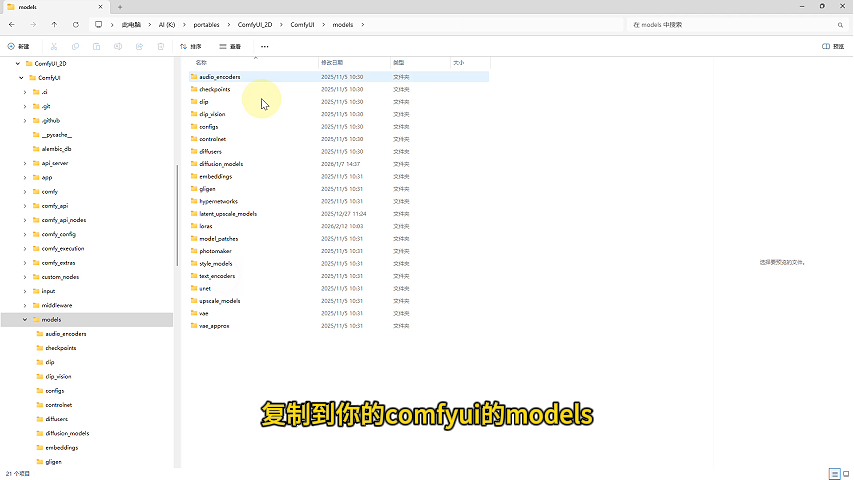

下载模型后放入ComfyUI的models目录

在图片编辑工作流中加载LoRA

输入提示词并上传图片即可看到效果

二、知识小结

| 分类维度 | 核心内容 | 技术参数/操作要点 | 对比效果/注意事项 |

| 训练平台 | lora训练大师云端平台 | - 支持Qwen Image Edit 2511模型- 提供8元新用户赠金- 镜像部署支持48G/24G显存 | 低显存模式需开启分块处理 |

| 训练流程 | Qwen Image Edit 2511模型训练 | 1. 数据集准备:控制组(原图)+目标组(提取效果)2. 配置文件修改:分辨率(512-1024)、路径设置 | 效果对比:- 加Lora:花纹提取明显- 无Lora:原始效果 |

| 部署步骤 | 镜像部署与资源分配 | - 搜索镜像“AI搅拌手”- 选择48G显存(推荐)- 开启地下城模式(可选) | 24G显存需启用分块优化 |

| 数据预处理 | 素材标注与达标处理 | - 触发词自动标注- 压缩包直接拖拽上传- 目标组/控制组文件名需严格对应(如0001.jpg) | 未达标素材需通过“加载训练素材”功能预处理 |

| 训练配置 | 参数设置与采样监控 | - 最大训练轮数=步数×素材量- 过程采样:每500步/轮次- 输出命名规则:每10轮保存 | 显存占用:分辨率越高,训练越慢 |

| 模型应用 | Lora模型集成与效果验证 | 1. 下载模型至/models目录2. 工作流嵌入Lora节点3. 触发词控制效果开关 | 应用对比:- 儿童服装案例展示花纹提取差异 |

| 监控优化 | 训练过程可视化 | - 实时查看loss曲线- 过程采样图片对比- 显存占用监控 | 5000步训练案例显示稳定收敛 |

可点击下方链接观看视频教程👇

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)