算力即竞争力:UltraLAB赋能2026半导体十大前沿

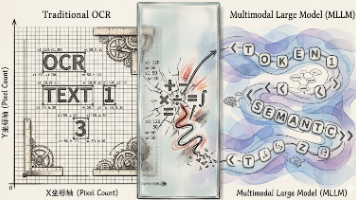

当2nm GAAFET进入量产、Chiplet异构集成重构设计范式、AI辅助EDA成为标配,半导体科研已从“工艺微缩”转向“系统级创新”。在这场算力密度与技术精度的赛跑中,UltraLAB以“三维平衡”的硬件哲学,为每一个前沿课题提供匹配的加速引擎。

2026年,全球半导体产业正站在万亿美元市场的门槛前。对于高校实验室、科研院所的PI和博士生而言,算力基础设施的配置水平,直接决定了技术突破的速度——因为今天的半导体仿真,已不再是单点工具的堆叠,而是从原子级TCAD到系统级多物理场、从AI加速设计到Chiplet签核的全链条算力战争。

结合StartUs Insights、VLSI Symposium等权威机构发布的2026年技术路线图,UltraLAB深度解析十大热门研究课题的计算特征,并提出精准的硬件配置黄金法则。

一、十大前沿课题与UltraLAB精准配置方案

课题一:2nm以下先进工艺与GAAFET器件物理仿真

随着台积电N2、英特尔18A全面上量,全环绕栅极(GAAFET)晶体管接棒FinFET成为主流。背面供电网络(BSPDN)技术通过PowerVia设计,实现25%频率提升与36%功耗降低。

计算特征:

- TCAD仿真需求解泊松-漂移扩散方程组,网格规模达十亿级单元

- atomistic仿真(如NEMO5)涉及非平衡格林函数(NEGF)计算,内存带宽饥渴

- 寄生参数提取要求电磁场全波仿真,频率覆盖DC至毫米波

UltraLAB推荐配置(GA660M):

- CPU:AMD EPYC 9575F ×2 (128核) —— 高主频(5.0GHz+)加速网格收敛

- GPU:NVIDIA RTX 5090 ×4 —— CUDA加速3D电磁求解

- 内存:1TB DDR5-6400 —— 处理GAAFET纳米片结构的高密度网格数据

- 存储:20TB NVMe RAID0 (读速50GB/s+) —— TCAD临时文件I/O吞吐优化

课题二:Chiplet与3D异构集成设计自动化

2026年先进封装市场规模突破503亿美元,CoWoS-S中介层面积扩展至6倍光罩尺寸(5148 mm²),混合键合间距压缩至3μm以下,Chiplet标准化(UCIe 1.1)与3D堆叠热-电-力多物理场协同设计成为核心挑战。

计算特征:

- 多物理场耦合:热仿真(Icepak)+电磁信号完整性(HFSS)+机械应力(Abaqus)联合求解

- 巨量数据传输:单颗3D IC设计数据量达500GB+,版本迭代产生PB级数据洪流

- 签核验证:电源完整性(IR Drop)分析需处理百亿节点矩阵

UltraLAB推荐配置(GX660):

- 双路AMD 9995WX(96核,5.2GHz睿频):支撑ANSYS SIwave/RedHawk的分布式并行

- 512GB HBM2e显存级存储池:通过CXL 2.0内存扩展,突破“内存墙”

- 100GbE高速互联:支持多工作站分布式签核

课题三:AI辅助芯片设计(AI for EDA)

大语言模型与强化学习正重塑设计流程。2026年,英伟达GB200 NVL72提供30倍LLM推理性能提升。

计算特征:

- 大模型微调:基于Llama 3.1或CodeLlama的EDA专用模型需FP8/BF16混合精度训练

- 图神经网络(GNN):网表表征学习对GPU显存容量提出极高要求(单卡48GB+)

- 强化学习探索:布局优化涉及海量状态空间搜索,需GPU集群并行

UltraLAB推荐配置(AlphaPro660):

- 计算节点:AMD 9985WX + 4×RTX 5090 (128GB显存/卡)

- 推理节点:Intel Xeon W9-3575X(高主频优化单线程EDA工具响应)

- 存储架构:全闪存Lustre并行文件系统,100GB/s聚合带宽

- 网络:InfiniBand NDR 400Gbps,支持GPUDirect RDMA

课题四:高带宽存储器(HBM4)与存算一体架构

SK海力士已交付12层HBM4样品(带宽2TB/s),存算一体技术通过忆阻器/RRAM实现55-88 TOPS/W能效比。

计算特征:

- 存储电路-器件联合仿真:SPICE级电路仿真结合器件TCAD,时间步长跨度达12个数量级

- 量子输运计算:弹道输运模型求解需要GPU加速的蒙特卡洛方法

- 热-电协同:HBM堆叠的热管理涉及微尺度两相流模拟

UltraLAB推荐配置(GA660M):

- CPU:AMD EPYC 9755 (128核) —— 支持CXL 2.0 Type 3内存扩展

- GPU:NVIDIA B200 —— 192GB HBM3e显存,支撑显存内计算仿真

- 网络:NVIDIA ConnectX-7 —— 支持CXL over Fabric,内存池化延迟μs

课题五:宽禁带功率半导体(SiC/GaN)多物理场可靠性

Wolfspeed量产300mm SiC晶圆,GaN进入数据中心HVDC架构。可靠性研究聚焦栅氧陷阱效应、动态导通电阻退化、高温高场下的电-热-力耦合失效。

计算特征:

- 第一性原理计算:VASP/Quantum ESPRESSO计算SiC/GaN缺陷能级,需高内存带宽

- 有限元可靠性:Abaqus耦合电场-热场-机械应力的瞬态分析

- 跨尺度仿真:从原子级缺陷到系统级热网络,多尺度算法数据吞吐量巨大

UltraLAB推荐配置:

- 量子计算节点:双路AMD 9575F + 512GB DDR5,优化VASP HSE06计算

- 多物理场工作站:AMD 9995WX + RTX 6000 Ada,支持Ansys Mechanical GPU加速

课题六:硅光集成与CPO(共封装光学)

英伟达Spectrum-X/Quantum-X交换机集成CPO技术,实现1.6Tb/s光引擎。关键挑战:光子-电子协同仿真、热串扰管理、光纤耦合效率优化。

计算特征:

- 时域有限差分(FDTD):Lumerical FDTD求解麦克斯韦方程,网格尺寸<<波长

- 多物理场耦合:电光热耦合仿真涉及频域-时域混合算法

- 工艺变异分析:蒙特卡洛分析要求数百次全波仿真

UltraLAB推荐配置(AR350):

- 高频CPU:Intel Xeon W9-3595X(5.4GHz睿频),加速FDTD网格更新

- 大显存GPU:RTX 5090 128GB×2,支持Lumerical的GPU加速引擎

- 高速互联:100Gb RoCEv2,支持跨节点并行FDTD计算

课题七:后摩尔时代二维材料器件(TMDs/石墨烯)

二维过渡金属硫化物(TMDs)晶体管进入实验验证阶段,MIT实现垂直堆叠逻辑-存储单元。研究聚焦接触电阻抑制、栅极氧化层界面态、多Valley输运。

计算特征:

- 第一性原理高通量:Materials Project式DFT计算,单体系即需数千核时

- 量子输运:非平衡格林函数结合DFT Hamiltonian,内存需求随原子数平方增长

- 原子级TCAD:Sentaurus原子级模拟需GPU加速

UltraLAB推荐配置(GX660集群):

- 计算集群:双路AMD EPYC 9755 (256核/节点)

- 内存:2TB DDR5 per node(处理1000+原子体系的NEGF矩阵)

- 加速卡:NVIDIA H100 80GB (Quantum ESPRESSO CUDA加速)

- 存储:WEKA文件系统,应对百万级小文件IOPS需求

课题八:量子计算芯片低温控制集成

Quantum Motion在22FDX工艺集成量子比特与低温CMOS控制电路,相干时间突破100μs。2026年迈向“量子就绪”半导体。

计算特征:

- 低温器件仿真:TCAD模拟4K-300K宽温区载流子输运,涉及冻析效应

- 量子-经典接口电路:QSPICE仿真低温CMOS与量子比特耦合

- 电磁兼容:极低温下的信号完整性与串扰分析

UltraLAB推荐配置(AR350):

- 高主频工作站:AMD 9950X3D(大缓存优化电路仿真收敛)

- 低温TCAD专用节点:支持Cryogenic模型库的多核服务器

- 低噪声电源:医用级稳压保障敏感量子器件仿真精度

课题九:先进封装热-电-力可靠性数字孪生

台积电CoWoS-CPO方案降低功耗50%,混合键合实现9μm间距。3D堆叠的热管理(>775μm厚度堆叠)与热-机械应力成为良率瓶颈。

计算特征:

- 多尺度热仿真:从芯片级(μm)到系统级(机架级),需结合CFD与有限元

- 粘塑性分析:焊点与底部填充胶的蠕变-疲劳分析,时间尺度跨度大

- 随机有限元:材料属性变异导致的不确定性量化

UltraLAB推荐配置:

| 应用场景 | CPU | GPU | 内存 | 存储 |

|---|---|---|---|---|

| 芯片级热分析 | AMD 9995WX | RTX 5090×2 | 256GB | 10TB NVMe |

| 系统级CFD | 双路EPYC 9575F | - | 512GB | 并行文件系统 |

| 不确定性量化 | 256核集群 | - | 1TB | 100TB+ RAID6 |

课题十:半导体制造“绿色低碳”化学工艺模拟

单座晶圆厂日耗水500万加仑,台积电2030年目标60%绿电。研究聚焦刻蚀/清洗工艺化学反应动力学优化、超纯水系统能耗模拟、废弃物循环。

计算特征:

- 反应力场(ReaxFF):LAMMPS模拟等离子体刻蚀中的复杂化学反应,原子数达百万级

- 计算流体力学(CFD):Ansys Fluent模拟反应腔室流场与传质

- 生命周期评估(LCA):全厂级能耗与碳足迹数据密集型分析

UltraLAB推荐配置(GA660M):

- 双路AMD EPYC 9575F(128核):兼顾频率与核心数

- 100GB/s全闪存阵列:应对ReaxFF轨迹文件的高频I/O

- GPU加速:RTX 6000 Ada加速CFD与分子动力学混合仿真

二、2026年半导体科研硬件配置黄金法则

基于十大课题的计算特征,UltraLAB提出“三维平衡”配置哲学:

1. I/O墙突破:全闪存架构成为刚需

2026年半导体仿真已进入“数据爆炸”时代。TCAD单任务临时文件可达TB级,Chiplet设计数据达PB级。50GB/s+带宽的全闪存阵列是确保GPU/CPU不空转的前提。

推荐配置:

- 本地层:4×PCIe 5.0 NVMe RAID0(16GB/s)

- 共享层:100GbE全闪存存储(WEKA/GPFS)

- 归档层:LTO-9磁带库(18TB/盘)

2. 异构计算:高频与多核的精准分工

- 高频优先(5.0GHz+):EDA网格剖分、SPICE仿真、优化算法

- 多核优先(128核+):物理求解、蒙特卡洛分析、机器学习训练

- GPU加速:电磁仿真、深度学习、分子动力学

黄金组合:AMD Ryzen/Threadripper PRO(高频单核)+ AMD EPYC(多核并行)+ NVIDIA RTX 50系列(GPU加速)

3. 内存-显存池化:CXL 2.0架构

通过CXL内存扩展卡,将DRAM池化为统一地址空间,突破单节点内存限制。对于3D IC热仿真、AI大模型微调等“内存墙”场景,1TB+内存配置成为标配。

4. 静音液冷:实验室环境适配

随着CPU功耗突破500W、GPU突破600W,全液冷方案已成为保障实验室案头工作站稳定运行的唯一选择。UltraLAB的静音液冷技术可将噪音控制在40dB以下,满足实验室声学环境要求。

三、UltraLAB半导体科研工作站产品矩阵

| 系列 | 定位 | 核心配置 | 适用场景 |

|---|---|---|---|

| UltraLAB AR350 | 个人旗舰 | AMD 9950X3D + RTX 5090×2 + 256GB | TCAD建模、PCB设计、轻量级AI推理 |

| UltraLAB GA660M | 团队算力中枢 | 双路EPYC 9755 + RTX 5090×4 + 1TB | 3D EM仿真、Chiplet设计、大模型微调 |

| UltraLAB GX660 | 系级集群头节点 | 双路Xeon 5代 + 2TB内存 + IB网络 | 全厂级sign-off、分布式EDA、量子计算模拟 |

| UltraLAB AlphaPro660 | 液冷静音旗舰 | 双路EPYC 9575F + 4×B200 + 全液冷 | 7×24小时持续计算、HBM仿真、多物理场耦合 |

结语:用匹配的算力,加速中国半导体的下一个突破

当半导体技术进入埃米(Angstrom)时代,仿真精度与算力密度的赛跑从未停止。从GAAFET的原子级TCAD,到Chiplet的百亿节点签核,从AI驱动的EDA布局,到量子计算的低温控制——每一个前沿课题的突破,都建立在精准配置的算力底座之上。

UltraLAB深耕行业计算应用十余年,通过精准分析软件计算特点,为清华大学集成电路学院、中科院微电子所等顶级机构提供定制化硬件方案。2026年,让我们用匹配的算力,加速中国半导体的下一个突破。

如需针对您具体研究方向的定制化配置方案,欢迎联系UltraLAB技术顾问团队。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)