利用 RabbitMQ 优化大数据领域的数据存储架构

利用 RabbitMQ 优化大数据领域的数据存储架构

关键词:RabbitMQ、大数据、消息队列、数据存储、架构优化、异步处理、解耦

摘要:本文探讨如何利用 RabbitMQ 消息队列技术优化大数据领域的数据存储架构。我们将从消息队列的基本概念入手,分析大数据存储面临的挑战,详细讲解 RabbitMQ 的核心原理和特性,并通过实际案例展示如何将其应用于大数据存储架构优化中。文章将涵盖技术原理、架构设计、代码实现和性能优化等多个方面,帮助读者构建更高效、更可靠的大数据存储系统。

背景介绍

目的和范围

本文旨在为大数据架构师和开发者提供一种利用 RabbitMQ 优化数据存储架构的实用方法。我们将重点讨论如何通过消息队列解决大数据存储中的性能瓶颈、系统耦合和数据一致性问题。

预期读者

- 大数据架构师和工程师

- 后端开发人员

- 系统运维工程师

- 对消息队列技术感兴趣的技术爱好者

文档结构概述

- 介绍消息队列和大数据存储的基本概念

- 分析大数据存储面临的挑战

- 深入讲解 RabbitMQ 的核心原理

- 展示如何利用 RabbitMQ 优化存储架构

- 提供实际案例和代码实现

- 讨论性能优化和最佳实践

术语表

核心术语定义

- RabbitMQ:一个开源的消息代理和队列服务器,用于在应用程序之间异步传递消息

- 消息队列:一种应用程序之间的通信方法,消息发送到队列中,由接收方处理

- 大数据存储:用于存储、管理和处理海量数据的技术和架构

相关概念解释

- 生产者(Producer):发送消息的应用程序

- 消费者(Consumer):接收消息的应用程序

- 交换器(Exchange):接收生产者发送的消息并根据规则路由到队列

- 队列(Queue):存储消息的缓冲区

- 绑定(Binding):连接交换器和队列的规则

缩略词列表

- MQ:Message Queue,消息队列

- AMQP:Advanced Message Queuing Protocol,高级消息队列协议

- QoS:Quality of Service,服务质量

- TTL:Time To Live,生存时间

核心概念与联系

故事引入

想象一下,你经营着一家大型电商平台,每天有数百万用户浏览商品、下单购买。这些用户行为会产生海量数据,需要实时存储和分析。如果让每个用户请求直接写入数据库,就像让所有顾客同时挤进一家小商店结账,必然导致系统崩溃。RabbitMQ 就像一位聪明的导购员,安排顾客有序排队,分批进入,既保证了商店正常运营,又不会让顾客等待太久。

核心概念解释

核心概念一:消息队列

消息队列就像一个邮局系统。发送者(生产者)把信件(消息)投递到邮局(消息队列),邮局负责将信件分发给正确的收件人(消费者)。这样发送者和接收者不需要同时在线,也不需要知道对方的具体位置。

核心概念二:RabbitMQ

RabbitMQ 是一个专业的邮局,它支持多种投递方式(交换器类型),可以确保信件不会丢失(持久化),还能处理特殊情况(死信队列)。它遵循国际邮政协定(AMQP),能与各种语言的应用程序通信。

核心概念三:大数据存储挑战

大数据存储就像管理一个巨型仓库。当货物(数据)太多、进出太频繁时,直接操作仓库会导致效率低下。我们需要一个缓冲区(消息队列)来暂存货物,让仓库管理员(数据库)按自己的能力处理,避免超负荷。

核心概念之间的关系

消息队列与大数据存储的关系

消息队列就像仓库门口的装卸区,卡车(数据生产者)把货物卸在这里,再由叉车(消费者)按仓库的处理能力分批运入。这样卡车不必等待仓库处理完所有货物,可以继续去拉新的货物。

RabbitMQ与消息队列的关系

RabbitMQ 是一个智能装卸系统,它可以根据货物类型(路由键)决定放在哪个区域(队列),可以设置优先处理某些货物(优先级队列),还能在系统故障时保护货物不丢失(持久化)。

大数据存储与系统性能的关系

没有消息队列的大数据存储就像没有缓冲区的仓库,卡车必须等待每批货物完全入库才能离开,导致整个系统效率低下。引入 RabbitMQ 后,仓库可以持续高效运转,吞吐量大幅提升。

核心概念原理和架构的文本示意图

[数据生产者] -> [RabbitMQ交换器] -> [队列] -> [数据消费者] -> [大数据存储]

↑ |

|_____________________________________|

反馈与控制

Mermaid 流程图

核心算法原理 & 具体操作步骤

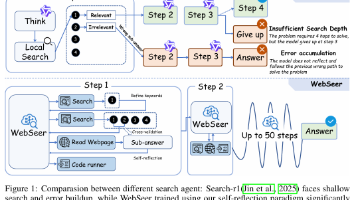

RabbitMQ 的核心算法主要包括消息路由算法和队列调度算法。我们来看一下主要的交换器类型及其路由原理:

-

直连交换器(Direct Exchange):精确匹配路由键

# Python示例:使用直连交换器 channel.exchange_declare(exchange='direct_logs', exchange_type='direct') channel.queue_bind(exchange='direct_logs', queue=queue_name, routing_key='storage') -

扇出交换器(Fanout Exchange):广播到所有绑定队列

channel.exchange_declare(exchange='logs', exchange_type='fanout') channel.queue_bind(exchange='logs', queue=queue_name) -

主题交换器(Topic Exchange):基于模式匹配路由

channel.exchange_declare(exchange='topic_logs', exchange_type='topic') channel.queue_bind(exchange='topic_logs', queue=queue_name, routing_key='storage.#') -

头交换器(Headers Exchange):基于消息头匹配

channel.exchange_declare(exchange='headers_logs', exchange_type='headers') channel.queue_bind(exchange='headers_logs', queue=queue_name, arguments={'x-match': 'all', 'type': 'storage'})

数学模型和公式 & 详细讲解 & 举例说明

消息队列性能模型

消息队列系统的性能可以用以下模型表示:

系统吞吐量=min(Nproducers⋅RproducerMsgSize,Nconsumers⋅RconsumerMsgSize,Rbroker) \text{系统吞吐量} = \min\left(\frac{N_{\text{producers}} \cdot R_{\text{producer}}}{\text{MsgSize}}, \frac{N_{\text{consumers}} \cdot R_{\text{consumer}}}{\text{MsgSize}}, R_{\text{broker}}\right) 系统吞吐量=min(MsgSizeNproducers⋅Rproducer,MsgSizeNconsumers⋅Rconsumer,Rbroker)

其中:

- NproducersN_{\text{producers}}Nproducers: 生产者数量

- RproducerR_{\text{producer}}Rproducer: 单个生产者发送速率(msg/s)

- NconsumersN_{\text{consumers}}Nconsumers: 消费者数量

- RconsumerR_{\text{consumer}}Rconsumer: 单个消费者处理速率(msg/s)

- MsgSize\text{MsgSize}MsgSize: 平均消息大小

- RbrokerR_{\text{broker}}Rbroker: 消息代理处理能力

队列长度与延迟关系

Little’s Law 描述了队列中消息数量与延迟的关系:

L=λW L = \lambda W L=λW

其中:

- LLL: 平均队列长度

- λ\lambdaλ: 平均到达率

- WWW: 平均等待时间

这意味着要减少延迟,要么提高处理能力(减少W),要么控制到达率(λ),或者两者兼施。

项目实战:代码实际案例和详细解释说明

开发环境搭建

-

安装 RabbitMQ 服务器:

# Ubuntu sudo apt-get install rabbitmq-server # 启动服务 sudo systemctl start rabbitmq-server -

安装 Python 客户端库:

pip install pika

源代码详细实现和代码解读

生产者代码:发送大数据存储请求

import pika

import json

class StorageProducer:

def __init__(self, host='localhost'):

self.connection = pika.BlockingConnection(

pika.ConnectionParameters(host=host))

self.channel = self.connection.channel()

# 声明直连交换器

self.channel.exchange_declare(

exchange='storage_direct',

exchange_type='direct',

durable=True) # 持久化交换器

# 声明队列,设置最大长度防止内存溢出

self.channel.queue_declare(

queue='storage_queue',

durable=True, # 持久化队列

arguments={

'x-max-length': 10000, # 最大消息数

'x-overflow': 'reject-publish' # 超出时拒绝新消息

})

# 绑定队列到交换器

self.channel.queue_bind(

exchange='storage_direct',

queue='storage_queue',

routing_key='storage')

def publish(self, data):

"""发布存储请求"""

try:

self.channel.basic_publish(

exchange='storage_direct',

routing_key='storage',

body=json.dumps(data),

properties=pika.BasicProperties(

delivery_mode=2, # 持久化消息

priority=data.get('priority', 0)

))

return True

except Exception as e:

print(f"Failed to publish message: {e}")

return False

def close(self):

self.connection.close()

# 使用示例

producer = StorageProducer()

data = {

"id": "user123",

"action": "purchase",

"items": ["item1", "item2"],

"timestamp": "2023-01-01T12:00:00",

"priority": 1 # 高优先级

}

producer.publish(data)

producer.close()

消费者代码:处理存储请求

import pika

import json

import time

from database import DatabaseClient # 假设的数据库客户端

class StorageConsumer:

def __init__(self, host='localhost'):

self.connection = pika.BlockingConnection(

pika.ConnectionParameters(host=host))

self.channel = self.connection.channel()

# 确保队列存在

self.channel.queue_declare(

queue='storage_queue',

durable=True,

arguments={

'x-max-length': 10000,

'x-overflow': 'reject-publish'

})

# 设置QoS,限制未确认消息数量

self.channel.basic_qos(prefetch_count=100) # 每次最多处理100条

self.db = DatabaseClient() # 初始化数据库客户端

def callback(self, ch, method, properties, body):

"""处理消息的回调函数"""

try:

data = json.loads(body)

print(f"Processing message: {data['id']}")

# 模拟处理时间,高优先级消息处理更快

if properties.priority > 0:

time.sleep(0.1) # 高优先级快速处理

else:

time.sleep(0.5) # 普通优先级

# 存储到数据库

success = self.db.insert(data)

if success:

ch.basic_ack(delivery_tag=method.delivery_tag)

else:

# 存储失败,拒绝消息并重新入队

ch.basic_nack(delivery_tag=method.delivery_tag, requeue=True)

except Exception as e:

print(f"Error processing message: {e}")

# 消息格式错误,直接丢弃

ch.basic_nack(delivery_tag=method.delivery_tag, requeue=False)

def start_consuming(self):

"""开始消费消息"""

self.channel.basic_consume(

queue='storage_queue',

on_message_callback=self.callback,

auto_ack=False) # 手动确认

print('Waiting for messages. To exit press CTRL+C')

try:

self.channel.start_consuming()

except KeyboardInterrupt:

self.channel.stop_consuming()

self.connection.close()

# 启动消费者

consumer = StorageConsumer()

consumer.start_consuming()

代码解读与分析

-

生产者关键设计:

- 使用持久化的交换器和队列,确保消息不丢失

- 设置队列最大长度,防止内存溢出

- 支持消息优先级,确保重要数据优先处理

- 消息体使用JSON格式,便于跨语言处理

-

消费者关键设计:

- 设置QoS(prefetch_count),控制处理速度

- 手动确认消息,确保数据成功存储后才确认

- 区分处理优先级,优化系统响应

- 完善的错误处理,避免消息丢失或死循环

-

性能优化点:

- 批量插入:可以修改消费者,累积多条消息后批量写入数据库

- 并行处理:可以启动多个消费者进程并行处理

- 死信队列:可以配置处理失败的消息转到死信队列,供后续分析

实际应用场景

-

电商用户行为分析:

- 场景:百万级用户点击、浏览、购买事件的实时收集和分析

- 方案:前端发送事件到RabbitMQ,消费者批量写入数据仓库

- 优势:缓冲高峰流量,避免直接冲击分析数据库

-

物联网设备数据采集:

- 场景:数千个传感器持续发送监测数据

- 方案:设备数据先发送到RabbitMQ,由消费者处理后存入时序数据库

- 优势:解耦设备与存储系统,设备无需关心存储状态

-

日志收集与分析:

- 场景:分布式系统产生的海量日志需要集中存储

- 方案:各服务发送日志到RabbitMQ,消费者处理后存入Elasticsearch

- 优势:避免日志丢失,控制写入速率保护存储系统

-

金融交易记录:

- 场景:高频交易系统产生的交易记录需要可靠存储

- 方案:交易系统发送记录到RabbitMQ,持久化后由消费者处理

- 优势:确保交易记录不丢失,即使存储系统暂时不可用

工具和资源推荐

-

管理工具:

- RabbitMQ Management Plugin:内置的Web管理界面

rabbitmq-plugins enable rabbitmq_management- Prometheus RabbitMQ Exporter:监控RabbitMQ指标

-

客户端库:

- Python: pika

- Java: amqp-client

- Go: amqp

- Node.js: amqplib

-

相关技术:

- Kafka:高吞吐量消息系统,适合日志类场景

- Redis Streams:轻量级消息队列,适合简单场景

- Apache Pulsar:新一代消息系统,适合云原生环境

-

学习资源:

- 官方文档:https://www.rabbitmq.com/documentation.html

- 《RabbitMQ in Action》:深入讲解RabbitMQ的书籍

- RabbitMQ Patterns:常见消息模式集合

未来发展趋势与挑战

-

云原生支持:

- RabbitMQ正在增强Kubernetes支持,如RabbitMQ Cluster Operator

- 挑战:在弹性伸缩环境中保持消息可靠性

-

性能优化:

- 新版本在吞吐量和延迟方面持续改进

- 挑战:与Kafka等高性能系统竞争

-

多协议支持:

- 除了AMQP,还支持MQTT、STOMP等协议

- 挑战:保持各协议实现的一致性和可靠性

-

大数据集成:

- 与Spark、Flink等大数据框架更紧密集成

- 挑战:处理超大规模数据时的性能瓶颈

-

安全增强:

- 更完善的TLS支持和认证机制

- 挑战:平衡安全性和性能开销

总结:学到了什么?

核心概念回顾

- 消息队列:作为数据生产者和存储系统之间的缓冲层,提高系统可靠性和扩展性

- RabbitMQ:功能丰富的消息代理,支持多种消息模式、优先级、持久化等特性

- 大数据存储挑战:高吞吐量、可靠性、顺序性等要求,可以通过消息队列有效解决

概念关系回顾

- RabbitMQ 作为消息队列的实现,为大数据存储架构提供了异步处理能力,解耦了数据生产者和存储系统

- 通过持久化、确认机制和死信队列,确保了数据在传输过程中不丢失

- 优先级队列和QoS设置使得关键数据能够得到优先处理,优化了系统资源利用

架构价值

- 削峰填谷:缓冲突发流量,保护存储系统

- 解耦系统:生产者和消费者独立演进和扩展

- 提高可靠性:消息持久化和重试机制增强数据可靠性

- 灵活扩展:可以方便地增加消费者提高处理能力

思考题:动动小脑筋

思考题一:

如果你的系统需要处理每秒10万条消息,你会如何设计RabbitMQ的架构?需要考虑哪些因素?

思考题二:

如何利用RabbitMQ实现大数据存储系统的"至少一次"语义?如果要求"精确一次"语义,又该如何设计?

思考题三:

在大数据场景下,RabbitMQ和Kafka各有何优劣?在什么情况下你会选择RabbitMQ而不是Kafka?

附录:常见问题与解答

Q1: RabbitMQ队列消息堆积怎么办?

A1: 可以采取以下措施:

- 增加消费者数量

- 优化消费者处理逻辑,提高处理速度

- 设置队列最大长度,防止无限堆积

- 对于非关键数据,可以设置TTL自动过期

Q2: 如何保证消息顺序性?

A2: RabbitMQ在单个队列中可以保证消息顺序,但需要注意:

- 使用单个队列和单个消费者可以严格保证顺序

- 多个消费者时,可以将需要有序的消息设为同一优先级并使用单个消费者

- 或者使用一致性哈希将相关消息路由到同一队列

Q3: RabbitMQ集群如何配置?

A3: RabbitMQ集群配置步骤:

- 确保各节点使用相同的erlang cookie

- 在各节点上执行

rabbitmqctl join_cluster rabbit@node1 - 配置镜像队列策略实现高可用

- 注意网络延迟和分区处理策略

扩展阅读 & 参考资料

-

官方文档:

- RabbitMQ Documentation: https://www.rabbitmq.com/documentation.html

- AMQP 0-9-1 Specification: https://www.rabbitmq.com/amqp-0-9-1-reference.html

-

书籍:

- 《RabbitMQ in Action》 by Alvaro Videla and Jason J. W. Williams

- 《Designing Data-Intensive Applications》 by Martin Kleppmann

-

开源项目:

- RabbitMQ Cluster Operator: https://github.com/rabbitmq/cluster-operator

- RabbitMQ Prometheus Exporter: https://github.com/kbudde/rabbitmq_exporter

-

相关论文:

- “A Survey of Message Queueing and Message Brokering Systems”

- “Benchmarking Message Queue Systems for Big Data Applications”

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)