大语言模型应用核心揭秘:从Embedding到RAG,打造智能问答利器!

本文深入剖析了Embedding、RAG、微调、Prompt和上下文窗口这五大语言模型应用层核心技术,通过图书馆的比喻形象解释了各自的定义与作用。Embedding将文本转为索引标签,RAG结合外部知识库生成准确回答,微调定制模型专项能力,Prompt清晰下达指令,上下文窗口限制处理文本长度。文章重点阐述了这些技术的协同关系,并以公司内部知识库问答机器人为例,展示了完整工作流程。此外,还提供了针对不同业务场景的技术选型对照表,为实际应用提供指导。

Embedding、RAG、微调、 Prompt 、上下文窗口都是大语言模型(LLM)应用层的核心技术,彼此关联且分工明确,我们可以用 “图书馆” 的比喻来逐个理解,再说明它们的协同关系。

1. Embedding(嵌入):把文字变成 “图书馆索引标签”

核心定义:将文本、图片等非结构化数据,转换成计算机能理解的低维稠密向量(一串数字),向量之间的距离代表语义相似度。通俗理解:就像图书馆给每本书贴的 “主题标签”,比如《三体》的标签是「科幻、宇宙、刘慈欣」,《百年孤独》的标签是「魔幻现实主义、拉美、家族」。标签越像,两本书的内容越接近。

举例

- 输入句子 A:“猫喜欢吃鱼”,输入句子 B:“狗喜欢啃骨头”,输入句子 C:“猫咪爱吃鱼”。

- Embedding 转换后,A 和 C 的向量距离非常近(语义几乎一致),A 和 B 的向量距离很远(语义差异大)。

- 应用场景:搜索引擎的语义匹配、RAG 的文档检索、推荐系统的内容相似性判断。

2. RAG(检索增强生成):先查馆藏再回答,而不是凭记忆瞎说

核心定义:在模型生成回答前,先从外部知识库(文档、数据库)检索与问题相关的信息,再把检索到的信息和问题一起喂给模型,让模型基于这些真实信息生成回答。通俗理解:就像你问图书管理员 “三体里的黑暗森林法则是什么”,管理员不会凭自己的模糊记忆回答,而是先去书架上找到《三体》这本书,翻到对应的章节,再照着内容给你解释。

举例

- 问题:“字节跳动 2024 年的营收是多少?”

- 直接问大模型(无 RAG):模型可能因为训练数据截止到 2023 年,给出错误答案或 “不知道”。

- 用 RAG 后:系统先检索 2024 年权威财经报道、字节跳动公开财报,找到 “2024 年字节跳动营收约 1500 亿美元” 的信息,再把这个信息传给模型,模型就能准确回答。

- 核心价值:解决大模型的知识过时、事实错误(幻觉)问题,无需重新训练模型。

3. 微调(Fine-tuning):给模型 “定制专项辅导课”

核心定义:在大模型预训练的基础上,用小批量的领域数据继续训练模型,让模型适配特定场景的任务或风格。通俗理解:就像一个通用学霸(预训练大模型),原本什么都懂一点,但你想让他专攻 “高考数学压轴题”,于是给他做 100 套压轴题真题(微调数据),经过专项训练后,他做这类题的正确率会大幅提升。

举例

- 通用大模型:能写文章、聊天,但写法律文书时不专业,会出现术语错误。

- 微调后:用 1 万份真实的合同、判决书、法律意见书作为微调数据,训练模型。微调后的模型能精准写出符合规范的法律条款,比如 “本合同有效期自签订之日起 1 年,期满前 30 日内双方可协商续签”。

- 与 RAG 的区别:微调是改变模型的 “固有知识”,适合需要长期稳定适配某领域的场景;RAG 是临时借用外部知识,适合知识频繁更新的场景。

4. Prompt(提示词):给模型 “下达清晰的指令”

核心定义:用户输入给模型的文本指令,用来引导模型生成符合需求的输出,包括问题、任务描述、约束条件、示例等。通俗理解:就像你去图书馆借书,对管理员说的话 —— 指令越清晰,管理员越容易帮你找到想要的书。

- 模糊指令:“我想看小说” → 管理员可能随便拿一本小说。

- 清晰指令:“我想看一本 2020 年后出版的、中国作家写的科幻小说,不要太长” → 管理员能精准推荐《北京折叠》《球状闪电》等。

举例

- 基础 Prompt:“写一篇关于春天的作文” → 模型生成一篇普通的写景作文。

- 优化 Prompt:“写一篇初中生水平的春天作文,要求用比喻和拟人手法,字数 300 字左右,重点描写春雨和小草” → 模型生成的内容会严格符合这些约束。

- 进阶技巧:Few-shot Prompt(给模型几个示例),比如 “请判断情感倾向:示例 1 今天天气真好→积极;示例 2 我丢了钱包→消极;现在判断:这部电影太精彩了→?”,模型会根据示例给出答案。

5. 上下文窗口(Context Window):模型的 “短期记忆容量”

核心定义:指模型能同时处理的输入 + 输出文本的最大长度,单位是 token(1 个 token≈0.75 个中文字)。超过这个长度,模型会 “忘记” 前面的内容。通俗理解:就像图书馆管理员的临时记忆上限—— 你一次给他的书单 + 问题不能太长,否则他记不住前面的内容。比如管理员的记忆容量是 100 个词,你说 “我要借《三体》《百年孤独》《红楼梦》……(共 150 个词的书单)”,他可能只记得最后几本。

举例

- 模型 A 的上下文窗口是 4k token(约 3000 中文字):你输入一篇 2000 字的文章,再问 “这篇文章的中心思想是什么”,模型能完整理解并回答。

- 如果你输入一篇 5000 字的文章(超过 4k token):模型会截断前面的内容,只基于最后 1000 字回答,导致答案错误。

- 影响:上下文窗口越大,模型能处理的长文本、多轮对话越多(比如连续聊 10 轮不忘记前面的内容),但硬件成本也越高。目前主流模型的窗口有 4k、8k、32k、128k 等。

6.核心技术的协同关系(完整工作流举例)

假设你要做一个公司内部知识库问答机器人:

- Embedding:把公司所有的产品手册、员工手册、FAQ 文档转换成向量,存入向量数据库(相当于给所有文档贴好索引标签)。

- 用户提问:员工问 “如何申请年假?”

- RAG 检索:系统把问题转换成向量,去向量数据库里检索最相似的文档(比如《员工手册 - 假期制度》)。

- 上下文窗口:把检索到的假期制度内容 + 用户问题,拼成一个不超过模型窗口长度的输入。

- Prompt 设计:给输入加指令 “请根据以下员工手册内容,简洁回答用户的问题:{检索内容} 问题:{用户问题}”。

- 微调(可选):如果回答风格不符合公司要求,用 100 个 “标准问题 + 标准回答” 数据微调模型,让回答更规范。

- 模型生成:输出最终答案:“申请年假需提前 15 天在 OA 系统提交申请,经直属领导审批通过后生效……”

7、大模型核心技术选型对照表

该表格聚焦业务需求场景,明确 Embedding、RAG、微调、Prompt、上下文窗口的选型策略,方便快速匹配技术方案。

| 业务场景 | 核心需求 | 优先技术组合 | 选型理由 & 实操要点 |

| 实时知识问答(如公司财报、新闻资讯、政策解读) | 知识频繁更新、要求答案真实无幻觉 | Embedding + RAG + 精准 Prompt | 1. 无需重新训练模型,仅需更新向量数据库里的文档,成本低 2. Prompt 需明确约束:“仅基于提供的检索内容回答,不要编造信息” 3. Embedding 模型选择与业务文本匹配的类型(如专业文档选领域专用 Embedding 模型) |

| 领域专用助手(如法律文书撰写、医疗问诊话术、工业设备故障诊断) | 输出内容需符合领域规范、术语精准 | 通用模型 + 领域数据微调 + 场景化 Prompt | 1. 微调让模型 “记住” 领域规则,比单纯 Prompt 更稳定 2. 微调数据需高质量(如法律场景用真实判决书、合同范本) 3. Prompt 补充具体任务要求(如 “撰写一份劳动仲裁申请书,包含申请人信息、仲裁请求、事实理由”) |

| 长文本处理(如万字合同审核、长篇小说情节分析、论文摘要生成) | 需理解超长输入内容 | 大上下文窗口模型 + RAG(分段检索) | 1. 选择 32k/128k 大窗口模型,避免截断关键内容 2. 长文档先分段做 Embedding,RAG 检索相关段落再拼接,减少窗口占用 3. Prompt 明确输出格式(如 “列出合同中 5 处风险条款,每处标注风险等级”) |

| 多轮对话助手(如智能客服、私人助理) | 记住历史对话信息,连贯回答 | 适中上下文窗口 + 对话 Prompt 模板 | 1. 窗口大小选 8k-16k,足够容纳 10-20 轮对话 2. Prompt 模板固定格式:“历史对话:{历史内容}\n 当前问题:{用户提问}\n 请基于历史对话连贯回答” 3. 定期清理无关历史内容,节省窗口空间 |

| 创意内容生成(如广告文案、小说续写、短视频脚本) | 风格多样、自由度高 | 通用大模型 + 精 | - |

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

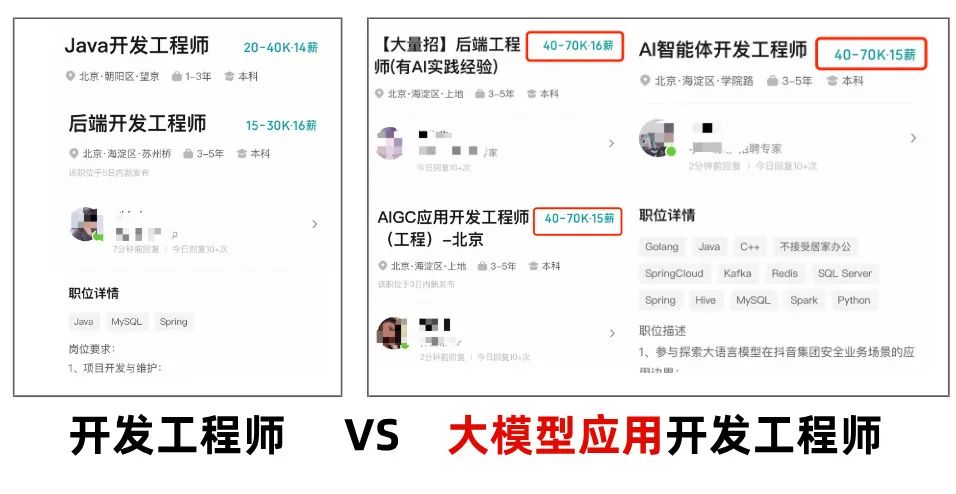

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)