24张图解AI大模型通识:从人工智能、深度学习、机器学习到AI大模型的细分知识点全解析

前言

大模型技术发展得飞快,各种新概念一个接一个冒出来。刚入门的朋友就像走进了一家超大的“技术超市”:今天被Transformer的注意力机制勾住了目光,明天又迷上Prompt的“魔法咒语”,后天LangChain又像拉链一样把各种东西串在一起。

到头来,购物车里塞得满满当当,可真要动手用的时候,却不知道该怎么搭配组合。学大模型很容易陷入知识碎片化的困境,没有完整的体系,很难做到真正理解,也记不牢固。

更让人头疼的是,大模型更新的速度,比我们整理学习资料的速度还要快!这篇文章就是想用可视化图解的方式,把相关概念梳理清楚,帮大家搭建起从AI基础到Agent应用的完整知识体系,让大家能系统吃透大模型技术的核心逻辑和发展脉络。

一、人工智能技术基础:从符号主义到深度学习

1.1 人工智能技术架构

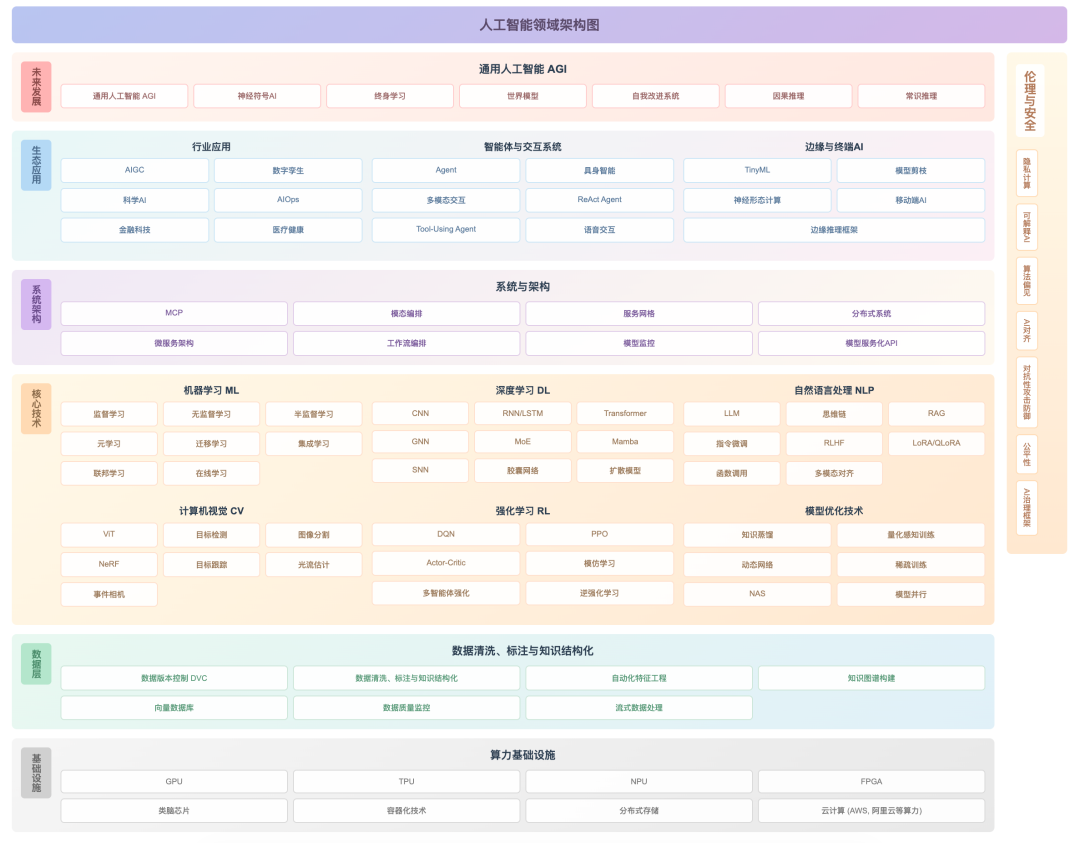

学AI的时候,如果能先搞清楚整个技术领域的大致框架,明白每个知识点在什么位置、属于哪个层次,学习效率会高很多。人工智能是个非常庞大的知识体系,绝不是几张图或者几个专业名词就能讲完的。

其实很多人脑子里已经积累了不少AI相关的知识,这篇文章就是想用一个清晰的框架帮你梳理一遍,相当于给你的“大脑知识库”做一次小小的优化调整。

图 1:人工智能领域架构图

1.2 人工智能的分层领域

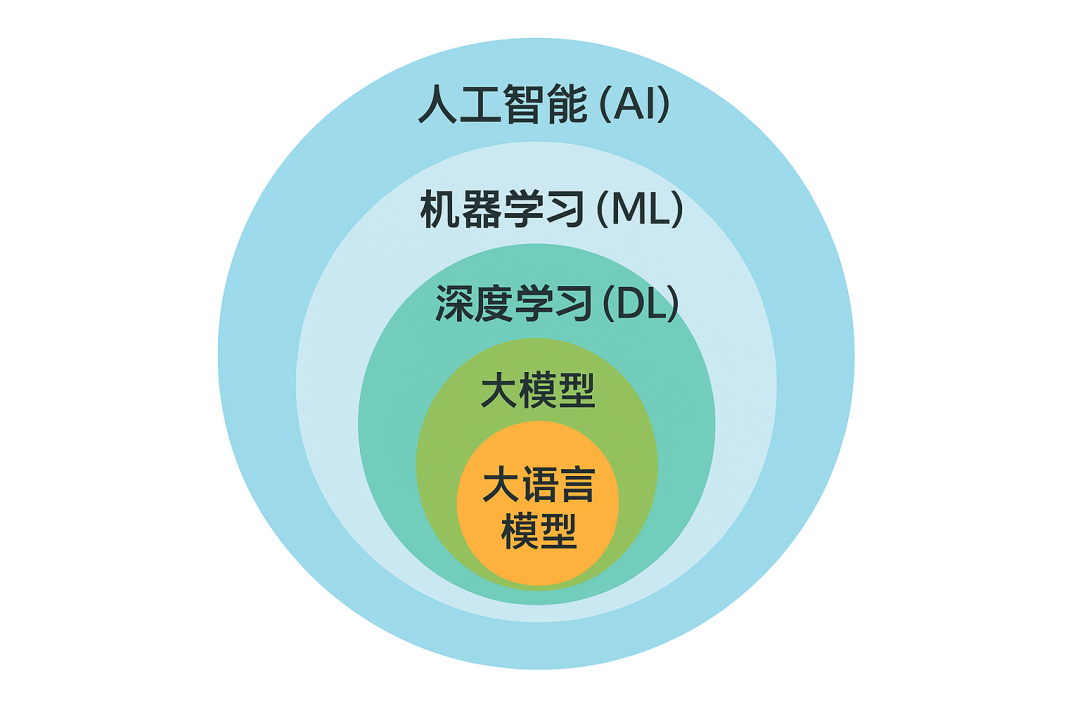

核心关系:人工智能(AI)包含机器学习(ML),机器学习(ML)又包含深度学习(DL)。

发展历程:符号主义时代(1950s-1980s):主要是靠规则来运行的专家系统,所有规则都需要人手动写好。

机器学习时代(1990s-2000s):可以从数据里自己学习规律,不再那么依赖人工写规则。

深度学习时代(2010s-2020s):用大规模神经网络,在语音、图像、自然语言处理等领域广泛应用。

大模型时代(2020s 至今):超大规模预训练模型、生成式模型大量出现,朝着通用智能的方向发展。

图 2:深度学习与大模型的关系

1.3 深度学习的核心:神经网络家族

神经网络的基础其实就是简单的感知机模型,它主要包含输入层、隐藏层和输出层,一般用来做通用的模式识别任务。

随着深度学习不断发展,市面上也出现了很多典型的网络架构:

Transformer和CNN、RNN属于同一级别,都是神经网络里的基础架构类型。而Transformer最具革命性的地方在于:

它不再依赖序列顺序,能够实现完全并行化训练;

可以更好地处理长距离依赖问题;

同时也为大模型的进一步拓展提供了切实可行的工程思路。

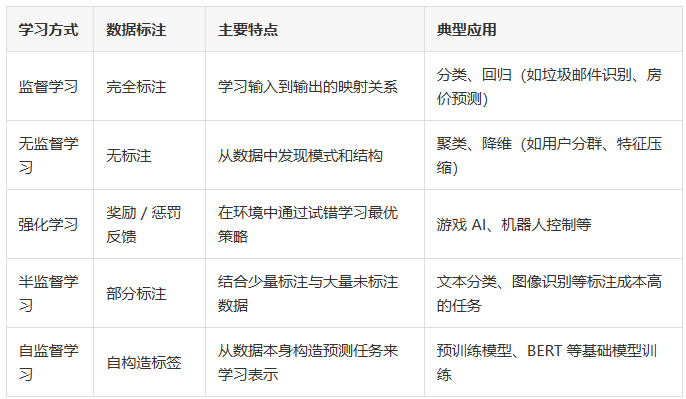

1.4 机器学习的范式:监督 / 无监督等学习方式

深度学习其实是机器学习里面的一个分支,而监督学习、无监督学习、强化学习这些,是按照学习方式来给机器学习做的分类。

它们最核心的区别在于,监督学习和无监督学习主要看有没有用到带标签的数据,而强化学习是靠不断试错,再结合奖励信号来学习怎么做出决策的。

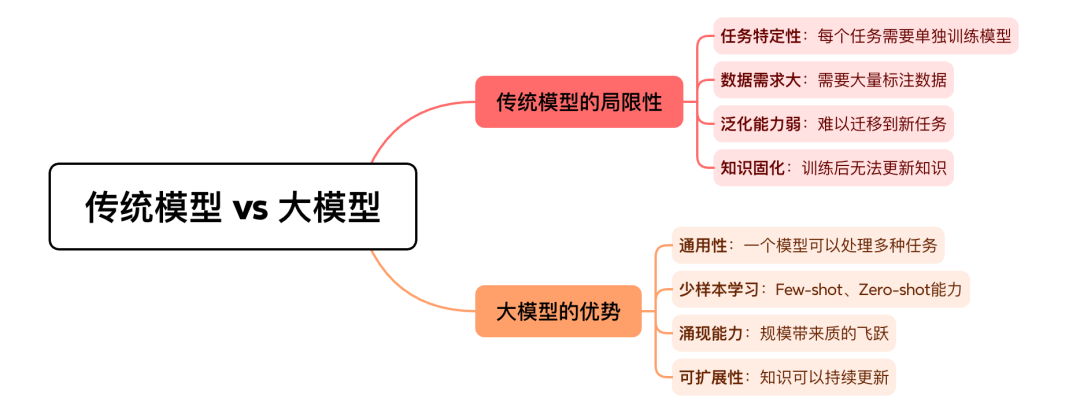

1.5 为什么需要大模型?

从传统模型到大模型,本质上就是从专家系统转向通用智能的过程。传统模型就像是经过专门训练的行业专家,只在单一任务上做精调,泛化能力比较有限。而大模型更像是学识广博的通才,能用同一个模型,搞定多种任务、覆盖多个领域。

图 3:传统模型 vs 大模型对比图

二、大模型技术:从 Transformer 到模型应用

2.1 大模型领域知识框架

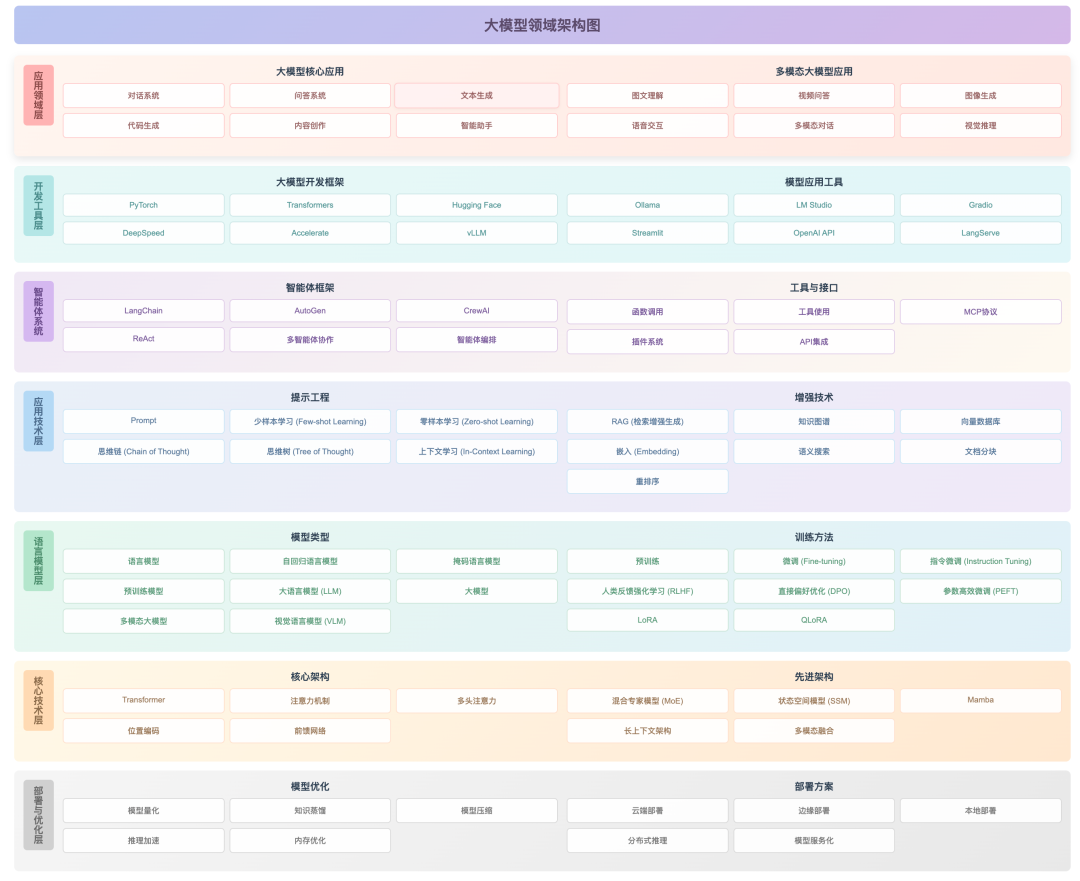

大模型这个领域里的概念特别多,像架构、训练范式、推理方式、应用形态这些都属于其中。我们可以从这几个层面来搞懂它:

底层基础方面,主要是算力、数据还有模型架构,比如Transformer。

训练与对齐这块,包括预训练、微调、指令微调,还有RLHF这类对齐方式。

能力扩展上,有工具调用、RAG、长上下文、代码能力、多模态。

应用形态则包含聊天助手、代码助手、搜索增强、Agent、Multi-Agent等等。

图 4:大模型领域架构图

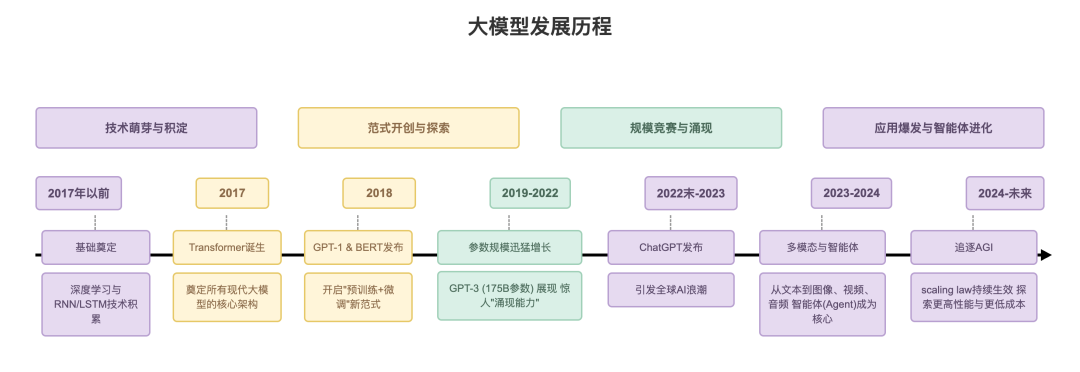

2.2 大模型发展历程

大模型的发展历程,其实可以简单总结成:从最开始的预训练语言模型,一步步发展到现在的通用多模态 Agent 平台。

最早的时候,用的是基于统计和n-gram的语言模型。

到了中期,就变成了基于RNN、LSTM的语言建模。

真正的转折点,是Transformer架构被提出来之后,大家才开始做大规模的预训练。

再往后就进入了大模型时代,GPT系列、BERT系列,还有各个国家和厂商自己研发的大模型,都纷纷发展起来了。

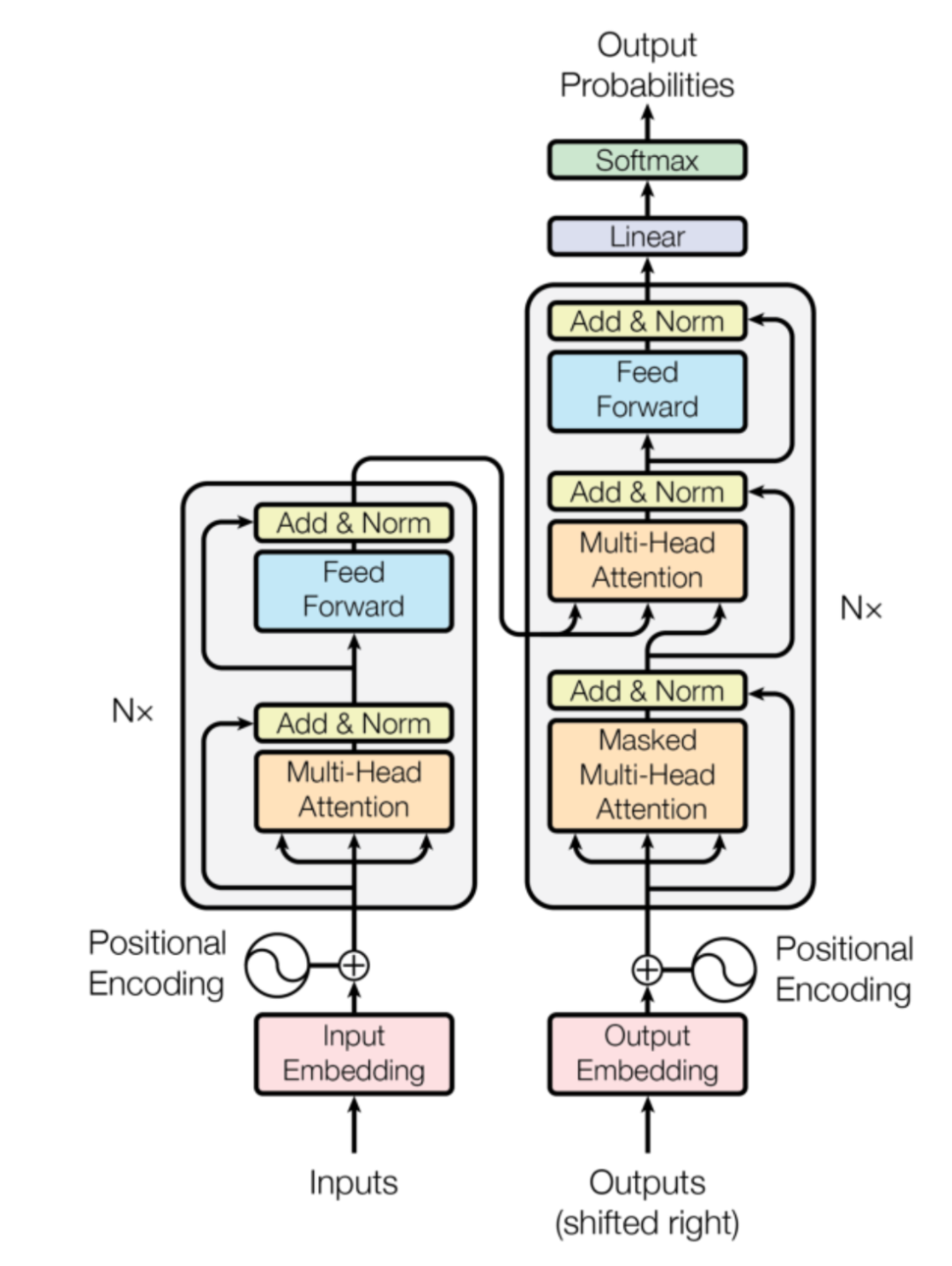

2.3 Transformer 架构:并行化的革命

之前我们说过,RNN 和 LSTM 存在两个主要问题:一个是难以并行,因为它们有严格的序列依赖,没法很好地发挥现代硬件的并行优势;

另一个是长距离依赖能力弱,对于时间间隔比较久的信息,很容易出现“遗忘”的情况。而 Transformer 给出的核心解决办法,就是 Self-Attention 机制。

1)Self-Attention(自注意力)

概述:简单来说,就是让序列里的每一个元素,都能和序列中其他所有元素产生关联,相当于互相“沟通交流”。

再通过计算彼此之间的相似度,给不同元素分配对应的注意力权重,这样就能精准捕捉到序列内部的依赖关系,还有深层的语义联系。

比喻:就跟我们平时读一段话一样,看到每一个词的时候,不会单独只看这个词本身,而是会下意识把它和整段话里其他所有词关联起来,结合上下文才能弄懂它真正的意思。

2)多头注意力(Multi-Head Attention)

概述:把输入的向量拆分成好几个“头”,每个头都会单独去学习一套属于自己的注意力权重,分别从不一样的视角去抓取和关注关键信息,不会局限在单一角度。

比喻:就好比找来好几位专业人士,让他们分别从不同维度分析同一段文字,最后再把所有人的分析结果整合到一起,得出更全面的结论。

3)位置编码(Positional Encoding)

问题:Self-Attention这个机制本身,没办法感知到元素的先后顺序,对序列的位置信息不敏感。

解决办法:通过额外加入位置编码的方式,把每个token对应的位置信息明确传给模型,让模型清楚知道每一个token在序列里处在什么位置。

4)编码器-解码器架构(Encoder-Decoder)

概述:编码器的主要作用,是吃透输入的信息,再把这些信息压缩提炼出来;解码器则是依托编码器处理好的信息,一步步生成对应的输出序列。

比喻:编码器就像是负责“读懂内容”的理解者,解码器更像是负责“把意思说出来”的表达者,这套架构经常用在机器翻译、文本摘要这类任务当中。

Transformer 的革命性意义:

彻底打破了RNN模型没办法并行处理的瓶颈,大幅提升了运算效率;为大规模的模型预训练搭建了高效可行的基础架构;现如今已经成为各类现代大模型通用的核心标准架构。

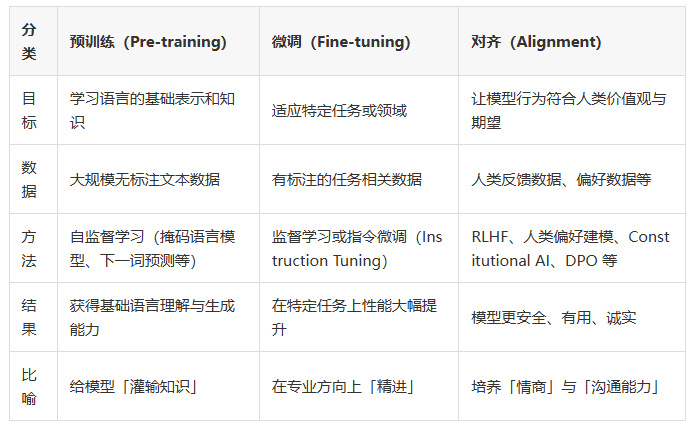

2.4 大模型的训练三阶段:预训练、微调、对齐

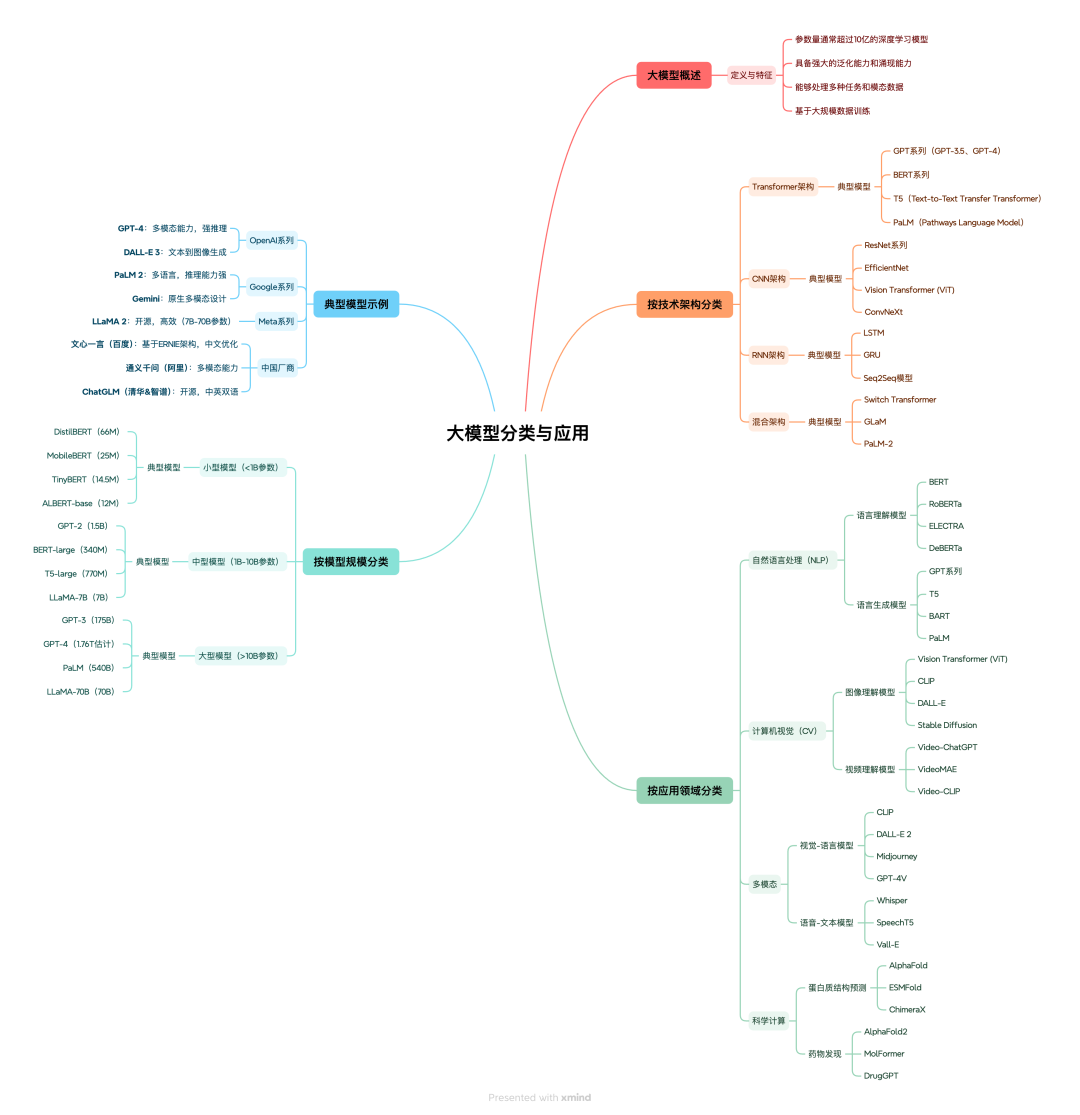

2.5 大模型的分类与应用

大模型其实能从好几个角度来划分,比如说从模态来看,可以分成文本模型、图像模型、语音模型、多模态模型等等。

从用途上区分,又有通用对话模型、编程模型、搜索增强模型、Agent 型模型这些类型。要是按照部署形态来分的话,还能分为云端大模型、本地轻量模型、端侧模型等。

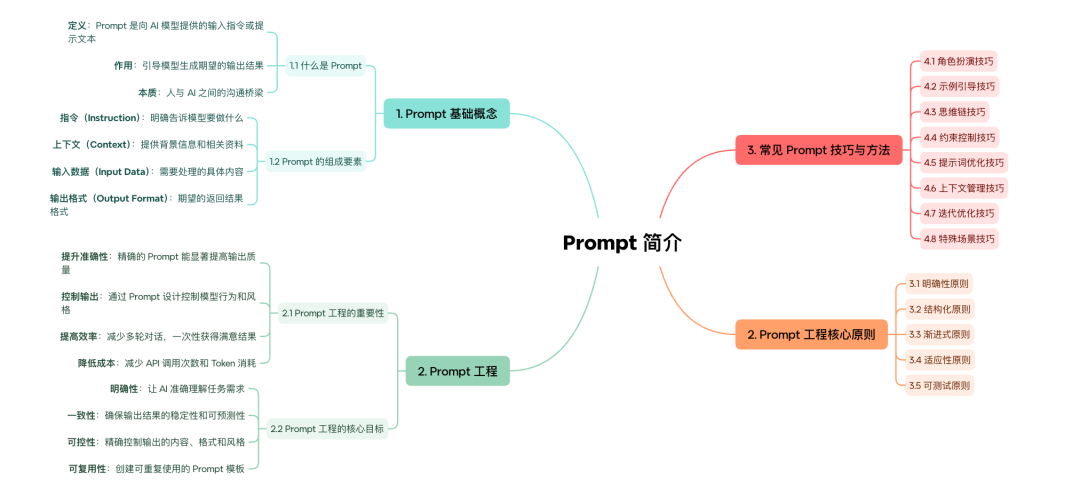

2.6 Prompt Engineering:与 AI 对话的艺术

Prompt 就是人和大模型之间的沟通桥梁,写得清楚明白,才是让模型听话的关键。好的 Prompt,目标明确、约束清楚、步骤拆分合理、还能给到合适的上下文。

不好的 Prompt,则是指令含糊、没有边界条件、不给参考示例、也不设定角色。

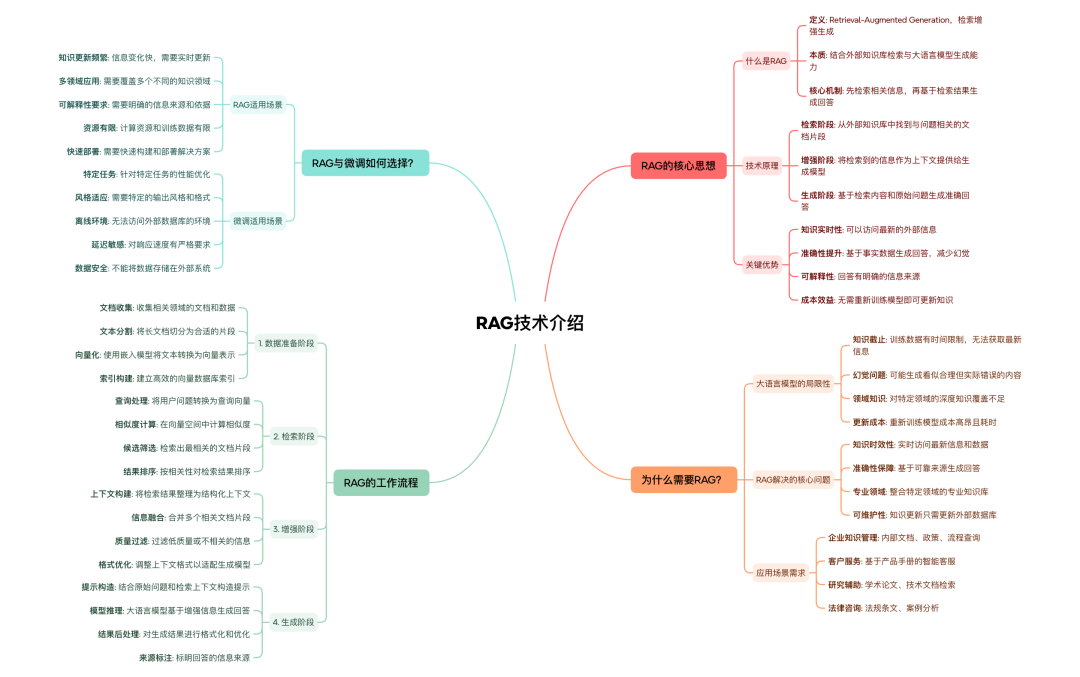

2.7 RAG:检索增强生成

RAG(Retrieval-Augmented Generation)是把外部知识检索和大模型生成结合在一起的技术思路:在调用大模型之前,先从向量数据库或者搜索引擎里找出相关的文档;

再把找到的内容和用户的问题一起输入给模型;模型在参考这些资料的基础上给出回答,从而提高回答的准确性和时效性。

三、智能体(Agent)技术:让 AI 具备行动能力

3.1 智能体(Agent)的定义

很多人对AI Agent的概念都有点模糊,其实最主要的原因是:Agent在不同场景下,说法不一样。我们可以从三个角度来理解它:

(1)学术视角

所谓AI Agent,就是具备这些能力的智能实体:

感知能力(Perception)、决策能力(Decision Making)、行动能力(Action)、目标驱动(Goal Oriented)。它不是一个简单的模型,而是能在环境里自主运行的智能体。

(2)现代大模型时代的视角

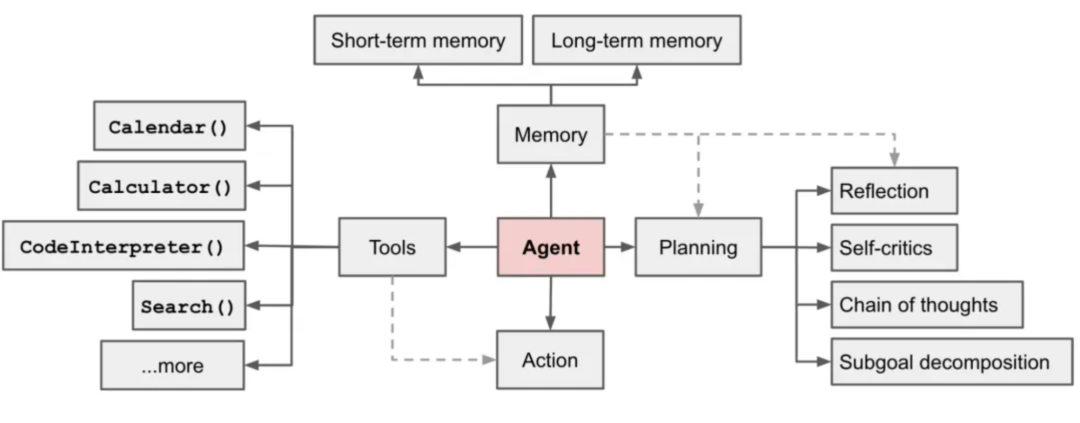

到了大模型的时代,AI Agent通常包含这几个部分:

大模型(LLM / 多模态模型),这是它的核心,负责推理、理解和生成内容;

记忆(Memory),用来存长期的知识、上下文以及和人交互的历史;

工具使用(Tool Use / Function Calling),就是能调用API、数据库、搜索引擎、代码执行器这些外部功能;

规划(Planning),能把复杂的任务拆成一步步能执行的步骤,还能反思调整、反复优化;

行动(Action),按照规划好的步骤调用工具、操作系统或应用,一直到完成目标为止。

(3)产品 / 工程视角

从产品和工程实际应用来看,AI Agent就是一个能一直运行、可以重复执行任务、还能自主完成工作的软件智能体。

比如:能自动写代码、运行代码、修复错误的AI Dev Agent;能自动处理客户咨询、流转工单的AI客服Agent;能自动分析业务数据、生成结论的AI分析Agent等等。

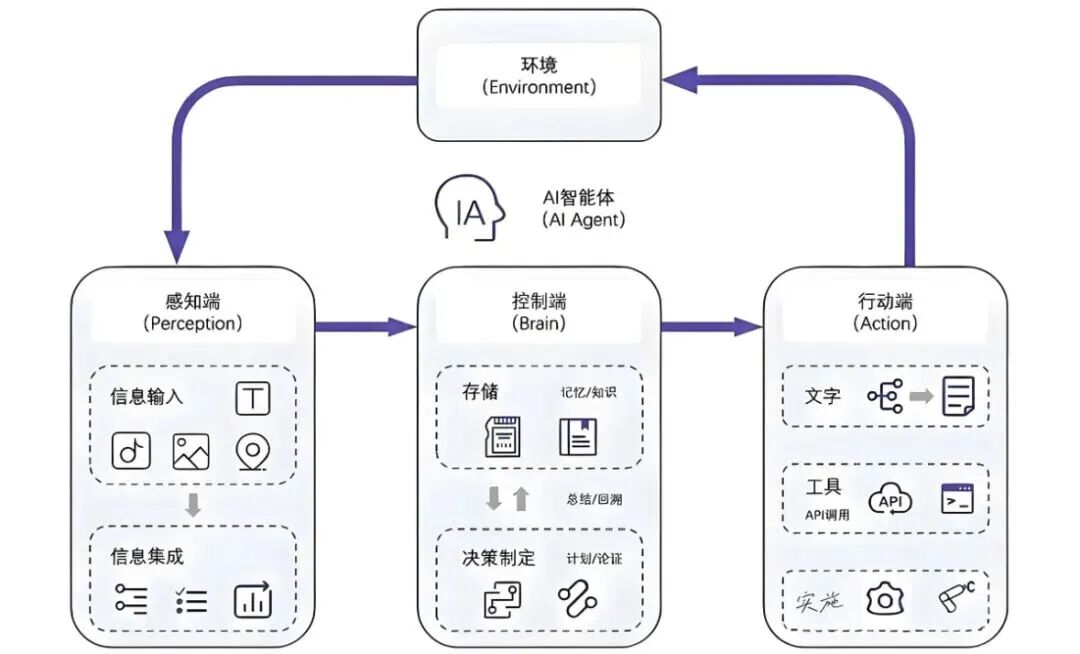

总结定义:广义来说,AI Agent是一种能在环境中自主感知、思考、规划并执行行动,从而达成特定目标的智能系统。

与大模型关系:Agent不一定非得有大模型,但现在主流的Agent,基本都以LLM或多模态模型为核心,再搭配上工具调用、记忆和规划机制,形成一套像人类执行任务那样的完整闭环能力。

更易落地的当下定义:现在我们说的AI Agent,其实就是基于大模型的自主智能系统,能感知环境、记住信息、做好规划、调用工具,还能执行行动,最终实现明确的目标。

3.2 智能体和大模型:从大脑到完整的身体

大语言模型(LLM),就相当于一个“超级厉害的大脑”,懂的知识多、推理能力也强,但它本身没有“手脚”,没法直接感知世界,也没法直接执行操作。

而智能体(Agent),就是在拥有“大脑”(也就是LLM)的基础上,再给它加上“手脚”(Tool)和“记忆”(Memory),这样它就能主动去感知、规划、行动,还能反思调整。

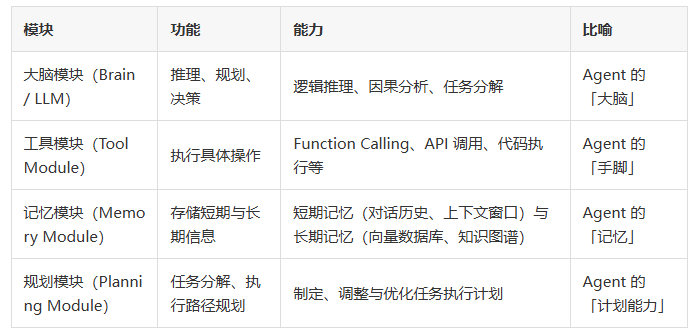

3.3 智能体的四大核心组件

最常见的一种拆解方式,是把智能体分成四个核心组件:

3.4 智能体的工作流程:感知 - 决策 - 行动 - 反思

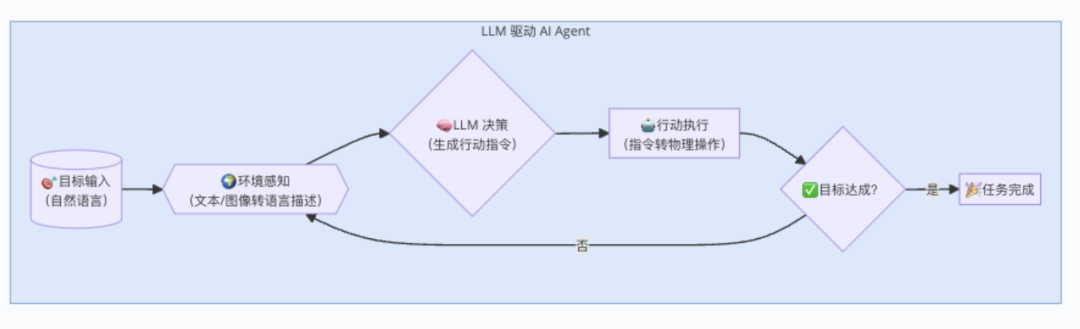

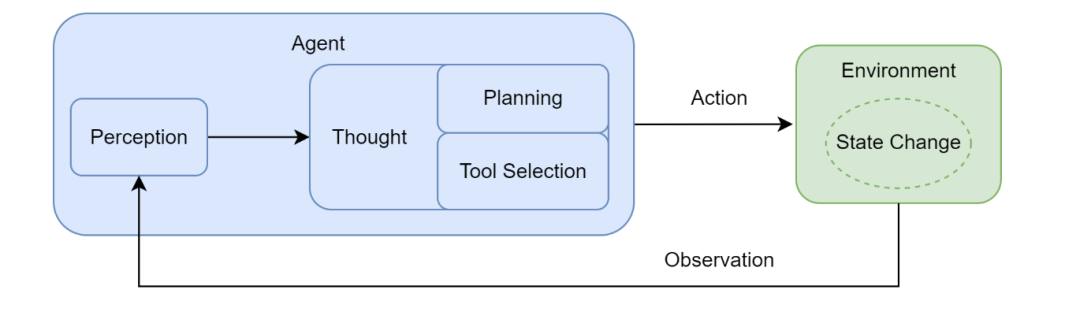

本文侧重的是基于大模型的智能体(LLM Agent),其典型流程包括:

智能体循环的关键步骤:

感知(Perception):借助传感器(比如 API 监听、用户输入接口)获取外界的输入信息,这些信息就是观察(Observation)。

思考(Thought):由大语言模型带动的内部推理环节,还能细分成两部分:

规划(Planning):结合当下的观察和过往记忆,更新对任务和环境的认知,制定或修改执行方案,把复杂目标拆分成一个个子任务。

工具选择(Tool Selection):在现有的工具库里挑选最适配的工具,并确定好调用的参数。

行动(Action):通过执行器(Actuators)完成具体操作,一般是调用某类工具(比如代码解释器、搜索 API 等),对环境产生作用。

观察与反思:依据行动的结果更新记忆和计划,开启下一轮循环。

从实际应用来看,Agent Loop 一般就是持续依据用户需求和环境的反馈,反复执行任务直到实现目标。

3.5 MCP 协议

MCP也就是Model Context Protocol,属于一种开放标准协议,主要用来把AI应用和外部的数据源、工具连接起来。

它会提供统一的接口,方便AI模型安全地访问文件系统、数据库、API等各类资源,同时支持本地和远程服务器,还具备工具调用和资源访问的能力,能够简化AI应用和外部系统集成开发的流程。

MCP是由Anthropic等公司共同推进的,目的就是为了标准化AI应用的上下文管理以及外部交互工作。

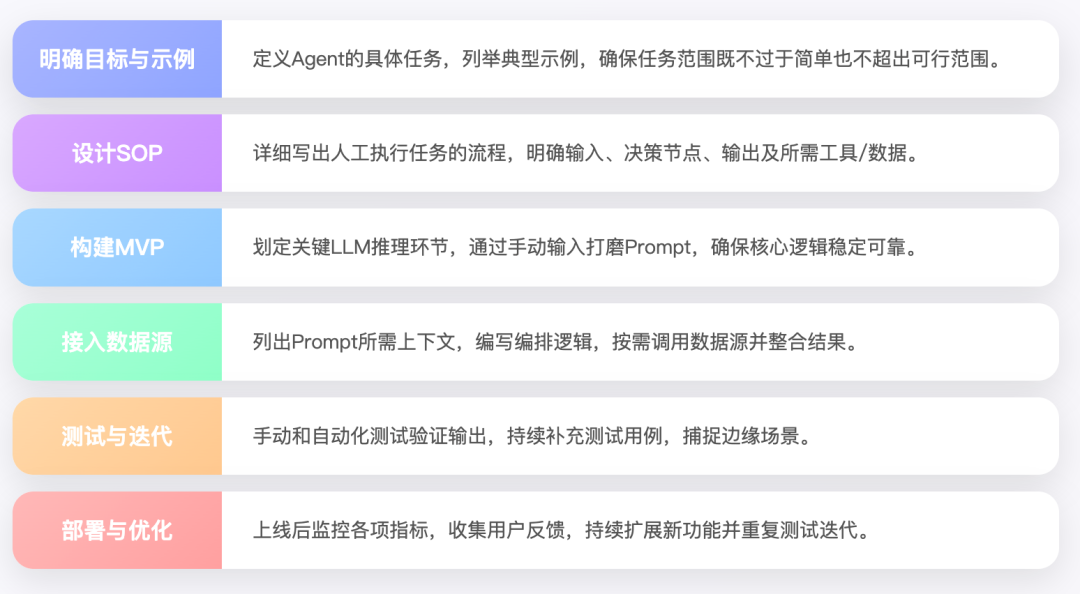

3.6 智能体设计的参考流程

设计一个 AI Agent 时,通常会经历以下步骤:

四、多智能体(Multi-Agent)技术:AI 协作的新范式

4.1 多智能体简介 为什么我们需要多智能体呢?

(1)单智能体的局限性:

能力比较单一,很难同时掌握多种专业技能;

遇到复杂任务时就吃力了,有些任务需要多步骤、多领域配合着完成;

效率不高,只能一步步串行执行,没法充分利用并行的资源;

扩展起来也麻烦,应对不了大规模的分布式场景。

(2)多智能体的优势:

能实现专业化分工,每个智能体都专注于自己擅长的领域;

可以并行处理任务,多个智能体一起干活,能加快整体任务的进度;

能把复杂的大任务拆解开,分成一个个子任务,分别去处理;

系统扩展性好,能根据需求随时增加或者替换智能体。

多智能体(Multi-Agent)模式,其实就是智能体系统从“一个人单打独斗”变成“一群人团队协作”的核心发展方向:

靠多个专业的智能体,再加上彼此的通信机制和协调策略,实现从“什么都想做的全能助手”到“各有所长的专家团队”的转变。

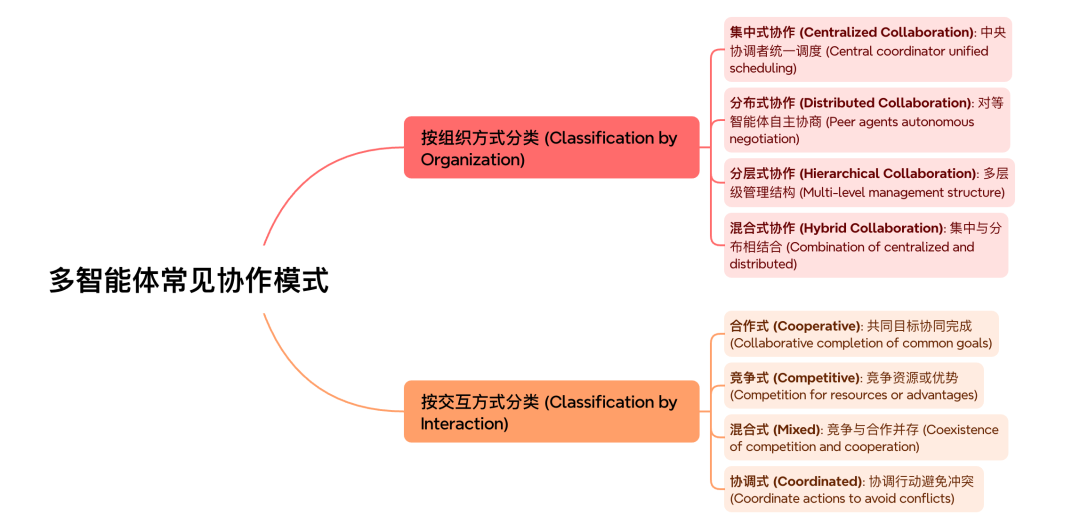

4.2 多智能体的协作模式

常见的多智能体协作模式有这几种:

主从模式:一个主Agent来调度多个子Agent,分配好各自的任务;

平行协作:多个Agent地位平等,一起协作,通过协调机制统一最终的结果;

黑板模式:所有Agent都通过一块共享的“黑板”来交换信息、同步进度;

组织/角色模式:按照“部门-角色”的方式来分配任务,就像公司里各部门各司其职一样。

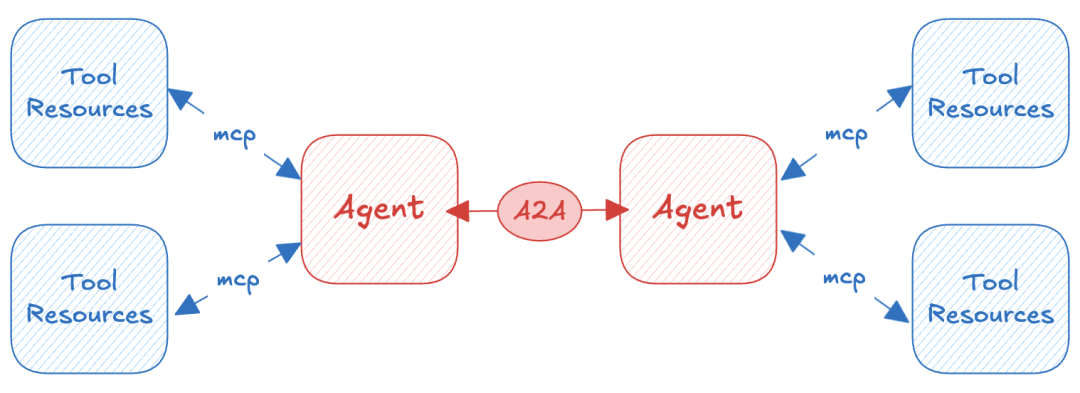

4.3 A2A 协议

A2A(Application to Application)协议是一种企业级集成协议,用于实现不同应用系统之间的直接通信和数据交换。

在 AI 与多智能体场景下,A2A 协议可用于:定义不同 AI 智能体之间的消息格式与交互规则;支持任务分配机制和协作流程;实现智能体之间的知识共享、能力互补与分布式问题求解

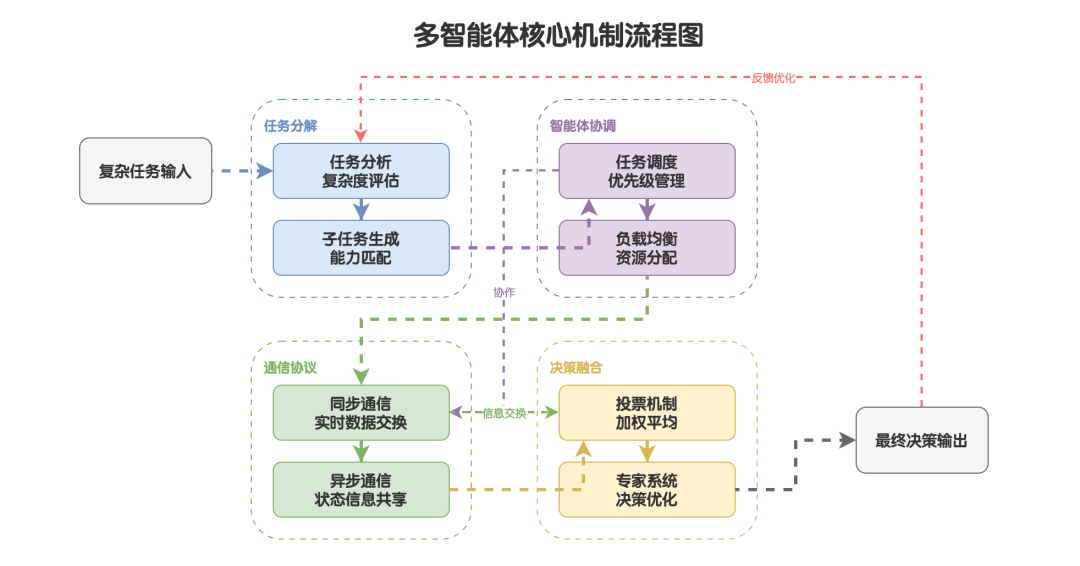

4.4 多智能体的核心机制

多智能体系统的核心机制主要有这几个方面:任务分解,就是把复杂的问题拆成多个子任务,再按照每个智能体的专业特长进行合理分配。

智能体协调,借助任务调度、优先级管理以及负载均衡等方式,防止出现资源争抢和重复工作的情况。

通信协议,搭建起统一规范的信息交流方式,既支持同步通信,也支持异步通信,确保数据和状态能够准确、及时地传输。

决策融合,把多个智能体得出的决策结果进行汇总,通过投票、加权平均或者专家系统等方法,得出最终的决策结果。

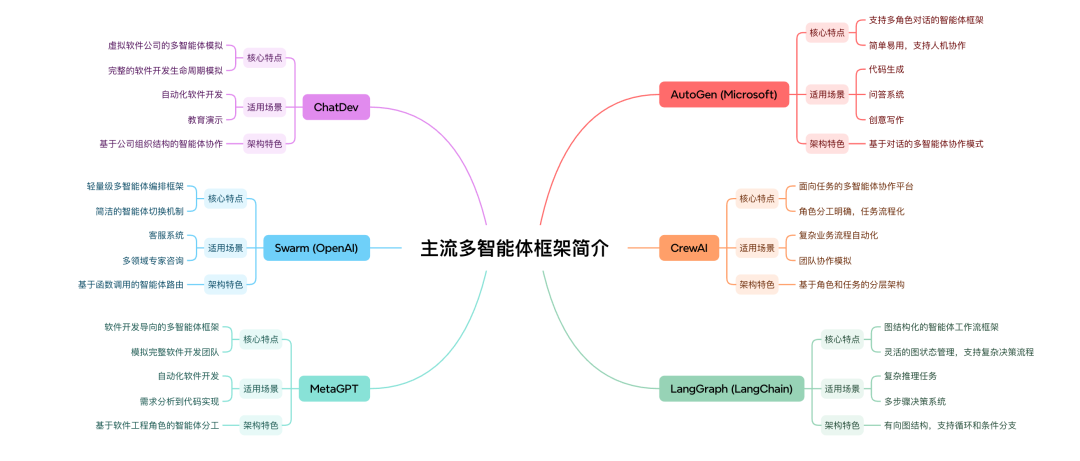

4.5 主流多智能体框架

多智能体框架是搭建复杂AI系统的关键基础,比较常见的框架有这些(举例):主要用于科研领域的多智能体仿真平台;和大模型相结合的多Agent协作框架;能够支持工具编排与工作流运行的Agent平台等等。

感谢阅读!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)