项目分享|微软VibeVoice,让机器真正“听懂”和“说出”长对话

项目分享|微软VibeVoice,让机器真正“听懂”和“说出”长对话

引言

在语音合成(TTS)领域,长篇幅、多说话者、低延迟的自然语音生成一直是行业难点,传统TTS模型往往受限于说话者数量、生成时长和实时性。微软开源的VibeVoice项目打破了这些限制,作为一款前沿的开源语音AI框架,它专注于生成富有表现力的长篇多说话者对话音频,为播客、智能对话等场景提供了全新的技术方案。本文将从项目介绍、创新优势、技术部署三个维度,全面解析这款开源TTS神器。

项目概览

VibeVoice是微软推出的开源前沿语音AI框架,基于MIT协议开源,目前在GitHub上收获17.4k stars、1.9k forks,由4位核心开发者维护,代码全程采用Python编写,具备极高的易用性和拓展性。

该项目核心定位是解决传统TTS在可扩展性、说话者一致性和自然对话轮替上的痛点,主打表现力、长篇幅、多说话者的对话音频生成,可广泛应用于播客制作、智能对话系统等场景。现阶段VibeVoice包含两大核心模型变体:一是长篇多说话者模型,支持合成长达90分钟的语音内容,同时兼容最多4位不同说话者,突破了传统模型1-2位说话者的限制;二是实时流式TTS模型,首段语音生成延迟仅约300ms,支持流式文本输入,专为低延迟实时语音生成设计。

项目在2025年完成了多次重要更新,12月3日开源VibeVoice-Realtime-0.5B实时TTS模型,支持流式输入和长篇生成;12月9日新增9种语言的实验性说话者,覆盖德、法、日、韩等主流语种,进一步拓展了多语言应用能力。需要注意的是,该项目目前定位为研究开发用途,暂不建议直接用于商业或实际生产场景。

核心创新与技术优势

VibeVoice能实现对传统TTS的突破,核心源于其独有的技术创新和架构设计,相比同类方案,具备多方面显著优势:

- 创新的连续语音分词器设计:采用声学和语义双维度的连续语音分词器,运行在7.5Hz的超低帧率下,既能高效保留音频的高保真度,又能大幅提升长序列音频的计算效率,为长篇幅语音生成奠定技术基础。

- 下一代令牌扩散框架:融合大语言模型(LLM)与扩散头,通过LLM深度理解文本上下文和对话流程,保证语音生成的语义连贯性和自然度;再由扩散头生成高保真的声学细节,实现“语义+声学”的双重高质量输出。

- 极致的长篇幅与多说话者支持:支持90分钟超长语音生成,同时兼容4位不同说话者,且能保证说话者音色、语气的一致性,解决了传统TTS多说话者场景下的音色混淆、断连问题。

- 低延迟实时生成能力:实时流式模型首段语音生成延迟低至300ms,支持流式文本输入,可满足实时语音交互的低延迟需求,为智能客服、实时对话机器人等场景提供可能。

- 多语言拓展与跨语言能力:在基础的英、中双语基础上,新增9种实验性语种支持,具备跨语言语音生成潜力,且提供跨语言demo示例,验证了模型的多语言适配性。

- 安全的语音定制机制:为降低深度伪造风险,语音提示采用嵌入式格式提供,同时为有定制需求的用户提供官方团队对接渠道,在技术创新的同时兼顾AI伦理与安全。

技术原理与部署实践

核心技术原理

VibeVoice的技术架构围绕**“文本理解-令牌生成-声学合成”** 三大核心环节展开:首先通过基于Qwen2.5 1.5b的大语言模型对输入文本进行上下文解析,识别对话角色、语义逻辑和情感倾向;接着通过7.5Hz超低帧率的声学/语义分词器,将文本转换为连续的语音令牌,实现长序列的高效处理;最后通过next-token扩散框架的扩散头,将语音令牌合成为高保真的声学信号,生成最终的语音音频。整个流程实现了从文本到语音的端到端优化,兼顾了语义连贯性、声学保真度和计算效率。

环境搭建与部署

VibeVoice推荐基于NVIDIA深度学习容器管理CUDA环境,保证环境的兼容性和稳定性,具体部署步骤如下:

- 启动NVIDIA PyTorch容器(验证过24.07/24.10/24.12版本,更高版本兼容)

sudo docker run --privileged --net=host --ipc=host --ulimit memlock=-1:-1 --ulimit stack=-1:-1 --gpus all --rm -it nvcr.io/nvidia/pytorch:24.07-py3

# 若容器无flash attention,手动安装

pip install flash-attn --no-build-isolation

- 克隆项目并安装依赖

git clone https://github.com/microsoft/VibeVoice.git

cd VibeVoice/

pip install -e .

# 安装ffmpeg用于demo演示

apt update && apt install ffmpeg -y

核心代码使用示例

VibeVoice提供了简洁的API调用方式,以实时流式模型VibeVoice-Realtime-0.5B为例,实现基础的文本转语音仅需几行代码:

from vibevoice import VibeVoiceRealtime

import soundfile as sf

# 加载预训练实时模型

model = VibeVoiceRealtime.from_pretrained("microsoft/VibeVoice-Realtime-0.5B")

# 输入待转换文本

text = "大家好,今天为大家分享微软开源的VibeVoice语音合成项目,它支持90分钟长篇多说话者语音生成!"

# 生成语音音频

audio = model.generate(text)

# 保存音频文件(采样率24000)

sf.write("vibevoice_output.wav", audio, 24000)

注意事项

- 模型目前仅对英、中双语做了深度优化,其他语种为实验性支持,可能出现非预期输出;

- 模型仅专注于语音合成,不支持背景噪音、音乐等非语音音频的生成;

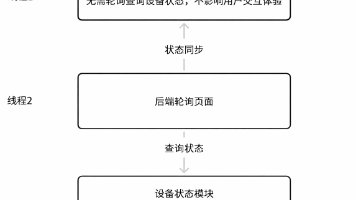

- 暂未实现对话中重叠语音的建模,生成的对话语音为轮替式输出;

- 运行模型需要NVIDIA显卡支持CUDA,建议使用高性能GPU以保证生成效率。

该项目及相关内容已在AladdinEdu课题广场同步发布,欢迎前往了解更多技术实现与资源!

项目地址:AladdinEdu课题广场

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)