云原生环境下的大数据建模新思路

云原生环境下的大数据建模新思路:从"固定拼图桌"到"魔法积木台"的进化

关键词:云原生、大数据建模、弹性计算、容器化、数据湖仓一体、Serverless、实时分析

摘要:传统大数据建模像在固定大小的拼图桌上拼巨型拼图——桌子太大浪费空间,太小又不够用。云原生技术的出现,为大数据建模打造了一张"会变形的魔法积木台":用容器化组件当"标准积木块",用Kubernetes当"智能搭积木助手",用弹性伸缩实现"桌子随拼图大小自动扩展"。本文将带你从生活场景出发,一步步拆解云原生如何重构大数据建模的底层逻辑,并用实战案例演示新范式的落地方法。

背景介绍

目的和范围

本文聚焦"云原生+大数据建模"的交叉领域,旨在解决3个核心问题:

- 传统大数据建模在资源管理、灵活性、实时性上的痛点是什么?

- 云原生技术(容器化、微服务、弹性伸缩等)如何针对性解决这些痛点?

- 如何在实际项目中落地云原生大数据建模的新范式?

预期读者

- 大数据工程师:想了解如何用云原生优化现有建模流程

- 数据分析师:关心建模效率与实时性提升

- 技术管理者:关注资源成本与团队协作模式变化

文档结构概述

本文将按照"问题引入→概念拆解→原理分析→实战落地→趋势展望"的逻辑展开,用"拼图游戏"贯穿全文类比,结合代码示例与真实场景,帮你建立云原生大数据建模的完整认知。

术语表

| 术语 | 通俗解释 |

|---|---|

| 云原生(Cloud Native) | 专为云计算设计的技术体系,核心是"用云的方式用云"(比如用容器代替虚拟机) |

| 容器化(Container) | 把软件及其依赖打包成"标准化盒子",保证"在我家能跑,在你家也能跑" |

| 弹性伸缩(Elasticity) | 资源像橡皮筋一样,需求大时自动"拉长"(扩容),需求小时自动"缩短"(缩容) |

| 数据湖仓一体(LakeHouse) | 结合数据湖(存海量原始数据)和数据仓库(存加工后数据)的混合架构 |

| Serverless | "不需要管服务器"的计算模式,用多少资源付多少钱,像用电一样按需取用 |

核心概念与联系:从"固定拼图桌"到"魔法积木台"

故事引入:小明的拼图烦恼

小明是学校拼图社社长,最近遇到了大麻烦:

- 社团有1000片的小拼图,也有100万片的巨型拼图

- 以前用固定木头桌子:拼小拼图时桌子空一大半(资源浪费),拼大拼图时桌子不够用(需要借桌子,耗时又麻烦)

- 拼图工具(尺子、胶水、放大镜)分散在不同抽屉,找工具总耽误时间(组件耦合)

- 社团活动时间不固定,有时候突然要拼紧急任务,现搬桌子根本来不及(实时性差)

直到社团来了新指导老师,带来了"魔法积木台套装":

- 积木块(容器):每块积木大小统一(标准化),能快速拼出不同大小的桌子

- 智能搭积木机器人(Kubernetes):能根据当前拼图大小,自动增减积木块(弹性伸缩)

- 工具百宝盒(微服务组件):每个工具单独放在透明盒子里(解耦),需要时直接拿出来用

- 魔法仓库(对象存储):所有拼图碎片(原始数据)和半成品(中间数据)都存在这里,随取随用

小明的拼图效率瞬间提升10倍!这就是云原生给大数据建模带来的改变。

核心概念解释(像给小学生讲故事)

核心概念一:云原生——为云计算而生的"魔法套装"

云原生不是某一个技术,而是一套"为云计算设计的方法论"。就像我们去露营不会带大铁锅,而是带轻便的折叠锅——云原生技术(容器、Kubernetes、微服务等)就是专门为"在云端灵活使用资源"设计的工具。

核心概念二:大数据建模——用数据拼出"未来地图"

大数据建模就像用数据碎片拼"未来地图"。比如电商公司要预测"双11"销量,需要收集用户浏览记录(碎片A)、历史购买数据(碎片B)、物流信息(碎片C)…然后用算法把这些碎片拼成一张"销量预测图"。

核心概念三:云原生大数据平台——会变形的"智能拼图台"

这是云原生技术与大数据平台的结合体。它就像小明的"魔法积木台":

- 用容器打包Hadoop/Spark/Flink等大数据组件(标准化积木块)

- 用Kubernetes管理这些容器(智能搭积木机器人)

- 结合对象存储(魔法仓库)和弹性计算(自动增减积木),实现"按需即用"

核心概念之间的关系(用拼图游戏类比)

| 概念关系 | 拼图场景类比 |

|---|---|

| 云原生支撑大数据建模 | 魔法积木台支撑各种拼图任务:小拼图用小桌子,大拼图用大桌子,紧急任务5分钟搭好桌子 |

| 大数据建模依赖云原生平台 | 复杂拼图需要智能拼图台:传统桌子无法处理百万片拼图,魔法台能轻松扩展 |

| 两者共同目标:高效用数据 | 最终都是为了更快、更省、更准地拼出"未来地图" |

核心原理的文本示意图

云原生技术栈(容器+K8s+服务网格)

│

▼

云原生大数据平台(弹性计算+分布式存储+微服务组件)

│

▼

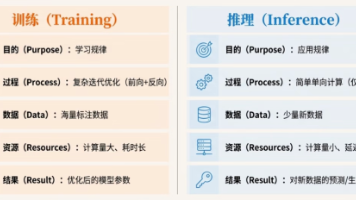

大数据建模流程(数据采集→清洗→特征工程→模型训练→推理)

│

▼

业务价值(精准营销/实时风控/智能决策)

Mermaid 流程图:传统VS云原生建模流程对比

核心算法原理 & 具体操作步骤:云原生如何"改造"建模流程

传统建模的3大痛点

- 资源浪费:任务高峰时资源不足,低谷时资源闲置(就像拼图桌白天挤成一团,晚上空着落灰)

- 灵活性差:调整集群配置需要人工干预(像手动搬桌子,每次调整要1小时)

- 实时性弱:无法快速响应突发需求(比如临时要分析"爆款商品"数据,传统集群启动要4小时)

云原生的3个"解题思路"

思路1:容器化——把大数据组件装进"标准化盒子"

- 原理:用Docker将Hadoop/Spark/Flink等组件及其依赖打包成容器镜像(就像把拼图工具和材料装进统一大小的盒子)

- 好处:“一次打包,到处运行”,避免"在我电脑能跑,在你电脑报错"的环境问题

Dockerfile示例(打包Spark):

# 基础镜像使用官方Spark镜像

FROM apache/spark:3.5.0

# 安装常用依赖(比如Python3)

RUN apt-get update && apt-get install -y python3

# 复制自定义配置文件到容器

COPY spark-defaults.conf /opt/spark/conf/

# 暴露Spark UI端口

EXPOSE 8080

思路2:Kubernetes调度——用"智能机器人"管理盒子

- 原理:Kubernetes(简称K8s)是容器编排工具,能自动管理容器的创建、销毁、扩缩容(就像智能搭积木机器人,根据当前拼图大小自动增减积木块)

- 关键功能:

- 弹性伸缩(HPA):根据CPU/内存使用率或任务队列长度,自动调整容器数量

- 服务发现:容器之间能自动找到彼此(就像拼图工具盒上贴了定位标签,需要时1秒找到)

K8s部署Spark任务的YAML示例:

apiVersion: batch/v1

kind: Job

metadata:

name: spark-data-modeling

spec:

parallelism: 5 # 同时运行5个任务实例

template:

spec:

containers:

- name: spark-container

image: my-spark-image:v1 # 前面打包的Docker镜像

command: ["spark-submit", "--class", "com.example.ModelingJob", "modeling.jar"]

restartPolicy: Never

backoffLimit: 4 # 失败重试4次

思路3:Serverless计算——“用多少资源,付多少钱”

- 原理:Serverless(无服务器)模式下,用户只需要提交任务代码,不需要管理服务器(就像用公共拼图台,按使用时间付费,不用自己买桌子)

- 典型产品:AWS Glue、阿里云函数计算(FC)结合MaxCompute

- 优势:成本降低70%+(闲置资源不收费),启动时间从分钟级到秒级

数学模型和公式:云原生如何优化资源利用率

资源调度的优化模型

假设我们有一个大数据任务,需要处理N条数据,每条数据处理时间为t,集群有m个节点,每个节点的处理能力为c(条/秒)。传统集群的资源利用率U_traditional为:

Utraditional=N×tm×c×T U_{traditional} = \frac{N \times t}{m \times c \times T} Utraditional=m×c×TN×t

(T为任务总时间,包含资源申请+启动+运行时间)

云原生集群通过弹性伸缩,在任务高峰时扩容到m’个节点,低谷时缩容到m’'个节点,资源利用率U_cloud_native为:

Ucloud_native=N×t∑i=1k(mi×c×ti) U_{cloud\_native} = \frac{N \times t}{\sum_{i=1}^{k} (m_i \times c \times t_i)} Ucloud_native=∑i=1k(mi×c×ti)N×t

(k为时间分片数,m_i为第i时间段的节点数,t_i为第i时间段的时长)

举例:

-

传统集群:固定m=10节点,任务运行2小时(含30分钟启动时间),处理100万条数据,每条处理0.1秒

Utraditional=1000000×0.110×(1000000/10/3600)×120×60≈35% U_{traditional} = \frac{1000000 \times 0.1}{10 \times (1000000/10/3600) \times 120 \times 60} \approx 35\% Utraditional=10×(1000000/10/3600)×120×601000000×0.1≈35% -

云原生集群:任务启动秒级(t_i=0),高峰时m’=20节点运行30分钟,低谷时m’'=5节点运行30分钟

Ucloud_native=1000000×0.1(20×1000000/20/3600×30×60)+(5×1000000/5/3600×30×60)≈85% U_{cloud\_native} = \frac{1000000 \times 0.1}{(20 \times 1000000/20/3600 \times 30 \times 60) + (5 \times 1000000/5/3600 \times 30 \times 60)} \approx 85\% Ucloud_native=(20×1000000/20/3600×30×60)+(5×1000000/5/3600×30×60)1000000×0.1≈85%

项目实战:用云原生重构用户行为建模系统

开发环境搭建(以阿里云为例)

-

准备云资源:

- 购买ACK(阿里云容器服务Kubernetes版)

- 创建OSS(对象存储)用于存储原始数据和中间结果

- 开通Serverless Flink服务(用于实时计算)

-

安装工具链:

- 本地安装kubectl(K8s命令行工具)

- 安装Docker(用于打包自定义容器镜像)

- 配置阿里云CLI(用于上传镜像到容器镜像服务ACR)

源代码详细实现(用户行为实时建模)

我们要实现一个"用户30天行为偏好模型",实时分析用户最近30天的点击、加购、下单数据,输出用户偏好标签(如"数码爱好者"“生鲜高频用户”)。

步骤1:数据采集(用Flume+Kafka)

- 用Flume将APP端日志采集到Kafka消息队列(就像用管道把拼图碎片传到传送带上)

- Kafka Topic配置:

# server.properties num.partitions=6 # 6个分区,支持高并发 retention.ms=168*3600*1000 # 保留7天数据

步骤2:实时清洗(Serverless Flink)

用Flink SQL过滤无效数据(如机器人点击),并关联用户基本信息(性别、年龄)。

Flink SQL示例:

-- 创建Kafka数据源表

CREATE TABLE user_behavior (

user_id BIGINT,

event_type STRING, -- click/add_to_cart/order

item_id BIGINT,

event_time TIMESTAMP(3),

WATERMARK FOR event_time AS event_time - INTERVAL '5' SECOND

) WITH (

'connector' = 'kafka',

'topic' = 'user_behavior_topic',

'properties.bootstrap.servers' = 'kafka-1:9092,kafka-2:9092',

'format' = 'json'

);

-- 创建用户信息维表(存储在OSS)

CREATE TABLE user_profile (

user_id BIGINT,

gender STRING,

age INT

) WITH (

'connector' = 'oss',

'path' = 'oss://my-bucket/user_profile/',

'format' = 'parquet'

);

-- 实时关联清洗

INSERT INTO cleaned_behavior

SELECT

ub.user_id,

ub.event_type,

ub.item_id,

up.gender,

up.age,

ub.event_time

FROM user_behavior AS ub

LEFT JOIN user_profile FOR SYSTEM_TIME AS OF ub.event_time AS up

ON ub.user_id = up.user_id;

步骤3:特征工程(Spark on K8s)

用Spark计算用户30天内各品类的点击次数、加购率等特征。

Spark任务提交命令(K8s模式):

spark-submit \

--master k8s://https://kubernetes-api-server:6443 \

--deploy-mode cluster \

--name feature-engineering \

--class com.example.FeatureJob \

--conf spark.kubernetes.container.image=my-spark-image:v1 \

--conf spark.kubernetes.authenticate.driver.serviceAccountName=spark-sa \

--conf spark.executor.instances=10 \ # 初始10个Executor

--conf spark.dynamicAllocation.enabled=true \ # 开启动态分配

--conf spark.dynamicAllocation.minExecutors=2 \

--conf spark.dynamicAllocation.maxExecutors=50 \ # 最大50个Executor(弹性伸缩)

local:///opt/spark/jars/feature-engineering.jar

步骤4:模型训练(MLflow on K8s)

用MLflow管理机器学习模型,支持自动调参和版本控制。

MLflow训练脚本片段:

import mlflow

from sklearn.ensemble import RandomForestClassifier

# 从OSS读取特征数据

features = pd.read_parquet("oss://my-bucket/features/")

# 启动MLflow实验

with mlflow.start_run():

# 记录参数

mlflow.log_param("n_estimators", 100)

mlflow.log_param("max_depth", 6)

# 训练模型

model = RandomForestClassifier(n_estimators=100, max_depth=6)

model.fit(features.drop("label", axis=1), features["label"])

# 保存模型到OSS

mlflow.sklearn.log_model(model, "user_preference_model")

代码解读与分析

- 弹性伸缩:Spark的

dynamicAllocation配置让Executor数量随任务负载自动增减(比如数据量突然增大时,从10个扩到50个) - 成本优化:Serverless Flink按实际使用的CU(计算单元)付费,任务空闲时不收费

- 可维护性:所有组件容器化后,升级Flink版本只需更新镜像标签(从

flink:1.15到flink:1.18),无需重启集群

实际应用场景

场景1:电商实时用户分群

- 需求:双11期间,实时识别"高价值用户"(近1小时加购3件以上且浏览时长>10分钟),推送专属优惠券

- 云原生优势:

- 弹性伸缩:0点下单高峰时,Flink任务自动从5个并行度扩到50个

- 实时性:数据处理延迟从传统的5分钟降到3秒

- 成本:非高峰时段资源自动缩容,双11当天成本仅为传统集群的1/3

场景2:金融实时风控

- 需求:检测异常交易(如用户5分钟内异地登录+大额转账)

- 云原生优势:

- 容器化:风控规则更新时,只需替换容器镜像(秒级生效),传统集群需要重启服务(30分钟)

- 分布式存储:OSS支持PB级日志存储,传统HDFS扩容需要人工添加节点(耗时几小时)

工具和资源推荐

| 类别 | 工具/资源 | 推荐理由 |

|---|---|---|

| 容器化 | Docker | 标准化容器打包工具,大数据组件容器化的基石 |

| 编排调度 | Kubernetes | 容器编排事实标准,支持弹性伸缩、服务发现、自动修复 |

| 大数据计算 | Flink on K8s/Spark on K8s | 云原生版计算引擎,支持动态资源分配 |

| 存储 | AWS S3/阿里云OSS/MinIO | 对象存储支持无限扩展,与云原生计算无缝集成 |

| 模型管理 | MLflow/Kubeflow | 云原生机器学习平台,支持模型训练、部署、监控全流程 |

| 监控运维 | Prometheus+Grafana | 云原生监控套件,可实时监控容器、任务、资源的运行状态 |

| 学习资源 | 《云原生大数据实践》(机械工业出版社) | 结合理论与实战的云原生大数据指南 |

未来发展趋势与挑战

趋势1:Serverless大数据成为主流

Gartner预测,2025年70%的大数据任务将运行在Serverless模式下。用户只需关注业务逻辑,无需管理服务器,真正实现"代码即服务"。

趋势2:AI与云原生深度融合

- 智能调度:用强化学习优化K8s的资源调度策略(比如预测任务负载,提前扩容)

- 自动建模:云原生平台内置AutoML工具,自动完成特征工程、模型选择(就像"傻瓜式拼图助手")

挑战1:多租户资源隔离

企业内部多个团队共享云原生平台时,需要解决"资源抢占"问题(比如A团队的任务不能挤爆B团队的资源)。可能的解决方案:K8s的Namespace+资源配额+QoS分级。

挑战2:数据安全与合规

容器化带来的"数据流动加速"可能增加泄露风险。需要结合云原生安全工具(如SPIFFE/SPIRE身份认证)和加密存储(如AWS KMS)。

总结:学到了什么?

核心概念回顾

- 云原生:为云计算设计的技术体系(容器+K8s+Serverless)

- 大数据建模:用数据拼"未来地图"的过程(采集→清洗→特征→模型)

- 云原生大数据平台:会变形的"智能拼图台"(弹性、解耦、按需)

概念关系回顾

云原生就像"拼图台的魔法套装",为大数据建模解决了3大问题:

- 资源:从"固定桌子"到"弹性积木台"(利用率提升)

- 效率:从"手动搬桌子"到"机器人自动搭台"(启动时间缩短)

- 成本:从"买整张桌子"到"按使用时间付费"(成本降低)

思考题:动动小脑筋

- 如果你是某电商的数据工程师,现有建模流程用的是传统Hadoop集群,你会优先用云原生改造哪个环节(数据采集/清洗/特征工程/模型训练)?为什么?

- Serverless模式下,大数据任务的成本是"用多少付多少",但可能出现"任务跑崩导致成本爆炸"的情况。你有什么方法避免这种风险?

- 云原生强调"容器化",但有些老旧的大数据组件(比如2010年的Hadoop 2.x)很难容器化。你会如何解决这个问题?

附录:常见问题与解答

Q1:云原生大数据平台是不是必须用Kubernetes?

A:Kubernetes是云原生的事实标准,但不是唯一选择。比如AWS有EKS(托管K8s),阿里云有ACK,也可以用AWS EMR Serverless(无需管理集群)等专有服务。

Q2:容器化会增加性能开销吗?

A:Docker容器的性能开销通常小于5%(对比虚拟机),因为容器共享宿主机内核,没有额外的虚拟化层。对于大数据这种CPU密集型任务,影响可以忽略。

Q3:传统集群迁移到云原生需要多长时间?

A:取决于现有系统的复杂度。简单任务(如Spark批处理)可以在1周内完成容器化;复杂系统(如包含自定义Hadoop插件)可能需要1-3个月。建议采用"先试点后推广"策略(比如先迁移非核心任务)。

扩展阅读 & 参考资料

- 《云原生技术实践白皮书》(中国信息通信研究院)

- Kubernetes官方文档:https://kubernetes.io/

- Apache Flink云原生部署指南:https://nightlies.apache.org/flink/flink-docs-release-1.18/docs/deployment/resource-providers/kubernetes/

- Serverless大数据最佳实践:https://aws.amazon.com/cn/big-data/serverless/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)