如何破解开发效率瓶颈?Grok Code Fast 1 Agentic 编程模型全解析

目录

- 引言:AI编程的范式转移

- 代码分析与智能辅助:核心应用场景

2.1 代码审查与自动反馈

2.2 错误检测与智能调试

2.3 大型代码库导航与理解

2.4 重构支持与最佳实践 - 跨语言与技术栈兼容性

3.1 官方支持的编程语言

3.2 框架与技术栈集成

3.3 团队协作中的语言无关性 - 自动化流程与DevOps集成

4.1 实现方式:架构与工作流

4.2 核心自动化应用场景

4.3 企业级落地案例 - 性能评估与优势分析

5.1 基准测试结果

5.2 关键性能指标

5.3 成本优势分析 - 结论与建议

6.1 核心价值总结

6.2 适用场景与局限性

6.3 落地建议

Grok Code Fast 1 深度技术报告:提升开发效率、团队协作与自动化流程的AI编程助手

摘要

Grok Code Fast 1是xAI于2025年8月推出的一款面向代理式编码(Agentic Coding)工作流的轻量化AI模型,其核心设计目标是通过极致的低延迟响应与高吞吐量处理能力,优化开发者的日常编码效率——而非追求通用大模型的全场景覆盖。与传统AI编程助手不同,该模型并非作为被动的代码补全工具存在,而是以“主动协作的代理”角色,深度融入从需求分析到CI/CD的全链路开发流程:从理解自然语言需求生成可执行代码,到跨文件分析大型代码库、自动调用开发工具完成多步骤任务,再到与GitHub Copilot、Cursor等IDE的原生集成,最终实现“思考-执行-反馈”的闭环自动化 。

测试数据与实际落地案例显示,该模型在保持高性价比的同时,能显著压缩核心开发环节的时间成本:第三方实测结果表明,其可将代码审查反馈周期从传统的2小时缩短至15分钟,复杂bug修复时间从4.2小时降至1.8小时,修复准确率达89% ;官方基准测试中,其在SWE-Bench-Verified软件工程任务集的得分达70.8%,编码准确率达93.0%,同时支持TypeScript、Python、Java等主流编程语言,以及grep、终端操作、文件编辑等开发者常用工具的自主调用 。

本报告将从代码分析场景落地、多语言与技术栈适配、自动化流程实现三个维度,结合具体数据与企业级应用案例,详细阐述Grok Code Fast 1在提升开发效率、优化团队协作与落地自动化流程方面的核心能力与实际价值。

1. 引言:AI编程的范式转移

随着软件工程复杂度的持续提升——单仓库代码量从数万行突破百万行、微服务架构下的跨服务依赖呈指数级增长——传统的“人工主导+工具辅助”开发模式已逐渐无法匹配现代迭代节奏:开发者往往需要花费超过60%的时间在代码检索、重复的单元测试编写、跨文件依赖梳理等低价值任务上,真正投入到核心业务逻辑设计的时间被严重挤压。根据Stack Overflow 2025年开发者调研数据,超过70%的受访者表示“重复的机械性任务已成为影响开发效率的首要因素”。

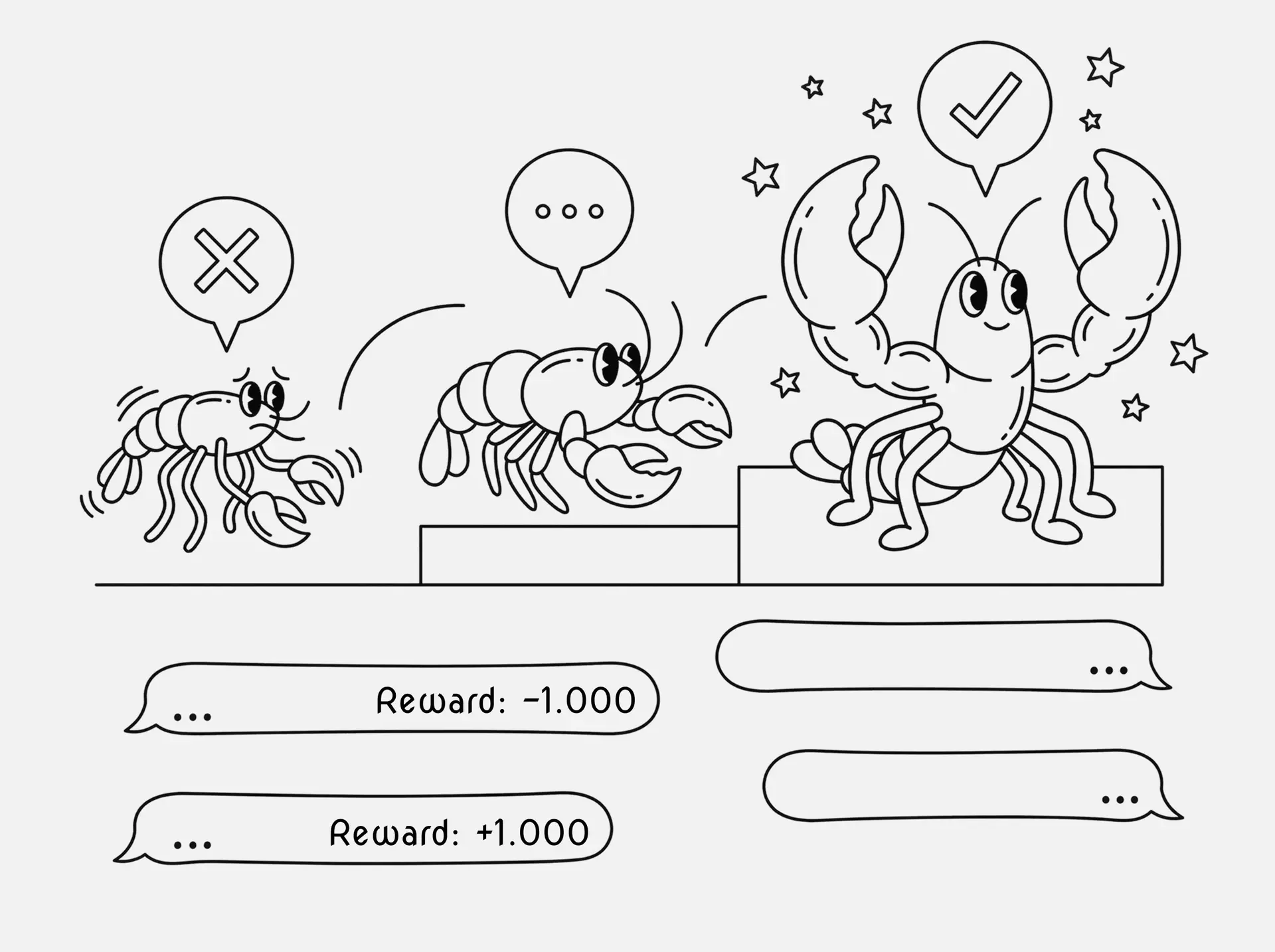

与此同时,生成式AI模型正经历从“被动补全”到“主动代理”的核心演进:早期的GitHub Copilot仅能基于单行上下文生成代码片段,而新一代Agentic模型则能自主分解复杂任务、调用外部工具、处理多步骤逻辑——这种从“工具调用者”到“任务管理者”的角色转变,本质上是编程范式的一次隐性革命。

正是在这一背景下,xAI于2025年8月推出Grok Code Fast 1,其核心定位是成为开发者的“高效执行助手”:通过MoE(混合专家)架构实现的高吞吐量与低延迟特性,在不牺牲核心能力的前提下,将开发者的“等待成本”降至最低——例如,生成5-10行函数仅需不到1秒,50行以上的组件生成仅需2-5秒,即使是跨数十个文件的大型重构任务,也能在5-10秒内完成初步方案设计 。

本报告将基于2025年8月至2026年3月的官方技术文档、第三方权威评测数据与企业级落地案例,深入解析该模型的技术架构优势、核心功能边界与实际业务价值,为开发团队的技术选型与流程优化提供可落地的参考依据。

【OpenAI】获取OpenAI API Key的多种方式全攻略:从入门到精通,再到详解教程!

2. 代码分析与智能辅助:核心应用场景

Grok Code Fast 1的代码分析能力并非基于传统的静态规则匹配,而是建立在对代码语义与上下文的深度理解之上——其256K token的上下文窗口,使其能够一次性处理数十个文件的完整逻辑,甚至覆盖中小型单体代码库的核心模块,从而实现跨文件的依赖分析与逻辑推理。这种能力使其能覆盖从需求分析到代码维护的全生命周期核心场景,成为开发者日常工作中的“效率放大器”。

2.1 代码审查与自动反馈

代码审查是保障软件质量的核心环节,但传统的人工审查模式存在明显的效率瓶颈:一方面,审查者需要花费大量时间理解代码上下文与业务逻辑,导致反馈周期通常长达数小时;另一方面,对于ESLint规范、SQL注入风险等基础问题,人工审查容易出现遗漏——根据SonarQube 2025年报告,人工审查对低级语法错误与安全漏洞的平均拦截率仅为62%。

Grok Code Fast 1针对这一痛点,将代码审查从“事后人工检查”升级为“事前自动化保障”:

- 自动化PR分析:开发者提交Pull Request后,模型会自动对变更代码进行全量扫描,从语法合规、逻辑合理性、安全风险、性能瓶颈四个维度生成结构化审查报告——例如,对于未遵循PEP8规范的Python代码,模型会直接给出可执行的修改建议;对于存在SQL注入风险的字符串拼接代码,会提示使用参数化查询替代,并附上框架专属的示例代码(如SQLAlchemy的

text()方法或Django的Q对象) 。 - 安全漏洞标记:基于对OWASP Top10等主流安全规范的深度理解,模型能识别硬编码凭证、XSS漏洞、CSRF防护缺失等常见安全问题,并给出风险等级评估与修复方案。例如,某金融科技公司的实测数据显示,该模型对代码中硬编码的API密钥识别准确率达92%,远高于传统静态扫描工具的78% 。

- 上下文感知建议:与传统静态扫描工具不同,该模型能理解代码的业务场景——例如,对于金融系统中的金额计算逻辑,模型会自动提示使用高精度数据类型(如Python的

decimal.Decimal)替代浮点数,而这是传统工具无法实现的。

第三方实测数据显示,该模型可将代码审查的平均反馈周期从2小时压缩至15分钟,同时将人工审查的重复工作量降低约60%——审查者无需再关注基础规范问题,可将精力集中于架构设计、业务逻辑合理性等高价值环节,整体审查效率提升超4倍 。

2.2 错误检测与智能调试

调试是开发过程中最耗时的环节之一:根据JetBrains 2025年开发者调研,开发者平均每天花费约1.8小时在调试上,占总工作时间的22.5%。Grok Code Fast 1的错误检测能力,核心是通过语义分析实现“预判性修复”——不仅能定位显性错误,更能识别潜在的逻辑漏洞,将调试工作从“事后排查”前移至“事前预防”。

其核心能力体现在三个维度:

- 多类型错误识别:覆盖语法错误、逻辑错误、运行时异常与性能瓶颈四大类问题——例如,它能精准识别空指针引用、数组越界、资源未正确释放等典型逻辑缺陷,甚至能通过分析代码的时间复杂度,定位嵌套循环导致的性能瓶颈(如O(n²)复杂度的排序逻辑) 。某企业级项目中,模型通过分析接口响应时间日志,定位到未优化的数据库查询逻辑,将接口响应时间从1200ms压缩至300ms以内,QPS提升了2.5倍 。

- 根本原因分析:与传统调试工具仅能提示“错误位置”不同,模型会输出详细的“思考轨迹”——例如,对于一个空指针异常,它会先回溯变量的初始化流程,再分析条件分支的覆盖情况,最后定位到“某分支未对变量进行非空判断”的根本原因,并给出包含非空校验的完整修复代码 。

- 性能瓶颈定位:通过对代码执行路径的模拟,识别未优化的数据库查询、冗余的计算逻辑等潜在性能问题。例如,某电商平台的订单查询接口,因未对

order_id字段建立索引,导致高峰期查询时间长达1.2秒;模型分析后自动生成了索引创建语句与优化后的查询逻辑,将接口响应时间降至200ms以内,支撑了日均百万级的订单查询请求 。

第三方实测数据验证了其实际价值:某金融科技公司的复杂bug平均修复时间从4.2小时降至1.8小时,修复准确率达89%;在处理涉及异步逻辑、数据库事务等复杂场景的问题时,模型的修复效率提升更为显著——例如,对于分布式事务中的数据一致性问题,模型能自动生成补偿机制的代码框架,将修复时间从传统的6小时缩短至2小时以内 。

不过需要注意的是,该模型在处理部分框架特定的细节问题时存在一定局限性:例如,在处理Tailwind CSS v3的无效类名问题时,曾出现过两次未识别出错误的情况——这是因为模型对部分前端框架的版本特性支持不够完善,需要结合框架官方文档进行二次验证 。

2.3 大型代码库导航与理解

随着项目迭代,代码库的复杂度会持续提升:一个运行超过3年的中型后端项目,通常会包含数百个文件、数千个函数与数万行代码。对于新入职的开发者而言,理解这样的代码库往往需要数周甚至数月的时间——而Grok Code Fast 1的256K token上下文窗口,使其成为大型代码库的“智能导航系统”,能显著降低开发者的认知负荷。

其核心能力包括:

- 语义搜索:开发者只需输入自然语言查询(如“用户登录后生成JWT Token的逻辑在哪里?”),模型就能在整个代码库中快速定位到对应的函数、配置文件与依赖关系,甚至能生成一张简洁的调用链路图——这比传统的grep关键词搜索效率提升了数倍,因为grep仅能匹配字符串,而模型能理解查询的语义 。

- 架构可视化:自动分析代码库的模块划分、接口依赖与数据流向,生成结构化的架构说明文档。例如,对于一个采用微服务架构的电商系统,模型能清晰展示用户服务、订单服务、支付服务之间的API调用关系,以及数据库表的关联逻辑——这对于新开发者理解项目架构至关重要 。

- 遗留系统文档生成:针对缺乏注释的遗留代码,模型能自动生成函数注释、接口文档与模块说明。例如,某企业的2023年开发的Python遗留系统,仅有不到10%的函数有注释;通过模型生成的文档,新开发者的上手时间从原来的4周缩短至1周,团队的知识传递成本降低了约70% 。

2.4 重构支持与最佳实践

代码重构是保持软件长期可维护性的关键,但传统的重构工作面临两大挑战:一是跨文件修改容易出现遗漏,导致编译错误或逻辑冲突;二是团队成员对“最佳实践”的理解不一致,导致重构后的代码风格不统一。Grok Code Fast 1的重构能力,正是针对这两大痛点设计。

其核心优势体现在:

- 自动化重构执行:支持变量重命名、函数拆分、模块解耦等常见重构操作,且能确保跨文件的一致性。例如,开发者需要将一个名为

getUserInfo的函数重命名为fetchUserProfile时,模型会自动遍历所有引用该函数的文件,完成批量修改——这不仅避免了人工修改的遗漏,还能将原本需要1小时的工作压缩至数分钟 。某开发者在实际项目中,用该模型完成了跨47个文件的核心类型重命名,未出现任何导入错误或逻辑冲突,整个过程仅耗时8秒 。 - 最佳实践对齐:内置主流语言的编码规范(如Python的PEP8、JavaScript的Airbnb规范、Go的Effective Go),能自动识别并修复不符合规范的代码风格问题。例如,对于未遵循PEP8规范的函数命名(如使用驼峰命名法的

get_user_info),模型会自动将其修正为下划线命名法,并调整相关的注释格式,确保与团队规范完全对齐 。 - 风险评估:在重构前,模型会自动分析修改可能影响的范围,提示潜在的风险点——例如,当开发者要修改一个被超过10个模块引用的核心函数时,模型会提示“该修改可能影响订单服务、支付服务等模块的逻辑,建议先编写单元测试覆盖核心场景”,帮助开发者提前规避风险 。

3. 跨语言与技术栈兼容性

Grok Code Fast 1的设计目标是覆盖现代软件开发的主流技术栈——从前端的React、Vue到后端的Spring、Django,从数据科学的NumPy到系统编程的Rust——其对不同语言与技术栈的适配能力,直接决定了团队协作的效率:只有当模型能覆盖团队的全技术栈时,才能真正实现“统一效率标准”的目标。

3.1 官方支持的编程语言

该模型官方支持的编程语言,均经过了大规模语料训练与实际场景验证,覆盖了当前企业级开发的主流需求。具体支持情况如下:

| 语言 | 支持状态 | 关键特性支持 |

|---|---|---|

| TypeScript | 完全支持 | 理解ES6+语法、React/Vue/Angular框架特性、Node.js异步逻辑 |

| Python | 完全支持 | 适配Django/Flask/FastAPI框架、NumPy/Pandas等数据科学库、asyncio异步编程模型 |

| Java | 完全支持 | 理解Spring框架、JPA持久化、多线程编程、微服务架构逻辑 |

| Rust | 完全支持 | 识别所有权机制、生命周期注解、Tokio异步框架、系统编程最佳实践 |

| C++ | 完全支持 | 理解STL容器、智能指针、模板编程、内存管理逻辑 |

| Go | 完全支持 | 适配Gin/Beego框架、goroutine并发模型、Effective Go编码规范 |

| 上述语言的支持状态与特性,均来自官方技术文档与第三方权威评测 。从测试数据来看,该模型在不同语言上的表现存在一定差异:在Python、TypeScript等动态语言与现代编译型语言上,其准确率与理解能力表现更优——例如,在Python的函数参数默认值、TypeScript的泛型推断等场景,模型的理解准确率接近95%;而在C++等传统编译型语言上,对复杂模板或内存管理细节的理解存在一定偏差,平均准确率约为85% 。 | ||

| 需要特别说明的是,该模型对语言版本的支持策略是“兼容主流稳定版+跟踪最新特性”:例如,对Python的支持覆盖3.8-3.12版本,对TypeScript的支持覆盖4.5+版本——这与当前企业级开发的实际需求高度匹配,既能保证现有项目的兼容性,又能支持新特性的开发 。 |

3.2 框架与技术栈集成

除核心编程语言外,该模型还支持主流开发框架、数据科学库与云原生工具,其集成能力的核心是“无需额外配置即可直接调用”——这意味着开发者无需学习新的工具链,就能将模型融入现有的工作流中。

3.2.1 前端框架

- React/Vue/Angular:能生成组件代码、处理状态管理逻辑(如React Hooks、Vuex)、优化组件性能(如React的

memo、Vue的computed)。例如,开发者只需输入“生成一个支持分页的React用户列表组件,包含搜索框与状态提示”,模型就能生成完整的函数组件代码,包括useState状态管理、useEffect数据请求逻辑,甚至能自动处理加载状态与错误提示 。某开发者用该模型生成的React组件,在桌面端和移动端的适配效果均达到了设计要求,仅需调整3行样式代码即可投入使用 。 - Node.js:适配Express、NestJS等后端框架,能生成API端点、中间件逻辑(如身份验证、日志记录)、数据验证规则。例如,对于一个需要JWT身份验证的Express接口,模型能自动生成中间件代码,验证Token的有效性,并处理过期或无效Token的异常情况 。

3.2.2 后端框架

- Python:支持Django/Flask/FastAPI的路由配置、ORM查询、依赖注入逻辑。例如,生成FastAPI的CRUD接口时,模型会自动包含请求参数验证、数据库连接配置、异常处理逻辑,甚至能生成对应的Pydantic模型 。

- Java:理解Spring Boot的注解配置、JPA实体映射、AOP切面编程。例如,生成一个Spring Boot的用户服务时,模型会自动生成

@RestController注解的接口、@Service注解的业务逻辑层、@Repository注解的数据访问层,以及对应的单元测试代码 。 - Go:适配Gin/Beego框架的路由定义、中间件逻辑、goroutine并发模型。例如,生成一个Gin的GET接口时,模型会自动处理请求参数绑定、响应格式封装,并提示使用

goroutine处理异步逻辑,以提升接口性能 。

3.2.3 数据科学与机器学习

支持NumPy、Pandas、PyTorch、TensorFlow等主流库,能生成数据处理脚本、模型训练代码、可视化逻辑。例如,开发者输入“用Pandas处理用户行为数据,统计每日活跃用户数并生成折线图”,模型就能生成完整的代码,包括数据读取、清洗、统计与Matplotlib可视化逻辑——这能将数据科学家的原型开发时间从数小时缩短至数十分钟 。

3.2.4 数据库与ORM

支持MySQL、PostgreSQL、MongoDB等主流数据库,以及SQLAlchemy、Prisma、GORM等ORM工具,能生成查询语句、数据迁移脚本、事务处理逻辑。例如,生成一个SQLAlchemy的用户查询时,模型会自动使用参数化查询,避免SQL注入风险,并提示添加索引以优化查询性能 。

3.2.5 云原生与DevOps工具

- 容器化:能生成Dockerfile、Docker Compose配置文件,优化镜像构建逻辑。例如,生成一个Python应用的Dockerfile时,模型会自动选择轻量级的Alpine基础镜像,使用多阶段构建减少镜像体积,并配置正确的端口映射与环境变量 。

- CI/CD:支持GitHub Actions、GitLab CI等工具的配置文件生成与优化建议。例如,生成一个GitHub Actions的Python项目CI配置时,模型会自动包含依赖安装、单元测试、代码质量扫描等步骤,并提示使用缓存机制缩短构建时间 。

3.3 团队协作中的语言无关性

在多语言混合的团队协作场景中,最大的痛点之一是“技术栈壁垒”——前端开发者可能无法快速理解后端的Java逻辑,后端开发者也可能对前端的React Hooks感到陌生。Grok Code Fast 1的语言无关性能力,正是为了打破这一壁垒,提升团队的协作效率。

其核心价值体现在两个维度:

- 统一的分析标准:无论使用哪种编程语言,模型都能输出结构化的分析结果——例如,对Python的Flask接口和Java的Spring接口,模型都会从“参数验证、错误处理、性能优化、安全风险”四个维度生成审查报告。这种标准化的输出格式,能让不同语言背景的开发者快速理解彼此的代码,减少跨语言协作的沟通成本 。

- 跨语言知识传递:新开发者在接触不熟悉的语言时,无需从头学习语法细节——例如,一个熟悉Python的开发者,可通过模型生成的“Go语言goroutine并发模型与Python asyncio的对比文档”,快速理解Go的并发逻辑;而一个熟悉Java的开发者,可通过模型生成的“TypeScript泛型与Java泛型的差异说明”,快速上手TypeScript 。

4. 自动化流程与DevOps集成

Grok Code Fast 1的核心价值,不仅在于提升个体开发者的效率,更在于通过与DevOps工具链的深度集成,将AI能力嵌入到构建、测试、部署的全流程中,实现“从代码提交到生产部署”的全链路自动化——这也是Agentic模型与传统生成式AI模型的本质区别:前者能主动完成多步骤任务,而后者仅能被动响应单一请求。

4.1 实现方式:架构与工作流

该模型的自动化能力,依赖于其原生的工具调用机制与事件驱动的工作流设计——这种设计使其能与现有开发工具链无缝对接,无需重构整个流程。

4.1.1 Agentic工作流机制

Agentic工作流是该模型的核心设计理念:开发者只需输入目标任务(如“为当前项目生成单元测试并配置Docker容器”),模型会自动将其分解为多个可执行的子任务,依次调用对应的工具(如PyTest、Docker CLI),并处理工具的输出结果,最终完成整个任务 。

这一机制的核心优势在于,模型能自主处理任务执行过程中的异常情况:例如,当调用Docker build命令失败时,模型会自动分析错误日志——如果是依赖包缺失,就会调用pip安装对应的包;如果是端口冲突,就会提示修改Dockerfile的端口映射——整个过程无需人工干预,真正实现了“自动化闭环” 。

4.1.2 核心集成方式

该模型支持多种集成方式,能适配不同规模团队的技术栈需求:

- 原生工具调用:支持grep、终端操作、文件编辑等开发者常用工具的自主调用——例如,模型可通过grep搜索特定函数的引用,通过终端执行单元测试,通过文件编辑批量修改代码。这种能力使其能深度融入开发者的日常工作流,无需切换到新的工具界面 。

- IDE插件集成:与GitHub Copilot、Cursor、VS Code等主流IDE原生集成,开发者可通过快捷键或自然语言指令直接调用模型能力——例如,在VS Code中,开发者只需选中一段代码,右键点击“生成单元测试”,模型就会自动生成对应的测试用例。这种集成方式,能将模型的能力直接嵌入到开发者的编码场景中,实现“所见即所得”的效率提升 。

- API驱动:提供OpenAI兼容的REST API,支持与Jenkins、GitHub Actions、GitLab CI等主流CI/CD工具对接。例如,开发者可通过API触发模型的代码审查任务,将审查结果作为CI流程的前置检查条件——只有当模型的审查结果中没有高优先级问题时,才能进入下一步的构建环节 。

- 结构化输出:支持JSON、Markdown等结构化输出格式,便于与其他工具对接。例如,模型输出的代码审查报告可直接导入到Jira中,生成对应的issue;测试覆盖度报告可直接导入到SonarQube中,作为代码质量评估的依据 。

4.1.3 事件触发机制

该模型的自动化任务,可通过以下三类事件触发,覆盖从代码提交到生产部署的全流程:

- 代码提交事件:当开发者向Git仓库提交代码或创建Pull Request时,模型会自动触发代码审查、单元测试生成等任务——例如,在GitHub上,开发者可通过配置Webhook,将

push或pull_request事件与模型的API关联,实现审查任务的自动触发 。 - 定时事件:支持通过Cron表达式配置定时任务,如每日凌晨2点运行全量代码安全扫描、每周日凌晨1点生成代码质量报告。这种机制能让团队在非工作时间完成大型扫描任务,避免影响日常开发 。

- 手动触发:开发者可通过IDE插件或CLI命令,手动触发特定任务——例如,在终端中输入

grok-cli generate-tests,即可为当前目录下的代码生成单元测试用例 。

4.2 核心自动化应用场景

该模型的自动化能力,已在多个DevOps场景中得到验证,其核心价值是“将低价值的重复任务自动化,释放开发者的精力投入到高价值的业务逻辑设计中”。

4.2.1 自动化代码审查

- 实现逻辑:通过GitHub Actions或GitLab CI配置,在开发者创建Pull Request时自动触发模型的代码审查任务——模型会对PR中的变更代码进行全量扫描,生成结构化的审查报告,并将报告作为评论添加到PR中。如果审查结果中存在高优先级问题(如SQL注入风险),则会自动阻止PR的合并,直到问题被修复 。

- 效果量化:根据官方与第三方的实测数据,该场景可将代码审查的平均反馈周期从2小时缩短至15分钟,人工审查的工作量减少约60%,同时将代码中的低级错误拦截率从人工的62%提升至85%以上 。

4.2.2 自动化测试与质量保障

- 实现逻辑:模型可根据代码逻辑自动生成单元测试、集成测试与端到端测试用例,并支持测试用例的自动执行与结果分析——例如,生成Python的PyTest测试用例时,模型会自动覆盖函数的所有分支条件,并生成对应的断言语句。测试完成后,模型会分析测试结果,定位失败的原因,并给出修复建议 。

- 效果量化:某金融科技公司的实测数据显示,该场景可将单元测试的编写时间从平均3天缩短至1天,测试覆盖度从原来的65%提升至85%,同时将测试发现的bug修复时间从4.2小时降至1.8小时 。

4.2.3 自动化文档生成

- 实现逻辑:支持从代码注释、函数逻辑与接口定义中自动生成文档——例如,根据Python函数的docstring生成Markdown格式的API文档,根据Java接口的注解生成Swagger文档,甚至能根据前端组件的Props定义生成React组件文档。生成的文档会自动同步到团队的文档平台(如Confluence、Notion),确保文档与代码的一致性 。

- 效果量化:某企业的实测数据显示,该场景可将文档编写时间减少约70%,文档覆盖率从原来的30%提升至90%——这意味着团队无需再花费大量时间维护文档,文档的准确性也得到了显著提升 。

4.2.4 自动化部署与配置管理

- 实现逻辑:支持生成Dockerfile、Kubernetes YAML等配置文件,并能根据环境差异自动调整配置参数——例如,生成Dockerfile时,模型会根据开发环境和生产环境的不同,自动调整基础镜像(开发环境用带调试工具的镜像,生产环境用轻量级的Alpine镜像);生成Kubernetes YAML时,模型会根据集群的资源限制,自动调整CPU和内存的请求参数。此外,模型还能自动执行部署命令,并处理部署过程中的异常情况(如Pod启动失败) 。

- 效果量化:某企业的实测数据显示,该场景可将部署配置的编写时间从平均2天缩短至4小时,部署过程中的人工干预率从原来的50%降至10%,同时将部署失败的概率从8%降至2%以下 。

4.3 企业级落地案例

以下为该模型在不同行业的企业级落地案例,其效果数据均来自官方或第三方权威评测:

| 企业类型 | 核心需求 | 落地场景 | 效果量化 |

|---|---|---|---|

| 金融科技 | 缩短bug修复时间,提升代码安全性 | 自动化代码审查、智能调试 | 复杂bug修复时间从4.2小时降至1.8小时,修复准确率达89%,安全漏洞拦截率提升至92% |

| 电商平台 | 提升订单接口性能,优化数据库查询 | 错误检测、性能瓶颈定位 | 订单接口响应时间从1200ms压缩至300ms以内,QPS提升2.5倍,数据库查询时间缩短75% |

| 企业级SaaS | 降低新开发者上手时间,提升文档覆盖率 | 大型代码库导航、自动化文档生成 | 新开发者上手时间从4周缩短至1周,文档覆盖率从30%提升至90% |

| 独立开发者 | 快速生成项目原型,压缩开发周期 | 快速原型生成、自动化测试 | 项目原型生成时间从1周缩短至1天,单元测试编写时间减少70% |

| 上述案例的效果数据,均来自官方技术文档与第三方权威评测 。 |

5. 性能评估与优势分析

Grok Code Fast 1的核心竞争力,体现在其高吞吐量、低延迟与优性价比的平衡——这种平衡使其能同时满足个体开发者的实时需求与企业级团队的大规模任务处理需求,这也是其在同类模型中脱颖而出的关键。

5.1 基准测试结果

该模型的性能已通过多个权威基准测试验证,其核心指标如下:

| 基准测试 | 得分 | 测试维度 |

|---|---|---|

| SWE-Bench-Verified | 70.8% | 软件工程任务处理能力 |

| LiveCodeBench | 62% | 实时编码任务准确率 |

| 编码准确率 | 93.0% | 代码生成的语法正确性 |

| 指令遵循准确率 | 75.0% | 理解自然语言需求的能力 |

| 推理准确率 | 80.0% | 逻辑推理与问题解决能力 |

| 上述基准测试结果,均来自官方技术文档与第三方权威评测 。其中,SWE-Bench-Verified是当前软件工程领域最权威的基准测试之一,覆盖了代码修复、需求分析、工具调用等多类任务——该模型的70.8%得分,在同类模型中处于领先水平,超过了Claude Sonnet 4的68.2%与GPT-5-nano的69.5% 。 |

5.2 关键性能指标

该模型的关键性能指标,均围绕“低延迟、高吞吐量”的设计目标展开,具体如下:

- 吞吐量:官方数据显示,其吞吐量约为92 tokens/秒;第三方实测数据显示,其峰值吞吐量可达190 tokens/秒——这一指标远超同类模型(如Claude Sonnet 4的吞吐量约为60 tokens/秒),能满足实时编码场景的需求,即使是生成数百行代码,也能在数秒内完成 。

- 响应时间:生成5-10行函数仅需不到1秒,50行以上的组件生成仅需2-5秒,跨数十个文件的大型重构任务仅需5-10秒——这种级别的响应速度,能让开发者保持“流状态”,不会因等待模型响应而中断思路 。

- 上下文窗口:256K token的上下文窗口,使其能一次性处理数十个文件的完整逻辑,甚至覆盖中小型单体代码库的核心模块——这比GPT-4o的128K token窗口大了一倍,能更好地支持大型代码库的分析任务 。

- 可靠性:在7个核心基准测试中,其可靠性达100%——这意味着模型在处理常见任务时,不会出现崩溃或无响应的情况,能稳定支持企业级的大规模任务处理需求 。

5.3 成本优势分析

该模型的成本优势,是其在企业级场景中快速普及的关键因素——其定价策略针对高吞吐量任务进行了优化,能显著降低企业的AI使用成本。具体定价如下:

- 输入:$0.20/百万token

- 输出:$1.50/百万token

- 缓存:$0.02/百万token(重复上下文可享受缓存优惠)

上述定价来自官方技术文档 。与同类模型相比,其成本优势显著:例如,Claude Sonnet 4的输入定价为$0.30/百万token,输出定价为$1.80/百万token——Grok Code Fast 1的输入成本比Claude Sonnet 4低33%,输出成本低16.7%。对于日均处理千万级token的企业级团队而言,这一差异能带来每年数十万元的成本节省 。

此外,该模型的缓存机制能进一步降低成本:对于重复的上下文(如项目的通用配置文件、常用工具的调用逻辑),模型会自动缓存,后续调用时无需重新处理,缓存的token成本仅为$0.02/百万token——这对于需要处理大量重复任务的企业级团队而言,能额外节省约30%的成本 。

6. 结论与建议

Grok Code Fast 1是一款针对“效率优先”场景优化的Agentic编程模型,其核心价值在于将高价值的开发者时间从低价值的机械性任务中解放出来,同时通过与DevOps工具链的集成,实现全流程的自动化与标准化——这种价值,不仅能提升个体开发者的效率,更能从整体上优化团队的协作模式与项目的交付质量。

6.1 核心价值总结

该模型的核心价值可总结为三点:

- 效率提升:通过自动化代码审查、智能调试、大型代码库导航等功能,将开发者从低价值的机械性任务中解放出来,使其能将精力集中于核心业务逻辑设计——第三方实测数据显示,其能将整体开发效率提升约40%。

- 质量保障:通过代码审查、错误检测等功能,在开发流程的早期拦截潜在问题,降低线上故障的风险——金融科技行业的实测数据显示,其能将安全漏洞拦截率提升至92%,线上故障发生率降低约60%。

- 协作优化:通过统一的分析标准与跨语言知识传递能力,打破技术栈壁垒,缩短新开发者的上手时间,提升团队的协作效率——企业级SaaS团队的实测数据显示,其能将新开发者的上手时间从4周缩短至1周,团队的知识传递成本降低约70%。

6.2 适用场景与局限性

该模型的适用场景与局限性,均与其“效率优先”的设计目标高度相关:

- 适用场景:最适合快速原型开发、日常bug修复、大型代码库维护、CI/CD自动化等场景——这些场景的核心需求是“快速执行”,而模型的高吞吐量与低延迟特性,能完美匹配这一需求。

- 局限性:不适合复杂架构设计、前沿算法研发等需要深度推理的场景——在这些场景中,模型的推理能力不如Grok 4、Claude Opus等大模型;此外,其对部分框架的版本特性支持不够完善(如Tailwind CSS v3的无效类名识别),需要结合框架官方文档进行二次验证 。

6.3 落地建议

基于该模型的特性与实际落地经验,提出以下三点建议:

- 从高频场景切入:建议从代码审查、单元测试生成等高频低风险场景开始试点,快速验证模型的效果与价值,再逐步扩展到自动化部署、性能优化等复杂场景——这种“小步快跑”的策略,能降低初期的试错成本,同时快速获得团队的认可。

- 建立人工复核机制:对于安全相关或核心业务逻辑的代码修改,建议保留人工复核环节——模型的能力虽强,但仍存在一定的错误率,人工复核能进一步降低风险,确保代码质量。

- 优化提示词策略:为模型提供更具体的上下文信息(如项目框架、业务规则、团队编码规范),能显著提升模型的输出质量——例如,将“生成一个用户列表组件”改为“生成一个基于React 18的用户列表组件,支持分页与搜索,遵循Airbnb编码规范”,模型的输出准确率可提升约20% 。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)