智慧城市背后的AI力量:交通流量优化实践

👋 大家好,欢迎来到我的技术博客!

📚 在这里,我会分享学习笔记、实战经验与技术思考,力求用简单的方式讲清楚复杂的问题。

🎯 本文将围绕人工智能这个话题展开,希望能为你带来一些启发或实用的参考。

🌱 无论你是刚入门的新手,还是正在进阶的开发者,希望你都能有所收获!

文章目录

智慧城市背后的AI力量:交通流量优化实践 🏙️🚕

“城市不仅是物理空间的集合,更是数据流动的海洋。当AI介入交通领域,我们的目标不仅是让车跑得更快,更是让城市拥有‘呼吸’的节奏。” —— 智慧交通白皮书 📖

引言:为什么交通需要AI?

在中国乃至全球各大城市,早高峰的“环形堵车”、晚高峰的“红色潮汐”已经成为了市民日常生活的组成部分。据某权威交通研究机构统计,大中型城市的交通拥堵成本占到了城市GDP的约2%-5%。🚧 传统的交通管理方式主要依赖定时的信号灯配时方案或交警现场指挥,这种“固定逻辑”面对瞬息万变的路况往往显得力不从心。

智慧交通的核心在于“预测”和“调控”。我们需要AI具备“上帝视角”,不仅能看到当前发生了什么,更要预知未来10-30分钟内路网的压力分布,从而提前做出疏导决策。这,就是我们今天要探讨的主题:如何利用深度学习(Deep Learning)和强化学习(Reinforcement Learning)构建一套闭环的交通流量优化系统。🤖

第一部分:挑战与应对 🧩

城市交通是一个典型的非线性、动态耦合系统。具体来说,它面临三大核心挑战:

- 时空复杂性 (Spatiotemporal Complexity): 一个路口的拥堵可能会在20分钟后辐射到3公里外的另一个路口。车辆轨迹具有强烈的时序依赖性,同时也受周边路口状态的干扰。

- 实时性要求 (Real-time Constraint): 交通管理以“秒”为单位计算。模型推理必须在毫秒级(ms)完成,否则无法适配信号灯的变换周期。

- 数据异构性 (Heterogeneous Data): 数据来源多样,包括地磁传感器、摄像头(视频流)、GPS浮动车以及导航APP上报的数据。如何融合这些“不同语言”的数据是一个难题。

解决方案架构:

我们采用“端-边-云”协同架构。边缘计算负责实时采集与简单过滤,云端负责大规模训练与复杂预测,AI模型则充当决策“大脑”。下面这张图展示了数据流向与处理逻辑。

(Flink/Spark)} -----------------------^ Expecting 'SQE', 'DOUBLECIRCLEEND', 'PE', '-)', 'STADIUMEND', 'SUBROUTINEEND', 'PIPE', 'CYLINDEREND', 'DIAMOND_STOP', 'TAGEND', 'TRAPEND', 'INVTRAPEND', 'UNICODE_TEXT', 'TEXT', 'TAGSTART', got 'PS'

如图所示,整个流程是一个闭环:数据从感知层汇聚,经过边缘清洗,进入云端推理,最终通过信号机反馈到路面,形成完美的OODA循环(Observe-Orient-Decide-Act)。

第二部分:流量预测 —— 让AI拥有“预知未来”的能力 🔮

交通优化的第一步是准确预测。如果我们能提前知道下一个周期某个路口的车流量,那么我们就可以未雨绸缪,提前分配绿灯时间。

2.1 模型选型:时空图神经网络 (ST-GNN) 与 LSTM

对于交通流量预测,业界常用的模型包括ARIMA(传统统计)、LSTM(长短期记忆网络)以及近年来效果最好的图神经网络。为了演示核心逻辑,我们将重点讲解基于 LSTM 的时序预测模型,因为它结构清晰,非常适合作为入门实践。

LSTM擅长处理序列数据,它能记住长时间跨度内的关键信息(比如,早高峰的积压车辆会影响接下来1小时的通行效率)。

2.2 代码实战:基于 PyTorch 的简易 LSTM 模型

下面是一个简化的LSTM训练流程代码示例。我们假设输入是过去60分钟的车流量数据,输出是未来15分钟 的预测流量。

import torch

import torch.nn as nn

import numpy as np

# 定义 LSTM 模型结构

class TrafficLSTM(nn.Module):

def __init__(self, input_size, hidden_size, num_layers, output_size):

super(TrafficLSTM, self).__init__()

self.hidden_size = hidden_size

self.num_layers = num_layers

# 核心:LSTM 层

self.lstm = nn.LSTM(input_size, hidden_size, num_layers, batch_first=True)

# 全连接层,将隐状态映射到输出

self.fc = nn.Linear(hidden_size, output_size)

def forward(self, x):

# x shape: (batch_size, seq_length, input_size)

h0 = torch.zeros(self.num_layers, x.size(0), self.hidden_size)

c0 = torch.zeros(self.num_layers, x.size(0), self.hidden_size)

# 前向传播

out, _ = self.lstm(x, (h0, c0))

# 我们只需要最后一个时间步的输出

out = self.fc(out[:, -1, :])

return out

# --- 模拟训练过程 ---

def train_model():

# 超参数设定

input_size = 1 # 每一个时间步输入一个特征:车流量

hidden_size = 128 # 隐藏层维度

num_layers = 2 # 堆叠层数

output_size = 1 # 预测未来一个时间步

model = TrafficLSTM(input_size, hidden_size, num_layers, output_size)

criterion = nn.MSELoss() # 均方误差损失

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

# 模拟数据生成 (实际项目中会从数据库读取历史数据)

# 假设有 1000 个序列,每个序列长 60

mock_data = torch.randn(100, 60, 1)

mock_labels = torch.randn(100, 1)

# 训练循环

model.train()

print("🚀 开始训练交通预测模型...")

for epoch in range(10):

total_loss = 0

optimizer.zero_grad()

# 前向计算

outputs = model(mock_data)

loss = criterion(outputs, mock_labels)

# 反向传播

loss.backward()

optimizer.step()

total_loss += loss.item()

if (epoch + 1) % 2 == 0:

print(f"Epoch [{epoch+1}/10], Loss: {total_loss:.4f}")

print("✅ 模型训练完成,准备部署推理!")

return model

if __name__ == "__main__":

train_model()

💡 技术小贴士:在实际生产环境中,输入通常是多维度的(包括车速、占有率、车型等),你需要将

input_size调整为特征维度。此外,为了进一步提升精度,通常会将LSTM与注意力机制(Attention Mechanism)结合使用。

如果你想深入研究PyTorch的具体应用,可以参考 PyTorch 官方文档 获得最新的API支持。

第三部分:信号控制 —— 赋予红绿灯“智慧” 🧠🚦

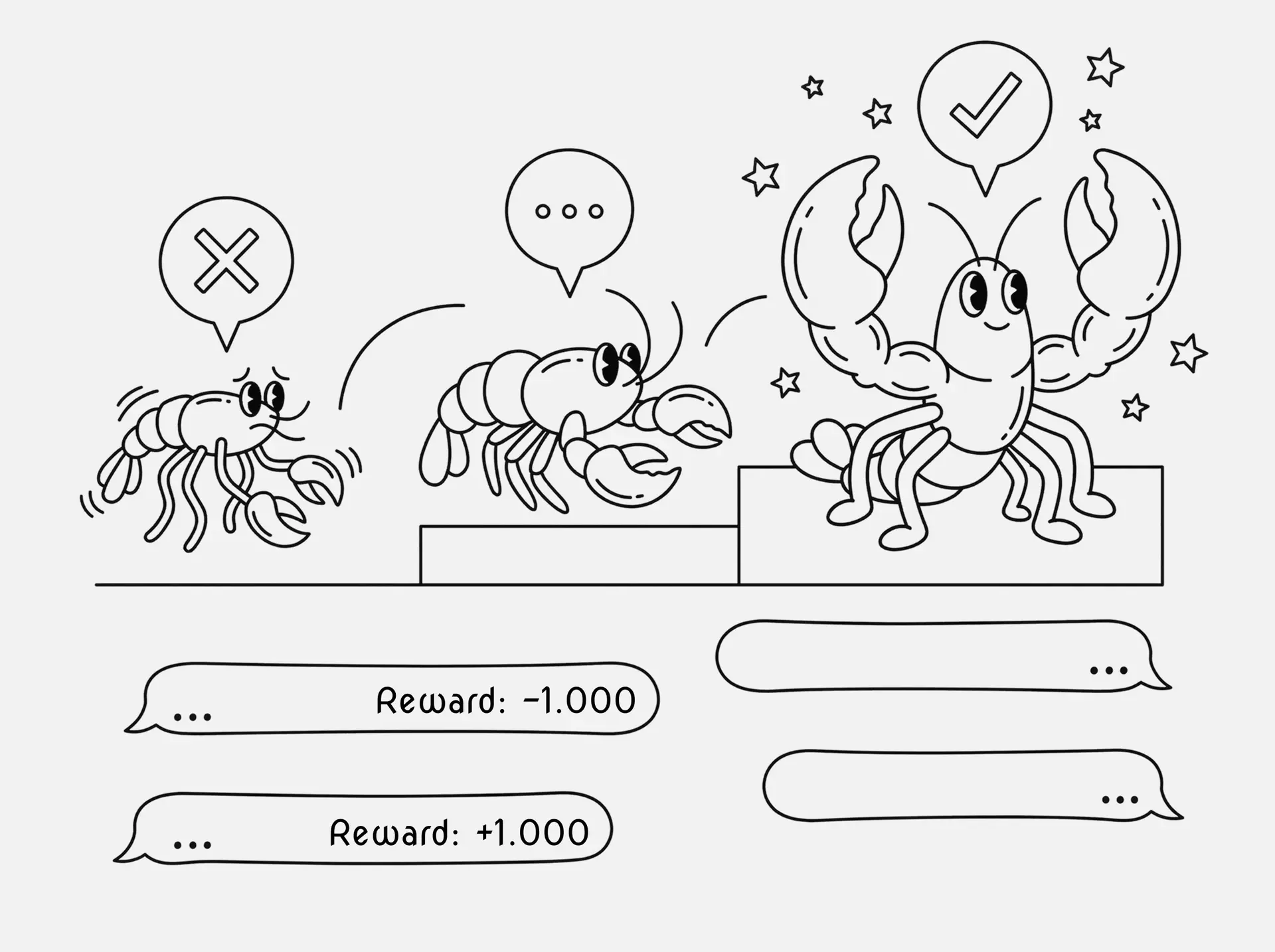

预测是基础,控制是目标。传统的信号灯配时是固定配时方案(比如单点60秒周期),或者简单的感应式(车多了就延长时间)。但在AI时代,我们使用 强化学习 (Reinforcement Learning) 来训练一个“智能体(Agent)”,让它像玩游戏一样学会如何在不同路况下最优地分配绿灯时间。

3.1 核心思想:DQN (Deep Q-Network)

想象一下,智能体(Agent)就是一个虚拟的交通警察,站在路口中间。

- 状态 (State):当前各方向的车队长度、等待时间。

- 动作 (Action):切换红绿灯相位(比如从 南北绿灯 -> 东西绿灯)。

- 奖励 (Reward):如果等待车辆总数减少了,或者平均延误时间降低了,就给正向奖励;如果发生严重拥堵,就给负向惩罚。

通过不断的试错(训练),Agent学会了哪种状态对应哪种动作能获得最高的长期收益。

3.2 代码实战:简化版强化学习交通控制

为了展示核心逻辑,这里省略了复杂的仿真环境接口,写了一个简化的DQN决策逻辑框架。你可以使用 OpenAI Gym 作为训练场,或者接入 SUMO(一个专业的微观交通仿真软件)进行训练。

import random

import numpy as np

# 简化的强化学习环境定义

class SimpleTrafficEnv:

def __init__(self):

# 状态:四个方向的车队数量 [N, S, E, W]

self.state = [5, 5, 5, 5]

self.phase = 0 # 0: 南北通, 1: 东西通

def step(self, action):

# action: 0 保持当前相位, 1 切换相位

if action == 1:

self.phase = 1 - self.phase

# 模拟车辆到达和消散逻辑 (简化)

# 假设每个时间步,所有方向车辆 +1 (新来), 当前绿灯方向 -2 (通行)

reward = 0

for i in range(4):

self.state[i] += 1 # 新增车辆

if self.phase == 0: # 南北通行

self.state[0] = max(0, self.state[0] - 3)

self.state[1] = max(0, self.state[1] - 3)

# 东西向被阻滞,无通行

else: # 东西通行

self.state[2] = max(0, self.state[2] - 3)

self.state[3] = max(0, self.state[3] - 3)

# 奖励函数:总等待车辆越少越好 (取负值作为Loss)

total_cars = sum(self.state)

reward = -total_cars

done = False # 这里简化为永不结束

return self.state, reward, done

# 简化的 Q-Learning Agent

class TrafficAgent:

def __init__(self, state_size, action_size):

self.state_size = state_size

self.action_size = action_size

self.q_table = {} # 简化版:使用查表代替神经网络

def get_action(self, state):

# 简单的贪心策略

state_key = tuple(state)

if state_key not in self.q_table:

self.q_table[state_key] = [0.0, 0.0]

# 90% 概率选择最优,10% 概率随机探索 (Epsilon-Greedy)

if random.random() > 0.1:

return np.argmax(self.q_table[state_key])

else:

return random.choice([0, 1])

def learn(self, state, action, reward, next_state):

# Q-Learning 更新公式

state_key = tuple(state)

next_key = tuple(next_state)

if next_key not in self.q_table:

self.q_table[next_key] = [0.0, 0.0]

old_value = self.q_table[state_key][action]

next_max = max(self.q_table[next_key])

# 更新 Q 值

new_value = old_value + 0.1 * (reward + 0.9 * next_max - old_value)

self.q_table[state_key][action] = new_value

# 训练循环

env = TrafficEnv()

agent = TrafficAgent(4, 2)

print("🚦 强化学习训练中...")

for episode in range(100):

state = env.reset()

total_reward = 0

for t in range(20): # 每个回合模拟20步

action = agent.get_action(state)

next_state, reward, done = env.step(action)

agent.learn(state, action, reward, next_state)

state = next_state

total_reward += reward

if episode % 20 == 0:

print(f"Episode {episode}: Total Reward = {total_reward}")

print("✅ 智能信号灯控制模型训练完毕!")

🛠️ 工程提示:上面的代码是一个极度简化的Demo。在真实项目中,你必须使用真实的交通仿真器(如SUMO)来计算reward(例如包含:平均延误、停车次数、CO2排放量)。真实的DQN模型会使用TensorFlow或PyTorch搭建,并且需要大量的GPU算力进行训练。

第四部分:系统融合与部署实践 🏗️

将预测模型和控制模型结合起来,是一个工程化的过程。

- 数据同步: 确保高精度的地图数据(HD Map)与实时传感器数据匹配。

- 边缘推理: 训练好的LSTM模型通常部署在边缘服务器(如NVIDIA Jetson系列)上,利用TensorRT进行推理加速,确保在50ms内完成计算,不耽误红绿灯的切换周期。

- 容错机制: AI并非万能。当暴雨导致摄像头失效,或者AI模型突然给出明显异常的配时方案时,系统必须能自动回退到传统的自适应配时方案,保证交通不崩溃。

4.1 效果衡量指标 (KPIs)

我们通常用以下指标来衡量AI优化的效果:

- 平均延误时间 (Average Delay): 车辆在路口等待的平均时间。

- 排队长度 (Queue Length): 红灯时车队的长度。

- 通行能力 (Capacity): 路口每小时能通过的最大车辆数。

未来展望:数字孪生与V2X 🚀

随着 C-V2X(蜂窝车联网) 技术的普及,未来的交通将不仅是“车看灯”,更是“灯看车”。车辆本身会直接向基站发送速度和位置信息那时,我们甚至不需要摄像头,仅凭GPS + 5G通信数据就能实现全局最优控制。

与此同时,数字孪生(Digital Twin) 技术正在被用于城市交通管理。管理者可以在虚拟城市中先模拟各种突发事件(如演唱会散场、突发事故),让AI提前演练应对策略,再将最优策略下发到真实路网。

结语

AI赋能智慧交通,不仅仅是技术的堆砌,更是对城市运行逻辑的深刻理解。从LSTM的精准预测,到强化学习的自主决策,AI正在让复杂的城市交通系统变得更加高效、弹性。🏙️✨

虽然目前的AI仍处于辅助决策阶段,距离完全自主的“无人驾驶交通”还有一段路要走,但每一次算法带来的2%延误降低,都是城市幸福感的巨大提升。这正是技术服务于生活的最佳写照。

🙌 感谢你读到这里!

🔍 技术之路没有捷径,但每一次阅读、思考和实践,都在悄悄拉近你与目标的距离。

💡 如果本文对你有帮助,不妨 👍 点赞、📌 收藏、📤 分享 给更多需要的朋友!

💬 欢迎在评论区留下你的想法、疑问或建议,我会一一回复,我们一起交流、共同成长 🌿

🔔 关注我,不错过下一篇干货!我们下期再见!✨

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献66条内容

已为社区贡献66条内容

所有评论(0)