【论文阅读】Learning Person-specific Cognition from Facial Reactions for Automatic Personality Recognition

Learning Person-specific Cognition from Facial Reactions for Automatic Personality Recognition

论文核心思想:对于每个受试者,生成一个个性化的CNN结构来表示其认知过程;然后将训练好后的网络结构及参数冻结并转化成一个图网络来表示其个性化认知;最后用这个图来做人格识别

摘要

本文提出从目标对象通过面部反应模拟的认知中识别其真实的(自报)人格特质。该方法基于认知科学中的以下两个发现:(i)人类认知部分决定所表达的行为,并与真实人格特质直接相关;(ii)在双人互动中,个体的非言语行为会受到其对话伙伴行为的影响。在此背景下,我们假设在双人互动过程中,目标对象的面部反应主要由两个因素驱动:其内部(特定于个人)的认知过程,以及对话伙伴外显的非言语行为。因此,我们提出以人格化CNN架构来表示目标对象(定义为听者)的人格化认知,该架构具有独特的架构参数和深度,以对话伙伴(定义为说话者)展示的视听非言语线索为输入,并能够重现目标对象的面部反应。每个人格化CNN均通过神经架构搜索(NAS)和一种新颖的自适应损失函数进行探索,然后将其表示为图表示以识别目标对象的真实人格。实验结果不仅表明,在人类-人类和人类-机器交互场景中,生成的图表示与目标对象的人格特质密切相关,并且显著优于现有方法,而且还证明了所提出的新型策略有助于学习更可靠的人格表示。

关键词:真实人格识别、二元互动、特定个体认知模拟、面部反应生成、端到端图表示学习、多维边特征

引言

理解人类人格可以为多种应用带来益处。机器学习(ML)的最新进展促进非侵入式自动人格特质分析,能够从受试者的视听非言语行为中识别其人格特质。心理学和生物学证据表明,非言语行为是人格的可靠预测指标。ML模型大多使用外部观察者(标注者)提供的人格标签进行训练的。因此,这些ML模型扮演着外部人工观察者的角色,观察目标受试者的非言语远端线索,即音频信号(如delta-梅尔倒谱系数、语音持续时间、音调、停顿率等),视觉线索(如面部动作、手势),可观察的人际线索等,估测人格。然而,人们通过远端线索(例如精力)外化其人格,这些线索会基于观察者实际感知的内容产生感知偏差,从而变成近端线索(例如音量)。因此,上述方法可被视为自动人格感知(APP)解决方案(从近端线索进行推理)。

自动人格识别(APR)目标是通过机器可检测的远端线索推断真实的人格。虽然APP方法基于近端行为线索预测表观人格(感知),但APR旨在识别影响远端行为线索生成的真实人格。因此,那些作为外部观察者训练以提供人格感知的APP模型可能无法可靠地识别真实的人格特质(问题1)。此外,大多数这些APP解决方案通过将片段级人格标签重新用作帧/薄片级标签来训练机器学习模型,从而独立地从单个帧或行为的薄片中识别人格特质。这存在一个问题:具有不同人格特质的人在单个帧或薄片中可能表现出非常相似的非言语视听行为。因此,此类策略可能导致相同的输入模式在训练过程中与多个标签配对,使其在理论上无法学习到良好的假设(问题2)。尽管最近的方法通过使用整个片段建模人格(即在片段级识别人格特质)来解决此问题,但它们仅选择一组关键帧来代表整个片段。这可能会忽略被丢弃的帧所显示的短期行为(问题3),而这些行为可能包含人格识别的关键线索。

本文提出了一种新颖的视听自动真实人格识别框架,以解决上述问题。

真正的人格会影响个体对远端线索的外化认知过程(例如面部反应)。最近的研究表明,在双人及群体互动中,主体的非语言行为(例如面部反应)会受到其对话伙伴行为的影响,因此可以从对话伙伴的行为中预测主体的非语言行为。

因此,本文假设在双人互动过程中,目标主体(听者)的面部反应由两个主要因素驱动:(i)目标主体的内部(特定于个人)认知,(ii)对话伙伴(说话者)外化的非语言行为。

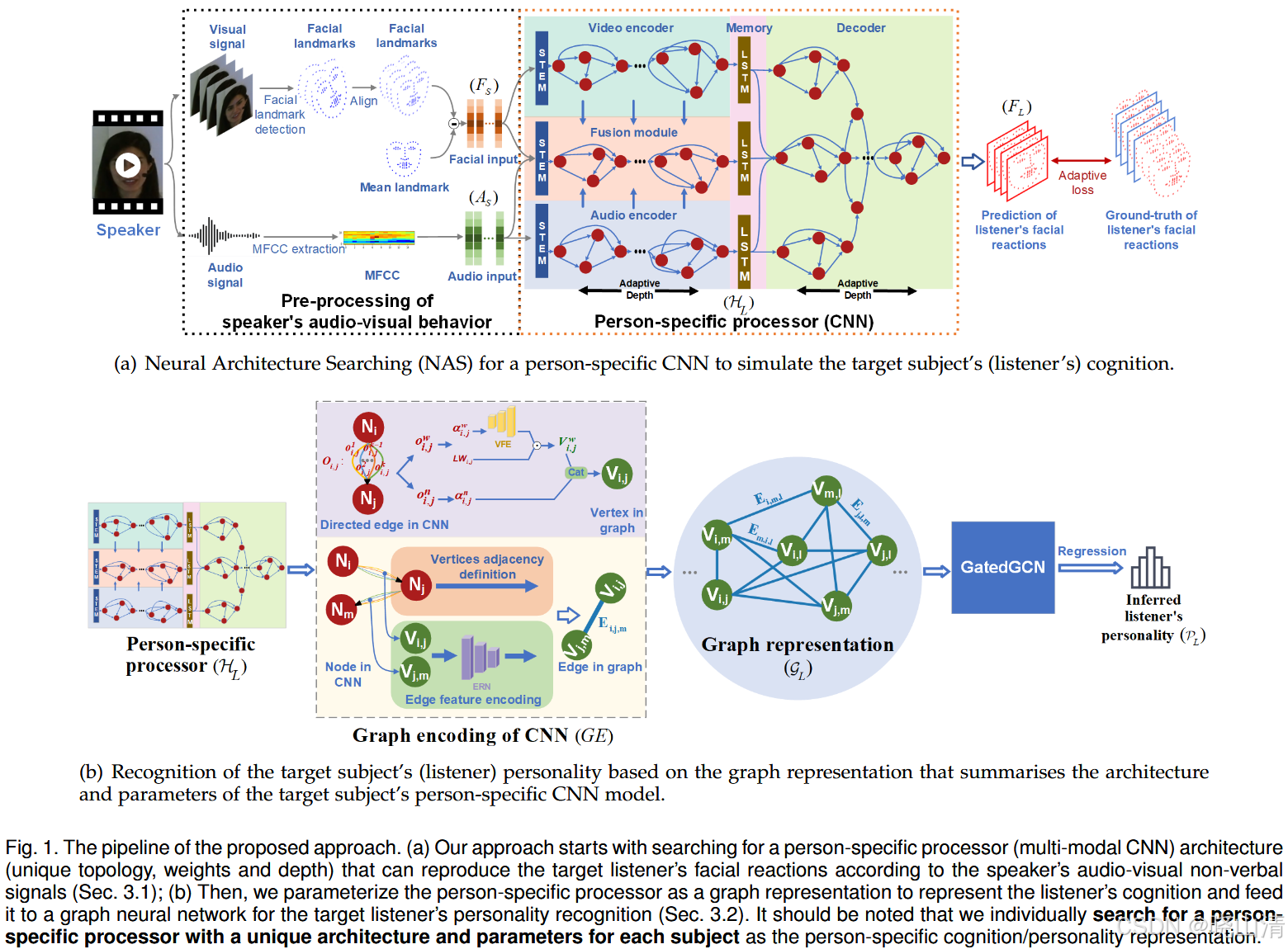

因此,我们提出为每个主体学习一个个性化卷积神经网络(CNN),该网络能够重现主体对对话伙伴的面部反应。由此,所探索的个性化CNN可以表示目标主体在生成面部反应过程中的认知过程,而该过程与主体的真实人格密切相关(解决问题1)。更重要的是,每个人格化CNN都是利用目标视频中所有可用帧所包含的行为进行探索的(解决问题3),因此其架构和参数包含片段级信息,这些信息随后被编码为表示目标主体人格的图。这使得基于图神经网络(GNN)的人格模型的训练可以通过将片段级表示与片段级人格标签配对来实现(避免问题2)。所提方法的流程如图1所示。本文的主要贡献总结如下:

- 使用目标主体的模拟个性化认知作为源描述符,以识别该主体的真实人格特质。据我们所知,这是首个采用音频-视觉方法,利用个性化卷积神经网络(CNN)架构和权重来表征目标主体的认知,并从模拟认知中识别真实(自报)人格特质的研究。

- 提出了一种新颖的音频-视觉非侵入式个性化认知模拟策略,该策略能自动为每个主体搜索最优多模态人格化CNN,以重现主体的面部反应。所探索的个性化CNN具有独特的层(操作)组合、权重和深度,充当目标主体的人格化认知过程,用于生成独特且人格化的面部反应。

- 提出了一种新颖的图编码策略,将探索到的CNN的独特架构和参数参数化为图表示形式,其中每个包含一组操作(如卷积、池化等)的CNN边被视为一个顶点,而图中边的存在则由CNN的架构决定。

- 提出了一种基于Transformer的特征学习策略,通过深度学习为图表示中每对相邻顶点生成任务特定的多维边特征。据我们所知,这是首个针对图结构深度学习多维边特征以表征卷积神经网络架构的方法。

- 在人类-人类和人类-机器双人互动设置下进行了一系列实验,不仅验证了所提方法在识别真实人格特质方面的优越性能,还系统展示了各种内部(方法论)和外部(主体人口统计学)因素对该方法的影响。

与我们早期的会议版本相比,扩展的期刊版本具有以下额外贡献和创新:

- 方法论:首先,我们引入了一种深度搜索策略(NAS),使每个个性化CNN不仅具有独特的架构参数,还具有独特的深度。除了将所有个性化CNN统一为与会议版本相同拓扑结构的图表示外,我们进一步提出将不同深度的CNN编码为具有不同拓扑类型的异构图表示。其次,我们提出了一种新颖的端到端顶点特征学习策略,从对应的操作(OPs)和层权重(LWs)中编码任务特定的顶点特征,取代了会议版本中引入的手工顶点特征编码策略。最后,我们提出了一种新颖的基于Transformer的多维边特征学习策略,该策略利用注意力操作学习顶点间显著的任务特定关系线索。

- 实验:第一,我们针对不同人口统计学群体进行了额外的消融研究。第二,我们增加了一个实验,将所提方法(个性化CNN的权重和架构参数作为个性化认知表示)与使用标准CNN架构(ResNet)的个性化权重作为个性化认知表示的系统进行比较。第三,我们针对上述新方法论贡献进行了额外的消融研究。第四,我们在一个额外收集的人机互动场景下的自报人格数据集上进行了所有实验。

- 展现方式:首先,在第3节开头,我们添加了详细概述和一系列公式,以解释所提方法的完整流程。其次,我们添加了文字和图表,以解释上述新方法论贡献和新实验结果。第三,在补充材料中,我们额外提供了VFE和EFE的伪代码。最后,在补充材料中提供了所有复现基线的详细设置。

相关工作

本节首先在第2.1节回顾了先前的视听自动人格分析方法。随后,它总结了生物学和心理学研究,这些研究发现人格可以通过人类认知来反映,为我们的工作提供了理论基础,即从模拟的人类认知过程中识别真实的人格特质(第2.2节)。

音视频自动人格分析

早期机器学习:提取手工设计的特征(如低级特征(如直方图定向梯度(HOG)、局部相位量化(LPQ))、中级特征(如中级行为属性统计数据、面部属性(凝视、头部运动等)、姿势、手势、行为共现模式、身体骨骼活动、量化局部泽尔尼克矩(QLZM)、视觉注意力焦点))来描述视听人类非言语行为或主体之间的人际关系,随后输入到支持向量机回归器(SVR)或逻辑回归等传统机器学习模型中,以生成表观人格预测。

深度学习:大多采用卷积神经网络(CNNs)从帧或短视频片段中学习任务特定的深度特征。提取的特征与属性特定模型结合以预测人格。

由于人格特质模型侧重于评估目标主体在较长时间内相对稳定的人格方面(通常远长于单个音视频片段的时长),因此帧/短时切片级行为可能无法可靠地反映人格特质。也有研究探讨基于片段级/长期行为建模人格特质的方法。但研究都集中在自动人格感知分析上,选择子集或关键帧来表示整个视频,未能充分利用数据中的全部信息。

人格与人类认知之间的关系

生物学研究指出,人格特质(例如外向性、尽责性和神经质)与人类脑结构、脑局部体积、灰质和白质等脑活动密切相关,这些是决定和控制人类认知过程的关键因素。心理学研究也指出,人们的人格与他们在各种日常活动中的认知过程密切相关。重要的是,人类认知与人格之间的关系相对稳定,给我们带来启示:人类认知可以作为识别人格的可靠且稳定的来源。

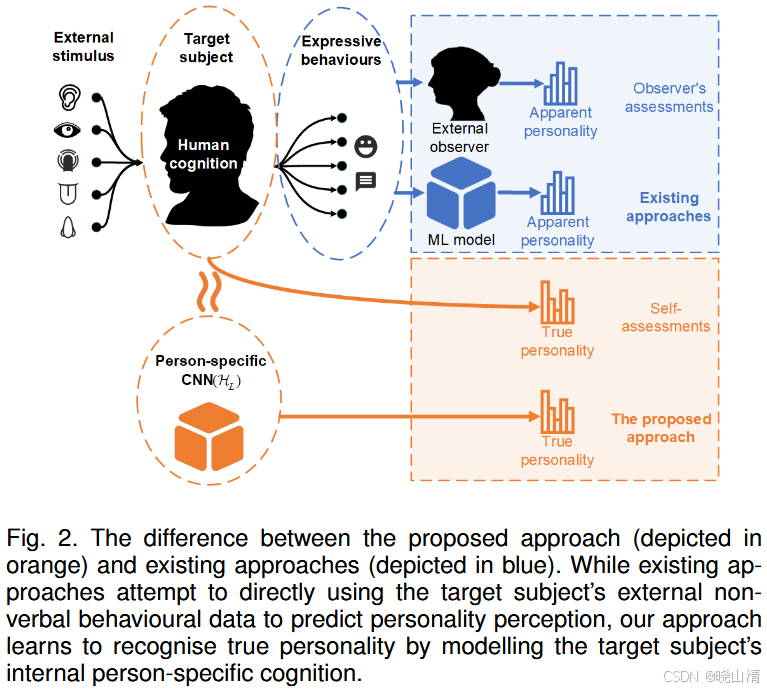

如图2,我们方法与现有方法的主要区别在于:现有方法试图直接从目标对象的可观测非言语行为中实现自动人格感知,其中机器学习模型充当外部观察者。相反,我们的方法受到上述关于人格与人类认知相互关系的研究的启发,通过模拟和建模目标对象的个体特异性认知过程来学习识别真实人格。

方法

(i)个性化认知(CNN)模拟(第3.1节)

(i)个性化认知(CNN)模拟(第3.1节)

我们的方法从模拟和建模每个目标主体(听者)的认知开始,通过单独搜索最优的个性化多模态CNN H L \mathcal{H}_L HL来实现。所探索的个性化CNN应能准确重现听者对对话伙伴(说话者)的音频 A S A_S AS和面部行为 F S F_S FS的面部反应 F L F_L FL,即主体在双人互动中接收到的信号(如图1(a)所示)。

H L = N A S ( F L , A S , F S ) \mathcal{H}_L = NAS(F_L, A_S, F_S) HL=NAS(FL,AS,FS),其中NAS表示基于DARTs的神经架构搜索算法。 H L \mathcal{H}_L HL包括深度 D L C N N D^{CNN}_L DLCNN、操作参数(OPs) O L O_L OL以及操作层的权重(LWs) W L W_L WL即 H L = { D L C N N , O L , W L } \mathcal{H}_L = \{D^{CNN}_L, O_L, W_L\} HL={DLCNN,OL,WL}

总之,我们通过考虑听者的面部反应以及相应说话者的音频和面部行为,为每位听者单独搜索一个特定于个人的CNN。具体而言,在此阶段,我们的目标是调整特定于个人的CNN以适应提供的听者-说话者二元交互数据,其中我们在相同的数据上搜索并验证该特定于个人的CNN。图9展示了搜索过程中具有代表性的损失曲线。

(ii)生成个人特定图表示(第3.2节)

H L \mathcal{H}_L HL代表目标听者的特定认知,因此 H L \mathcal{H}_L HL与听者的真实人格密切相关。然而,由于现有任何机器学习模型都无法直接处理该CNN,因此无法将已探索的CNN直接输入到机器学习预测器中进行个性识别。由于每个CNN网络都可以用图来很好地描述,其中包含参数的一组层可被视为顶点,它们之间的连接关系可被视为边,我们将 H L \mathcal{H}_L HL参数化为可学习的图表示 G L ( V , E ) \mathcal{G}_L(V, E) GL(V,E),作为对应听者的特定认知表示用于个性识别: G L ( V , E ) = G E ( H L ) = G E ( D L C N N , O L , W L ) \mathcal{G}_L(V, E)= GE(\mathcal{H}_L) = GE(D^{CNN}_L, O_L, W_L) GL(V,E)=GE(HL)=GE(DLCNN,OL,WL),其中GE表示所提出的图编码策略(如图1(b)中所述);V和E分别表示图表示 G L \mathcal{G}_L GL的节点和边。

(iii)基于生成的个人特定图表示进行人格识别(第3.3节)

最后,生成的图表示 G L \mathcal{G}_L GL被输入到图神经网络(GNN)模型中,以识别目标听众的真实人格,即 P L = G N N ( G L ) P_L = GNN(\mathcal{G}_L) PL=GNN(GL),其中 P L P_L PL表示目标听众预测的五种个性特质。

个性化认知(CNN)模拟

本节解释了我们如何搜索针对特定个人的多模态CNN,以表征目标听者的认知。具体而言,我们介绍了CNN的输入和目标(第3.1.1节),允许每个特定个人的CNN准确模拟目标听者认知的CNN设置(第3.1.2节),用于搜索和训练特定个人CNN的损失函数(第3.1.3节),以及架构参数的优化策略(第3.1.4节)。特定个人搜索的复杂性分析在补充材料中提供。

-

输入和目标

在双人互动过程中,听者的面部反应主要由两个因素驱动:(i)听者特定的认知;(ii)对话伙伴(即说话者)外显的非语言行为。基于此,我们探索了一种能够表征听者认知的特定人CNN模型 H L \mathcal{H}_L HL,当输入音频信号AS和说话者的面部行为FS时,该模型可输出听者的面部反应FL,即 F L = H L ( A S , F S ) F_L =\mathcal{H}_L(A_S, F_S) FL=HL(AS,FS)。一旦获得HL模型,它便在所提供的双人互动中承担起对应听者认知处理器的角色,用于生成面部反应。因此,所学习到的HL模型对于建模听者的真实人格特质具有充分的信息量,这不仅因为真实人格与听者的认知相关,还因为真实人格是人类生成和展示非语言行为的关键影响因素。

本文使用说话者和听者的面部关键点序列分别表示输入和目标面部运动。我们经验性地将序列长度设置为80帧(约3秒)。这是因为该时长不仅足以包含由多个面部表情组成的完整面部行为/反应,而且不会过长以至于包含对多个刺激的多个反应。每帧的对齐面部关键点通过OpenFace 2.0获取,然后基于预定义的平均人脸形状进行转换,以保留仅含面部行为而不含身份信息的内容。此外,使用64 bin的对数梅尔频谱作为音频表示,每个音频帧通过40毫秒的汉宁窗计算,步长为40毫秒。这样,每个视频的音频帧数量与视频帧数量保持一致。 -

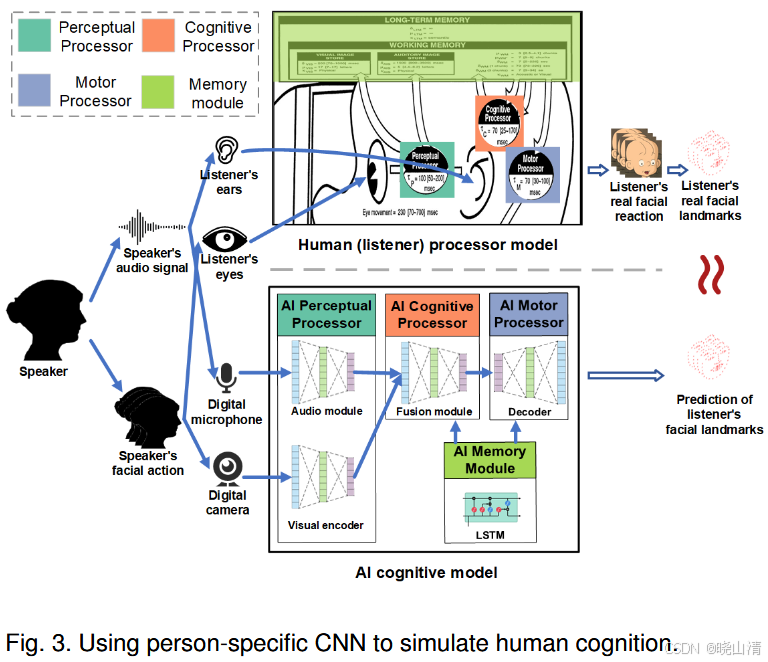

多模态认知处理器模型

基本拓扑结构:受模型人类处理器(MHP)启发(如图3),包含视觉、音频编码器模拟人类感知处理器;音频-视觉解码器模拟人类运动处理器;融合模块参与模拟人类认知处理器,即在多个层次上联合处理音频视觉线索。由于在每个人特定CNN的优化过程中,它会输入说话者的音频视觉序列,并输出听者的面部反应序列,因此我们还采用长短期记忆网络(LSTM)来处理来自两个编码器生成的潜在特征序列,旨在模拟MHP中的人类工作记忆模块。每个人特定CNN的基本拓扑结构也如图1(a)所示。

特定认知模拟的模型设置:参考DARTs,每个模块表示为由多个单元组成的有向无环子图。每个单元包含一组表示潜在特征的节点以及一组CNN边,其中每条边包含由操作(OPs)和层权重(LWs)定义的一组操作。具体而言,节点 N j N_j Nj表示从相邻父节点 N i 、 N i + 1 、 ⋅ ⋅ ⋅ 、 N j − 1 ( i < j ) N_i、N_{i+1}、···、N_{j−1}(i < j) Ni、Ni+1、⋅⋅⋅、Nj−1(i<j)生成的一组特征图。相邻节点通过CNN边 O i , j O_{i,j} Oi,j连接,该边包含一组预定义的操作 o i , j k o^k_{i,j} oi,jk(例如卷积、池化等),每个 o i , j k o^k_{i,j} oi,jk包含一组层权重 w i , j k w^k_{i,j} wi,jk(例如卷积层的核权重)。特别地,对于那些没有可学习层权重的操作(例如池化、恒等映射等),我们将其层权重定义为 o i , j k = ∅ o^k_{i,j} = \emptyset oi,jk=∅。即 O i , j = { o i , j k ( w i , j k ) ∣ k = 1 , 2 , ⋅ ⋅ ⋅ , K } O_{i,j} = \{o^k_{i,j} (w^k_{i,j})|k = 1, 2, · · · , K\} Oi,j={oi,jk(wi,jk)∣k=1,2,⋅⋅⋅,K}

在传播过程中,节点 N j N_j Nj中的特征图由所有相邻父节点 N i ( i < j 且adj ( i , j ) = 1 ) N_i(i < j且\text{adj}(i, j) = 1) Ni(i<j且adj(i,j)=1)通过相应CNN边 O i , j O_{i,j} Oi,j的所有操作生成,adj(i, j)表示连接性(即0表示不连接,1表示连接): N j = ∑ i < j ( O i , j ( N i ) × a d j ( i , j ) ) Nj =\sum\limits^{i<j}(O_{i,j}(N_i) × adj(i, j)) Nj=∑i<j(Oi,j(Ni)×adj(i,j))

如图4(c), O i , j O_{i,j} Oi,j中的每个操作 o i , j k o^k_{i,j} oi,jk被分配一个操作参数(OP) α i , j k α^k_{i,j} αi,jk以表示其重要性。这样,当将节点 N i N_i Ni中的特征图输入到CNN边 O i , j O_{i,j} Oi,j时,输出可以表示为: O i , j ( N i ) = ∑ k = 1 K ( α i , j k × o i , j k ( w i , j k ( N i ) ) ) O_{i,j}(N_i) = \sum\limits^K_{k=1}(α^k_{i,j} × o^k_{i,j}(w^k_{i,j}(N_i))) Oi,j(Ni)=k=1∑K(αi,jk×oi,jk(wi,jk(Ni)))

为了模拟面部反应中不确定且复杂的人类认知过程,我们将第n个(n > 2)融合单元设置为接收四个输入:第n个视觉单元 C n Visual C^\text{Visual}_n CnVisual和第n个音频单元 C n Audio C^\text{Audio}_n CnAudio的输出,以及第(n − 1)个和第(n − 2)个融合单元( C n − 1 Fusion , C n − 2 Fusion C^\text{Fusion}_{n−1}, C^\text{Fusion}_{n−2} Cn−1Fusion,Cn−2Fusion)的输出,可表示为: C n Fusion = ∥ { C n − 1 Fusion , C n − 2 Fusion , C n Audio , C n Visual } C^\text{Fusion}_n = ∥\{C^\text{Fusion}_{n−1}, C^\text{Fusion}_{n−2}, C^\text{Audio}_n, C^\text{Visual}_n\} CnFusion=∥{Cn−1Fusion,Cn−2Fusion,CnAudio,CnVisual}

其中∥是连接运算符。

因此,输入的音频和视觉信号可以在多个层次上组合并联合处理(如图1(a)所示)。第二,在每个单元中,我们设置每个节点连接到其所有先前节点,以表示所有可能的信息流,使提取的特征(节点)在CNN传播过程中可能受到多个先前状态(父节点)信息的影响(如图4(b)所示)。第三,我们设置每条CNN边具有唯一的一组OP和LW,而不是让所有单元共享相同的OP集。最后,由于深度也是影响CNN认知过程的关键因素,我们还为每个目标听者的特定CNN搜索唯一的单元数量(如图1(a)所示)。这样,表示目标听者认知的特定CNN HL可以定义为:

H L = { D L C N N , O L , W L } = { ( O L Audio , O L Video , O L Fusion , O L Decoder ) , ( W L Audio , W L Video , W L Fusion , W L Decoder ) , ( D L AVF , D L Decoder ) \mathcal{H}_L=\{D^{CNN}_L, O_L, W_L\} =\{(O^\text{Audio}_L, O^\text{Video}_L, O^\text{Fusion}_L, O^\text{Decoder}_L), (W^\text{Audio}_L, W ^\text{Video}_L, W ^\text{Fusion}_L, W ^\text{Decoder}_L), (D^\text{AVF}_L, D^\text{Decoder}_L) HL={DLCNN,OL,WL}={(OLAudio,OLVideo,OLFusion,OLDecoder),(WLAudio,WLVideo,WLFusion,WLDecoder),(DLAVF,DLDecoder)

其中 D L AVF D^\text{AVF}_L DLAVF表示音频、视觉和融合模块的深度,即这三个模块被设置为具有相同数量的单元。总之,与为每个受试者训练具有固定架构的特定CNN相比(后者仅使用一组唯一LW表示受试者的特定认知),我们方法探索的人特定CNN允许受试者的认知不仅通过一组唯一LW,还通过唯一OP和深度(即CNN的架构)来表示。换句话说,理论上,我们方法探索的CNN能更好地表示复杂的人类认知(在第4.4节中评估)。

所用操作(搜索空间):在本文中,我们为每条边 O i , j O_{i,j} Oi,j预定义了 v = 5 v= 5 v=5个具有层权重(LWs)的操作,以及 k = 5 k= 5 k=5个没有LWs的操作。这里,目标听者的人特定CNN的所有OP和LW分别定义为 α L α_L αL和 W L W_L WL。特定CNN设置(例如单元、节点和操作)的详细信息见表1。作为首次搜索特定CNN以将每个听者的个性表示为其人特定认知的工作,尚无先前研究建议最优操作和搜索空间。由于本文的主要目标是验证所探索的人特定CNN的个性化架构和权重能够反映相应听者自报的人格特质这一概念,我们发现先前深度学习模型中频繁使用的标准深度学习操作(卷积、池化等)已能使大多数探索的特定CNN准确重现其目标听者的面部反应。因此,我们决定基于这些标准深度学习操作定义搜索空间。尽管可以在搜索空间中采用更多操作,但这将进一步增加搜索过程的计算成本。在未来的工作中,我们将提出一种更高效的人特定CNN搜索策略,并专门研究用于表示与个性相关的人特定认知的最优搜索空间。 -

自适应损失函数

相似情绪或意图的面部反应可以通过不同的面部时空模式来表现,这在一定程度上是由听者的面部身份差异、反应时间和个性差异引起的。虽然不同主体的面部差异可以通过将面部投影到平均面部来部分解决,但我们认为听者对说话者行为产生面部反应总存在时间延迟。这是因为相应认知过程的执行需要一定时间。重要的是,这种时间延迟的持续时间不仅因不同听者而异,还可能因同一听者在其他外部因素影响下而变化。鉴于此,我们引入自适应因子 τ τ τ来建模这种不确定性。

音频-面部输入 A S ( t 1 , t 2 ) A_S(t_1, t_2) AS(t1,t2)和 F S ( t 1 , t 2 ) F_S(t_1, t_2) FS(t1,t2)表示说话者从 t 1 t_1 t1到 t 2 t_2 t2时间段内表达的音频-面部非言语行为。我们提出以下自适应损失(A-loss)函数来衡量预测听者面部反应与真实值之间的相似度: L A − l o s s ( t 1 , t 2 , τ ) = L A − l o s s ( F L p ( t 1 , t 2 ) , F L g ( t 1 + τ , t 2 + τ ) ) = ∑ i = t 1 t 2 ∑ j = 1 68 m i n ( L ⋆ ( x i , j p , x i + τ , j g ) + L ⋆ ( y i , j p , y i + τ , j g ) , ε ) ) L_{A−loss}(t_1, t_2, τ ) = L_{A−loss}(F^p_L(t_1, t_2), F^g_L(t_{1 + τ}, t_{2 + τ})) = \sum\limits^{t2}_{i=t_1}\sum\limits^{68}_{j=1} min(L⋆(x^p_{i,j} , x^g_{i+τ,j} ) + L⋆(y^p_{i,j} , y^g_{i+τ,j} ), ε)) LA−loss(t1,t2,τ)=LA−loss(FLp(t1,t2),FLg(t1+τ,t2+τ))=i=t1∑t2j=1∑68min(L⋆(xi,jp,xi+τ,jg)+L⋆(yi,jp,yi+τ,jg),ε)),其中 F L p ( t 1 , t 2 ) F^p_L(t_1, t_2) FLp(t1,t2)表示对应于输入的听者面部反应的预测关键点; F L g ( t 1 + τ , t 2 + τ ) F^g_L(t_{1 + τ}, t_{2 + τ}) FLg(t1+τ,t2+τ)是由引发的听者真实面部反应关键点,其中τ表示时间延迟; ( x i , j p , y i , j p ) (x^p_{i,j} , y^p_{i,j}) (xi,jp,yi,jp)表示第i帧第j个面部关键点的预测坐标, ( x i + τ , j g , y i + τ , j g ) (x^g_{i+τ,j} , y^g_{i+τ,j}) (xi+τ,jg,yi+τ,jg)是相应的真值坐标。具体而言,ε是一个常数值,用于避免异常值(如错误检测的面部区域)导致的极大损失值,这些异常值可能导致CNN搜索方向错误。L⋆表示预测与真值之间的相似度度量。在本文中,L⋆定义为均方误差(MSE)。为了实现所提出的自适应损失(即在每个时间点计算一个τ),实际操作中我们使用滑动时间窗口将听者面部反应的预测与一组真实值候选(真实值候选的持续时间长于时间窗口,如图1(a)最后一部分所示)进行比较。具体来说,我们设置R个真实值候选,即 F L g ( t 1 + r , t 2 + r ) , r = 1 , 2 , ⋅ ⋅ ⋅ R F^g_L(t_{1 + r}, t_{2 + r}),r = 1, 2, · · · R FLg(t1+r,t2+r),r=1,2,⋅⋅⋅R,并仅选择使损失 L A − l o s s ( t 1 , t 2 , τ ) L_{A−loss}(t_1, t_2, τ ) LA−loss(t1,t2,τ)最小的 r = τ : τ = a r g m i n L A − l o s s ( t 1 , t 2 , τ ) r = τ:τ = argminL_{A−loss}(t_1, t_2, τ ) r=τ:τ=argminLA−loss(t1,t2,τ)。因此,在每次训练迭代中,延迟时段可以自动适应每个听者。 -

优化策略

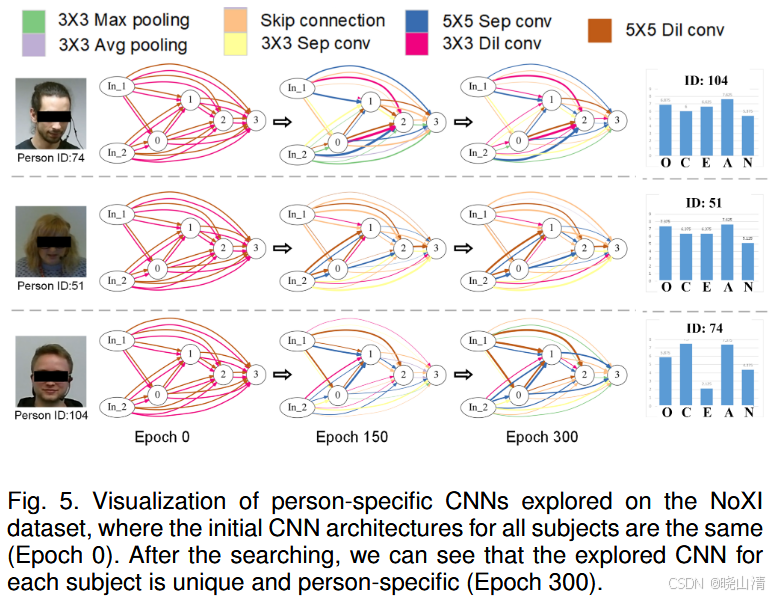

为了为每个听者搜索最优的多模态CNN(如3.1.2节所述),我们基于连续松弛算法进行单级优化。该优化在过程中同时调整所有操作符(OPs)、层权重(LWs)以及特定于人的CNN的深度。与广泛使用的双级优化策略相比,后者分别在验证集上优化OPs,在训练集上优化LWs,即优化其中一个时冻结另一个,所提出的单级优化策略允许OPs、LWs和深度同时进行优化。其目的是模拟人类认知在反应生成过程中所有认知过程共同激活的方式——没有证据表明人类认知处理器的某些部分在反应生成期间会被冻结。此外,该策略允许使用完整的音频-面部帧而非其子片段来优化OPs、LWs和深度,即所探索的CNN是片段级表示且不忽略任何帧。所提出单级OPs、LWs和深度优化的伪代码见算法1。特定于人的CNN优化过程的代表性示例在图5中可视化展示。

生成个人特定图表示

让我们回顾一下本文的主要假设:如果卷积神经网络(CNN)能够重现目标主体的面部反应,那么该CNN就代表了主体的特定认知,而这种认知与主体的真实人格密切相关。因此,我们为每个主体寻找一个特定的CNN。由于所探索的CNN是一个有向无环图,我们将每个探索到的CNN编码为一个图 G ( V , E ) \mathcal{G}(V, E) G(V,E),并将其视为相应主体的人格表示。这一过程在公式3中进行了表述,其中每个图表示G由一组顶点V和边E组成。具体而言,我们将每个CNN边 O i , j O_{i,j} Oi,j表示为对应图表示 G ( V , E ) \mathcal{G}(V, E) G(V,E)中的一个顶点 V i , j V_{i,j} Vi,j。同时,在G(V, E)中顶点 V i , j V_{i,j} Vi,j和 V j , m V_{j,m} Vj,m之间的边存在性 A i , j , m A_{i,j,m} Ai,j,m由它们对应的CNN边 O i , j O_{i,j} Oi,j和 O j , m O_{j,m} Oj,m之间的关系决定。如果 A i , j , m = 1 A_{i,j,m}= 1 Ai,j,m=1,那么边特征 E i , j , m E_{i,j,m} Ei,j,m通过考虑顶点特征 V i , j V_{i,j} Vi,j和 V j , m ) V_{j,m}) Vj,m)来获得,即: { V i , j = V F E ( O i , j ) E i , j , m , A i , j , m = E F E ( V i , j , V j , m , O i , j , O j , m ) \begin{cases}V_{i,j} = VFE(O_{i,j})\\E_{i,j,m}, A_{i,j,m} = EFE(V_{i,j} , V_{j,m}, O_{i,j}, O_{j,m})\end{cases} {Vi,j=VFE(Oi,j)Ei,j,m,Ai,j,m=EFE(Vi,j,Vj,m,Oi,j,Oj,m),其中VFE表示第3.2.1节中描述的所提出的顶点特征编码策略,EFE表示第3.2.2节中描述的所提出的边特征编码策略。我们还在补充材料中额外提供了VFE和EFE的伪代码。

-

顶点特征编码

给定CNN边 O i , j O_{i,j} Oi,j,我们将所有操作分为两部分:具有权重(例如卷积)的 v v v个操作 o i , j w o^w_{i,j} oi,jw,以及不具有权重(例如池化)的 k k k个操作 o i , j n o^n_{i,j} oi,jn。然后,我们提出一种顶点特征编码(VFE)策略,获得对应的顶点 V i , j V_{i,j} Vi,j,具体步骤如下:- 权重对齐:我们首先注意到每个CNN边的权重数量不同(在我们的研究中从数百到数千不等),这是因为它们的输入和输出特征图数量不同。因此,我们遵循剪枝滤波器的思想,从每个操作 o i , j k o^k_{i,j} oi,jk中选择固定数量的最具代表性的权重,记为 S ω i , j k Sω^k_{i,j} Sωi,jk。例如,我们从每个卷积操作中选择L1值(权重绝对值之和)最高的前5个内核的权重。这样, O i , j O_{i,j} Oi,j(包含K个操作)的LW表示 L W i , j = [ S ω i , j 1 , S ω i , j 2 , ⋅ ⋅ ⋅ , S ω i , j K ] LW_{i,j} = [Sω^1_{i,j}, Sω^2_{i,j}, ···, Sω^K_{i,j}] LWi,j=[Sωi,j1,Sωi,j2,⋅⋅⋅,Sωi,jK]对所有CNN边具有固定维度。

- 操作与权重融合:由于每个操作 α i , j k α^k_{i,j} αi,jk反映了操作 o i , j k o^k_{i,j} oi,jk(及其权重 ω i , j k ω^k_{i,j} ωi,jk)的重要性,我们使用操作来加权相应的权重。对于具有权重的操作,其原始操作 α i , j w α^w_{i,j} αi,jw被投影到与权重表示 L W i , j LW_{i,j} LWi,j维度相同的操作-权重加权向量

O P − L W i , j = V E N ( α i , j w ) = V E N ( [ α i , j w 1 , α i , j w 2 , ⋅ ⋅ ⋅ , α i , j w v ] ) OP-LW_{i,j} = VEN(α^w_{i,j}) = VEN([α^{w_1}_{i,j}, α^{w_2}_{i,j}, ···, α^{w_v}_{i,j}]) OP−LWi,j=VEN(αi,jw)=VEN([αi,jw1,αi,jw2,⋅⋅⋅,αi,jwv])

其中VEN是一个具有两个隐藏层的多层感知器(MLP)。然后,通过计算加权向量 O P − L W i , j OP-LW_{i,j} OP−LWi,j与权重表示 L W i , j LW_{i,j} LWi,j之间的点积,将具有权重的操作的操作和权重组合起来,可表示为: V i , j w = ⟨ O P − L W i , j , L W i , j ⟩ V^w_{i,j} = ⟨OP-LW_{i,j}, LW_{i,j}⟩ Vi,jw=⟨OP−LWi,j,LWi,j⟩ - 顶点特征生成:最后,我们将获得的 V i , j w V^w_{i,j} Vi,jw与不具有权重的 κ κ κ个操作的操作 α i , j n α^n_{i,j} αi,jn连接起来作为最终的顶点特征 V i , j = [ α i , j n , V i , j w ] V_{i,j} = [α^n_{i,j}, V^w_{i,j}] Vi,j=[αi,jn,Vi,jw]

由于 α i , j n , V i , j w α^n_{i,j}, V^w_{i,j} αi,jn,Vi,jw的维度均为固定,所有顶点特征将具有相同维度。该过程如图1(b)所示(用紫色表示)。

-

边特征编码

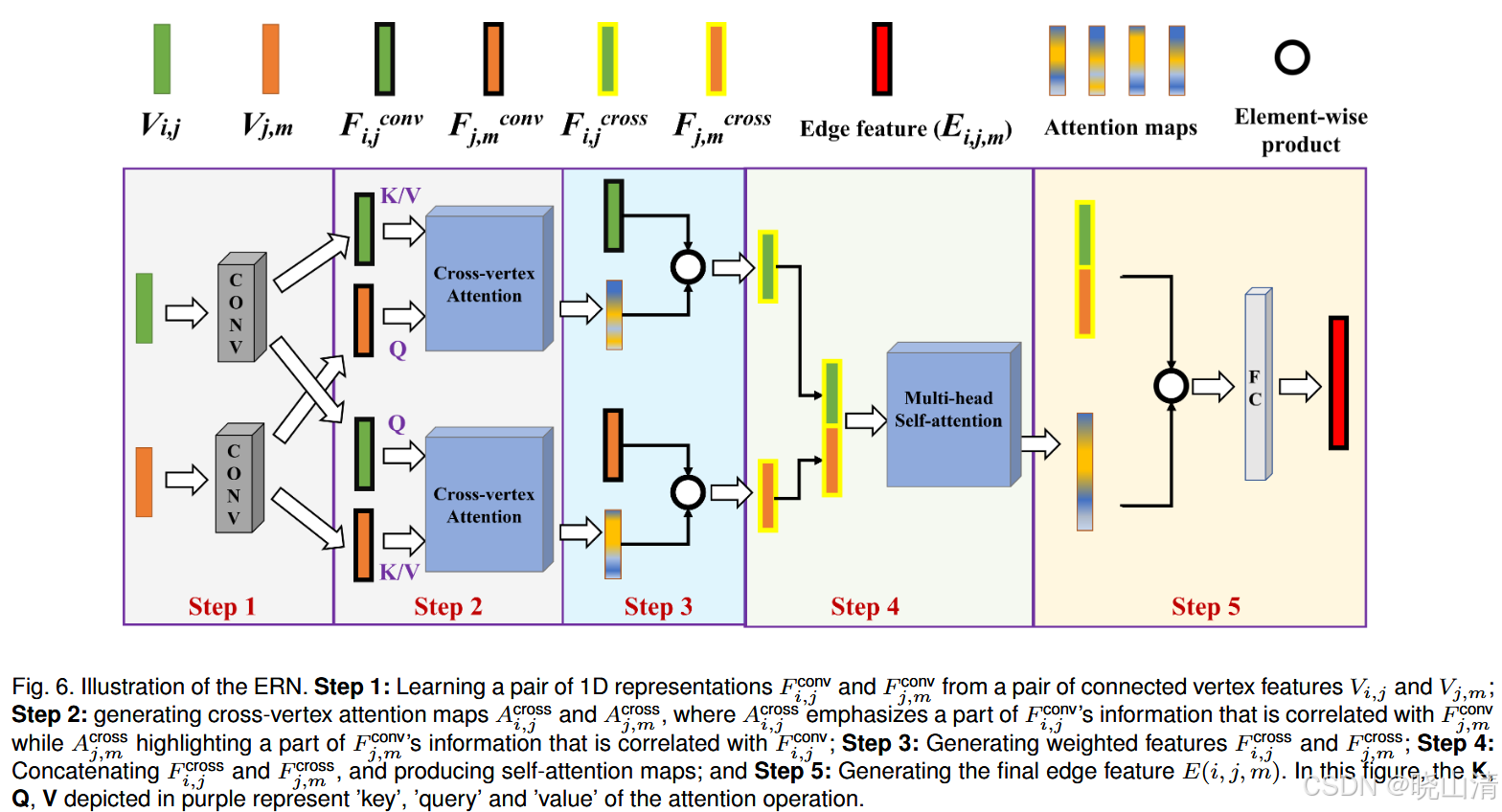

定义当且仅当CNN边 O i , j O_{i,j} Oi,j和 O j , m O_{j,m} Oj,m连接到CNN中的同一节点 N j N_j Nj时, V i , j V_{i,j} Vi,j和 V j , m V_{j,m} Vj,m相连(即边 E i , j , m E_{i,j,m} Ei,j,m存在, A i , j , m = 1 A_{i,j,m}= 1 Ai,j,m=1),如图1(b)。虽然现有大多数方法仅使用单一二进制值(0或1)来定义图中顶点对之间的关系,但这种单值二进制边特征通常无法描述所有与任务相关的关联线索,因为顶点之间的关系有时可以通过多个属性来描述。因此,我们旨在生成一种特定于个人的图表示,该表示不仅编码特定于个人的CNN的参数(包含在顶点特征中)和架构(以图拓扑结构编码),还编码CNN边之间的潜在关联,这可能提供额外的与个性相关的信息线索。为此,我们提出了一种新颖的多维边特征编码策略,将每对相连顶点之间的关系(边)表示为多维向量。具体而言,我们建议直接从顶点 V i , j V_{i,j} Vi,j和 V j , m V_{j,m} Vj,m生成边特征 E i , j , m = E R N ( V i , j , V j , m ) E_{i,j,m} = ERN(V_{i,j}, V_{j,m}) Ei,j,m=ERN(Vi,j,Vj,m),其中ERN是基于注意力的边关系网络。它以一对顶点的特征 V i , j V_{i,j} Vi,j和 V j , m V_{j,m} Vj,m作为输入,并输出包含与这两个顶点相关的任务特定关系特征的边特征 E i , j , m E_{i,j,m} Ei,j,m。ERN的详细过程如图6所示。需要注意的是,ERN和VEN均以端到端的方式与个性识别模型联合训练。这样,它们能够从探索到的特定于个人的CNN的参数和架构中学习生成与个性相关的顶点和边特征(即个性相关特征)。

人格识别

在本文中,每个受试者的人格特质是通过该受试者特定CNN的图表示来识别的。我们将人格识别建模为一个多任务图回归问题(联合识别5种人格)。具体而言,我们采用最先进的残差门控图卷积神经网络(残差GatedGCN)作为人格识别模型来处理生成的图表示,因为它是能够处理异构图和包含多维边特征的图的最先进的图神经网络(GNN)模型。我们经验性地使用了一个包含六个GatedGCN层的网络(详细设置见补充材料)。然后,在最后一个GatedGCN层后附加两个全连接(FC)层以连接所有生成的顶点特征,每个FC层之后均跟随ReLU激活函数和 dropout(0.3)。输出层的大小设置为5,以联合识别外向性(Ext)、宜人性(Agr)、开放性(Ope)、尽责性(Con)和神经质(Neu)这五种个性特质。

实验

数据集

人类-人类互动:NoXi数据集。所有参与者均使用Saucier的Mini-Markers对其大五人格特质进行了自我评估。

人类-机器互动:我们在虚拟人类问卷(VHQ)数据库上进行了人机实验。具体而言,一个虚拟人类代理面试官直接投影在参与者面前提问,这是通过ARIA-VALUSPA平台实现的。大五人格特质的自报告标签是通过要求参与者在线填写BFI-44问卷获得的。

实现细节

-

Persons-specific CNN:NoXI数据集:多模态个性化CNN(卷积神经网络)每个编码器包含6个单元(1个预定义卷积单元、3个下采样单元和2个常规单元),每个解码器包含5个单元(2个常规单元和3个上采样单元)。所采用的LSTM(长短期记忆网络)具有3个隐藏层。在神经架构搜索过程中,输入说话者的视听信号持续80帧,听者的候选真实值包含105帧,延迟因子r的范围为0至25帧,即选择80个连续帧作为最终反应。VHQ数据集:由于音频数据非常嘈杂,我们仅为每个主体搜索单模态特定人物CNN,该网络以虚拟人类的面部特征点作为输入,旨在重现目标主体的面部反应。我们注意到,在交互过程中虚拟人类仅说出一组预定义的句子。因此,我们将所有句子分为4类:与抑郁相关的问题、与焦虑相关的问题、与人格相关的问题以及其他句子(例如,虚拟人类要求主体重复答案),然后将每类句子编码为一个独热向量(例如,1000、0100、0010和0001)。因此,在VHQ数据集中探索的多模态CNN通过在编码器的最后一层全连接层将深度学习得到的虚拟人类面部特征与提出的句子类别特征进行拼接来实现。

-

NAS(Neural Architecture Search):每个数据集的所有个性化CNN均采用相同的初始架构和参数,其中OPs和LWs采用Xavier策略进行初始化。同时使用相同的训练策略来获取每个数据集中所有个性化CNN。具体而言,在每个个性化CNN的搜索过程中,我们根据相应视频中的时间戳将面部标志点序列输入到每个CNN中,即从视频开始到视频结束。这不仅确保了CNN的OPs和LWs在搜索过程中始终收敛到特定视频的同一组值,而且还确保了各个探索的特定人员CNN之间的差异仅受特定人员反应的影响,而非权重初始化或用于搜索的帧顺序。在搜索过程中,批处理大小设置为60个视听片段,同时独立使用2个Adam优化器联合调整OPs和LWs,其学习率分别为0.05和0.001。

-

训练:NoXI数据集:12折的被试无关交叉验证。对于每一折,使用154个视频进行训练和超参数优化,14个视频用于测试(每个被试仅出现在训练集或测试集中,不同时出现)。VHQ数据集:留一被试交叉验证。对于每一折,使用154个视频进行训练和超参数优化,剩余的视频用于测试。对于NoXI和VHQ两个数据集,我们报告了所有折次测试集上的准确率平均值。本文中的所有实验均在PyTorch平台上使用Nvidia V100 GPU进行。

评价指标

皮尔逊相关系数(PCC)、平均准确率(ACC)

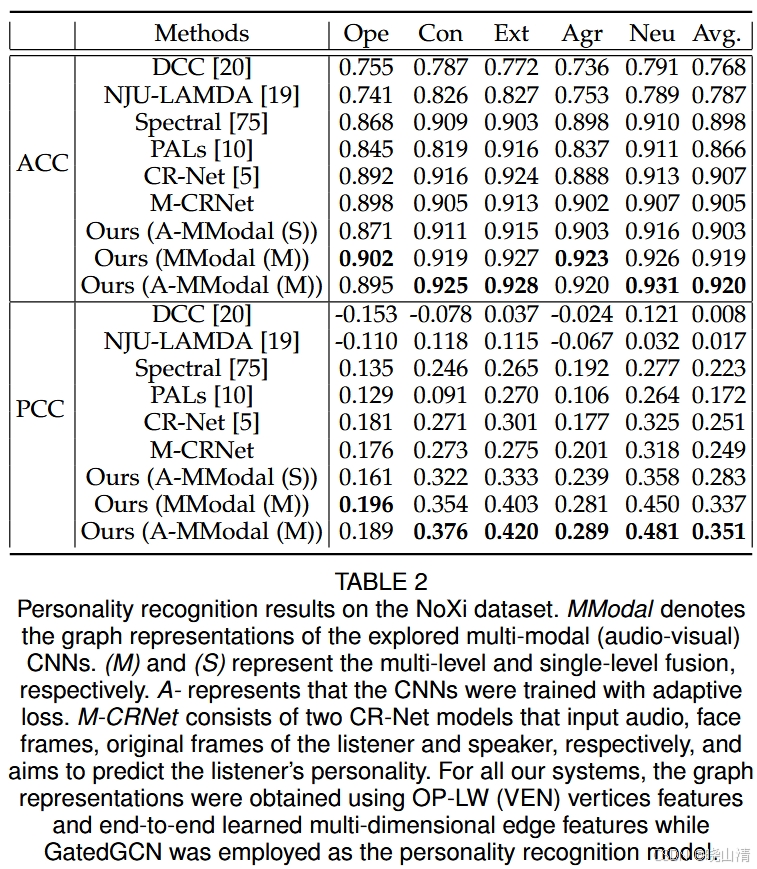

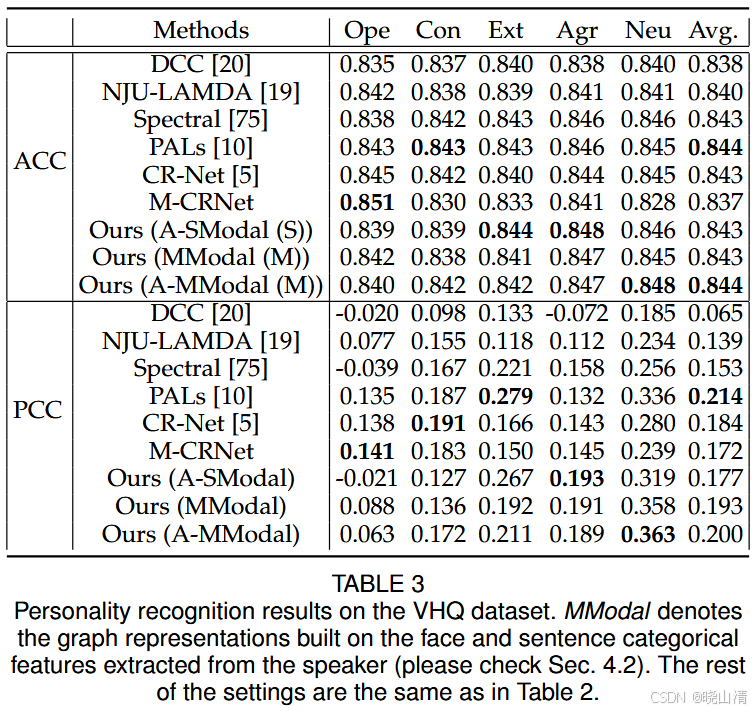

比较

需要注意的是,我们的方法在人机交互场景中的优势不如人际交互场景明显。这可以通过以下事实来解释:VHQ数据集中使用的虚拟人仅具有有限的非言语面部行为,而NoXI数据集中的真实人类说话者则更为丰富。因此,在人机交互场景中,听者的面部反应可能与虚拟人所表达的非言语行为相关性较低。

消融实验

- 个性化CNN:模态、参数共享策略、损失函数

- 图表示:点特征表示、边特征表示

结论与未来工作

本文提出了首个从自动探索的个性化CNN架构及参数的图表示中识别真实人格特质的工作,其中每个CNN通过个性化面部反应模拟每个目标主体的认知。我们的方法在不同性质的数据集(即在人际互动与人机互动场景下录制的数据集)上进行了评估,取得的结果表明以下结论:

(i) 个性化CNN的图表示与目标主体自报的人格特质呈正相关,这表明我们方法探索的CNN可能具有与其对应主体相似的“人格”;

(ii) 与大多数直接从目标主体非言语行为预测人格的现有APP方法相比,所提方法具有明显优势,证明了从主体的模拟认知中识别自报(真实)人格的可靠性;

(iii) 所提方法学习到的图表示在两种互动场景下对识别外向性(Ext)和神经质(Neu)特质均具有特别重要的信息价值;

(iv) 在人际互动场景下,所提方法在人格识别和面部反应预测方面的表现优于人机互动场景,这表明人类说话者表达的非言语行为更能触发听者的与人格相关面部反应;

(v) 许多人类人口统计学属性(如年龄、性别、教育水平和人际关系)会影响所提方法的性能,其中性别和年龄是最具影响力的因素。这是因为由于这些因素,相同意图或情绪的面部反应可能存在差异;

(vi) 在多种技术设置中,所提的自适应损失函数、独立参数策略以及端到端顶点/边特征学习策略极大地提升了人格识别性能。

本工作的主要局限有:1.为每个主体搜索独特的CNN架构需要相对较长时间,即所提方法的训练和推理时间预计长于大多数现有方法。因此,它可能不适用于快速人格评估需求。2.我们仅使用了视听模态,而忽略了其他人类信号,如心理信号(脑电图、心率、皮肤温度等)和言语信息,这些信号对个体的沟通和反应贡献了重要信息。

因此,一个潜在的未来方向是加速个性化认知模拟算法,使其无需从头开始为每个人搜索个性化的CNN。然后,添加其他模态(如言语信号、心理信号等)可能使CNN在二元互动中更接近目标主体的认知,其中对话响应生成可用于预测听者的言语反应。原则上,所有这些模态都可以通过所提的融合模块结合,即在多个层次上进行融合,因为每种模态都会受到其他模态的影响。当然,仍有一些特定于模态的问题需要解决。同时,从应用角度来看,本工作为从个性化认知过程的模拟中预测和识别社会情感现象(如人格、情感、参与度等)开辟了新的研究途径,这将对包括神经科学、认知科学、行为科学和情感科学在内的相关领域产生进一步影响。另一项未来工作将重点扩展和评估我们的方法,以在临床环境中使用领域特定损失函数分析心理健康或其他人类内部状态,即用CNN参数表示它们,或创建数据驱动的机器人教练,能够在二元互动中表达个性化行为。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)