多Agent实战搭建指南(非常详细),打造个人AI团队从入门到精通,收藏这一篇就够了!

上周服务器做了一个有趣的实验:让三个不同的AI助手同时运行,它们各自负责不同的工作领域。

这个想法源于一个实际问题:单Agent处理多任务时,经常会出现状态混乱。

写文章时突然切换到代码调试,语气和风格立马就变了。上下文被各类对话混杂在一起,效率反而下降。

于是我做了个大胆的尝试:给每个工作类型配置独立的Agent。

一个月跑下来,效果远超预期。

今天分享这套多Agent配置方案,重点讲讲bindings这个关键机制。

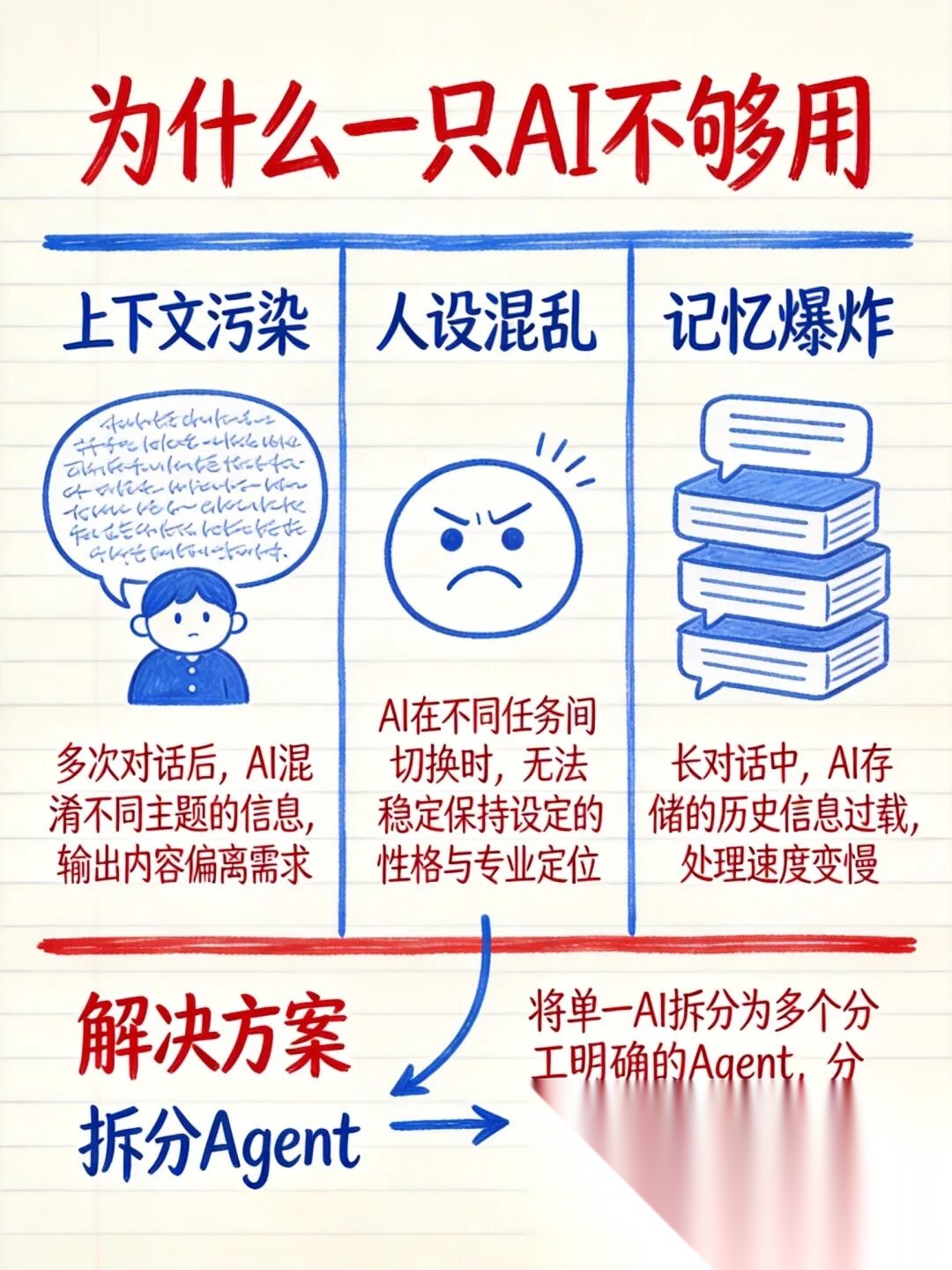

单Agent的瓶颈

最早也是用一个Agent搞定所有任务,从内容创作到技术支持,甚至日常运营都丢给它。

但很快暴露了三个明显的问题:

上下文干扰严重

最典型的情况是在写作过程中插入技术问题讨论。AI回答完技术问题后,继续写文章时,风格和语气都出现了明显偏差。

对话历史里混杂了各种不同类型的内容,模型很难准确判断当前应该采用什么语气和表达方式。

人设边界模糊

给Agent设定的初始人设是"轻松口语化的写作助手",但这个属性会贯穿所有对话场景。

即使是代码调试或数据分析,它也会用同样的语气去处理,专业性明显不足。

记忆压力过大

单一Agent承载所有对话记录,上下文窗口快速填满。Token成本激增,而且历史对话会干扰新任务的判断。

多Agent的核心逻辑

OpenClaw的多Agent实现其实相当直观,关键在于bindings这个路由机制。

简单理解就是:为不同的对话场景指定对应的Agent实例。

比如我的配置是:

- 内容创作群 → 写作专用Agent

- 数据分析群 → 运营分析Agent

- 技术支持群 → 代码调试Agent

每个群组绑定不同的Agent,但它们共享同一个OpenClaw实例。

消息进入后,系统会根据bindings配置自动分发到对应的Agent处理。

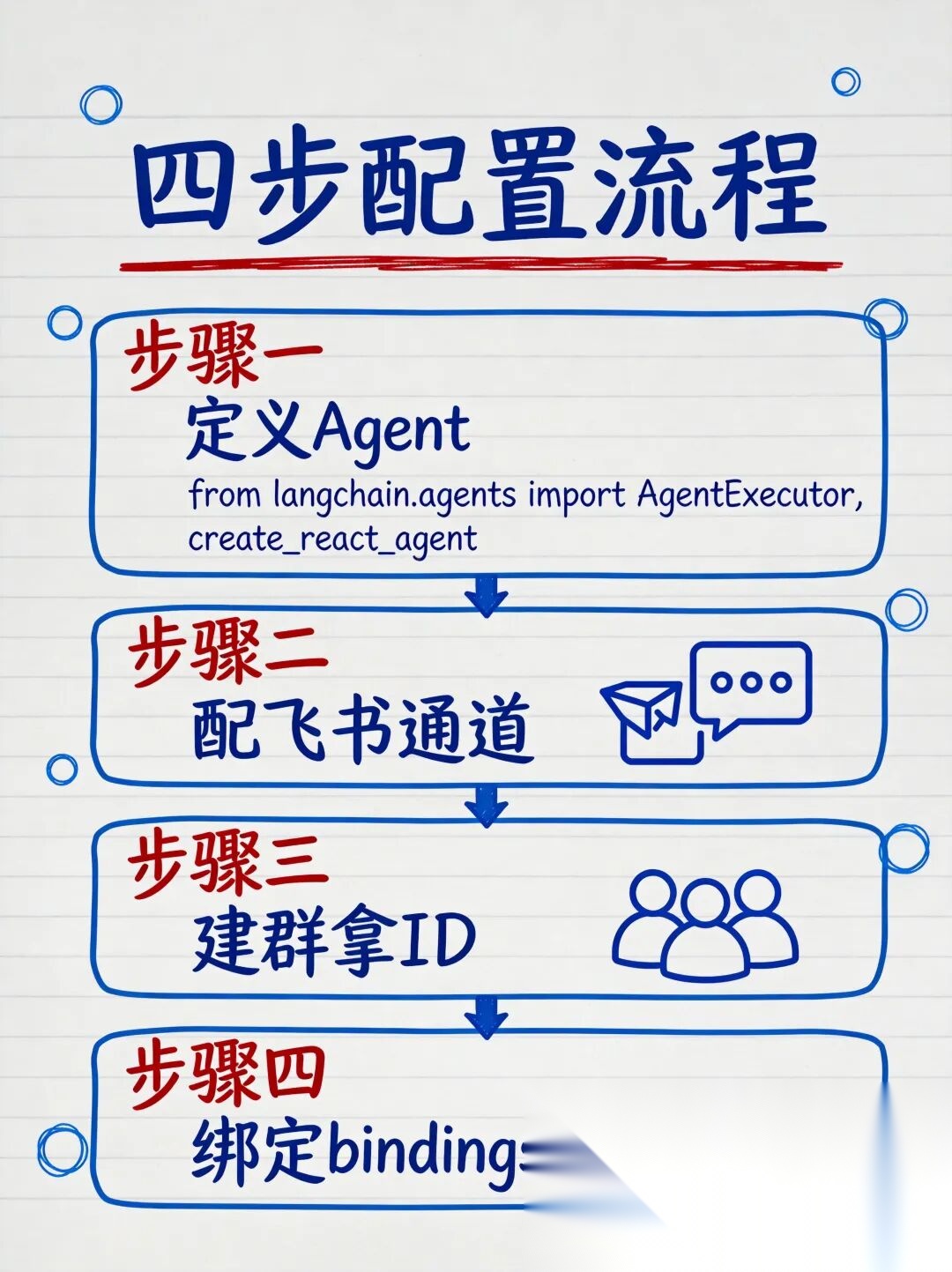

实操配置步骤

整个配置过程可以拆分为四个主要环节。

建议在操作前先用代码生成工具辅助编写配置文件,避免手动输入导致的语法错误。

配置Agent定义

在OpenClaw的配置文件中,需要明确每个Agent的属性:

| json |

{ "agents": { "list": [ { "id": "content_creator", "name": "content_creator", "workspace": "/root/.openclaw/workspace-content", "identity": { "name": "内容助手", "theme": "内容创作与编辑", "emoji": "📝" } }, { "id": "data_analyst", "name": "data_analyst", "workspace": "/root/.openclaw/workspace-data", "identity": { "name": "数据助手", "theme": "数据分析与运营", "emoji": "📊" } } ] }}

配置要点:

- workspace路径必须独立,确保不同Agent的数据互不干扰

- identity信息会被注入到系统提示词,直接影响Agent的输出风格

- 可以为不同Agent指定不同的模型参数,平衡效果与成本

配置即时通讯通道

以飞书为例,需要先在开放平台创建应用,然后在OpenClaw中配置:

| json |

{ "channels": { "feishu": { "appId": "cli_xxx", "appSecret": "xxx", "connectionMode": "websocket", "groupPolicy": "open", "requireMention": false } }}

两个关键参数:

-

groupPolicy: "open":允许所有群组接入,无需逐一添加白名单

-

requireMention: false":群内消息直接触发,无需@机器人(高活跃群组建议开启)

建立群组并获取标识

在即时通讯平台创建对应的群组,将机器人加入后,需要获取每个群组的唯一标识符。

有两种常用方式:

- 日志查看法:在群内发送测试消息,然后查看OpenClaw日志

- API调用法:通过平台提供的接口获取群组列表

实践来看,日志查看法更快捷,无需编写额外的API调用代码。

配置绑定规则

使用获取到的群组ID,建立Agent与群组的对应关系:

| json |

{ "bindings": [ { "agentId": "content_creator", "match": { "channel": "feishu", "peer": { "kind": "group", "id": "oc_content_group_id" } } }, { "agentId": "data_analyst", "match": { "channel": "feishu", "peer": { "kind": "group", "id": "oc_data_group_id" } } } ]}

配置完成后重启Gateway服务,即可开始使用。

不同群组的消息会自动路由到对应的Agent,实现真正的场景隔离。

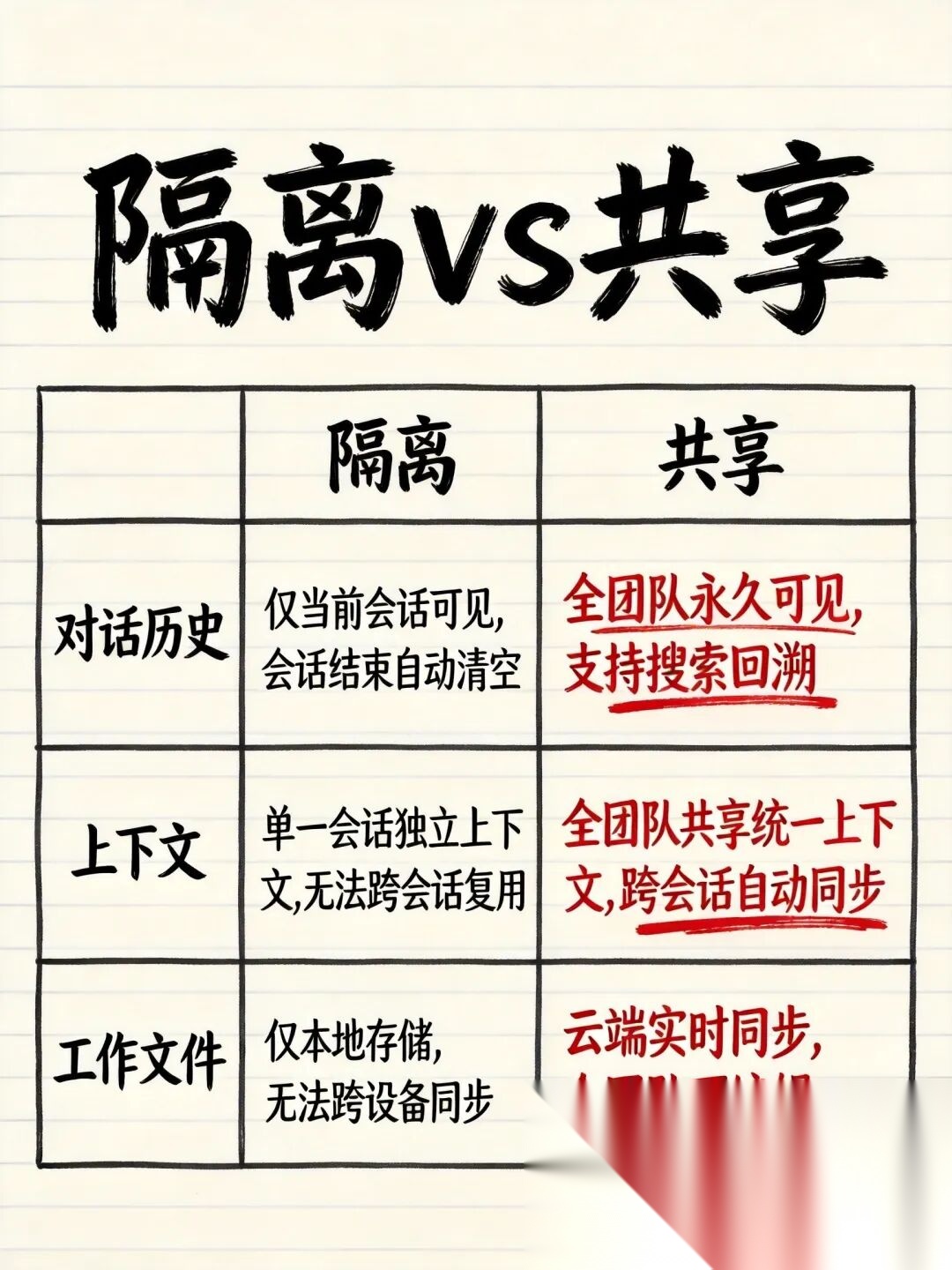

数据隔离与共享机制

多Agent部署后,一个常见疑问是:不同Agent之间是否能够互相访问彼此的数据?

OpenClaw的设计逻辑是:对话层完全隔离,数据层可控共享。

完全隔离的部分

-

对话历史记录

:每个Agent的聊天记录独立存储,互不可见

-

上下文状态

:每个对话会话有独立的Session ID,格式为

agent:xxx:platform:type:id

可配置共享的部分

-

文件系统

:如果多个Agent指向同一个workspace目录,可以访问相同的文件资源(不推荐,容易冲突)

-

长期记忆

:通过配置共享的记忆目录,可以实现跨Agent的知识复用

推荐的做法是为每个Agent分配独立的workspace,需要共享的数据通过软链接或同步工具进行管理。

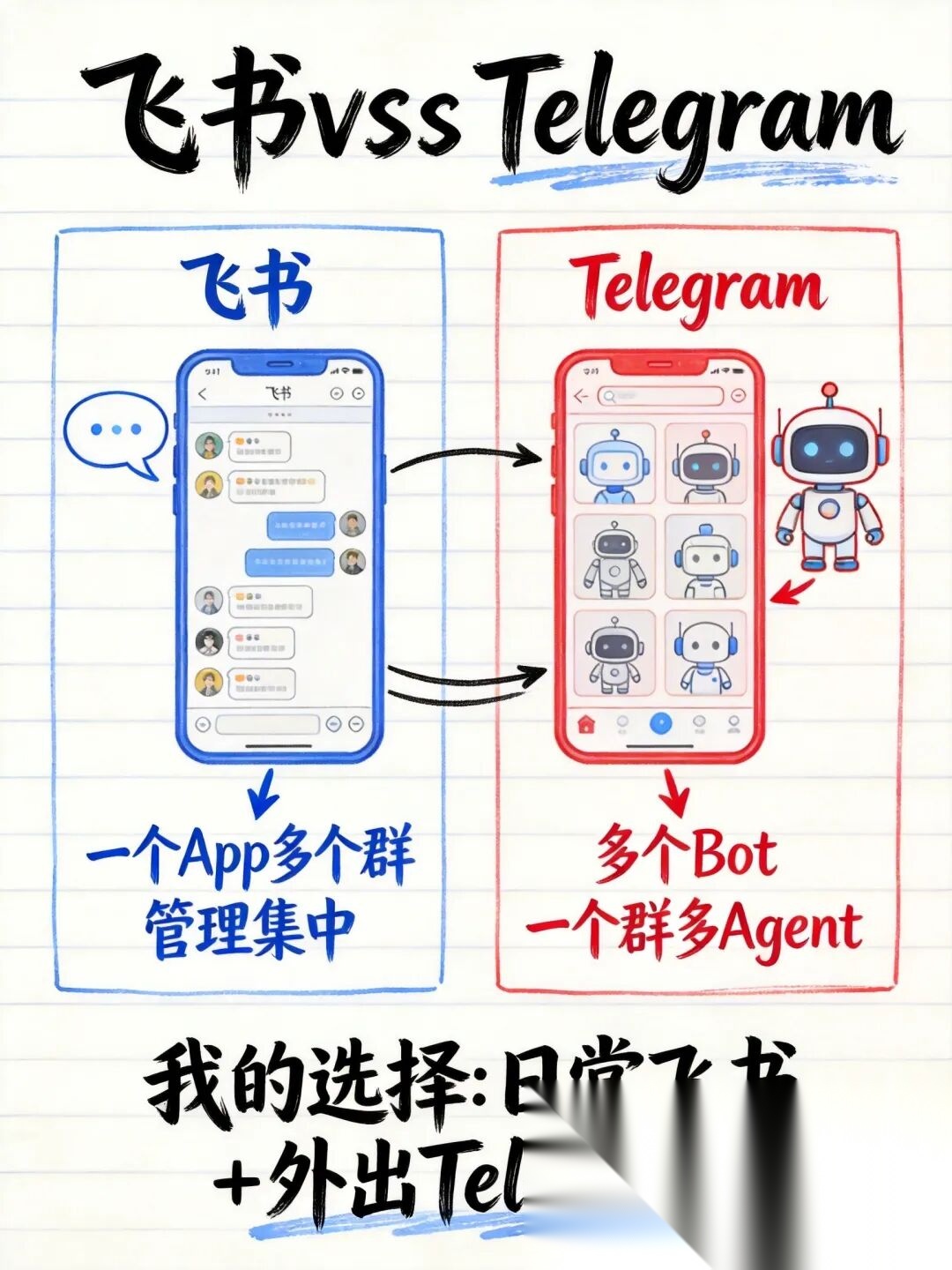

多平台适配策略

我在实际使用中同时接入了飞书和Telegram两个平台,它们的实现方式有明显差异。

飞书方案

-

实现方式

:单个应用实例 + 多个群组

-

优势

:权限管理集中,运维成本低

-

适用场景

:企业内部协作,已有飞书生态

Telegram方案

-

实现方式

:多个Bot实例

-

优势

:单个群组内可同时调用不同Agent,灵活度高

-

适用场景

:个人使用,需要快速切换不同Agent

我的实际部署策略是:办公环境使用飞书,移动办公使用Telegram。两侧Agent配置保持同步,但对话记录相互独立。

需要特别注意的是,飞书群聊模式下不支持斜杠命令,这一点与Telegram的行为有差异。

实战调优技巧

经过一个月的实际运行,总结出几个关键的优化点。

差异化模型配置

不同类型的任务对模型能力的要求差异很大,应该针对性选择:

- 内容创作:Claude Opus,长文本生成质量更高

- 数据分析:豆包/GLM,性价比优秀,常规任务足够

- 代码调试:Claude Sonnet,编程能力与成本平衡良好

实测混合配置的月度成本约为全Opus配置的30%。

工作空间严格隔离

初期尝试过共享workspace,结果导致文件冲突和数据覆盖问题。

必须确保每个Agent拥有独立的工作目录,数据共享通过专门设计的同步机制实现,而不是依赖共享目录。

人设文件持续优化

每个Agent的workspace中都应该配置详细的SOUL.md文件,明确定义:

- 角色定位和行为准则

- 特定场景的处理规范

- 输出风格和语言偏好

这不是一次性的配置工作,需要根据实际使用情况持续迭代调整。Agent的表现会随着SOUL.md的优化而逐步改善。

路由规则的灵活应用

bindings的匹配机制比表面上看更灵活,可以实现多种场景的精细化控制:

- 私聊默认路由到主Agent

- 特定群组路由到专用Agent

- 特定用户的消息路由到指定Agent

匹配规则按顺序执行,建议将具体性强的规则放在前面,通用规则放在后面。

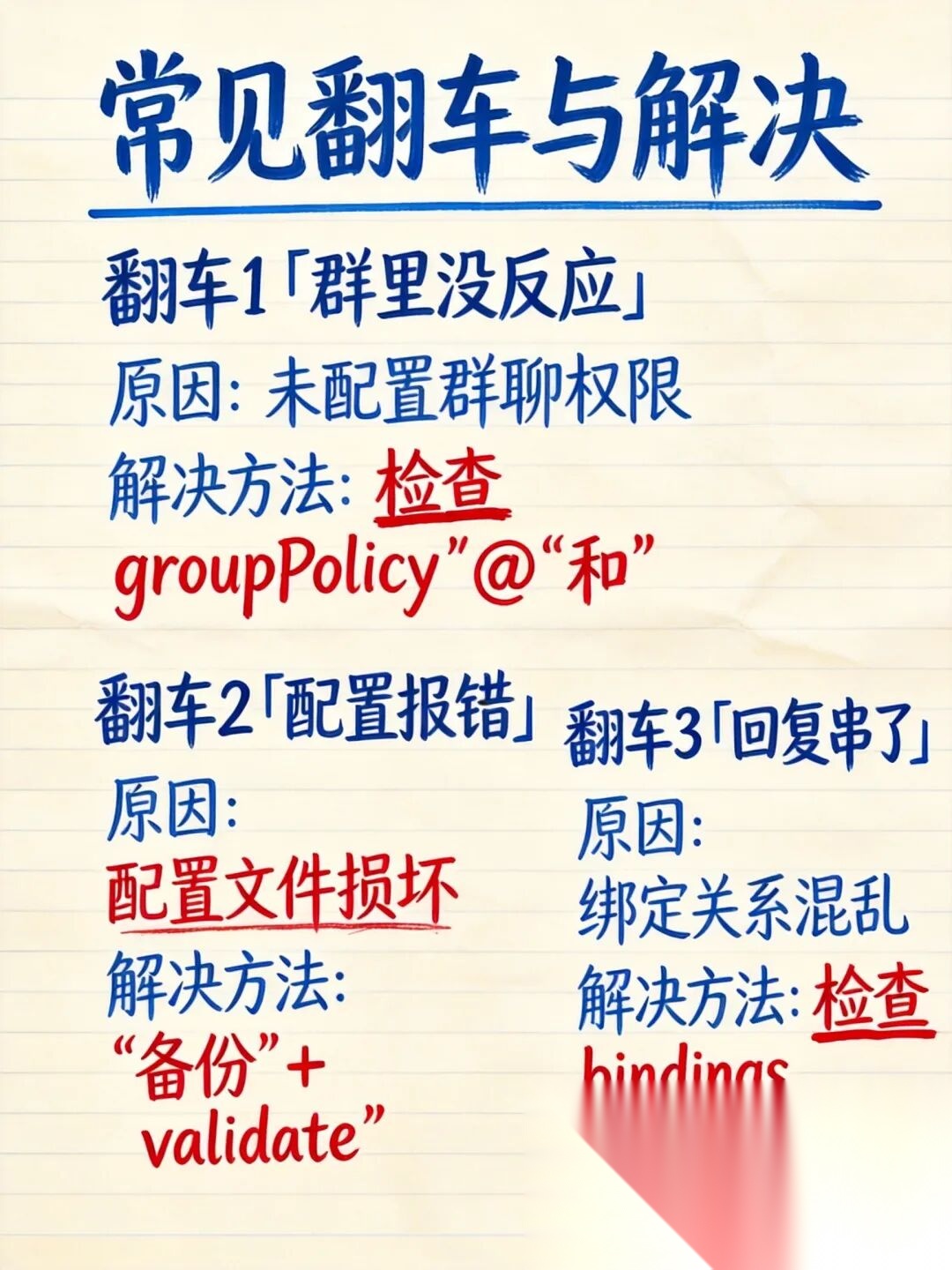

常见问题排查

配置过程中遇到了一些典型问题,这里汇总解决方案。

消息无响应

大部分情况是groupPolicy配置问题,或者requireMention设置为true但用户没有@机器人。

排查步骤:

- 检查日志中是否有

received message记录 - 如果有收到消息但无

dispatching记录,说明bindings配置有问题 - 如果连接收记录都没有,需要检查飞书应用的权限配置

配置加载失败

JSON格式错误是最常见的失败原因,特别是逗号缺失或括号不匹配。

推荐操作流程:

| bash |

# 备份原配置cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# 修改后验证openclaw config validate# 验证通过再重启

Agent身份错误

出现A群组的消息由B风格的Agent回复的情况,通常是群组ID绑定错误。

检查bindings配置中的peer.id是否正确对应了目标群组的chat_id。

另外需要注意私聊场景的绑定配置,如果未配置私聊路由,默认会fallback到主Agent。

实际部署方案

最终稳定的配置方案如下:

- Agent数量:3个

- content_creator(Claude Opus):内容生产

- data_analyst(豆包/GLM):数据分析与运营

- tech_support(Claude Sonnet):技术支持与兜底

- 飞书接入:3个群组分别绑定对应Agent,私聊路由到tech_support

- Telegram接入:2个独立Bot,分别对应content_creator和data_analyst

- 成本结构:服务器成本100元/月 + API调用200-400元/月,相比全Opus配置节省超过50%

这套系统稳定运行近一个月,最明显的感受是每个Agent的专业度都有了明显提升。

这并非模型能力的变化,而是上下文环境更加纯粹。每个Agent的对话历史都高度聚焦,模型能够更准确地理解和执行任务。

专业化分工带来的效果提升是显著的。

总结

多Agent配置的核心其实很简单:明确定义、场景绑定、路由分发、持续优化。

但配置完成只是起点,真正决定系统价值的是后续对每个Agent的精细化调教。

这个过程有点像带新人——你需要清晰地告诉它期望什么、避免什么、遇到各种情况应该如何处理。

指令越明确,执行越精准。

如果你已经在使用OpenClaw,强烈建议尝试多Agent部署。这就像给个人工作室配齐了不同岗位的助手,各司其职,效率翻倍。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献148条内容

已为社区贡献148条内容

所有评论(0)