国产大模型登顶全球榜单,这次我为什么没有跟着鼓掌

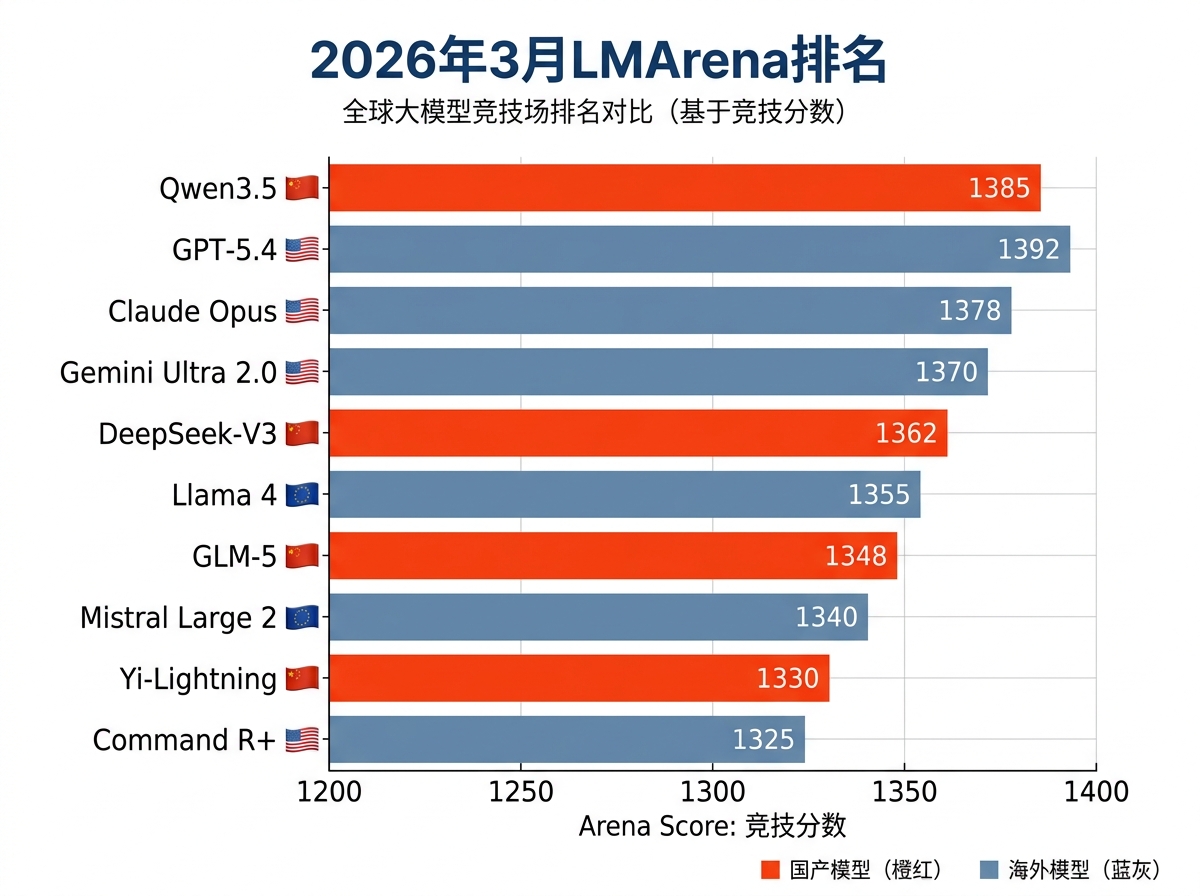

3月20日,LMArena发了最新一期榜单,阿里的Qwen3.5-Max-Preview拿了1464分,全球第六,中国第一,把GPT-5.4、Claude Sonnet 4.6、Grok 4.1这些名字全部压在了下面。

AI圈子当天沸了。朋友圈开始有人转,标题都是"国产模型杀疯了"、"历史性突破"、"中国AI正式追上"。

我盯着那张排名图看了好一会儿,说实话,有点感慨,但感慨的内容和你们想的可能不一样。

先说数据层面真实的进步是多大。

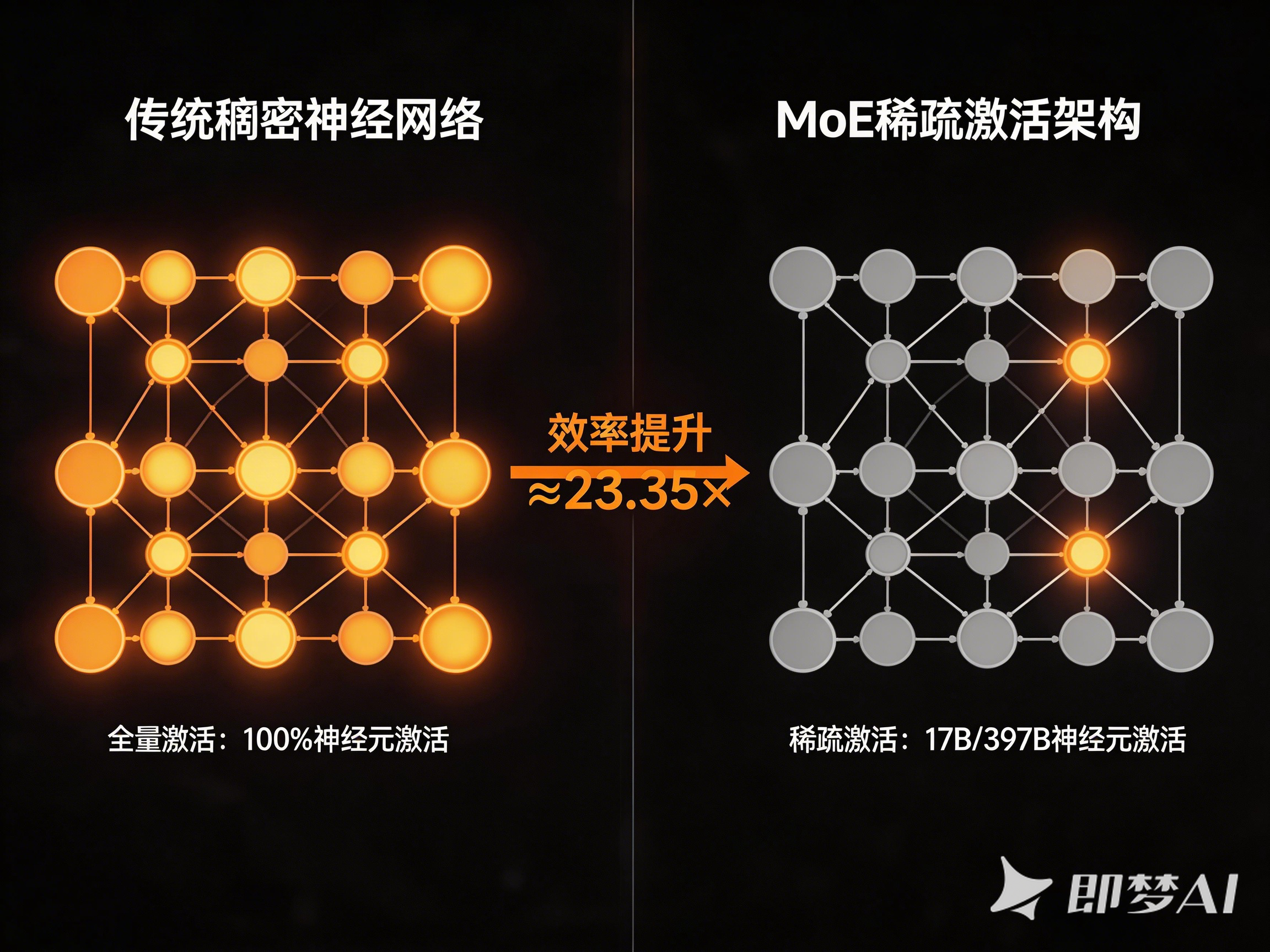

Qwen3.5-Max-Preview这次用的是稀疏MoE架构,总参数397B,但每次推理只激活17B——这个数字是核心。17B激活参数意味着什么?意味着它调用的算力规模,大约等于一个入门级的语言模型,但性能跑到了旗舰级别。

具体来说,32K上下文吞吐量提升了8.6倍,256K上下文吞吐量提升了19倍,显存占用相比上一代降低了60%。KV Cache通过16:1的分组查询注意力机制,压缩到了原来的6.25%。

这些数字不是市场部拍的,是可以在实际推理成本上验证的东西。换句话说,Qwen3.5这次的技术路线选择是对的——不是堆参数,而是把效率逼到极限。

在LMArena的细分项里,数学能力进了全球前五,专家级文本处理进了全球前十。整个阿里千问团队因为这个成绩,在公司级排名里拿到了全球第五、国内第一。字节跳动排全球第六,智谱第七,月之暗面第八,百度第九——中国前五大AI实验室,全部进了全球前十。

这是2026年,三年前还在讨论"能不能做出GPT-2水平的中文模型"的时候,没几个人会相信这种局面会这么快出现。

但我觉得有一个问题需要认真说清楚:LMArena的分数,到底在测什么?

LMArena的机制是盲测投票——两个模型各生成一段回答,用户在不知道是谁的情况下选哪个更好。听起来很公平,实际上存在一个底层逻辑:这个榜单测的是"更讨用户喜欢",而不是"更有能力"。

举个具体的例子:如果你让两个模型写一段营销文案,其中一个更会用排比句、节奏感更强,另一个更准确但相对平淡,大多数普通用户会投前者的票。但如果你要评估哪个模型更适合做代码审查或者科研文献分析,结果可能完全相反。

Qwen系列一直有个公认的特点:中文理解极好,创意写作流畅,表达方式有亲切感——这些特质在LMArena这种以"语言质量感知"为核心的评测里,天然有优势。这不是黑,这是它的真实长板。

但问题是,上下文处理能力、复杂推理的稳定性、边缘case的容错率、代码执行的精确度——这些才是真实业务场景里最容易出事的地方。而这些能力,在盲测投票机制下很难被充分暴露。

我周末拿Qwen3.5和Claude Opus 4.6做了一个不算严格的对比。任务是:给一段2000字的合同,找出其中三处对乙方不利的条款,并建议修改方向。

Qwen3.5的回答流畅,格式好,三处条款都找到了,建议也写得很像一回事。Claude的回答没那么好看,但它额外标注了一处我没要求它找的潜在风险——一条关于违约金计算方式的表述,如果按字面解读对乙方非常不利,但措辞比较隐蔽。

我没办法用这个说谁强谁弱,样本太小。但我想说的是,在LMArena的盲测里,大多数用户拿到Qwen3.5那段回答会直接满意,而Claude多出来的那个发现,很可能在投票环节里根本不会被注意到。

"讨用户喜欢"和"在关键时刻更可靠"是两件不同的事。

当然,我不是要泼冷水。

真正让我觉得这次Qwen3.5有意义的,不是那个排名数字,而是背后的技术逻辑。稀疏MoE这条路选对了。它意味着中国的大模型正在进入一个新阶段:不再靠堆算力追别人,而是在效率上找到自己的出路。

这对中国AI生态的意义,其实比登顶某个榜单要大得多。

因为算力这件事上,客观说国内现在还有瓶颈——A100/H100的供给问题没有完全解决,自研芯片还没到完全可以撑起旗舰训练的阶段。如果模型技术路线本身就是"参数越大越好",那就是一场从起跑线就输掉的游戏。

但稀疏MoE告诉你,参数量不是唯一的维度。397B总参数、17B激活参数、接近OpenAI旗舰级别的测评成绩——这个组合本身就是一种方法论的胜利,不只是数字的胜利。

海外开发者现在有47%在用Qwen系列,不是因为爱国,是因为它在API成本和性能之间的比值,确实有竞争力。

还有一件事值得单独说一下。

Qwen3.5-Max-Preview现在还是预览版,正式版还没出。这个"预览版"三个字很有意思——能出来打榜,说明技术准备充分了;但留个"预览版"名头,意味着正式版还有空间。

对比一下DeepSeek,V4一等再等,4月才发布,36氪那篇分析说得挺准——研发目标已经从"发模型"变成了"做系统工程",要解决长期记忆、工具调用、工作流闭环这些问题。这是更难的活,但不发布就在排行榜上没声音。

现在Qwen抢先占了榜单的话题度,DeepSeek V4的正式亮相就要面临"我比榜单更强"的压力。4月的国产大模型正面PK,会比这次更热闹。

所以,真的追上了吗?

有些维度,真的差不多了。中文能力,长文本处理,开源生态,API定价竞争力——这些方向上已经可以正面竞争。

但有些维度还有真实的差距。尤其是推理的稳健性、复杂工具调用的可靠性、在真实生产环境中长期运行的稳定性——这些东西不会体现在盲测分数里,只会出现在你某天凌晨两点催一个重要任务的时候。

我的判断是:Qwen3.5这次是中国大模型里迄今为止最有说服力的一次登顶,但它登的那座山,并不是最终的那座。

好奇问一下:你平时工作里有在用Qwen系列或者其他国产大模型吗?和海外模型比,体验上最明显的差异在哪里?

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)