别让 AI 糊弄你:我的 Claude Code 防翻车指南

一包烟一壶水一个 Claude Code,玩一天

AI 写代码这事,我被坑惨过。

写完的接口一跑全是 bug,分页传个负数直接 500。让它自己写测试?测试全绿,上线照炸。在 CLAUDE.md 里写了一堆规矩约束它,聊久了上下文一压缩,规矩全忘光,说难听点就是压缩成傻逼了。

但我现在每天还是一包烟一壶水,Claude Code 从早开到晚,基本写完就能用。

中间发生了什么?往下看。

先说最值钱的部分:怎么让 AI 写的代码不炸

我知道你可能不关心我用了什么 skill 什么 agent,你关心的是:怎么让这玩意写出来的东西能用。

我也是。所以先说这个。

CLAUDE.md 管不住它

最开始我以为在 CLAUDE.md 里写一堆规矩就行了。代码风格、架构规范、什么不许干,写得清清楚楚。

前几轮对话确实管用。但聊久了上下文一压缩,你精心写的那些约束,它觉得不重要直接给你扔了。压缩完跟没写一样。

教训:CLAUDE.md 只能管短对话。长对话靠它等于没靠。

让它自己测自己?别逗了

AI 写完代码我自己跑,一跑一堆 bug。那让它自己写测试自己跑?

更离谱。它写的测试就是走个过场,覆盖不全,边界不管,异常不测。有一次一个分页接口,它测了正常查询能返回数据就算过了。页码传负数?没测。传零?没测。传个 999999999?没测。上线直接 500。

自己测自己,跟自己批改自己作业一个道理。

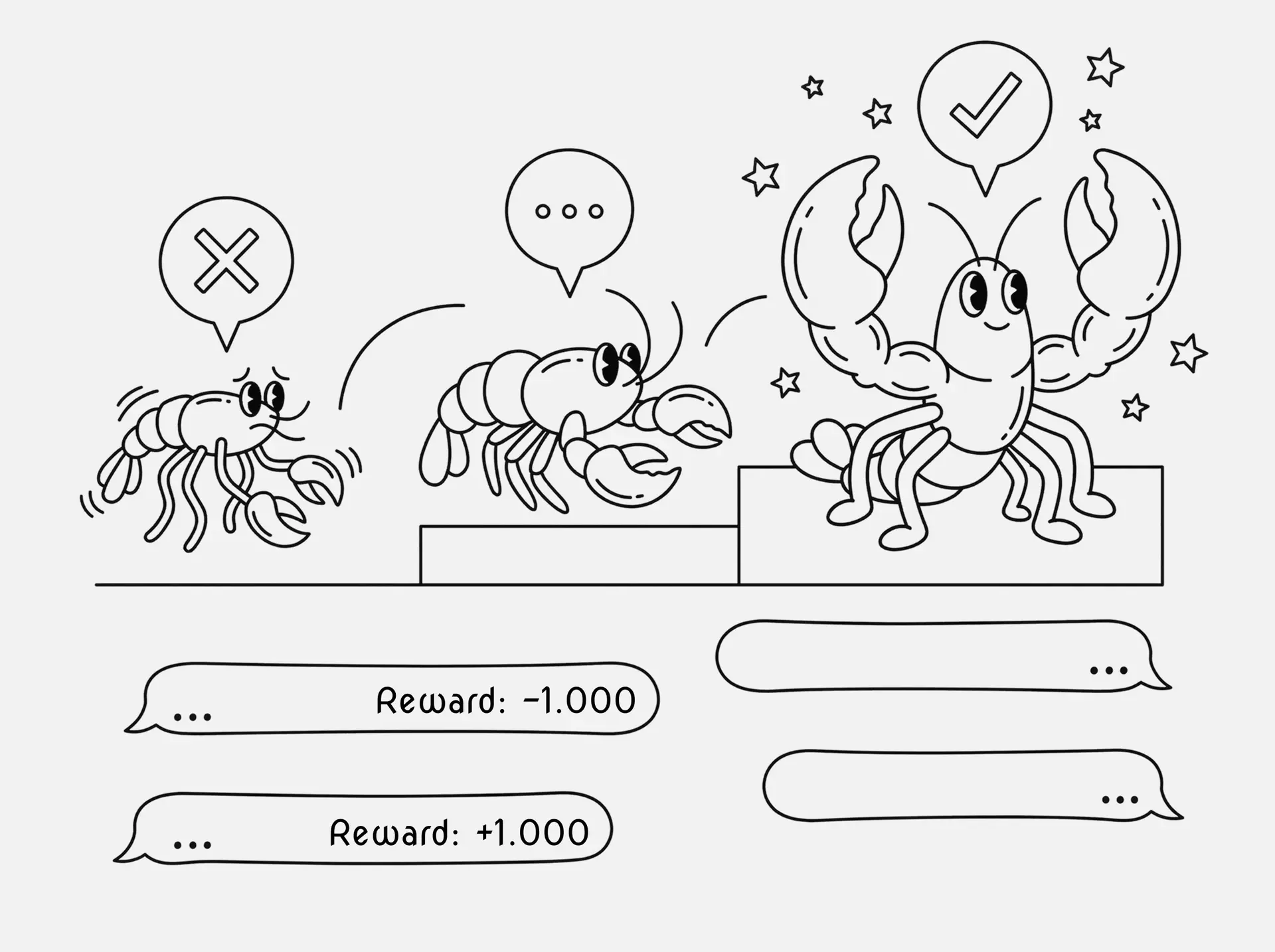

转折点:专业术语 + 质量检测 + 测试模板

后来我去研究了专业的测试方法论,发现一个关键的事:

你跟它说"测一下",它就随便糊弄。你说"写端到端测试、边界测试、异常路径测试",它就认真了。

不是它故意偷懒。是"测一下"这三个字信息量太少,它不知道你要测到什么程度。专业术语等于给它划范围。

但光有术语还不够。我又加了两样东西:

代码质量检测 — lint、类型检查、复杂度分析、安全扫描。AI 写完代码先过一遍,不过的打回去。

测试模板 — 正向测试、异常测试、边界测试、异步测试、集成测试、回归测试,每种都有模板。AI 照着模板写,想糊弄都难。

这套东西我整理成了开源仓库,直接拿去用:

https://github.com/zqt996/project-templates

具体怎么用

Java 项目:仓库里有一套质量检测配置,PMD(阿里规范)、SpotBugs(bug 检测)、JaCoCo(覆盖率)、OWASP(安全扫描),复制到项目里一行命令跑完:

./quality-check.sh fast

# 报告在 target/site/index.html

在 CLAUDE.md 里加一句就行:

代码写完后运行 ./quality-check.sh fast,所有检查必须通过

Python 项目:同样的思路,Black、Flake8、Pylint、Bandit、MyPy、Radon,还有 pre-commit 集成:

./install.sh /path/to/your/project

./quality_check.sh app

测试框架:这个是重头。核心是三层验证,每个用例都要过三关:

# 第一层:前端操作

feedback_page.create_feedback("测试标题", "测试内容", "test@example.com")

# 第二层:API 验证

response = client.get("/api/feedbacks")

assert response.status_code == 200

# 第三层:数据库验证

result = db.fetch_one(

"SELECT * FROM feedbacks WHERE user_name = %s", ("测试标题",)

)

assert result["content"] == "测试内容"

前端看到的对不对、API 返回的对不对、数据库里存的对不对。三层全过了才算过。

模板里还集成了 Allure 报告,跑完自动生成带截图、录像、API 请求响应记录的完整报告。拿到项目里用就几步:

cp -r pytest-test-framework /path/to/your/project/tests

pip install -r requirements-test.txt

playwright install chromium

pytest

最狠的一步:只认报告

质量检测和测试模板搭好之后,我又加了一条规矩:什么都不认,只认报告。

AI 生成的报告必须带完整证据链:操作视频、关键步骤截图、API 请求响应完整记录、后端日志截图、验证步骤说明。三层验证的结果全要体现在报告里。

报告有问题?自己回去改。我不翻代码,不手动验证,只看报告。

Playwright MCP 在这步帮了大忙,自动开浏览器操作截图录视频,全自动。

后来又上了 TDD

superpowers 插件里有现成的 /superpowers:test-driven-development。先写测试确认全挂(红灯),再写最小实现让测试过(绿灯),最后重构。费 token 但代码质量又上了一截。

有意思的是,这套东西加上去之后,哪怕换个比较菜的模型,出来的东西也还凑合。模板和检测兜底了,模型差点也不至于太离谱。

一句话总结:你得告诉 AI 怎么证明自己干对了。光让它写代码不行,得让它写代码、写测试、跑测试、出报告。不然它永远在糊弄你。

日常干活的工具

上面说的是怎么保证质量。下面说说日常怎么提效。

Skill

Claude Code 的 skill 就是预设工作流,斜杠命令触发。我常用的:

superpowers:test-driven-development # TDD

superpowers:systematic-debugging # 系统排查 bug

superpowers:writing-plans # 先写计划

superpowers:executing-plans # 按计划干

superpowers:dispatching-parallel-agents # 并行派子任务

superpowers:verification-before-completion # 干完先验证

superpowers:requesting-code-review # 代码审查

Agent

我做 Java 项目,最烦建完表之后那一套:实体类、Repository、Service、Controller、DTO。以前手写耗一下午,现在丢给它几分钟搞定:

基于这张表结构,生成完整 CRUD:

1. 实体类(JPA 注解)

2. Repository

3. Service + ServiceImpl

4. Controller(RESTful)

5. DTO 请求响应分开

use subagent 并行处理,减少上下文占用

use subagent 是关键词,拆成几个子 agent 分头干,主对话不会被撑爆。use team 更猛,一个 agent 写后端一个写前端一个写测试,适合大活。

MCP

MCP 是 Claude Code 的插件协议,接外部工具用的。这块我踩了不少坑才筛出来几个真正好使的,按使用频率排:

Playwright MCP — 用得最多,没有之一。前端写完它自己开浏览器点点点,截图录视频给你看。测试报告里的证据链全靠它。配置也简单,npx @anthropic-ai/mcp-server-playwright 就行。

Context7 — 查文档神器。问某个库怎么用,它直接拉最新文档和代码示例过来,不用自己翻官网。比你跟 AI 说"去查一下 xxx 文档"靠谱,因为它拉的是实时的。

数据库 MCP — 直接连库查数据。写完接口让它自己去数据库验证存对了没有,三层验证里的第三层就靠它。MySQL、PostgreSQL 都支持。

GitHub MCP — 操作 GitHub 仓库,看 issue、提 PR、查 commit 历史。配合代码审查工作流用。

Firecrawl MCP — 爬网页内容。需要参考某个网站的实现或者抓文档的时候用,比让 AI 自己瞎猜强。

Sequential Thinking MCP — 这个比较特别,不是接外部工具的,是让 AI 一步步思考而不是一口气回答。复杂问题的时候开着,回答质量明显不一样。

提示词

几个好使的:

- 复杂任务先让它写计划。我有一次让它重构一个模块,它上来就改了二十多个文件,思路不对回滚都费劲。从那以后大活必须先出方案。

参考 xxx 的实现方式。指个项目里已有的类似代码,它照着风格来,比从头描述需求靠谱。减少当前上下文占用。直接说,它会主动用 agent 而不是在主对话里堆代码。

模型和渠道

我用 Claude 4.5 和 4.6。国产模型试过,差太多,被 Claude 惯坏了回不去。跟吸毒似的,真不夸张。

渠道折腾了不少。买号不稳定,反代用量大了风控严,最后稳定在中转站。我用 cc switch 做渠道切换,主力挂了切备用。备用是原价号,但现在原价号也老被封,操了。实在不行国产顶一下。

一直在用的中转站:https://api.xstx.info ,体验还行。大家有低价靠谱的渠道也分享下。

写着写着断了是真难受。

文中提到的东西

| 东西 | 地址 | 干嘛的 |

|---|---|---|

| 模板仓库 | zqt996/project-templates | 测试模板 + 代码质量检测,复制到项目直接用 |

| Superpowers | Claude Code 内置 | TDD、调试、计划、代码审查等工作流 |

| Playwright MCP | microsoft/playwright-mcp | 浏览器自动化,截图录视频 |

| Context7 MCP | upstash/context7 | 查库文档,拉最新示例 |

| GitHub MCP | github/github-mcp-server | 操作 GitHub 仓库,PR、issue、commit |

| Firecrawl MCP | firecrawl | 爬网页内容,抓文档 |

| Sequential Thinking | modelcontextprotocol/servers | 让 AI 分步思考,复杂问题质量更高 |

| 中转站 | https://api.xstx.info | 我在用的 Claude API 渠道 |

一包烟一壶水,开着 Claude Code 能搞一整天。

模板仓库随便用,有问题提 issue。

一天不用真难受。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)