基于YOLOv8/YOLOv10/YOLOv11/YOLOv12与SpringBoot的犬种识别检测系统(DeepSeek智能分析+web交互界面+前后端分离+YOLO数据)

摘要

随着人工智能与计算机视觉技术的飞速发展,目标检测技术在社会生活、宠物管理及智慧城市等领域的应用日益深化。本项目设计并实现了一个集高效识别、智能分析与可视化交互于一体的智能犬种识别检测系统。系统核心采用当前主流且先进的YOLO系列目标检测算法,集成了YOLOv8、YOLOv10、YOLOv11及YOLOv12等多个版本模型,用户可根据实际场景对精度与速度的需求灵活切换。系统后端基于SpringBoot框架构建,采用前后端分离的现代化架构,前端提供友好的Web交互界面,数据库选用MySQL进行结构化数据持久化。

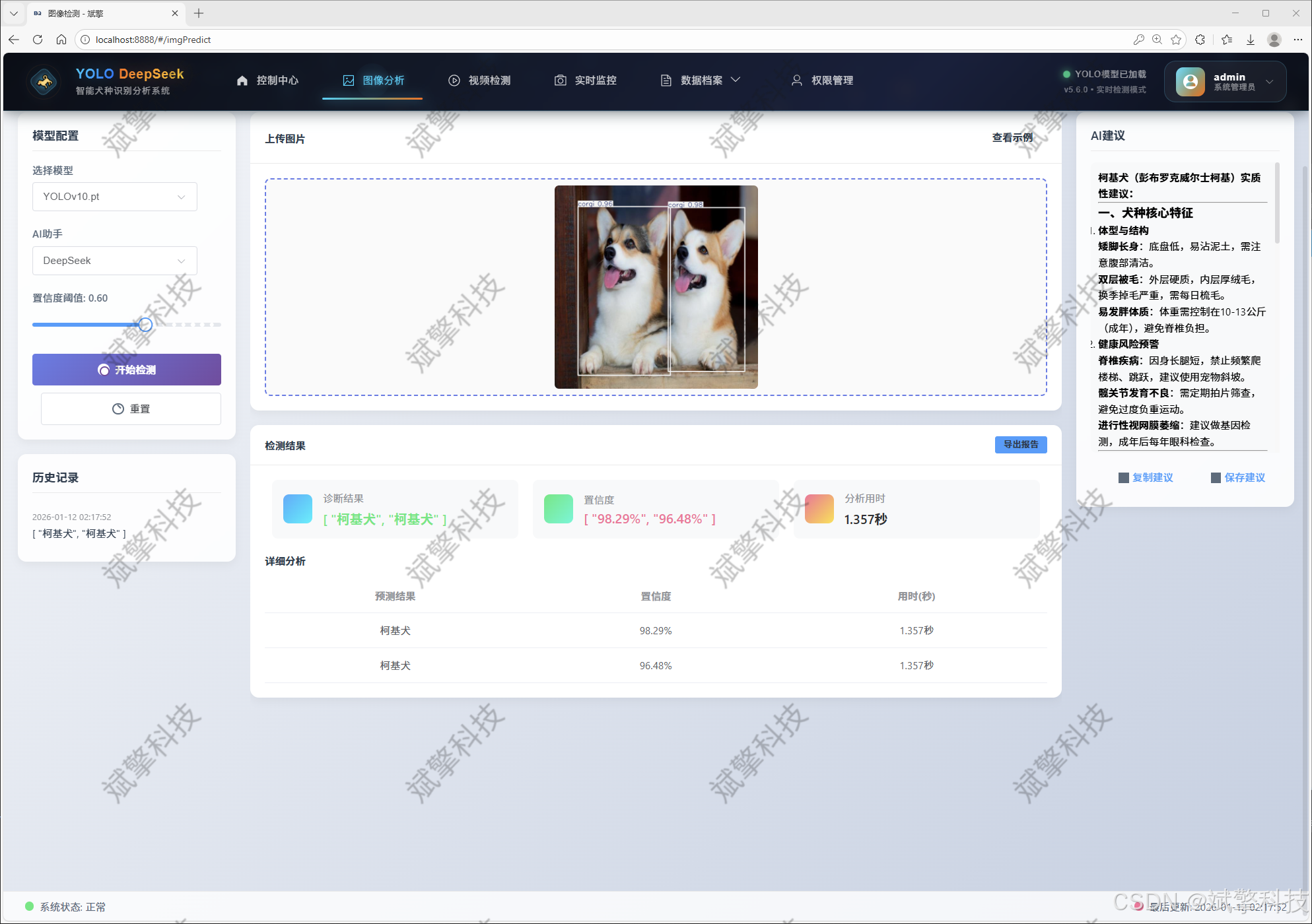

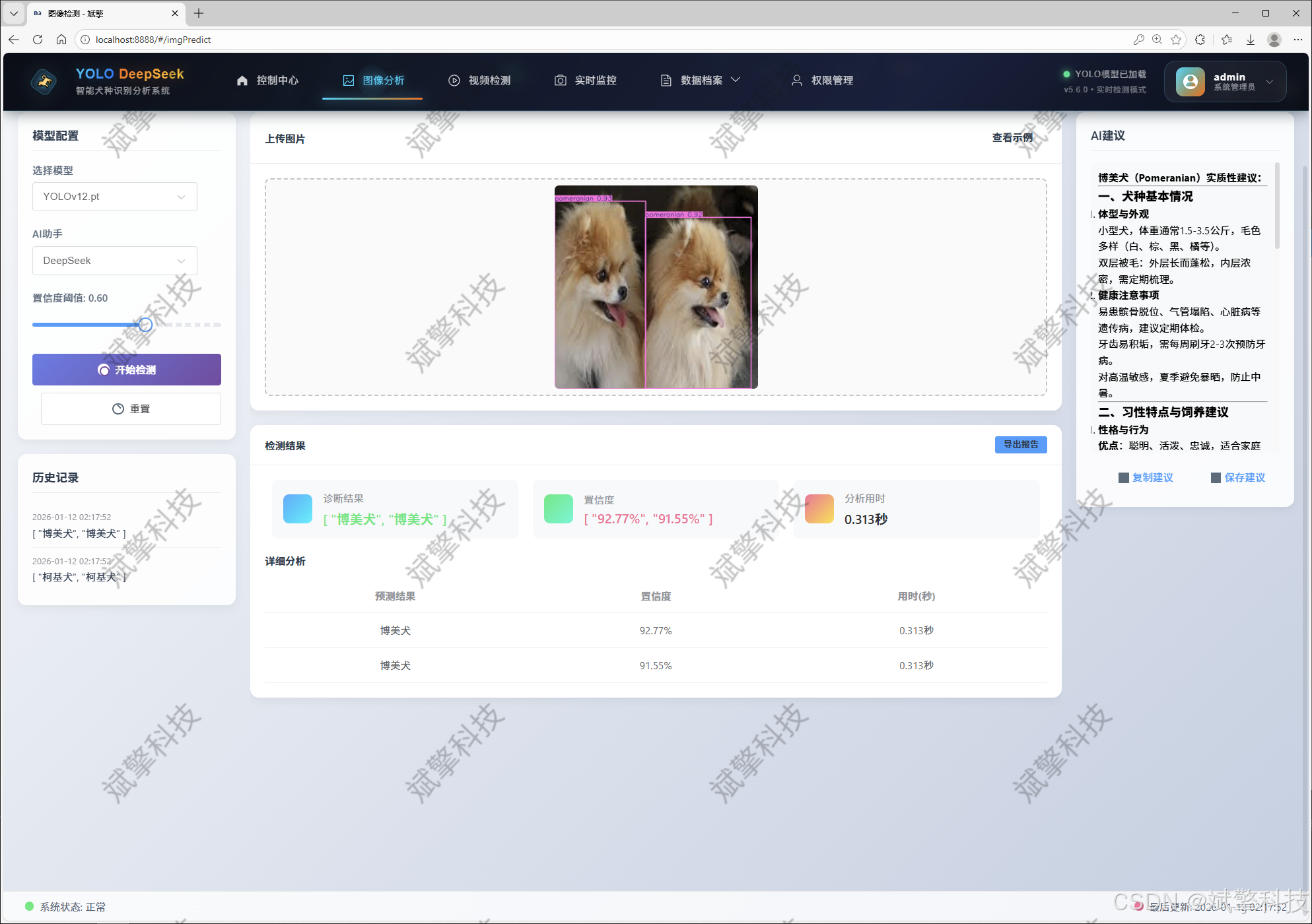

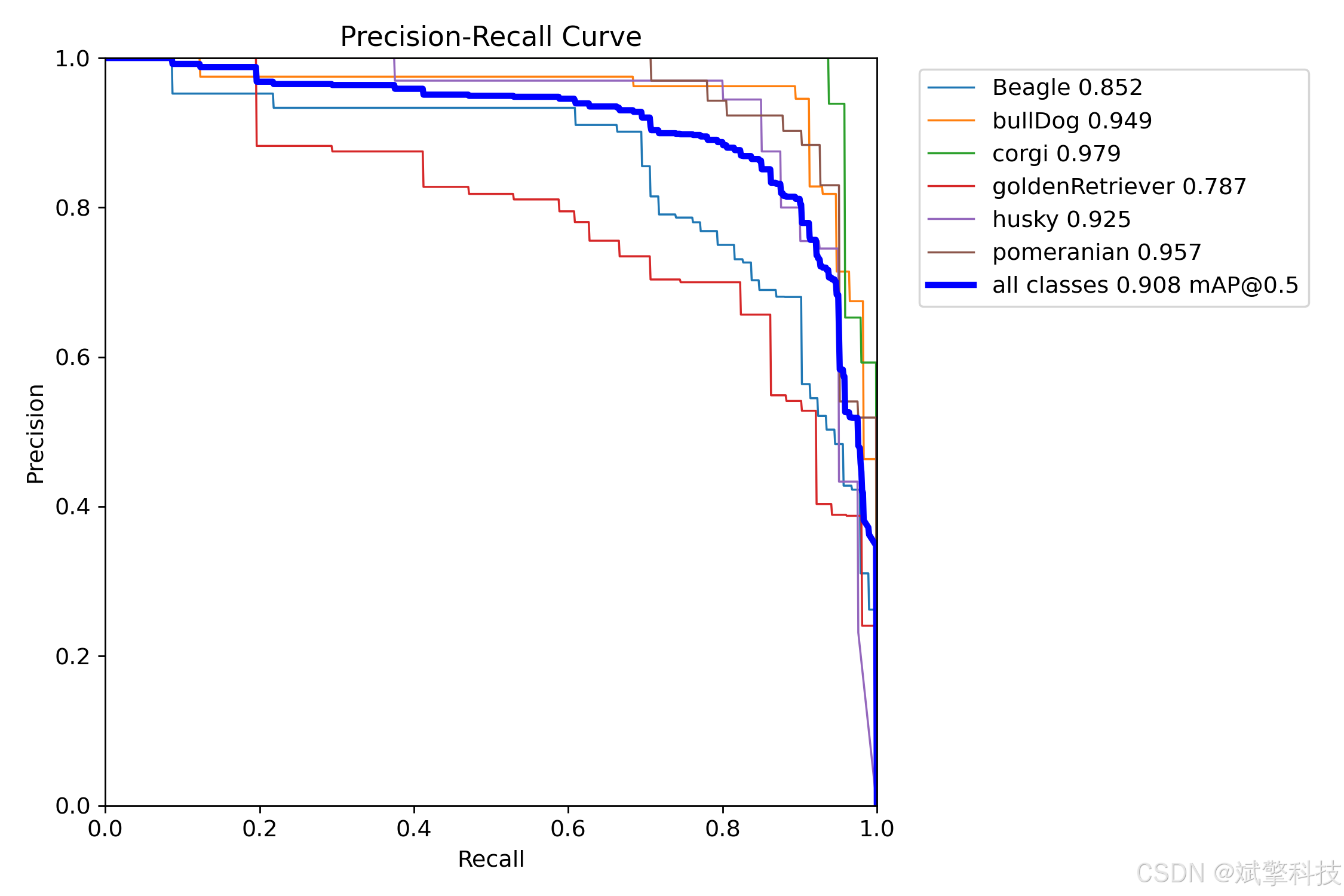

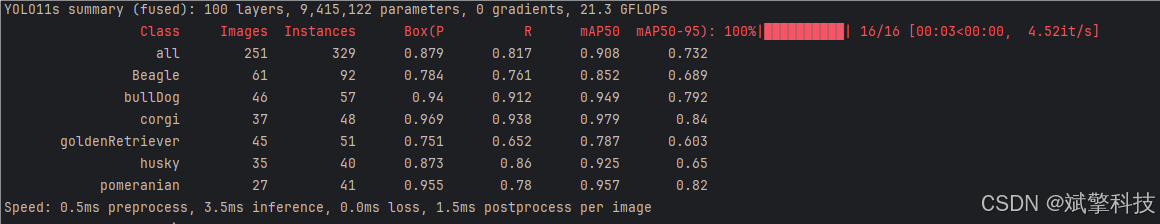

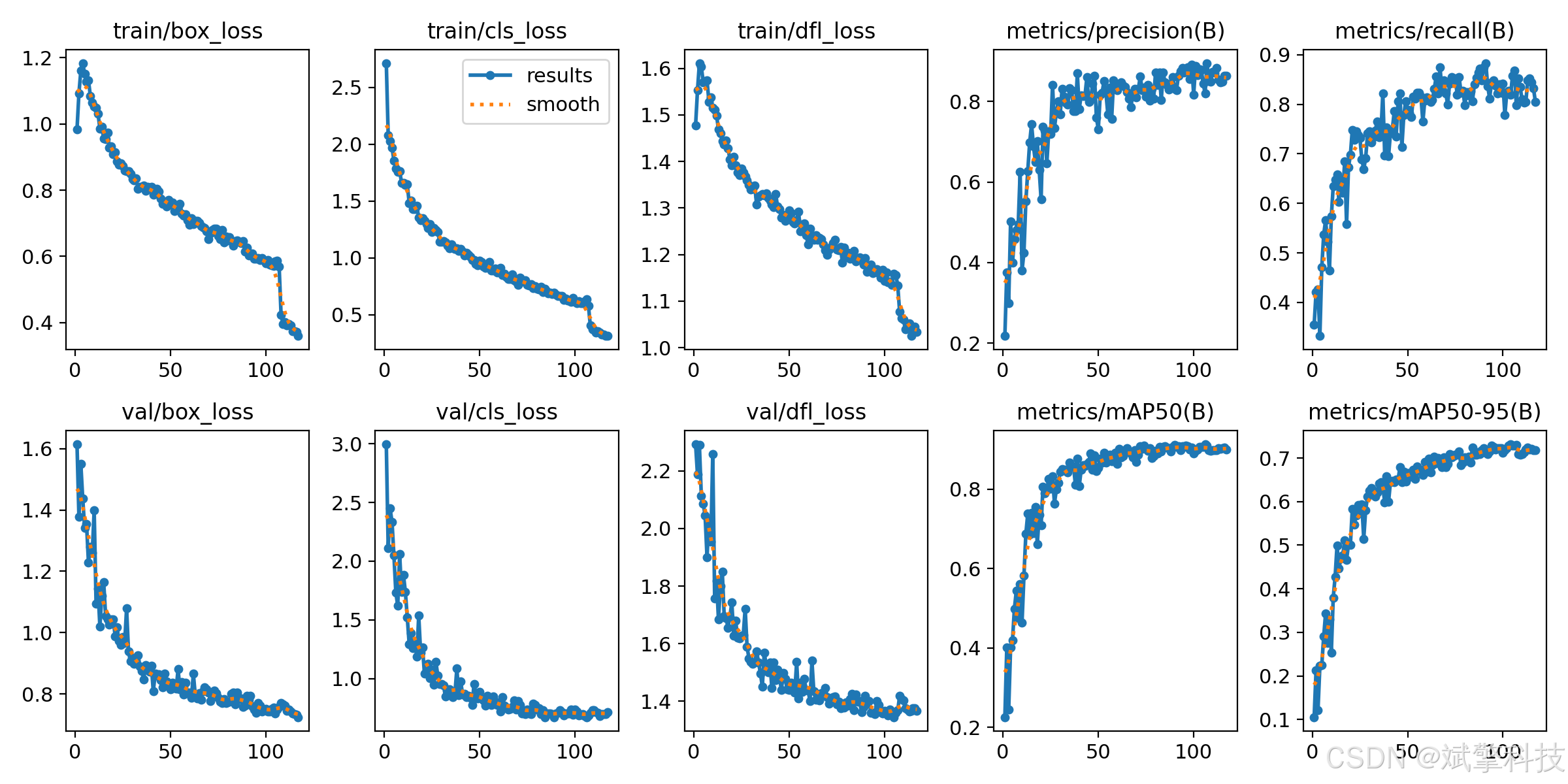

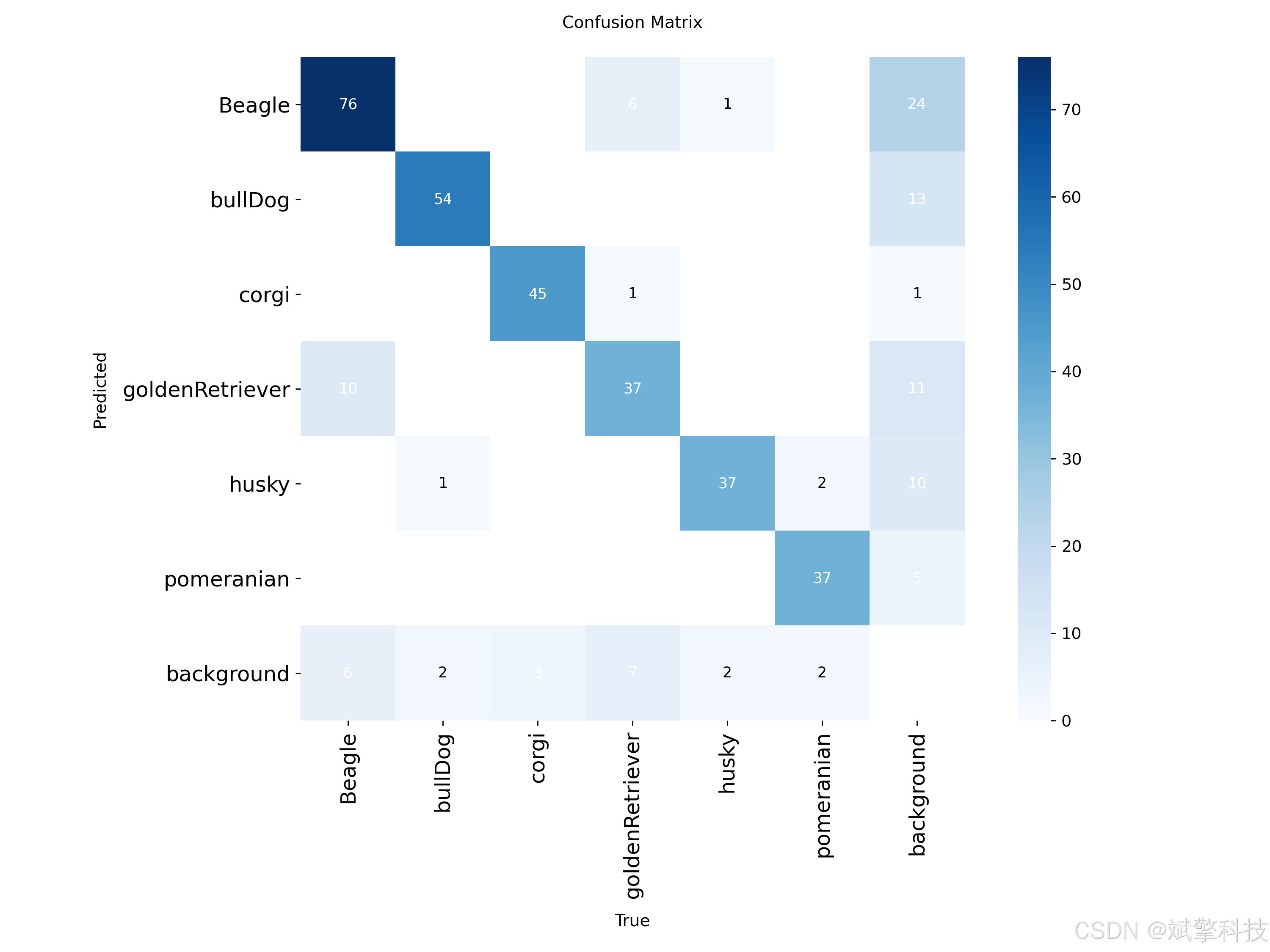

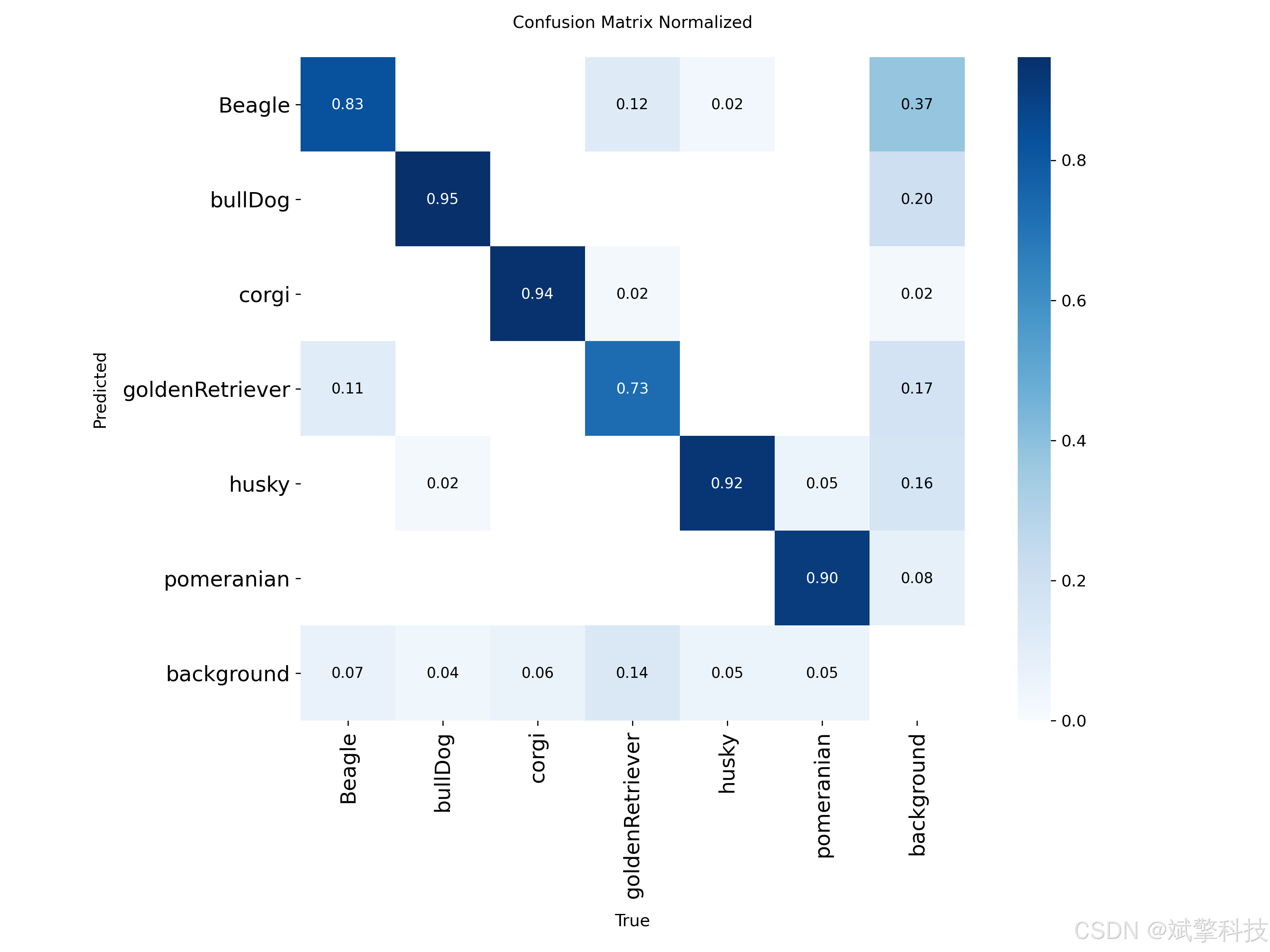

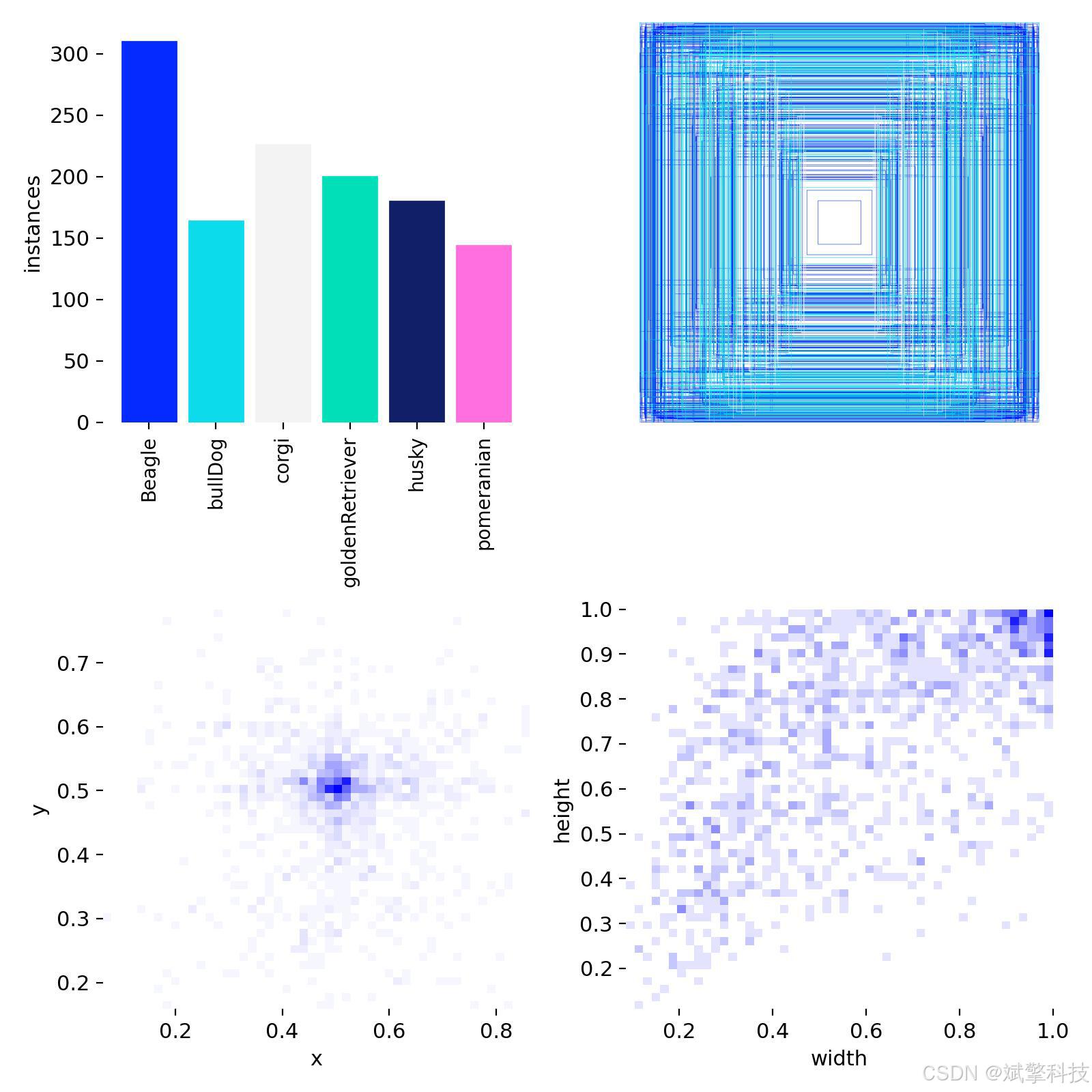

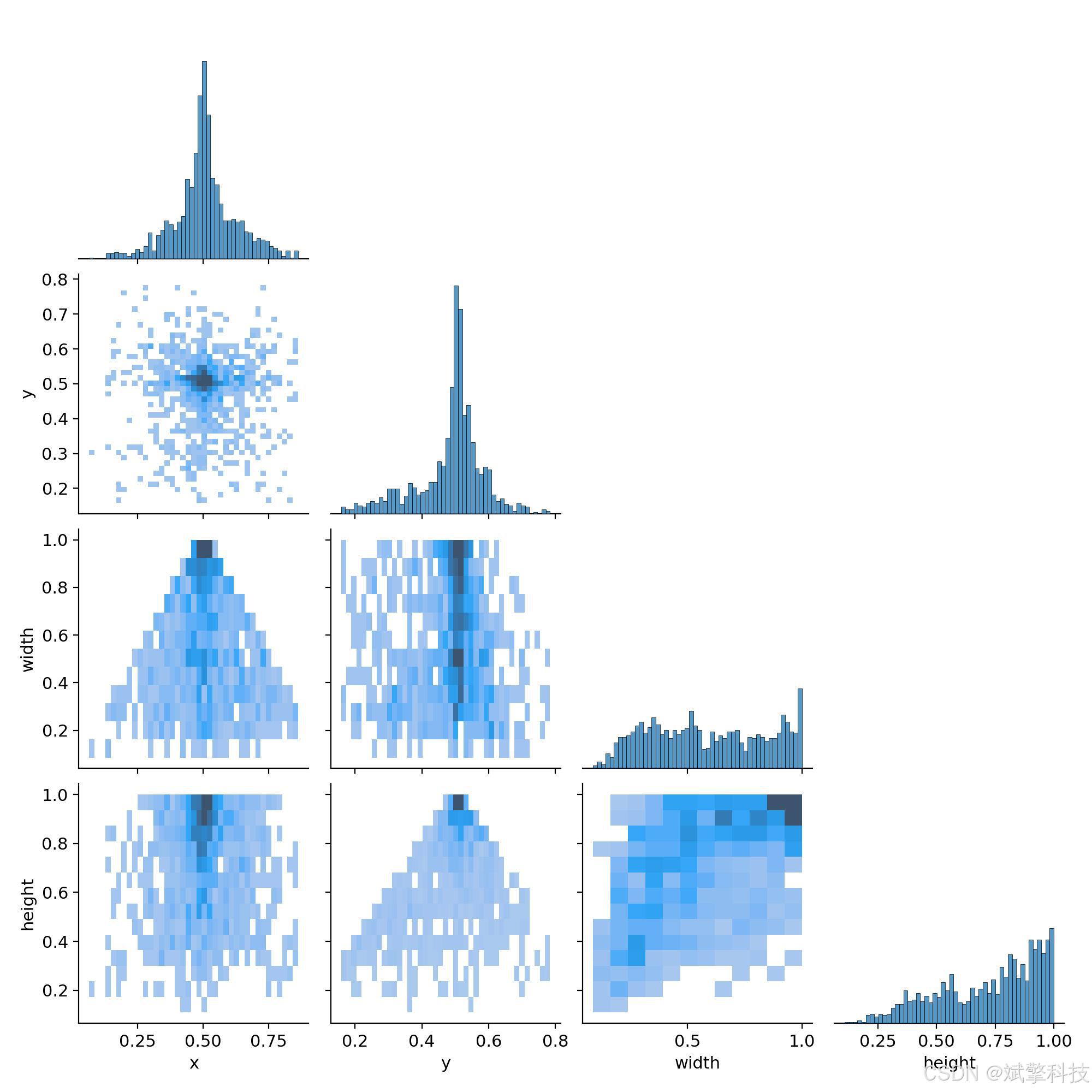

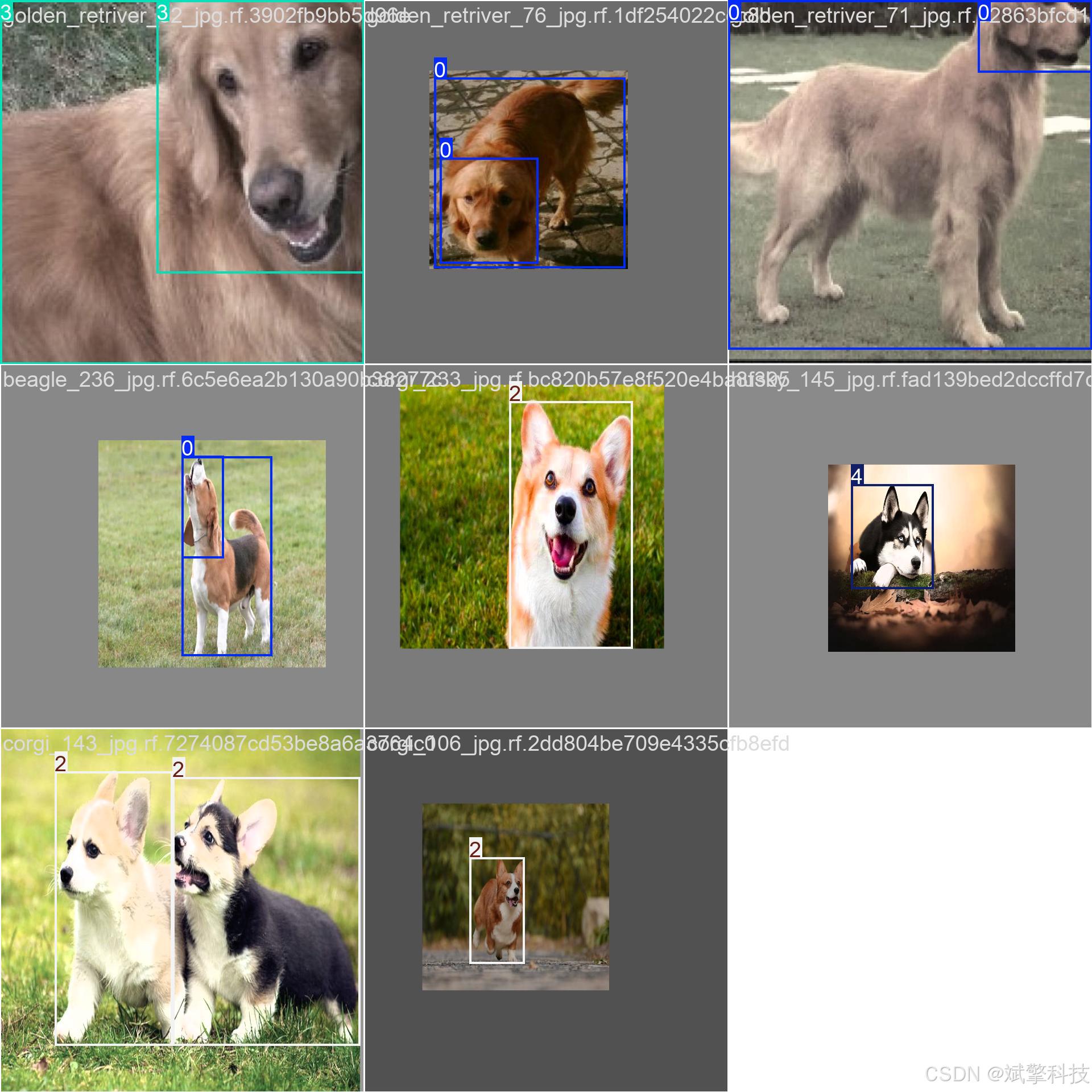

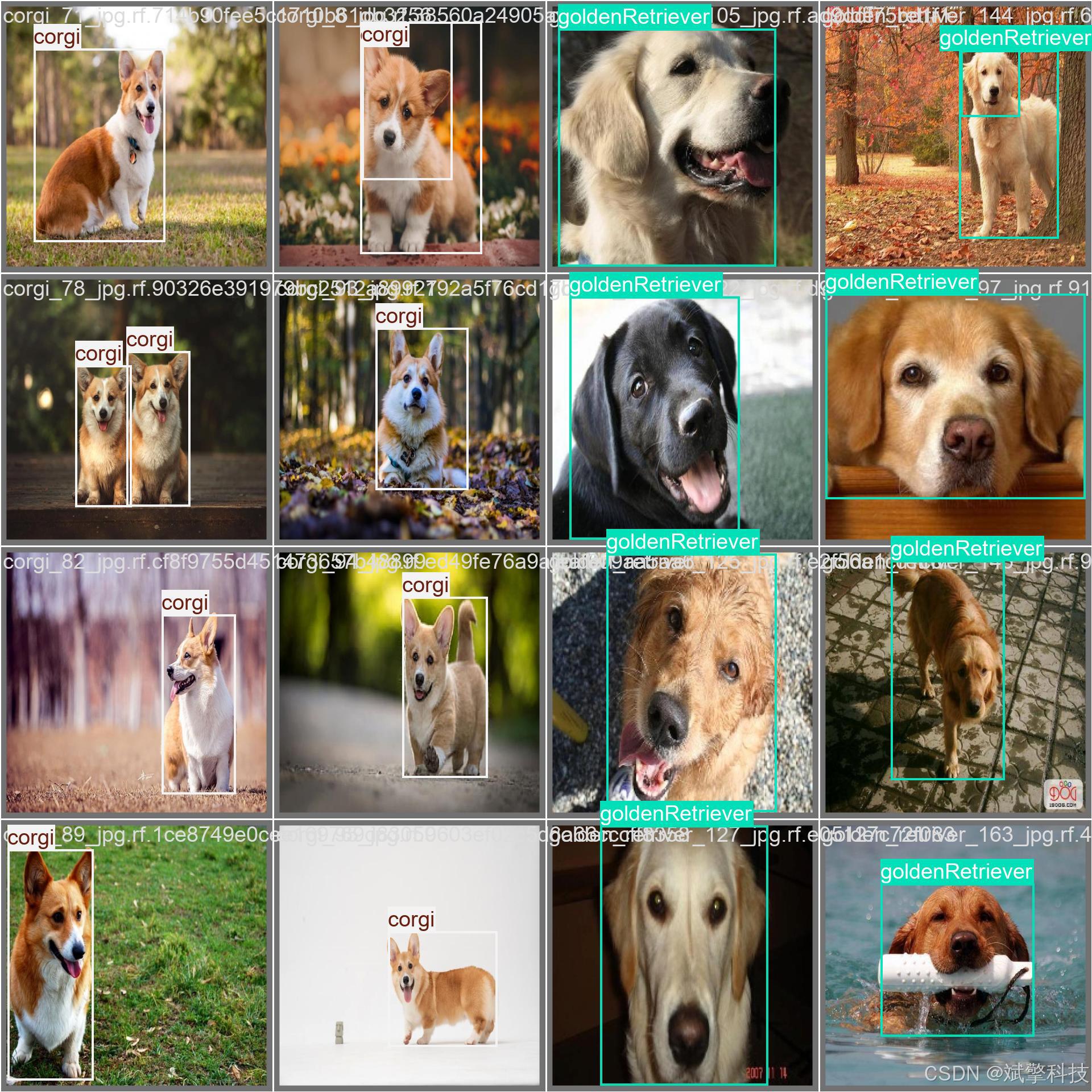

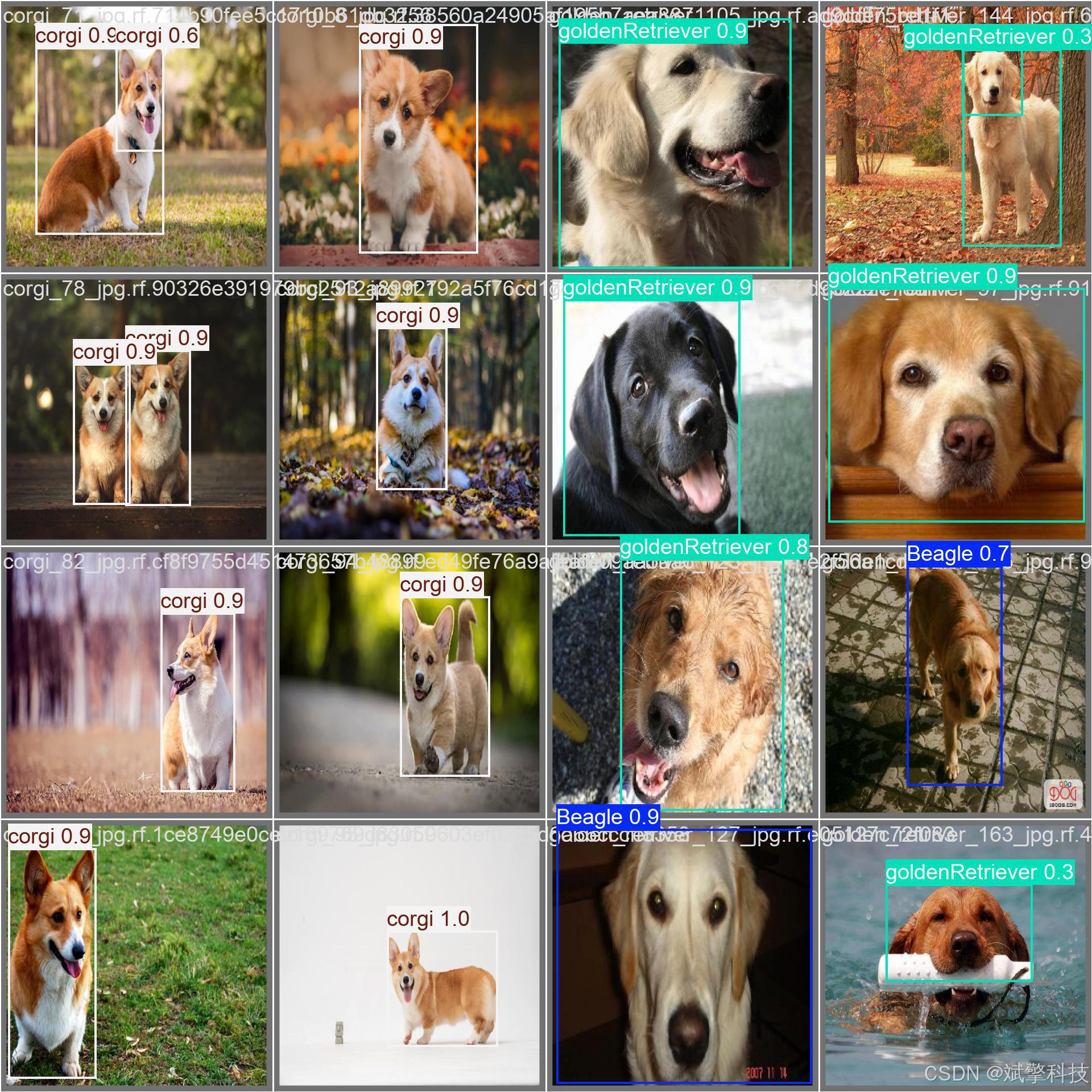

系统实现了对六种常见犬种(比格犬、斗牛犬、柯基犬、金毛寻回犬、哈士奇、博美犬)的精准识别。训练数据集包含总计1257张标注图像(训练集880张,验证集251张,测试集126张)。除基础的图像、视频及摄像头实时检测功能外,本系统的核心创新点在于深度整合了DeepSeek大语言模型的AI分析能力,可为检测结果提供品种习性、饲养建议等智能文本描述,极大丰富了系统的输出价值。

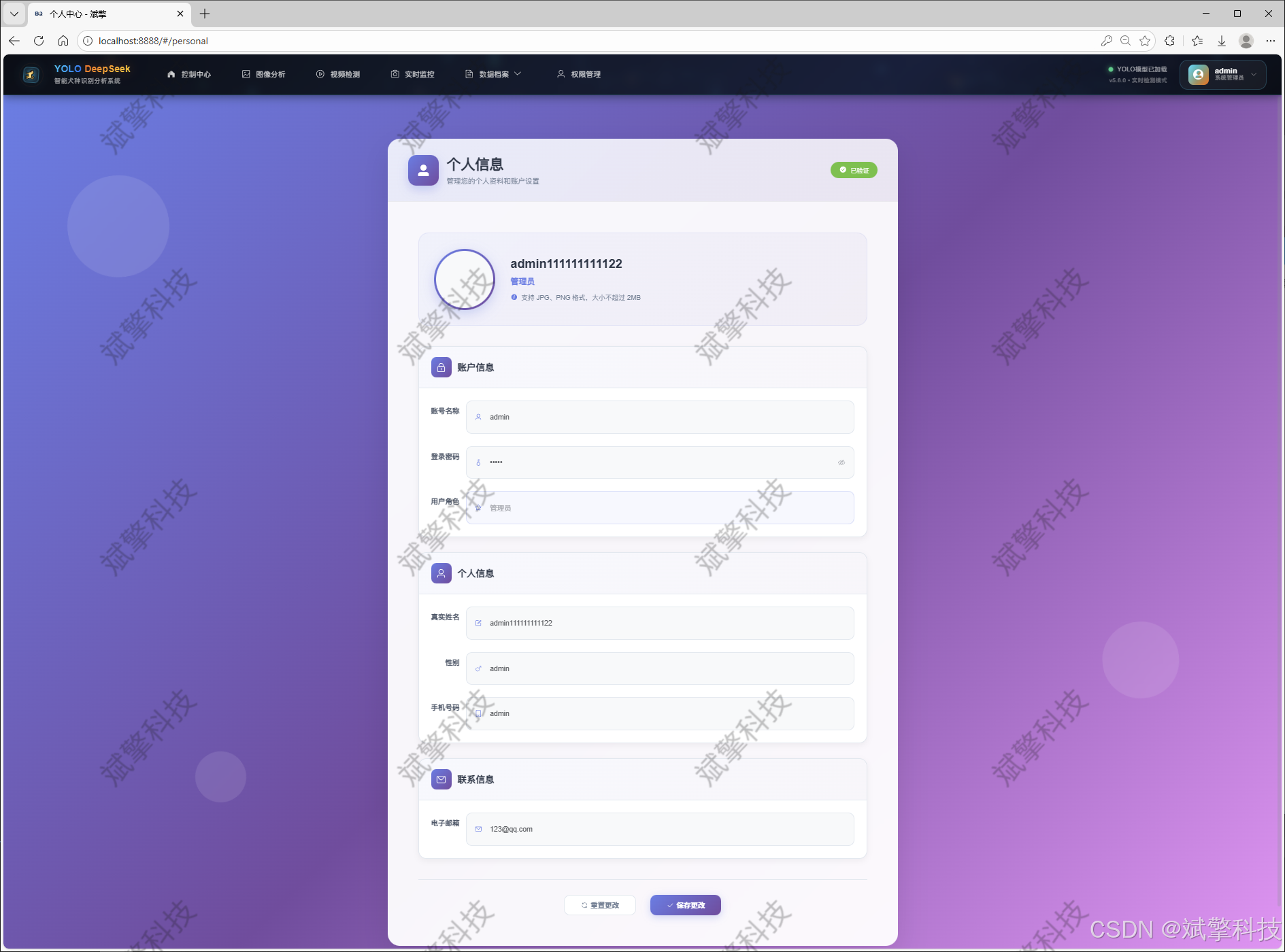

系统功能完备,涵盖用户登录注册、多模态检测记录管理(图片、视频、实时流)、全方位数据可视化、管理员对用户及识别记录的增删改查(CRUD),以及用户个人中心信息维护等模块。本系统不仅是一个高精度的犬种识别工具,更是一个集数据管理、智能分析与用户交互于一体的综合性服务平台,为宠物行业智能化、社区宠物管理及视觉技术教学实践提供了有力的解决方案。

关键词: 目标检测;YOLO系列;犬种识别;SpringBoot;前后端分离;DeepSeek;智能分析;数据可视化;MySQL

详细功能展示视频

基于YOLO和千问|DeepSeek的犬种识别检测系统(web界面+YOLOv8/YOLOv10/YOLOv11/YOLOv12+深度学习+python)_哔哩哔哩_bilibili

基于YOLO和千问|DeepSeek的犬种识别检测系统(web界面+YOLOv8/YOLOv10/YOLOv11/YOLOv12+深度学习+python)_哔哩哔哩_bilibili

https://www.bilibili.com/video/BV1afc4zDErD/

目录

一、引言

1.1 研究背景与意义

在当今社会,宠物犬已成为众多家庭的重要成员,犬只的品种识别在宠物管理、兽医诊断、犬只训练、社区安全乃至宠物社交应用等多个场景中具有广泛需求。传统的人工识别方式高度依赖经验,效率低下且存在主观误差。因此,利用计算机视觉技术实现自动化、智能化的犬种识别具有显著的应用价值。

近年来,基于深度学习的目标检测算法取得了突破性进展,其中YOLO(You Only Look Once) 系列因其在速度与精度上的卓越平衡而备受青睐。从YOLOv1到最新的YOLOv12,该系列算法不断进化,为实时检测任务提供了丰富多样的模型选择。与此同时,Web应用开发技术也趋于成熟,SpringBoot作为Java领域最流行的微服务框架,以其快速构建、简化配置和强大生态的优势,成为开发企业级后端服务的首选。将尖端的目标检测模型与稳健的后端服务、交互式前端界面相结合,构建一个完整的应用系统,是技术落地和价值实现的关键路径。

此外,单纯的目标检测仅能提供“是什么”的信息。为提升系统的实用性和用户体验,引入大语言模型(如DeepSeek) 进行后处理与分析,能够将视觉识别结果转化为自然语言描述,为用户提供更深层次的品种相关知识,实现了从“感知”到“认知”的跨越。

1.2 项目概述

本项目旨在构建一个功能全面、性能优异、用户体验良好的智能犬种识别检测系统。系统以多版本YOLO算法为识别引擎,以SpringBoot + Vue.js 前后端分离架构为应用骨架,以MySQL为数据支撑,并创新性地集成DeepSeek API以提供智能分析功能。

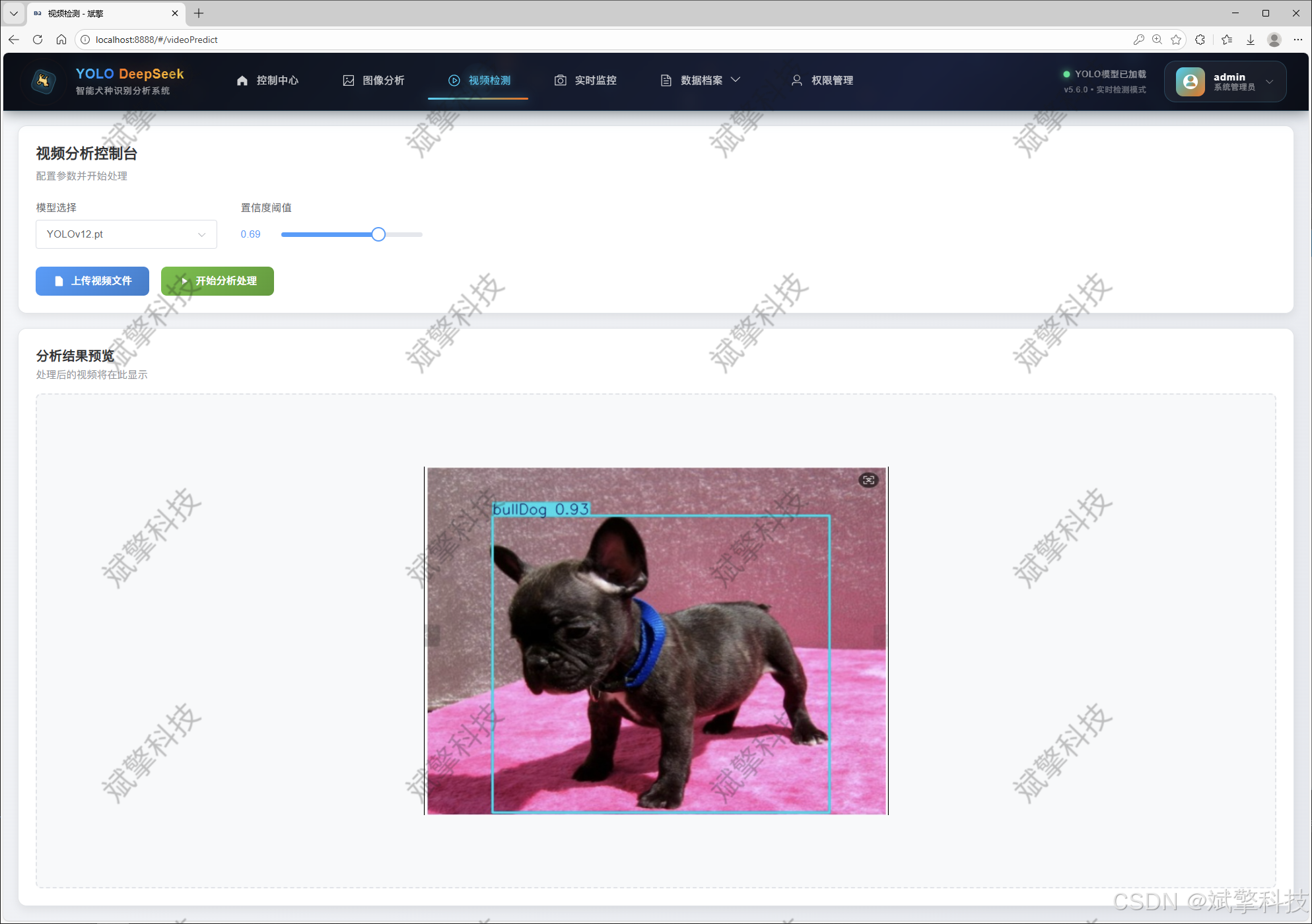

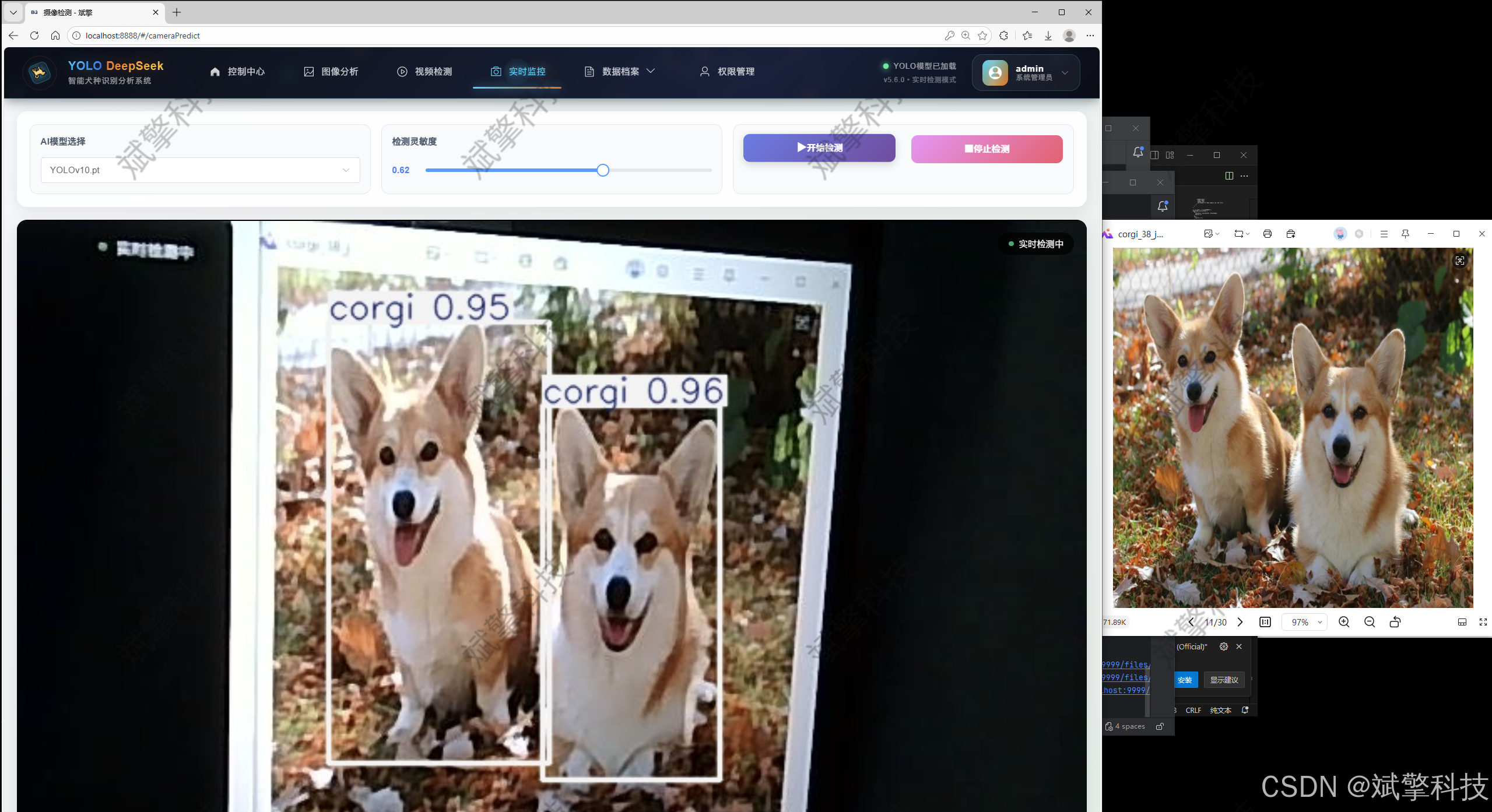

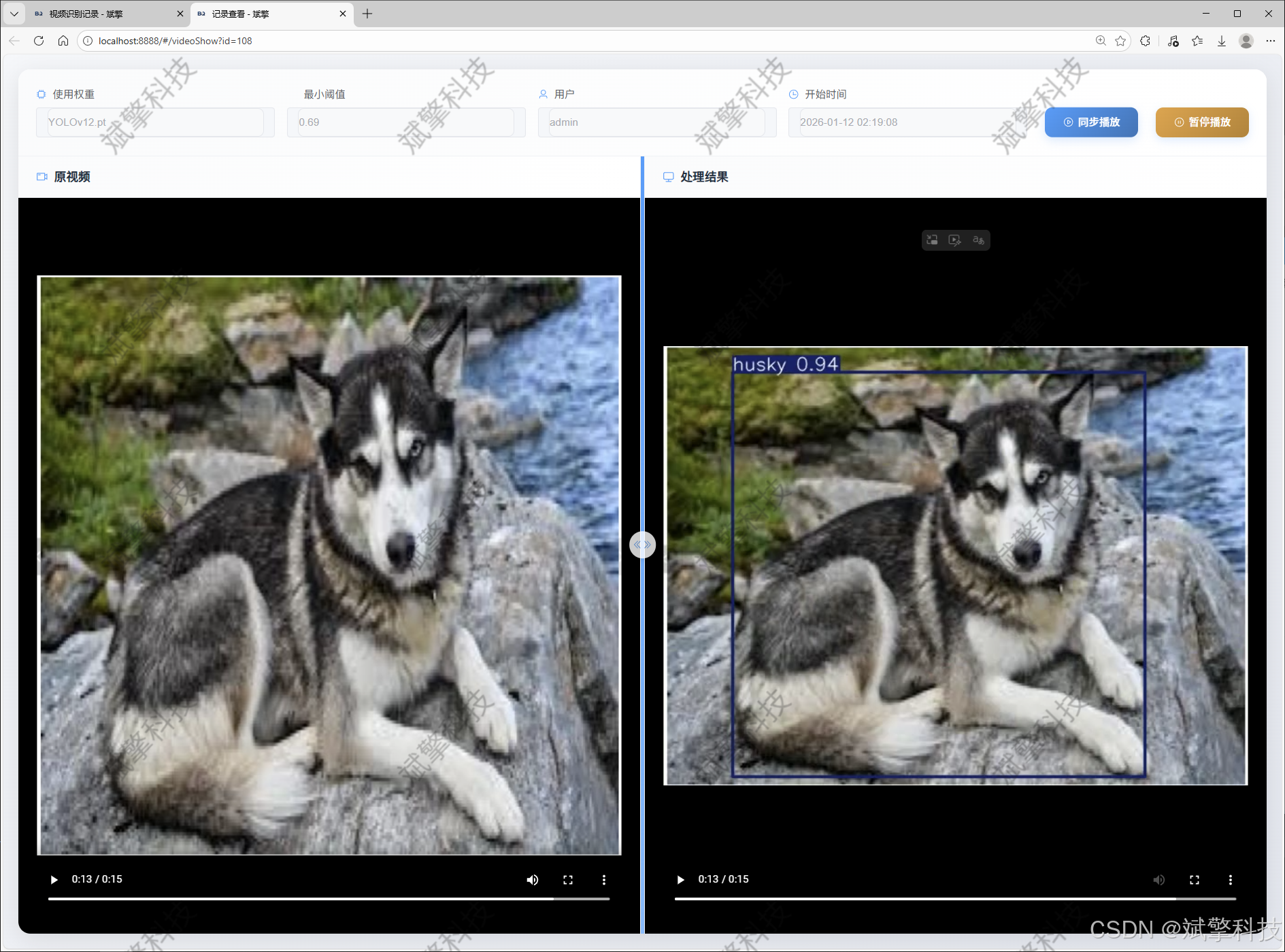

系统核心识别对象为6类常见犬种,通过精心收集和标注的数据集进行模型训练与验证。系统为用户提供三种检测模式:图片检测、视频文件检测以及摄像头实时检测,满足不同场景下的应用需求。所有检测记录(包括原始文件、检测结果、时间、用户信息等)均被妥善保存,便于后续查询、分析与可视化展示。

系统还配备了完整的用户管理体系,包括用户自助注册登录、个人信息维护,以及管理员后台进行用户管理、记录管理等,确保了系统的安全性与可管理性。

1.3 主要贡献与创新点

-

多模型集成与可配置性: 在单一系统中无缝集成YOLOv8, v10, v11, v12四个最新版本模型,允许用户根据对实时性、准确性的不同侧重点进行动态切换,增强了系统的灵活性和技术前瞻性。

-

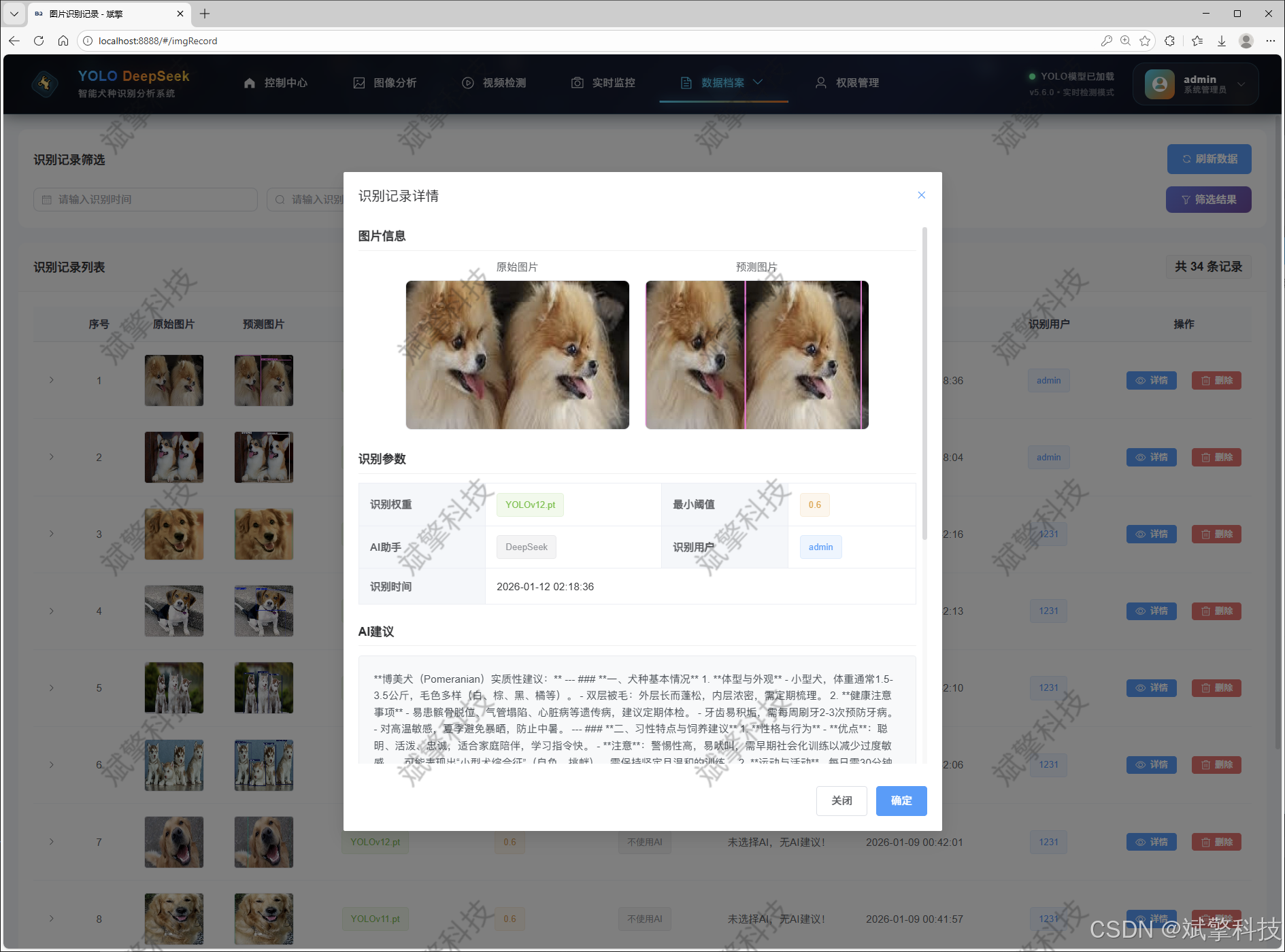

检测与分析深度融合: 突破传统检测系统仅输出边界框和类别的局限,通过调用DeepSeek大语言模型API,为识别出的犬种自动生成富文本介绍,提供了“检测+科普”的一站式服务。

-

完备的全栈系统实现: 不仅完成了核心算法集成,更构建了包含用户管理、多模态检测、记录追踪、数据可视化在内的完整Web应用,形成了一个可直接部署使用的产品级解决方案,而非单纯的算法演示。

-

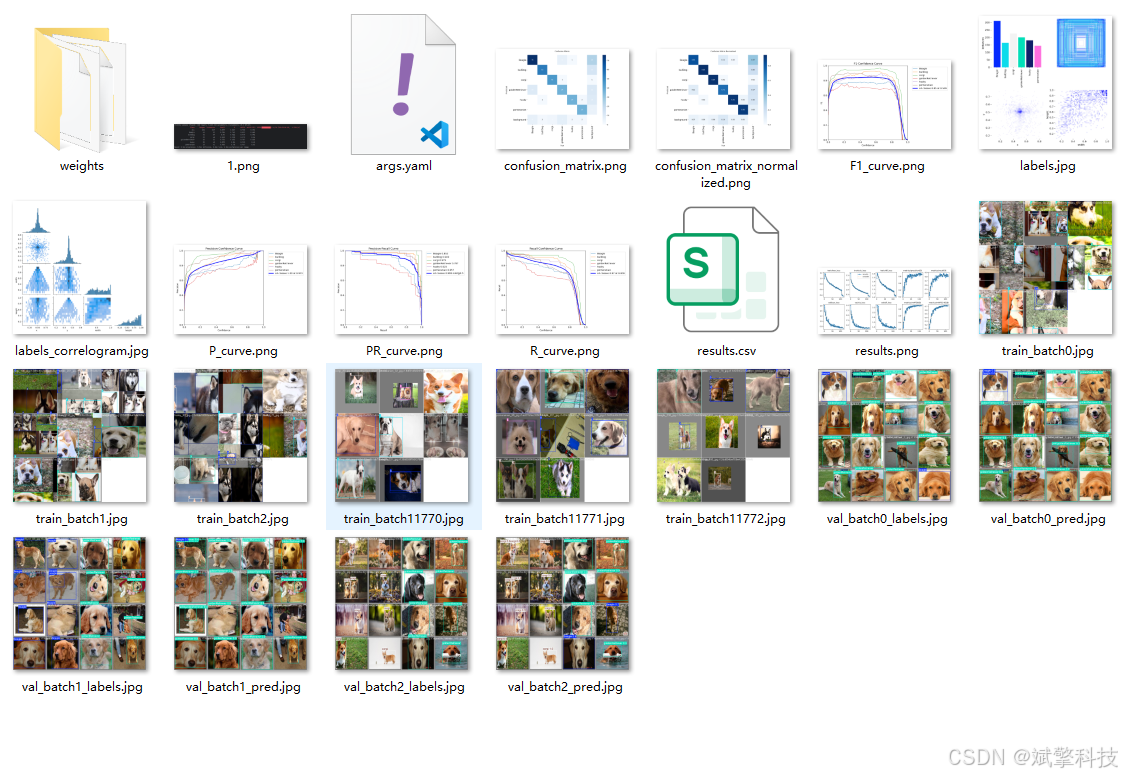

高质量专用数据集构建与验证: 针对6个特定犬种,构建了超过1200张标注图像的数据集,并合理划分为训练集、验证集和测试集,为模型训练与系统性能评估奠定了坚实基础。

二、 系统核心特性概述

功能模块

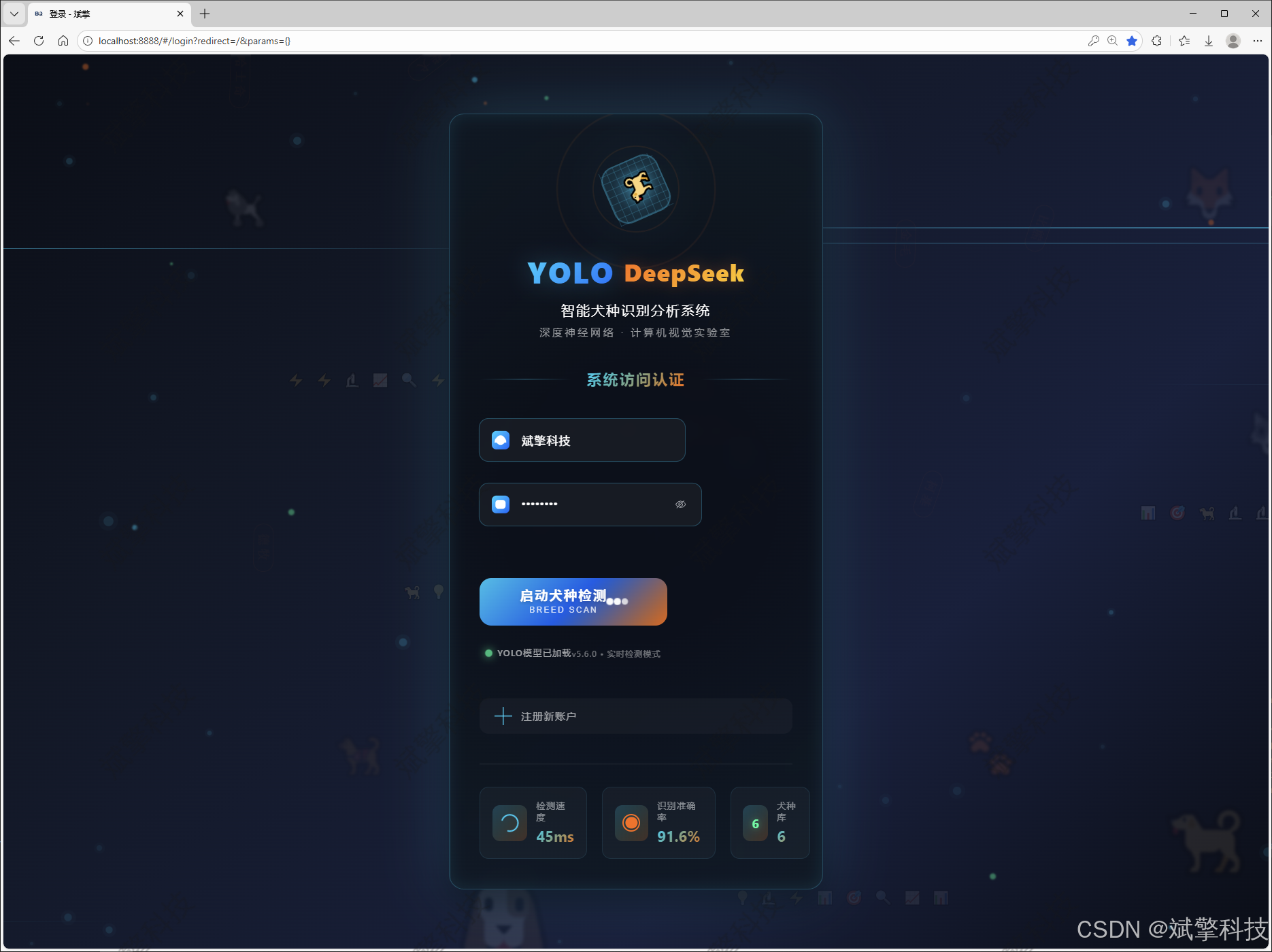

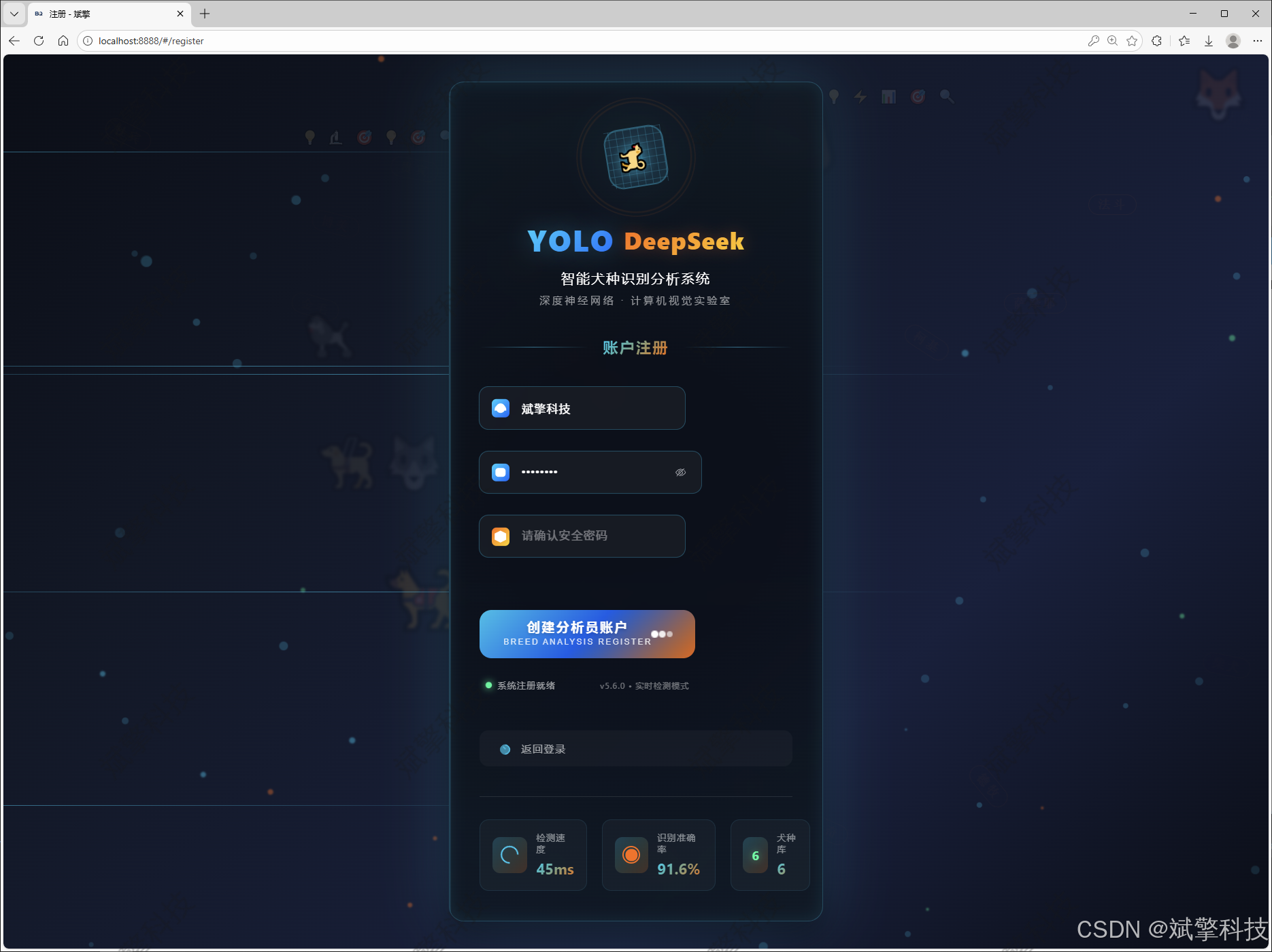

✅ 用户登录注册:支持密码检测,保存到MySQL数据库。

✅ 支持四种YOLO模型切换,YOLOv8、YOLOv10、YOLOv11、YOLOv12。

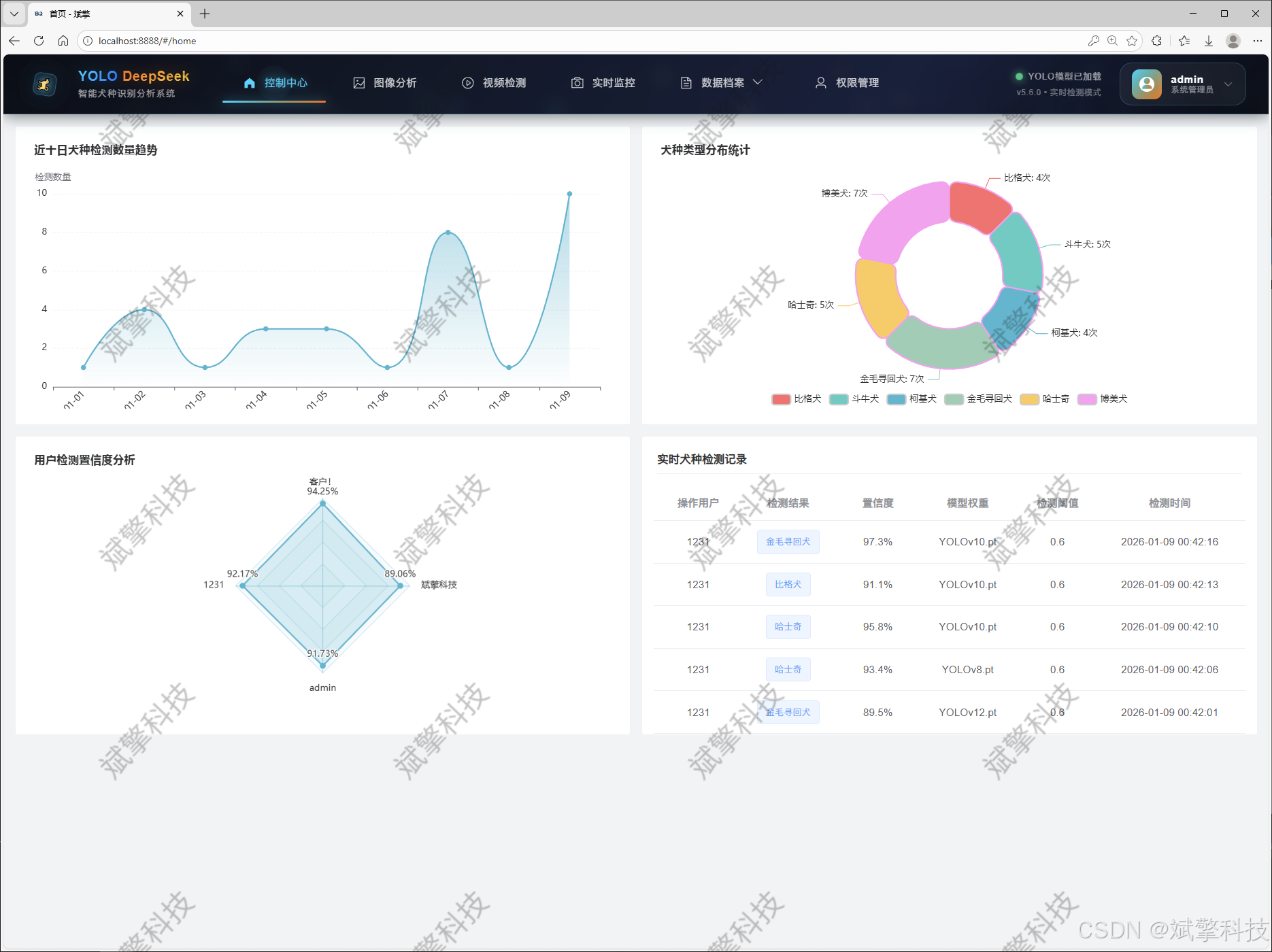

✅ 信息可视化,数据可视化。

✅ 图片检测支持AI分析功能,deepseek

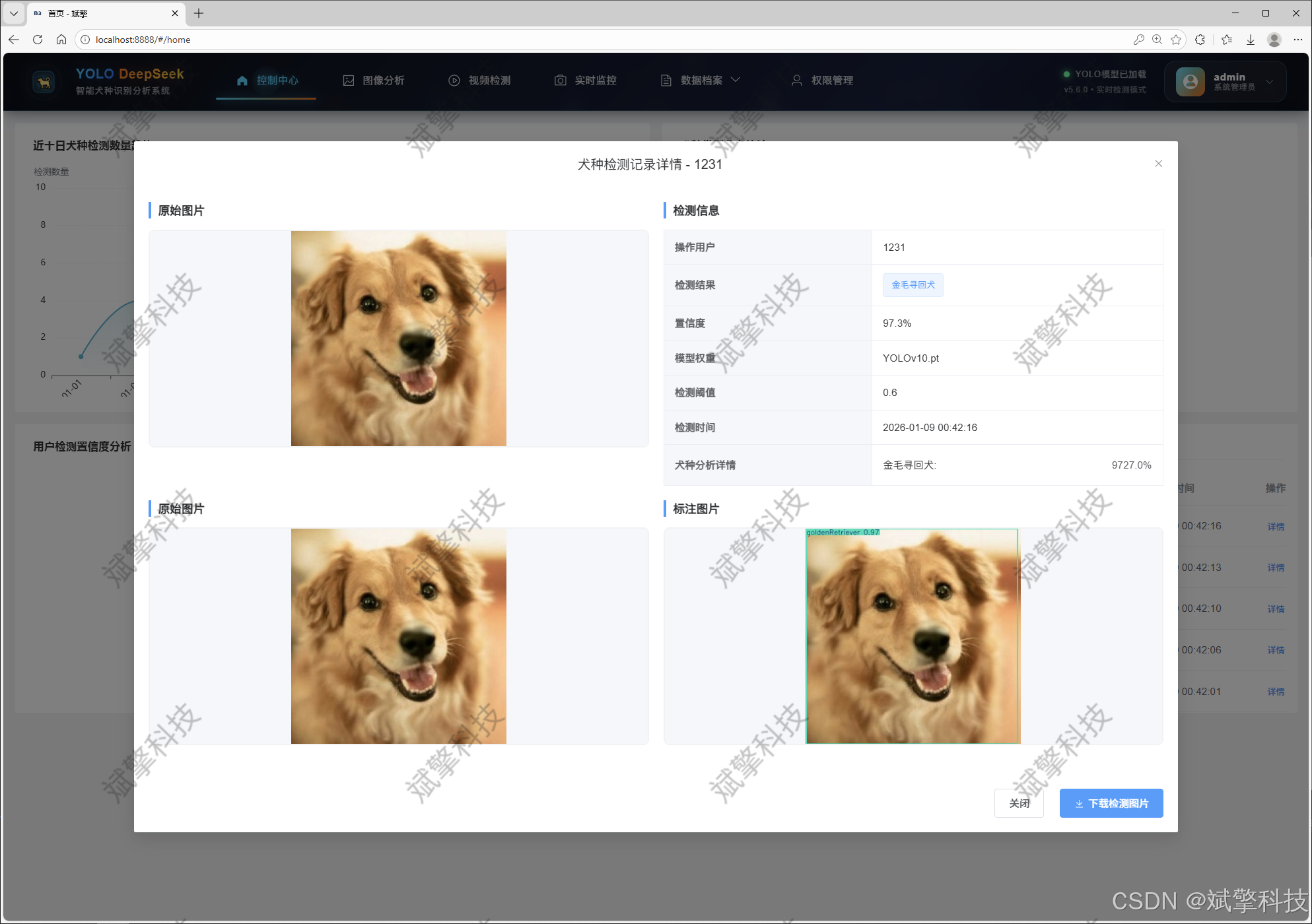

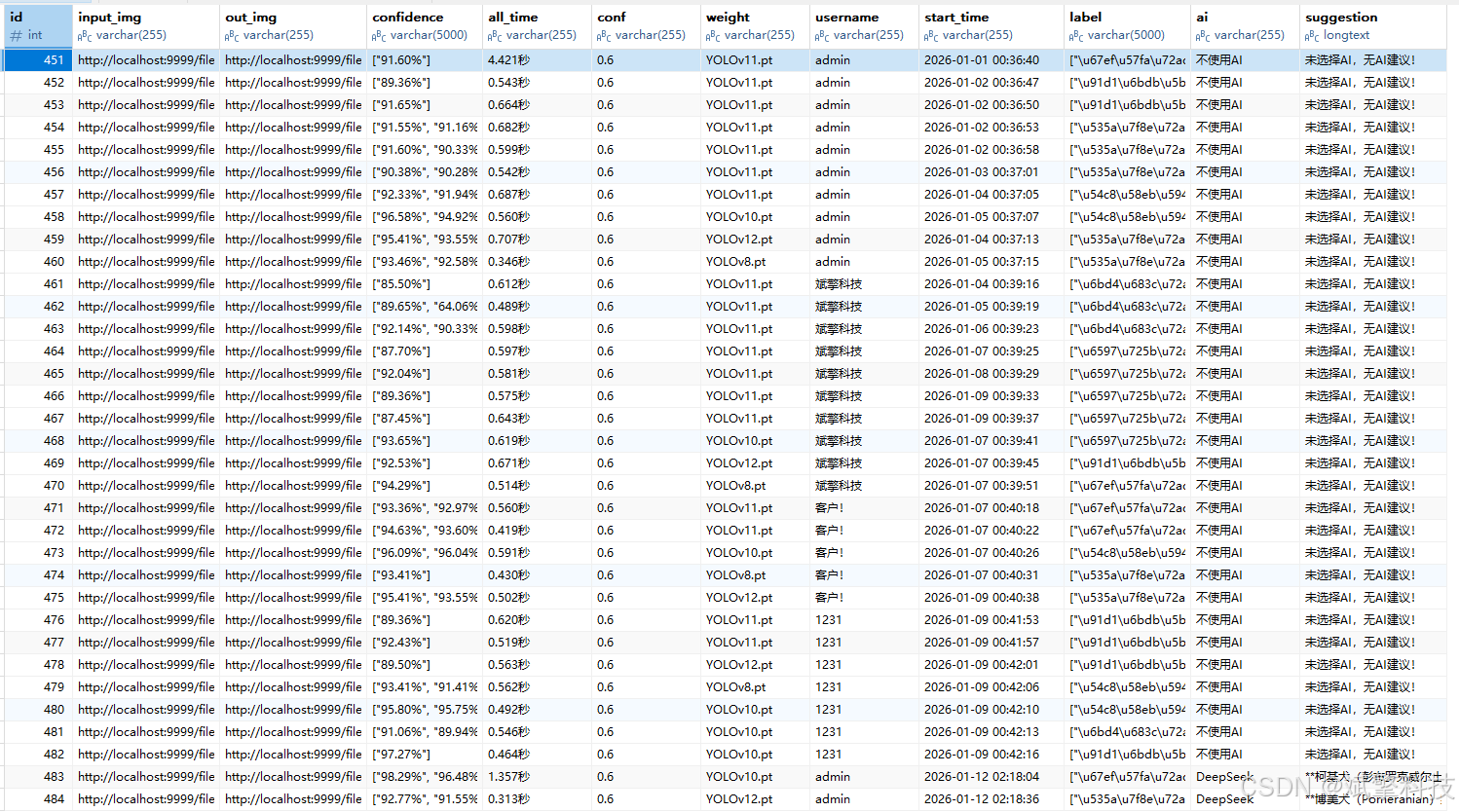

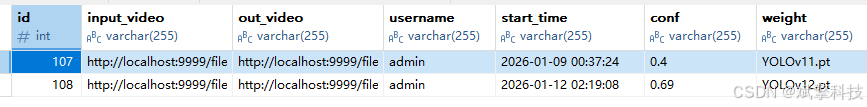

✅ 支持图像检测、视频检测和摄像头实时检测,检测结果保存到MySQL数据库。

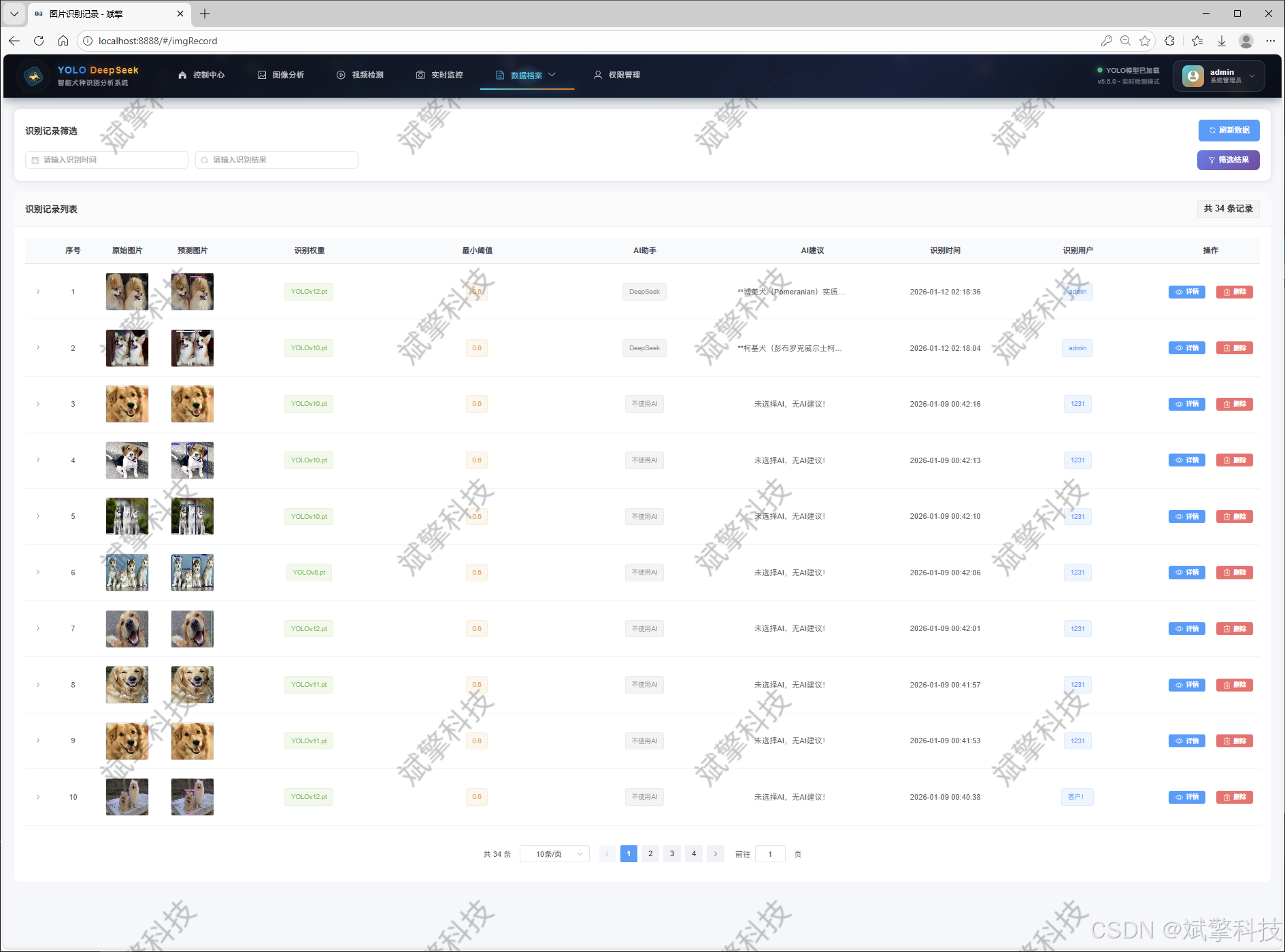

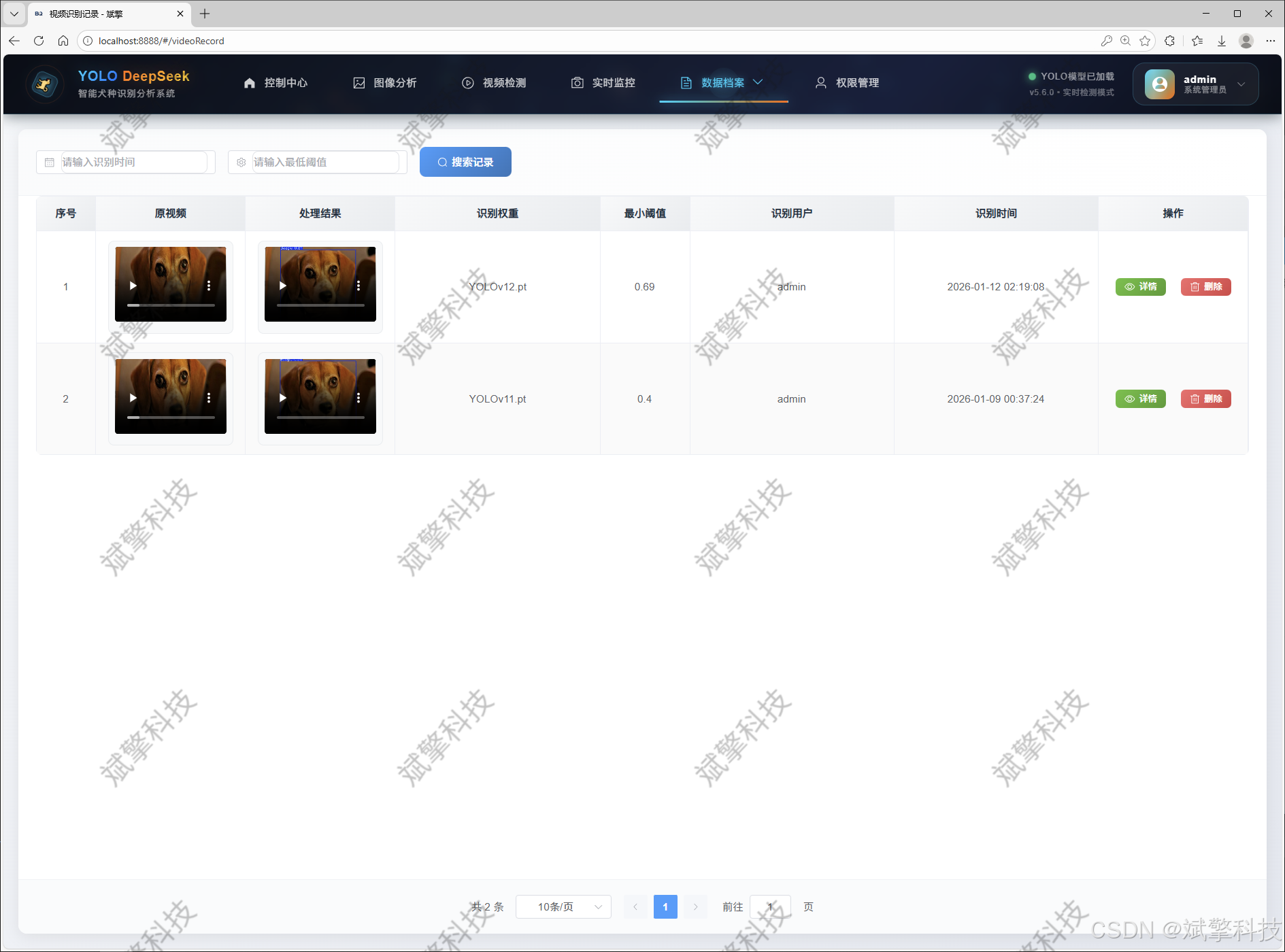

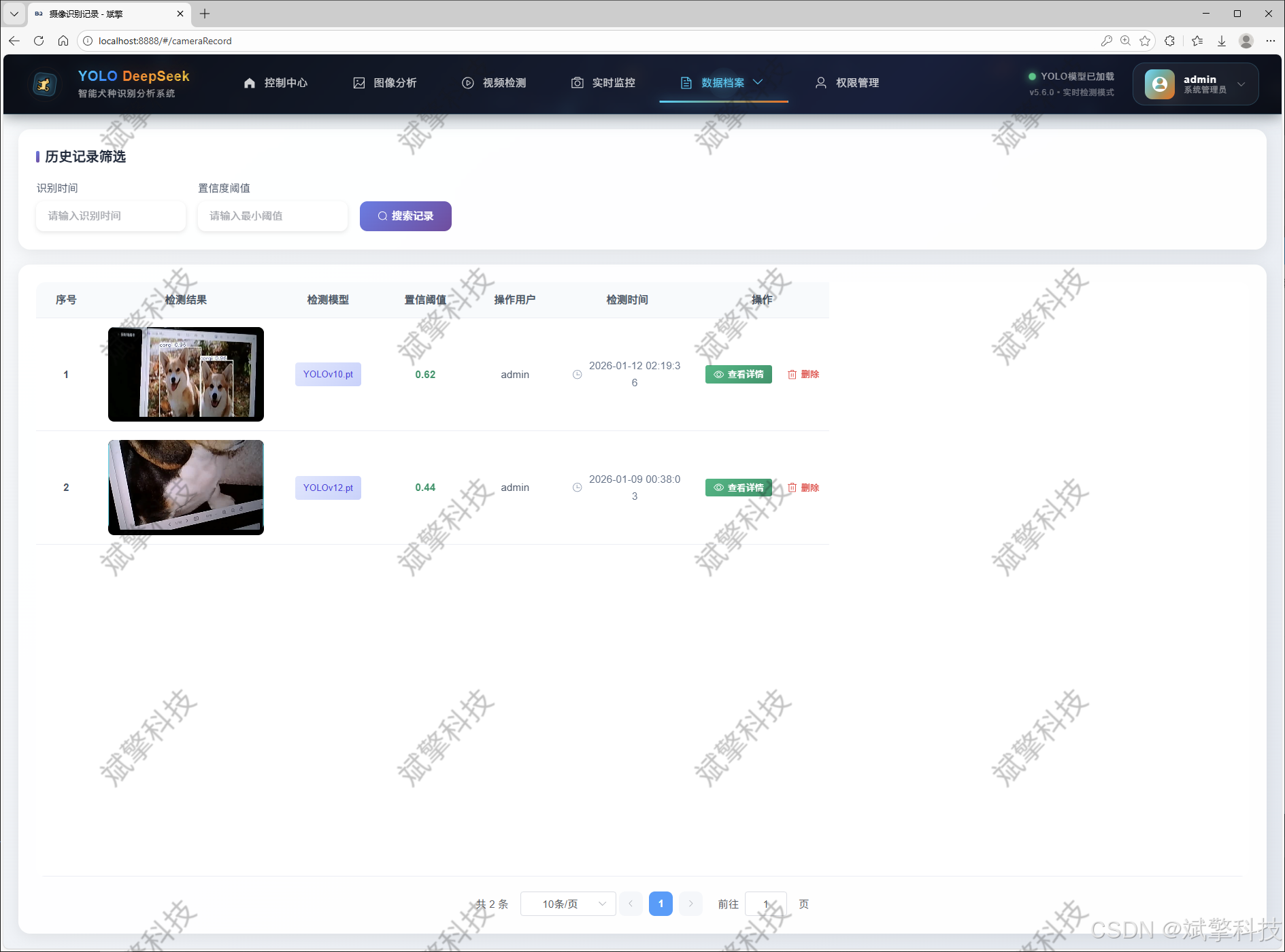

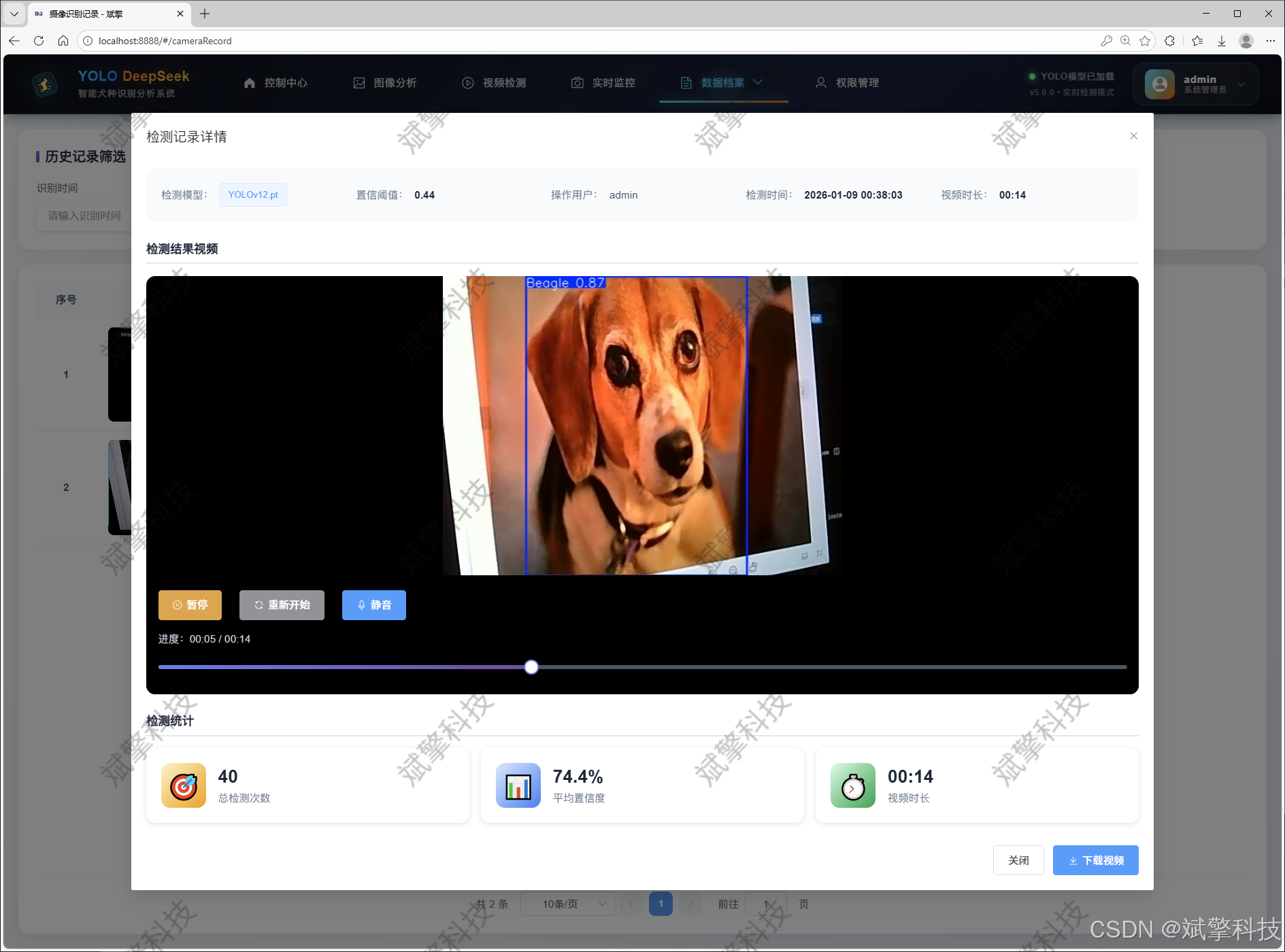

✅ 图片识别记录管理、视频识别记录管理和摄像头识别记录管理。

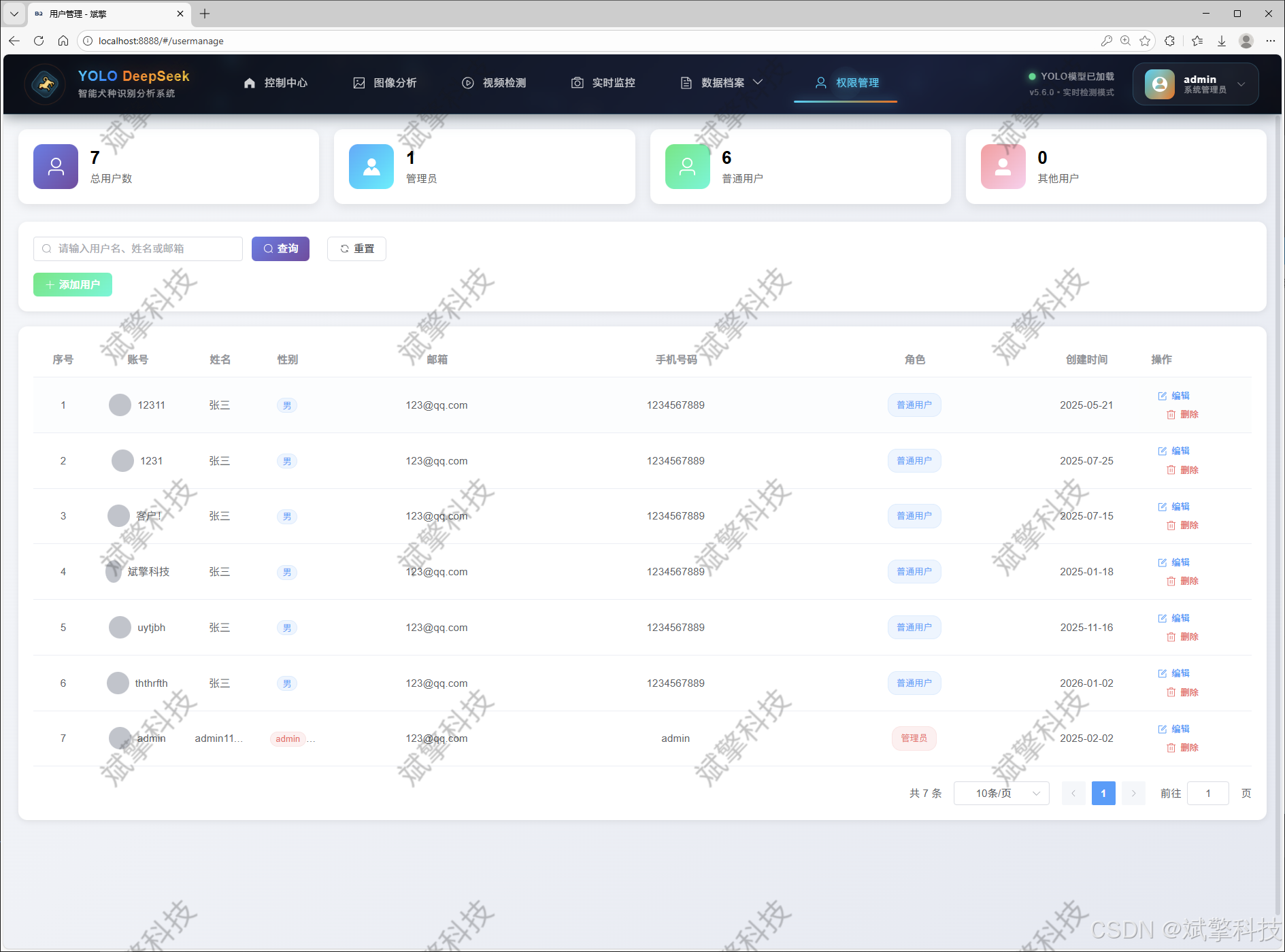

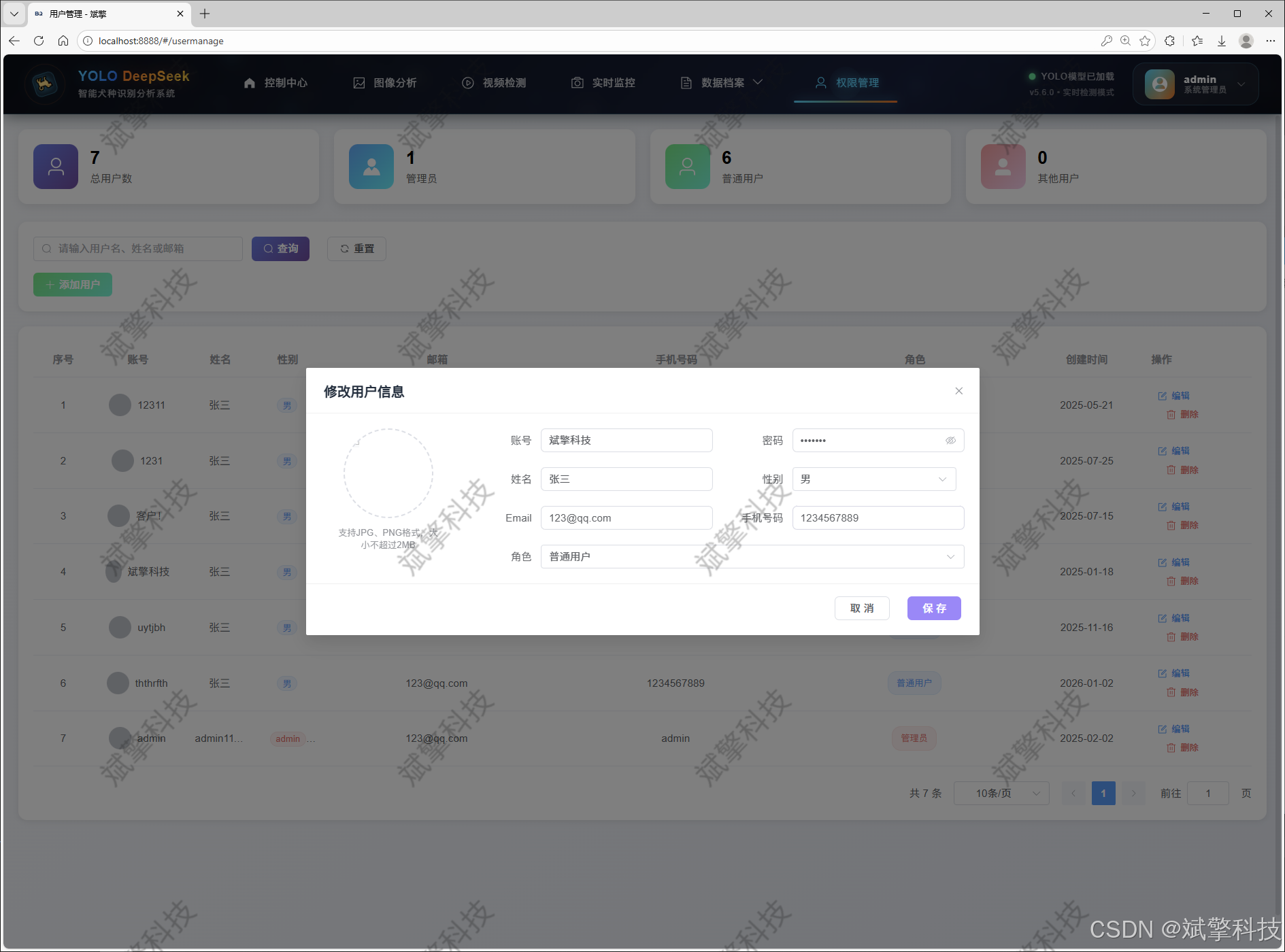

✅ 用户管理模块,管理员可以对用户进行增删改查。

✅ 个人中心,可以修改自己的信息,密码姓名头像等等。

登录注册模块

可视化模块

图像检测模块

-

YOLO模型集成 (v8/v10/v11/v12)

-

DeepSeek多模态分析

-

支持格式:JPG/PNG/MP4/RTSP

视频检测模块

实时检测模块

图片识别记录管理

视频识别记录管理

摄像头识别记录管理

用户管理模块

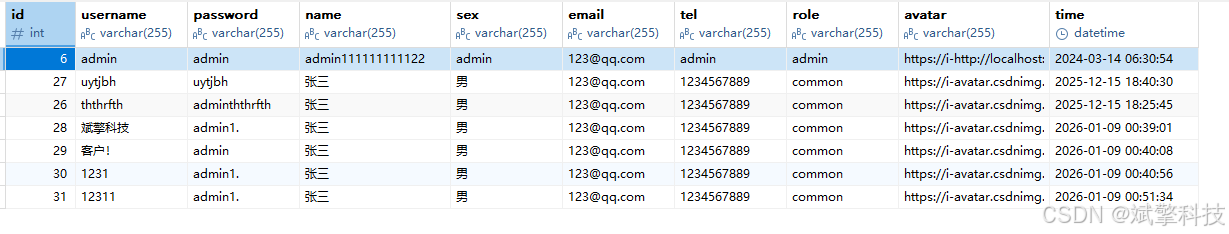

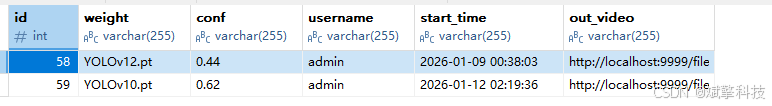

数据管理模块(MySQL表设计)

-

users- 用户信息表

-

imgrecords- 图片检测记录表

-

videorecords- 视频检测记录表

-

camerarecords- 摄像头检测记录表

模型训练结果

#coding:utf-8

#根据实际情况更换模型

# yolon.yaml (nano):轻量化模型,适合嵌入式设备,速度快但精度略低。

# yolos.yaml (small):小模型,适合实时任务。

# yolom.yaml (medium):中等大小模型,兼顾速度和精度。

# yolob.yaml (base):基本版模型,适合大部分应用场景。

# yolol.yaml (large):大型模型,适合对精度要求高的任务。

from ultralytics import YOLO

model_path = 'pt/yolo12s.pt'

data_path = 'data.yaml'

if __name__ == '__main__':

model = YOLO(model_path)

results = model.train(data=data_path,

epochs=500,

batch=64,

device='0',

workers=0,

project='runs',

name='exp',

)

YOLO概述

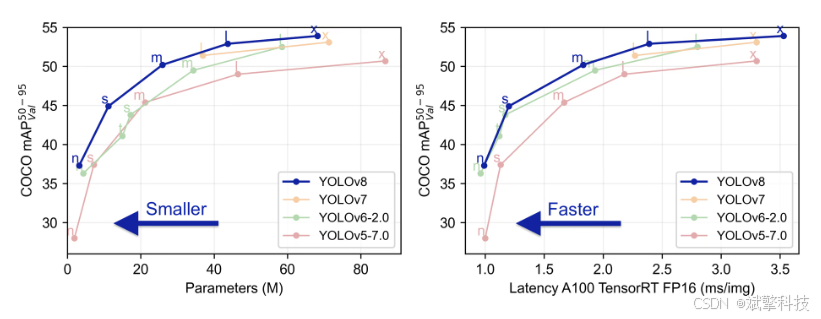

YOLOv8

YOLOv8 由 Ultralytics 于 2023 年 1 月 10 日发布,在准确性和速度方面提供了尖端性能。基于先前 YOLO 版本的进步,YOLOv8 引入了新功能和优化,使其成为各种应用中目标检测任务的理想选择。

YOLOv8 的主要特性

- 高级骨干和颈部架构: YOLOv8 采用最先进的骨干和颈部架构,从而改进了特征提取和目标检测性能。

- 无锚点分离式 Ultralytics Head: YOLOv8 采用无锚点分离式 Ultralytics head,与基于锚点的方法相比,这有助于提高准确性并提高检测效率。

- 优化的准确性-速度权衡: YOLOv8 专注于在准确性和速度之间保持最佳平衡,适用于各种应用领域中的实时对象检测任务。

- 丰富的预训练模型: YOLOv8提供了一系列预训练模型,以满足各种任务和性能要求,使您更容易为特定用例找到合适的模型。

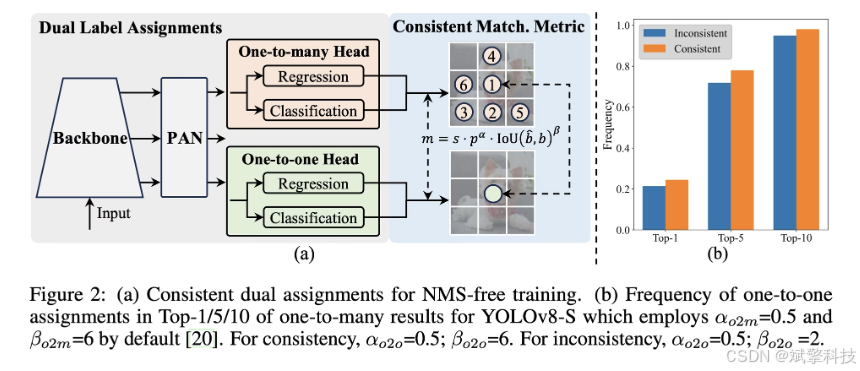

YOLOv10

YOLOv10 由 清华大学研究人员基于 Ultralytics Python构建,引入了一种新的实时目标检测方法,解决了先前 YOLO 版本中存在的后处理和模型架构缺陷。通过消除非极大值抑制 (NMS) 并优化各种模型组件,YOLOv10 以显著降低的计算开销实现了最先进的性能。大量实验表明,它在多个模型尺度上都具有卓越的精度-延迟权衡。

概述

实时目标检测旨在以低延迟准确预测图像中的对象类别和位置。YOLO 系列因其在性能和效率之间的平衡而一直处于这项研究的前沿。然而,对 NMS 的依赖和架构效率低下阻碍了最佳性能。YOLOv10 通过引入用于无 NMS 训练的一致双重分配和整体效率-准确性驱动的模型设计策略来解决这些问题。

架构

YOLOv10 的架构建立在之前 YOLO 模型优势的基础上,同时引入了几项关键创新。该模型架构由以下组件组成:

- 骨干网络:负责特征提取,YOLOv10 中的骨干网络使用增强版的 CSPNet (Cross Stage Partial Network),以改善梯度流并减少计算冗余。

- Neck:Neck 的设计目的是聚合来自不同尺度的特征,并将它们传递到 Head。它包括 PAN(路径聚合网络)层,用于有效的多尺度特征融合。

- One-to-Many Head:在训练期间为每个对象生成多个预测,以提供丰富的监督信号并提高学习准确性。

- 一对一头部:在推理时为每个对象生成一个最佳预测,以消除对NMS的需求,从而降低延迟并提高效率。

主要功能

- 免NMS训练:利用一致的双重分配来消除对NMS的需求,从而降低推理延迟。

- 整体模型设计:从效率和准确性的角度对各种组件进行全面优化,包括轻量级分类 Head、空间通道解耦下采样和秩引导块设计。

- 增强的模型功能: 结合了大内核卷积和部分自注意力模块,以提高性能,而无需显着的计算成本。

YOLOv11

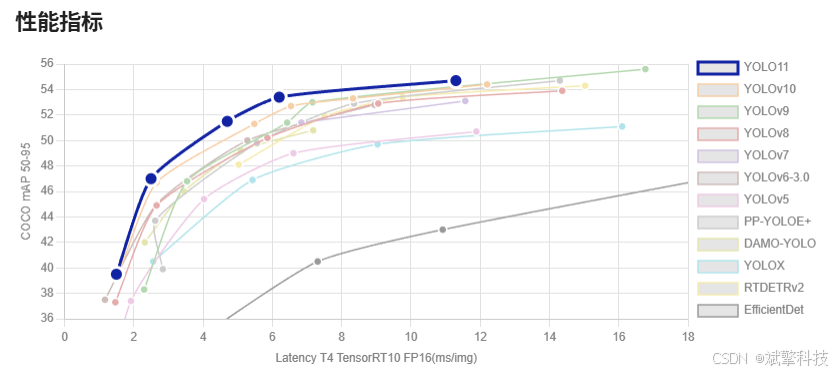

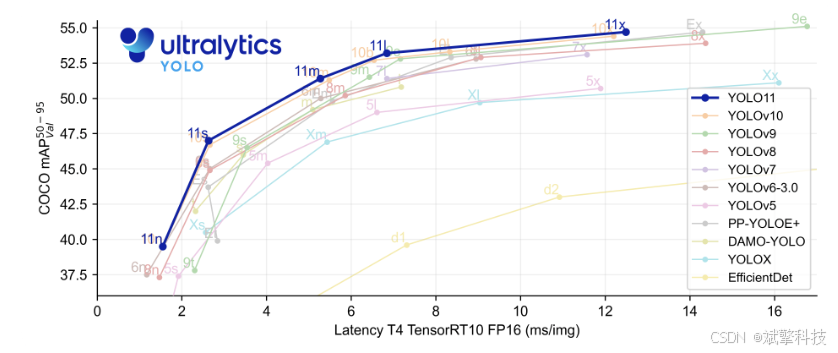

YOLO11 是 Ultralytics YOLO 系列实时目标检测器的最新迭代版本,它以前沿的精度、速度和效率重新定义了可能性。YOLO11 在之前 YOLO 版本的显著进步基础上,在架构和训练方法上进行了重大改进,使其成为各种计算机视觉任务的多功能选择。

主要功能

- 增强的特征提取: YOLO11 采用改进的 backbone 和 neck 架构,从而增强了特征提取能力,以实现更精确的目标检测和复杂的任务性能。

- 优化效率和速度: YOLO11 引入了改进的架构设计和优化的训练流程,从而提供更快的处理速度,并在精度和性能之间保持最佳平衡。

- 更高精度,更少参数: 随着模型设计的进步,YOLO11m 在 COCO 数据集上实现了更高的 平均精度均值(mAP),同时比 YOLOv8m 少用 22% 的参数,在不牺牲精度的情况下提高了计算效率。

- 跨环境的适应性: YOLO11 可以无缝部署在各种环境中,包括边缘设备、云平台和支持 NVIDIA GPU 的系统,从而确保最大的灵活性。

- 广泛支持的任务范围: 无论是目标检测、实例分割、图像分类、姿势估计还是旋转框检测 (OBB),YOLO11 都旨在满足各种计算机视觉挑战。

Ultralytics YOLO11 在其前代产品的基础上进行了多项重大改进。主要改进包括:

- 增强的特征提取: YOLO11 采用了改进的骨干网络和颈部架构,增强了特征提取能力,从而实现更精确的目标检测。

- 优化的效率和速度: 改进的架构设计和优化的训练流程提供了更快的处理速度,同时保持了准确性和性能之间的平衡。

- 更高精度,更少参数: YOLO11m 在 COCO 数据集上实现了更高的平均 精度均值 (mAP),同时比 YOLOv8m 少用 22% 的参数,在不牺牲精度的情况下提高了计算效率。

- 跨环境的适应性: YOLO11 可以部署在各种环境中,包括边缘设备、云平台和支持 NVIDIA GPU 的系统。

- 广泛支持的任务范围: YOLO11 支持各种计算机视觉任务,例如目标检测、实例分割、图像分类、姿势估计和旋转框检测 (OBB)。

YOLOv12

YOLO12引入了一种以注意力为中心的架构,它不同于之前YOLO模型中使用的传统基于CNN的方法,但仍保持了许多应用所需的实时推理速度。该模型通过在注意力机制和整体网络架构方面的新颖方法创新,实现了最先进的目标检测精度,同时保持了实时性能。尽管有这些优势,YOLO12仍然是一个社区驱动的版本,由于其沉重的注意力模块,可能表现出训练不稳定、内存消耗增加和CPU吞吐量较慢的问题,因此Ultralytics仍然建议将YOLO11用于大多数生产工作负载。

主要功能

- 区域注意力机制: 一种新的自注意力方法,可以有效地处理大型感受野。它将 特征图 分成 l 个大小相等的区域(默认为 4 个),水平或垂直,避免复杂的运算并保持较大的有效感受野。与标准自注意力相比,这大大降低了计算成本。

- 残差高效层聚合网络(R-ELAN):一种基于 ELAN 的改进的特征聚合模块,旨在解决优化挑战,尤其是在更大规模的以注意力为中心的模型中。R-ELAN 引入:

- 具有缩放的块级残差连接(类似于层缩放)。

- 一种重新设计的特征聚合方法,创建了一个类似瓶颈的结构。

- 优化的注意力机制架构:YOLO12 精简了标准注意力机制,以提高效率并与 YOLO 框架兼容。这包括:

- 使用 FlashAttention 来最大限度地减少内存访问开销。

- 移除位置编码,以获得更简洁、更快速的模型。

- 调整 MLP 比率(从典型的 4 调整到 1.2 或 2),以更好地平衡注意力和前馈层之间的计算。

- 减少堆叠块的深度以改进优化。

- 利用卷积运算(在适当的情况下)以提高其计算效率。

- 在注意力机制中添加一个7x7可分离卷积(“位置感知器”),以隐式地编码位置信息。

- 全面的任务支持: YOLO12 支持一系列核心计算机视觉任务:目标检测、实例分割、图像分类、姿势估计和旋转框检测 (OBB)。

- 增强的效率: 与许多先前的模型相比,以更少的参数实现了更高的准确率,从而证明了速度和准确率之间更好的平衡。

- 灵活部署: 专为跨各种平台部署而设计,从边缘设备到云基础设施。

主要改进

-

增强的 特征提取:

- 区域注意力: 有效处理大型感受野,降低计算成本。

- 优化平衡: 改进了注意力和前馈网络计算之间的平衡。

- R-ELAN:使用 R-ELAN 架构增强特征聚合。

-

优化创新:

- 残差连接:引入具有缩放的残差连接以稳定训练,尤其是在较大的模型中。

- 改进的特征集成:在 R-ELAN 中实现了一种改进的特征集成方法。

- FlashAttention: 整合 FlashAttention 以减少内存访问开销。

-

架构效率:

- 减少参数:与之前的许多模型相比,在保持或提高准确性的同时,实现了更低的参数计数。

- 简化的注意力机制:使用简化的注意力实现,避免了位置编码。

- 优化的 MLP 比率:调整 MLP 比率以更有效地分配计算资源。

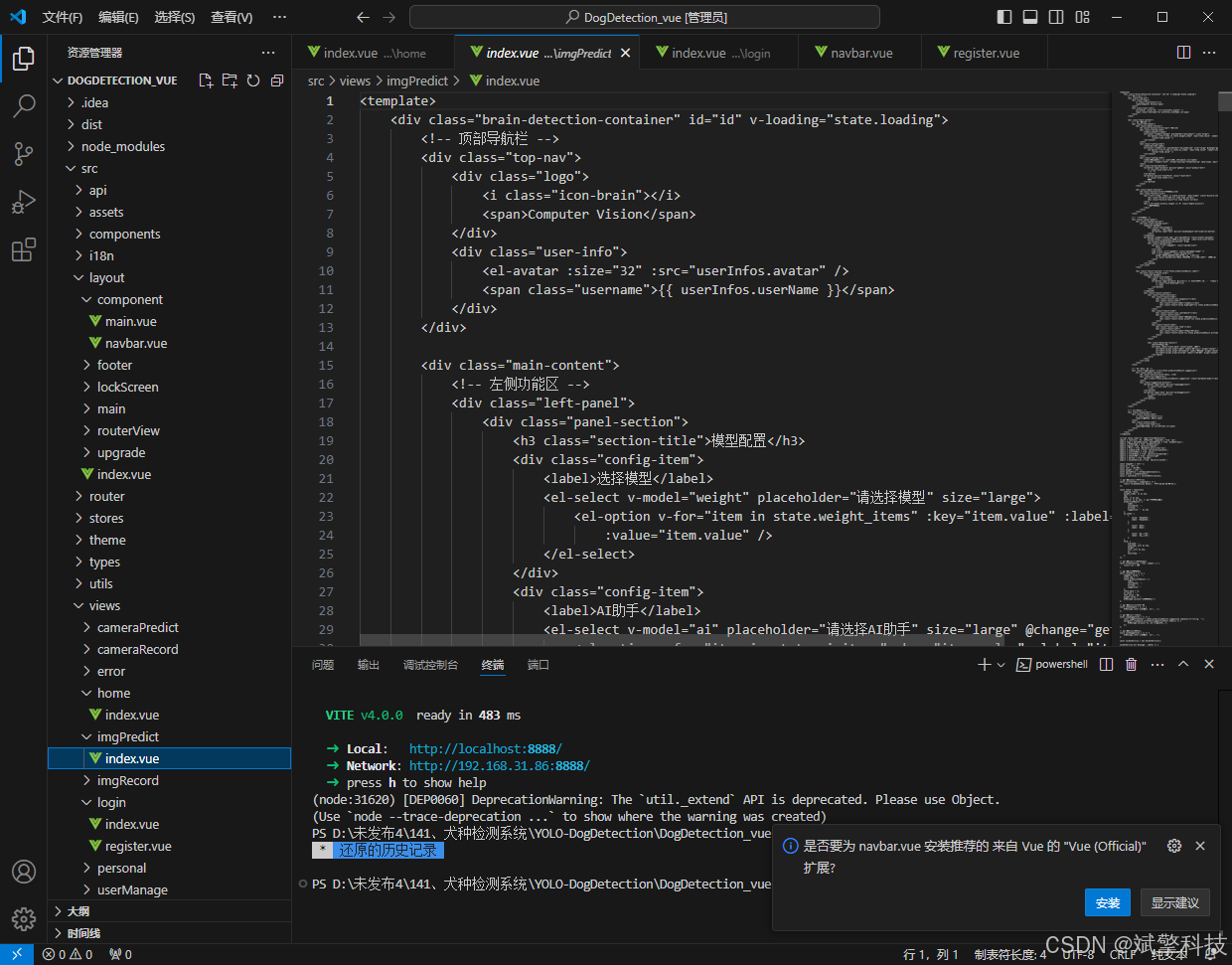

前端代码展示

图片检测界面一小部分代码:

<template>

<div class="brain-detection-container" id="id" v-loading="state.loading">

<!-- 顶部导航栏 -->

<div class="top-nav">

<div class="logo">

<i class="icon-brain"></i>

<span>Computer Vision</span>

</div>

<div class="user-info">

<el-avatar :size="32" :src="userInfos.avatar" />

<span class="username">{{ userInfos.userName }}</span>

</div>

</div>

<div class="main-content">

<!-- 左侧功能区 -->

<div class="left-panel">

<div class="panel-section">

<h3 class="section-title">模型配置</h3>

<div class="config-item">

<label>选择模型</label>

<el-select v-model="weight" placeholder="请选择模型" size="large">

<el-option v-for="item in state.weight_items" :key="item.value" :label="item.label"

:value="item.value" />

</el-select>

</div>

<div class="config-item">

<label>AI助手</label>

<el-select v-model="ai" placeholder="请选择AI助手" size="large" @change="getData">

<el-option v-for="item in state.ai_items" :key="item.value" :label="item.label"

:value="item.value" />

</el-select>

</div>

<div class="config-item">

<label>置信度阈值: {{ (conf/100).toFixed(2) }}</label>

<el-slider v-model="conf" :format-tooltip="formatTooltip" show-stops :max="100" :step="5" />

</div>

<div class="action-buttons">

<el-button type="primary" @click="upData" class="predict-btn">

<i class="icon-scan"></i>

开始检测

</el-button>

<el-button @click="resetForm" class="reset-btn">

<i class="icon-reset"></i>

重置

</el-button>

</div>

</div>

<div class="panel-section">

<h3 class="section-title">历史记录</h3>

<div class="history-list">

<div v-for="(item, index) in state.history" :key="index" class="history-item">

<div class="history-time">{{ item.time }}</div>

<div class="history-result">{{ item.result }}</div>

</div>

<div v-if="state.history.length === 0" class="empty-history">

暂无历史记录

</div>

</div>

</div>

</div>

<!-- 中间内容区 -->

<div class="center-panel">

<div class="upload-section">

<el-card class="upload-card">

<template #header>

<div class="card-header">

<span>上传图片</span>

<el-button type="text" @click="showExample">查看示例</el-button>

</div>

</template>

<el-upload v-model="state.img" ref="uploadFile" class="avatar-uploader"

action="http://localhost:9999/files/upload" :show-file-list="false"

:on-success="handleAvatarSuccessone" drag>

<div class="upload-area">

<el-icon v-if="!imageUrl" class="upload-icon">

<Plus />

</el-icon>

<img v-else :src="imageUrl" class="uploaded-image" />

<div v-if="!imageUrl" class="upload-text">

<p>将图片拖拽到此处,或<em>点击上传</em></p>

<p class="upload-tip">支持 JPG、PNG 格式,大小不超过 10MB</p>

</div>

</div>

</el-upload>

</el-card>

</div>

<div class="result-section" v-if="state.predictionResult.label">

<el-card class="result-card">

<template #header>

<div class="card-header">

<span>检测结果</span>

<el-button type="primary" @click="() => htmlToPDF('id', '检测报告')" size="small">

<i class="icon-download"></i>

导出报告

</el-button>

</div>

</template>

<div class="result-content">

<div class="result-overview">

<div class="result-item">

<div class="result-icon diagnosis"></div>

<div class="result-info">

<div class="result-label">诊断结果</div>

<div class="result-value highlight">{{ state.predictionResult.label || '-' }}</div>

</div>

</div>

<div class="result-item">

<div class="result-icon confidence"></div>

<div class="result-info">

<div class="result-label">置信度</div>

<div class="result-value accent">{{ state.predictionResult.confidence || '-' }}</div>

</div>

</div>

<div class="result-item">

<div class="result-icon time"></div>

<div class="result-info">

<div class="result-label">分析用时</div>

<div class="result-value">{{ state.predictionResult.allTime ? `${state.predictionResult.allTime}` : '-' }}</div>

</div>

</div>

</div>

<div class="detailed-results">

<h4>详细分析</h4>

<el-table :data="state.data" style="width: 100%">

<el-table-column prop="label" label="预测结果" align="center" />

<el-table-column prop="confidence" label="置信度" align="center" />

<el-table-column prop="allTime" label="用时(秒)" align="center" />

</el-table>

</div>

</div>

</el-card>

</div>

</div>

<!-- 右侧AI建议区 -->

<div class="right-panel" v-if="state.predictionResult.suggestion">

<div class="panel-section">

<h3 class="section-title">AI建议</h3>

<div class="ai-suggestion">

<div v-html="state.predictionResult.suggestion" class="markdown-body"></div>

</div>

<div class="suggestion-actions">

<el-button type="text" @click="copySuggestion">

<i class="icon-copy"></i>

复制建议

</el-button>

<el-button type="text" @click="saveSuggestion">

<i class="icon-save"></i>

保存建议

</el-button>

</div>

</div>

</div>

</div>

<!-- 底部状态栏 -->

<div class="status-bar">

<div class="status-item">

<i class="icon-status"></i>

<span>系统状态: 正常</span>

</div>

<div class="status-item">

<i class="icon-time"></i>

<span>最后更新: {{ currentTime }}</span>

</div>

</div>

</div>

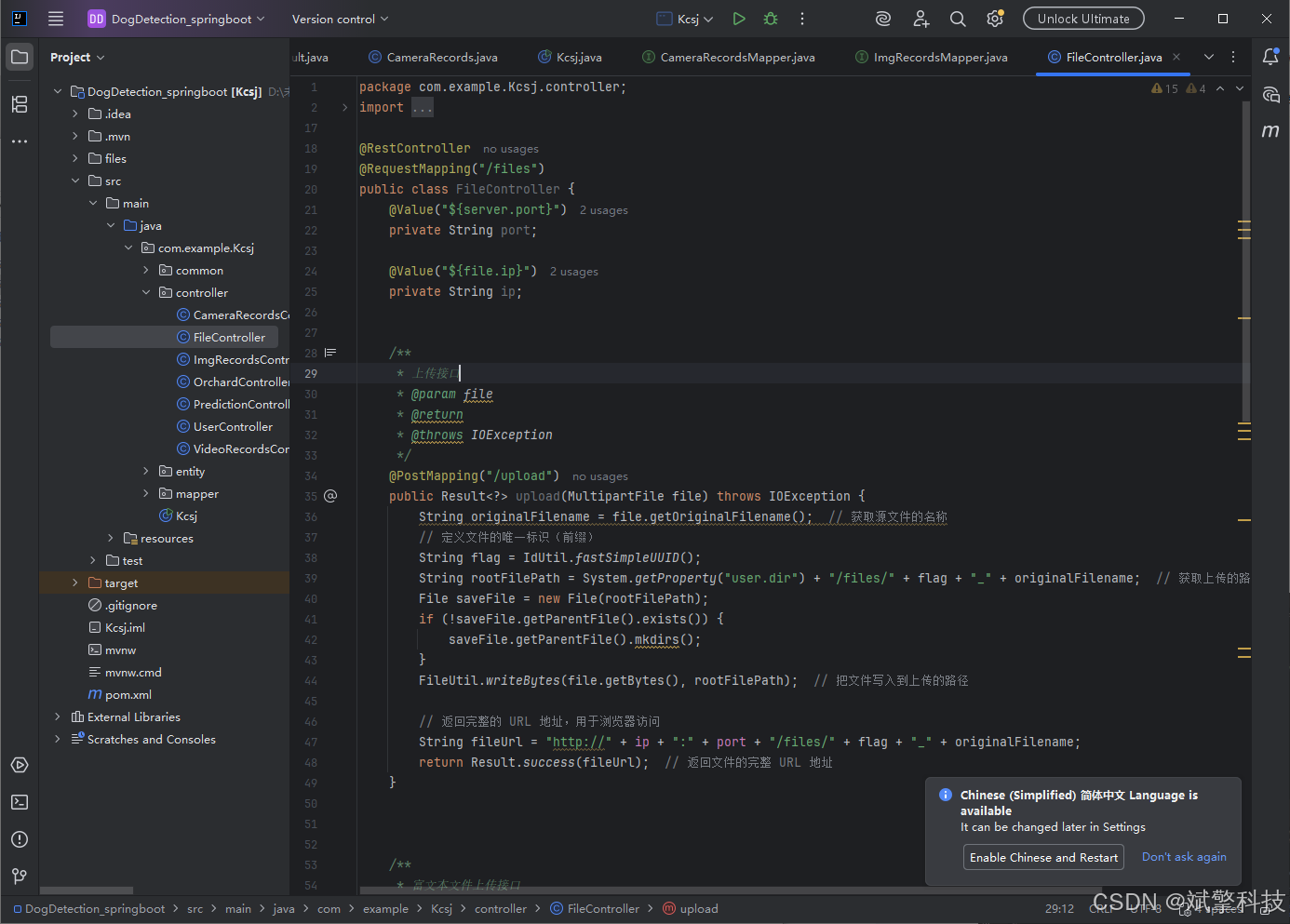

</template>后端代码展示

详细功能展示视频

基于YOLO和千问|DeepSeek的犬种识别检测系统(web界面+YOLOv8/YOLOv10/YOLOv11/YOLOv12+深度学习+python)_哔哩哔哩_bilibili

基于YOLO和千问|DeepSeek的犬种识别检测系统(web界面+YOLOv8/YOLOv10/YOLOv11/YOLOv12+深度学习+python)_哔哩哔哩_bilibili

https://www.bilibili.com/video/BV1afc4zDErD/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献256条内容

已为社区贡献256条内容

所有评论(0)